Périphériques technologiques

Périphériques technologiques

IA

IA

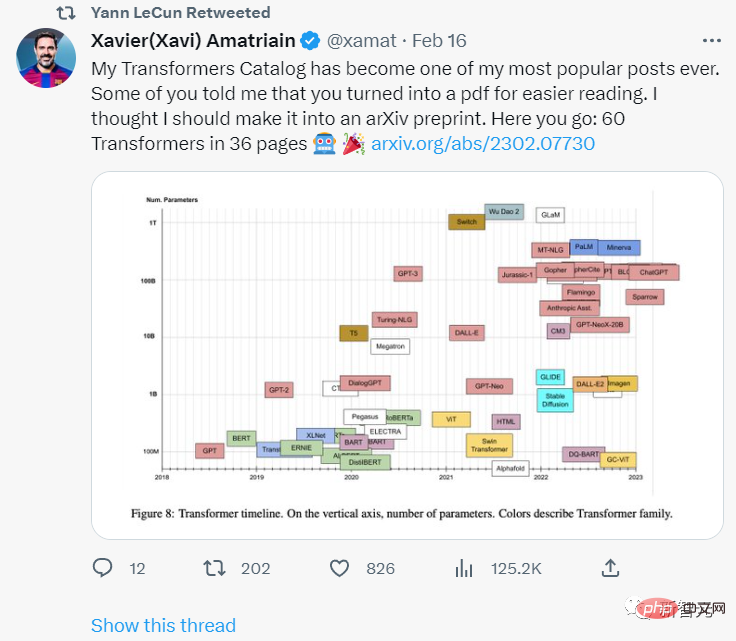

La collection de Transformers la plus complète de l'histoire ! LeCun recommande : Créez un catalogue de 60 modèles. Quel papier avez-vous manqué ?

La collection de Transformers la plus complète de l'histoire ! LeCun recommande : Créez un catalogue de 60 modèles. Quel papier avez-vous manqué ?

La collection de Transformers la plus complète de l'histoire ! LeCun recommande : Créez un catalogue de 60 modèles. Quel papier avez-vous manqué ?

S'il y a quelque chose qui a soutenu le développement de modèles à grande échelle ces dernières années, c'est bien Transformer !

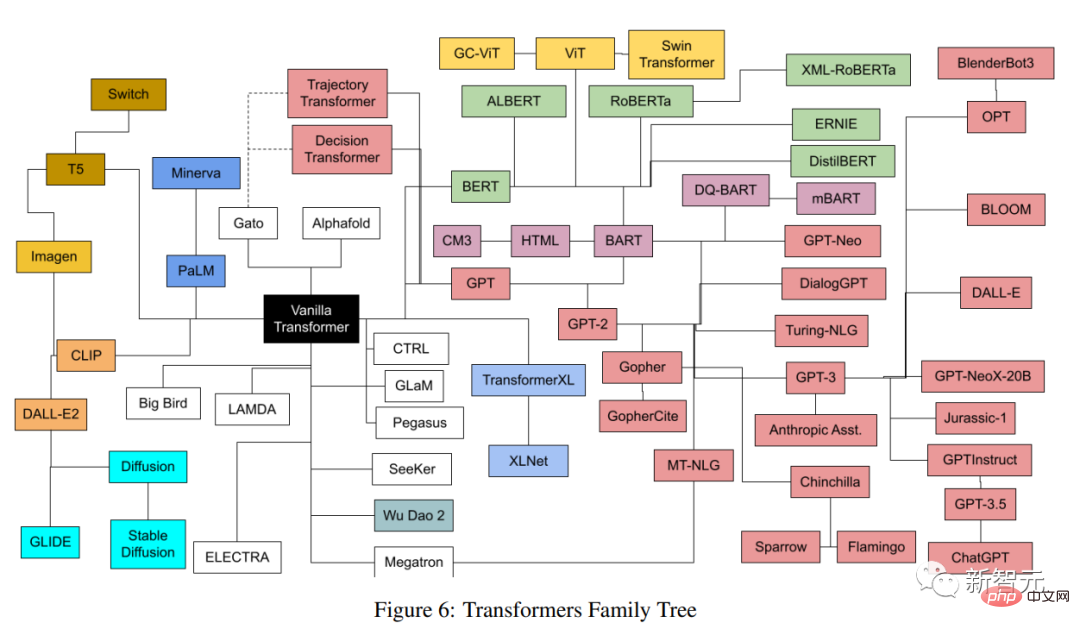

Basé sur Transformer, un grand nombre de modèles surgissent dans divers domaines. Chaque modèle a une architecture différente, des détails différents et un nom difficile à expliquer.

Récemment, un auteur a procédé à une classification et indexation complètes de tous les modèles Transformer populaires sortis ces dernières années et a fourni un catalogue complet mais simple autant que possible. Innovation du transformateur et examen de son historique de développement. Yann LeCun, lauréat du prix Turing, a exprimé son approbation.

L'auteur de l'article, Xavier (Xavi) Amatriain, a obtenu un doctorat de l'Université Pompeu Fabra en Espagne en 2005. Il est actuellement vice-président de l'ingénierie chez LinkedIn, principalement responsable des produits artificiels stratégie de renseignement.

Qu'est-ce que Transformer ?

Transformer est un type de modèle d'apprentissage profond doté de caractéristiques architecturales uniques. Il est apparu pour la première fois dans le célèbre article « Attention is All you Need » publié par les chercheurs de Google en 2017. Cet article a accumulé de nombreuses données en seulement 5 ans. un chiffre stupéfiant de 38 000 citations.

Transformer est un type de modèle d'apprentissage profond doté de caractéristiques architecturales uniques. Il est apparu pour la première fois dans le célèbre article « Attention is All you Need » publié par les chercheurs de Google en 2017. Cet article a accumulé de nombreuses données en seulement 5 ans. un chiffre stupéfiant de 38 000 citations.

L'architecture du transformateur appartient également au modèle encodeur-décodeur (encodeur-décodeur), mais dans les modèles précédents, l'attention n'était qu'un des mécanismes, dont la plupart étaient basés sur LSTM (mémoire longue à court terme) et autres RNN (Réseau neuronal récurrent).

Un aperçu clé de l'article qui propose Transformer est que, comme le titre l'indique, le mécanisme d'attention peut être utilisé comme le seul mécanisme pour dériver les dépendances entre les entrées et les sorties. Cet article n'a pas l'intention d'entrer dans tous les détails. de l'architecture Transformer. Les amis intéressés peuvent effectuer une recherche sur le blog "The Illustrated Transformer".

Lien du blog : https://jalammar.github.io/illustrated-transformer/

Seuls certains des composants les plus importants sont brièvement décrits ci-dessous.

Architecture codeur-décodeur

Architecture codeur-décodeur

Une architecture générale d'encodeur/décodeur se compose de deux modèles, l'encodeur prend l'entrée et l'encode dans un vecteur de longueur fixe ; le décodeur reçoit ce vecteur et le décode en une séquence de sortie.

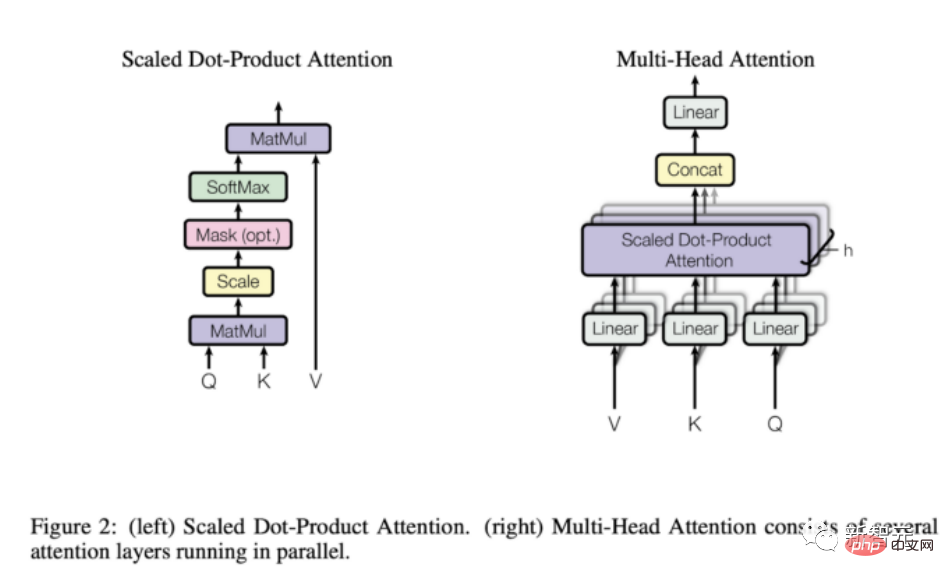

L'encodeur et le décodeur sont formés conjointement pour minimiser la vraisemblance conditionnelle du journal. Une fois entraîné, l'encodeur/décodeur peut générer une sortie basée sur une séquence d'entrée donnée, ou il peut évaluer une paire de séquences d'entrée/sortie. Sous l'architecture originale du Transformer, l'encodeur et le décodeur ont 6 couches identiques. Dans chacune de ces 6 couches, l'encodeur a deux sous-couches : une couche d'attention multi-têtes et un simple réseau de rétroaction, chaque sous-couche. la couche a une connexion résiduelle et une normalisation de couche. La taille de sortie de l'encodeur est de 512, et le décodeur ajoute une troisième sous-couche, qui est une autre couche d'attention multi-têtes sur la sortie de l'encodeur. De plus, une autre couche multi-têtes dans le décodeur est masquée pour empêcher les fuites d'informations d'attirer l'attention sur les positions suivantes. Mécanisme d'attention Comme le montre la description ci-dessus, le seul élément « étrange » dans la structure du modèle est l'attention des taureaux, qui est la pleine puissance du emplacement du modèle. La fonction d'attention est un mappage entre la requête et un ensemble de paires clé-valeur vers la sortie. La sortie est calculée comme une somme pondérée de valeurs, où le poids attribué à chaque valeur est déterminé par la fonction de compatibilité du. requête et la clé correspondante Calculée. Transformer utilise l'attention multi-têtes, qui est le calcul parallèle d'un ensemble de fonctions d'attention, également connu sous le nom de mise à l'échelle de l'attention du produit scalaire. Par rapport aux réseaux récurrents et convolutifs, la couche d'attention présente plusieurs avantages, les plus importants étant sa moindre complexité informatique et sa connectivité plus élevée, ce qui est particulièrement utile pour apprendre les dépendances à long terme dans les séquences.

Que peut faire Transformer ? Pourquoi est-il devenu populaire ?

Le Transformer original a été conçu pour la traduction de langues, principalement de l'anglais vers l'allemand, mais les résultats expérimentaux de la première version de l'article ont montré que l'architecture peut être bien généralisée à d'autres tâches linguistiques.

Cette tendance particulière a été rapidement remarquée par la communauté des chercheurs.

Dans les prochains mois, le classement de toutes les tâches ML liées au langage sera entièrement occupé par une certaine version de l'architecture Transformer. Par exemple, la tâche de questions et réponses Squad a été rapidement éliminée par divers modèles Transformer.

L'une des principales raisons pour lesquelles Transofrmer peut occuper si rapidement la plupart des classements PNL est : sa capacité à s'adapter rapidement à d'autres tâches, à savoir l'apprentissage par transfert. Les modèles Transformer pré-entraînés peuvent être adaptés très facilement et rapidement s'ils ne sont pas utilisés ; Les tâches entraînées présentent d'énormes avantages par rapport aux autres modèles.

En tant que praticien du ML, vous n'avez plus besoin de former un grand modèle à partir de zéro sur un énorme ensemble de données, vous pouvez simplement réutiliser le modèle pré-entraîné sur la tâche à accomplir, peut-être juste avec des données beaucoup plus petites. Ajustez-le légèrement.

La technique spécifique utilisée pour adapter les modèles pré-entraînés à différentes tâches est ce qu'on appelle le réglage fin.

Il s'avère que les Transformers sont si adaptables à d'autres tâches que, bien qu'ils aient été développés à l'origine pour des tâches liées au langage, ils sont rapidement devenus utiles pour d'autres tâches, depuis les applications visuelles ou audio et musicales jusqu'à jouer aux échecs ou à faire mathématiques.

Bien sûr, toutes ces applications ne seraient pas possibles sans la myriade d’outils facilement accessibles à toute personne capable d’écrire quelques lignes de code.

Transformer est non seulement rapidement intégré aux principaux frameworks d'intelligence artificielle (c'est-à-dire Pytorch et TensorFlow), mais il existe également certaines entreprises entièrement dédiées à Transformer.

Huggingface, une startup qui a levé plus de 60 millions de dollars à ce jour, a été construite presque entièrement autour de l'idée de commercialiser sa bibliothèque open source Transformer.

GPT-3 est un modèle Transformer lancé par OpenAI en mai 2020 et est une version de suivi de leurs précédents GPT et GPT-2. La société a créé beaucoup de buzz en présentant le modèle dans une prépublication, affirmant que le modèle était si puissant qu'elle n'était pas qualifiée pour le diffuser dans le monde.

De plus, OpenAI non seulement n'a pas publié GPT-3, mais l'a également commercialisé via un très large partenariat avec Microsoft.

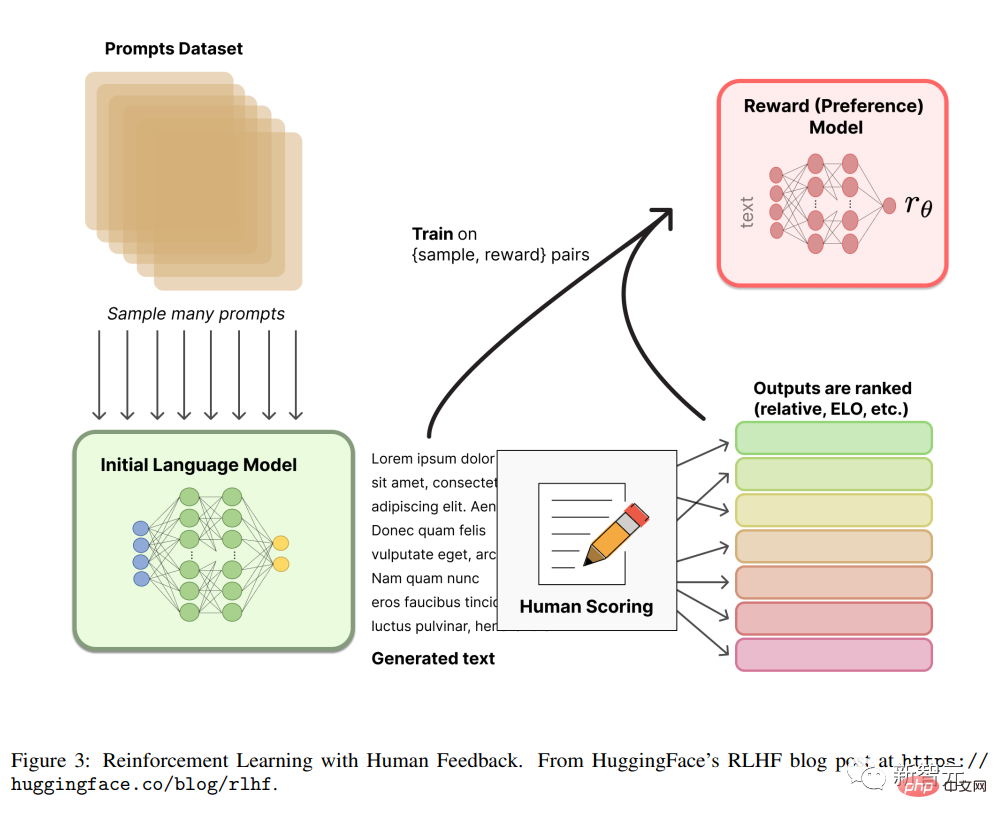

Désormais, GPT-3 fournit un support technique sous-jacent pour plus de 300 applications différentes et constitue le fondement de la stratégie commerciale d'OpenAI. C'est important pour une entreprise qui a reçu plus d'un milliard de dollars de financement. L'apprentissage par renforcement à partir des commentaires (ou préférences) humains, également connu sous le nom de RLHF (ou RLHP), est récemment devenu un énorme ajout à la boîte à outils de l'intelligence artificielle.

Ce concept est issu pour la première fois de l'article de 2017 "Deep Reinforcement Learning from Human Preferences", mais récemment, il a été appliqué à ChatGPT et à des agents conversationnels similaires, obtenant d'assez bons résultats et attirant l'attention du public.

L'idée est très simple, une fois le modèle de langage pré-entraîné, il peut générer différentes réponses à la conversation et permettre aux humains de classer les résultats. Ces classements peuvent être utilisés (c'est-à-dire les préférences) ou des commentaires. ) en utilisant des mécanismes d'apprentissage par renforcement pour entraîner des récompenses.

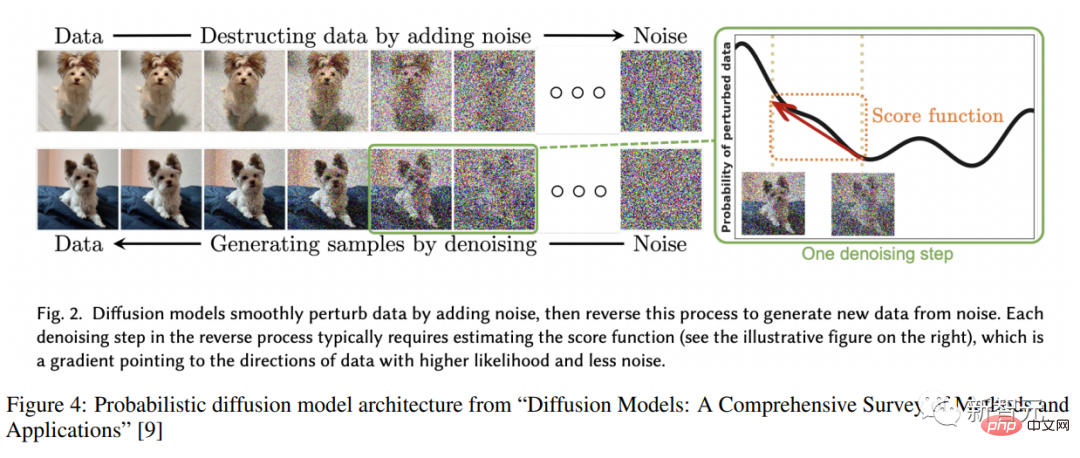

Modèle de diffusion Diffusion

Le modèle de diffusion est devenu le nouveau SOTA pour la génération d'images, et a forte tendance à remplacer les GAN (Generative Adversarial Networks).

Le modèle de diffusion est un type de modèle d'inférence variationnelle à variables latentes entraînées. En pratique, cela signifie entraîner un réseau neuronal profond pour débruiter les images floues par une certaine fonction de bruit.

Un réseau ainsi formé apprend en réalité l'espace latent représenté par ces images.

Après avoir lu l'introduction, commencez le Voyage rétrospectif Transformer !

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Le modèle MoE open source le plus puissant au monde est ici, avec des capacités chinoises comparables à celles du GPT-4, et le prix ne représente que près d'un pour cent de celui du GPT-4-Turbo.

May 07, 2024 pm 04:13 PM

Le modèle MoE open source le plus puissant au monde est ici, avec des capacités chinoises comparables à celles du GPT-4, et le prix ne représente que près d'un pour cent de celui du GPT-4-Turbo.

May 07, 2024 pm 04:13 PM

Imaginez un modèle d'intelligence artificielle qui non seulement a la capacité de surpasser l'informatique traditionnelle, mais qui permet également d'obtenir des performances plus efficaces à moindre coût. Ce n'est pas de la science-fiction, DeepSeek-V2[1], le modèle MoE open source le plus puissant au monde est ici. DeepSeek-V2 est un puissant mélange de modèle de langage d'experts (MoE) présentant les caractéristiques d'une formation économique et d'une inférence efficace. Il est constitué de 236B paramètres, dont 21B servent à activer chaque marqueur. Par rapport à DeepSeek67B, DeepSeek-V2 offre des performances plus élevées, tout en économisant 42,5 % des coûts de formation, en réduisant le cache KV de 93,3 % et en augmentant le débit de génération maximal à 5,76 fois. DeepSeek est une entreprise explorant l'intelligence artificielle générale

L'IA bouleverse la recherche mathématique ! Le lauréat de la médaille Fields et mathématicien sino-américain a dirigé 11 articles les mieux classés | Aimé par Terence Tao

Apr 09, 2024 am 11:52 AM

L'IA bouleverse la recherche mathématique ! Le lauréat de la médaille Fields et mathématicien sino-américain a dirigé 11 articles les mieux classés | Aimé par Terence Tao

Apr 09, 2024 am 11:52 AM

L’IA change effectivement les mathématiques. Récemment, Tao Zhexuan, qui a prêté une attention particulière à cette question, a transmis le dernier numéro du « Bulletin de l'American Mathematical Society » (Bulletin de l'American Mathematical Society). En se concentrant sur le thème « Les machines changeront-elles les mathématiques ? », de nombreux mathématiciens ont exprimé leurs opinions. L'ensemble du processus a été plein d'étincelles, intense et passionnant. L'auteur dispose d'une équipe solide, comprenant Akshay Venkatesh, lauréat de la médaille Fields, le mathématicien chinois Zheng Lejun, l'informaticien de l'Université de New York Ernest Davis et de nombreux autres universitaires bien connus du secteur. Le monde de l’IA a radicalement changé. Vous savez, bon nombre de ces articles ont été soumis il y a un an.

KAN, qui remplace MLP, a été étendu à la convolution par des projets open source

Jun 01, 2024 pm 10:03 PM

KAN, qui remplace MLP, a été étendu à la convolution par des projets open source

Jun 01, 2024 pm 10:03 PM

Plus tôt ce mois-ci, des chercheurs du MIT et d'autres institutions ont proposé une alternative très prometteuse au MLP – KAN. KAN surpasse MLP en termes de précision et d’interprétabilité. Et il peut surpasser le MLP fonctionnant avec un plus grand nombre de paramètres avec un très petit nombre de paramètres. Par exemple, les auteurs ont déclaré avoir utilisé KAN pour reproduire les résultats de DeepMind avec un réseau plus petit et un degré d'automatisation plus élevé. Plus précisément, le MLP de DeepMind compte environ 300 000 paramètres, tandis que le KAN n'en compte qu'environ 200. KAN a une base mathématique solide comme MLP est basé sur le théorème d'approximation universelle, tandis que KAN est basé sur le théorème de représentation de Kolmogorov-Arnold. Comme le montre la figure ci-dessous, KAN a

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas entre officiellement dans l’ère des robots électriques ! Hier, l'Atlas hydraulique s'est retiré "en larmes" de la scène de l'histoire. Aujourd'hui, Boston Dynamics a annoncé que l'Atlas électrique était au travail. Il semble que dans le domaine des robots humanoïdes commerciaux, Boston Dynamics soit déterminé à concurrencer Tesla. Après la sortie de la nouvelle vidéo, elle a déjà été visionnée par plus d’un million de personnes en seulement dix heures. Les personnes âgées partent et de nouveaux rôles apparaissent. C'est une nécessité historique. Il ne fait aucun doute que cette année est l’année explosive des robots humanoïdes. Les internautes ont commenté : Les progrès des robots ont fait ressembler la cérémonie d'ouverture de cette année à des êtres humains, et le degré de liberté est bien plus grand que celui des humains. Mais n'est-ce vraiment pas un film d'horreur ? Au début de la vidéo, Atlas est allongé calmement sur le sol, apparemment sur le dos. Ce qui suit est à couper le souffle

Google est ravi : les performances de JAX surpassent Pytorch et TensorFlow ! Cela pourrait devenir le choix le plus rapide pour la formation à l'inférence GPU

Apr 01, 2024 pm 07:46 PM

Google est ravi : les performances de JAX surpassent Pytorch et TensorFlow ! Cela pourrait devenir le choix le plus rapide pour la formation à l'inférence GPU

Apr 01, 2024 pm 07:46 PM

Les performances de JAX, promu par Google, ont dépassé celles de Pytorch et TensorFlow lors de récents tests de référence, se classant au premier rang sur 7 indicateurs. Et le test n’a pas été fait sur le TPU présentant les meilleures performances JAX. Bien que parmi les développeurs, Pytorch soit toujours plus populaire que Tensorflow. Mais à l’avenir, des modèles plus volumineux seront peut-être formés et exécutés sur la base de la plate-forme JAX. Modèles Récemment, l'équipe Keras a comparé trois backends (TensorFlow, JAX, PyTorch) avec l'implémentation native de PyTorch et Keras2 avec TensorFlow. Premièrement, ils sélectionnent un ensemble de

Nouveaux travaux sur la prédiction de séries chronologiques + grand modèle NLP : générer automatiquement des invites implicites pour la prédiction de séries chronologiques

Mar 18, 2024 am 09:20 AM

Nouveaux travaux sur la prédiction de séries chronologiques + grand modèle NLP : générer automatiquement des invites implicites pour la prédiction de séries chronologiques

Mar 18, 2024 am 09:20 AM

Aujourd'hui, j'aimerais partager un travail de recherche récent de l'Université du Connecticut qui propose une méthode pour aligner les données de séries chronologiques avec de grands modèles de traitement du langage naturel (NLP) sur l'espace latent afin d'améliorer les performances de prévision des séries chronologiques. La clé de cette méthode consiste à utiliser des indices spatiaux latents (invites) pour améliorer la précision des prévisions de séries chronologiques. Titre de l'article : S2IP-LLM : SemanticSpaceInformedPromptLearningwithLLMforTimeSeriesForecasting Adresse de téléchargement : https://arxiv.org/pdf/2403.05798v1.pdf 1. Modèle de fond de problème important

Les robots Tesla travaillent dans les usines, Musk : Le degré de liberté des mains atteindra 22 cette année !

May 06, 2024 pm 04:13 PM

Les robots Tesla travaillent dans les usines, Musk : Le degré de liberté des mains atteindra 22 cette année !

May 06, 2024 pm 04:13 PM

La dernière vidéo du robot Optimus de Tesla est sortie, et il peut déjà fonctionner en usine. À vitesse normale, il trie les batteries (les batteries 4680 de Tesla) comme ceci : Le responsable a également publié à quoi cela ressemble à une vitesse 20 fois supérieure - sur un petit "poste de travail", en sélectionnant et en sélectionnant et en sélectionnant : Cette fois, il est publié L'un des points forts de la vidéo est qu'Optimus réalise ce travail en usine, de manière totalement autonome, sans intervention humaine tout au long du processus. Et du point de vue d'Optimus, il peut également récupérer et placer la batterie tordue, en se concentrant sur la correction automatique des erreurs : concernant la main d'Optimus, le scientifique de NVIDIA Jim Fan a donné une évaluation élevée : la main d'Optimus est l'un des robots à cinq doigts du monde. le plus adroit. Ses mains ne sont pas seulement tactiles

FisheyeDetNet : le premier algorithme de détection de cible basé sur une caméra fisheye

Apr 26, 2024 am 11:37 AM

FisheyeDetNet : le premier algorithme de détection de cible basé sur une caméra fisheye

Apr 26, 2024 am 11:37 AM

La détection de cibles est un problème relativement mature dans les systèmes de conduite autonome, parmi lesquels la détection des piétons est l'un des premiers algorithmes à être déployés. Des recherches très complètes ont été menées dans la plupart des articles. Cependant, la perception de la distance à l’aide de caméras fisheye pour une vue panoramique est relativement moins étudiée. En raison de la distorsion radiale importante, la représentation standard du cadre de délimitation est difficile à mettre en œuvre dans les caméras fisheye. Pour alléger la description ci-dessus, nous explorons les conceptions étendues de boîtes englobantes, d'ellipses et de polygones généraux dans des représentations polaires/angulaires et définissons une métrique de segmentation d'instance mIOU pour analyser ces représentations. Le modèle fisheyeDetNet proposé avec une forme polygonale surpasse les autres modèles et atteint simultanément 49,5 % de mAP sur l'ensemble de données de la caméra fisheye Valeo pour la conduite autonome.