Code : https://github.com/graykode/distribution-is-all-you-need/blob/master/uniform.py

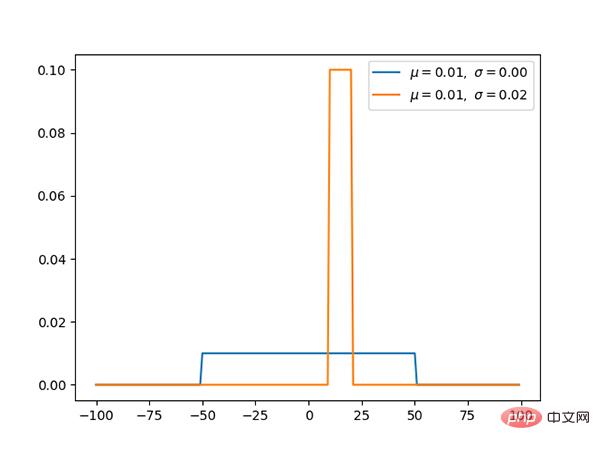

La distribution uniforme a la même valeur de probabilité sur [a, b] et est une distribution de probabilité simple.

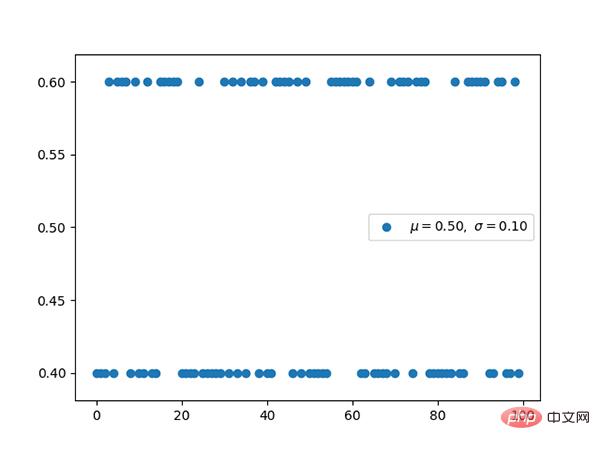

Code : https://github.com/graykode/distribution-is-all-you-need/blob/master/bernoulli.py

Code : https://github.com/graykode/distribution-is-all-you-need/blob/master/binomial.py

Code : https://github.com/graykode/distribution-is-all-you-need/blob/master/categorical.py

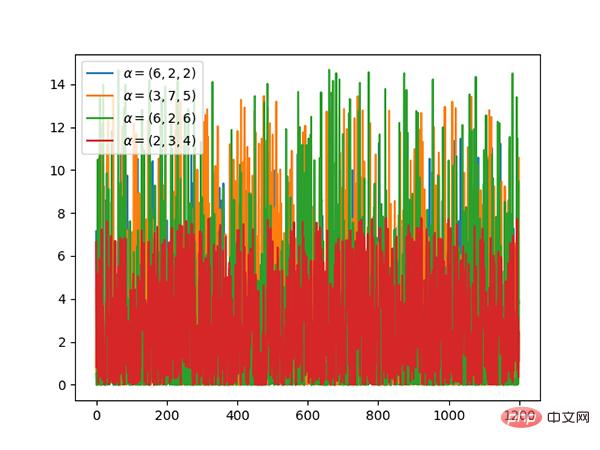

Code : https://github.com/graykode/distribution-is-all-you-need/blob/master/multinomial.py

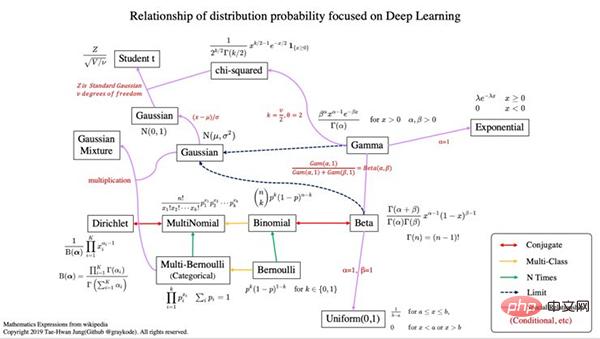

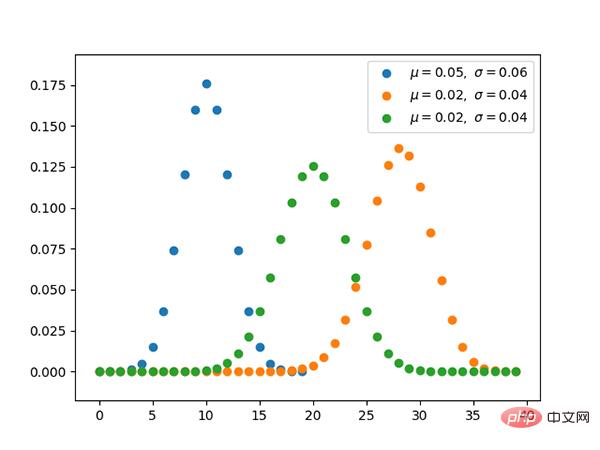

Distribution et classification polynomiales La relation entre les distributions est la même que la relation entre la distribution de Bernoul et la distribution binomiale.

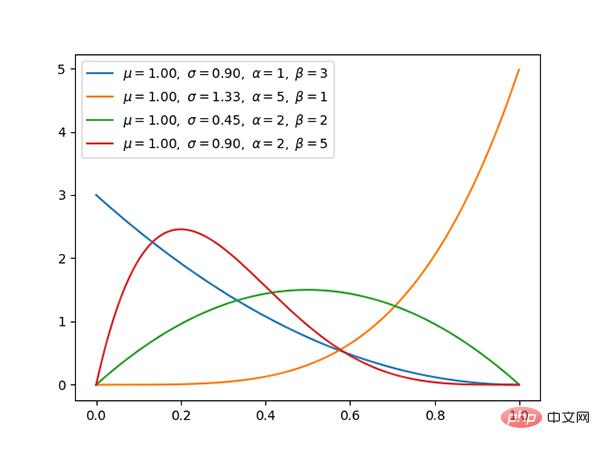

Code : https://github.com/graykode/distribution-is-all-you-need/blob/master/beta.py

Code : https://github.com/graykode/distribution-is-all-you-need/blob/master/dirichlet.py

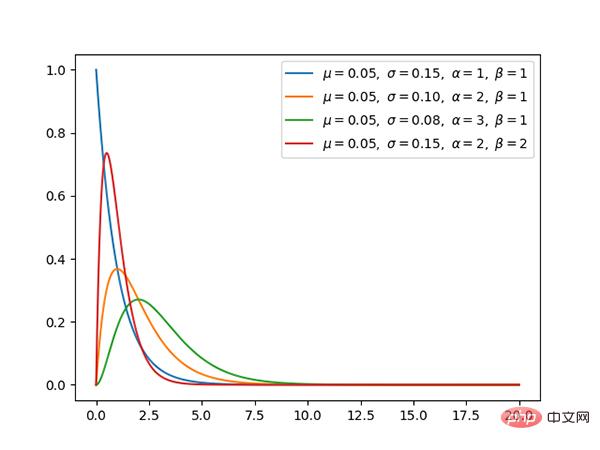

Code : https://github.com/graykode/distribution-is-all-you-need/blob/master/gamma.py

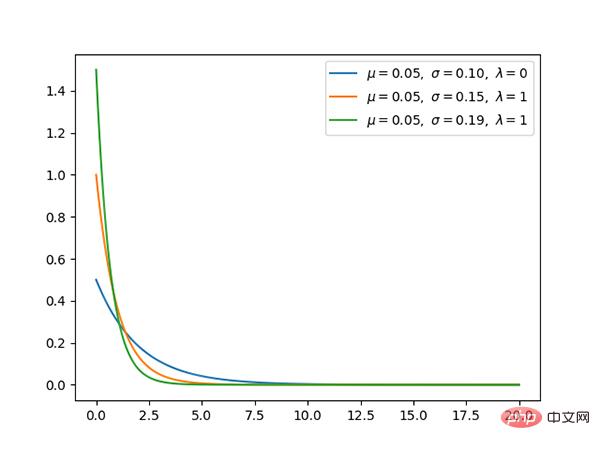

Code : https://github.com/graykode/distribution-is-all-you-need/blob/master/exponential.py

La distribution exponentielle est un cas particulier de la distribution γ lorsque α vaut 1.

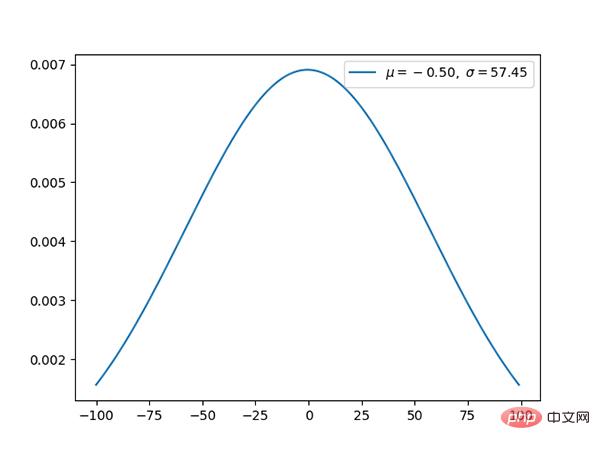

Code : https://github.com/graykode/distribution-is-all-you-need/blob/master/gaussian.py

La distribution gaussienne est une Distribution de probabilité continue très courante.

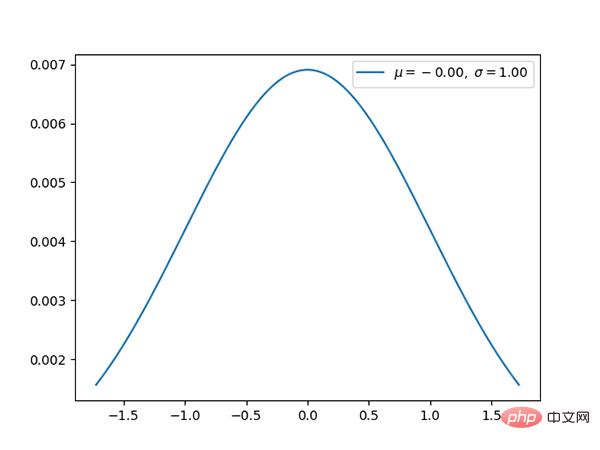

Code : https://github.com/graykode/distribution-is-all-you-need/blob/master/normal.py

La distribution normale est La La distribution gaussienne standard a une moyenne de 0 et un écart type de 1.

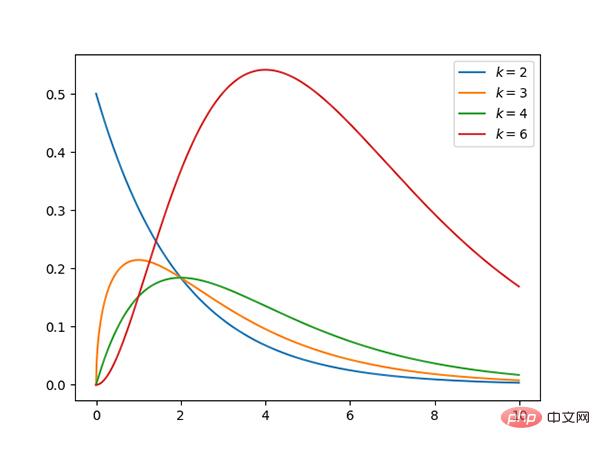

Code : https://github.com/graykode/distribution-is-all-you-need/blob/master/chi-squared.py

Code : https://github.com/graykode/distribution-is-all-you-need/ blob/master /student-t.py

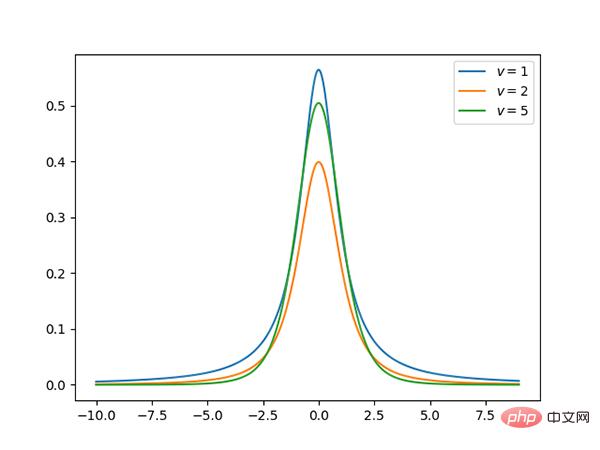

t La distribution est symétrique, en forme de cloche, similaire à la distribution normale, mais a des queues plus lourdes, ce qui signifie qu'elle est plus susceptible de produire des valeurs bien inférieures à la moyenne.

via : https://github.com/graykode/distribution-is-all-you-needa

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Que signifie l'intervalle ?

Que signifie l'intervalle ?

Que comprend le stockage par cryptage des données ?

Que comprend le stockage par cryptage des données ?

Utilisation de setInterval dans JS

Utilisation de setInterval dans JS

Quels sont les attributs du javabean ?

Quels sont les attributs du javabean ?

Quels sont les paramètres du chapiteau ?

Quels sont les paramètres du chapiteau ?

Où regarder les rediffusions en direct de Douyin

Où regarder les rediffusions en direct de Douyin

Solution au problème selon lequel les fichiers exe ne peuvent pas être ouverts dans le système win10

Solution au problème selon lequel les fichiers exe ne peuvent pas être ouverts dans le système win10

équipebition

équipebition

Tutoriel de configuration des variables d'environnement Java

Tutoriel de configuration des variables d'environnement Java