Périphériques technologiques

Périphériques technologiques

IA

IA

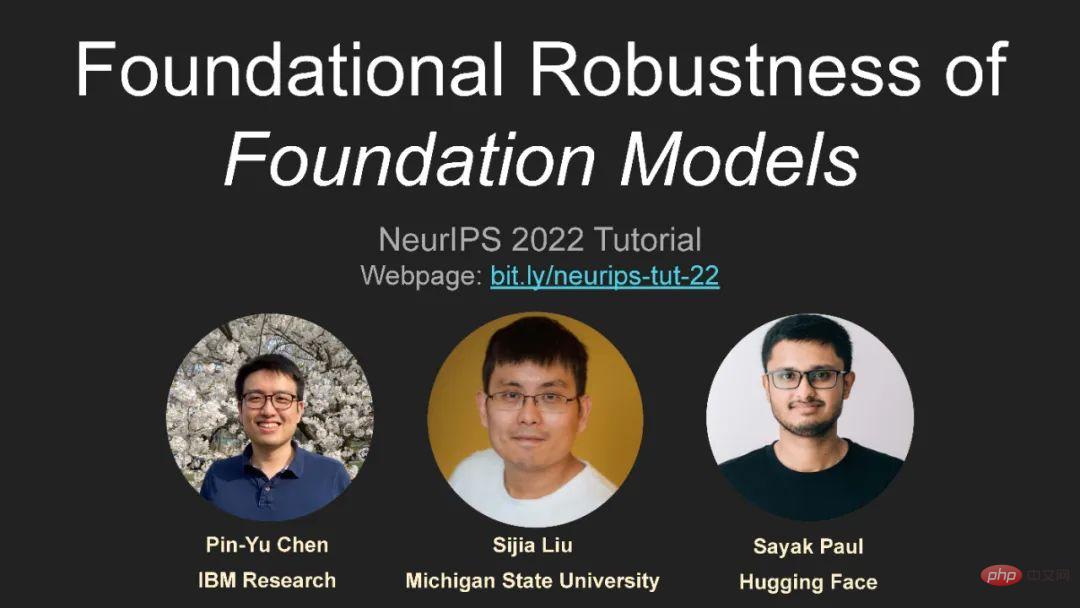

Quelle est la fiabilité des grands modèles ? Dernier tutoriel d'IBM et d'autres chercheurs sur la « Robustesse de base des modèles de base »

Quelle est la fiabilité des grands modèles ? Dernier tutoriel d'IBM et d'autres chercheurs sur la « Robustesse de base des modèles de base »

Quelle est la fiabilité des grands modèles ? Dernier tutoriel d'IBM et d'autres chercheurs sur la « Robustesse de base des modèles de base »

En tant que l'une des conférences académiques sur l'IA les plus prestigieuses au monde, NeurIPS est chaque année un événement important dans la communauté universitaire. Son nom complet est Neural Information Processing Systems, qui est généralement organisé par la Fondation NeurIPS chaque année en décembre.

Le contenu discuté lors de la conférence comprend l'apprentissage profond, la vision par ordinateur, l'apprentissage automatique à grande échelle, la théorie de l'apprentissage, l'optimisation, la théorie de la parcimonie et de nombreuses autres subdivisions.

Cette année, NeurIPS est la 36ème édition et se tiendra pendant deux semaines du 28 novembre au 9 décembre.

La première semaine sera une réunion en personne au Ernest N. Morial Convention Center à la Nouvelle-Orléans, aux États-Unis, et la deuxième semaine sera une réunion en ligne.

Des chercheurs du Centre de recherche IBM et d'autres chercheurs parlent de la robustesse des grands modèles, ce qui mérite beaucoup d'attention !

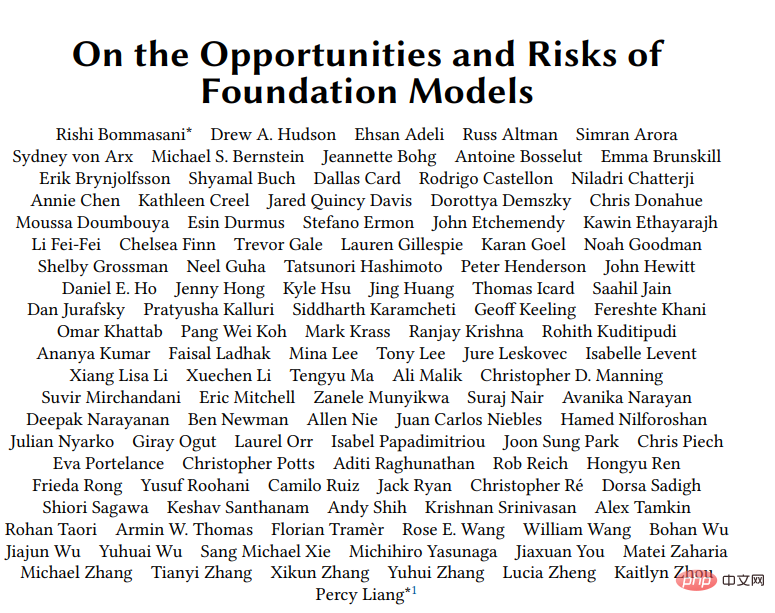

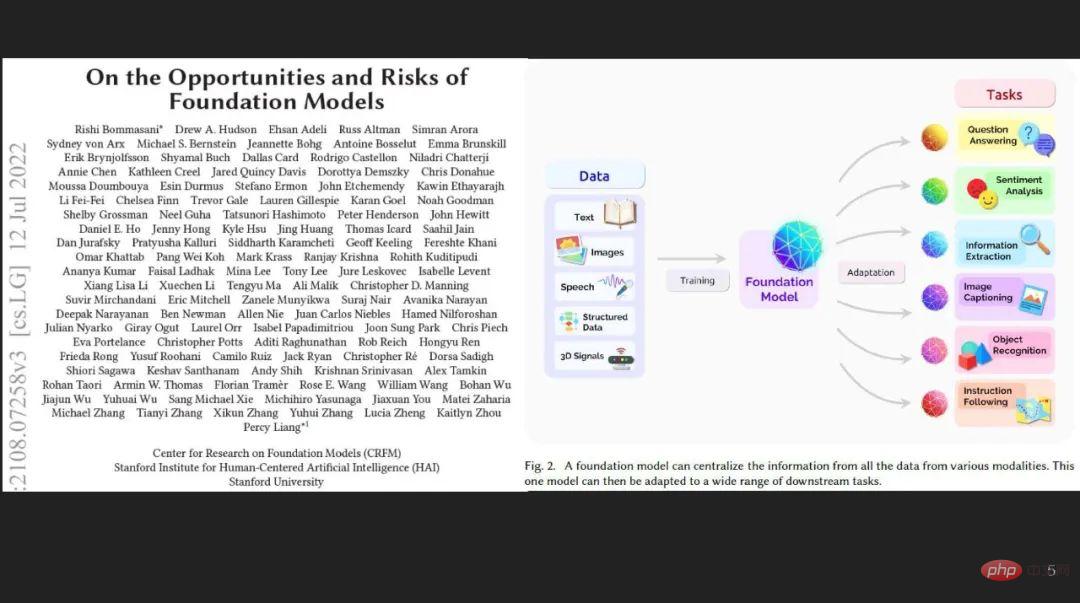

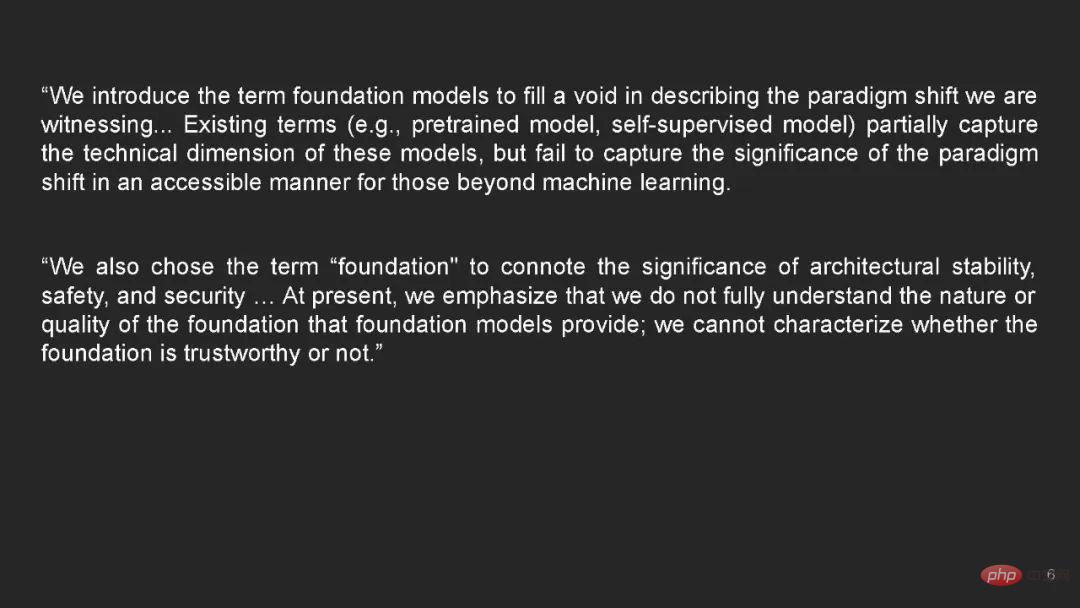

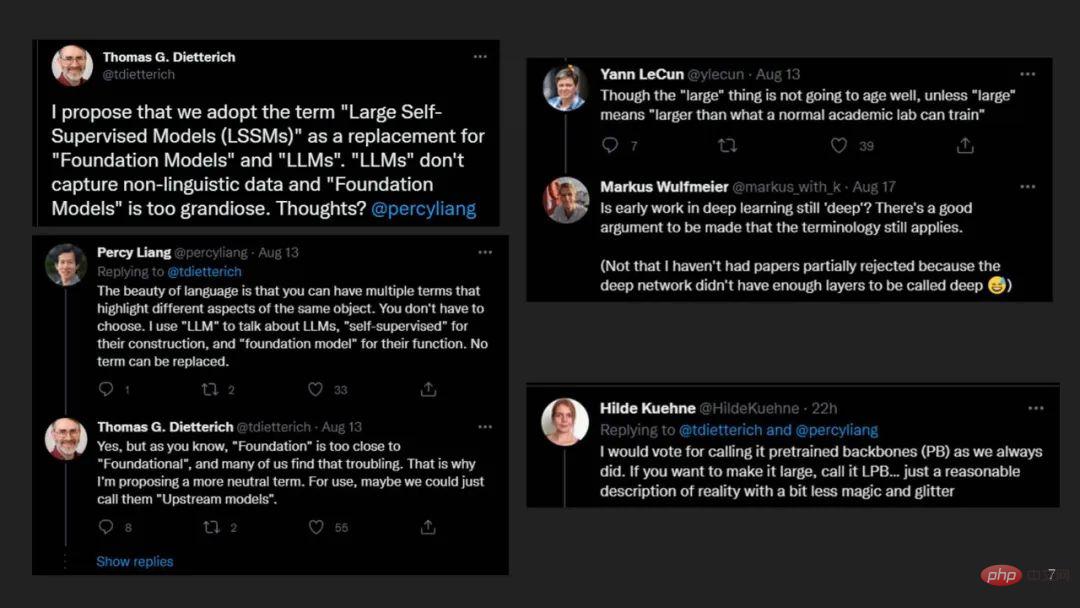

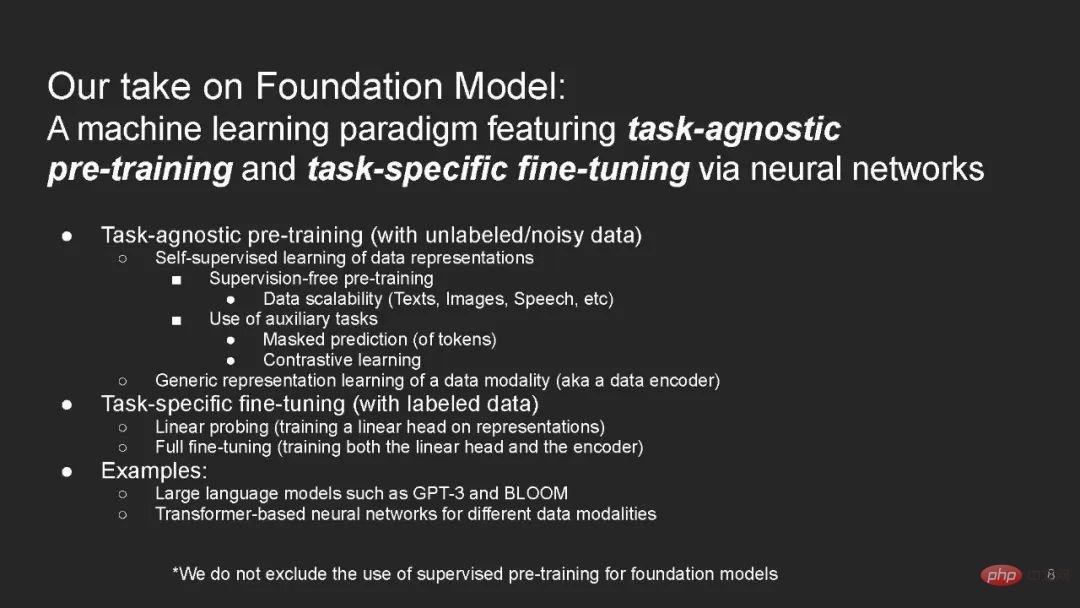

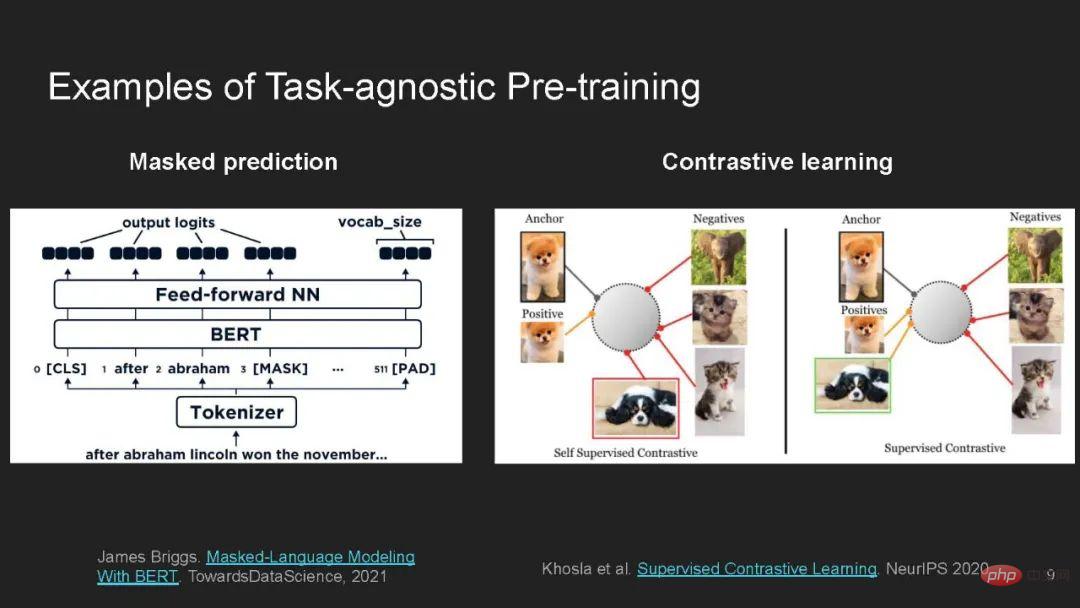

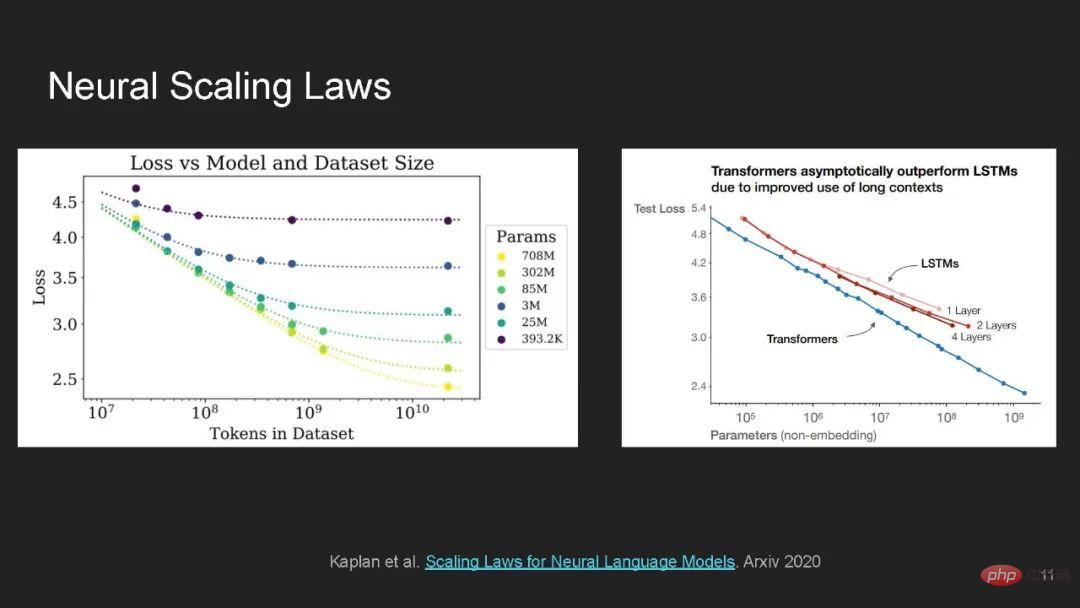

Le modèle de base adopte une méthode d'apprentissage en profondeur, une pré-formation sur des données non étiquetées à grande échelle et un réglage fin grâce à la supervision de tâches spécifiques, qui devient la technologie dominante de l'apprentissage automatique.

Bien que les modèles de base soient très prometteurs dans l'apprentissage des représentations générales et la généralisation peu/zéro à travers les domaines et les modèles de données, ils souffrent en même temps de limitations dues à l'utilisation de volumes de données excessifs et d'architectures de réseaux neuronaux complexes. Cela pose des défis sans précédent et des risques considérables en termes de sécurité et de confidentialité.

Ce didacticiel vise à fournir un didacticiel en ligne de type Coursera avec des conférences complètes, une démonstration pratique et interactive de codage en direct Jupyter/Colab et une discussion de groupe sur différents aspects de la fiabilité dans le modèle sous-jacent.

https://sites.google.com/view/neurips2022-frfm-turotial

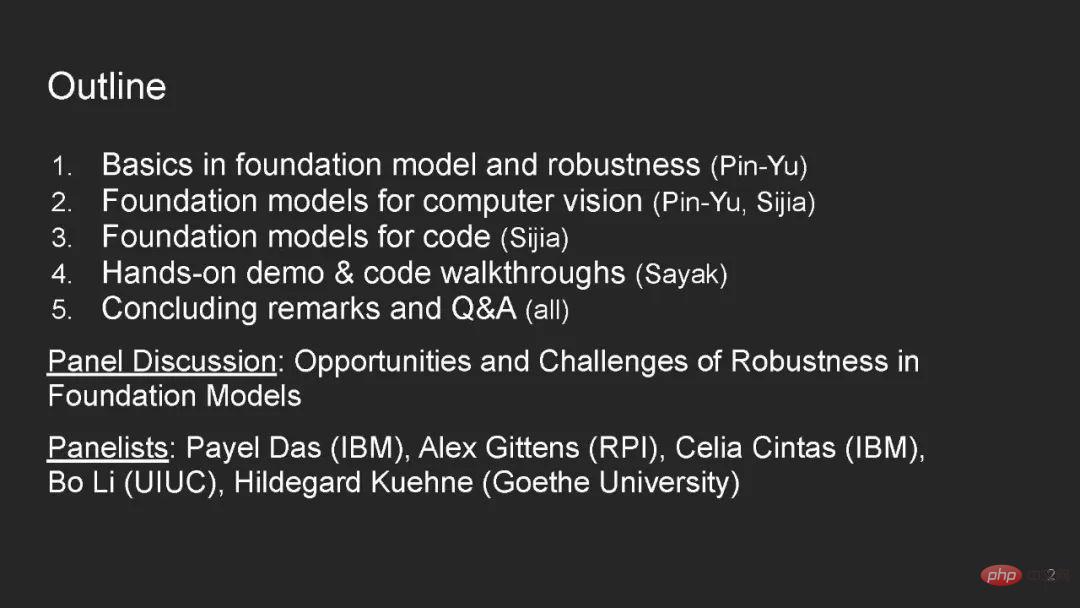

Contenu du répertoire :

- Bases des modèles de fondation et de la robustesse

- Plongée en profondeur sur les modèles de fondation pour ordinateur vision

- Plongée approfondie sur les modèles de base pour le code

- Présentation pratique du code

- Remarques finales

- Q&A

- Discussion en panel

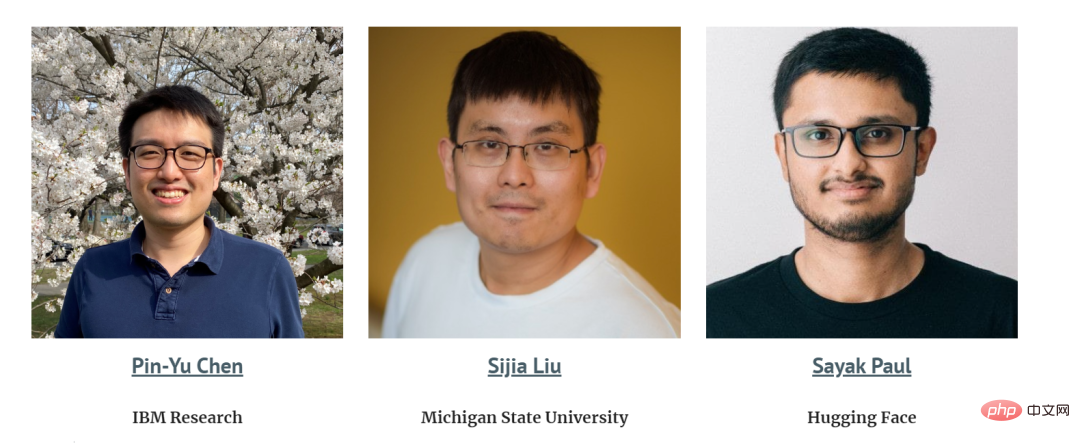

Intervenant :

Les systèmes d'apprentissage automatique du monde réel doivent être robustes aux changements de distribution - ils doivent bien fonctionner sur des distributions de test différentes de la distribution de formation.

Telles que les cartes de pauvreté dans les pays sous-financés [Xie et al. 2016 ; Jean et al. 2016], les voitures autonomes [Yu et al. 2020a], les diagnostics médicaux [AlBadawy et al. al. 2018 ; Dai et Gool 2018] De telles applications à haut risque nécessitent que le modèle se généralise bien à des environnements non visibles dans les données de formation. Par exemple, les échantillons de test proviennent de différents pays, sont dans des conditions de conduite différentes ou proviennent de différents. les hôpitaux.

Des travaux antérieurs ont montré que ces changements de distribution peuvent entraîner une dégradation importante des performances, même pour les modèles de pointe actuels [Blitzer et al. 2006 ; Sugiyama et al. 2007 ; Peng et al. 2019 ; Kumar et al. 2020a ; Yu et al. 2020b ; Geirhos et al. 2020 ;

Un modèle de base est formé sur un ensemble de données non étiquetés vaste et diversifié échantillonné à partir d'une distribution  , et peut ensuite être adapté à de nombreuses tâches en aval.

, et peut ensuite être adapté à de nombreuses tâches en aval.

Pour chaque tâche en aval  , le modèle de base est entraîné sur des données d'entraînement en distribution (ID) étiquetées échantillonnées à partir de la distribution d'entraînement

, le modèle de base est entraîné sur des données d'entraînement en distribution (ID) étiquetées échantillonnées à partir de la distribution d'entraînement  , puis entraîné sur la distribution hors distribution (ID), OOD) est évalué sur la distribution test

, puis entraîné sur la distribution hors distribution (ID), OOD) est évalué sur la distribution test  .

.

Par exemple, un modèle de prévision de carte de pauvreté [Xie et al. 2016 ; Jean et al. 2016] peut apprendre des caractéristiques utiles pour tous les pays à partir de données satellite non étiquetées du monde entier, puis utiliser des échantillons étiquetés du Nigeria Fine-. le réglage est effectué sur des exemples et finalement évalué au Malawi où il y a un manque d'exemples étiquetés.

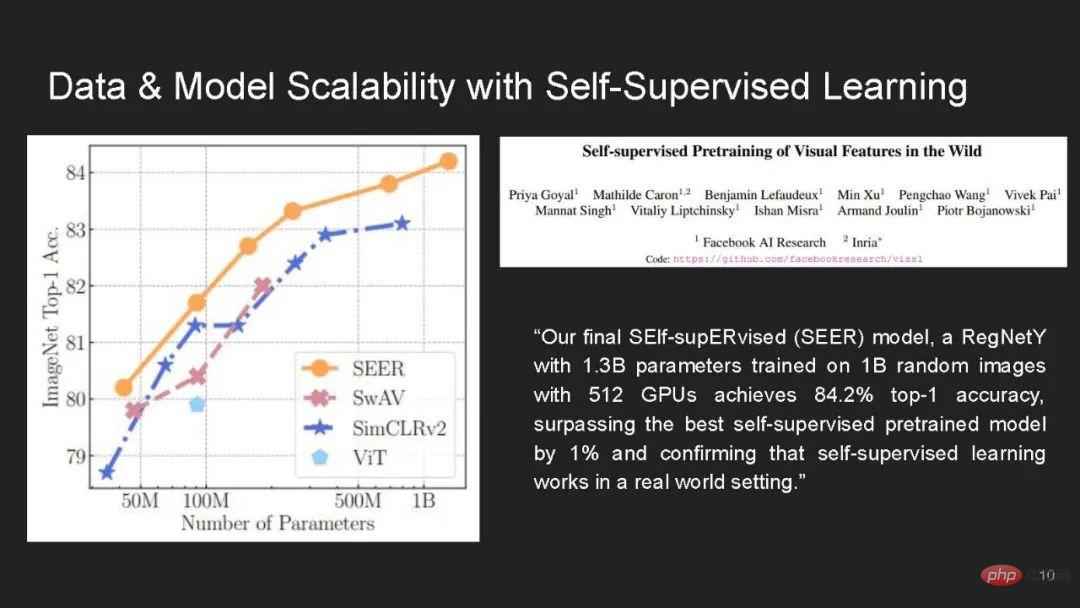

Nous pensons que : 1) Le modèle de base est une approche particulièrement prometteuse en termes de robustesse. Les travaux existants montrent que le pré-entraînement sur des données non étiquetées est une méthode efficace et générale pour améliorer la précision de la distribution des tests OOD, contrairement à de nombreuses interventions de robustesse qui se limitent à des changements de distribution limités.

Cependant, nous avons également discuté de 2) pourquoi le modèle sous-jacent peut ne pas toujours faire face aux changements de distribution, comme certains en raison de corrélations parasites ou de changements de distribution au fil du temps.

Enfin, 3) nous décrivons plusieurs directions de recherche pour exploiter et améliorer la robustesse du modèle sous-jacent.

Nous avons remarqué qu'une façon pour le modèle de base d'améliorer les performances des tâches en aval est de fournir des biais inductifs (via l'initialisation du modèle) pour le modèle adapté. Ces biais sont appris sur une variété d'ensembles de données en plus de l'aval. données de formation.

Cependant, le même biais inductif peut également coder des associations néfastes à partir de données de pré-formation et conduire à des préjudices de représentation et d'affectation en présence de changements de distribution.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Le modèle MoE open source le plus puissant au monde est ici, avec des capacités chinoises comparables à celles du GPT-4, et le prix ne représente que près d'un pour cent de celui du GPT-4-Turbo.

May 07, 2024 pm 04:13 PM

Le modèle MoE open source le plus puissant au monde est ici, avec des capacités chinoises comparables à celles du GPT-4, et le prix ne représente que près d'un pour cent de celui du GPT-4-Turbo.

May 07, 2024 pm 04:13 PM

Imaginez un modèle d'intelligence artificielle qui non seulement a la capacité de surpasser l'informatique traditionnelle, mais qui permet également d'obtenir des performances plus efficaces à moindre coût. Ce n'est pas de la science-fiction, DeepSeek-V2[1], le modèle MoE open source le plus puissant au monde est ici. DeepSeek-V2 est un puissant mélange de modèle de langage d'experts (MoE) présentant les caractéristiques d'une formation économique et d'une inférence efficace. Il est constitué de 236B paramètres, dont 21B servent à activer chaque marqueur. Par rapport à DeepSeek67B, DeepSeek-V2 offre des performances plus élevées, tout en économisant 42,5 % des coûts de formation, en réduisant le cache KV de 93,3 % et en augmentant le débit de génération maximal à 5,76 fois. DeepSeek est une entreprise explorant l'intelligence artificielle générale

L'IA bouleverse la recherche mathématique ! Le lauréat de la médaille Fields et mathématicien sino-américain a dirigé 11 articles les mieux classés | Aimé par Terence Tao

Apr 09, 2024 am 11:52 AM

L'IA bouleverse la recherche mathématique ! Le lauréat de la médaille Fields et mathématicien sino-américain a dirigé 11 articles les mieux classés | Aimé par Terence Tao

Apr 09, 2024 am 11:52 AM

L’IA change effectivement les mathématiques. Récemment, Tao Zhexuan, qui a prêté une attention particulière à cette question, a transmis le dernier numéro du « Bulletin de l'American Mathematical Society » (Bulletin de l'American Mathematical Society). En se concentrant sur le thème « Les machines changeront-elles les mathématiques ? », de nombreux mathématiciens ont exprimé leurs opinions. L'ensemble du processus a été plein d'étincelles, intense et passionnant. L'auteur dispose d'une équipe solide, comprenant Akshay Venkatesh, lauréat de la médaille Fields, le mathématicien chinois Zheng Lejun, l'informaticien de l'Université de New York Ernest Davis et de nombreux autres universitaires bien connus du secteur. Le monde de l’IA a radicalement changé. Vous savez, bon nombre de ces articles ont été soumis il y a un an.

KAN, qui remplace MLP, a été étendu à la convolution par des projets open source

Jun 01, 2024 pm 10:03 PM

KAN, qui remplace MLP, a été étendu à la convolution par des projets open source

Jun 01, 2024 pm 10:03 PM

Plus tôt ce mois-ci, des chercheurs du MIT et d'autres institutions ont proposé une alternative très prometteuse au MLP – KAN. KAN surpasse MLP en termes de précision et d’interprétabilité. Et il peut surpasser le MLP fonctionnant avec un plus grand nombre de paramètres avec un très petit nombre de paramètres. Par exemple, les auteurs ont déclaré avoir utilisé KAN pour reproduire les résultats de DeepMind avec un réseau plus petit et un degré d'automatisation plus élevé. Plus précisément, le MLP de DeepMind compte environ 300 000 paramètres, tandis que le KAN n'en compte qu'environ 200. KAN a une base mathématique solide comme MLP est basé sur le théorème d'approximation universelle, tandis que KAN est basé sur le théorème de représentation de Kolmogorov-Arnold. Comme le montre la figure ci-dessous, KAN a

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas entre officiellement dans l’ère des robots électriques ! Hier, l'Atlas hydraulique s'est retiré "en larmes" de la scène de l'histoire. Aujourd'hui, Boston Dynamics a annoncé que l'Atlas électrique était au travail. Il semble que dans le domaine des robots humanoïdes commerciaux, Boston Dynamics soit déterminé à concurrencer Tesla. Après la sortie de la nouvelle vidéo, elle a déjà été visionnée par plus d’un million de personnes en seulement dix heures. Les personnes âgées partent et de nouveaux rôles apparaissent. C'est une nécessité historique. Il ne fait aucun doute que cette année est l’année explosive des robots humanoïdes. Les internautes ont commenté : Les progrès des robots ont fait ressembler la cérémonie d'ouverture de cette année à des êtres humains, et le degré de liberté est bien plus grand que celui des humains. Mais n'est-ce vraiment pas un film d'horreur ? Au début de la vidéo, Atlas est allongé calmement sur le sol, apparemment sur le dos. Ce qui suit est à couper le souffle

Google est ravi : les performances de JAX surpassent Pytorch et TensorFlow ! Cela pourrait devenir le choix le plus rapide pour la formation à l'inférence GPU

Apr 01, 2024 pm 07:46 PM

Google est ravi : les performances de JAX surpassent Pytorch et TensorFlow ! Cela pourrait devenir le choix le plus rapide pour la formation à l'inférence GPU

Apr 01, 2024 pm 07:46 PM

Les performances de JAX, promu par Google, ont dépassé celles de Pytorch et TensorFlow lors de récents tests de référence, se classant au premier rang sur 7 indicateurs. Et le test n’a pas été fait sur le TPU présentant les meilleures performances JAX. Bien que parmi les développeurs, Pytorch soit toujours plus populaire que Tensorflow. Mais à l’avenir, des modèles plus volumineux seront peut-être formés et exécutés sur la base de la plate-forme JAX. Modèles Récemment, l'équipe Keras a comparé trois backends (TensorFlow, JAX, PyTorch) avec l'implémentation native de PyTorch et Keras2 avec TensorFlow. Premièrement, ils sélectionnent un ensemble de

Nouveaux travaux sur la prédiction de séries chronologiques + grand modèle NLP : générer automatiquement des invites implicites pour la prédiction de séries chronologiques

Mar 18, 2024 am 09:20 AM

Nouveaux travaux sur la prédiction de séries chronologiques + grand modèle NLP : générer automatiquement des invites implicites pour la prédiction de séries chronologiques

Mar 18, 2024 am 09:20 AM

Aujourd'hui, j'aimerais partager un travail de recherche récent de l'Université du Connecticut qui propose une méthode pour aligner les données de séries chronologiques avec de grands modèles de traitement du langage naturel (NLP) sur l'espace latent afin d'améliorer les performances de prévision des séries chronologiques. La clé de cette méthode consiste à utiliser des indices spatiaux latents (invites) pour améliorer la précision des prévisions de séries chronologiques. Titre de l'article : S2IP-LLM : SemanticSpaceInformedPromptLearningwithLLMforTimeSeriesForecasting Adresse de téléchargement : https://arxiv.org/pdf/2403.05798v1.pdf 1. Modèle de fond de problème important

Les robots Tesla travaillent dans les usines, Musk : Le degré de liberté des mains atteindra 22 cette année !

May 06, 2024 pm 04:13 PM

Les robots Tesla travaillent dans les usines, Musk : Le degré de liberté des mains atteindra 22 cette année !

May 06, 2024 pm 04:13 PM

La dernière vidéo du robot Optimus de Tesla est sortie, et il peut déjà fonctionner en usine. À vitesse normale, il trie les batteries (les batteries 4680 de Tesla) comme ceci : Le responsable a également publié à quoi cela ressemble à une vitesse 20 fois supérieure - sur un petit "poste de travail", en sélectionnant et en sélectionnant et en sélectionnant : Cette fois, il est publié L'un des points forts de la vidéo est qu'Optimus réalise ce travail en usine, de manière totalement autonome, sans intervention humaine tout au long du processus. Et du point de vue d'Optimus, il peut également récupérer et placer la batterie tordue, en se concentrant sur la correction automatique des erreurs : concernant la main d'Optimus, le scientifique de NVIDIA Jim Fan a donné une évaluation élevée : la main d'Optimus est l'un des robots à cinq doigts du monde. le plus adroit. Ses mains ne sont pas seulement tactiles

FisheyeDetNet : le premier algorithme de détection de cible basé sur une caméra fisheye

Apr 26, 2024 am 11:37 AM

FisheyeDetNet : le premier algorithme de détection de cible basé sur une caméra fisheye

Apr 26, 2024 am 11:37 AM

La détection de cibles est un problème relativement mature dans les systèmes de conduite autonome, parmi lesquels la détection des piétons est l'un des premiers algorithmes à être déployés. Des recherches très complètes ont été menées dans la plupart des articles. Cependant, la perception de la distance à l’aide de caméras fisheye pour une vue panoramique est relativement moins étudiée. En raison de la distorsion radiale importante, la représentation standard du cadre de délimitation est difficile à mettre en œuvre dans les caméras fisheye. Pour alléger la description ci-dessus, nous explorons les conceptions étendues de boîtes englobantes, d'ellipses et de polygones généraux dans des représentations polaires/angulaires et définissons une métrique de segmentation d'instance mIOU pour analyser ces représentations. Le modèle fisheyeDetNet proposé avec une forme polygonale surpasse les autres modèles et atteint simultanément 49,5 % de mAP sur l'ensemble de données de la caméra fisheye Valeo pour la conduite autonome.