Périphériques technologiques

Périphériques technologiques

IA

IA

En utilisant CNN comme modèle de base, la convolution déformable InternImage réalise un nouveau record en matière de détection et de segmentation !

En utilisant CNN comme modèle de base, la convolution déformable InternImage réalise un nouveau record en matière de détection et de segmentation !

En utilisant CNN comme modèle de base, la convolution déformable InternImage réalise un nouveau record en matière de détection et de segmentation !

Le développement fulgurant des transformateurs visuels à grande échelle ces dernières années a repoussé les limites des performances dans le domaine de la vision par ordinateur. Les modèles Vision Transformer battent les réseaux de neurones convolutifs en augmentant le nombre de paramètres du modèle et de données d'entraînement. Des chercheurs du laboratoire d'intelligence artificielle de Shanghai, de l'université Tsinghua, de Nanda, de SenseTime et de Hong Kong chinois ont résumé les écarts entre les réseaux neuronaux convolutifs et les transformateurs visuels. Au niveau de l'opérateur, les opérateurs de CNN traditionnels manquent de dépendances longue distance et de capacités d'agrégation spatiale adaptative. Au niveau structurel, les structures de CNN traditionnelles manquent de composants avancés ;

Compte tenu des problèmes techniques ci-dessus, Des chercheurs du laboratoire Pujiang, de l'université Tsinghua et d'autres institutions ont proposé de manière innovante un modèle à grande échelle basé sur des réseaux neuronaux convolutifs, appelé InternImage, qui utilise la convolution dynamique clairsemée comme sous-calcul de base. , réalisant une agrégation spatiale adaptative en saisissant des informations pertinentes comme condition. InternImage permet d'apprendre des modèles de paramètres à grande échelle plus puissants et plus robustes à partir de données massives en réduisant le biais inductif strict des CNN traditionnels. Son efficacité a été vérifiée sur des tâches visuelles incluant la classification d'images, la détection d'objets et la segmentation sémantique. Il a obtenu des résultats compétitifs dans des ensembles de données de référence exigeants, notamment ImageNet, COCO et ADE20K. Au même niveau de paramètres, il a dépassé la structure visuelle du Transformer et a fourni une nouvelle direction pour les grands modèles d'images.

- Lien papier : https://arxiv.org/abs/2211.05778

- Code source ouvert : https://github.com/OpenGVLab/InternImage

Limitations des réseaux de neurones convolutifs traditionnels

L'expansion de l'échelle du modèle est une stratégie importante pour améliorer la qualité de la représentation des caractéristiques. Dans le domaine de la vision par ordinateur, l'augmentation du nombre de paramètres du modèle peut non seulement améliorer efficacement. la capacité d'apprentissage des représentations des modèles profonds, mais aussi Réaliser l'apprentissage et l'acquisition de connaissances à partir de données massives. ViT et Swin Transformer ont étendu pour la première fois le modèle de profondeur à 2 milliards et 3 milliards de niveaux de paramètres. La précision de classification de leurs modèles uniques dans l'ensemble de données ImageNet a également dépassé 90 %, dépassant de loin le réseau CNN traditionnel et les modèles à petite échelle. briser le goulot d'étranglement technique. Cependant, en raison du manque de capacités de modélisation de dépendances à longue distance et de relations spatiales, les modèles CNN traditionnels ne peuvent pas atteindre des capacités d'expansion à l'échelle du modèle similaires à la structure Transformer. Les chercheurs ont résumé les différences entre le réseau neuronal convolutif traditionnel et le transformateur visuel :

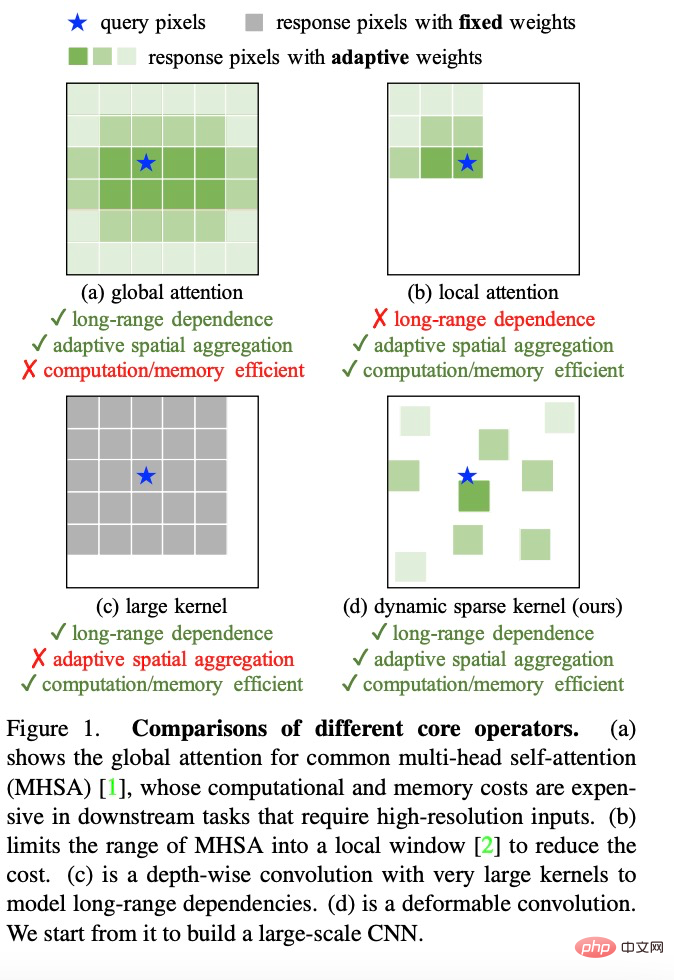

(1) Au niveau de l'opérateur, le mécanisme d'attention multi-têtes du transformateur visuel a des dépendances à longue distance et des capacités d'agrégation spatiale adaptatives, bénéficiant À partir d'ici, le transformateur visuel peut apprendre des représentations plus puissantes et plus robustes à partir de données massives que le réseau CNN.

(2) Du point de vue de l'architecture du modèle, en plus du mécanisme d'attention multi-têtes, le transformateur visuel dispose de modules plus avancés que le réseau CNN ne possède pas, tels que la normalisation des couches (LN), le réseau neuronal à action directe FFN, GELU, etc.

Bien que certains travaux récents tentent d'utiliser de grandes convolutions du noyau pour obtenir des dépendances longue distance, ils sont encore loin des transformateurs visuels de pointe en termes d'échelle et de précision du modèle.

Poursuite de l'expansion des réseaux convolutifs déformables

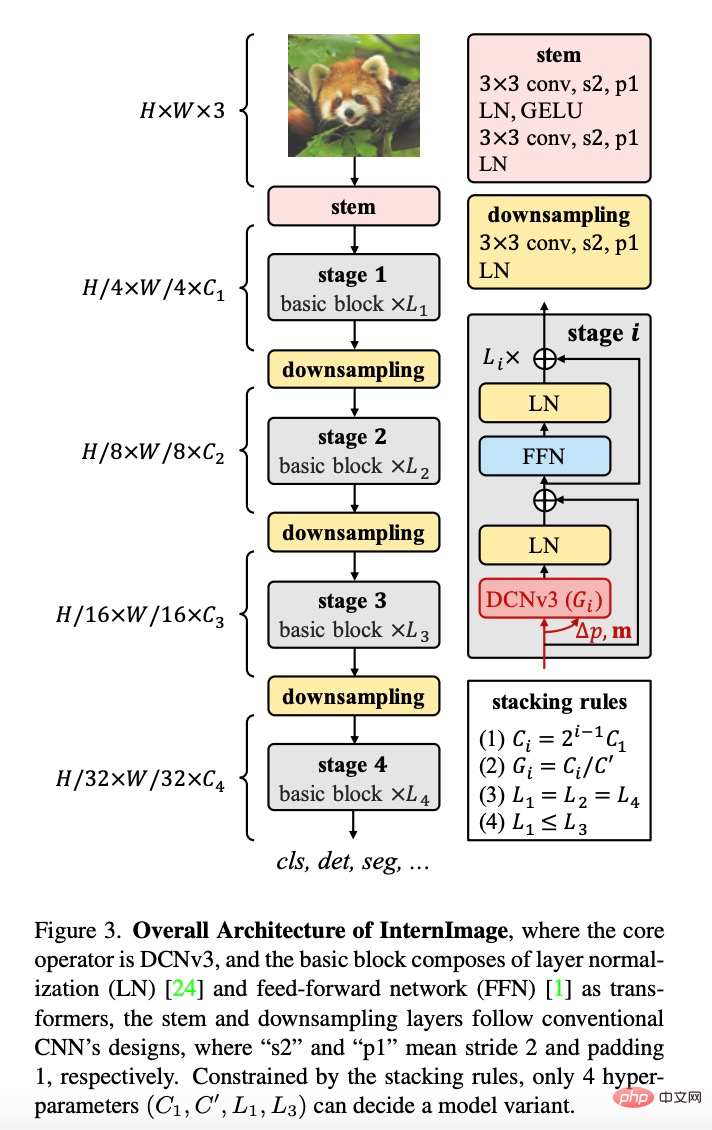

InternImage améliore l'évolutivité des modèles convolutifs et atténue le biais inductif en repensant les opérateurs et les structures de modèle, y compris (1) l'opérateur DCNv3, basé sur l'opérateur DCNv2. Sub-introduit des poids de projection partagés, multi- mécanismes de groupe et modulation de points d'échantillonnage. (2) Module de base, intégrant des modules avancés comme unité de module de base pour la construction de modèles (3) Règles d'empilement de modules, standardisant la largeur, la profondeur, le nombre de groupes et d'autres hyper-paramètres du modèle lors de l'expansion du modèle.

Ce travail se concentre sur la construction d'un modèle CNN capable de s'adapter efficacement à des paramètres à grande échelle. Premièrement, l'opérateur de convolution déformable DCNv2 est repensé pour s'adapter aux dépendances à longue distance et affaiblir le biais inductif ; puis, l'opérateur de convolution ajusté est combiné avec des composants avancés pour enfin établir un module unitaire de base, explorer et mettre en œuvre des règles d'empilement et de mise à l'échelle des modules ; construire un modèle de base avec des paramètres à grande échelle et des représentations puissantes peut être appris à partir de données massives.

Au niveau de l'opérateur, cette étude résume d'abord les principales différences entre l'opérateur de convolution et les autres opérateurs grand public. Les modèles actuels de la série Transformer s'appuient principalement sur le mécanisme d'auto-attention multi-têtes pour réaliser une construction de modèles à grande échelle. Ses opérateurs ont des dépendances longue distance, qui sont suffisantes pour construire des relations de connexion entre les entités longue distance, et disposent également d'une agrégation adaptative spatiale. capacités pour réaliser une relation de construction au niveau du pixel. Cependant, ce mécanisme d'attention mondial nécessite d'énormes besoins en matière de calcul et de stockage, ce qui rend difficile une formation efficace et une convergence rapide. De même, les mécanismes d’attention locale ne dépendent pas des caractéristiques à longue portée. La convolution dense à grand noyau n'a pas de capacité d'agrégation spatiale, il est donc difficile de surmonter le biais inductif naturel de la convolution, qui n'est pas propice à l'expansion du modèle. Par conséquent, InternImage conçoit des opérateurs de convolution dynamiques et clairsemés pour obtenir des effets d'attention globale sans gaspiller trop de ressources de calcul et de stockage, permettant ainsi une formation efficace.

Sur la base de l'opérateur DCNv2, les chercheurs ont repensé, ajusté et proposé l'opérateur DCNv3. Les améliorations spécifiques incluent les parties suivantes.

(1) Poids de projection partagé. Semblable à la convolution conventionnelle, différents points d'échantillonnage dans DCNv2 ont des poids de projection indépendants, de sorte que la taille de son paramètre est linéairement liée au nombre total de points d'échantillonnage. Afin de réduire la complexité des paramètres et de la mémoire, nous nous appuyons sur l'idée de convolution séparable et utilisons des poids indépendants de la position pour remplacer les poids de regroupement. Les poids de projection sont partagés entre différents points d'échantillonnage et toutes les dépendances de position d'échantillonnage sont conservées.

(2) Présentation de plusieurs ensembles de mécanismes. La conception multigroupe a été introduite pour la première fois dans la convolution groupée et est largement utilisée dans l'auto-attention multi-têtes de Transformer. Elle peut être associée à une agrégation spatiale adaptative pour améliorer efficacement la diversité des fonctionnalités. Inspirés par cela, les chercheurs divisent le processus d'agrégation spatiale en plusieurs groupes, et chaque groupe a un décalage d'échantillonnage indépendant. Depuis lors, différents groupes d’une même couche DCNv3 présentent différents modèles d’agrégation spatiale, ce qui entraîne une riche diversité de fonctionnalités.

(3) Normalisation scalaire de la modulation du point d'échantillonnage. Afin d'atténuer le problème d'instabilité lorsque la capacité du modèle est étendue, les chercheurs ont défini le mode de normalisation sur la normalisation Softmax sur une base échantillon par échantillon. Cela rend non seulement le processus de formation des modèles à grande échelle plus stable, mais également les constructions. un modèle de toutes les relations de connexion des points d’échantillonnage.

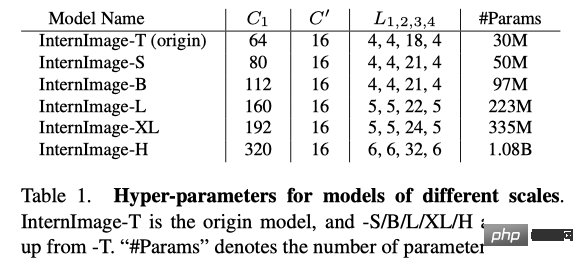

Après avoir construit l'opérateur DCNv3, vous devez d'abord normaliser les détails globaux des modules de base et des autres couches du modèle, puis construire une InternImage en explorant la stratégie d'empilement de ces modules de base. Enfin, des modèles avec différentes quantités de paramètres sont construits selon les règles d'expansion du modèle proposé.

Module de base. Différente de la structure de goulot d'étranglement largement utilisée dans les CNN traditionnels, cette étude adopte un module de base plus proche des ViT, équipé de composants plus avancés, notamment GELU, la normalisation de couche (LN) et le réseau à action directe (FFN), qui ont fait leurs preuves. plus efficace dans une variété de tâches de vision. Les détails du module de base sont présentés dans la figure ci-dessus, où l'opérateur principal est DCNv3, qui prédit le biais d'échantillonnage et l'échelle de modulation en faisant passer les caractéristiques d'entrée via une convolution séparable légère. Pour les autres composants, suivez la même conception qu'un transformateur normal.

Règles d'empilage. Afin de clarifier le processus d'empilement de blocs, cette étude propose deux règles d'empilement de modules. La première règle est le nombre de canaux dans les trois dernières étapes  , qui est déterminé par le nombre de canaux dans la première étape

, qui est déterminé par le nombre de canaux dans la première étape  , c'est-à-dire

, c'est-à-dire  ; La deuxième règle est que le numéro de groupe de chaque module correspond au nombre de canaux dans chaque étape, c'est-à-dire

; La deuxième règle est que le numéro de groupe de chaque module correspond au nombre de canaux dans chaque étape, c'est-à-dire  troisièmement, le mode d'empilement est fixé sur "AABA", c'est-à-dire ; le nombre de piles de modules dans les étapes 1, 2 et 4 est le même

troisièmement, le mode d'empilement est fixé sur "AABA", c'est-à-dire ; le nombre de piles de modules dans les étapes 1, 2 et 4 est le même , et pas plus grand que l'étape 3

, et pas plus grand que l'étape 3  . Par conséquent, un modèle avec un volume de paramètres de 30M est choisi comme base. Les paramètres spécifiques sont : le nombre de canaux de sortie Steam

. Par conséquent, un modèle avec un volume de paramètres de 30M est choisi comme base. Les paramètres spécifiques sont : le nombre de canaux de sortie Steam est de 64 ; le nombre de groupes est de 1/16 du nombre de canaux d'entrée dans chaque étage ; , étapes 1, 2 et 4 Le nombre de piles de modules

est de 64 ; le nombre de groupes est de 1/16 du nombre de canaux d'entrée dans chaque étage ; , étapes 1, 2 et 4 Le nombre de piles de modules  est de 4, le nombre de piles de modules

est de 4, le nombre de piles de modules  à l'étape 3 est de 18 et les paramètres du modèle sont de 30 M.

à l'étape 3 est de 18 et les paramètres du modèle sont de 30 M.

Règles de mise à l'échelle du modèle. Sur la base du modèle optimal sous les contraintes ci-dessus, cette étude a normalisé deux dimensions de mise à l'échelle du modèle de réseau : à savoir la profondeur D (nombre de piles de modules) et la largeur C (nombre de canaux), en utilisant les facteurs de restriction  et

et  le long du coefficient composite

le long du coefficient composite  met à l'échelle la profondeur et la largeur, c'est-à-dire

met à l'échelle la profondeur et la largeur, c'est-à-dire  , où

, où  , selon les expériences, son réglage optimal est

, selon les expériences, son réglage optimal est  .

.

En suivant cette règle, cette étude a construit des modèles à différentes échelles, à savoir InternImage-T, S, B, L, XL. Les paramètres spécifiques sont :

Résultats expérimentaux

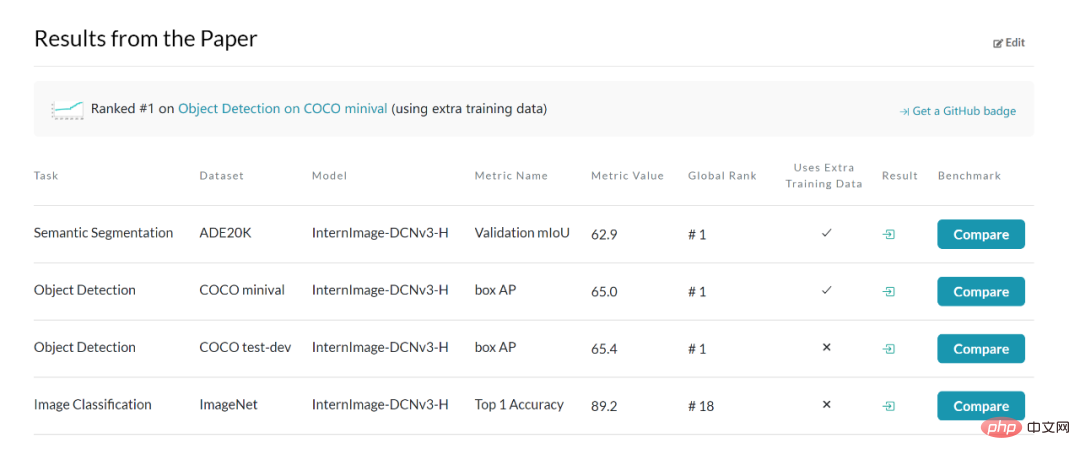

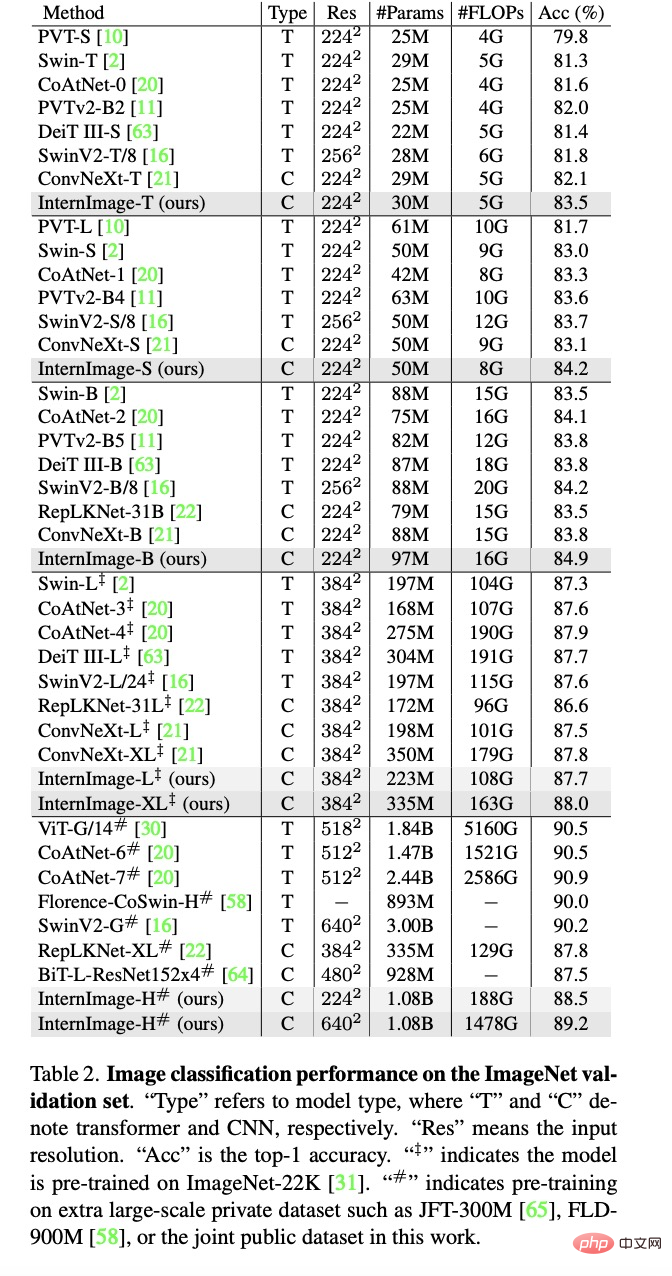

Expérience de classification d'images : En utilisant 427 millions d'ensembles de données publiques : Laion-400M, YFCC15M, CC12M, InternImage-H a obtenu une précision de 89,2 % sur ImageNet-1K.

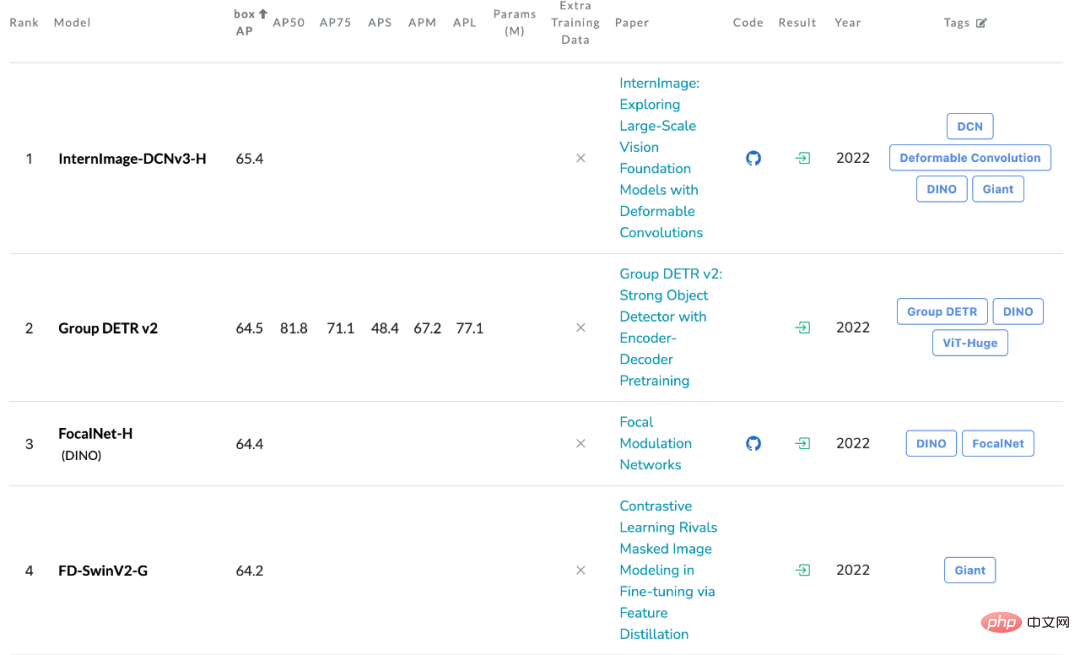

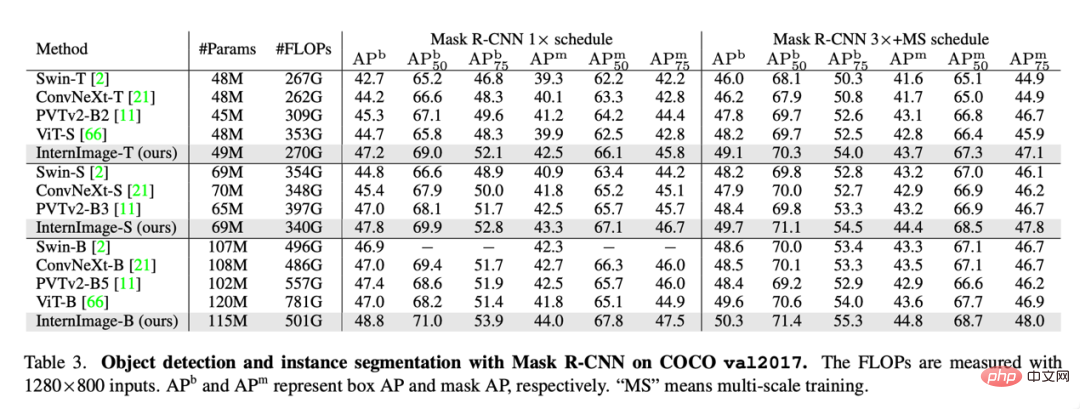

Détection d'objets : en utilisant le plus grand InternImage-H comme réseau principal et en utilisant DINO comme cadre de détection de base, pré-entraînez le détecteur DINO sur l'ensemble de données Objects365, puis exécutez sur COCO Effectuez des réglages fins. Le modèle a obtenu un résultat optimal de 65,4 % dans la tâche de détection de cible, dépassant ainsi les limites de performances de la détection de cible COCO.

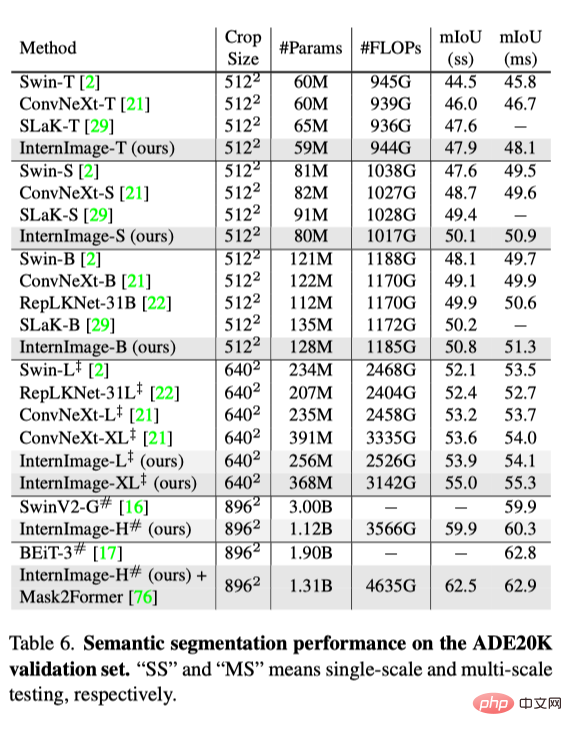

Segmentation sémantique : En termes de segmentation sémantique, InternImage-H a également obtenu de bonnes performances et, combiné à Mask2Former, a atteint le niveau actuel le plus élevé de 62,9 % sur ADE20K.

Conclusion

Cette étude propose InternImage, un nouveau modèle de base à grande échelle basé sur CNN qui peut fournir des représentations puissantes pour des tâches de vision polyvalentes telles que la classification d'images, la détection d'objets et la segmentation sémantique. Les chercheurs ont ajusté l'opérateur flexible DCNv2 pour répondre aux besoins du modèle de base et ont développé une série de règles de blocage, d'empilement et de mise à l'échelle basées sur l'opérateur principal. Des expériences approfondies sur la détection d'objets et les tests de segmentation sémantique ont vérifié qu'InternImage peut atteindre des performances équivalentes ou supérieures à celles des transformateurs visuels à grande échelle bien conçus, formés sur de grandes quantités de données, indiquant que CNN constitue également une étape considérable dans le modèle visuel de base à grande échelle. recherche. choisir. Pourtant, les CNN à grande échelle en sont encore à leurs premiers stades de développement, et les chercheurs espèrent qu’InternImage pourra constituer un bon point de départ.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

Le modèle MoE open source le plus puissant au monde est ici, avec des capacités chinoises comparables à celles du GPT-4, et le prix ne représente que près d'un pour cent de celui du GPT-4-Turbo.

May 07, 2024 pm 04:13 PM

Le modèle MoE open source le plus puissant au monde est ici, avec des capacités chinoises comparables à celles du GPT-4, et le prix ne représente que près d'un pour cent de celui du GPT-4-Turbo.

May 07, 2024 pm 04:13 PM

Imaginez un modèle d'intelligence artificielle qui non seulement a la capacité de surpasser l'informatique traditionnelle, mais qui permet également d'obtenir des performances plus efficaces à moindre coût. Ce n'est pas de la science-fiction, DeepSeek-V2[1], le modèle MoE open source le plus puissant au monde est ici. DeepSeek-V2 est un puissant mélange de modèle de langage d'experts (MoE) présentant les caractéristiques d'une formation économique et d'une inférence efficace. Il est constitué de 236B paramètres, dont 21B servent à activer chaque marqueur. Par rapport à DeepSeek67B, DeepSeek-V2 offre des performances plus élevées, tout en économisant 42,5 % des coûts de formation, en réduisant le cache KV de 93,3 % et en augmentant le débit de génération maximal à 5,76 fois. DeepSeek est une entreprise explorant l'intelligence artificielle générale

KAN, qui remplace MLP, a été étendu à la convolution par des projets open source

Jun 01, 2024 pm 10:03 PM

KAN, qui remplace MLP, a été étendu à la convolution par des projets open source

Jun 01, 2024 pm 10:03 PM

Plus tôt ce mois-ci, des chercheurs du MIT et d'autres institutions ont proposé une alternative très prometteuse au MLP – KAN. KAN surpasse MLP en termes de précision et d’interprétabilité. Et il peut surpasser le MLP fonctionnant avec un plus grand nombre de paramètres avec un très petit nombre de paramètres. Par exemple, les auteurs ont déclaré avoir utilisé KAN pour reproduire les résultats de DeepMind avec un réseau plus petit et un degré d'automatisation plus élevé. Plus précisément, le MLP de DeepMind compte environ 300 000 paramètres, tandis que le KAN n'en compte qu'environ 200. KAN a une base mathématique solide comme MLP est basé sur le théorème d'approximation universelle, tandis que KAN est basé sur le théorème de représentation de Kolmogorov-Arnold. Comme le montre la figure ci-dessous, KAN a

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas entre officiellement dans l’ère des robots électriques ! Hier, l'Atlas hydraulique s'est retiré "en larmes" de la scène de l'histoire. Aujourd'hui, Boston Dynamics a annoncé que l'Atlas électrique était au travail. Il semble que dans le domaine des robots humanoïdes commerciaux, Boston Dynamics soit déterminé à concurrencer Tesla. Après la sortie de la nouvelle vidéo, elle a déjà été visionnée par plus d’un million de personnes en seulement dix heures. Les personnes âgées partent et de nouveaux rôles apparaissent. C'est une nécessité historique. Il ne fait aucun doute que cette année est l’année explosive des robots humanoïdes. Les internautes ont commenté : Les progrès des robots ont fait ressembler la cérémonie d'ouverture de cette année à des êtres humains, et le degré de liberté est bien plus grand que celui des humains. Mais n'est-ce vraiment pas un film d'horreur ? Au début de la vidéo, Atlas est allongé calmement sur le sol, apparemment sur le dos. Ce qui suit est à couper le souffle

Google est ravi : les performances de JAX surpassent Pytorch et TensorFlow ! Cela pourrait devenir le choix le plus rapide pour la formation à l'inférence GPU

Apr 01, 2024 pm 07:46 PM

Google est ravi : les performances de JAX surpassent Pytorch et TensorFlow ! Cela pourrait devenir le choix le plus rapide pour la formation à l'inférence GPU

Apr 01, 2024 pm 07:46 PM

Les performances de JAX, promu par Google, ont dépassé celles de Pytorch et TensorFlow lors de récents tests de référence, se classant au premier rang sur 7 indicateurs. Et le test n’a pas été fait sur le TPU présentant les meilleures performances JAX. Bien que parmi les développeurs, Pytorch soit toujours plus populaire que Tensorflow. Mais à l’avenir, des modèles plus volumineux seront peut-être formés et exécutés sur la base de la plate-forme JAX. Modèles Récemment, l'équipe Keras a comparé trois backends (TensorFlow, JAX, PyTorch) avec l'implémentation native de PyTorch et Keras2 avec TensorFlow. Premièrement, ils sélectionnent un ensemble de

L'IA bouleverse la recherche mathématique ! Le lauréat de la médaille Fields et mathématicien sino-américain a dirigé 11 articles les mieux classés | Aimé par Terence Tao

Apr 09, 2024 am 11:52 AM

L'IA bouleverse la recherche mathématique ! Le lauréat de la médaille Fields et mathématicien sino-américain a dirigé 11 articles les mieux classés | Aimé par Terence Tao

Apr 09, 2024 am 11:52 AM

L’IA change effectivement les mathématiques. Récemment, Tao Zhexuan, qui a prêté une attention particulière à cette question, a transmis le dernier numéro du « Bulletin de l'American Mathematical Society » (Bulletin de l'American Mathematical Society). En se concentrant sur le thème « Les machines changeront-elles les mathématiques ? », de nombreux mathématiciens ont exprimé leurs opinions. L'ensemble du processus a été plein d'étincelles, intense et passionnant. L'auteur dispose d'une équipe solide, comprenant Akshay Venkatesh, lauréat de la médaille Fields, le mathématicien chinois Zheng Lejun, l'informaticien de l'Université de New York Ernest Davis et de nombreux autres universitaires bien connus du secteur. Le monde de l’IA a radicalement changé. Vous savez, bon nombre de ces articles ont été soumis il y a un an.

FisheyeDetNet : le premier algorithme de détection de cible basé sur une caméra fisheye

Apr 26, 2024 am 11:37 AM

FisheyeDetNet : le premier algorithme de détection de cible basé sur une caméra fisheye

Apr 26, 2024 am 11:37 AM

La détection de cibles est un problème relativement mature dans les systèmes de conduite autonome, parmi lesquels la détection des piétons est l'un des premiers algorithmes à être déployés. Des recherches très complètes ont été menées dans la plupart des articles. Cependant, la perception de la distance à l’aide de caméras fisheye pour une vue panoramique est relativement moins étudiée. En raison de la distorsion radiale importante, la représentation standard du cadre de délimitation est difficile à mettre en œuvre dans les caméras fisheye. Pour alléger la description ci-dessus, nous explorons les conceptions étendues de boîtes englobantes, d'ellipses et de polygones généraux dans des représentations polaires/angulaires et définissons une métrique de segmentation d'instance mIOU pour analyser ces représentations. Le modèle fisheyeDetNet proposé avec une forme polygonale surpasse les autres modèles et atteint simultanément 49,5 % de mAP sur l'ensemble de données de la caméra fisheye Valeo pour la conduite autonome.

Les robots Tesla travaillent dans les usines, Musk : Le degré de liberté des mains atteindra 22 cette année !

May 06, 2024 pm 04:13 PM

Les robots Tesla travaillent dans les usines, Musk : Le degré de liberté des mains atteindra 22 cette année !

May 06, 2024 pm 04:13 PM

La dernière vidéo du robot Optimus de Tesla est sortie, et il peut déjà fonctionner en usine. À vitesse normale, il trie les batteries (les batteries 4680 de Tesla) comme ceci : Le responsable a également publié à quoi cela ressemble à une vitesse 20 fois supérieure - sur un petit "poste de travail", en sélectionnant et en sélectionnant et en sélectionnant : Cette fois, il est publié L'un des points forts de la vidéo est qu'Optimus réalise ce travail en usine, de manière totalement autonome, sans intervention humaine tout au long du processus. Et du point de vue d'Optimus, il peut également récupérer et placer la batterie tordue, en se concentrant sur la correction automatique des erreurs : concernant la main d'Optimus, le scientifique de NVIDIA Jim Fan a donné une évaluation élevée : la main d'Optimus est l'un des robots à cinq doigts du monde. le plus adroit. Ses mains ne sont pas seulement tactiles

DualBEV : dépassant largement BEVFormer et BEVDet4D, ouvrez le livre !

Mar 21, 2024 pm 05:21 PM

DualBEV : dépassant largement BEVFormer et BEVDet4D, ouvrez le livre !

Mar 21, 2024 pm 05:21 PM

Cet article explore le problème de la détection précise d'objets sous différents angles de vue (tels que la perspective et la vue à vol d'oiseau) dans la conduite autonome, en particulier comment transformer efficacement les caractéristiques de l'espace en perspective (PV) en vue à vol d'oiseau (BEV). implémenté via le module Visual Transformation (VT). Les méthodes existantes sont globalement divisées en deux stratégies : la conversion 2D en 3D et la conversion 3D en 2D. Les méthodes 2D vers 3D améliorent les caractéristiques 2D denses en prédisant les probabilités de profondeur, mais l'incertitude inhérente aux prévisions de profondeur, en particulier dans les régions éloignées, peut introduire des inexactitudes. Alors que les méthodes 3D vers 2D utilisent généralement des requêtes 3D pour échantillonner des fonctionnalités 2D et apprendre les poids d'attention de la correspondance entre les fonctionnalités 3D et 2D via un transformateur, ce qui augmente le temps de calcul et de déploiement.