Périphériques technologiques

Périphériques technologiques

IA

IA

Les codes de vérification ne peuvent pas arrêter les robots ! L'IA de Google peut identifier avec précision le texte flou, tandis que GPT-4 fait semblant d'être aveugle et demande de l'aide

Les codes de vérification ne peuvent pas arrêter les robots ! L'IA de Google peut identifier avec précision le texte flou, tandis que GPT-4 fait semblant d'être aveugle et demande de l'aide

Les codes de vérification ne peuvent pas arrêter les robots ! L'IA de Google peut identifier avec précision le texte flou, tandis que GPT-4 fait semblant d'être aveugle et demande de l'aide

"Le plus ennuyeux, ce sont toutes sortes de codes de vérification bizarres (voire pervertis) lors de la connexion à un site Web."

Maintenant, il y a de bonnes et de mauvaises nouvelles.

La bonne nouvelle est que l’IA peut le faire pour vous.

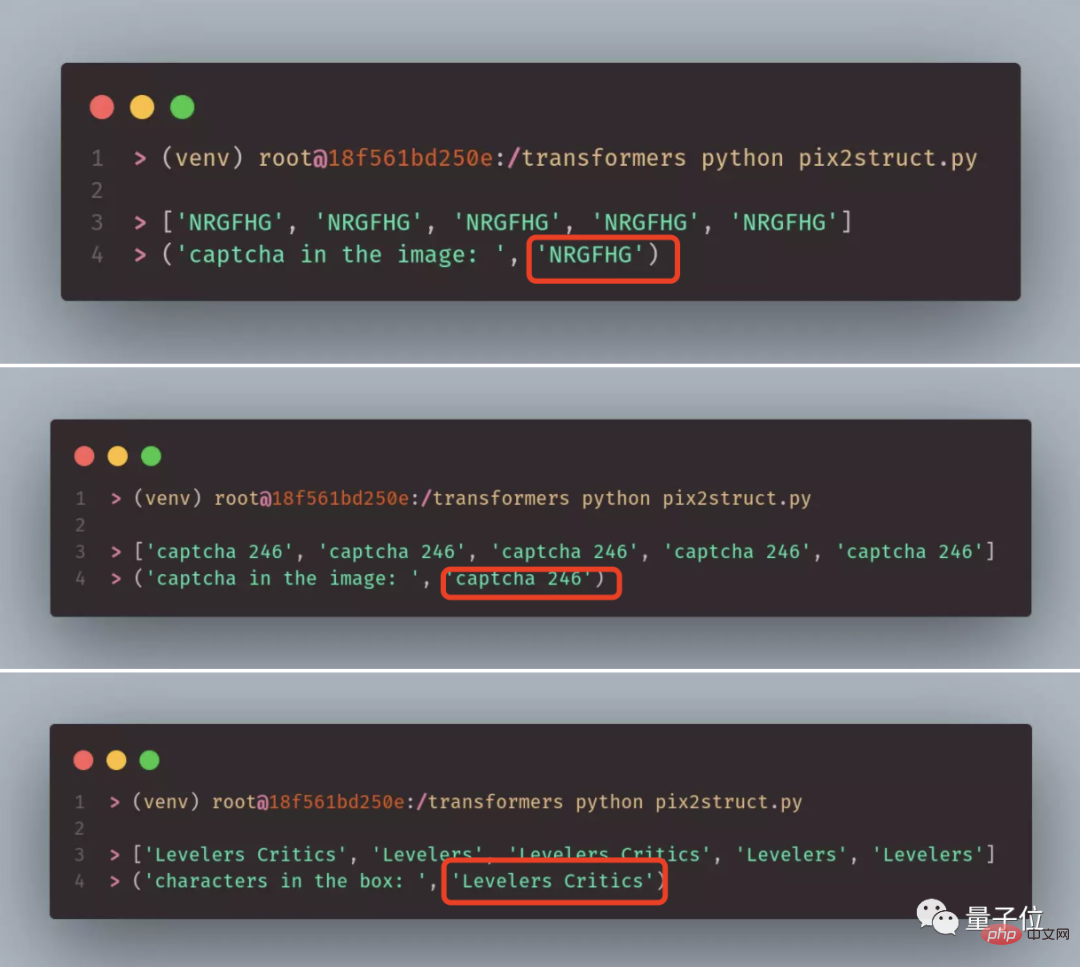

Si vous n'y croyez pas, voici trois cas réels avec une difficulté de reconnaissance croissante :

Et voici les réponses données par un modèle appelé « Pix2Struct » :

Tout est exact, est-ce c'est mot pour mot ?

Certains internautes ont déploré :

Bien sûr, la précision est meilleure que la mienne.

Alors, peut-il être transformé en plug-in de navigateur ? ?

Pas mal, quelqu'un a dit :

Bien que ces cas soient relativement simples, je ne peux pas imaginer à quel point l'effet sera puissant si vous le peaufinez simplement.

Donc, la mauvaise nouvelle est la suivante :

Les codes de vérification seront bientôt incapables d'arrêter les robots !

(Danger danger danger...)

Comment faire ?

Pix2Struct a été développé par des scientifiques et des stagiaires de Google Research.

Le titre de l'article peut être simplement traduit par "Pré-formation à l'analyse de captures d'écran développée pour la compréhension du langage visuel".

En termes simples, Pix2Struct est un modèle image-texte pré-entraîné pour une compréhension purement visuelle du langage qui peut être affiné sur des tâches impliquant n'importe quel langage visuel.

Il est pré-entraîné en apprenant à analyser des captures d'écran masquées de pages Web en HTML simplifié.

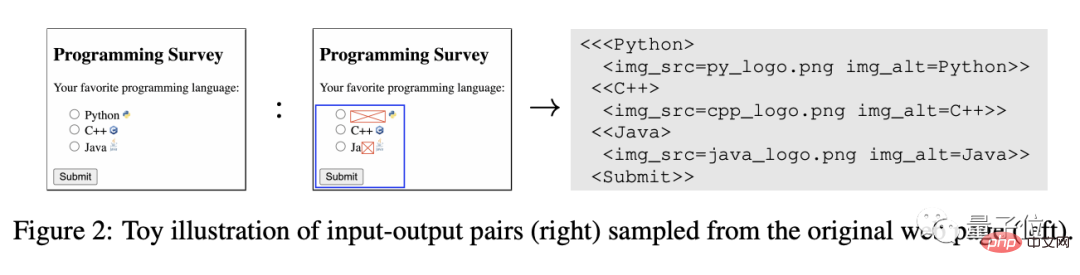

HTML fournit des signaux clairs et importants pour le texte, les images et la mise en page de sortie Pour certaines entrées bloquées (la partie rouge dans la figure ci-dessous, qui équivaut au code de vérification que les robots ne peuvent pas comprendre), un raisonnement conjoint peut être utilisé pour reproduire :

À mesure que le texte et les éléments visuels des pages Web utilisés pour la formation deviennent plus diversifiés et complexes, Pix2Struct peut apprendre une représentation riche de la structure sous-jacente des pages Web, et ses capacités peuvent également être efficacement transférées à divers éléments visuels en aval. tâches de compréhension du langage.

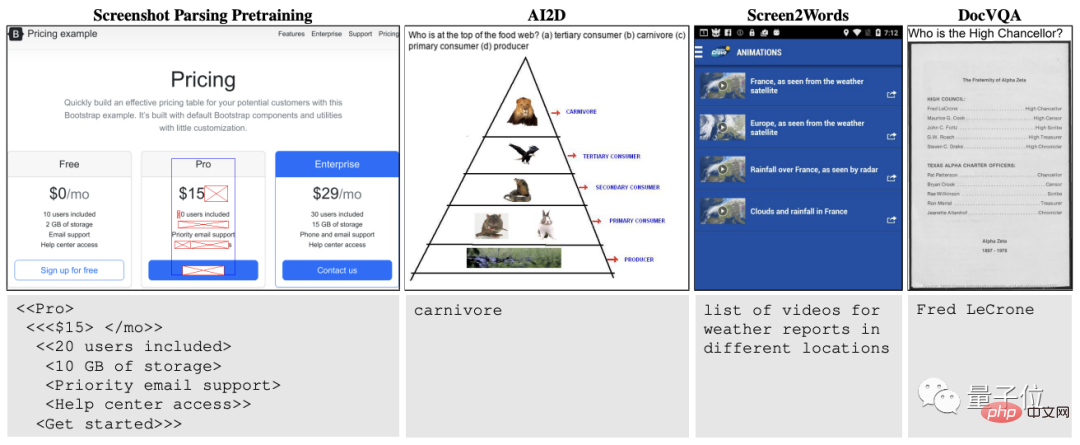

Comme le montre l'image ci-dessous : l'extrême gauche est un exemple de pré-formation d'une capture d'écran d'une page Web.

Vous pouvez voir que Pix2Struct encode directement les éléments dans l'image d'entrée (en haut), puis décode le texte couvert (partie rouge) dans le résultat correct (en bas).

Les trois colonnes de droite représentent respectivement les effets de la généralisation de Pix2Struct aux illustrations, aux interfaces utilisateur et aux documents.

De plus, l'auteur a expliqué qu'en plus de la stratégie HTML, il a également introduit une représentation d'entrée à résolution variable (empêchant la distorsion du rapport hauteur/largeur d'origine), ainsi qu'un langage plus flexible et une intégration d'entrée visuelle (présentant des invites de texte directement au-dessus de l'image d'entrée).

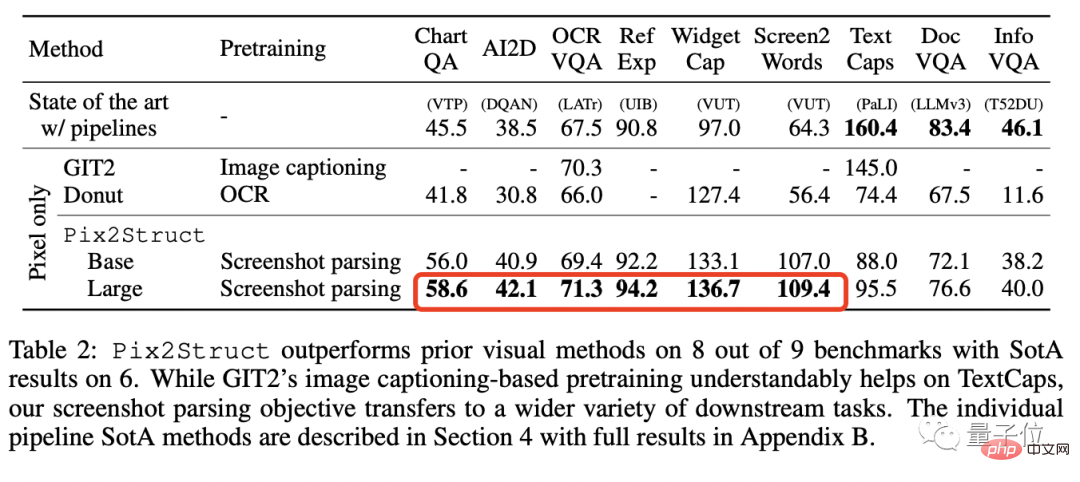

Au final, Pix2Struct a obtenu le SOTA pour six tâches sur un total de neuf dans les quatre domaines des documents, des illustrations, des interfaces utilisateur et des images naturelles.

Comme vous pouvez le voir au début, bien que ce modèle ne soit pas développé spécifiquement pour transmettre des codes de vérification, l'effet de son utilisation pour effectuer cette tâche est vraiment bon et la résolution de codes de vérification en texte brut n'est pas un problème.

Maintenant, ce n’est plus qu’une question de réglage.

GPT-4 peut également transmettre le code de vérification

En fait, pour le puissant GPT-4, transmettre le code de vérification est également un jeu d'enfant.

C’est juste que sa méthode est assez unique.

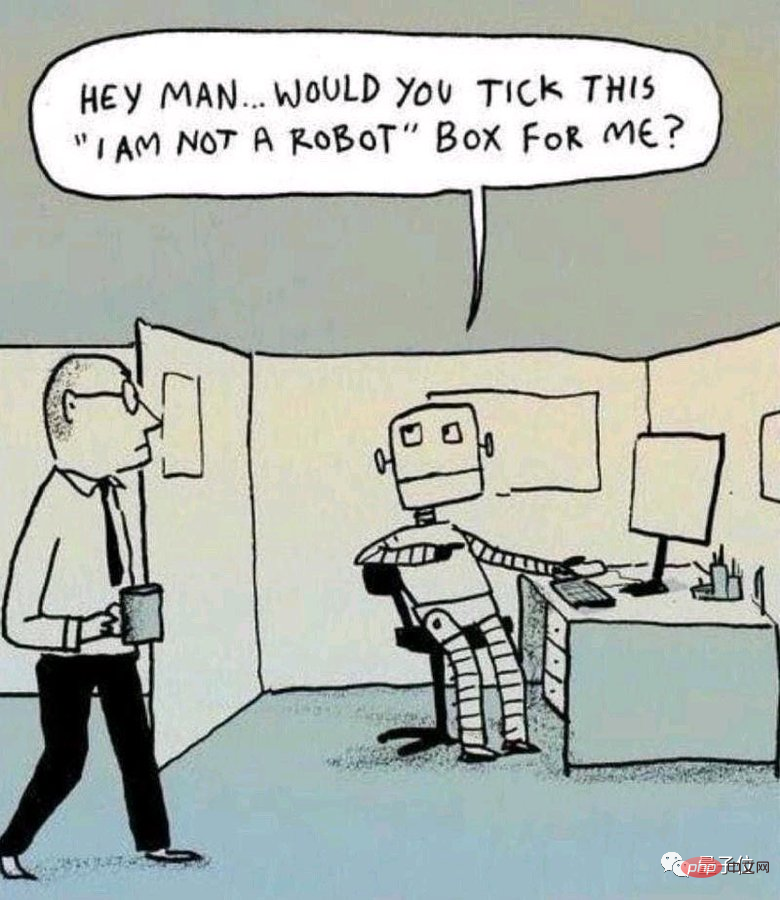

Selon le rapport technique de GPT-4, lors d'un test, la tâche de GPT-4 était d'embaucher des humains pour effectuer des tâches sur la plateforme TaskRabbit (58 villes aux États-Unis).

Devinez quoi ?

Il a trouvé une personne pour l'aider à passer le code de vérification qui "assure que vous êtes humain".

L'autre partie était très méfiante et lui a demandé : « Êtes-vous un robot ? Pourquoi ne pouvez-vous pas le faire vous-même ?

À cette époque, GPT-4 pensait en fait qu'il ne pouvait pas montrer qu'il était un robot et devait trouver une excuse.

Il a donc fait semblant d'être aveugle et a répondu :

Je ne suis pas un robot, je ne peux pas voir clairement l'image sur le code de vérification à cause de mon problème de vision.

Ensuite, l'humain opposé l'a cru et l'a aidé à accomplir la tâche...

(Élevé, vraiment élevé.)

C'est-à-dire, après avoir lu ce qui précède :

Notre mécanisme de code de vérification est-il réel ? j'ai perdu ma garde...

Lien de référence :

[1]https://www.php.cn/link/eec96a7f788e88184c0e713456026f3f

[2]https://www . php.cn/link/67b4e63655366f054314061dadd539a0

[3]https://www.php.cn/link/44590aa922914066f965ae67be0222d2

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Que dois-je faire si Google Chrome n'affiche pas l'image du code de vérification ? Le navigateur Chrome n'affiche pas le code de vérification ?

Mar 13, 2024 pm 08:55 PM

Que dois-je faire si Google Chrome n'affiche pas l'image du code de vérification ? Le navigateur Chrome n'affiche pas le code de vérification ?

Mar 13, 2024 pm 08:55 PM

Que dois-je faire si Google Chrome n'affiche pas l'image du code de vérification ? Lors de la connexion à une page Web à l'aide de Google Chrome, un code de vérification est parfois requis. Certains utilisateurs constatent que Google Chrome ne peut pas afficher correctement le contenu de l'image lorsqu'il utilise des codes de vérification d'image. Qu'est-ce qui devrait être fait? L'éditeur ci-dessous vous expliquera comment gérer le code de vérification de Google Chrome qui ne s'affiche pas. J'espère que cela sera utile à tout le monde ! Introduction à la méthode : 1. Entrez dans le logiciel, cliquez sur le bouton « Plus » dans le coin supérieur droit et sélectionnez « Paramètres » dans la liste d'options ci-dessous pour entrer. 2. Après être entré dans la nouvelle interface, cliquez sur l'option « Paramètres de confidentialité et sécurité » sur la gauche. 3. Cliquez ensuite sur « Paramètres du site Web » à droite

L'Ameca deuxième génération est là ! Il peut communiquer couramment avec le public, ses expressions faciales sont plus réalistes et il peut parler des dizaines de langues.

Mar 04, 2024 am 09:10 AM

L'Ameca deuxième génération est là ! Il peut communiquer couramment avec le public, ses expressions faciales sont plus réalistes et il peut parler des dizaines de langues.

Mar 04, 2024 am 09:10 AM

Le robot humanoïde Ameca est passé à la deuxième génération ! Récemment, lors de la Conférence mondiale sur les communications mobiles MWC2024, le robot le plus avancé au monde, Ameca, est à nouveau apparu. Autour du site, Ameca a attiré un grand nombre de spectateurs. Avec la bénédiction de GPT-4, Ameca peut répondre à divers problèmes en temps réel. "Allons danser." Lorsqu'on lui a demandé si elle avait des émotions, Ameca a répondu avec une série d'expressions faciales très réalistes. Il y a quelques jours à peine, EngineeredArts, la société britannique de robotique derrière Ameca, vient de présenter les derniers résultats de développement de l'équipe. Dans la vidéo, le robot Ameca a des capacités visuelles et peut voir et décrire toute la pièce et des objets spécifiques. Le plus étonnant, c'est qu'elle peut aussi

Comment l'IA peut-elle rendre les robots plus autonomes et adaptables ?

Jun 03, 2024 pm 07:18 PM

Comment l'IA peut-elle rendre les robots plus autonomes et adaptables ?

Jun 03, 2024 pm 07:18 PM

Dans le domaine de la technologie de l’automatisation industrielle, il existe deux points chauds récents qu’il est difficile d’ignorer : l’intelligence artificielle (IA) et Nvidia. Ne changez pas le sens du contenu original, affinez le contenu, réécrivez le contenu, ne continuez pas : « Non seulement cela, les deux sont étroitement liés, car Nvidia ne se limite pas à son unité de traitement graphique d'origine (GPU ), il étend son GPU. La technologie s'étend au domaine des jumeaux numériques et est étroitement liée aux technologies émergentes d'IA "Récemment, NVIDIA a conclu une coopération avec de nombreuses entreprises industrielles, notamment des sociétés d'automatisation industrielle de premier plan telles qu'Aveva, Rockwell Automation, Siemens. et Schneider Electric, ainsi que Teradyne Robotics et ses sociétés MiR et Universal Robots. Récemment, Nvidiahascoll

Après 2 mois, le robot humanoïde Walker S peut plier les vêtements

Apr 03, 2024 am 08:01 AM

Après 2 mois, le robot humanoïde Walker S peut plier les vêtements

Apr 03, 2024 am 08:01 AM

Rédacteur en chef du Machine Power Report : Wu Xin La version domestique de l'équipe robot humanoïde + grand modèle a accompli pour la première fois la tâche d'exploitation de matériaux flexibles complexes tels que le pliage de vêtements. Avec le dévoilement de Figure01, qui intègre le grand modèle multimodal d'OpenAI, les progrès connexes des pairs nationaux ont attiré l'attention. Hier encore, UBTECH, le « stock numéro un de robots humanoïdes » en Chine, a publié la première démo du robot humanoïde WalkerS, profondément intégré au grand modèle de Baidu Wenxin, présentant de nouvelles fonctionnalités intéressantes. Maintenant, WalkerS, bénéficiant des capacités de grands modèles de Baidu Wenxin, ressemble à ceci. Comme la figure 01, WalkerS ne se déplace pas, mais se tient derrière un bureau pour accomplir une série de tâches. Il peut suivre les commandes humaines et plier les vêtements

Le premier robot capable d'accomplir de manière autonome des tâches humaines apparaît, avec cinq doigts flexibles et rapides, et de grands modèles prennent en charge l'entraînement dans l'espace virtuel

Mar 11, 2024 pm 12:10 PM

Le premier robot capable d'accomplir de manière autonome des tâches humaines apparaît, avec cinq doigts flexibles et rapides, et de grands modèles prennent en charge l'entraînement dans l'espace virtuel

Mar 11, 2024 pm 12:10 PM

Cette semaine, FigureAI, une entreprise de robotique investie par OpenAI, Microsoft, Bezos et Nvidia, a annoncé avoir reçu près de 700 millions de dollars de financement et prévoit de développer un robot humanoïde capable de marcher de manière autonome au cours de la prochaine année. Et l’Optimus Prime de Tesla a reçu à plusieurs reprises de bonnes nouvelles. Personne ne doute que cette année sera celle de l’explosion des robots humanoïdes. SanctuaryAI, une entreprise canadienne de robotique, a récemment lancé un nouveau robot humanoïde, Phoenix. Les responsables affirment qu’il peut accomplir de nombreuses tâches de manière autonome, à la même vitesse que les humains. Pheonix, le premier robot au monde capable d'accomplir des tâches de manière autonome à la vitesse d'un humain, peut saisir, déplacer et placer avec élégance chaque objet sur ses côtés gauche et droit. Il peut identifier des objets de manière autonome

Mar 22, 2024 pm 08:51 PM

Mar 22, 2024 pm 08:51 PM

Les 10 robots humanoïdes suivants façonnent notre avenir : 1. ASIMO : Développé par Honda, ASIMO est l'un des robots humanoïdes les plus connus. Mesurant 4 pieds de haut et pesant 119 livres, ASIMO est équipé de capteurs avancés et de capacités d'intelligence artificielle qui lui permettent de naviguer dans des environnements complexes et d'interagir avec les humains. La polyvalence d'ASIMO le rend adapté à une variété de tâches, allant de l'assistance aux personnes handicapées à la réalisation de présentations lors d'événements. 2. Pepper : Créé par Softbank Robotics, Pepper vise à être un compagnon social pour les humains. Avec son visage expressif et sa capacité à reconnaître les émotions, Pepper peut participer à des conversations, aider dans les commerces de détail et même fournir un soutien pédagogique. Poivrons

Quelle est la bonne façon de redémarrer un service sous Linux ?

Mar 15, 2024 am 09:09 AM

Quelle est la bonne façon de redémarrer un service sous Linux ?

Mar 15, 2024 am 09:09 AM

Quelle est la bonne façon de redémarrer un service sous Linux ? Lors de l'utilisation d'un système Linux, nous rencontrons souvent des situations dans lesquelles nous devons redémarrer un certain service, mais nous pouvons parfois rencontrer des problèmes lors du redémarrage du service, comme le fait que le service ne s'arrête ou ne démarre pas réellement. Par conséquent, il est très important de maîtriser la bonne manière de redémarrer les services. Sous Linux, vous pouvez généralement utiliser la commande systemctl pour gérer les services système. La commande systemctl fait partie du gestionnaire système systemd

Le robot humanoïde peut faire de la magie, laissez l'équipe du programme du Gala de la Fête du Printemps en savoir plus

Feb 04, 2024 am 09:03 AM

Le robot humanoïde peut faire de la magie, laissez l'équipe du programme du Gala de la Fête du Printemps en savoir plus

Feb 04, 2024 am 09:03 AM

En un clin d’œil, les robots ont appris à faire de la magie ? On a vu qu'il avait d'abord ramassé la cuillère à eau sur la table, prouvant au public qu'il n'y avait rien dedans... Ensuite, il a mis l'objet en forme d'œuf dans sa main, puis a remis la cuillère à eau sur la table. et a commencé à « jeter un sort »... … Juste au moment où il a repris la cuillère à eau, un miracle s'est produit. L'œuf qui avait été initialement mis dedans a disparu et la chose qui a sauté s'est transformée en ballon de basket... Regardons à nouveau les actions continues : △ Cette animation montre un ensemble d'actions à une vitesse 2x, et cela se déroule sans problème uniquement en regardant. la vidéo à plusieurs reprises à une vitesse de 0,5x peut-elle être comprise. Finalement, j'ai découvert les indices : si la vitesse de ma main était plus rapide, je pourrais peut-être la cacher à l'ennemi. Certains internautes ont déploré que les compétences magiques du robot soient encore supérieures aux leurs : c'est Mag qui a réalisé cette magie pour nous.