Périphériques technologiques

Périphériques technologiques

IA

IA

Nanyang Polytechnic a proposé la tâche de générer une PSG à partir du graphique de scène complet, en localisant les objets au niveau des pixels et en prédisant 56 relations.

Nanyang Polytechnic a proposé la tâche de générer une PSG à partir du graphique de scène complet, en localisant les objets au niveau des pixels et en prédisant 56 relations.

Nanyang Polytechnic a proposé la tâche de générer une PSG à partir du graphique de scène complet, en localisant les objets au niveau des pixels et en prédisant 56 relations.

Nous sommes déjà en 2022, mais la plupart des tâches actuelles de vision par ordinateur se concentrent encore uniquement sur la perception de l’image. Par exemple, la tâche de classification d'images nécessite uniquement que le modèle identifie les catégories d'objets dans l'image. Bien que des tâches telles que la détection de cibles et la segmentation d'images nécessitent en outre de trouver l'emplacement des objets, ces tâches ne suffisent toujours pas à démontrer que le modèle a acquis une compréhension complète et approfondie de la scène.

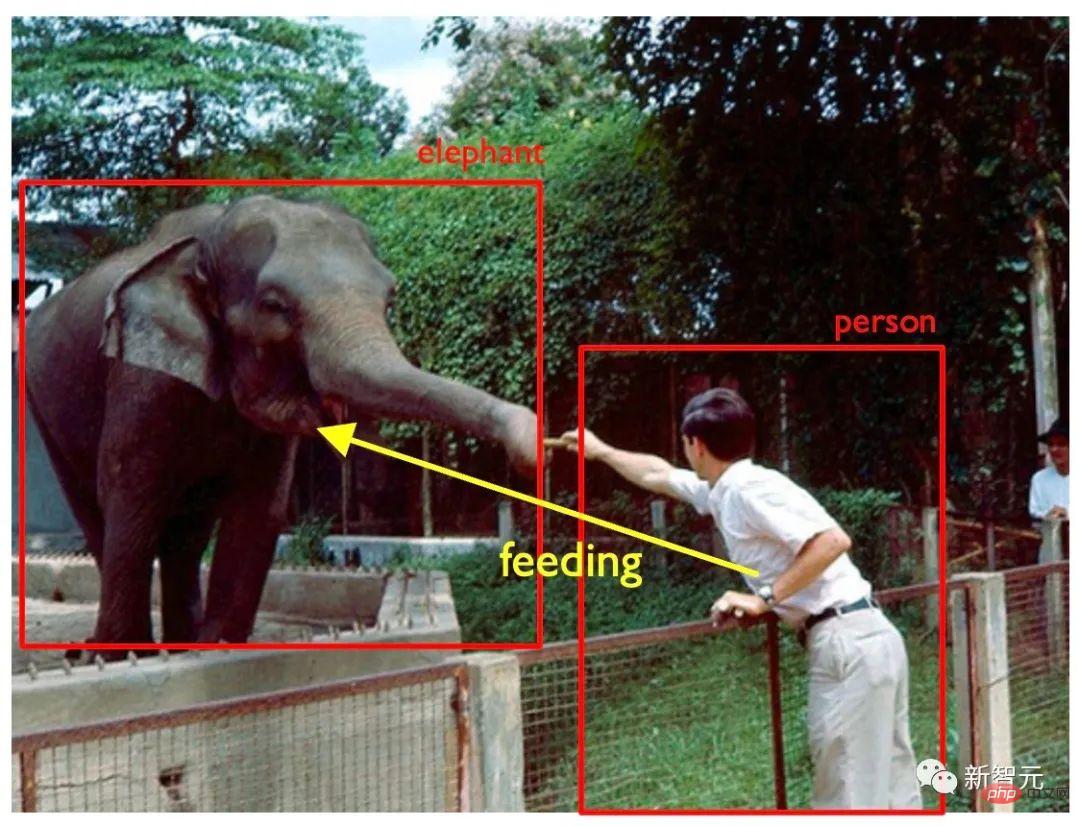

Prenons l'exemple de la figure 1 ci-dessous. Si le modèle de vision par ordinateur ne détecte que des personnes, des éléphants, des clôtures, des arbres, etc. dans l'image, nous ne pensons généralement pas que le modèle a compris l'image, et le modèle ne peut pas le faire. prendre des décisions basées sur la compréhension. Des décisions plus avancées, comme émettre un avertissement « pas d'alimentation ».

Figure 1 : Exemple de diagramme original

En fait, dans de nombreux scénarios d'IA du monde réel tels que les villes intelligentes, la conduite autonome et la fabrication intelligente, en plus de positionner des cibles dans la scène, Nous attendons également généralement des modèles qu’ils raisonnent et prédisent les relations entre les sujets dans une image. Par exemple, dans les applications de conduite autonome, les véhicules autonomes doivent analyser si les piétons au bord de la route poussent un chariot ou font du vélo. Selon la situation, les décisions ultérieures correspondantes peuvent être différentes.

Dans un scénario d'usine intelligente, pour juger si l'opérateur fonctionne correctement et en toute sécurité, il faut également que le modèle côté surveillance ait la capacité de comprendre la relation entre les sujets. La plupart des méthodes existantes définissent manuellement certaines règles codées en dur. Cela rend le modèle peu généralisable et difficile à adapter à d’autres situations spécifiques.

La tâche de génération de graphe de scène (scene graphe génération, ou SGG) vise à résoudre les problèmes ci-dessus. En plus des exigences de classification et de localisation des objets cibles, la tâche SGG nécessite également que le modèle prédise la relation entre les objets (voir Figure 2).

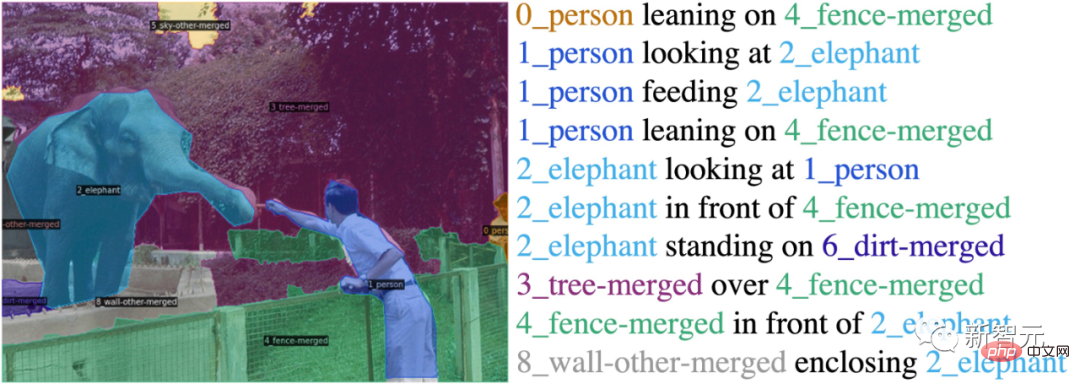

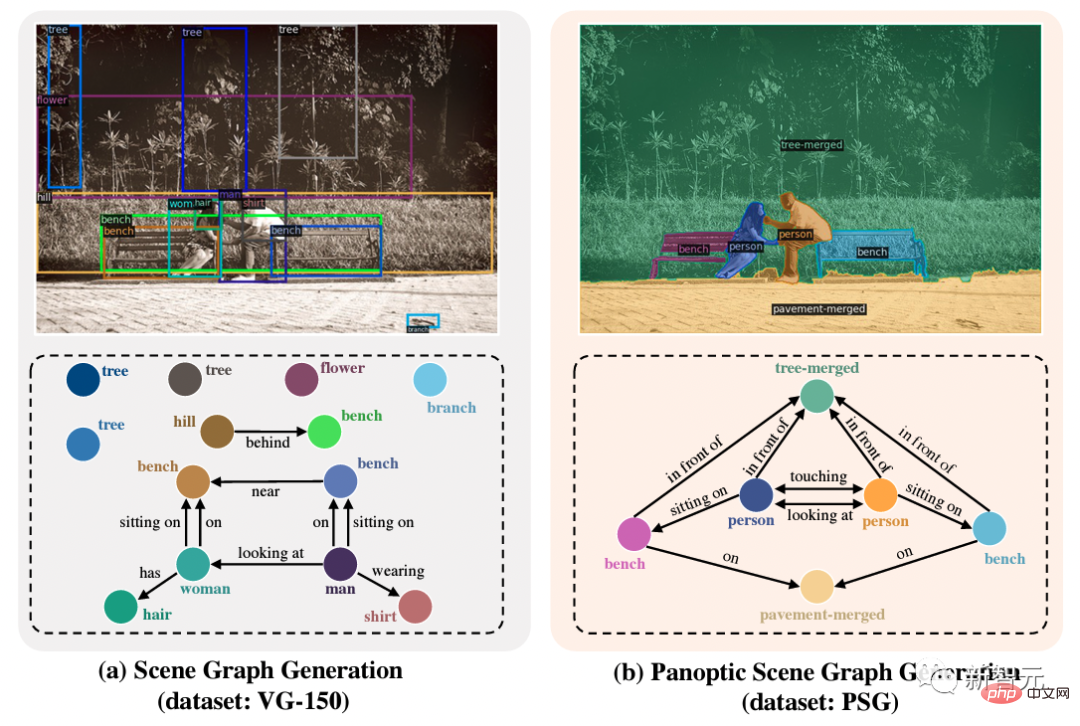

Figure 2 : Génération de graphiques de scène

Les ensembles de données pour les tâches traditionnelles de génération de graphiques de scène ont généralement des annotations de cadre de délimitation des objets et des annotations des relations entre les boîtes de délimitation. Cependant, ce paramètre présente plusieurs défauts inhérents :

(1) Les cadres de délimitation ne peuvent pas localiser avec précision les objets : comme le montre la figure 2, les cadres de délimitation incluront inévitablement les objets autour des personnes lors de l'annotation des personnes.

(2) L'arrière-plan ; ne peut pas être annoté : comme le montre la figure 2, les arbres derrière l'éléphant sont marqués d'un cadre de délimitation, qui couvre presque toute l'image, de sorte que la relation impliquant l'arrière-plan ne peut pas être annotée avec précision, ce qui rend également le graphique de scène incapable de couvrir complètement. L'image, incapable d'obtenir une compréhension complète de la scène.

Par conséquent, l'auteur propose la tâche de génération de graphiques de scène complète (PSG) avec un ensemble de données PSG à grande échelle finement annoté.

Figure 3 : Génération de graphiques de scène complets Comme le montre la figure 3, cette tâche utilise la segmentation panoramique pour localiser de manière complète et précise les objets et les arrière-plans, résolvant ainsi les lacunes inhérentes à la tâche de génération de graphiques de scène et progressant ainsi le terrain. Avancer vers une compréhension globale et approfondie de la scène.

Informations papier

Lien papier : https://arxiv.org/abs/2207.11247Page du projet : https://psgdataset.org/OpenPSG Codebase : https://github.com/Jingkang50/ Lien OpenPSGCompetition : https://www.cvmart.net/race/10349/baseECCV'22 Lien de l'atelier SenseHuman : https://sense-human.github.io/HuggingFace Lien de démonstration : https://huggingface.co/spaces/ ECCV2022/PSG

L'ensemble de données PSG proposé par l'auteur contient près de 50 000 images de coco, et sur la base de l'annotation de segmentation panoramique existante de coco, la relation entre les blocs segmentés est annotée. L'auteur définit soigneusement 56 types de relations, parmi lesquelles les relations de position (au-dessus, devant, etc.), les relations communes entre objets (suspendus, etc.), les actions biologiques communes (marcher, se tenir debout, etc.), les relations humaines. comportements (cuisine, etc.), relations dans les scènes de circulation (conduite, conduite à cheval, etc.), relations dans les scènes de mouvement (coups de pied, etc.) et relations entre arrière-plans (enfermement, etc.). L'auteur demande aux annotateurs d'utiliser des expressions verbales plus précises plutôt que des expressions plus vagues, et d'annoter les relations dans le diagramme de manière aussi complète que possible.

Affichage des effets du modèle PSG

Avantages de la tâche

L'auteur comprend une fois de plus les avantages de la tâche de génération de graphe de scène complète (PSG) à travers l'exemple ci-dessous :

L'image de gauche provient de Visual Genome (VG-150), un ensemble de données traditionnel pour la tâche SGG. On peut voir que les annotations basées sur les images de détection sont généralement inexactes et que les pixels couverts par les images de détection ne peuvent pas localiser avec précision les objets, en particulier les arrière-plans tels que les chaises et les arbres. Dans le même temps, l'annotation des relations basée sur les cadres de détection a généralement tendance à étiqueter certaines relations ennuyeuses, telles que « les gens ont une tête » et « les gens portent des vêtements ».

En revanche, la tâche PSG proposée dans l'image de droite fournit une représentation graphique de scène plus complète (y compris l'interaction du premier plan et de l'arrière-plan), plus claire (granularité de l'objet appropriée) et plus précise (précise au niveau des pixels), pour promouvoir le développement du domaine de la compréhension de la scène.

Deux grands types de modèles PSG

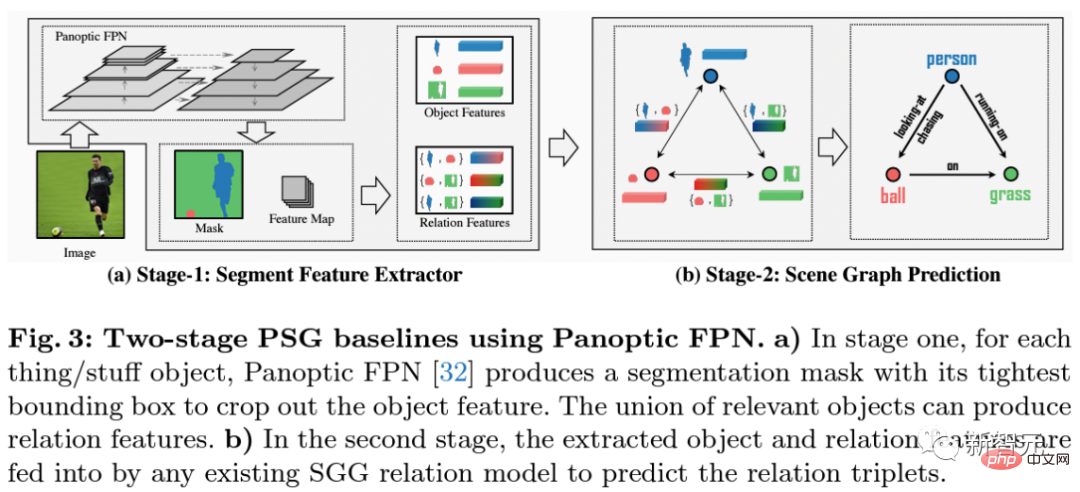

Afin de prendre en charge les tâches PSG proposées, l'auteur a construit une plateforme de code open source OpenPSG, qui implémente quatre méthodes en deux étapes et deux méthodes en une seule étape pour faciliter le développement de chacun, en utilisant , analyser.

La méthode en deux étapes utilise Panoptic-FPN pour effectuer une segmentation panoramique de l'image dans un premier temps.

Ensuite, l'auteur extrait les caractéristiques des objets obtenus par segmentation panoramique et les caractéristiques relationnelles de chaque paire de fusions d'objets, et les envoie à l'étape suivante de prédiction de relation. Le framework a intégré et reproduit les méthodes classiques de génération de graphiques de scène traditionnels IMP, VCTree, Motifs et GPSNet.

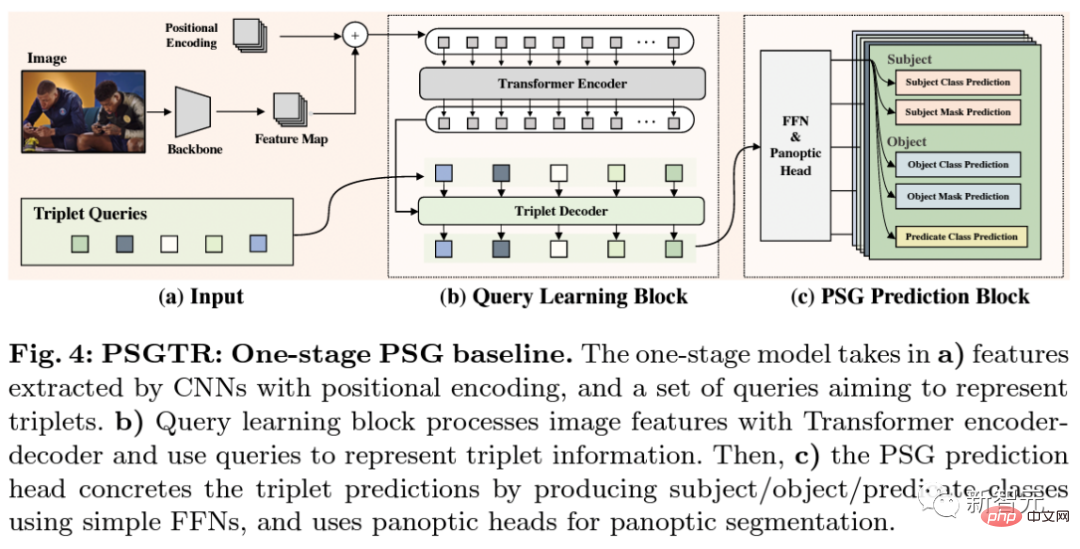

PSGFormer est une méthode en une seule étape basée sur le double décodeur DETR. Le modèle extrait d'abord les caractéristiques de l'image via l'épine dorsale du réseau neuronal convolutif en a) et ajoute des informations de codage de position comme entrée de l'encodeur. En même temps, il initialise un ensemble de requêtes pour représenter les triplets. Semblable à DETR, en b), le modèle entre la sortie de l'encodeur sous forme de clé et de valeur ainsi que les requêtes représentant les triples dans le décodeur pour une opération d'attention croisée. Le modèle entre ensuite chaque requête décodée dans le module de prédiction correspondant au triplet sujet-verbe-objet en c), et obtient finalement le résultat de prédiction du triplet correspondant.

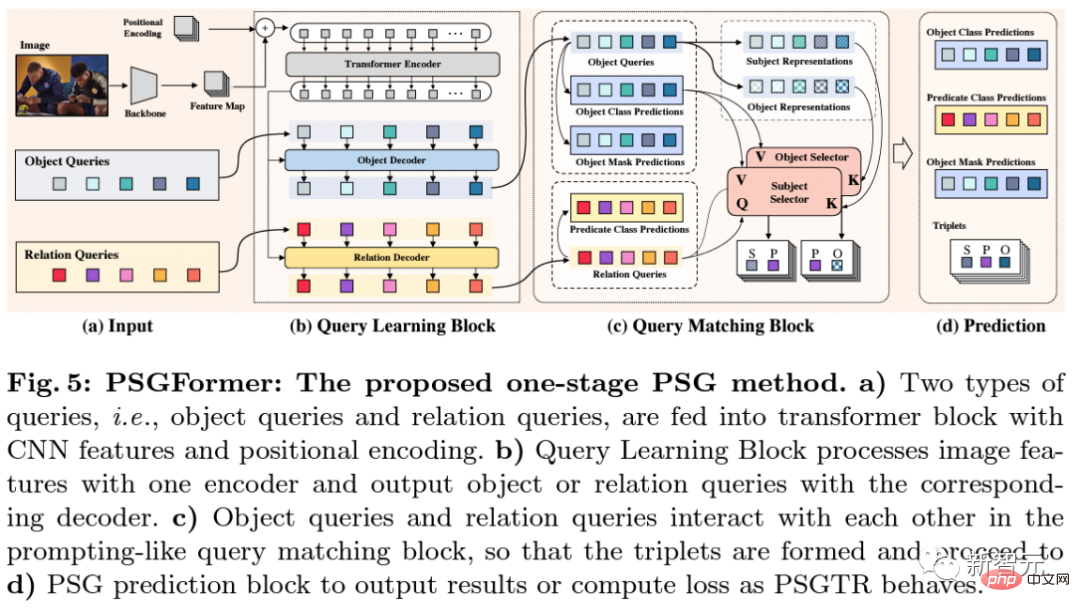

PSGFormer est une méthode DETR en une seule étape basée sur un double décodage. Le modèle a) extrait les caractéristiques de l'image via CNN, entre les informations de codage de position dans l'encodeur et initialise deux ensembles de requêtes pour représenter respectivement les objets et les relations. Ensuite, à l'étape b), sur la base des informations d'image codées par le codeur, le modèle apprend la requête d'objet et la requête de relation par décodage d'attention croisée dans le décodeur d'objet et le codeur de relation respectivement.

Une fois les deux types de requêtes apprises, les requêtes triples appariées sont obtenues par mappage et correspondance en c). Enfin, en d), les prédictions concernant la requête d'objet et la requête de relation sont complétées via la tête de prédiction, et le résultat final de la triple prédiction est obtenu sur la base des résultats de correspondance en c).

PSGTR et PSGFormer sont tous deux des modèles étendus et améliorés basés sur DETR. La différence est que PSGTR utilise un ensemble de requêtes pour modéliser directement les triples, tandis que PSGFormer utilise deux ensembles de requêtes pour modéliser respectivement les objets et les relations. et les inconvénients. Pour plus de détails, veuillez vous référer aux résultats expérimentaux dans l'article.

Conclusion Partage

La plupart des méthodes efficaces sur les tâches SGG le sont toujours sur les tâches PSG. Cependant, certaines méthodes qui utilisent des priors statistiques forts sur l'ensemble de données ou des priors sur la direction du prédicat dans le sujet, le prédicat et l'objet peuvent ne pas être aussi efficaces. Cela peut être dû au fait que le biais de l'ensemble de données PSG n'est pas si grave par rapport à l'ensemble de données VG traditionnel, et que la définition des verbes prédicats est plus claire et plus facile à apprendre. Les auteurs espèrent donc que les méthodes ultérieures se concentreront sur l’extraction d’informations visuelles et la compréhension de l’image elle-même. Les priorités statistiques peuvent être efficaces pour brosser des ensembles de données, mais elles ne sont pas essentielles.

Par rapport au modèle à deux étages, le modèle à un étage peut actuellement obtenir de meilleurs résultats. Cela peut être dû au fait que le signal de supervision concernant la relation dans le modèle à une étape peut être directement transféré du côté de la carte des caractéristiques, de sorte que le signal de relation participe à davantage d'apprentissage du modèle, ce qui est bénéfique pour la capture des relations. Cependant, comme cet article ne propose que plusieurs modèles de base et n’optimise pas les modèles à une ou deux étapes, on ne peut pas dire que le modèle à une étape est nécessairement plus solide que le modèle à deux étapes. Cela espère également que les candidats continueront à explorer.

Par rapport à la tâche SGG traditionnelle, la tâche PSG effectue une correspondance de relations basée sur la carte de segmentation panoramique et nécessite la confirmation de l'ID du sujet et des objets objets dans chaque relation. Par rapport à la prédiction directe en deux étapes de la carte de segmentation panoramique pour compléter la division des identifiants d'objets, le modèle en une seule étape doit compléter cette étape par une série de post-traitements. Si le modèle en une seule étape existant est encore amélioré et mis à niveau, la manière de compléter plus efficacement la confirmation des identifiants d'objets dans le modèle en une seule étape et de générer de meilleures images de segmentation panoramique reste un sujet qui mérite d'être exploré.

Enfin, tout le monde est invité à essayer HuggingFace :

Démo : https://huggingface.co/spaces/ECCV2022/PSG

Perspectives sur la génération d'images

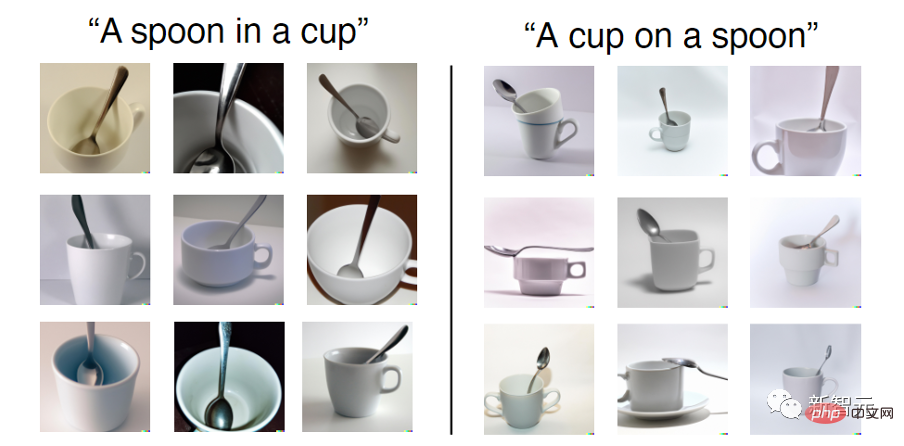

Basé sur le incendie récent Les modèles génératifs pour la saisie de texte (tels que DALL-E 2) sont vraiment étonnants, mais certaines recherches montrent que ces modèles génératifs peuvent simplement coller plusieurs entités dans le texte, sans même comprendre les relations spatiales exprimées dans le texte. Comme indiqué ci-dessous, même si l'entrée est "tasse sur cuillère", les images générées sont toujours "cuillère sur tasse".

Il se trouve que l'ensemble de données PSG est marqué d'une relation de graphe de scène basée sur un masque. L'auteur peut utiliser le graphique de scène et le masque de segmentation panoramique comme paire d'entraînement pour obtenir un modèle text2mask et générer des images plus détaillées basées sur le masque. Par conséquent, il est possible que l’ensemble de données PSG fournisse également une solution potentielle pour la génération d’images axées sur les relations.

P.S. Le « PSG Challenge », qui vise à encourager le milieu à explorer ensemble la reconnaissance globale des scènes, bat son plein. Lien du concours : https://www.cvmart.net/race/10349/base

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Bytedance Cutting lance le super abonnement SVIP : 499 yuans pour un abonnement annuel continu, offrant une variété de fonctions d'IA

Jun 28, 2024 am 03:51 AM

Bytedance Cutting lance le super abonnement SVIP : 499 yuans pour un abonnement annuel continu, offrant une variété de fonctions d'IA

Jun 28, 2024 am 03:51 AM

Ce site a rapporté le 27 juin que Jianying est un logiciel de montage vidéo développé par FaceMeng Technology, une filiale de ByteDance. Il s'appuie sur la plateforme Douyin et produit essentiellement du contenu vidéo court pour les utilisateurs de la plateforme. Il est compatible avec iOS, Android et. Windows, MacOS et autres systèmes d'exploitation. Jianying a officiellement annoncé la mise à niveau de son système d'adhésion et a lancé un nouveau SVIP, qui comprend une variété de technologies noires d'IA, telles que la traduction intelligente, la mise en évidence intelligente, l'emballage intelligent, la synthèse humaine numérique, etc. En termes de prix, les frais mensuels pour le clipping SVIP sont de 79 yuans, les frais annuels sont de 599 yuans (attention sur ce site : équivalent à 49,9 yuans par mois), l'abonnement mensuel continu est de 59 yuans par mois et l'abonnement annuel continu est de 59 yuans par mois. est de 499 yuans par an (équivalent à 41,6 yuans par mois) . En outre, le responsable de Cut a également déclaré que afin d'améliorer l'expérience utilisateur, ceux qui se sont abonnés au VIP d'origine

Assistant de codage d'IA augmenté par le contexte utilisant Rag et Sem-Rag

Jun 10, 2024 am 11:08 AM

Assistant de codage d'IA augmenté par le contexte utilisant Rag et Sem-Rag

Jun 10, 2024 am 11:08 AM

Améliorez la productivité, l’efficacité et la précision des développeurs en intégrant une génération et une mémoire sémantique améliorées par la récupération dans les assistants de codage IA. Traduit de EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG, auteur JanakiramMSV. Bien que les assistants de programmation d'IA de base soient naturellement utiles, ils ne parviennent souvent pas à fournir les suggestions de code les plus pertinentes et les plus correctes, car ils s'appuient sur une compréhension générale du langage logiciel et des modèles d'écriture de logiciels les plus courants. Le code généré par ces assistants de codage est adapté à la résolution des problèmes qu’ils sont chargés de résoudre, mais n’est souvent pas conforme aux normes, conventions et styles de codage des équipes individuelles. Cela aboutit souvent à des suggestions qui doivent être modifiées ou affinées pour que le code soit accepté dans l'application.

Le réglage fin peut-il vraiment permettre au LLM d'apprendre de nouvelles choses : l'introduction de nouvelles connaissances peut amener le modèle à produire davantage d'hallucinations

Jun 11, 2024 pm 03:57 PM

Le réglage fin peut-il vraiment permettre au LLM d'apprendre de nouvelles choses : l'introduction de nouvelles connaissances peut amener le modèle à produire davantage d'hallucinations

Jun 11, 2024 pm 03:57 PM

Les grands modèles linguistiques (LLM) sont formés sur d'énormes bases de données textuelles, où ils acquièrent de grandes quantités de connaissances du monde réel. Ces connaissances sont intégrées à leurs paramètres et peuvent ensuite être utilisées en cas de besoin. La connaissance de ces modèles est « réifiée » en fin de formation. À la fin de la pré-formation, le modèle arrête effectivement d’apprendre. Alignez ou affinez le modèle pour apprendre à exploiter ces connaissances et répondre plus naturellement aux questions des utilisateurs. Mais parfois, la connaissance du modèle ne suffit pas, et bien que le modèle puisse accéder à du contenu externe via RAG, il est considéré comme bénéfique de l'adapter à de nouveaux domaines grâce à un réglage fin. Ce réglage fin est effectué à l'aide de la contribution d'annotateurs humains ou d'autres créations LLM, où le modèle rencontre des connaissances supplémentaires du monde réel et les intègre.

Aucune donnée OpenAI requise, rejoignez la liste des grands modèles de code ! UIUC publie StarCoder-15B-Instruct

Jun 13, 2024 pm 01:59 PM

Aucune donnée OpenAI requise, rejoignez la liste des grands modèles de code ! UIUC publie StarCoder-15B-Instruct

Jun 13, 2024 pm 01:59 PM

À la pointe de la technologie logicielle, le groupe de l'UIUC Zhang Lingming, en collaboration avec des chercheurs de l'organisation BigCode, a récemment annoncé le modèle de grand code StarCoder2-15B-Instruct. Cette réalisation innovante a permis une percée significative dans les tâches de génération de code, dépassant avec succès CodeLlama-70B-Instruct et atteignant le sommet de la liste des performances de génération de code. Le caractère unique de StarCoder2-15B-Instruct réside dans sa stratégie d'auto-alignement pur. L'ensemble du processus de formation est ouvert, transparent et complètement autonome et contrôlable. Le modèle génère des milliers d'instructions via StarCoder2-15B en réponse au réglage fin du modèle de base StarCoder-15B sans recourir à des annotations manuelles coûteuses.

Afin de fournir un nouveau système de référence et d'évaluation de questions-réponses scientifiques et complexes pour les grands modèles, l'UNSW, Argonne, l'Université de Chicago et d'autres institutions ont lancé conjointement le cadre SciQAG.

Jul 25, 2024 am 06:42 AM

Afin de fournir un nouveau système de référence et d'évaluation de questions-réponses scientifiques et complexes pour les grands modèles, l'UNSW, Argonne, l'Université de Chicago et d'autres institutions ont lancé conjointement le cadre SciQAG.

Jul 25, 2024 am 06:42 AM

L'ensemble de données ScienceAI Question Answering (QA) joue un rôle essentiel dans la promotion de la recherche sur le traitement du langage naturel (NLP). Des ensembles de données d'assurance qualité de haute qualité peuvent non seulement être utilisés pour affiner les modèles, mais également évaluer efficacement les capacités des grands modèles linguistiques (LLM), en particulier la capacité à comprendre et à raisonner sur les connaissances scientifiques. Bien qu’il existe actuellement de nombreux ensembles de données scientifiques d’assurance qualité couvrant la médecine, la chimie, la biologie et d’autres domaines, ces ensembles de données présentent encore certaines lacunes. Premièrement, le formulaire de données est relativement simple, et la plupart sont des questions à choix multiples. Elles sont faciles à évaluer, mais limitent la plage de sélection des réponses du modèle et ne peuvent pas tester pleinement la capacité du modèle à répondre aux questions scientifiques. En revanche, les questions et réponses ouvertes

Yolov10 : explication détaillée, déploiement et application en un seul endroit !

Jun 07, 2024 pm 12:05 PM

Yolov10 : explication détaillée, déploiement et application en un seul endroit !

Jun 07, 2024 pm 12:05 PM

1. Introduction Au cours des dernières années, les YOLO sont devenus le paradigme dominant dans le domaine de la détection d'objets en temps réel en raison de leur équilibre efficace entre le coût de calcul et les performances de détection. Les chercheurs ont exploré la conception architecturale de YOLO, les objectifs d'optimisation, les stratégies d'expansion des données, etc., et ont réalisé des progrès significatifs. Dans le même temps, le recours à la suppression non maximale (NMS) pour le post-traitement entrave le déploiement de bout en bout de YOLO et affecte négativement la latence d'inférence. Dans les YOLO, la conception de divers composants manque d’une inspection complète et approfondie, ce qui entraîne une redondance informatique importante et limite les capacités du modèle. Il offre une efficacité sous-optimale et un potentiel d’amélioration des performances relativement important. Dans ce travail, l'objectif est d'améliorer encore les limites d'efficacité des performances de YOLO à la fois en post-traitement et en architecture de modèle. à cette fin

Les performances de SOTA, la méthode d'IA de prédiction d'affinité protéine-ligand multimodale de Xiamen, combinent pour la première fois des informations sur la surface moléculaire

Jul 17, 2024 pm 06:37 PM

Les performances de SOTA, la méthode d'IA de prédiction d'affinité protéine-ligand multimodale de Xiamen, combinent pour la première fois des informations sur la surface moléculaire

Jul 17, 2024 pm 06:37 PM

Editeur | KX Dans le domaine de la recherche et du développement de médicaments, il est crucial de prédire avec précision et efficacité l'affinité de liaison des protéines et des ligands pour le criblage et l'optimisation des médicaments. Cependant, les études actuelles ne prennent pas en compte le rôle important des informations sur la surface moléculaire dans les interactions protéine-ligand. Sur cette base, des chercheurs de l'Université de Xiamen ont proposé un nouveau cadre d'extraction de caractéristiques multimodales (MFE), qui combine pour la première fois des informations sur la surface des protéines, la structure et la séquence 3D, et utilise un mécanisme d'attention croisée pour comparer différentes modalités. alignement. Les résultats expérimentaux démontrent que cette méthode atteint des performances de pointe dans la prédiction des affinités de liaison protéine-ligand. De plus, les études d’ablation démontrent l’efficacité et la nécessité des informations sur la surface des protéines et de l’alignement des caractéristiques multimodales dans ce cadre. Les recherches connexes commencent par "S

Préparant des marchés tels que l'IA, GlobalFoundries acquiert la technologie du nitrure de gallium de Tagore Technology et les équipes associées

Jul 15, 2024 pm 12:21 PM

Préparant des marchés tels que l'IA, GlobalFoundries acquiert la technologie du nitrure de gallium de Tagore Technology et les équipes associées

Jul 15, 2024 pm 12:21 PM

Selon les informations de ce site Web du 5 juillet, GlobalFoundries a publié un communiqué de presse le 1er juillet de cette année, annonçant l'acquisition de la technologie de nitrure de gallium (GaN) et du portefeuille de propriété intellectuelle de Tagore Technology, dans l'espoir d'élargir sa part de marché dans l'automobile et Internet. des objets et des domaines d'application des centres de données d'intelligence artificielle pour explorer une efficacité plus élevée et de meilleures performances. Alors que des technologies telles que l’intelligence artificielle générative (GenerativeAI) continuent de se développer dans le monde numérique, le nitrure de gallium (GaN) est devenu une solution clé pour une gestion durable et efficace de l’énergie, notamment dans les centres de données. Ce site Web citait l'annonce officielle selon laquelle, lors de cette acquisition, l'équipe d'ingénierie de Tagore Technology rejoindrait GF pour développer davantage la technologie du nitrure de gallium. g