Le machine learning a fait de grands progrès récemment, mais il reste encore un défi majeur : le besoin de grandes quantités de données étiquetées pour entraîner le modèle.

Parfois, ce type de données n'est pas disponible dans le monde réel. Prenons l’exemple des soins de santé : nous ne disposons peut-être pas de suffisamment d’examens aux rayons X pour détecter une nouvelle maladie. Mais grâce à l'apprentissage en quelques étapes, le modèle peut apprendre des connaissances à partir de quelques exemples seulement !

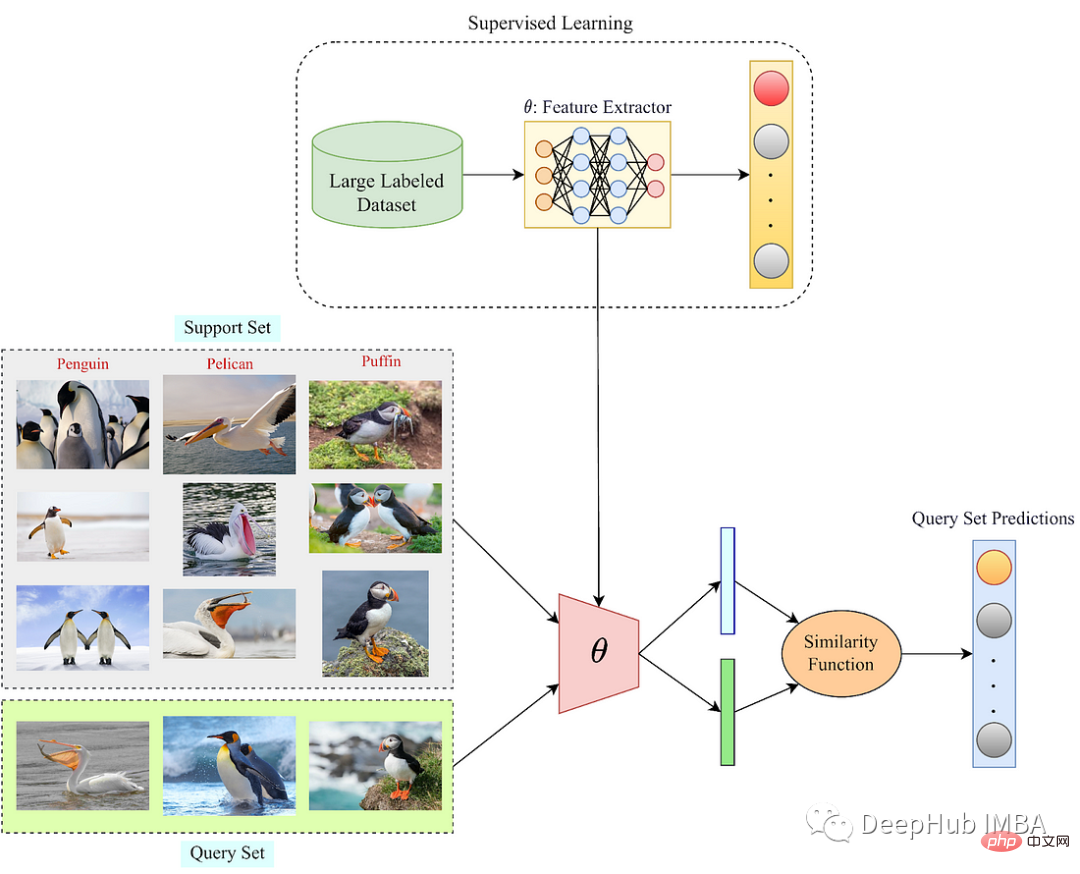

L'apprentissage en quelques étapes (FSL) est donc un sous-domaine de l'apprentissage automatique, qui résout le problème de l'apprentissage de nouvelles tâches avec seulement un petit nombre de tâches étiquetées ! exemples. L'intérêt du FSL est de permettre aux modèles d'apprentissage automatique d'apprendre de nouvelles choses avec un peu de données, ce qui est utile dans les situations où la collecte d'un ensemble de données étiquetées est trop coûteuse, prend trop de temps ou n'est pas pratique.

Prise en charge d'un ensemble d'échantillons/de requêtes : utilisez un petit nombre d'images pour classer l'ensemble de requêtes.

Il existe trois méthodes principales pour comprendre l'apprentissage en quelques étapes : le méta-apprentissage, le niveau des données et le niveau des paramètres.

Les algorithmes de méta-apprentissage entraînent généralement un modèle sur un ensemble de tâches associées et apprennent à extraire des fonctionnalités indépendantes et spécifiques à une tâche à partir des données disponibles. Les fonctionnalités indépendantes des tâches capturent les connaissances générales sur les données, tandis que les fonctionnalités spécifiques aux tâches capturent les détails de la tâche en cours. Pendant la formation, l'algorithme apprend à s'adapter aux nouvelles tâches en mettant à jour les paramètres du modèle en utilisant seulement quelques exemples étiquetés de chaque nouvelle tâche. Cela permet au modèle de se généraliser à de nouvelles tâches avec peu d'exemples.

Méthodes au niveau des données

L'idée principale est de créer de nouveaux exemples en appliquant diverses transformations aux exemples existants, ce qui peut aider le modèle à mieux comprendre la structure sous-jacente des données.

Il existe deux types de méthodes au niveau des données :

Augmentation des données : l'augmentation des données implique la création de nouveaux exemples en appliquant différentes transformations aux données existantes ;Les méthodes au niveau des paramètres visent à apprendre des représentations de fonctionnalités plus robustes qui peuvent mieux se généraliser à de nouvelles tâches.

Il existe deux méthodes au niveau des paramètres :

Extraction de fonctionnalités : l'extraction de fonctionnalités implique l'apprentissage d'un ensemble de fonctionnalités à partir des données qui peuvent être utilisées pour de nouvelles tâches ; modéliser de nouvelles tâches en apprenant les paramètres optimaux de la tâche.Le méta-apprentissage est une approche populaire du FLS, qui implique la formation d'un modèle sur une variété de tâches connexes afin qu'il puisse apprendre à apprendre efficacement de nouvelles tâches. L'algorithme apprend à extraire des fonctionnalités indépendantes et spécifiques à la tâche à partir des données disponibles, s'adaptant rapidement aux nouvelles tâches.

Méta-apprentissage basé sur des métriques

Les algorithmes de méta-apprentissage basés sur des métriques apprennent une manière spéciale de comparer différents exemples pour chaque nouvelle tâche. Ils y parviennent en mappant les exemples d’entrée dans un espace de fonctionnalités spécial où les exemples similaires sont proches les uns des autres et les exemples différents sont éloignés les uns des autres. Le modèle peut utiliser cette métrique de distance pour classer les nouveaux exemples dans la classe appropriée.

Gradient Meta-Based Learning

Le méta-apprentissage basé sur les gradients apprend à mettre à jour leurs paramètres afin qu'ils puissent s'adapter rapidement aux nouveaux défis.

Ces algorithmes entraînent les modèles à apprendre un premier ensemble de paramètres et à s'adapter rapidement à de nouvelles tâches avec seulement quelques exemples. MAML (model-agnostic meta-learning) est un algorithme de méta-apprentissage populaire basé sur le gradient qui apprend à optimiser les paramètres d'un modèle pour s'adapter rapidement à de nouvelles tâches. Il entraîne le modèle à travers une série de tâches connexes et met à jour les paramètres du modèle à l'aide de quelques exemples de chaque tâche. Une fois que le modèle a appris ces paramètres, il peut les affiner à l'aide d'autres exemples de la tâche en cours, améliorant ainsi ses performances.

FSL dispose de plusieurs algorithmes, notamment :

L'idée clé de MAML est d'apprendre l'initialisation des paramètres du modèle qui peuvent être adaptés à de nouvelles tâches avec quelques exemples. Pendant la formation, MAML accepte un ensemble de tâches associées et apprend à mettre à jour les paramètres du modèle en utilisant seulement quelques exemples étiquetés de chaque tâche. Ce processus permet au modèle de se généraliser à de nouvelles tâches en apprenant de bonnes initialisations des paramètres du modèle qui peuvent être rapidement adaptées à de nouvelles tâches.

Matching Network est un autre algorithme de classification d'images en quelques prises de vue couramment utilisé. Au lieu d'apprendre des métriques ou des paramètres fixes, il apprend des métriques dynamiques basées sur l'ensemble de supports actuel. Cela signifie que la métrique utilisée pour comparer l’image de requête et l’ensemble de supports diffère pour chaque image de requête.

L'algorithme de réseau de correspondance utilise un mécanisme d'attention pour calculer une somme pondérée des fonctionnalités de l'ensemble de support pour chaque image de requête. Les poids sont appris en fonction de la similarité entre l'image de requête et chaque image d'ensemble de supports. La somme pondérée des caractéristiques de l'ensemble de support est ensuite concaténée avec les caractéristiques de l'image de requête, et les vecteurs résultants sont passés à travers plusieurs couches entièrement connectées pour produire la classification finale.

Prototype Network est un algorithme de classification d'images en quelques prises de vue simple et efficace. Il apprend une représentation de l'image et calcule un prototype pour chaque classe en utilisant la moyenne des fonctionnalités d'intégration des exemples pris en charge. Lors des tests, la distance entre l'image de requête et chaque prototype de classe est calculée et la classe avec le prototype le plus proche est attribuée à la requête.

L'apprentissage du réseau relationnel compare les paires d'exemples prises en charge et utilise ces informations pour classer les exemples de requêtes. Le réseau de relations comprend deux sous-réseaux : le réseau d'intégration de fonctionnalités et le réseau de relations. Le réseau d'intégration de fonctionnalités mappe chaque exemple de l'ensemble de support et l'exemple de requête dans un espace de fonctionnalités. Le réseau de relations calcule ensuite le score de relation entre l'exemple de requête et chaque exemple d'ensemble de supports. Enfin, ces scores de relation sont utilisés pour classer les exemples de requêtes.

L'apprentissage en quelques plans a de nombreuses applications dans différents domaines, notamment :

Dans diverses tâches de vision par ordinateur, notamment la classification d'images, la détection d'objets et la segmentation. L'apprentissage par quelques coups permet d'identifier de nouveaux objets dans les images qui ne sont pas présents dans les données d'entraînement.

Dans les tâches de traitement du langage naturel, telles que la classification de texte, l'analyse des sentiments et la modélisation du langage, l'apprentissage en quelques étapes permet d'améliorer les performances des modèles de langage sur les langages à faibles ressources.

Utilisez l'apprentissage en quelques étapes en robotique pour permettre aux robots d'apprendre rapidement de nouvelles tâches et de s'adapter à de nouveaux environnements. Par exemple, un robot peut apprendre à ramasser de nouveaux objets avec seulement quelques exemples.

Peu d'échantillons permettent d'identifier des maladies rares et des anomalies dans le domaine du diagnostic médical lorsque les données sont limitées, et peuvent aider à personnaliser le traitement et à prédire les résultats pour les patients.

L'apprentissage en quelques coups est une technique puissante qui permet à un modèle d'apprendre à partir d'un petit nombre d'exemples. Il a de nombreuses applications dans divers domaines et a le potentiel de révolutionner l’apprentissage automatique. Avec une recherche et un développement continus, l'apprentissage en quelques étapes peut ouvrir la voie à des systèmes d'apprentissage automatique plus efficaces et efficients.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Algorithme de remplacement de page

Algorithme de remplacement de page

Le Bitcoin est-il légal en Chine ?

Le Bitcoin est-il légal en Chine ?

Comment ouvrir le fichier php

Comment ouvrir le fichier php

Quels sont les moteurs de workflow Java ?

Quels sont les moteurs de workflow Java ?

point de symbole spécial

point de symbole spécial

Que faire avec la carte vidéo

Que faire avec la carte vidéo

Introduction aux fournisseurs de services proposant des prix de serveur cloud rentables

Introduction aux fournisseurs de services proposant des prix de serveur cloud rentables

Outils de gestion MySQL couramment utilisés

Outils de gestion MySQL couramment utilisés