Périphériques technologiques

Périphériques technologiques

IA

IA

Au-delà de PaLM ! Un maître de l'Université de Pékin a proposé DiVeRSe, actualisant complètement le classement du raisonnement PNL

Au-delà de PaLM ! Un maître de l'Université de Pékin a proposé DiVeRSe, actualisant complètement le classement du raisonnement PNL

Au-delà de PaLM ! Un maître de l'Université de Pékin a proposé DiVeRSe, actualisant complètement le classement du raisonnement PNL

Les modèles de langage à grande échelle peuvent être considérés comme la pierre angulaire de la technologie moderne de traitement du langage naturel, tels que GPT-3 avec 175 milliards de paramètres et PaLM avec 540 milliards de paramètres pré-entraînés, offrant des capacités d'apprentissage très puissantes en quelques étapes. tâches en aval.

Mais les tâches de raisonnement restent un problème difficile, en particulier les questions qui nécessitent un raisonnement en plusieurs étapes pour obtenir la bonne réponse.

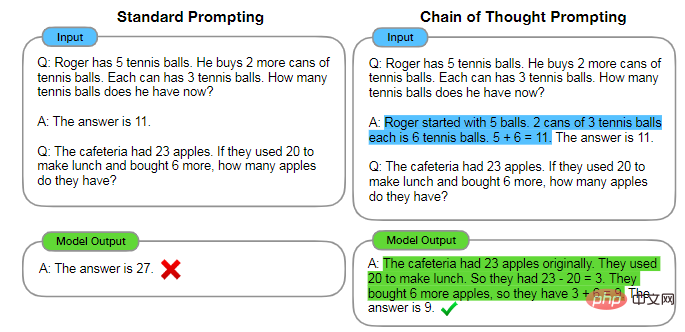

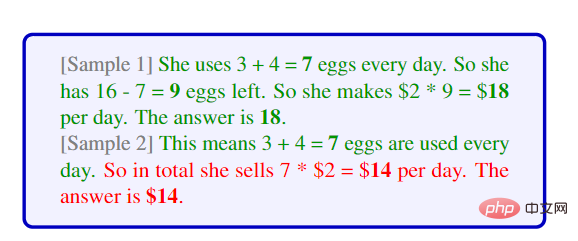

Récemment, des chercheurs ont découvert que tant qu'une invite correctement conçue peut guider le modèle pour effectuer un raisonnement en plusieurs étapes afin de générer la réponse finale, cette méthode est également appelée raisonnement en chaîne de pensée.

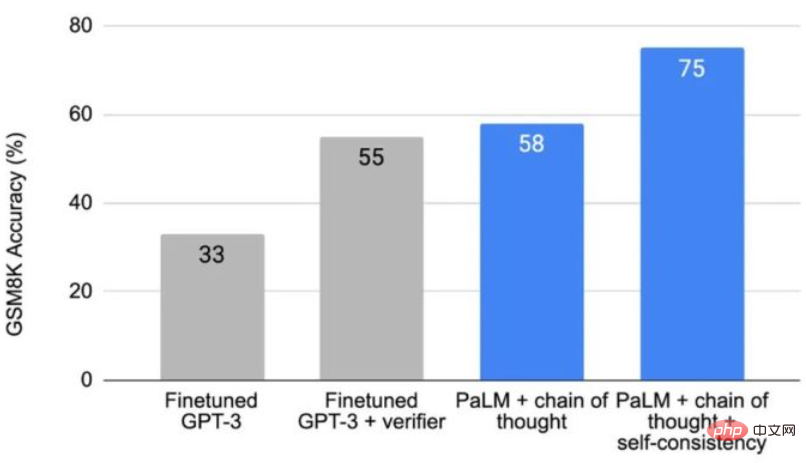

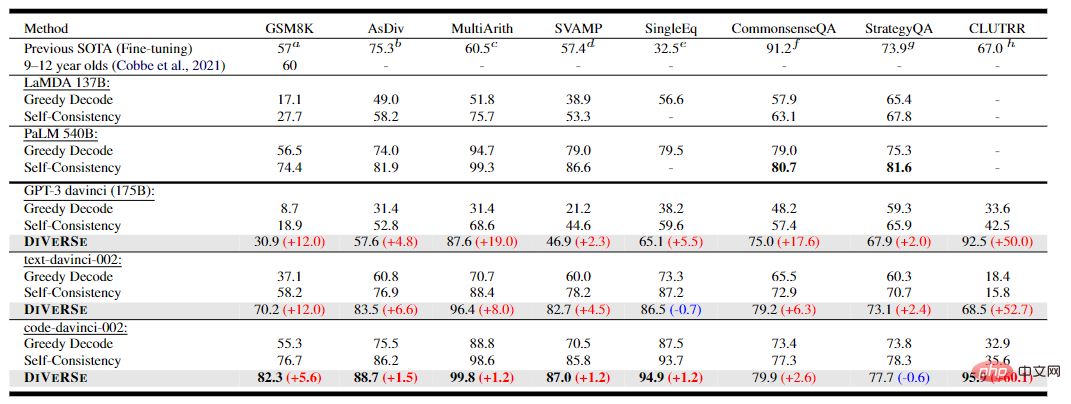

La technologie de la chaîne de pensée a augmenté la précision de 17,9 % à 58,1 % sur le test arithmétique GSM8K, et le mécanisme d'auto-cohérence introduit plus tard a encore augmenté la précision à 74,4 %

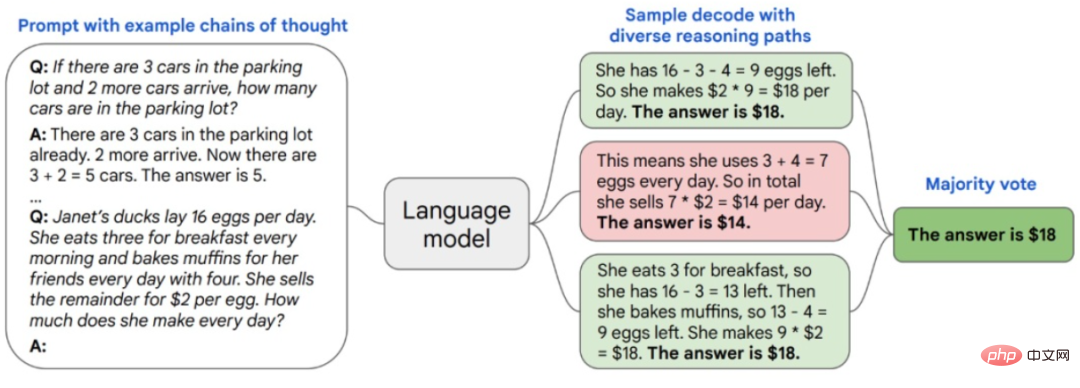

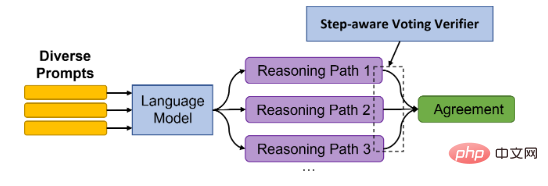

Simple Par exemple, des tâches de raisonnement complexes ont généralement plusieurs chemins de raisonnement qui peuvent conduire à des réponses correctes. La méthode auto-cohérente échantillonne un ensemble de chemins de raisonnement différents du modèle de langage à travers la chaîne de pensée, puis renvoie la réponse la plus cohérente parmi elles.

Récemment, des chercheurs de l'Université de Pékin et de Microsoft se sont basés sur la nouvelle méthode auto-cohérente DiVeRSe, qui contient trois innovations majeures et améliore encore les capacités de raisonnement du modèle.

Lien papier : https://arxiv.org/abs/2206.02336

Lien code : https://github.com/microsoft/DiVeRSe

Premièrement, affecté par l'approche auto-cohérente « différentes idées, mêmes réponses « Inspiré par l'échantillonnage de différents chemins de raisonnement à partir de modèles linguistiques, DiVerSe va encore plus loin en termes de diversité. Selon le concept de « tous les chemins mènent à Rome », plusieurs invites sont utilisées pour générer des réponses, qui peuvent générer des réponses plus complètes et plus détaillées. des réponses complémentaires.

Les chercheurs fournissent d'abord 5 invites différentes pour chaque question, puis échantillonnent 20 chemins de raisonnement pour chaque invite, et enfin génèrent 100 chemins de raisonnement de réponse pour chaque question.

Une question clé est de savoir comment obtenir différentes invites. Supposons qu'après avoir obtenu une bibliothèque d'échantillons, nous puissions en échantillonner K échantillons pour construire une invite, puis la répéter 5 fois

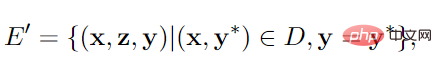

S'il n'y a pas assez d'échantillons, utilisez ensuite self. -méthode d'enseignement pour améliorer la diversité des invites, c'est-à-dire générer des pseudo chemins d'inférence et des paires à partir d'une partie des échantillons.

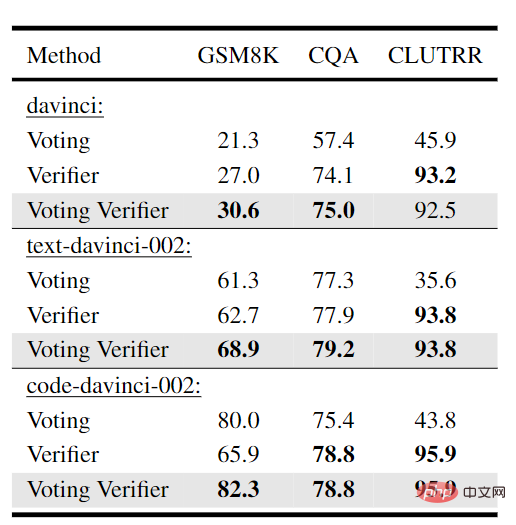

Deuxièmement, lors de la génération du chemin d'inférence, il n'existe aucun mécanisme dans le modèle de langage pour corriger les erreurs des étapes précédentes, ce qui peut prêter à confusion dans le résultat final de la prédiction. DiVeRSe s'appuie sur l'idée de vérificateur pour vérifier l'exactitude de chaque chemin de raisonnement afin de guider le mécanisme de vote. Autrement dit, tous les mécanismes de raisonnement ne sont pas aussi importants ou bons.

Supposons que nous ayons 100 chemins de raisonnement pour une question, dont 60 aboutissent à « la réponse est 110 » et dont 40 aboutissent à « la réponse est 150 ». Sans validateur (c'est-à-dire la méthode auto-cohérente d'origine), « la réponse est 110 » est un vote majoritaire, nous pouvons donc traiter 110 comme la réponse finale et supprimer les 40 raisonnements qui aboutissent à 150.

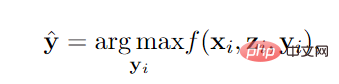

le vérificateur note le chemin de raisonnement. La fonction f est formée par un double classificateur. L'entrée est la question x, le chemin z et la réponse y, et la sortie est la probabilité de positif.

Avec le vérificateur, supposons que le score moyen des 60 chemins de raisonnement de « La réponse est 110 » est de 0,3 ; le score moyen des 40 chemins de raisonnement de « La réponse est 150 » est de 0,8. Ensuite, la réponse finale devrait être 150, car 40*0,8>60*0,3

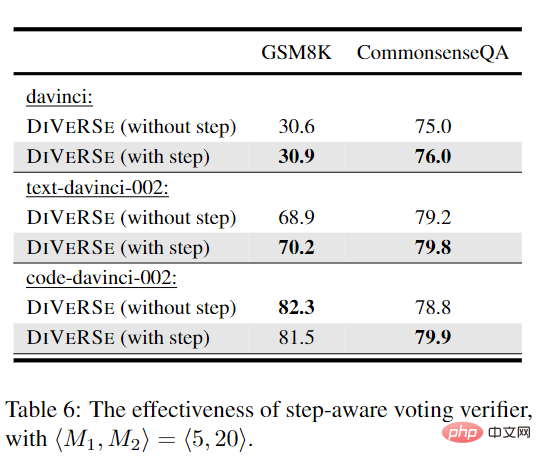

Troisièmement, puisque la réponse est générée sur la base du raisonnement de plusieurs étapes, lorsqu'un chemin génère une réponse correcte, toutes les étapes peuvent être prises en compte. . Cependant, lorsqu’une mauvaise réponse est générée, cela ne signifie pas que toutes les étapes étaient fausses ou ont contribué à l’erreur.

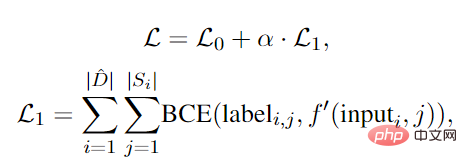

En d'autres termes, même si le résultat est erroné, certaines étapes intermédiaires peuvent toujours être correctes, mais certaines étapes de déviation ultérieures conduisent à la mauvaise réponse finale. DiVeRSe a conçu un mécanisme pour attribuer une étiquette fine à chaque étape et a proposé un vérificateur sensible aux étapes, et a attribué l'exactitude au raisonnement de chaque étape au lieu de simplement regarder la réponse finale.

Le corps principal est toujours un classificateur à deux, mais la question clé est de savoir comment obtenir l'étiquette négative au niveau de l'étape, car si la réponse finale est fausse, sans participation humaine, nous ne savons pas quelle étape est fausse et la bonne. La réponse et le processus doivent tous être corrects.

Les chercheurs ont proposé le concept de supports. Par exemple, dans les tâches arithmétiques, il doit y avoir un résultat intermédiaire d'un autre exemple qui soit le même que le résultat de l'étape intermédiaire.

Sur la base de ces trois améliorations, les chercheurs ont mené des expériences sur 5 ensembles de données de raisonnement arithmétique. On constate que la méthode DiVeRSe basée sur le code-davinci-002 a atteint un nouvel algorithme SOTA, avec un taux d'amélioration moyen de. 6,2%

Sur les deux tâches de raisonnement de bon sens, les performances de DiVeRSe sont légèrement inférieures à celles de l'autocohérence basée sur PaLM (-2,2%). est une tâche à choix multiples plutôt qu'une tâche ouverte. La tâche de génération a entraîné davantage d'instances de faux positifs.

Dans la tâche de raisonnement inductif, DiVeRSe a obtenu un score de 95,9 % à la tâche CLUTRR, dépassant le résultat de réglage fin SOTA précédent (+28,9 %)

Dans l'expérience d'ablation, on peut voir que le mécanisme de vérification du vote s'améliore performances. Plus évident.

Dans la plupart des expériences, l'extension du vérificateur de vote à une version compatible avec les étapes peut améliorer les performances. Pour le code-davinci-002 sur GSM8K, la version progressive du vérificateur entraînera une légère diminution des performances.

Les raisons possibles sont que le code-davinci-002 est plus puissant et peut produire des chemins d'inférence de meilleure qualité pour GSM8K, réduisant ainsi la nécessité d'informations au niveau des étapes, c'est-à-dire que text-davinci est plus susceptible de générer des chemins d'inférence courts/incomplets, tandis que code-davinci est plus convivial pour générer du contenu croissant.

Le premier auteur de l'article est Yifei Li. Il est diplômé de l'Université Northeastern avec un baccalauréat en génie logiciel en 2020. Il étudie actuellement pour une maîtrise à l'Université de Pékin. Son principal domaine de recherche est le traitement du langage naturel. , en particulier les invites dans les modèles de langage à grande échelle - le réglage et le raisonnement.

Le deuxième auteur de l'article est Zeqi Lin, chercheur DKI chez Microsoft Research Asia. Il a obtenu sa licence et son doctorat à l'Université de Pékin en 2014 et 2019 respectivement. Son principal domaine de recherche est l'apprentissage automatique et son application dans l'analyse logicielle. et l'analyse des données.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Bytedance Cutting lance le super abonnement SVIP : 499 yuans pour un abonnement annuel continu, offrant une variété de fonctions d'IA

Jun 28, 2024 am 03:51 AM

Bytedance Cutting lance le super abonnement SVIP : 499 yuans pour un abonnement annuel continu, offrant une variété de fonctions d'IA

Jun 28, 2024 am 03:51 AM

Ce site a rapporté le 27 juin que Jianying est un logiciel de montage vidéo développé par FaceMeng Technology, une filiale de ByteDance. Il s'appuie sur la plateforme Douyin et produit essentiellement du contenu vidéo court pour les utilisateurs de la plateforme. Il est compatible avec iOS, Android et. Windows, MacOS et autres systèmes d'exploitation. Jianying a officiellement annoncé la mise à niveau de son système d'adhésion et a lancé un nouveau SVIP, qui comprend une variété de technologies noires d'IA, telles que la traduction intelligente, la mise en évidence intelligente, l'emballage intelligent, la synthèse humaine numérique, etc. En termes de prix, les frais mensuels pour le clipping SVIP sont de 79 yuans, les frais annuels sont de 599 yuans (attention sur ce site : équivalent à 49,9 yuans par mois), l'abonnement mensuel continu est de 59 yuans par mois et l'abonnement annuel continu est de 59 yuans par mois. est de 499 yuans par an (équivalent à 41,6 yuans par mois) . En outre, le responsable de Cut a également déclaré que afin d'améliorer l'expérience utilisateur, ceux qui se sont abonnés au VIP d'origine

Assistant de codage d'IA augmenté par le contexte utilisant Rag et Sem-Rag

Jun 10, 2024 am 11:08 AM

Assistant de codage d'IA augmenté par le contexte utilisant Rag et Sem-Rag

Jun 10, 2024 am 11:08 AM

Améliorez la productivité, l’efficacité et la précision des développeurs en intégrant une génération et une mémoire sémantique améliorées par la récupération dans les assistants de codage IA. Traduit de EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG, auteur JanakiramMSV. Bien que les assistants de programmation d'IA de base soient naturellement utiles, ils ne parviennent souvent pas à fournir les suggestions de code les plus pertinentes et les plus correctes, car ils s'appuient sur une compréhension générale du langage logiciel et des modèles d'écriture de logiciels les plus courants. Le code généré par ces assistants de codage est adapté à la résolution des problèmes qu’ils sont chargés de résoudre, mais n’est souvent pas conforme aux normes, conventions et styles de codage des équipes individuelles. Cela aboutit souvent à des suggestions qui doivent être modifiées ou affinées pour que le code soit accepté dans l'application.

Sept questions d'entretien technique Cool GenAI et LLM

Jun 07, 2024 am 10:06 AM

Sept questions d'entretien technique Cool GenAI et LLM

Jun 07, 2024 am 10:06 AM

Pour en savoir plus sur l'AIGC, veuillez visiter : 51CTOAI.x Community https://www.51cto.com/aigc/Translator|Jingyan Reviewer|Chonglou est différent de la banque de questions traditionnelle que l'on peut voir partout sur Internet. nécessite de sortir des sentiers battus. Les grands modèles linguistiques (LLM) sont de plus en plus importants dans les domaines de la science des données, de l'intelligence artificielle générative (GenAI) et de l'intelligence artificielle. Ces algorithmes complexes améliorent les compétences humaines et stimulent l’efficacité et l’innovation dans de nombreux secteurs, devenant ainsi la clé permettant aux entreprises de rester compétitives. LLM a un large éventail d'applications. Il peut être utilisé dans des domaines tels que le traitement du langage naturel, la génération de texte, la reconnaissance vocale et les systèmes de recommandation. En apprenant de grandes quantités de données, LLM est capable de générer du texte

Le réglage fin peut-il vraiment permettre au LLM d'apprendre de nouvelles choses : l'introduction de nouvelles connaissances peut amener le modèle à produire davantage d'hallucinations

Jun 11, 2024 pm 03:57 PM

Le réglage fin peut-il vraiment permettre au LLM d'apprendre de nouvelles choses : l'introduction de nouvelles connaissances peut amener le modèle à produire davantage d'hallucinations

Jun 11, 2024 pm 03:57 PM

Les grands modèles linguistiques (LLM) sont formés sur d'énormes bases de données textuelles, où ils acquièrent de grandes quantités de connaissances du monde réel. Ces connaissances sont intégrées à leurs paramètres et peuvent ensuite être utilisées en cas de besoin. La connaissance de ces modèles est « réifiée » en fin de formation. À la fin de la pré-formation, le modèle arrête effectivement d’apprendre. Alignez ou affinez le modèle pour apprendre à exploiter ces connaissances et répondre plus naturellement aux questions des utilisateurs. Mais parfois, la connaissance du modèle ne suffit pas, et bien que le modèle puisse accéder à du contenu externe via RAG, il est considéré comme bénéfique de l'adapter à de nouveaux domaines grâce à un réglage fin. Ce réglage fin est effectué à l'aide de la contribution d'annotateurs humains ou d'autres créations LLM, où le modèle rencontre des connaissances supplémentaires du monde réel et les intègre.

Afin de fournir un nouveau système de référence et d'évaluation de questions-réponses scientifiques et complexes pour les grands modèles, l'UNSW, Argonne, l'Université de Chicago et d'autres institutions ont lancé conjointement le cadre SciQAG.

Jul 25, 2024 am 06:42 AM

Afin de fournir un nouveau système de référence et d'évaluation de questions-réponses scientifiques et complexes pour les grands modèles, l'UNSW, Argonne, l'Université de Chicago et d'autres institutions ont lancé conjointement le cadre SciQAG.

Jul 25, 2024 am 06:42 AM

L'ensemble de données ScienceAI Question Answering (QA) joue un rôle essentiel dans la promotion de la recherche sur le traitement du langage naturel (NLP). Des ensembles de données d'assurance qualité de haute qualité peuvent non seulement être utilisés pour affiner les modèles, mais également évaluer efficacement les capacités des grands modèles linguistiques (LLM), en particulier la capacité à comprendre et à raisonner sur les connaissances scientifiques. Bien qu’il existe actuellement de nombreux ensembles de données scientifiques d’assurance qualité couvrant la médecine, la chimie, la biologie et d’autres domaines, ces ensembles de données présentent encore certaines lacunes. Premièrement, le formulaire de données est relativement simple, et la plupart sont des questions à choix multiples. Elles sont faciles à évaluer, mais limitent la plage de sélection des réponses du modèle et ne peuvent pas tester pleinement la capacité du modèle à répondre aux questions scientifiques. En revanche, les questions et réponses ouvertes

Cinq écoles d'apprentissage automatique que vous ne connaissez pas

Jun 05, 2024 pm 08:51 PM

Cinq écoles d'apprentissage automatique que vous ne connaissez pas

Jun 05, 2024 pm 08:51 PM

L'apprentissage automatique est une branche importante de l'intelligence artificielle qui donne aux ordinateurs la possibilité d'apprendre à partir de données et d'améliorer leurs capacités sans être explicitement programmés. L'apprentissage automatique a un large éventail d'applications dans divers domaines, de la reconnaissance d'images et du traitement du langage naturel aux systèmes de recommandation et à la détection des fraudes, et il change notre façon de vivre. Il existe de nombreuses méthodes et théories différentes dans le domaine de l'apprentissage automatique, parmi lesquelles les cinq méthodes les plus influentes sont appelées les « Cinq écoles d'apprentissage automatique ». Les cinq grandes écoles sont l’école symbolique, l’école connexionniste, l’école évolutionniste, l’école bayésienne et l’école analogique. 1. Le symbolisme, également connu sous le nom de symbolisme, met l'accent sur l'utilisation de symboles pour le raisonnement logique et l'expression des connaissances. Cette école de pensée estime que l'apprentissage est un processus de déduction inversée, à travers les connaissances existantes.

Algorithme de détection amélioré : pour la détection de cibles dans des images de télédétection optique haute résolution

Jun 06, 2024 pm 12:33 PM

Algorithme de détection amélioré : pour la détection de cibles dans des images de télédétection optique haute résolution

Jun 06, 2024 pm 12:33 PM

01Aperçu des perspectives Actuellement, il est difficile d'atteindre un équilibre approprié entre efficacité de détection et résultats de détection. Nous avons développé un algorithme YOLOv5 amélioré pour la détection de cibles dans des images de télédétection optique haute résolution, en utilisant des pyramides de caractéristiques multicouches, des stratégies de têtes de détection multiples et des modules d'attention hybrides pour améliorer l'effet du réseau de détection de cibles dans les images de télédétection optique. Selon l'ensemble de données SIMD, le mAP du nouvel algorithme est 2,2 % meilleur que YOLOv5 et 8,48 % meilleur que YOLOX, permettant ainsi d'obtenir un meilleur équilibre entre les résultats de détection et la vitesse. 02 Contexte et motivation Avec le développement rapide de la technologie de télédétection, les images de télédétection optique à haute résolution ont été utilisées pour décrire de nombreux objets à la surface de la Terre, notamment des avions, des voitures, des bâtiments, etc. Détection d'objets dans l'interprétation d'images de télédétection

Les performances de SOTA, la méthode d'IA de prédiction d'affinité protéine-ligand multimodale de Xiamen, combinent pour la première fois des informations sur la surface moléculaire

Jul 17, 2024 pm 06:37 PM

Les performances de SOTA, la méthode d'IA de prédiction d'affinité protéine-ligand multimodale de Xiamen, combinent pour la première fois des informations sur la surface moléculaire

Jul 17, 2024 pm 06:37 PM

Editeur | KX Dans le domaine de la recherche et du développement de médicaments, il est crucial de prédire avec précision et efficacité l'affinité de liaison des protéines et des ligands pour le criblage et l'optimisation des médicaments. Cependant, les études actuelles ne prennent pas en compte le rôle important des informations sur la surface moléculaire dans les interactions protéine-ligand. Sur cette base, des chercheurs de l'Université de Xiamen ont proposé un nouveau cadre d'extraction de caractéristiques multimodales (MFE), qui combine pour la première fois des informations sur la surface des protéines, la structure et la séquence 3D, et utilise un mécanisme d'attention croisée pour comparer différentes modalités. alignement. Les résultats expérimentaux démontrent que cette méthode atteint des performances de pointe dans la prédiction des affinités de liaison protéine-ligand. De plus, les études d’ablation démontrent l’efficacité et la nécessité des informations sur la surface des protéines et de l’alignement des caractéristiques multimodales dans ce cadre. Les recherches connexes commencent par "S