Périphériques technologiques

Périphériques technologiques

IA

IA

Modèle open source, formation sur une seule carte, vous amène à comprendre la technologie populaire de génération audio guidée par texte AudioLDM

Modèle open source, formation sur une seule carte, vous amène à comprendre la technologie populaire de génération audio guidée par texte AudioLDM

Modèle open source, formation sur une seule carte, vous amène à comprendre la technologie populaire de génération audio guidée par texte AudioLDM

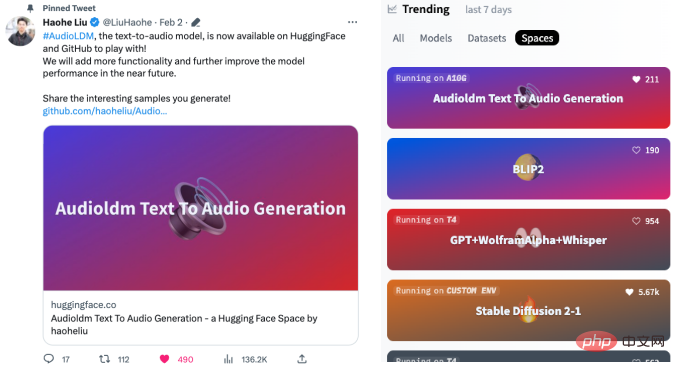

À partir d'un morceau de texte, l'intelligence artificielle peut générer de la musique, de la voix, divers effets sonores et même des sons imaginaires, tels que des trous noirs et des pistolets laser. AudioLDM, récemment lancé conjointement par l'Université de Surrey et l'Imperial College de Londres, est rapidement devenu populaire à l'étranger après sa sortie. Il a reçu près de 300 retweets et 1 500 likes sur Twitter en une semaine. Le deuxième jour après que le modèle ait été open source, AudioLDM s'est précipité en tête de la liste de recherche chaude de Hugging Face et, en une semaine, est entré dans la liste des 40 applications les plus populaires de Hugging Face (environ 25 000 au total), et est rapidement apparu dans de nombreux Travail dérivé basé sur AudioLDM.

Le modèle AudioLDM présente les points forts suivants :

- Le premier modèle open source capable de générer simultanément de la musique, de la parole et des effets sonores à partir de texte.

- Développé par le monde universitaire, il utilise moins de données, un seul GPU et des modèles plus petits pour obtenir les meilleurs résultats actuellement.

- Propose d'entraîner le modèle génératif de manière auto-supervisée, afin que la génération audio guidée par texte ne soit plus limitée par le problème des paires de données (texte-audio) manquantes.

- Le modèle peut réaliser un transfert de style audio, un remplissage audio manquant et une super-résolution audio sans formation supplémentaire (zéro-shot).

- Page d'accueil du projet : https://audioldm.github.io/

- Papier : https://arxiv.org/abs/2301.12503

- Code open source et modèle : https://github.com/haoheliu/AudioLDM

- Hugging Face Space : https://huggingface.co/spaces/haoheliu/audioldm-text-to-audio-generation

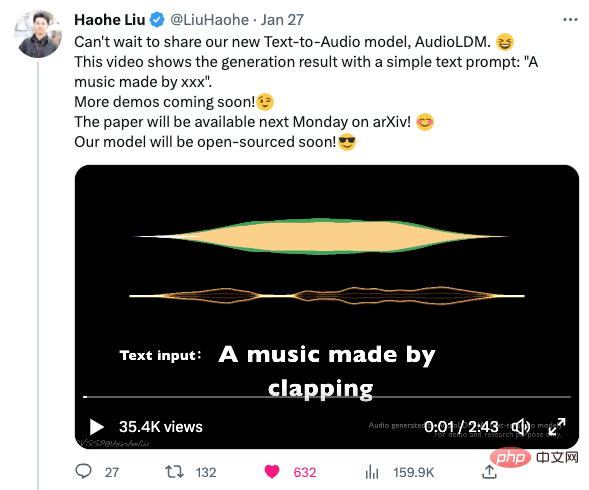

L'auteur a publié pour la première fois un aperçu du modèle le 27 janvier, montrant un texte très simple : "Une musique faite par []" (un morceau de musique généré par []) pour générer différents effets sonores. La vidéo, qui montre de la musique composée de différents instruments et même d'un moustique, a rapidement gagné du terrain sur Twitter, étant jouée plus de 35 400 fois et retweetée plus de 130 fois.

Ensuite, l'auteur a publié le document et une nouvelle vidéo. Dans cette vidéo, l'auteur démontre la plupart des capacités du modèle, ainsi que l'effet du travail avec ChatGPT pour générer des sons. AudioLDM peut même générer des sons provenant de l’espace.

Puis l'auteur a publié un article, un modèle pré-entraîné et une interface jouable, qui ont enflammé l'enthousiasme des internautes de Twitter et sont rapidement arrivés en tête de la liste de recherche chaude de Hugging Face le lendemain :

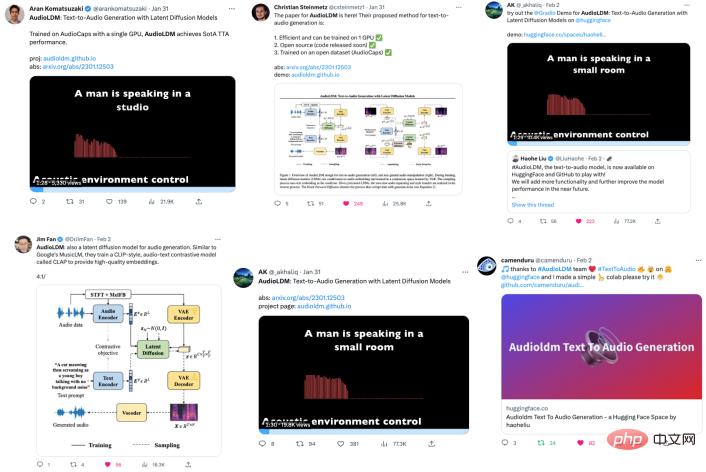

Ce travail a reçu une large attention sur Twitter, et des chercheurs du secteur ont transmis et commenté :

Les internautes ont utilisé AudioLDM pour générer une variété de sons .

Par exemple, il y a des sons générés de la fille chat en deux dimensions qui ronfle :

et des sons de fantômes :

Certains internautes l'ont synthétisé : "Voix de maman, basse fréquence, avec quelques gémissements douloureux".

Certains internautes ont même synthétisé : "melody pet sound".

Je dois admirer la riche imagination des internautes.

Certains internautes ont directement utilisé AudioLDM pour générer une série d'albums de musique dans divers styles, dont le jazz, le funk, l'électronique et le classique. Certaines musiques sont assez inventives.

Par exemple "Créer une musique d'ambiance sur le thème de l'univers et de la lune" :

et "Créer une musique utilisant des sons du futur" :

Les lecteurs intéressés peuvent visiter le site Web de cet album musical : https://www.latent.store/albums

Certains internautes ont également utilisé leur imagination pour créer une application de génération d'effets sonores guidée par l'image en combinant le texte généré par l'image. modèle et AudioLDM.

Par exemple, si vous donnez à AudioLDM ce texte : "Un chien qui court dans l'eau avec un frisbee" (un chien qui court dans l'eau avec un frisbee dans la gueule) :

peut être généré comme suit Le bruit des chiens clapotant l'eau.

Vous pouvez même restaurer les sons d'anciennes photos, comme l'image ci-dessous :

Après avoir obtenu "Un homme et une femme assis dans un bar" (Un homme et une femme assis dans une barre) ) texte, le modèle peut générer les sons suivants, où vous pouvez entendre des voix vagues et le bruit des verres à vin tinter en arrière-plan.

Certains internautes ont utilisé AudioLDM pour générer le son d'un chien enflammé, ce qui est très intéressant.

L'auteur a également produit une vidéo pour démontrer la capacité du modèle à générer des effets sonores, montrant comment les échantillons générés par AudioLDM sont proches de l'effet de la bibliothèque d'effets sonores.

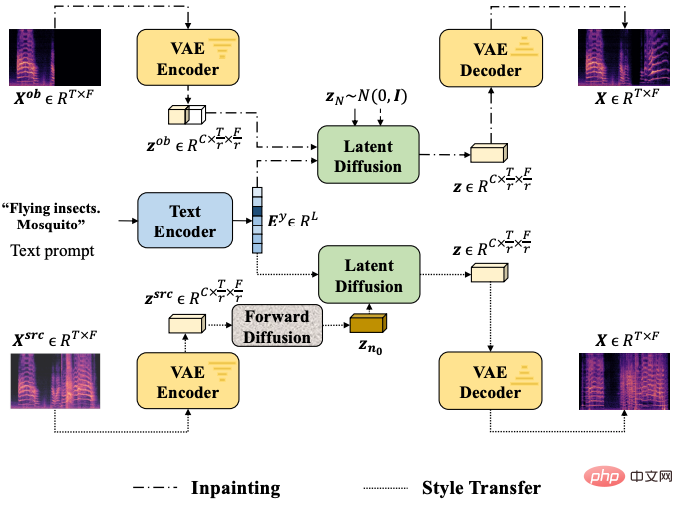

En fait, la génération audio de texte n'est qu'une partie des capacités d'AudioLDM peut également réaliser une conversion de timbre, un remplissage manquant et une super-résolution.

Les deux images ci-dessous montrent la conversion du timbre de (1) percussions à la musique d'ambiance et (2) de la trompette au chant des enfants ;

Ci-dessous l'effet des percussions sur la musique ambiante (intensité de conversion progressive).

L'effet de transformer le son de la trompette en le son d'un enfant chantant (intensité de conversion progressive).

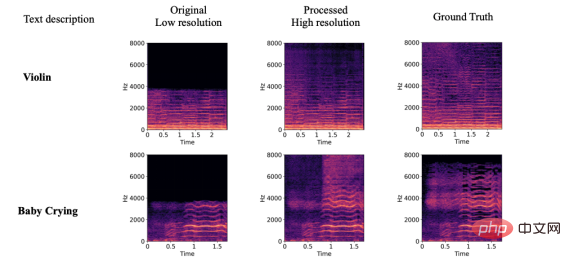

Ci-dessous, nous montrerons l'effet du modèle sur la super-résolution audio, le remplissage audio manquant et le contrôle du matériau sonore. En raison de la longueur limitée de l'article, l'audio est principalement affiché sous forme de spectrogrammes. Les lecteurs intéressés doivent se rendre sur la page d'accueil du projet AudioLDM : https://audioldm.github.io/

.En termes de super-résolution audio, l'effet d'AudioLDM est également très bon. Par rapport au modèle de super-résolution précédent, AudioLDM est un modèle de super-résolution universel et ne se limite pas au traitement de la musique et de la parole.

En termes de remplissage audio manquant, AudioLDM peut remplir différents contenus audio en fonction du texte donné, et la transition à la frontière est plus naturelle.

De plus, AudioLDM présente également de fortes capacités de contrôle, telles que la capacité de contrôler l'environnement acoustique, l'ambiance et la vitesse de la musique, les matériaux des objets, la hauteur et la séquence, etc. Les lecteurs intéressés peuvent consulter l'article AudioLDM ou page d'accueil du projet à afficher.

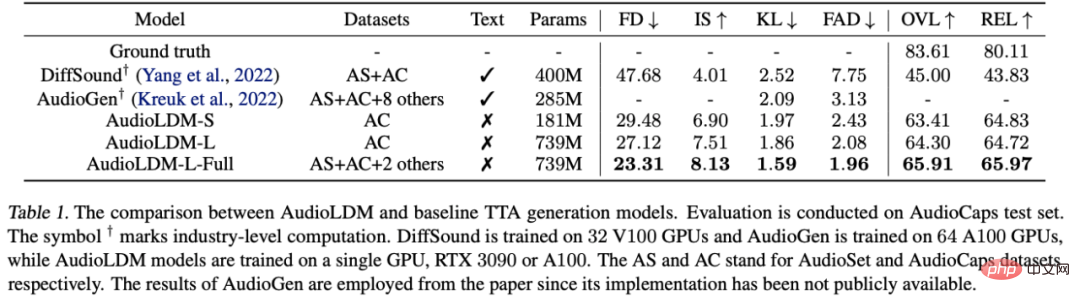

Dans l'article, l'auteur a fait une évaluation subjective et un indicateur objectif du modèle AudioLDM, et les résultats ont montré qu'il peut largement dépasser le modèle optimal précédent :

Parmi eux, AudioGen est celui d'octobre 2022 de Facebook. Le modèle proposé utilise dix ensembles de données, 64 GPU et 285 Mo de paramètres. En comparaison, AudioLDM-S peut obtenir de meilleurs résultats avec un seul ensemble de données, 1 GPU et 181 Mo de paramètres.

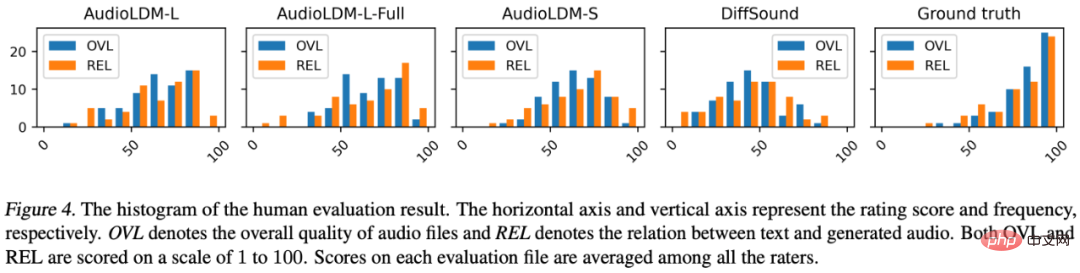

La notation subjective montre également qu'AudioLDM est nettement meilleur que la solution précédente DiffSound. Alors, quelles améliorations AudioLDM a-t-il apportées pour que le modèle ait d'aussi excellentes performances ?

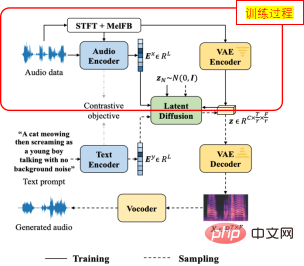

Tout d'abord, afin de résoudre le problème du trop petit nombre de paires de données texte-audio, l'auteur a proposé une méthode auto-supervisée pour entraîner AudioLDM.

Plus précisément, lors de la formation des LDM du module de base, l'auteur utilise l'intégration de l'audio lui-même comme signal de condition des LDM. L'ensemble du processus n'implique pas l'utilisation de texte (comme indiqué dans le. figure ci-dessus). Ce schéma est basé sur une paire d'encodeurs d'apprentissage contrastif audio-texte (CLAP) pré-entraînés, qui ont démontré de bonnes capacités de généralisation dans le texte CLAP original. AudioLDM tire parti des excellentes capacités de généralisation de CLAP pour réaliser une formation de modèles sur des données audio à grande échelle sans avoir besoin d'étiquettes de texte.

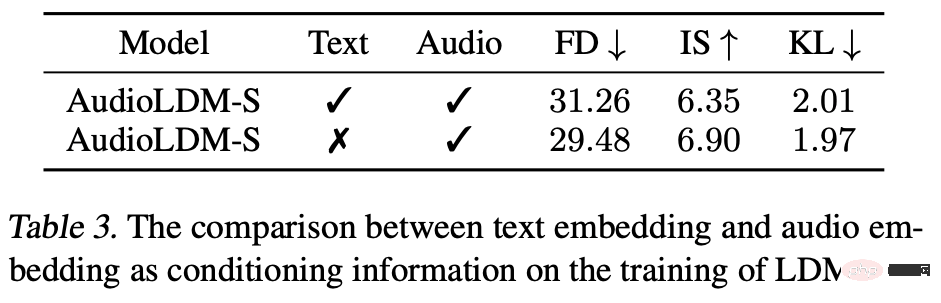

En fait, l'auteur a découvert que l'utilisation de la formation audio seule est encore meilleure que l'utilisation de paires de données audio-texte :

L'auteur a analysé deux raisons : (1) L'annotation de texte elle-même est difficile à inclure l'audio Toutes les informations, telles que l'environnement acoustique, la distribution des fréquences, etc., ce qui fait que l'intégration du texte ne peut pas bien représenter l'audio (2) La qualité du texte lui-même n'est pas parfaite. annotation "Bateaux : Battleships-5.25 espace convoyeur", ce type d'annotation est difficile même pour les humains d'imaginer quel est le son spécifique, ce qui posera des problèmes dans la formation du modèle. En revanche, l’utilisation de l’audio lui-même comme condition du LDM peut garantir une forte corrélation entre l’audio cible et la condition, obtenant ainsi de meilleurs résultats de génération.

De plus, la solution de Diffusion Latente adoptée par l'auteur permet de calculer le modèle de Diffusion dans un espace plus petit, réduisant ainsi considérablement les besoins en puissance de calcul du modèle.

De nombreuses explorations détaillées dans la formation et la structure des modèles aident également AudioLDM à obtenir d'excellentes performances.

L'auteur a également dessiné un schéma de structure simple pour présenter les deux principales tâches en aval :

L'auteur a également mené des expériences détaillées sur différentes structures de modèles, tailles de modèles, étapes d'échantillonnage DDIM et différentes échelles de guidage sans classificateur.

Tout en rendant le modèle public, les auteurs ont également divulgué la base de code de leur système d'évaluation de modèle génératif afin d'unifier les méthodes d'évaluation de la communauté universitaire sur de telles questions à l'avenir, facilitant ainsi les comparaisons entre les articles. lien suivant Support : https://github.com/haoheliu/audioldm_eval

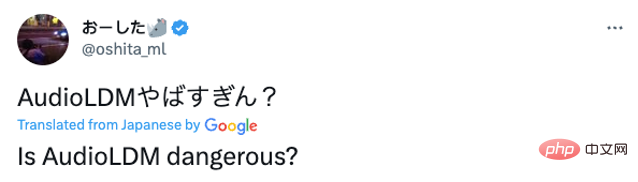

Bien que cette technologie soit devenue populaire, certains internautes ont également remis en question la sécurité de la technologie :

L'équipe de l'auteur a déclaré qu'elle limiterait l'utilisation du modèle, en particulier l'utilisation commerciale, pour garantir que le modèle n'est utilisé qu'à des fins de communication académique, et qu'elle utiliserait une LICENCE et une protection par filigrane appropriées pour éviter que des problèmes éthiques ne surviennent.

Informations sur l'auteur

L'article est composé de deux co-auteurs : Liu Haohe (Université du Surrey, Royaume-Uni) et Chen Zehua (Imperial College London, Royaume-Uni).

Liu Haohe étudie actuellement pour son doctorat à l'Université de Surrey, au Royaume-Uni, sous la direction du professeur Mark D. Plumbley. Ses projets open source ont reçu des milliers d'étoiles sur GitHub. Il a publié plus de 20 articles lors de conférences universitaires majeures et a remporté les trois premiers classements de plusieurs concours mondiaux d'acoustique des machines. Dans le monde de l'entreprise, il coopère étroitement avec Microsoft, ByteDance, la British Broadcasting Corporation, etc. Page d'accueil personnelle : https://www.surrey.ac.uk/people/haohe-liu

Chen Zehua est doctorant à l'Imperial College de Londres, auprès du professeur Danilo Mandic. Il a effectué un stage au Microsoft Speech Synthesis Research Group et au JD Artificial Intelligence Laboratory. Ses intérêts de recherche incluent les modèles génératifs, la synthèse vocale et la génération de signaux bioélectriques.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Le modèle MoE open source le plus puissant au monde est ici, avec des capacités chinoises comparables à celles du GPT-4, et le prix ne représente que près d'un pour cent de celui du GPT-4-Turbo.

May 07, 2024 pm 04:13 PM

Le modèle MoE open source le plus puissant au monde est ici, avec des capacités chinoises comparables à celles du GPT-4, et le prix ne représente que près d'un pour cent de celui du GPT-4-Turbo.

May 07, 2024 pm 04:13 PM

Imaginez un modèle d'intelligence artificielle qui non seulement a la capacité de surpasser l'informatique traditionnelle, mais qui permet également d'obtenir des performances plus efficaces à moindre coût. Ce n'est pas de la science-fiction, DeepSeek-V2[1], le modèle MoE open source le plus puissant au monde est ici. DeepSeek-V2 est un puissant mélange de modèle de langage d'experts (MoE) présentant les caractéristiques d'une formation économique et d'une inférence efficace. Il est constitué de 236B paramètres, dont 21B servent à activer chaque marqueur. Par rapport à DeepSeek67B, DeepSeek-V2 offre des performances plus élevées, tout en économisant 42,5 % des coûts de formation, en réduisant le cache KV de 93,3 % et en augmentant le débit de génération maximal à 5,76 fois. DeepSeek est une entreprise explorant l'intelligence artificielle générale

L'IA bouleverse la recherche mathématique ! Le lauréat de la médaille Fields et mathématicien sino-américain a dirigé 11 articles les mieux classés | Aimé par Terence Tao

Apr 09, 2024 am 11:52 AM

L'IA bouleverse la recherche mathématique ! Le lauréat de la médaille Fields et mathématicien sino-américain a dirigé 11 articles les mieux classés | Aimé par Terence Tao

Apr 09, 2024 am 11:52 AM

L’IA change effectivement les mathématiques. Récemment, Tao Zhexuan, qui a prêté une attention particulière à cette question, a transmis le dernier numéro du « Bulletin de l'American Mathematical Society » (Bulletin de l'American Mathematical Society). En se concentrant sur le thème « Les machines changeront-elles les mathématiques ? », de nombreux mathématiciens ont exprimé leurs opinions. L'ensemble du processus a été plein d'étincelles, intense et passionnant. L'auteur dispose d'une équipe solide, comprenant Akshay Venkatesh, lauréat de la médaille Fields, le mathématicien chinois Zheng Lejun, l'informaticien de l'Université de New York Ernest Davis et de nombreux autres universitaires bien connus du secteur. Le monde de l’IA a radicalement changé. Vous savez, bon nombre de ces articles ont été soumis il y a un an.

Google est ravi : les performances de JAX surpassent Pytorch et TensorFlow ! Cela pourrait devenir le choix le plus rapide pour la formation à l'inférence GPU

Apr 01, 2024 pm 07:46 PM

Google est ravi : les performances de JAX surpassent Pytorch et TensorFlow ! Cela pourrait devenir le choix le plus rapide pour la formation à l'inférence GPU

Apr 01, 2024 pm 07:46 PM

Les performances de JAX, promu par Google, ont dépassé celles de Pytorch et TensorFlow lors de récents tests de référence, se classant au premier rang sur 7 indicateurs. Et le test n’a pas été fait sur le TPU présentant les meilleures performances JAX. Bien que parmi les développeurs, Pytorch soit toujours plus populaire que Tensorflow. Mais à l’avenir, des modèles plus volumineux seront peut-être formés et exécutés sur la base de la plate-forme JAX. Modèles Récemment, l'équipe Keras a comparé trois backends (TensorFlow, JAX, PyTorch) avec l'implémentation native de PyTorch et Keras2 avec TensorFlow. Premièrement, ils sélectionnent un ensemble de

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas entre officiellement dans l’ère des robots électriques ! Hier, l'Atlas hydraulique s'est retiré "en larmes" de la scène de l'histoire. Aujourd'hui, Boston Dynamics a annoncé que l'Atlas électrique était au travail. Il semble que dans le domaine des robots humanoïdes commerciaux, Boston Dynamics soit déterminé à concurrencer Tesla. Après la sortie de la nouvelle vidéo, elle a déjà été visionnée par plus d’un million de personnes en seulement dix heures. Les personnes âgées partent et de nouveaux rôles apparaissent. C'est une nécessité historique. Il ne fait aucun doute que cette année est l’année explosive des robots humanoïdes. Les internautes ont commenté : Les progrès des robots ont fait ressembler la cérémonie d'ouverture de cette année à des êtres humains, et le degré de liberté est bien plus grand que celui des humains. Mais n'est-ce vraiment pas un film d'horreur ? Au début de la vidéo, Atlas est allongé calmement sur le sol, apparemment sur le dos. Ce qui suit est à couper le souffle

KAN, qui remplace MLP, a été étendu à la convolution par des projets open source

Jun 01, 2024 pm 10:03 PM

KAN, qui remplace MLP, a été étendu à la convolution par des projets open source

Jun 01, 2024 pm 10:03 PM

Plus tôt ce mois-ci, des chercheurs du MIT et d'autres institutions ont proposé une alternative très prometteuse au MLP – KAN. KAN surpasse MLP en termes de précision et d’interprétabilité. Et il peut surpasser le MLP fonctionnant avec un plus grand nombre de paramètres avec un très petit nombre de paramètres. Par exemple, les auteurs ont déclaré avoir utilisé KAN pour reproduire les résultats de DeepMind avec un réseau plus petit et un degré d'automatisation plus élevé. Plus précisément, le MLP de DeepMind compte environ 300 000 paramètres, tandis que le KAN n'en compte qu'environ 200. KAN a une base mathématique solide comme MLP est basé sur le théorème d'approximation universelle, tandis que KAN est basé sur le théorème de représentation de Kolmogorov-Arnold. Comme le montre la figure ci-dessous, KAN a

Recommandé : Excellent projet de détection et de reconnaissance des visages open source JS

Apr 03, 2024 am 11:55 AM

Recommandé : Excellent projet de détection et de reconnaissance des visages open source JS

Apr 03, 2024 am 11:55 AM

La technologie de détection et de reconnaissance des visages est déjà une technologie relativement mature et largement utilisée. Actuellement, le langage d'application Internet le plus utilisé est JS. La mise en œuvre de la détection et de la reconnaissance faciale sur le front-end Web présente des avantages et des inconvénients par rapport à la reconnaissance faciale back-end. Les avantages incluent la réduction de l'interaction réseau et de la reconnaissance en temps réel, ce qui réduit considérablement le temps d'attente des utilisateurs et améliore l'expérience utilisateur. Les inconvénients sont les suivants : il est limité par la taille du modèle et la précision est également limitée ; Comment utiliser js pour implémenter la détection de visage sur le web ? Afin de mettre en œuvre la reconnaissance faciale sur le Web, vous devez être familier avec les langages et technologies de programmation associés, tels que JavaScript, HTML, CSS, WebRTC, etc. Dans le même temps, vous devez également maîtriser les technologies pertinentes de vision par ordinateur et d’intelligence artificielle. Il convient de noter qu'en raison de la conception du côté Web

Les robots Tesla travaillent dans les usines, Musk : Le degré de liberté des mains atteindra 22 cette année !

May 06, 2024 pm 04:13 PM

Les robots Tesla travaillent dans les usines, Musk : Le degré de liberté des mains atteindra 22 cette année !

May 06, 2024 pm 04:13 PM

La dernière vidéo du robot Optimus de Tesla est sortie, et il peut déjà fonctionner en usine. À vitesse normale, il trie les batteries (les batteries 4680 de Tesla) comme ceci : Le responsable a également publié à quoi cela ressemble à une vitesse 20 fois supérieure - sur un petit "poste de travail", en sélectionnant et en sélectionnant et en sélectionnant : Cette fois, il est publié L'un des points forts de la vidéo est qu'Optimus réalise ce travail en usine, de manière totalement autonome, sans intervention humaine tout au long du processus. Et du point de vue d'Optimus, il peut également récupérer et placer la batterie tordue, en se concentrant sur la correction automatique des erreurs : concernant la main d'Optimus, le scientifique de NVIDIA Jim Fan a donné une évaluation élevée : la main d'Optimus est l'un des robots à cinq doigts du monde. le plus adroit. Ses mains ne sont pas seulement tactiles

FisheyeDetNet : le premier algorithme de détection de cible basé sur une caméra fisheye

Apr 26, 2024 am 11:37 AM

FisheyeDetNet : le premier algorithme de détection de cible basé sur une caméra fisheye

Apr 26, 2024 am 11:37 AM

La détection de cibles est un problème relativement mature dans les systèmes de conduite autonome, parmi lesquels la détection des piétons est l'un des premiers algorithmes à être déployés. Des recherches très complètes ont été menées dans la plupart des articles. Cependant, la perception de la distance à l’aide de caméras fisheye pour une vue panoramique est relativement moins étudiée. En raison de la distorsion radiale importante, la représentation standard du cadre de délimitation est difficile à mettre en œuvre dans les caméras fisheye. Pour alléger la description ci-dessus, nous explorons les conceptions étendues de boîtes englobantes, d'ellipses et de polygones généraux dans des représentations polaires/angulaires et définissons une métrique de segmentation d'instance mIOU pour analyser ces représentations. Le modèle fisheyeDetNet proposé avec une forme polygonale surpasse les autres modèles et atteint simultanément 49,5 % de mAP sur l'ensemble de données de la caméra fisheye Valeo pour la conduite autonome.