Le 14 mars, la société d'intelligence artificielle OpenAI a publié la version améliorée GPT-4 de ChatGPT (étape GPT-3.5), qui a de nouveau fait du sujet de ChatGPT, qui était resté légèrement silencieux, une nouvelle fois le début d'une « discussion brûlante explosive » , sans aucun suspense, c'est devenu une recherche brûlante sur les plateformes sociales. Des sujets tels que « L'IA finira par remplacer les humains » et « 90 % des humains dans les pays dotés d'une forte capacité d'examen GPP-4 » ont attiré de plus en plus l'attention des utilisateurs.

Par rapport au ChatGPT précédent, cette mise à niveau de GPT-4 peut être qualifiée de « poids lourd » : elle adopte un « modèle super multimodal » et la précision des réponses est grandement améliorée ; , la limite supérieure de traitement est augmentée à 2,5 W de mots ; la reconnaissance d'image est ajoutée sur la base de la saisie de texte brut ; la créativité est grandement améliorée et peut gérer des instructions plus subtiles...

Comparé à ChatGPT, GPT-4 est tellement excellent , mais le résultat terrible est le suivant : en raison de la commande folle des utilisateurs, le système de paiement OpenAI s'est écrasé.

Si ChatGPT basé sur le modèle GPT-3.5 est toujours un "pauvre élève" planant sur la ligne de passe, alors la force de GPT-4 devrait devenir un « meilleur étudiant » « La file d'attente est non seulement plus intelligente, mais aussi plus difficile à « tromper ».

Après avoir abandonné le préfixe de Chat, les capacités de GPT-4 ont considérablement changé. En termes simples, alors qu'OpenAI continue de se développer dans le sens de l'apprentissage profond, GPT-4 a fait un grand pas en avant pour devenir « plus humain ». Il a même participé à l'examen uniforme du barreau et aux examens d'admission aux facultés de droit. comme LSAT, classé dans le top 20 % ; il y a aussi des utilisateurs qui utilisent GPT-4 pour diffuser en direct sur YouTube pour écrire des articles, écrire du code, déclarer des impôts, écrire de la poésie, raconter des blagues...

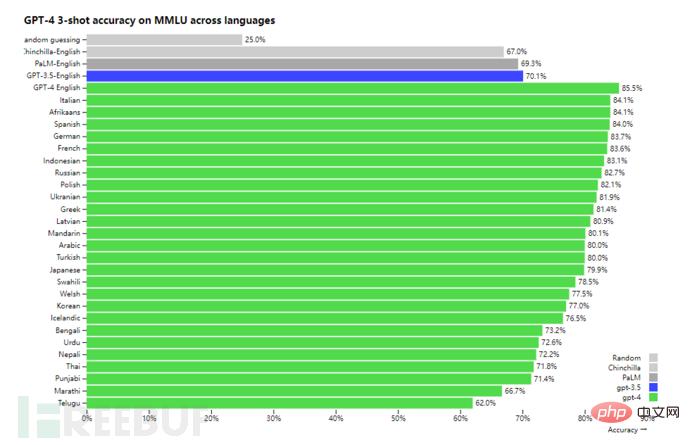

En testant 26 langues, GPT-4 surpasse d'autres grands modèles linguistiques tels que GPT-3.5 dans 24 langues, y compris des langues à faibles ressources telles que le letton, le gallois et le swahili, parmi lesquelles la précision de la reconnaissance du chinois atteint 80,1 % (image ci-dessous).

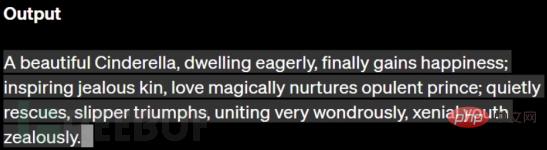

OpenAI a démontré un synopsis de l'histoire "Cendrillon" écrit en 26 mots en utilisant GPT-4. Les premières lettres de ces 26 mots correspondent à l'ordre correct des 26 lettres de A à Z, ce qui suffit à prouver. que GPT -4 Forte capacité en vocabulaire et en création linguistique.

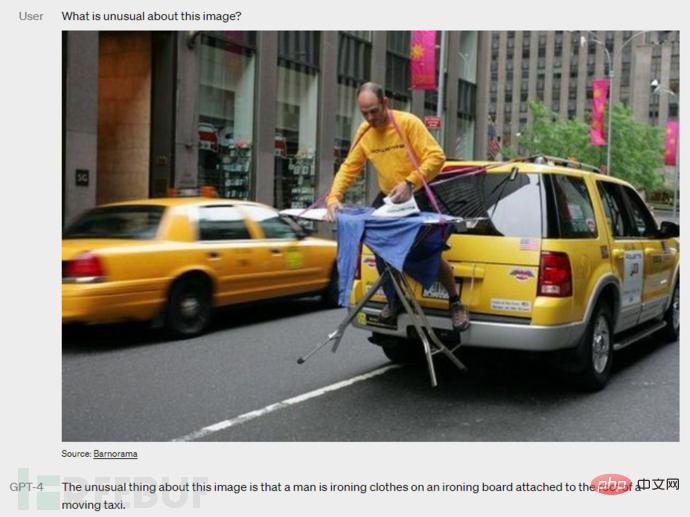

Mais la plus grande mise à jour est que GPT-4 prend en charge la reconnaissance d'image, qui peut donner des réponses logiques basées sur la compréhension du contenu de l'image. Par exemple, lorsqu'un utilisateur demande ce qu'il y a de spécial dans l'image ci-dessous, GPT-4 peut la décrire directement comme « un homme repassant des vêtements sur la planche à repasser sur le toit d'un taxi en mouvement ».

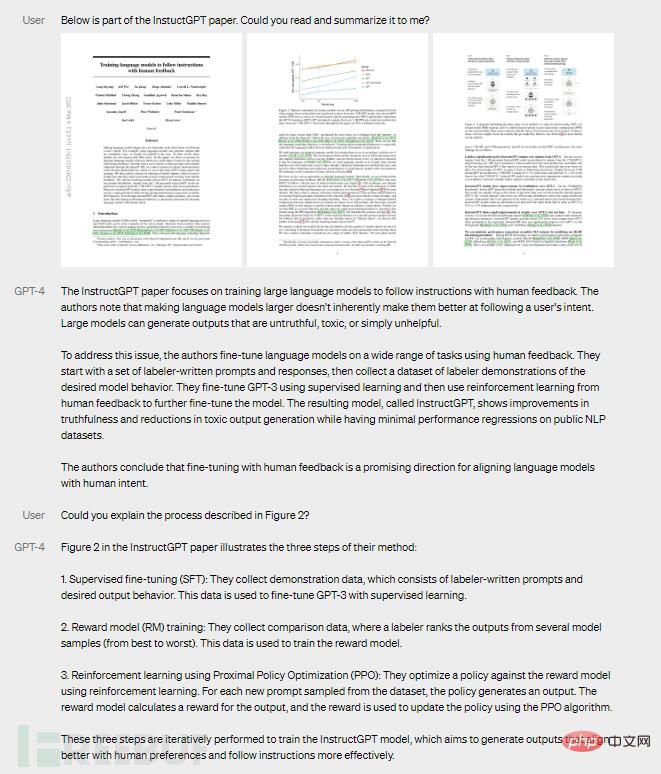

Dans un autre exemple, GPT-4 peut fournir un résumé basé sur la « compréhension » du document en fonction des besoins de l'utilisateur, et peut fournir une description concise d'un certain processus expérimental.

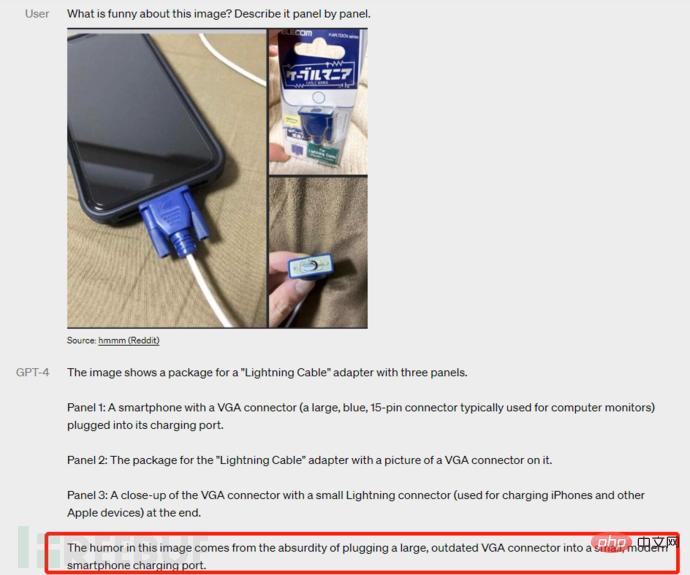

De plus, GPT-4 peut également comprendre dans une certaine mesure les « mèmes » amusants populaires sur Internet. Par exemple, il peut décrire que ce qui est amusant dans l'image ci-dessous est de « brancher un grand connecteur VGA obsolète ». un petit moderne Le ridicule des ports de chargement des smartphones ».

Tout d'abord, nous devons être conscients d'un problème : le GPT-4, de plus en plus intelligent, entraînera-t-il des risques de sécurité encore plus terribles ou deviendra-t-il une « épée tranchante » entre les mains des organisations cybercriminelles ?

Dans la version ChatGPT, FreeBuf a discuté en profondeur de son utilisation dans la cybercriminalité et des risques de sécurité qu'elle peut entraîner dans le cyberespace.

L'un est ses propres risques.

Par exemple, des experts en sécurité ont trouvé un texte très similaire aux secrets internes de l'entreprise dans le contenu généré par ChatGPT. La raison peut être que les employés d'Amazon ont saisi les informations de données internes de l'entreprise lorsqu'ils ont utilisé ChatGPT pour générer du code et du texte. Ensuite, dans GPT-4, de tels risques de sécurité existeront toujours et les grands géants défendront toujours le GPT.

En termes de politique de sécurité des réseaux, GPT-4 risque également de franchir la ligne rouge. Par exemple, si cela viole le principe du « minimum de données » du RGPD, si cela respecte le « droit à l'oubli » ou le « droit à la suppression », si l'utilisation des données publiques est conforme et si la collecte de propriété académique et intellectuelle les informations sont adaptées et conformes aux lois et réglementations en vigueur.

Actuellement, la loi sur la cybersécurité, la loi sur la protection des données et la loi sur la protection des informations personnelles de mon pays contiennent des réglementations détaillées sur la collecte et l'utilisation des données. À en juger par la seule situation actuelle, il est évident que GPT-4 ne peut pas répondre à toutes ces exigences. De plus, à l'avenir, le système juridique mondial sera encore affiné dans le sens de la « protection des données », et GPT sera alors confronté à une pression de conformité plus sévère.

Deuxièmement, il peut y avoir davantage de vulnérabilités cachées lors de l'utilisation de GPT-4 pour modifier du code.

Au stade ChatGPT-3.5, les entreprises et les développeurs tentent déjà de l'utiliser pour écrire du code et dépanner les vulnérabilités. Dans une expérience Kaspersky, les analystes ont découvert que ChatGPT peut être utilisé pour collecter des informations médico-légales pour les entreprises qui n'exécutent pas de systèmes de détection et de réponse des points finaux (EDR), ne détectent pas l'obscurcissement du code ou ne font pas d'ingénierie inverse des binaires de code.

Le GPT-4, plus intelligent, suscite également de grands espoirs de la part de nombreuses personnes. Lorsque de plus en plus de développeurs utiliseront GPT-4 pour écrire du code, les vulnérabilités cachées deviendront des bombes à retardement plus terrifiantes une fois exploitées par les attaquants, provoquant des désastres incalculables. l’ensemble de l’espace de sécurité des réseaux, notamment dans le domaine de la sécurité de la chaîne d’approvisionnement, qui nécessite une vigilance accrue.

Enfin, comment empêcher que GPT-4 soit exploité par des pirates informatiques, exerçant ainsi une nouvelle pression sur la défense de la sécurité des réseaux.

Un fait très évident est que depuis l'étape ChatGPT, il y a eu de plus en plus de cas d'utilisation de GPT dans l'industrie noire, la cybercriminalité, les attaques de pirates informatiques et d'autres domaines, et cela pourrait même devenir la norme à l'avenir.

Par exemple, des chercheurs de Cybernews ont découvert que ChatGPT pouvait être utilisé par des pirates pour trouver des failles de sécurité dans des sites Web. Avec leur aide, les chercheurs ont effectué un test d'intrusion sur un site Web ordinaire et l'ont combiné avec les suggestions et le code fournis par ChatGPT. 45 minutes. Changer l'exemple termine le hack.

ChatGPT possède déjà de telles capacités, sans parler du GPT-4, plus intelligent ? Il semble difficile d'utiliser GPT-4 pour renforcer considérablement le système de sécurité des réseaux à court terme, mais son utilisation dans la cybercriminalité est imminente. La manière de gérer des risques de sécurité similaires est devenue une question à considérer dès maintenant.

Bien sûr, OpenAI continue également de travailler dur sur la sécurité. Par exemple, ils ont embauché plus de 50 experts dans les domaines des risques d'amarrage de l'intelligence artificielle, de la cybersécurité, des risques biologiques, de la confiance et de la sécurité et de la sécurité internationale pour mener des tests contradictoires du modèle et former divers scénarios à haut risque afin de fournir des orientations pour les mesures d'atténuation et développement du modèle. Fournir une base d’amélioration. Par exemple, en collectant des données spécialisées supplémentaires pour améliorer la capacité de GPT-4 à rejeter les demandes sur la manière de synthétiser des produits chimiques dangereux.

Mais s'appuyer uniquement sur ces derniers n'est évidemment pas en mesure de répondre aux exigences de sécurité. Cela signifie également que nous devons améliorer les capacités de sécurité de l'intelligence artificielle représentée par GPT-4 sous de nombreux aspects, y compris la formulation de politiques et de réglementations, ainsi que les moyens technologiques. freiner les risques de malversations, etc.

Dans tous les cas, le progrès technologique a un effet incommensurable sur le développement humain, mais en même temps, nous devons avoir une compréhension claire des risques. En d’autres termes, nous adoptons le GPT-4 avec une attitude positive, mais nous devons être prêts à faire face aux risques.

Comme l’a dit un dirigeant de la Seconde Guerre mondiale : Nous ne pouvons pas faire changer d’avis les autres. Puisqu’ils veulent se préparer à la guerre, nous devons également nous préparer à la guerre. Il en va de même pour GPT-4, nous ne pouvons pas changer les autres pour qu'ils l'utilisent pour le « mal », mais nous pouvons décider comment l'utiliser pour le « bien ».

L’épée de l’IA est également extrêmement tranchante entre les mains de la sécurité des réseaux.

Nous sommes prêts !

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Comment implémenter la messagerie instantanée sur le front-end

Comment implémenter la messagerie instantanée sur le front-end

La différence entre Sass et moins

La différence entre Sass et moins

Comment résoudre l'erreur d'application WerFault.exe

Comment résoudre l'erreur d'application WerFault.exe

Solution d'erreur inattendue IIS 0x8ffe2740

Solution d'erreur inattendue IIS 0x8ffe2740

La différence entre les cours Python et les cours C+

La différence entre les cours Python et les cours C+

Y a-t-il une grande différence entre le langage C et Python ?

Y a-t-il une grande différence entre le langage C et Python ?

Le système d'exploitation Hongmeng de Huawei est-il Android ?

Le système d'exploitation Hongmeng de Huawei est-il Android ?

Win10 suspend les mises à jour

Win10 suspend les mises à jour