Périphériques technologiques

Périphériques technologiques

IA

IA

Des fichiers plus petits, de meilleure qualité, la populaire diffusion stable peut-elle compresser les images ?

Des fichiers plus petits, de meilleure qualité, la populaire diffusion stable peut-elle compresser les images ?

Des fichiers plus petits, de meilleure qualité, la populaire diffusion stable peut-elle compresser les images ?

Récemment, la diffusion stable est devenue une direction de recherche émergente. Un blogueur nommé Matthias Bühlmann a tenté d'explorer expérimentalement la puissance de ce modèle et a découvert que Stable Diffusion est un codec de compression d'image avec perte très puissant. Il a écrit un blog décrivant ce processus d'analyse expérimentale. Ce qui suit est le texte original du blog.

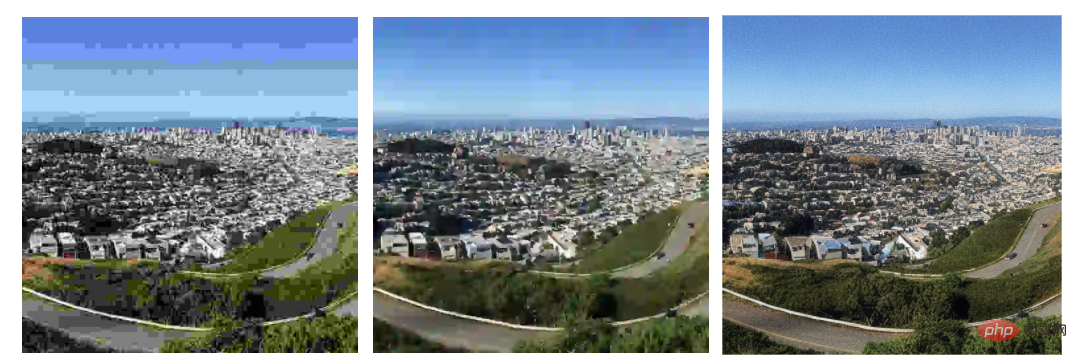

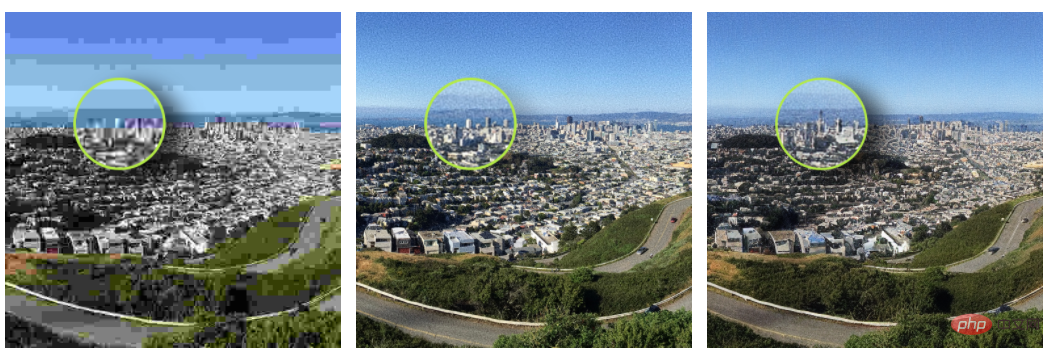

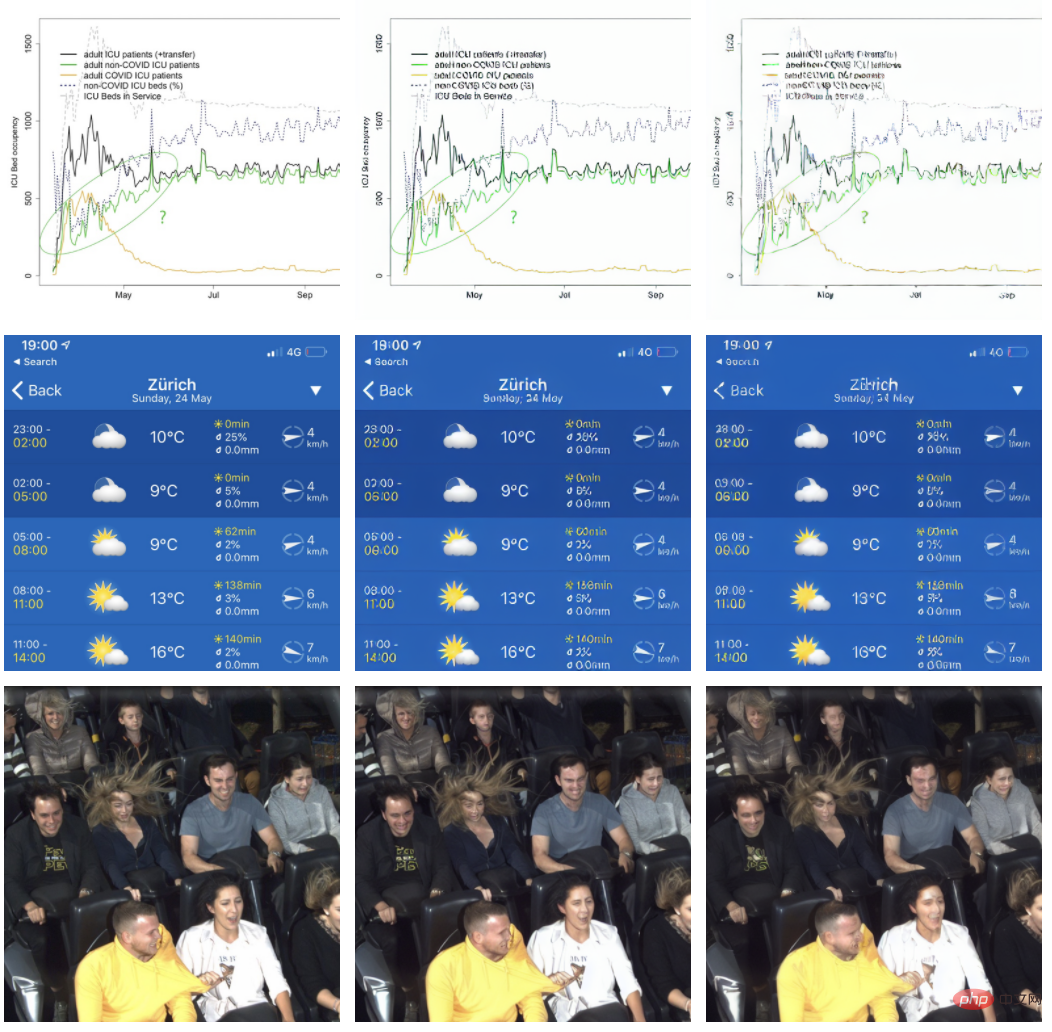

Tout d'abord, Matthias Bühlmann donne les résultats de compression de la méthode de diffusion stable et JPG et WebP dans des conditions de facteur de compression élevé. Tous les résultats sont en résolution de 512x512 pixels :

Figurine de paysage de San Francisco, de. de gauche à droite : JPG (6,16 Ko), WebP (6,80 Ko), Diffusion Stable : (4,96 Ko).

Candy Shop, de gauche à droite : JPG (5,68 Ko), WebP (5,71 Ko), Stable Diffusion (4,98 Ko).

Photos d'animaux, de gauche à droite : JPG (5,66 Ko), WebP (6,74 Ko), Stable Diffusion (4,97 Ko).

Ces exemples montrent clairement que la compression d'images avec Stable Diffusion préserve une meilleure qualité d'image avec des fichiers de plus petite taille par rapport à JPG et WebP.

Expérience d'exploration

Matthias Bühlmann a analysé le principe de fonctionnement de la diffusion stable qui utilise trois réseaux de neurones artificiels entraînés en série :

- Variational Auto Encoder (VAE)

- U-Net

- . Encodeur de texte

VAE encode et décode les images dans l'espace image en une représentation spatiale sous-jacente. La représentation spatiale latente de l'image source (512 x 512, 3x8 ou 4x8 bits) aura une résolution inférieure (64 x 64) et une précision supérieure (4x32 bits).

VAE apprend tout seul pendant le processus de formation. Au fur et à mesure que le modèle est entraîné, la représentation de l'espace latent des différentes versions du modèle peut sembler différente. Par exemple, la représentation de l'espace latent de Stable Diffusion v1.4 est la suivante. (remappé en image couleur à 4 canaux) :

Lorsque les caractéristiques latentes sont ré-agrandies et interprétées comme des valeurs de couleur (en utilisant le canal alpha), les principales caractéristiques de l'image sont toujours visibles, et le VAE code également les fonctionnalités à haute résolution en valeurs de pixels.

Par exemple, un aller-retour d'encodage/décodage VAE donne le résultat suivant :

Il est à noter que cet aller-retour n'est pas sans perte. Par exemple, les mots blancs sur la bande bleue de l’image sont légèrement moins lisibles après décodage. Le VAE du modèle Stable Diffusion v1.4 n'est généralement pas très efficace pour représenter les petits textes et les visages.

Nous savons que l'objectif principal de Stable Diffusion est de générer des images basées sur des descriptions textuelles, ce qui nécessite que le modèle opère sur la représentation spatiale latente de l'image. Le modèle utilise un U-Net entraîné pour débruiter de manière itérative l'image spatiale latente, produisant ce qu'il « voit » (prédit) dans le bruit, de la même manière que nous voyons parfois les nuages sous forme de formes ou de visages. Lors de l'étape itérative de débruitage, un troisième modèle ML (encodeur de texte) guide U-Net pour essayer de voir différentes informations.

Matthias Bühlmann a analysé comment la représentation latente générée par la VAE peut être efficacement compressée. Il a constaté que l'échantillonnage de la représentation latente dans VAE ou l'application de méthodes de compression d'image avec perte existantes à la représentation latente dégrade considérablement la qualité de l'image reconstruite, tandis que le processus de décodage VAE semble être relativement robuste à la qualité de la représentation latente.

Matthias Bühlmann a quantifié la représentation latente de la virgule flottante aux entiers non signés de 8 bits et n'a trouvé que de très petites erreurs de reconstruction. Comme le montre la figure ci-dessous, à gauche : représentation potentielle à virgule flottante de 32 bits ; au milieu : vérité terrain ; à droite : représentation potentielle entière de 8 bits.

Il a également constaté que grâce à une quantification plus poussée via des algorithmes de palette et de tramage, les résultats obtenus seront étonnamment bons. Cependant, lors du décodage directement à l'aide de VAE, la représentation palettisée entraînera des artefacts visibles :

Gauche : représentation latente de 32 bits ; Milieu : représentation latente quantifiée de 8 bits ; Droite : bande palettisée ; Représentation latente 8 bits avec tramage Floyd-Steinberg

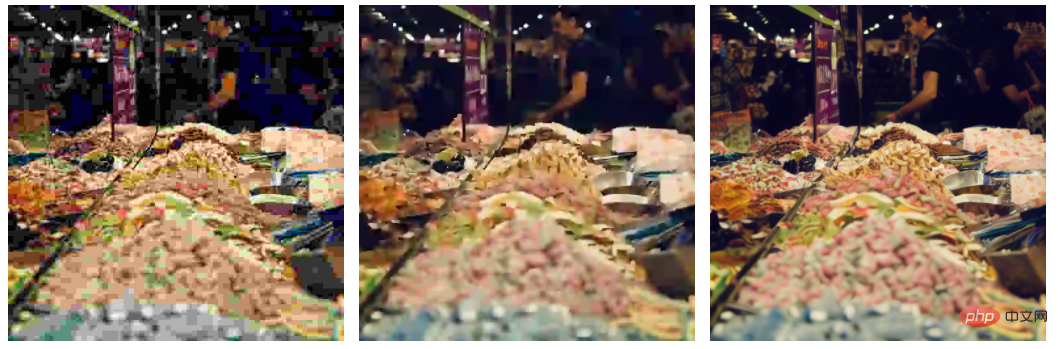

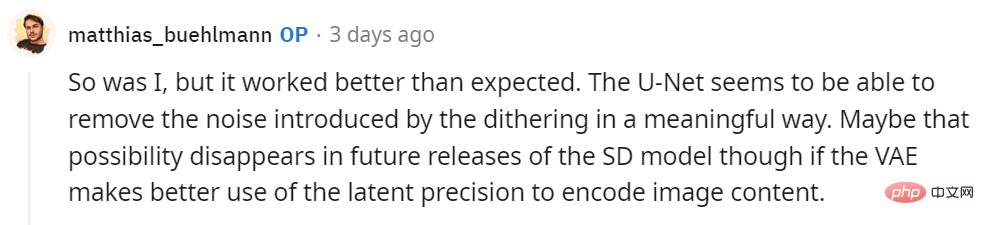

La représentation palettisée avec tramage Floyd-Steinberg introduit du bruit, déformant les résultats du décodage. Matthias Bühlmann a donc utilisé U-Net pour supprimer le bruit provoqué par le jitter. Après 4 itérations, le résultat de la reconstruction est visuellement très proche de la version non quantifiée :

Résultat de la reconstruction (à gauche : représentation palettisée avec gigue de Floyd-Steinberg ; au milieu : après quatre itérations Bruit ; à droite : Ground Truth) .

Bien que le résultat soit très bon, il introduit certains artefacts, tels que l'ombre brillante sur le symbole central ci-dessus.

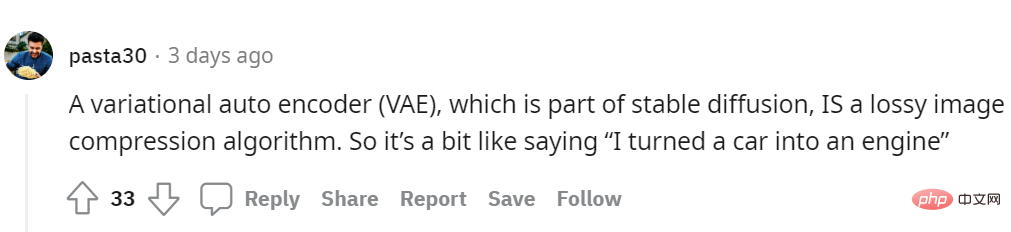

Bien que subjectivement, les résultats des images compressées Stable Diffusion soient bien meilleurs que ceux de JPG et WebP, du point de vue du PSNR, SSIM et d'autres indicateurs, Stable Diffusion n'a aucun avantage évident.

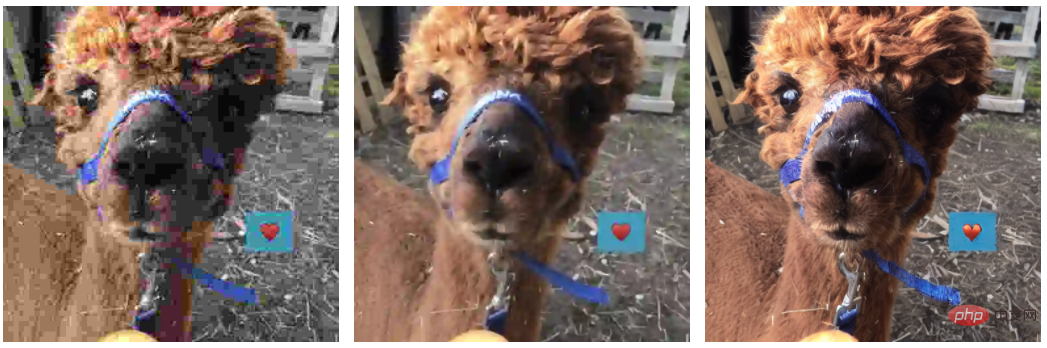

Comme le montre la figure ci-dessous, bien que la diffusion stable en tant que codec soit bien meilleure que les autres méthodes pour conserver la granularité de l'image, des fonctionnalités telles que la forme des objets dans l'image peuvent changer en raison d'artefacts de compression.

Gauche : compression JPG ; Milieu : vérité terrain ; droite : compression de diffusion stable.

Il convient de noter que le modèle Stable Diffusion v1.4 actuel ne peut pas bien conserver les informations textuelles et les traits du visage avec de très petites polices pendant le processus de compression, mais le modèle Stable Diffusion v1.5 fait du bon travail en face. génération Il y a eu des améliorations.

Gauche : Vérité terrain ; Milieu : Après l'aller-retour VAE (caractéristiques latentes de 32 bits) ; Droite : Résultats décodés à partir de caractéristiques latentes de 8 bits débruitées en palette.

Après la publication du blog, l’analyse expérimentale de Matthias Bühlmann a suscité la discussion de tous.

Matthias Bühlmann lui-même estime que l'effet de compression d'image de Stable Diffusion est meilleur que prévu, et U-Net semble être capable d'éliminer efficacement le bruit introduit par le tramage. Cependant, les futures versions du modèle Stable Diffusion pourraient ne plus disposer de cette fonctionnalité de compression d’image.

Cependant, certains internautes se sont interrogés : "VAE lui-même est utilisé pour la compression d'images." Par exemple, la méthode de compression d'image basée sur Transformer TIC utilise l'architecture VAE, donc l'expérience de Matthias Bühlmann semble exagérée.

Qu'en penses-tu ?

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Le modèle MoE open source le plus puissant au monde est ici, avec des capacités chinoises comparables à celles du GPT-4, et le prix ne représente que près d'un pour cent de celui du GPT-4-Turbo.

May 07, 2024 pm 04:13 PM

Le modèle MoE open source le plus puissant au monde est ici, avec des capacités chinoises comparables à celles du GPT-4, et le prix ne représente que près d'un pour cent de celui du GPT-4-Turbo.

May 07, 2024 pm 04:13 PM

Imaginez un modèle d'intelligence artificielle qui non seulement a la capacité de surpasser l'informatique traditionnelle, mais qui permet également d'obtenir des performances plus efficaces à moindre coût. Ce n'est pas de la science-fiction, DeepSeek-V2[1], le modèle MoE open source le plus puissant au monde est ici. DeepSeek-V2 est un puissant mélange de modèle de langage d'experts (MoE) présentant les caractéristiques d'une formation économique et d'une inférence efficace. Il est constitué de 236B paramètres, dont 21B servent à activer chaque marqueur. Par rapport à DeepSeek67B, DeepSeek-V2 offre des performances plus élevées, tout en économisant 42,5 % des coûts de formation, en réduisant le cache KV de 93,3 % et en augmentant le débit de génération maximal à 5,76 fois. DeepSeek est une entreprise explorant l'intelligence artificielle générale

L'IA bouleverse la recherche mathématique ! Le lauréat de la médaille Fields et mathématicien sino-américain a dirigé 11 articles les mieux classés | Aimé par Terence Tao

Apr 09, 2024 am 11:52 AM

L'IA bouleverse la recherche mathématique ! Le lauréat de la médaille Fields et mathématicien sino-américain a dirigé 11 articles les mieux classés | Aimé par Terence Tao

Apr 09, 2024 am 11:52 AM

L’IA change effectivement les mathématiques. Récemment, Tao Zhexuan, qui a prêté une attention particulière à cette question, a transmis le dernier numéro du « Bulletin de l'American Mathematical Society » (Bulletin de l'American Mathematical Society). En se concentrant sur le thème « Les machines changeront-elles les mathématiques ? », de nombreux mathématiciens ont exprimé leurs opinions. L'ensemble du processus a été plein d'étincelles, intense et passionnant. L'auteur dispose d'une équipe solide, comprenant Akshay Venkatesh, lauréat de la médaille Fields, le mathématicien chinois Zheng Lejun, l'informaticien de l'Université de New York Ernest Davis et de nombreux autres universitaires bien connus du secteur. Le monde de l’IA a radicalement changé. Vous savez, bon nombre de ces articles ont été soumis il y a un an.

KAN, qui remplace MLP, a été étendu à la convolution par des projets open source

Jun 01, 2024 pm 10:03 PM

KAN, qui remplace MLP, a été étendu à la convolution par des projets open source

Jun 01, 2024 pm 10:03 PM

Plus tôt ce mois-ci, des chercheurs du MIT et d'autres institutions ont proposé une alternative très prometteuse au MLP – KAN. KAN surpasse MLP en termes de précision et d’interprétabilité. Et il peut surpasser le MLP fonctionnant avec un plus grand nombre de paramètres avec un très petit nombre de paramètres. Par exemple, les auteurs ont déclaré avoir utilisé KAN pour reproduire les résultats de DeepMind avec un réseau plus petit et un degré d'automatisation plus élevé. Plus précisément, le MLP de DeepMind compte environ 300 000 paramètres, tandis que le KAN n'en compte qu'environ 200. KAN a une base mathématique solide comme MLP est basé sur le théorème d'approximation universelle, tandis que KAN est basé sur le théorème de représentation de Kolmogorov-Arnold. Comme le montre la figure ci-dessous, KAN a

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas entre officiellement dans l’ère des robots électriques ! Hier, l'Atlas hydraulique s'est retiré "en larmes" de la scène de l'histoire. Aujourd'hui, Boston Dynamics a annoncé que l'Atlas électrique était au travail. Il semble que dans le domaine des robots humanoïdes commerciaux, Boston Dynamics soit déterminé à concurrencer Tesla. Après la sortie de la nouvelle vidéo, elle a déjà été visionnée par plus d’un million de personnes en seulement dix heures. Les personnes âgées partent et de nouveaux rôles apparaissent. C'est une nécessité historique. Il ne fait aucun doute que cette année est l’année explosive des robots humanoïdes. Les internautes ont commenté : Les progrès des robots ont fait ressembler la cérémonie d'ouverture de cette année à des êtres humains, et le degré de liberté est bien plus grand que celui des humains. Mais n'est-ce vraiment pas un film d'horreur ? Au début de la vidéo, Atlas est allongé calmement sur le sol, apparemment sur le dos. Ce qui suit est à couper le souffle

Google est ravi : les performances de JAX surpassent Pytorch et TensorFlow ! Cela pourrait devenir le choix le plus rapide pour la formation à l'inférence GPU

Apr 01, 2024 pm 07:46 PM

Google est ravi : les performances de JAX surpassent Pytorch et TensorFlow ! Cela pourrait devenir le choix le plus rapide pour la formation à l'inférence GPU

Apr 01, 2024 pm 07:46 PM

Les performances de JAX, promu par Google, ont dépassé celles de Pytorch et TensorFlow lors de récents tests de référence, se classant au premier rang sur 7 indicateurs. Et le test n’a pas été fait sur le TPU présentant les meilleures performances JAX. Bien que parmi les développeurs, Pytorch soit toujours plus populaire que Tensorflow. Mais à l’avenir, des modèles plus volumineux seront peut-être formés et exécutés sur la base de la plate-forme JAX. Modèles Récemment, l'équipe Keras a comparé trois backends (TensorFlow, JAX, PyTorch) avec l'implémentation native de PyTorch et Keras2 avec TensorFlow. Premièrement, ils sélectionnent un ensemble de

Les robots Tesla travaillent dans les usines, Musk : Le degré de liberté des mains atteindra 22 cette année !

May 06, 2024 pm 04:13 PM

Les robots Tesla travaillent dans les usines, Musk : Le degré de liberté des mains atteindra 22 cette année !

May 06, 2024 pm 04:13 PM

La dernière vidéo du robot Optimus de Tesla est sortie, et il peut déjà fonctionner en usine. À vitesse normale, il trie les batteries (les batteries 4680 de Tesla) comme ceci : Le responsable a également publié à quoi cela ressemble à une vitesse 20 fois supérieure - sur un petit "poste de travail", en sélectionnant et en sélectionnant et en sélectionnant : Cette fois, il est publié L'un des points forts de la vidéo est qu'Optimus réalise ce travail en usine, de manière totalement autonome, sans intervention humaine tout au long du processus. Et du point de vue d'Optimus, il peut également récupérer et placer la batterie tordue, en se concentrant sur la correction automatique des erreurs : concernant la main d'Optimus, le scientifique de NVIDIA Jim Fan a donné une évaluation élevée : la main d'Optimus est l'un des robots à cinq doigts du monde. le plus adroit. Ses mains ne sont pas seulement tactiles

FisheyeDetNet : le premier algorithme de détection de cible basé sur une caméra fisheye

Apr 26, 2024 am 11:37 AM

FisheyeDetNet : le premier algorithme de détection de cible basé sur une caméra fisheye

Apr 26, 2024 am 11:37 AM

La détection de cibles est un problème relativement mature dans les systèmes de conduite autonome, parmi lesquels la détection des piétons est l'un des premiers algorithmes à être déployés. Des recherches très complètes ont été menées dans la plupart des articles. Cependant, la perception de la distance à l’aide de caméras fisheye pour une vue panoramique est relativement moins étudiée. En raison de la distorsion radiale importante, la représentation standard du cadre de délimitation est difficile à mettre en œuvre dans les caméras fisheye. Pour alléger la description ci-dessus, nous explorons les conceptions étendues de boîtes englobantes, d'ellipses et de polygones généraux dans des représentations polaires/angulaires et définissons une métrique de segmentation d'instance mIOU pour analyser ces représentations. Le modèle fisheyeDetNet proposé avec une forme polygonale surpasse les autres modèles et atteint simultanément 49,5 % de mAP sur l'ensemble de données de la caméra fisheye Valeo pour la conduite autonome.

DualBEV : dépassant largement BEVFormer et BEVDet4D, ouvrez le livre !

Mar 21, 2024 pm 05:21 PM

DualBEV : dépassant largement BEVFormer et BEVDet4D, ouvrez le livre !

Mar 21, 2024 pm 05:21 PM

Cet article explore le problème de la détection précise d'objets sous différents angles de vue (tels que la perspective et la vue à vol d'oiseau) dans la conduite autonome, en particulier comment transformer efficacement les caractéristiques de l'espace en perspective (PV) en vue à vol d'oiseau (BEV). implémenté via le module Visual Transformation (VT). Les méthodes existantes sont globalement divisées en deux stratégies : la conversion 2D en 3D et la conversion 3D en 2D. Les méthodes 2D vers 3D améliorent les caractéristiques 2D denses en prédisant les probabilités de profondeur, mais l'incertitude inhérente aux prévisions de profondeur, en particulier dans les régions éloignées, peut introduire des inexactitudes. Alors que les méthodes 3D vers 2D utilisent généralement des requêtes 3D pour échantillonner des fonctionnalités 2D et apprendre les poids d'attention de la correspondance entre les fonctionnalités 3D et 2D via un transformateur, ce qui augmente le temps de calcul et de déploiement.