Périphériques technologiques

Périphériques technologiques

IA

IA

Médias américains : Musk et d'autres ont raison d'appeler à la suspension de la formation en IA et à la nécessité de ralentir pour des raisons de sécurité

Médias américains : Musk et d'autres ont raison d'appeler à la suspension de la formation en IA et à la nécessité de ralentir pour des raisons de sécurité

Médias américains : Musk et d'autres ont raison d'appeler à la suspension de la formation en IA et à la nécessité de ralentir pour des raisons de sécurité

News du 30 mars, Elon Musk, PDG de Tesla, Steve Wozniak, co-fondateur d'Apple et 1 000 autres personnes ont récemment signé une lettre ouverte appelant à un moratoire sur la formation de systèmes d'IA plus puissants que GPT-4. BI, un média en ligne américain grand public, estime que, pour le bénéfice de l’ensemble de la société, le développement de l’IA doit ralentir.

Dans la lettre ouverte, Wozniak, Musk et d'autres ont demandé qu'à mesure que la technologie de l'IA devient de plus en plus puissante, des garde-fous de sécurité soient mis en place et que la formation de modèles d'IA plus avancés soit suspendue. Ils estiment que pour les modèles d'IA puissants comme le GPT-4 d'OpenAI, "ils ne devraient être développés que lorsque nous sommes convaincus que leur impact est positif et que les risques sont contrôlables".

Bien sûr, ce n’est pas la première fois que des gens réclament des garde-fous de sécurité pour l’IA. Cependant, à mesure que l’IA devient plus complexe et plus avancée, les appels à la prudence se multiplient.

James Grimmelmann, professeur de droit du numérique et de l'information à l'Université Cornell aux États-Unis, a déclaré : « Ralentir le développement de nouveaux modèles d'IA est une très bonne idée, car si l'IA finit par être bonne pour nous, alors il n'y a pas d'autre solution. mal en attendant quelques mois ou quelques années, nous arriverons au bout de toute façon et si c'est nuisible, alors nous nous gagnerons du temps supplémentaire pour trouver la meilleure façon d'y faire face et d'apprendre à le combattre. de ChatGPT souligne les dangers potentiels d'aller trop vite

En novembre dernier, lorsque le chatbot ChatGPT d'OpenAI a été lancé en version bêta publique, il a fait sensation. Naturellement, les gens ont commencé à promouvoir les capacités de ChatGPT, et son effet destructeur sur la société est rapidement devenu évident. ChatGPT a commencé à passer des examens médicaux, à donner des instructions sur la fabrication de bombes et s'est même créé un alter ego.

Plus nous utilisons l'IA, notamment les outils dits d'intelligence artificielle générative (AIGC) comme ChatGPT ou l'outil de conversion texte en image Stable Diffusion, plus nous constatons ses lacunes, son potentiel de création de biais et la façon dont nous l’humanité impuissante semble utiliser son pouvoir. Hasan Chowdhury, rédacteur en chef de

BI, écrit que l’IA a le potentiel de « devenir un turbocompresseur, accélérant la propagation de nos erreurs ». Comme les réseaux sociaux, ils exploitent le meilleur et le pire de l’humanité. Mais contrairement aux médias sociaux, l’IA sera davantage intégrée dans la vie des gens.

ChatGPT et d'autres produits d'IA similaires ont déjà tendance à déformer les informations et à commettre des erreurs, ce dont Wozniak a parlé publiquement. Il est sujet à ce qu'on appelle des « hallucinations » (informations mensongères), et même le PDG d'OpenAI, Sam Altman, a admis que les modèles de l'entreprise peuvent produire des réponses raciales, sexistes et biaisées. Stable Diffusion a également rencontré des problèmes de droits d'auteur et a été accusé de s'inspirer du travail d'artistes numériques.

À mesure que l’IA est intégrée dans la technologie quotidienne, nous pourrions introduire davantage de désinformation dans le monde à plus grande échelle. Même les tâches qui semblent inoffensives pour une IA, comme aider à planifier des vacances, peuvent ne pas donner des résultats totalement fiables.

Il est difficile de développer la technologie de l'IA de manière responsable lorsque le marché libre exige un développement rapide

Pour être clair, l'IA est une technologie incroyablement transformatrice, en particulier un AIGC comme ChatGPT. Il n’y a rien de mal en soi à développer des machines pour effectuer la plupart des tâches fastidieuses que les gens détestent.

Bien que cette technologie ait créé une crise existentielle au sein de la main-d'œuvre, elle a également été saluée comme un outil d'égalisation pour l'industrie technologique. Rien ne prouve non plus que ChatGPT se prépare à mener une insurrection de robots dans les années à venir.

De nombreuses entreprises d'IA font appel à des éthiciens pour développer cette technologie de manière responsable. Mais si la précipitation d’un produit dépasse son impact social, les équipes concentrées sur la création d’IA en toute sécurité ne pourront pas accomplir leur travail en toute tranquillité.

La vitesse semble être un facteur incontournable dans cet engouement pour l’IA. OpenAI estime que si l'entreprise évolue suffisamment vite, elle peut repousser la concurrence et devenir un leader dans le domaine de l'AIGC. Cela a incité Microsoft, Google et presque toutes les autres entreprises à emboîter le pas.

Lancer des modèles d'IA puissants pour l'expérience publique avant qu'ils ne soient prêts n'améliore pas la technologie. Les meilleurs cas d’utilisation de l’IA n’ont pas encore été trouvés, car les développeurs doivent éliminer le bruit généré par la technologie qu’ils créent et les utilisateurs sont distraits par le bruit.

Tout le monde ne veut pas ralentir les choses

La lettre ouverte de Musk et d'autres a également été critiquée par d'autres, qui estiment qu'elle passe à côté de l'essentiel.

Emily M. Bender, professeur à l'Université de Washington, a déclaré sur Twitter que Musk et d'autres leaders technologiques du cycle de battage médiatique se concentrent uniquement sur la puissance de l'IA, plutôt que sur les dommages réels qu'elle peut causer.

Gerry Melman, professeur de droit du numérique et de l'information à l'Université Cornell, a ajouté que les dirigeants technologiques qui ont signé la lettre ouverte « arrivaient tardivement » et ouvraient une boîte de Pandore qui pourrait s'attirer des ennuis. Il a déclaré : "Maintenant qu'ils ont signé cette lettre, ils ne peuvent pas faire demi-tour et imposer la même politique sur d'autres technologies telles que les voitures autonomes.

Une pause dans le développement ou l'imposition de davantage de réglementations peuvent ou non." obtenir des résultats. Mais désormais, la conversation semble avoir tourné. L’IA existe depuis des décennies, nous pouvons peut-être attendre encore quelques années.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Choisir le modèle d'intégration qui correspond le mieux à vos données : un test comparatif des intégrations multilingues OpenAI et open source

Feb 26, 2024 pm 06:10 PM

Choisir le modèle d'intégration qui correspond le mieux à vos données : un test comparatif des intégrations multilingues OpenAI et open source

Feb 26, 2024 pm 06:10 PM

OpenAI a récemment annoncé le lancement de son modèle d'intégration de dernière génération, embeddingv3, qui, selon eux, est le modèle d'intégration le plus performant avec des performances multilingues plus élevées. Ce lot de modèles est divisé en deux types : les plus petits text-embeddings-3-small et les plus puissants et plus grands text-embeddings-3-large. Peu d'informations sont divulguées sur la façon dont ces modèles sont conçus et formés, et les modèles ne sont accessibles que via des API payantes. Il existe donc de nombreux modèles d'intégration open source. Mais comment ces modèles open source se comparent-ils au modèle open source open source ? Cet article comparera empiriquement les performances de ces nouveaux modèles avec des modèles open source. Nous prévoyons de créer une donnée

Un nouveau paradigme de programmation, quand Spring Boot rencontre OpenAI

Feb 01, 2024 pm 09:18 PM

Un nouveau paradigme de programmation, quand Spring Boot rencontre OpenAI

Feb 01, 2024 pm 09:18 PM

En 2023, la technologie de l’IA est devenue un sujet brûlant et a un impact énorme sur diverses industries, notamment dans le domaine de la programmation. Les gens sont de plus en plus conscients de l’importance de la technologie de l’IA, et la communauté Spring ne fait pas exception. Avec l’évolution continue de la technologie GenAI (Intelligence Artificielle Générale), il est devenu crucial et urgent de simplifier la création d’applications dotées de fonctions d’IA. Dans ce contexte, « SpringAI » a émergé, visant à simplifier le processus de développement d'applications fonctionnelles d'IA, en le rendant simple et intuitif et en évitant une complexité inutile. Grâce à « SpringAI », les développeurs peuvent plus facilement créer des applications dotées de fonctions d'IA, ce qui les rend plus faciles à utiliser et à exploiter.

Travail posthume de l'équipe OpenAI Super Alignment : deux grands modèles jouent à un jeu et le résultat devient plus compréhensible

Jul 19, 2024 am 01:29 AM

Travail posthume de l'équipe OpenAI Super Alignment : deux grands modèles jouent à un jeu et le résultat devient plus compréhensible

Jul 19, 2024 am 01:29 AM

Si la réponse donnée par le modèle d’IA est incompréhensible du tout, oseriez-vous l’utiliser ? À mesure que les systèmes d’apprentissage automatique sont utilisés dans des domaines de plus en plus importants, il devient de plus en plus important de démontrer pourquoi nous pouvons faire confiance à leurs résultats, et quand ne pas leur faire confiance. Une façon possible de gagner confiance dans le résultat d'un système complexe est d'exiger que le système produise une interprétation de son résultat qui soit lisible par un humain ou un autre système de confiance, c'est-à-dire entièrement compréhensible au point que toute erreur possible puisse être trouvé. Par exemple, pour renforcer la confiance dans le système judiciaire, nous exigeons que les tribunaux fournissent des avis écrits clairs et lisibles qui expliquent et soutiennent leurs décisions. Pour les grands modèles de langage, nous pouvons également adopter une approche similaire. Cependant, lorsque vous adoptez cette approche, assurez-vous que le modèle de langage génère

L'éditeur Zed basé sur Rust est open source, avec prise en charge intégrée d'OpenAI et GitHub Copilot

Feb 01, 2024 pm 02:51 PM

L'éditeur Zed basé sur Rust est open source, avec prise en charge intégrée d'OpenAI et GitHub Copilot

Feb 01, 2024 pm 02:51 PM

Auteur丨Compilé par TimAnderson丨Produit par Noah|51CTO Technology Stack (WeChat ID : blog51cto) Le projet d'éditeur Zed est encore en phase de pré-version et a été open source sous licences AGPL, GPL et Apache. L'éditeur offre des performances élevées et plusieurs options assistées par l'IA, mais n'est actuellement disponible que sur la plate-forme Mac. Nathan Sobo a expliqué dans un article que dans la base de code du projet Zed sur GitHub, la partie éditeur est sous licence GPL, les composants côté serveur sont sous licence AGPL et la partie GPUI (GPU Accelerated User) l'interface) adopte la Licence Apache2.0. GPUI est un produit développé par l'équipe Zed

N'attendez pas OpenAI, attendez qu'Open-Sora soit entièrement open source

Mar 18, 2024 pm 08:40 PM

N'attendez pas OpenAI, attendez qu'Open-Sora soit entièrement open source

Mar 18, 2024 pm 08:40 PM

Il n'y a pas si longtemps, OpenAISora est rapidement devenu populaire grâce à ses étonnants effets de génération vidéo. Il s'est démarqué parmi la foule de modèles vidéo littéraires et est devenu le centre d'attention mondiale. Suite au lancement du processus de reproduction d'inférence de formation Sora avec une réduction des coûts de 46 % il y a 2 semaines, l'équipe Colossal-AI a entièrement open source le premier modèle de génération vidéo d'architecture de type Sora au monde "Open-Sora1.0", couvrant l'ensemble processus de formation, y compris le traitement des données, tous les détails de la formation et les poids des modèles, et joignez-vous aux passionnés mondiaux de l'IA pour promouvoir une nouvelle ère de création vidéo. Pour un aperçu, jetons un œil à une vidéo d'une ville animée générée par le modèle « Open-Sora1.0 » publié par l'équipe Colossal-AI. Ouvrir-Sora1.0

Les performances d'exécution locale du service Embedding dépassent celles d'OpenAI Text-Embedding-Ada-002, ce qui est très pratique !

Apr 15, 2024 am 09:01 AM

Les performances d'exécution locale du service Embedding dépassent celles d'OpenAI Text-Embedding-Ada-002, ce qui est très pratique !

Apr 15, 2024 am 09:01 AM

Ollama est un outil super pratique qui vous permet d'exécuter facilement des modèles open source tels que Llama2, Mistral et Gemma localement. Dans cet article, je vais vous présenter comment utiliser Ollama pour vectoriser du texte. Si vous n'avez pas installé Ollama localement, vous pouvez lire cet article. Dans cet article, nous utiliserons le modèle nomic-embed-text[2]. Il s'agit d'un encodeur de texte qui surpasse OpenAI text-embedding-ada-002 et text-embedding-3-small sur les tâches à contexte court et à contexte long. Démarrez le service nomic-embed-text lorsque vous avez installé avec succès o

Microsoft et OpenAI prévoient d'investir 100 millions de dollars dans des robots humanoïdes ! Les internautes appellent Musk

Feb 01, 2024 am 11:18 AM

Microsoft et OpenAI prévoient d'investir 100 millions de dollars dans des robots humanoïdes ! Les internautes appellent Musk

Feb 01, 2024 am 11:18 AM

Il a été révélé que Microsoft et OpenAI investissaient de grosses sommes d’argent dans une start-up de robots humanoïdes au début de l’année. Parmi eux, Microsoft prévoit d'investir 95 millions de dollars et OpenAI investira 5 millions de dollars. Selon Bloomberg, la société devrait lever un total de 500 millions de dollars au cours de ce cycle, et sa valorisation pré-monétaire pourrait atteindre 1,9 milliard de dollars. Qu'est-ce qui les attire ? Jetons d’abord un coup d’œil aux réalisations de cette entreprise en matière de robotique. Ce robot est tout argenté et noir, et son apparence ressemble à l'image d'un robot dans un blockbuster de science-fiction hollywoodien : maintenant, il met une capsule de café dans la machine à café : si elle n'est pas placée correctement, elle s'ajustera sans aucun problème. télécommande humaine : Cependant, après un certain temps, une tasse de café peut être emportée et dégustée : Avez-vous des membres de votre famille qui l'ont reconnu ? Oui, ce robot a été créé il y a quelque temps.

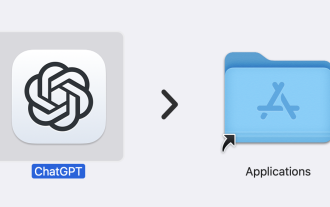

ChatGPT est désormais disponible pour macOS avec la sortie d'une application dédiée

Jun 27, 2024 am 10:05 AM

ChatGPT est désormais disponible pour macOS avec la sortie d'une application dédiée

Jun 27, 2024 am 10:05 AM

L'application ChatGPT Mac d'Open AI est désormais accessible à tous, après avoir été limitée aux seuls utilisateurs disposant d'un abonnement ChatGPT Plus au cours des derniers mois. L'application s'installe comme n'importe quelle autre application Mac native, à condition que vous disposiez d'un Apple S à jour.