Périphériques technologiques

Périphériques technologiques

IA

IA

Le modèle peut-il être directement connecté à AGI tant qu'il « s'agrandit » ? Marcus bombardé à nouveau : Trois crises sont apparues !

Le modèle peut-il être directement connecté à AGI tant qu'il « s'agrandit » ? Marcus bombardé à nouveau : Trois crises sont apparues !

Le modèle peut-il être directement connecté à AGI tant qu'il « s'agrandit » ? Marcus bombardé à nouveau : Trois crises sont apparues !

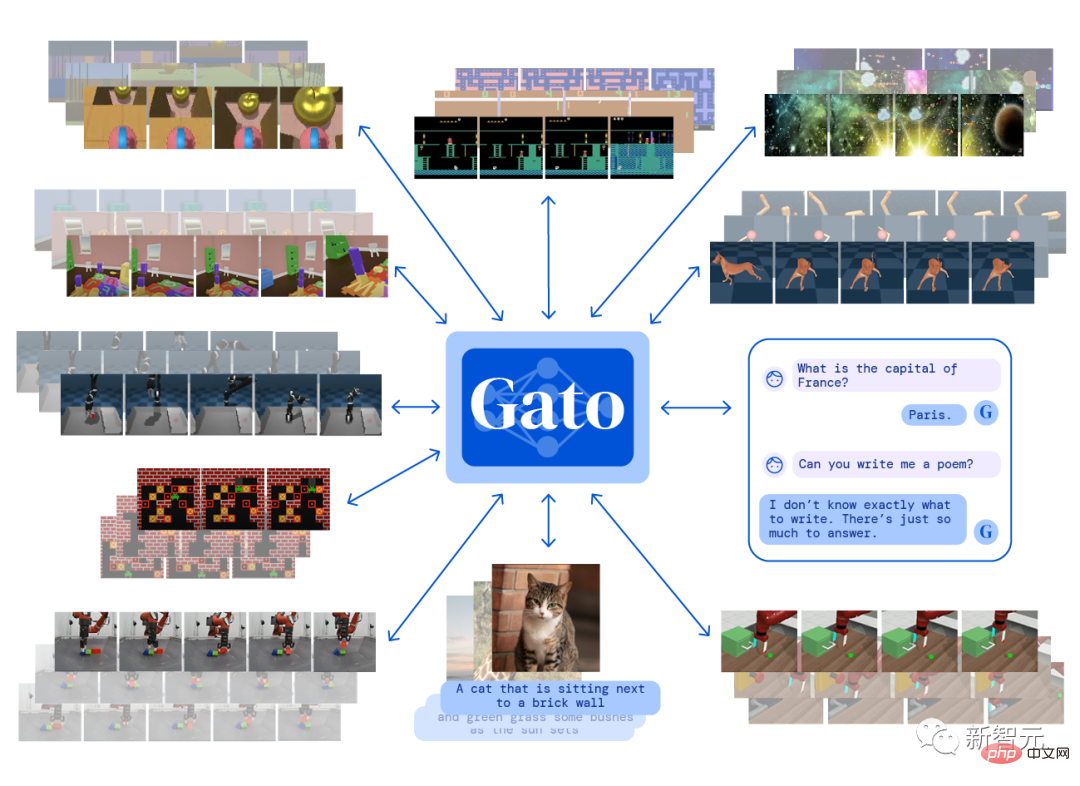

En mai de cette année, DeepMind a lancé Gato, un système d'intelligence artificielle multimodale capable d'effectuer plus de 600 tâches différentes en même temps avec un seul ensemble de paramètres de modèle, ce qui a suscité de vives discussions sur l'intelligence artificielle générale (AGI) dans le monde. industrie.

Nando de Freitas, le directeur de recherche chez DeepMind, avait également tweeté à l'époque que l'IA pouvait être dépassée tant que l'échelle continuait d'augmenter !

Tout ce que nous avons à faire est de rendre le modèle plus grand, plus sûr, plus efficace sur le plan informatique, un échantillonnage plus rapide, un stockage plus intelligent, plus de modalités, innover sur les données, en ligne/hors ligne, etc.

L'AGI peut être atteint en résolvant les problèmes d'échelle. L'industrie doit accorder plus d'attention à ces problèmes !

Récemment, Gary Marcus, spécialiste bien connu de l'IA, fondateur et PDG de Robust.AI et professeur émérite à l'Université de New York, a publié un autre blog, arguant que cette déclaration est « trop tôt » et qu'une crise a commencé !

Marcus continue de prêter attention au développement de l'industrie de l'IA, mais critique le battage médiatique de l'IA. Il a exprimé des objections telles que "l'apprentissage profond heurte un mur" et "GPT-3 n'a absolument aucun sens".

Que dois-je faire si je ne peux pas jouer avec le grand modèle ?

Nando estime que l'intelligence artificielle ne nécessite pas de changement de paradigme, elle nécessite seulement plus de données, une plus grande efficacité et des serveurs plus grands.

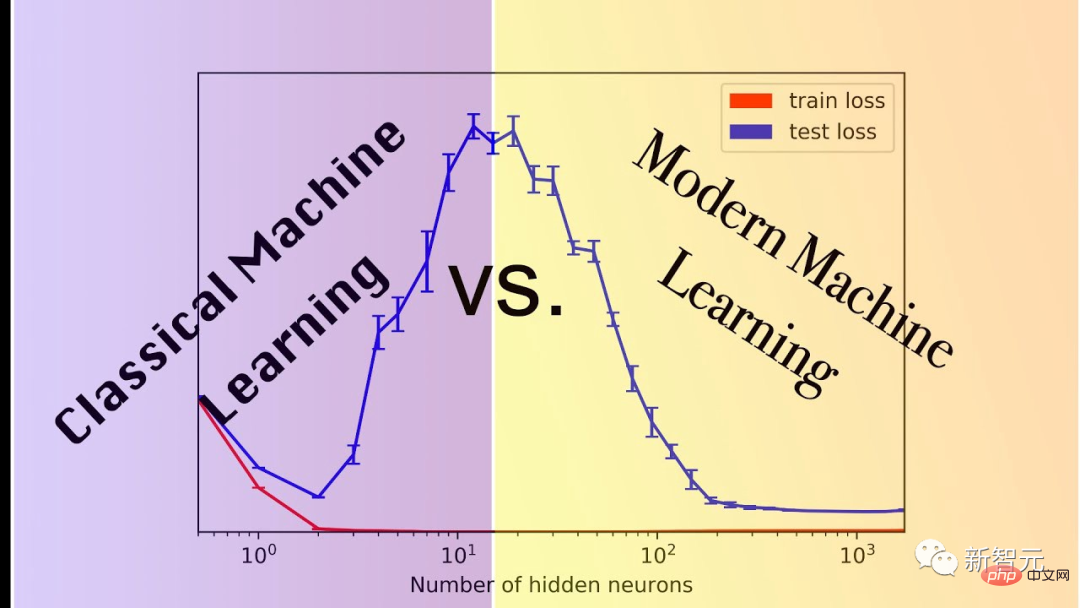

Marcus a paraphrasé cette hypothèse ainsi : Sans nouvelle innovation fondamentale, l'AGI pourrait émerger de modèles à plus grande échelle. Cette hypothèse peut également être appelée mise à l'échelle über-alles.

Son hypothèse, maintenant souvent appelée maximalisme de mise à l'échelle, est toujours très populaire, en grande partie parce que les modèles de plus en plus grands sont en effet très puissants et que des tâches telles que la génération d'images nécessitent l'aide de grands modèles.

Mais ce n’est que jusqu’à présent.

Le problème est que certaines des technologies qui ont été améliorées au fil des mois, voire des années, sont en réalité loin d'avoir l'échelle dont nous avons besoin.

Il existe de plus en plus de schémas de Ponzi. L'avantage de performance apporté par l'échelle n'est que le résultat d'une observation empirique et ne peut pas être garanti comme étant correct.

Marcus partage trois signes récents qui pourraient indiquer la fin de l'hypothèse de maximisation d'échelle.

1. Il n'y a peut-être pas suffisamment de volume de données dans le monde pour prendre en charge une échelle maximale.

Beaucoup de gens ont commencé à s’inquiéter à ce sujet.

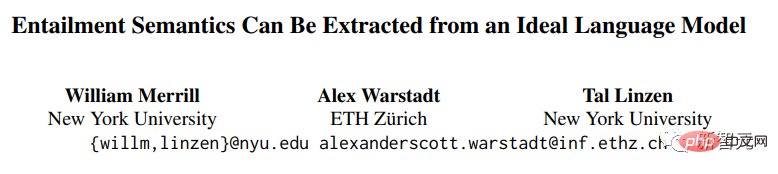

Les chercheurs William Merrill, Alex Warstadt et Tal Linzen de l'Université de New York et de l'ETH Zurich ont récemment proposé une preuve selon laquelle "les modèles de langage neuronal actuels ne sont pas bien adaptés pour extraire la sémantique du langage naturel sans de grandes quantités de données".

Lien papier : https://arxiv.org/pdf/2209.12407.pdf

Bien que cette preuve contienne trop de présupposés pour être utilisée comme preuve de réfutation, mais si cette hypothèse s'en rapproche, et il pourrait y avoir de véritables problèmes à grande échelle très rapidement.

2. Il n'y a peut-être pas suffisamment de ressources informatiques disponibles dans le monde pour prendre en charge une échelle maximale.

Miguel Solano a récemment envoyé à Marcus un manuscrit co-écrit. L'auteur estime qu'atteindre les super standards actuels tels que BIG-bench nécessitera de consommer un quart de la consommation électrique des États-Unis en 2022.

Lien du référentiel :https://www.php.cn/link/e21bd8ab999859f3642d2227e682e66f

BIG-bench est un ensemble de données de référence participatif conçu pour explorer de grands modèles de langage et les déduire des capacités futures, qui comprennent plus de 200 missions.

3. Certaines tâches importantes peuvent tout simplement ne pas évoluer.

L'exemple le plus évident est un récent travail de linguistique de Ruis, Khan, Biderman, Hooker, Rocktäschl et Grefenstette, qui ont étudié la signification pragmatique du langage.

Par exemple, pour la question « Avez-vous laissé des empreintes digitales ? », la réponse reçue peut être « Je portais des gants », dont la signification sémantique est « non ».

Comme Marcus le soutient depuis longtemps, il est vraiment difficile de sensibiliser un modèle à cela sans modèles cognitifs et sans bon sens.

L'échelle ne joue pratiquement aucun rôle dans ce type de tâche. Même le meilleur modèle n'a qu'une précision de 80,6 %. Pour la plupart des modèles, l'effet d'échelle est au mieux négligeable.

Et vous pouvez facilement imaginer une version plus complexe de cette tâche, où les performances du modèle seront encore plus dégradées.

Ce qui a encore plus frappé Marcus, c'est que même pour une seule tâche importante comme celle-ci, une performance d'environ 80 % peut signifier qu'un jeu à grande échelle ne peut pas continuer à être joué.

Si le modèle n'apprend que la syntaxe et la sémantique, mais échoue dans un raisonnement pragmatique ou de bon sens, alors vous n'obtiendrez peut-être pas du tout une AGI digne de confiance

La "loi de Moore" ne nous mène pas aussi loin que prévu initialement. Jusqu'ici, si vite , parce que ce n’est pas la loi de cause à effet dans l’univers et qu’elle sera toujours vraie.

Maximiser l'échelle n'est qu'une hypothèse intéressante. Elle ne nous permettra pas d'atteindre l'intelligence artificielle générale. Par exemple, résoudre les trois problèmes ci-dessus nous obligera à faire un changement de paradigme.

L'internaute Frank van der Velde a déclaré que les abonnés qui maximisent l'échelle ont tendance à utiliser des termes vagues comme « grand » et « plus ».

Les données d'entraînement utilisées par les modèles d'apprentissage profond sont trop volumineuses par rapport aux données d'entraînement utilisées par les humains dans l'apprentissage des langues.

Mais comparées à la véritable collection sémantique du langage humain, ces données dites massives sont encore insignifiantes. Il faudrait environ 10 milliards de personnes pour générer une phrase par seconde, et il faudrait 300 ans pour obtenir une telle échelle. ensemble de formation.

Netizen Rebel Science a même dit sans ambages que maximiser l'échelle n'est pas une hypothèse intéressante, mais une hypothèse stupide. Elle perdra non seulement sur la piste de l'IA, mais mourra également d'une manière laide.

Maximiser l'échelle est trop extrême

Raphaël Millière, maître de conférences au Département de philosophie de l'Université de Columbia et titulaire d'un doctorat à l'Université d'Oxford, a également exprimé certaines de ses propres opinions lorsque la bataille pour « maximiser l'échelle » était à son paroxysme.

La maximisation de l'échelle était autrefois considérée comme le point central des critiques de l'apprentissage profond (tels que Gary Marcus), et lorsque des initiés de l'industrie tels que Nando de Freitas et Alex Dimakis se sont joints au débat, les deux parties étaient en désaccord.

Les réactions des praticiens sont pour la plupart mitigées, mais pas trop négatives. Dans le même temps, la date prévisionnelle de mise en œuvre de l'AGI sur la plateforme de prédiction Metaculus a été avancée à un plus bas historique (mai 2028), ce qui pourrait également accroître la crédibilité de la maximisation. Dépenser.

La confiance croissante des gens dans « l’échelle » peut être due à la sortie de nouveaux modèles, tels que le succès de PaLM, DALL-E 2, Flamingo et Gato, qui ont alimenté le feu de la maximisation de l’échelle.

La « Leçon amère » de Sutton soulève de nombreux points dans la discussion sur la maximisation de l'échelle, mais ils ne sont pas complètement équivalents. Il estime que l'intégration des connaissances humaines dans des modèles d'intelligence artificielle (tels que l'ingénierie des fonctionnalités) est moins efficace que l'exploitation des données et du calcul. apprendre efficacement.

Lien de l'article : http://www.incompleteideas.net/IncIdeas/BitterLesson.html

Bien que non sans controverse, le point de vue de Sutton semble être nettement moins radical que la maximisation de l'échelle.

Cela souligne l’importance de l’échelle, mais cela ne réduit pas tous les problèmes de la recherche en IA à un simple défi d’échelle.

En fait, il est difficile de déterminer la signification spécifique de la maximisation de l'échelle. Au sens littéral, « La mise à l'échelle est tout ce dont vous avez besoin » indique que nous pouvons mettre en œuvre l'AGI sans aucune innovation algorithmique ni modification architecturale, et que nous pouvons étendre les modèles existants et forcer davantage de données. à saisir.

Cette explication littérale semble ridicule : même des modèles comme Palm, DALL-E 2, Flamingo ou Gato nécessitent encore des modifications architecturales par rapport aux approches précédentes.

Il serait vraiment surprenant que quelqu'un pense réellement que nous pourrions étendre un transformateur autorégressif disponible dans le commerce à AGI.

On ne sait pas exactement dans quelle mesure les personnes qui croient en la maximisation de l’échelle estiment que l’AGI a besoin d’innovation algorithmique, ce qui rend également difficile la génération de prédictions falsifiables de ce point de vue.

La mise à l'échelle peut être une condition nécessaire pour construire tout système méritant le label « intelligence artificielle générale », mais nous ne devons pas confondre la nécessité avec une condition suffisante.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Bytedance Cutting lance le super abonnement SVIP : 499 yuans pour un abonnement annuel continu, offrant une variété de fonctions d'IA

Jun 28, 2024 am 03:51 AM

Bytedance Cutting lance le super abonnement SVIP : 499 yuans pour un abonnement annuel continu, offrant une variété de fonctions d'IA

Jun 28, 2024 am 03:51 AM

Ce site a rapporté le 27 juin que Jianying est un logiciel de montage vidéo développé par FaceMeng Technology, une filiale de ByteDance. Il s'appuie sur la plateforme Douyin et produit essentiellement du contenu vidéo court pour les utilisateurs de la plateforme. Il est compatible avec iOS, Android et. Windows, MacOS et autres systèmes d'exploitation. Jianying a officiellement annoncé la mise à niveau de son système d'adhésion et a lancé un nouveau SVIP, qui comprend une variété de technologies noires d'IA, telles que la traduction intelligente, la mise en évidence intelligente, l'emballage intelligent, la synthèse humaine numérique, etc. En termes de prix, les frais mensuels pour le clipping SVIP sont de 79 yuans, les frais annuels sont de 599 yuans (attention sur ce site : équivalent à 49,9 yuans par mois), l'abonnement mensuel continu est de 59 yuans par mois et l'abonnement annuel continu est de 59 yuans par mois. est de 499 yuans par an (équivalent à 41,6 yuans par mois) . En outre, le responsable de Cut a également déclaré que afin d'améliorer l'expérience utilisateur, ceux qui se sont abonnés au VIP d'origine

Assistant de codage d'IA augmenté par le contexte utilisant Rag et Sem-Rag

Jun 10, 2024 am 11:08 AM

Assistant de codage d'IA augmenté par le contexte utilisant Rag et Sem-Rag

Jun 10, 2024 am 11:08 AM

Améliorez la productivité, l’efficacité et la précision des développeurs en intégrant une génération et une mémoire sémantique améliorées par la récupération dans les assistants de codage IA. Traduit de EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG, auteur JanakiramMSV. Bien que les assistants de programmation d'IA de base soient naturellement utiles, ils ne parviennent souvent pas à fournir les suggestions de code les plus pertinentes et les plus correctes, car ils s'appuient sur une compréhension générale du langage logiciel et des modèles d'écriture de logiciels les plus courants. Le code généré par ces assistants de codage est adapté à la résolution des problèmes qu’ils sont chargés de résoudre, mais n’est souvent pas conforme aux normes, conventions et styles de codage des équipes individuelles. Cela aboutit souvent à des suggestions qui doivent être modifiées ou affinées pour que le code soit accepté dans l'application.

Le réglage fin peut-il vraiment permettre au LLM d'apprendre de nouvelles choses : l'introduction de nouvelles connaissances peut amener le modèle à produire davantage d'hallucinations

Jun 11, 2024 pm 03:57 PM

Le réglage fin peut-il vraiment permettre au LLM d'apprendre de nouvelles choses : l'introduction de nouvelles connaissances peut amener le modèle à produire davantage d'hallucinations

Jun 11, 2024 pm 03:57 PM

Les grands modèles linguistiques (LLM) sont formés sur d'énormes bases de données textuelles, où ils acquièrent de grandes quantités de connaissances du monde réel. Ces connaissances sont intégrées à leurs paramètres et peuvent ensuite être utilisées en cas de besoin. La connaissance de ces modèles est « réifiée » en fin de formation. À la fin de la pré-formation, le modèle arrête effectivement d’apprendre. Alignez ou affinez le modèle pour apprendre à exploiter ces connaissances et répondre plus naturellement aux questions des utilisateurs. Mais parfois, la connaissance du modèle ne suffit pas, et bien que le modèle puisse accéder à du contenu externe via RAG, il est considéré comme bénéfique de l'adapter à de nouveaux domaines grâce à un réglage fin. Ce réglage fin est effectué à l'aide de la contribution d'annotateurs humains ou d'autres créations LLM, où le modèle rencontre des connaissances supplémentaires du monde réel et les intègre.

Aucune donnée OpenAI requise, rejoignez la liste des grands modèles de code ! UIUC publie StarCoder-15B-Instruct

Jun 13, 2024 pm 01:59 PM

Aucune donnée OpenAI requise, rejoignez la liste des grands modèles de code ! UIUC publie StarCoder-15B-Instruct

Jun 13, 2024 pm 01:59 PM

À la pointe de la technologie logicielle, le groupe de l'UIUC Zhang Lingming, en collaboration avec des chercheurs de l'organisation BigCode, a récemment annoncé le modèle de grand code StarCoder2-15B-Instruct. Cette réalisation innovante a permis une percée significative dans les tâches de génération de code, dépassant avec succès CodeLlama-70B-Instruct et atteignant le sommet de la liste des performances de génération de code. Le caractère unique de StarCoder2-15B-Instruct réside dans sa stratégie d'auto-alignement pur. L'ensemble du processus de formation est ouvert, transparent et complètement autonome et contrôlable. Le modèle génère des milliers d'instructions via StarCoder2-15B en réponse au réglage fin du modèle de base StarCoder-15B sans recourir à des annotations manuelles coûteuses.

Afin de fournir un nouveau système de référence et d'évaluation de questions-réponses scientifiques et complexes pour les grands modèles, l'UNSW, Argonne, l'Université de Chicago et d'autres institutions ont lancé conjointement le cadre SciQAG.

Jul 25, 2024 am 06:42 AM

Afin de fournir un nouveau système de référence et d'évaluation de questions-réponses scientifiques et complexes pour les grands modèles, l'UNSW, Argonne, l'Université de Chicago et d'autres institutions ont lancé conjointement le cadre SciQAG.

Jul 25, 2024 am 06:42 AM

L'ensemble de données ScienceAI Question Answering (QA) joue un rôle essentiel dans la promotion de la recherche sur le traitement du langage naturel (NLP). Des ensembles de données d'assurance qualité de haute qualité peuvent non seulement être utilisés pour affiner les modèles, mais également évaluer efficacement les capacités des grands modèles linguistiques (LLM), en particulier la capacité à comprendre et à raisonner sur les connaissances scientifiques. Bien qu’il existe actuellement de nombreux ensembles de données scientifiques d’assurance qualité couvrant la médecine, la chimie, la biologie et d’autres domaines, ces ensembles de données présentent encore certaines lacunes. Premièrement, le formulaire de données est relativement simple, et la plupart sont des questions à choix multiples. Elles sont faciles à évaluer, mais limitent la plage de sélection des réponses du modèle et ne peuvent pas tester pleinement la capacité du modèle à répondre aux questions scientifiques. En revanche, les questions et réponses ouvertes

Yolov10 : explication détaillée, déploiement et application en un seul endroit !

Jun 07, 2024 pm 12:05 PM

Yolov10 : explication détaillée, déploiement et application en un seul endroit !

Jun 07, 2024 pm 12:05 PM

1. Introduction Au cours des dernières années, les YOLO sont devenus le paradigme dominant dans le domaine de la détection d'objets en temps réel en raison de leur équilibre efficace entre le coût de calcul et les performances de détection. Les chercheurs ont exploré la conception architecturale de YOLO, les objectifs d'optimisation, les stratégies d'expansion des données, etc., et ont réalisé des progrès significatifs. Dans le même temps, le recours à la suppression non maximale (NMS) pour le post-traitement entrave le déploiement de bout en bout de YOLO et affecte négativement la latence d'inférence. Dans les YOLO, la conception de divers composants manque d’une inspection complète et approfondie, ce qui entraîne une redondance informatique importante et limite les capacités du modèle. Il offre une efficacité sous-optimale et un potentiel d’amélioration des performances relativement important. Dans ce travail, l'objectif est d'améliorer encore les limites d'efficacité des performances de YOLO à la fois en post-traitement et en architecture de modèle. à cette fin

Les performances de SOTA, la méthode d'IA de prédiction d'affinité protéine-ligand multimodale de Xiamen, combinent pour la première fois des informations sur la surface moléculaire

Jul 17, 2024 pm 06:37 PM

Les performances de SOTA, la méthode d'IA de prédiction d'affinité protéine-ligand multimodale de Xiamen, combinent pour la première fois des informations sur la surface moléculaire

Jul 17, 2024 pm 06:37 PM

Editeur | KX Dans le domaine de la recherche et du développement de médicaments, il est crucial de prédire avec précision et efficacité l'affinité de liaison des protéines et des ligands pour le criblage et l'optimisation des médicaments. Cependant, les études actuelles ne prennent pas en compte le rôle important des informations sur la surface moléculaire dans les interactions protéine-ligand. Sur cette base, des chercheurs de l'Université de Xiamen ont proposé un nouveau cadre d'extraction de caractéristiques multimodales (MFE), qui combine pour la première fois des informations sur la surface des protéines, la structure et la séquence 3D, et utilise un mécanisme d'attention croisée pour comparer différentes modalités. alignement. Les résultats expérimentaux démontrent que cette méthode atteint des performances de pointe dans la prédiction des affinités de liaison protéine-ligand. De plus, les études d’ablation démontrent l’efficacité et la nécessité des informations sur la surface des protéines et de l’alignement des caractéristiques multimodales dans ce cadre. Les recherches connexes commencent par "S

Préparant des marchés tels que l'IA, GlobalFoundries acquiert la technologie du nitrure de gallium de Tagore Technology et les équipes associées

Jul 15, 2024 pm 12:21 PM

Préparant des marchés tels que l'IA, GlobalFoundries acquiert la technologie du nitrure de gallium de Tagore Technology et les équipes associées

Jul 15, 2024 pm 12:21 PM

Selon les informations de ce site Web du 5 juillet, GlobalFoundries a publié un communiqué de presse le 1er juillet de cette année, annonçant l'acquisition de la technologie de nitrure de gallium (GaN) et du portefeuille de propriété intellectuelle de Tagore Technology, dans l'espoir d'élargir sa part de marché dans l'automobile et Internet. des objets et des domaines d'application des centres de données d'intelligence artificielle pour explorer une efficacité plus élevée et de meilleures performances. Alors que des technologies telles que l’intelligence artificielle générative (GenerativeAI) continuent de se développer dans le monde numérique, le nitrure de gallium (GaN) est devenu une solution clé pour une gestion durable et efficace de l’énergie, notamment dans les centres de données. Ce site Web citait l'annonce officielle selon laquelle, lors de cette acquisition, l'équipe d'ingénierie de Tagore Technology rejoindrait GF pour développer davantage la technologie du nitrure de gallium. g