Périphériques technologiques

Périphériques technologiques

IA

IA

La version allégée de la méthode de formation ChatGPT est open source ! Construit autour de LLaMA en seulement 3 jours, la vitesse de formation serait 15 fois plus rapide qu'OpenAI

La version allégée de la méthode de formation ChatGPT est open source ! Construit autour de LLaMA en seulement 3 jours, la vitesse de formation serait 15 fois plus rapide qu'OpenAI

La version allégée de la méthode de formation ChatGPT est open source ! Construit autour de LLaMA en seulement 3 jours, la vitesse de formation serait 15 fois plus rapide qu'OpenAI

La version allégée de ChatGPT basée sur le modèle Meta est là ?

Trois jours seulement après que Meta a annoncé le lancement de LLaMA, l'industrie a déjà développé une méthode de formation open source qui la transforme en ChatGPT, qui serait jusqu'à 15 fois plus rapide que la formation ChatGPT.

LLaMA est un GPT-3 ultra-rapide et ultra-petit lancé par Meta. Le nombre de paramètres ne représente que 10 % de ce dernier, et il ne nécessite qu'un seul GPU pour fonctionner.

La méthode pour le transformer en ChatGPT s'appelle ChatLLaMA, qui est formée sur la base du RLHF (apprentissage par renforcement basé sur le feedback humain) et est rapidement devenue populaire sur Internet.

Alors, la version open source de ChatGPT de Meta arrive vraiment ?

Attendez une minute, les choses ne sont pas si simples.

Formez LLaMA à la "méthode open source" de ChatGPT

Cliquez sur la page d'accueil du projet ChatLLaMA et vous constaterez qu'il intègre en fait quatre parties -

DeepSpeed, la méthode RLHF, LLaMA et l'ensemble de données généré sur la base de l'agent LangChain.

Parmi eux, DeepSpeed est une bibliothèque open source d'optimisation de formation d'apprentissage en profondeur, comprenant une technologie d'optimisation existante appelée Zero, qui est utilisée pour améliorer les capacités de formation de grands modèles. Plus précisément, elle fait référence à l'aide au modèle pour améliorer la vitesse de formation et réduire les coûts. , améliorer la disponibilité des modèles, etc.

RLHF utilisera le modèle de récompense pour affiner le modèle pré-entraîné. Le modèle de récompense utilise d'abord plusieurs modèles pour générer des questions et des réponses, puis s'appuie sur un tri manuel des questions et des réponses afin qu'il puisse apprendre à marquer. Ensuite, il note les réponses générées par le modèle sur la base de l'apprentissage des récompenses et améliore l'apprentissage. capacités du modèle grâce à l'apprentissage par renforcement.

LangChain est une grande bibliothèque de développement d'applications de modèles de langage qui espère intégrer divers grands modèles de langage et créer une application pratique combinée avec d'autres sources de connaissances ou puissance de calcul. L'agent LangChain libérera l'ensemble du processus de pensée GPT-3 comme une chaîne de pensée et enregistrera les opérations.

À ce stade, vous constaterez que la chose la plus critique reste le poids du modèle de LLaMA. D'où ça vient ?

Hé, va sur Meta et postule par toi-même, ChatLLaMA ne le fournit pas. (Bien que Meta prétende open source LLaMA, vous devez quand même postuler)

Donc essentiellement, ChatLLaMA n'est pas un projet open source ChatGPT, mais juste une méthode de formation basée sur LLaMA. Plusieurs projets intégrés dans sa bibliothèque étaient à l'origine All. sont open source.

En fait, ChatLLaMA n'a pas été construit par Meta, mais par une start-up d'IA appelée Nebuly AI.

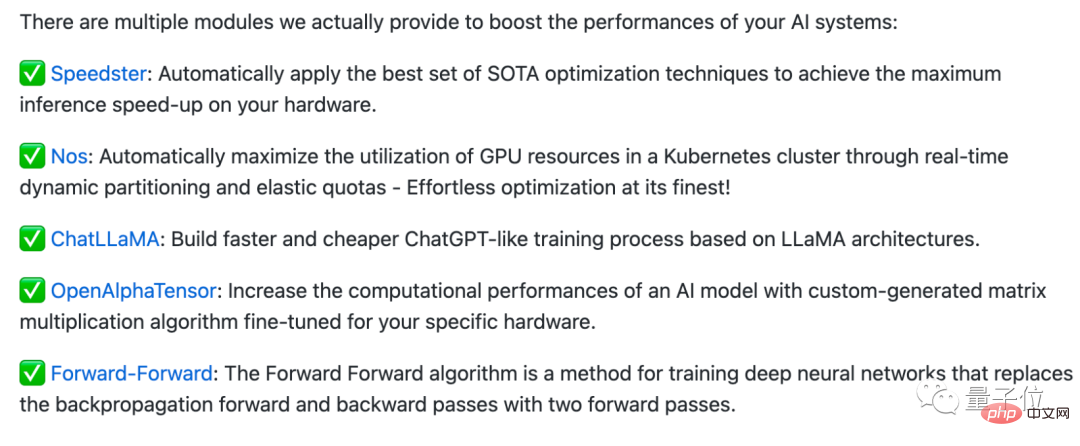

Nebuly AI a créé une bibliothèque open source appelée Nebullvm, qui intègre une série de modules d'optimisation plug-and-play pour améliorer les performances du système d'IA.

Par exemple, voici quelques modules actuellement inclus dans Nebullvm, dont OpenAlphaTensor basé sur l'algorithme open source AlphaTensor de DeepMind, des modules d'optimisation qui détectent automatiquement le matériel et l'accélèrent...

ChatLLaMA fait également partie de cette série de modules, Mais il faut préciser que sa licence open source n’est pas disponible dans le commerce.

Donc, si vous souhaitez utiliser directement le « ChatGPT auto-développé au niveau national », ce n'est peut-être pas si simple (doge).

Après avoir lu ce projet, certains internautes ont dit que ce serait formidable si quelqu'un pouvait vraiment obtenir les poids du modèle (code) de LLaMA...

Mais certains internautes ont souligné que c'est "15 fois plus rapide que la méthode de formation ChatGPT" Cette déclaration est purement trompeuse :

Le soi-disant 15 fois plus rapide est simplement dû au fait que le modèle LLaMA lui-même est petit et peut même fonctionner sur un seul GPU, mais cela ne devrait pas être dû à quelque chose de fait dans ce projet, non ?

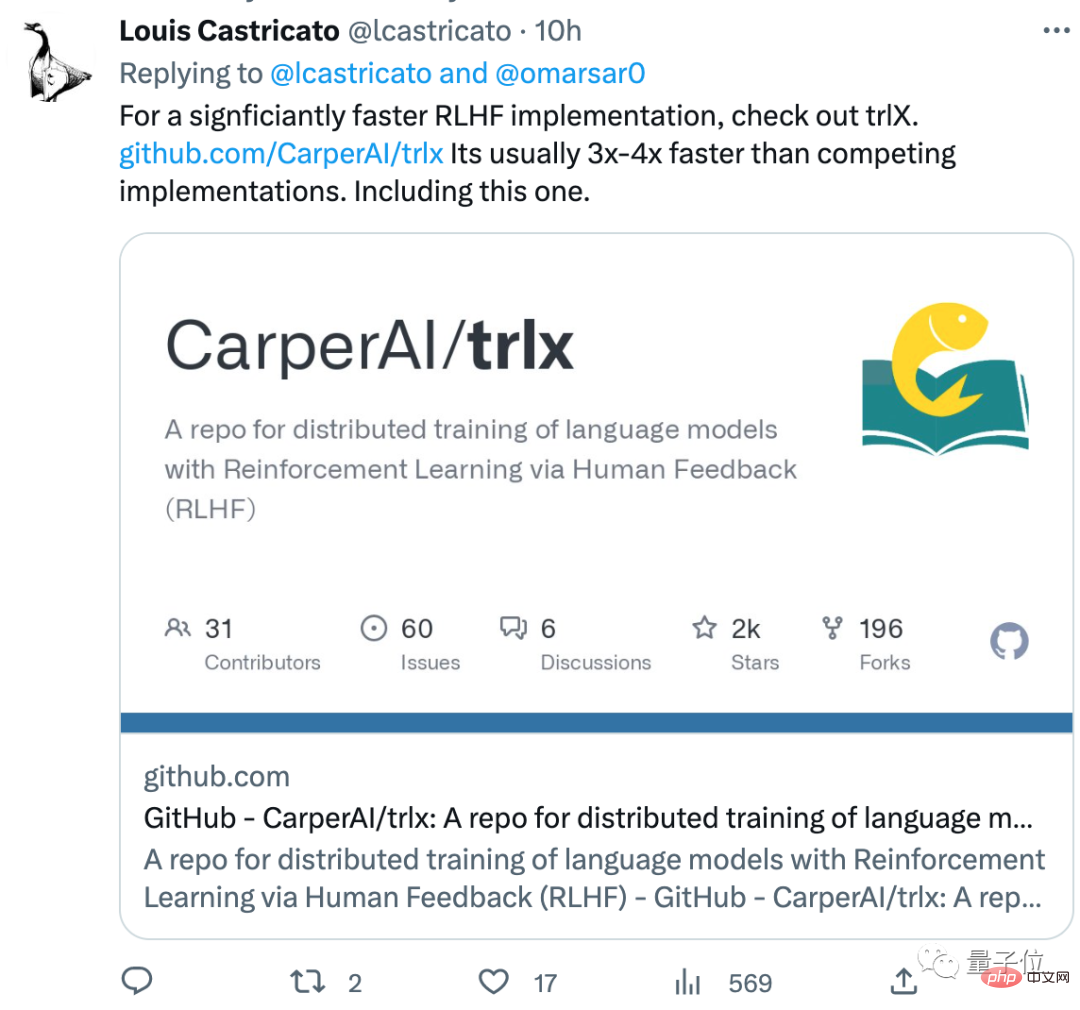

Cet internaute a également recommandé une méthode d'entraînement RLHF meilleure que celle de la bibliothèque, appelée trlx. La vitesse d'entraînement est 3 à 4 fois plus rapide que la méthode RLHF habituelle :

Vous la prenez. Vous avez le code pour LLaMA ? Que pensez-vous de cette méthode de formation ?

Adresse ChatLLaMA :https://www.php.cn/link/fed537780f3f29cc5d5f313bbda423c4

Lien de référence :https://www.php.cn/link/fe27f92b1e3f4997567807f38d567a35

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

Video Face Swap

Échangez les visages dans n'importe quelle vidéo sans effort grâce à notre outil d'échange de visage AI entièrement gratuit !

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Open source! Au-delà de ZoeDepth ! DepthFM : estimation rapide et précise de la profondeur monoculaire !

Apr 03, 2024 pm 12:04 PM

Open source! Au-delà de ZoeDepth ! DepthFM : estimation rapide et précise de la profondeur monoculaire !

Apr 03, 2024 pm 12:04 PM

0. À quoi sert cet article ? Nous proposons DepthFM : un modèle d'estimation de profondeur monoculaire génératif de pointe, polyvalent et rapide. En plus des tâches traditionnelles d'estimation de la profondeur, DepthFM démontre également des capacités de pointe dans les tâches en aval telles que l'inpainting en profondeur. DepthFM est efficace et peut synthétiser des cartes de profondeur en quelques étapes d'inférence. Lisons ce travail ensemble ~ 1. Titre des informations sur l'article : DepthFM : FastMonocularDepthEstimationwithFlowMatching Auteur : MingGui, JohannesS.Fischer, UlrichPrestel, PingchuanMa, Dmytr

Que faire si le code d'écran bleu 0x0000001 apparaît

Feb 23, 2024 am 08:09 AM

Que faire si le code d'écran bleu 0x0000001 apparaît

Feb 23, 2024 am 08:09 AM

Que faire avec le code d'écran bleu 0x0000001. L'erreur d'écran bleu est un mécanisme d'avertissement en cas de problème avec le système informatique ou le matériel. Le code 0x0000001 indique généralement une panne de matériel ou de pilote. Lorsque les utilisateurs rencontrent soudainement une erreur d’écran bleu lors de l’utilisation de leur ordinateur, ils peuvent se sentir paniqués et perdus. Heureusement, la plupart des erreurs d’écran bleu peuvent être dépannées et traitées en quelques étapes simples. Cet article présentera aux lecteurs certaines méthodes pour résoudre le code d'erreur d'écran bleu 0x0000001. Tout d'abord, lorsque nous rencontrons une erreur d'écran bleu, nous pouvons essayer de redémarrer

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas entre officiellement dans l’ère des robots électriques ! Hier, l'Atlas hydraulique s'est retiré "en larmes" de la scène de l'histoire. Aujourd'hui, Boston Dynamics a annoncé que l'Atlas électrique était au travail. Il semble que dans le domaine des robots humanoïdes commerciaux, Boston Dynamics soit déterminé à concurrencer Tesla. Après la sortie de la nouvelle vidéo, elle a déjà été visionnée par plus d’un million de personnes en seulement dix heures. Les personnes âgées partent et de nouveaux rôles apparaissent. C'est une nécessité historique. Il ne fait aucun doute que cette année est l’année explosive des robots humanoïdes. Les internautes ont commenté : Les progrès des robots ont fait ressembler la cérémonie d'ouverture de cette année à des êtres humains, et le degré de liberté est bien plus grand que celui des humains. Mais n'est-ce vraiment pas un film d'horreur ? Au début de la vidéo, Atlas est allongé calmement sur le sol, apparemment sur le dos. Ce qui suit est à couper le souffle

La vitalité de la super intelligence s'éveille ! Mais avec l'arrivée de l'IA qui se met à jour automatiquement, les mères n'ont plus à se soucier des goulots d'étranglement des données.

Apr 29, 2024 pm 06:55 PM

La vitalité de la super intelligence s'éveille ! Mais avec l'arrivée de l'IA qui se met à jour automatiquement, les mères n'ont plus à se soucier des goulots d'étranglement des données.

Apr 29, 2024 pm 06:55 PM

Je pleure à mort. Le monde construit à la folie de grands modèles. Les données sur Internet ne suffisent pas du tout. Le modèle de formation ressemble à « The Hunger Games », et les chercheurs en IA du monde entier se demandent comment nourrir ces personnes avides de données. Ce problème est particulièrement important dans les tâches multimodales. À une époque où rien ne pouvait être fait, une équipe de start-up du département de l'Université Renmin de Chine a utilisé son propre nouveau modèle pour devenir la première en Chine à faire de « l'auto-alimentation des données générées par le modèle » une réalité. De plus, il s’agit d’une approche à deux volets, du côté compréhension et du côté génération, les deux côtés peuvent générer de nouvelles données multimodales de haute qualité et fournir un retour de données au modèle lui-même. Qu'est-ce qu'un modèle ? Awaker 1.0, un grand modèle multimodal qui vient d'apparaître sur le Forum Zhongguancun. Qui est l'équipe ? Moteur Sophon. Fondé par Gao Yizhao, doctorant à la Hillhouse School of Artificial Intelligence de l’Université Renmin.

La version Kuaishou de Sora 'Ke Ling' est ouverte aux tests : génère plus de 120 s de vidéo, comprend mieux la physique et peut modéliser avec précision des mouvements complexes

Jun 11, 2024 am 09:51 AM

La version Kuaishou de Sora 'Ke Ling' est ouverte aux tests : génère plus de 120 s de vidéo, comprend mieux la physique et peut modéliser avec précision des mouvements complexes

Jun 11, 2024 am 09:51 AM

Quoi? Zootopie est-elle concrétisée par l’IA domestique ? Avec la vidéo est exposé un nouveau modèle de génération vidéo domestique à grande échelle appelé « Keling ». Sora utilise une voie technique similaire et combine un certain nombre d'innovations technologiques auto-développées pour produire des vidéos qui comportent non seulement des mouvements larges et raisonnables, mais qui simulent également les caractéristiques du monde physique et possèdent de fortes capacités de combinaison conceptuelle et d'imagination. Selon les données, Keling prend en charge la génération de vidéos ultra-longues allant jusqu'à 2 minutes à 30 ips, avec des résolutions allant jusqu'à 1080p, et prend en charge plusieurs formats d'image. Un autre point important est que Keling n'est pas une démo ou une démonstration de résultats vidéo publiée par le laboratoire, mais une application au niveau produit lancée par Kuaishou, un acteur leader dans le domaine de la vidéo courte. De plus, l'objectif principal est d'être pragmatique, de ne pas faire de chèques en blanc et de se mettre en ligne dès sa sortie. Le grand modèle de Ke Ling est déjà sorti à Kuaiying.

L'US Air Force présente son premier avion de combat IA de grande envergure ! Le ministre a personnellement effectué l'essai routier sans intervenir pendant tout le processus, et 100 000 lignes de code ont été testées 21 fois.

May 07, 2024 pm 05:00 PM

L'US Air Force présente son premier avion de combat IA de grande envergure ! Le ministre a personnellement effectué l'essai routier sans intervenir pendant tout le processus, et 100 000 lignes de code ont été testées 21 fois.

May 07, 2024 pm 05:00 PM

Récemment, le milieu militaire a été submergé par la nouvelle : les avions de combat militaires américains peuvent désormais mener des combats aériens entièrement automatiques grâce à l'IA. Oui, tout récemment, l’avion de combat IA de l’armée américaine a été rendu public pour la première fois, dévoilant ainsi son mystère. Le nom complet de ce chasseur est Variable Stability Simulator Test Aircraft (VISTA). Il a été personnellement piloté par le secrétaire de l'US Air Force pour simuler une bataille aérienne en tête-à-tête. Le 2 mai, le secrétaire de l'US Air Force, Frank Kendall, a décollé à bord d'un X-62AVISTA à la base aérienne d'Edwards. Notez que pendant le vol d'une heure, toutes les actions de vol ont été effectuées de manière autonome par l'IA ! Kendall a déclaré : "Au cours des dernières décennies, nous avons réfléchi au potentiel illimité du combat air-air autonome, mais cela a toujours semblé hors de portée." Mais maintenant,

Programme de codes à distance universels GE sur n'importe quel appareil

Mar 02, 2024 pm 01:58 PM

Programme de codes à distance universels GE sur n'importe quel appareil

Mar 02, 2024 pm 01:58 PM

Si vous devez programmer un appareil à distance, cet article vous aidera. Nous partagerons les meilleurs codes de télécommande universelle GE pour programmer n’importe quel appareil. Qu'est-ce qu'une télécommande GE ? GEUniversalRemote est une télécommande qui peut être utilisée pour contrôler plusieurs appareils tels que les téléviseurs intelligents, LG, Vizio, Sony, Blu-ray, DVD, DVR, Roku, AppleTV, lecteurs multimédias en streaming et plus encore. Les télécommandes GEUniversal sont disponibles en différents modèles avec différentes caractéristiques et fonctions. GEUniversalRemote peut contrôler jusqu'à quatre appareils. Les meilleurs codes de télécommande universels à programmer sur n'importe quel appareil. Les télécommandes GE sont livrées avec un ensemble de codes qui leur permettent de fonctionner avec différents appareils. vous pouvez

Pour seulement 250$, le directeur technique de Hugging Face vous apprend étape par étape comment peaufiner Llama 3

May 06, 2024 pm 03:52 PM

Pour seulement 250$, le directeur technique de Hugging Face vous apprend étape par étape comment peaufiner Llama 3

May 06, 2024 pm 03:52 PM

Les grands modèles de langage open source familiers tels que Llama3 lancé par Meta, les modèles Mistral et Mixtral lancés par MistralAI et Jamba lancé par AI21 Lab sont devenus des concurrents d'OpenAI. Dans la plupart des cas, les utilisateurs doivent affiner ces modèles open source en fonction de leurs propres données pour libérer pleinement le potentiel du modèle. Il n'est pas difficile d'affiner un grand modèle de langage (comme Mistral) par rapport à un petit en utilisant Q-Learning sur un seul GPU, mais le réglage efficace d'un grand modèle comme Llama370b ou Mixtral est resté un défi jusqu'à présent. . C'est pourquoi Philipp Sch, directeur technique de HuggingFace