Périphériques technologiques

Périphériques technologiques

IA

IA

Les essentiels du machine learning : comment éviter le surapprentissage ?

Les essentiels du machine learning : comment éviter le surapprentissage ?

Les essentiels du machine learning : comment éviter le surapprentissage ?

En fait, l'essence de la régularisation est très simple. Il s'agit d'un moyen ou d'une opération qui impose des restrictions ou des contraintes a priori sur un certain problème pour atteindre un objectif spécifique. Le but de l’utilisation de la régularisation dans un algorithme est d’empêcher le surajustement du modèle. Lorsqu'il s'agit de régularisation, de nombreux étudiants peuvent immédiatement penser à la norme L1 et à la norme L2 couramment utilisées. Avant de résumer, voyons d'abord ce qu'est la norme LP ? La

norme LP

norme peut simplement être comprise comme utilisée pour représenter la distance dans l'espace vectoriel, et la définition de la distance est très abstraite tant qu'elle satisfait aux inégalités non négatives, réflexives et triangulaires, elle peut être appelée distance.

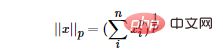

La norme LP n'est pas une norme, mais un ensemble de normes, qui est défini comme suit :

La plage de p est [1,∞). p n'est pas défini comme une norme dans la plage de (0,1) car il viole l'inégalité triangulaire.

Selon le changement de pp, la norme change également différemment. En empruntant un diagramme classique de changement de norme P comme suit :

L'image ci-dessus montre que lorsque p passe de 0 à l'infini positif, la boule unité (unité). balle) change. La boule unitaire définie sous la norme P est un ensemble convexe, mais lorsque 0

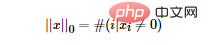

Alors la question est : quelle est la norme L0 ? La norme L0 représente le nombre d'éléments non nuls dans le vecteur et est exprimée par la formule suivante :

Nous pouvons trouver le terme de caractéristique clairsemé le moins optimal en minimisant la norme L0. Mais malheureusement, le problème d’optimisation de la norme L0 est un problème NP difficile (la norme L0 est également non convexe). Par conséquent, dans les applications pratiques, nous effectuons souvent une relaxation convexe de L0. Il est théoriquement prouvé que la norme L1 est l’approximation convexe optimale de la norme L0, donc la norme L1 est généralement utilisée au lieu d’optimiser directement la norme L0.

Norme L1

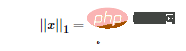

Selon la définition de la norme LP, nous pouvons facilement obtenir la forme mathématique de la norme L1 :

Comme vous pouvez le voir dans la formule ci-dessus, la norme L1 est la somme des valeurs absolues de chaque élément du vecteur, également appelé « Opérateur de régularisation clairsemée » (régularisation Lasso). La question est donc : pourquoi voulons-nous une sparsification ? Les avantages de la sparsification sont nombreux, les deux plus directs sont :

- Sélection des caractéristiques

- Interprétabilité

Norme L2

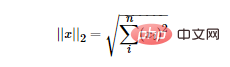

La norme L2 est la plus familière, c'est la distance euclidienne, la formule est la suivante :

La norme L2 a plusieurs noms. Certaines personnes appellent sa régression « Ridge Regression », tandis que d'autres l'appellent « Weight Decay ». Utiliser la norme L2 comme terme de régularisation peut obtenir une solution dense, c'est-à-dire que le paramètre ww correspondant à chaque caractéristique est très petit, proche de 0 mais pas 0 de plus, la norme L2 comme terme de régularisation peut empêcher le modèle de ; s'adapter à l'ensemble de formation. Trop de complexité conduit à un surajustement, améliorant ainsi la capacité de généralisation du modèle.

La différence entre la norme L1 et la norme L2

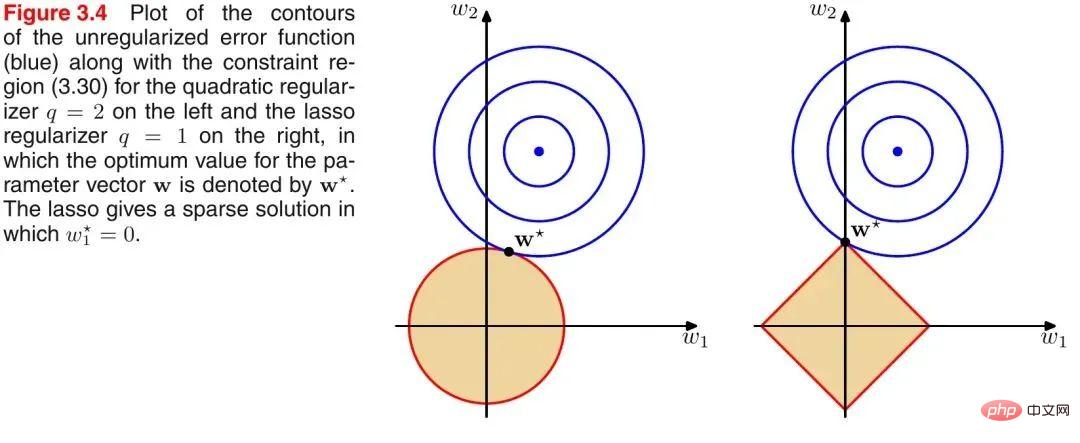

Introduisez un diagramme classique de PRML pour illustrer la différence entre la norme L1 et la norme L2, comme indiqué ci-dessous :

Comme le montre l'image ci-dessus, le cercle bleu indique la plage de solutions possibles du problème, et la couleur orange indique la plage de solutions possibles du terme régulier. La fonction objectif entière (problème original + terme régulier) a une solution si et seulement si les deux plages de solutions sont tangentes. Il est facile de voir sur la figure ci-dessus que puisque la plage de solution de la norme L2 est un cercle, le point tangent n'est probablement pas sur l'axe des coordonnées, et puisque la norme L1 est un losange (le sommet est convexe), son point tangent Le point tangent est plus susceptible d'être sur l'axe des coordonnées, et le point sur l'axe des coordonnées a une caractéristique selon laquelle un seul composant de coordonnées est différent de zéro et les autres composants de coordonnées sont nuls, c'est-à-dire qu'il est clairsemé. Nous avons donc la conclusion suivante : la norme L1 peut conduire à des solutions clairsemées, et la norme L2 peut conduire à des solutions denses.

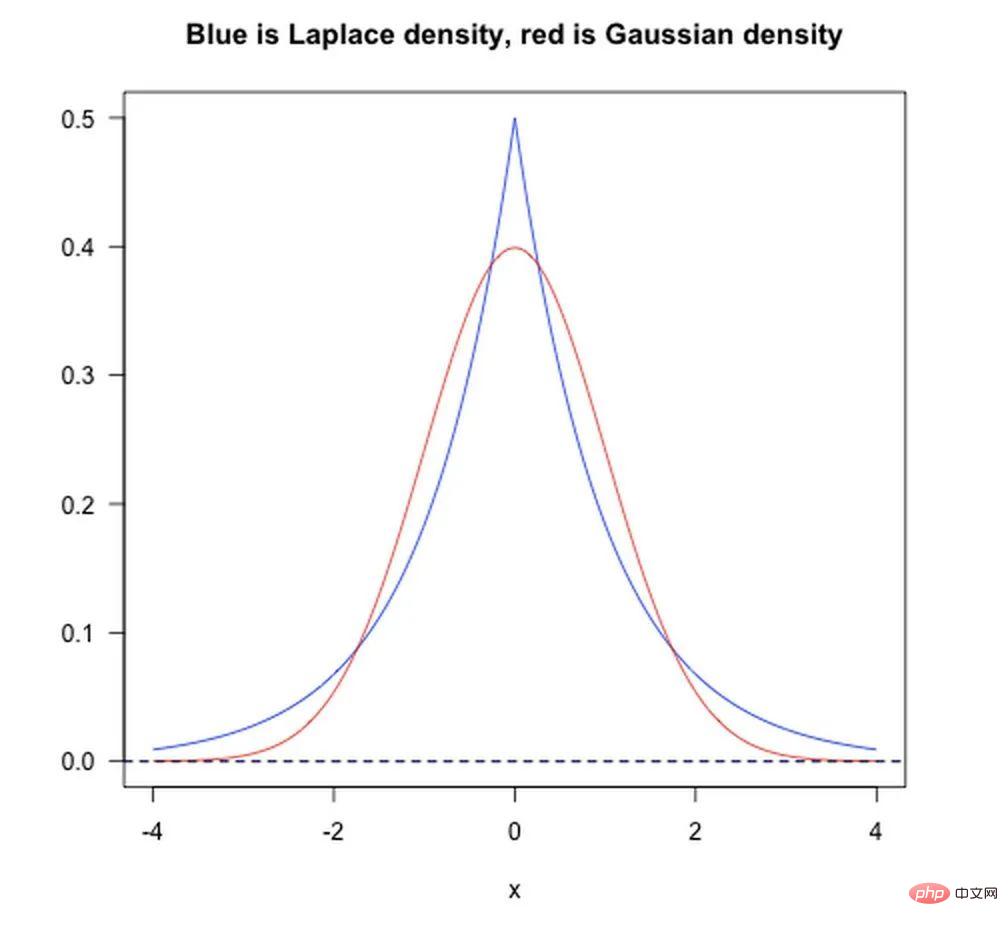

D'un point de vue bayésien a priori, lors de la formation d'un modèle, il ne suffit pas de s'appuyer uniquement sur l'ensemble de données de formation actuel. Afin d'obtenir de meilleures capacités de généralisation, il est souvent nécessaire d'ajouter des termes antérieurs, et l'ajout de termes réguliers équivaut à. A priori a été ajouté.

- La norme L1 équivaut à l'ajout d'un a priori laplacéen ;

- La norme L2 équivaut à l'ajout d'un a priori gaussien ;

Comme le montre la figure ci-dessous :

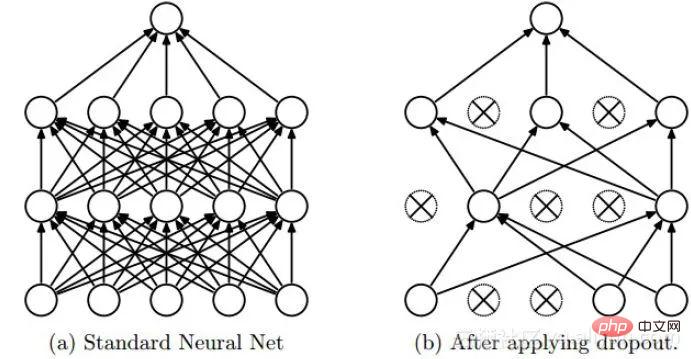

Dropout

Dropout est une méthode de régularisation souvent utilisée en apprentissage profond. Son approche peut être simplement comprise comme la suppression de certains neurones avec une probabilité p pendant le processus de formation des DNN, c'est-à-dire que la sortie des neurones rejetés est égale à 0. Le dropout peut être instancié comme le montre la figure ci-dessous :

Nous pouvons intuitivement comprendre l'effet de régularisation du dropout sous deux aspects :

- L'opération consistant à perdre aléatoirement des neurones au cours de chaque cycle d'entraînement au dropout est équivalente à plusieurs DNN sont en moyenne, ils ont donc pour effet de voter lorsqu'ils sont utilisés à des fins de prédiction.

- Réduire la co-adaptation complexe entre les neurones. Lorsque les neurones de la couche cachée sont supprimés de manière aléatoire, le réseau entièrement connecté devient clairsemé dans une certaine mesure, réduisant ainsi efficacement les effets synergiques des différentes fonctionnalités. En d’autres termes, certaines fonctionnalités peuvent s’appuyer sur l’action conjointe de nœuds cachés avec des relations fixes, et grâce au Dropout, cela organise efficacement la situation dans laquelle certaines fonctionnalités ne sont efficaces qu’en présence d’autres fonctionnalités, augmentant ainsi la robustesse du réseau neuronal. sexe.

Normalisation par lots

La normalisation par lots est strictement une méthode de normalisation, principalement utilisée pour accélérer la convergence du réseau, mais elle a également un certain degré d'effet de régularisation.

Voici une référence à l'explication du changement de covariable dans la réponse Zhihu du Dr Wei Xiushen.

Remarque : le contenu suivant est extrait de la réponse Zhihu du Dr Wei Xiushen. Tout le monde sait qu'une hypothèse classique de l'apprentissage automatique statistique est que « la distribution des données (distribution) de l'espace source (domaine source) et de l'espace cible (domaine cible) est cohérent ». S’ils sont incohérents, de nouveaux problèmes d’apprentissage automatique surgissent, tels que l’apprentissage par transfert/adaptation de domaine, etc. Le changement de covariable est un problème de branche sous l'hypothèse d'une distribution incohérente. Cela signifie que les probabilités conditionnelles de l'espace source et de l'espace cible sont cohérentes, mais leurs probabilités marginales sont différentes. Si vous y réfléchissez bien, vous constaterez qu'en effet, pour les sorties de chaque couche du réseau de neurones, du fait qu'elles ont subi des opérations intra-couches, leur répartition est évidemment différente de la répartition des signaux d'entrée correspondant à chaque couche, et la différence augmentera à mesure que la profondeur du réseau augmente, mais les étiquettes d'échantillon qu'ils peuvent « indiquer » restent inchangées, ce qui répond à la définition du décalage covariable.

L'idée de base de BN est en fait assez intuitive, car la valeur d'entrée d'activation du réseau neuronal avant transformation non linéaire (X=WU+B, U est l'entrée) à mesure que la profondeur du réseau s'approfondit, sa distribution se déplace ou change progressivement (c'est-à-dire le changement de covariable mentionné ci-dessus). La raison pour laquelle l'entraînement converge lentement est généralement parce que la distribution globale se rapproche progressivement des limites supérieure et inférieure de la plage de valeurs de la fonction non linéaire (pour la fonction sigmoïde, cela signifie que la valeur d'entrée d'activation X = WU + B est un grand négatif ou valeur positive ), cela provoque donc la disparition du gradient du réseau neuronal de bas niveau lors de la rétro-propagation, ce qui est la raison essentielle pour laquelle la formation des réseaux neuronaux profonds converge de plus en plus lentement. BN utilise une certaine méthode de normalisation pour forcer la distribution de la valeur d'entrée de n'importe quel neurone dans chaque couche du réseau neuronal à revenir à la distribution normale standard avec une moyenne de 0 et une variance de 1, afin d'éviter le problème de dispersion du gradient provoqué par le fonction d'activation. Ainsi, plutôt que de dire que le rôle du BN est d’atténuer le décalage des covariables, il vaut mieux dire que le BN peut atténuer le problème de dispersion des gradients.

Normalisation, standardisation et régularisation

Nous avons déjà mentionné la régularisation, nous mentionnons ici brièvement la normalisation et la standardisation. Normalisation : le but de la normalisation est de trouver une certaine relation de mappage pour mapper les données d'origine sur l'intervalle [a, b]. Généralement, a et b prendront des combinaisons de [−1,1], [0,1]. Il existe généralement deux scénarios d'application :

- Convertir le nombre en un nombre décimal entre (0, 1)

- Convertir le nombre dimensionnel en un nombre sans dimension

Normalisation min-max couramment utilisée :

Standardisation : Utiliser le théorème des grands nombres pour transformer les données en une distribution normale standard. La formule de standardisation est :

La différence entre normalisation et standardisation :

Nous pouvons l'expliquer simplement ainsi : la mise à l'échelle normalisée est "aplatie" uniformément à l'intervalle (déterminée uniquement par des valeurs extrêmes), tandis que la mise à l'échelle normalisée est plus "élastique" et "dynamique" et a une grande relation avec la distribution de l’échantillon global. Remarque :

- Normalisation : la mise à l'échelle est uniquement liée à la différence entre les valeurs maximales et minimales.

- Standardisation : la mise à l'échelle est liée à chaque point et se reflète par la variance. Comparez cela avec la normalisation, à laquelle tous les points de données contribuent (par le biais de la moyenne et de l'écart type).

Pourquoi la standardisation et la normalisation ?

- Améliorez la précision du modèle : après la normalisation, les caractéristiques entre les différentes dimensions sont numériquement comparables, ce qui peut considérablement améliorer la précision du classificateur.

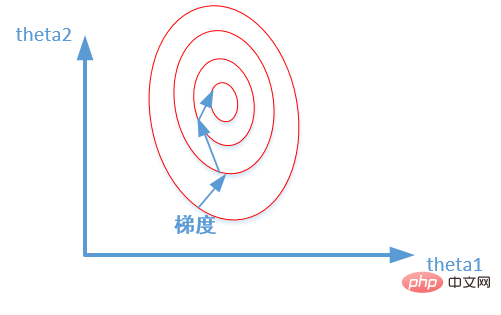

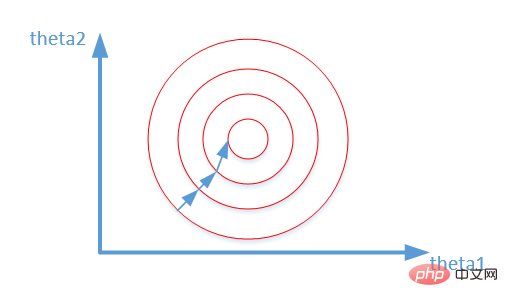

- Accélérer la convergence des modèles : après la standardisation, le processus d'optimisation de la solution optimale deviendra évidemment plus fluide, ce qui facilitera la convergence correcte vers la solution optimale. Comme le montre l'image ci-dessous :

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Cet article vous amènera à comprendre SHAP : explication du modèle pour l'apprentissage automatique

Jun 01, 2024 am 10:58 AM

Cet article vous amènera à comprendre SHAP : explication du modèle pour l'apprentissage automatique

Jun 01, 2024 am 10:58 AM

Dans les domaines de l’apprentissage automatique et de la science des données, l’interprétabilité des modèles a toujours été au centre des préoccupations des chercheurs et des praticiens. Avec l'application généralisée de modèles complexes tels que l'apprentissage profond et les méthodes d'ensemble, la compréhension du processus décisionnel du modèle est devenue particulièrement importante. Explainable AI|XAI contribue à renforcer la confiance dans les modèles d'apprentissage automatique en augmentant la transparence du modèle. L'amélioration de la transparence des modèles peut être obtenue grâce à des méthodes telles que l'utilisation généralisée de plusieurs modèles complexes, ainsi que les processus décisionnels utilisés pour expliquer les modèles. Ces méthodes incluent l'analyse de l'importance des caractéristiques, l'estimation de l'intervalle de prédiction du modèle, les algorithmes d'interprétabilité locale, etc. L'analyse de l'importance des fonctionnalités peut expliquer le processus de prise de décision du modèle en évaluant le degré d'influence du modèle sur les fonctionnalités d'entrée. Estimation de l’intervalle de prédiction du modèle

Au-delà d'ORB-SLAM3 ! SL-SLAM : les scènes de faible luminosité, de gigue importante et de texture faible sont toutes gérées

May 30, 2024 am 09:35 AM

Au-delà d'ORB-SLAM3 ! SL-SLAM : les scènes de faible luminosité, de gigue importante et de texture faible sont toutes gérées

May 30, 2024 am 09:35 AM

Écrit précédemment, nous discutons aujourd'hui de la manière dont la technologie d'apprentissage profond peut améliorer les performances du SLAM (localisation et cartographie simultanées) basé sur la vision dans des environnements complexes. En combinant des méthodes d'extraction de caractéristiques approfondies et de correspondance de profondeur, nous introduisons ici un système SLAM visuel hybride polyvalent conçu pour améliorer l'adaptation dans des scénarios difficiles tels que des conditions de faible luminosité, un éclairage dynamique, des zones faiblement texturées et une gigue importante. Notre système prend en charge plusieurs modes, notamment les configurations étendues monoculaire, stéréo, monoculaire-inertielle et stéréo-inertielle. En outre, il analyse également comment combiner le SLAM visuel avec des méthodes d’apprentissage profond pour inspirer d’autres recherches. Grâce à des expériences approfondies sur des ensembles de données publiques et des données auto-échantillonnées, nous démontrons la supériorité du SL-SLAM en termes de précision de positionnement et de robustesse du suivi.

Implémentation d'algorithmes d'apprentissage automatique en C++ : défis et solutions courants

Jun 03, 2024 pm 01:25 PM

Implémentation d'algorithmes d'apprentissage automatique en C++ : défis et solutions courants

Jun 03, 2024 pm 01:25 PM

Les défis courants rencontrés par les algorithmes d'apprentissage automatique en C++ incluent la gestion de la mémoire, le multithread, l'optimisation des performances et la maintenabilité. Les solutions incluent l'utilisation de pointeurs intelligents, de bibliothèques de threads modernes, d'instructions SIMD et de bibliothèques tierces, ainsi que le respect des directives de style de codage et l'utilisation d'outils d'automatisation. Des cas pratiques montrent comment utiliser la bibliothèque Eigen pour implémenter des algorithmes de régression linéaire, gérer efficacement la mémoire et utiliser des opérations matricielles hautes performances.

IA explicable : Expliquer les modèles IA/ML complexes

Jun 03, 2024 pm 10:08 PM

IA explicable : Expliquer les modèles IA/ML complexes

Jun 03, 2024 pm 10:08 PM

Traducteur | Revu par Li Rui | Chonglou Les modèles d'intelligence artificielle (IA) et d'apprentissage automatique (ML) deviennent aujourd'hui de plus en plus complexes, et le résultat produit par ces modèles est une boîte noire – impossible à expliquer aux parties prenantes. L'IA explicable (XAI) vise à résoudre ce problème en permettant aux parties prenantes de comprendre comment fonctionnent ces modèles, en s'assurant qu'elles comprennent comment ces modèles prennent réellement des décisions et en garantissant la transparence des systèmes d'IA, la confiance et la responsabilité pour résoudre ce problème. Cet article explore diverses techniques d'intelligence artificielle explicable (XAI) pour illustrer leurs principes sous-jacents. Plusieurs raisons pour lesquelles l’IA explicable est cruciale Confiance et transparence : pour que les systèmes d’IA soient largement acceptés et fiables, les utilisateurs doivent comprendre comment les décisions sont prises

Cinq écoles d'apprentissage automatique que vous ne connaissez pas

Jun 05, 2024 pm 08:51 PM

Cinq écoles d'apprentissage automatique que vous ne connaissez pas

Jun 05, 2024 pm 08:51 PM

L'apprentissage automatique est une branche importante de l'intelligence artificielle qui donne aux ordinateurs la possibilité d'apprendre à partir de données et d'améliorer leurs capacités sans être explicitement programmés. L'apprentissage automatique a un large éventail d'applications dans divers domaines, de la reconnaissance d'images et du traitement du langage naturel aux systèmes de recommandation et à la détection des fraudes, et il change notre façon de vivre. Il existe de nombreuses méthodes et théories différentes dans le domaine de l'apprentissage automatique, parmi lesquelles les cinq méthodes les plus influentes sont appelées les « Cinq écoles d'apprentissage automatique ». Les cinq grandes écoles sont l’école symbolique, l’école connexionniste, l’école évolutionniste, l’école bayésienne et l’école analogique. 1. Le symbolisme, également connu sous le nom de symbolisme, met l'accent sur l'utilisation de symboles pour le raisonnement logique et l'expression des connaissances. Cette école de pensée estime que l'apprentissage est un processus de déduction inversée, à travers les connaissances existantes.

Flash Attention est-il stable ? Meta et Harvard ont constaté que les écarts de poids de leur modèle fluctuaient de plusieurs ordres de grandeur.

May 30, 2024 pm 01:24 PM

Flash Attention est-il stable ? Meta et Harvard ont constaté que les écarts de poids de leur modèle fluctuaient de plusieurs ordres de grandeur.

May 30, 2024 pm 01:24 PM

MetaFAIR s'est associé à Harvard pour fournir un nouveau cadre de recherche permettant d'optimiser le biais de données généré lors de l'apprentissage automatique à grande échelle. On sait que la formation de grands modèles de langage prend souvent des mois et utilise des centaines, voire des milliers de GPU. En prenant comme exemple le modèle LLaMA270B, sa formation nécessite un total de 1 720 320 heures GPU. La formation de grands modèles présente des défis systémiques uniques en raison de l’ampleur et de la complexité de ces charges de travail. Récemment, de nombreuses institutions ont signalé une instabilité dans le processus de formation lors de la formation des modèles d'IA générative SOTA. Elles apparaissent généralement sous la forme de pics de pertes. Par exemple, le modèle PaLM de Google a connu jusqu'à 20 pics de pertes au cours du processus de formation. Le biais numérique est à l'origine de cette imprécision de la formation,

Algorithme de détection amélioré : pour la détection de cibles dans des images de télédétection optique haute résolution

Jun 06, 2024 pm 12:33 PM

Algorithme de détection amélioré : pour la détection de cibles dans des images de télédétection optique haute résolution

Jun 06, 2024 pm 12:33 PM

01Aperçu des perspectives Actuellement, il est difficile d'atteindre un équilibre approprié entre efficacité de détection et résultats de détection. Nous avons développé un algorithme YOLOv5 amélioré pour la détection de cibles dans des images de télédétection optique haute résolution, en utilisant des pyramides de caractéristiques multicouches, des stratégies de têtes de détection multiples et des modules d'attention hybrides pour améliorer l'effet du réseau de détection de cibles dans les images de télédétection optique. Selon l'ensemble de données SIMD, le mAP du nouvel algorithme est 2,2 % meilleur que YOLOv5 et 8,48 % meilleur que YOLOX, permettant ainsi d'obtenir un meilleur équilibre entre les résultats de détection et la vitesse. 02 Contexte et motivation Avec le développement rapide de la technologie de télédétection, les images de télédétection optique à haute résolution ont été utilisées pour décrire de nombreux objets à la surface de la Terre, notamment des avions, des voitures, des bâtiments, etc. Détection d'objets dans l'interprétation d'images de télédétection

AlphaFold 3 est lancé, prédisant de manière exhaustive les interactions et les structures des protéines et de toutes les molécules de la vie, avec une précision bien plus grande que jamais

Jul 16, 2024 am 12:08 AM

AlphaFold 3 est lancé, prédisant de manière exhaustive les interactions et les structures des protéines et de toutes les molécules de la vie, avec une précision bien plus grande que jamais

Jul 16, 2024 am 12:08 AM

Editeur | Radis Skin Depuis la sortie du puissant AlphaFold2 en 2021, les scientifiques utilisent des modèles de prédiction de la structure des protéines pour cartographier diverses structures protéiques dans les cellules, découvrir des médicaments et dresser une « carte cosmique » de chaque interaction protéique connue. Tout à l'heure, Google DeepMind a publié le modèle AlphaFold3, capable d'effectuer des prédictions de structure conjointe pour des complexes comprenant des protéines, des acides nucléiques, de petites molécules, des ions et des résidus modifiés. La précision d’AlphaFold3 a été considérablement améliorée par rapport à de nombreux outils dédiés dans le passé (interaction protéine-ligand, interaction protéine-acide nucléique, prédiction anticorps-antigène). Cela montre qu’au sein d’un cadre unique et unifié d’apprentissage profond, il est possible de réaliser