Génération d'images basée sur le modèle de diffusion

Partie 01 Cet article proposait que les modèles génératifs de l'époque tels que VAE présentaient une grande difficulté, c'est-à-dire que ce type de modèle définit d'abord la distribution conditionnelle, puis définit le postérieur variationnel à adapter. conduisent à la nécessité d'optimiser à la fois la distribution conditionnelle et la distribution variationnelle a posteriori. Cependant, cela est très difficile. Si nous pouvons définir un processus simple qui mappe la distribution des données à une gaussienne standard, la tâche du « générateur » devient simplement d'adapter chaque petite étape du processus inverse de ce processus. C'est l'idée centrale du modèle de diffusion. . Cependant, cet article n’a pas fait de vagues à l’époque.

1.2 DéveloppementEn 2020, sur la base d'idées précédentes, le modèle DDPM (Denoising Diffusion Probabilistic Models) a été proposé. Par rapport au modèle de diffusion de base, l'auteur a combiné le modèle de diffusion et le débruitage Les guides de partition. le processus de formation et d'échantillonnage, qui entraîne une amélioration appropriée des échantillons d'images générés, de sorte que dans des conditions de formation plus simples et plus stables, le résultat final puisse être comparable au modèle GAN.

Figure 2-Résultats de génération de DDPM

Cependant, le modèle DDPM n'est pas parfait Puisque le processus de diffusion est une chaîne de Markov, son inconvénient est qu'il nécessite un nombre relativement grand. d'étapes de diffusion. Ce n'est qu'ainsi que l'on peut obtenir des résultats relativement bons, ce qui entraîne une génération d'échantillons très lente.

Ainsi, après le DDPM, en 2021, Song et al. ont proposé le DDIM (Denoising Diffusioin Implicit Model), qui a transformé la méthode d'échantillonnage du processus de diffusion du DDPM et a promu le processus de diffusion markovien traditionnel pour les processus non markoviens. , des étapes d'échantillonnage plus petites peuvent être utilisées pour accélérer la génération d'échantillons, améliorant ainsi considérablement l'efficacité.

1.3 Outbreak

En 2022, Google a lancé un nouveau système d'IA basé sur le modèle de diffusion, qui peut convertir des descriptions textuelles en images réalistes.

Photo 3

Photo 4

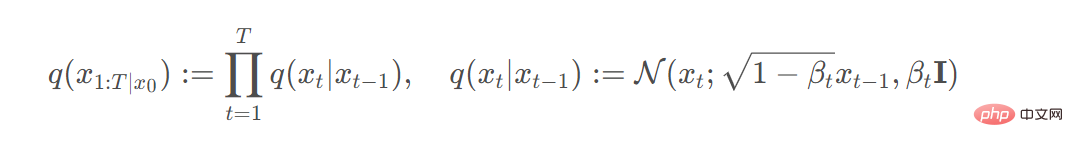

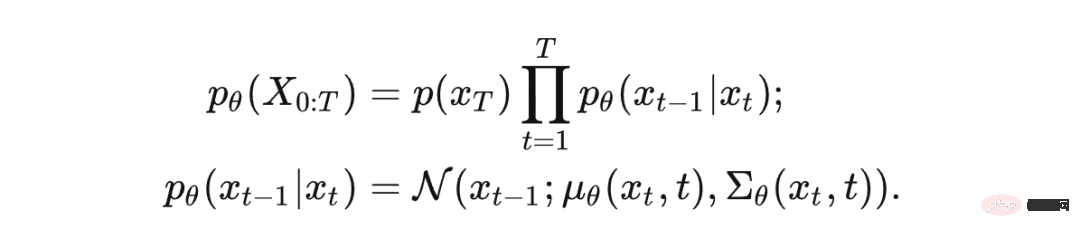

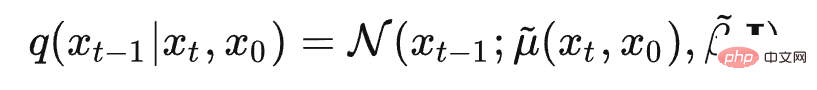

Comme le montre le schéma schématique fourni par Google, le champ saisi texte Tout d'abord, il est codé, puis converti en une petite image 64*64 par un modèle de diffusion texte-image. De plus, un modèle de diffusion super-résolution est utilisé pour traiter la petite image, et la résolution de l'image est. amélioré dans un processus itératif supplémentaire, résultant en Le résultat final généré est une image finale de 1024*1024. Ce processus magique est exactement comme ce que tout le monde ressent lorsqu'il l'utilise. Vous entrez un morceau de texte - un chien golden retriever portant un col roulé à pois rouges et un chapeau à carreaux bleus, puis le programme génère automatiquement le texte ci-dessus pour vous. vu. Une autre application populaire au niveau des phénomènes - novalAI, il s'agissait à l'origine d'un site Web dédié à l'écriture d'IA. Basé sur la génération d'images à chaud actuelle, il s'est combiné avec des ressources d'images sur Internet pour former un site Web axé sur la génération d'images bidimensionnelles. Le modèle a commencé à atteindre le niveau des peintres humains en termes d'effet. En plus de la saisie traditionnelle de texte pour produire des images, il prend également en charge la saisie d'images comme référence, ce qui permet à l'IA être basé sur des images connues La génération de nouvelles images basées sur des images existantes résout dans une certaine mesure le problème des résultats incontrôlables générés par l'IA. Partie 02 Explication du principe gi 2.1 Processus Forward , alors le processus d'ajout de bruit peut être exprimé par : Comme mentionné ci-dessus, il s'agit d'un Markov processus en chaîne. Finalement, les données auront tendance à être une distribution gaussienne isotrope. 2.2 Processus de diffusion inverse Le processus inverse est un processus de débruitage Si est connu, x0 peut être restauré à partir de la distribution gaussienne standard complète. est suffisamment petit, alors est toujours une distribution gaussienne, et alors Prévoyez-le, nous avons donc : Si x0 est connu, alors par la formule bayésienne : Si pour l'apprentissage automatique Les lecteurs qui savent il faut savoir que toute formation de modèle consiste à optimiser les paramètres du modèle pour obtenir une moyenne et une variance fiables. Nous maximisons le log de vraisemblance de la distribution de prédiction du modèle, c'est-à-dire : Après. une série de dérivation, le modèle DDPM a obtenu l'expression finale de la fonction de perte : Pour résumer le processus de formation : Figure 6 Cependant, avec le développement de la technologie de l'IA, il y aura toujours des différends, et le domaine de la génération d'images ne fait pas exception. En plus des problèmes de la technologie de l'IA elle-même, tels que la structure de l'image générée est erronée et déraisonnable, il existe également certains aspects juridiques, tels que les questions de droits d'auteur sur les œuvres d'IA elles-mêmes. Les problèmes techniques peuvent être résolus grâce au développement de la technologie elle-même. Nous avons des raisons de croire qu’avec le développement de la technologie de l’IA, la génération d’images atteindra à terme un niveau très élevé, ce qui éliminera la plupart des tâches bas de gamme liées à la peinture, ce qui éliminera la plupart des tâches liées à la peinture. Libère grandement la productivité humaine. Les problèmes de droit d'auteur peuvent encore obliger les ministères à accorder suffisamment d'attention au développement des industries connexes et à améliorer les politiques et les systèmes concernés. Cela nous oblige à réfléchir davantage aux domaines émergents afin que la technologie de l'IA puisse mieux nous servir. https://www.php.cn/link/3799b2e805a7fa8b076fc020574a73b2 https://www.php.cn/ lien /6872937617af85db5a39a5243e858d1f https://www.php.cn/link/831da40e5907987235ebe5616446e083  gird

gird

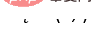

Alors, quel est le processus de fonctionnement d'une technologie d'IA aussi puissante ? Ici, nous prenons comme exemple le modèle DDPM plus classique pour donner un bref processus :

Le processus forward est un processus d'ajout de bruit à l'image, dans le but de construire un échantillon d'entraînement GT.

Pour une distribution de données initiale donnée x0~q(x), nous ajoutons progressivement du bruit gaussien à la distribution de données. Ce processus a T fois, et le résultat de chaque étape est x1, x2,..., xt , l'écart type du bruit est exprimé par

satisfait la distribution gaussienne et

satisfait la distribution gaussienne et ne peut pas être simplement déduit, nous utilisons donc un modèle d'apprentissage profond avec des paramètres

2.3 Processus de formation

Partie 03

Résumé ● Les modèles de diffusion ont montré grand potentiel. Par rapport aux modèles VAE, ils n'ont pas besoin d'aligner la distribution postérieure, ni de former des discriminateurs supplémentaires comme le GAN, y compris la vision par ordinateur, la bioinformatique, il a des applications dans le traitement de la voix et d'autres aspects. Cela contribuera à améliorer l'efficacité de la création d'images. Cela pourrait permettre à l'IA de générer plusieurs images en fonction des conditions, et les humains pourraient filtrer et modifier les résultats. Ce sera l'avenir de la peinture 2D, ce qui pourrait grandement améliorer l'efficacité de la production. d’actifs numériques 2D.

Références

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

1359

1359

52

52

Comment changer la taille d'une liste de bootstrap?

Apr 07, 2025 am 10:45 AM

Comment changer la taille d'une liste de bootstrap?

Apr 07, 2025 am 10:45 AM

La taille d'une liste d'amorçage dépend de la taille du conteneur qui contient la liste, pas de la liste elle-même. L'utilisation du système de grille de bootstrap ou de Flexbox peut contrôler la taille du conteneur, redimentant ainsi indirectement les éléments de la liste.

Comment implémenter la nidification des listes de bootstrap?

Apr 07, 2025 am 10:27 AM

Comment implémenter la nidification des listes de bootstrap?

Apr 07, 2025 am 10:27 AM

Les listes imbriquées dans Bootstrap nécessitent l'utilisation du système de grille de bootstrap pour contrôler le style. Tout d'abord, utilisez la couche extérieure & lt; ul & gt; et & lt; li & gt; Pour créer une liste, alors enveloppez la liste des calques intérieure dans & lt; div class = & quot; row & gt; et ajouter & lt; div class = & quot; col-md-6 & quot; & gt; à la liste des calques intérieure pour spécifier que la liste des calques intérieure occupe la moitié de la largeur d'une ligne. De cette façon, la liste intérieure peut avoir la bonne

Comment ajouter des icônes à la liste Bootstrap?

Apr 07, 2025 am 10:42 AM

Comment ajouter des icônes à la liste Bootstrap?

Apr 07, 2025 am 10:42 AM

Comment ajouter des icônes à la liste Bootstrap: fourre directement l'icône dans l'élément de liste & lt; li & gt;, en utilisant le nom de classe fourni par la bibliothèque d'icônes (comme Font Awesome). Utilisez la classe bootstrap pour aligner les icônes et le texte (par exemple, d-flex, justifier-content-between, align-items-center). Utilisez le composant Bootstrap Tag (badge) pour afficher les numéros ou l'état. Ajustez la position de l'icône (Flex-Direction: Row-Reverse;), Contrôlez le style (style CSS). Erreur commune: l'icône ne s'affiche pas (pas

Quelle méthode est utilisée pour convertir les chaînes en objets dans vue.js?

Apr 07, 2025 pm 09:39 PM

Quelle méthode est utilisée pour convertir les chaînes en objets dans vue.js?

Apr 07, 2025 pm 09:39 PM

Lors de la conversion des chaînes en objets dans vue.js, JSON.Parse () est préféré pour les chaînes JSON standard. Pour les chaînes JSON non standard, la chaîne peut être traitée en utilisant des expressions régulières et réduisez les méthodes en fonction du format ou du codé décodé par URL. Sélectionnez la méthode appropriée en fonction du format de chaîne et faites attention aux problèmes de sécurité et d'encodage pour éviter les bogues.

Quels changements ont été apportés avec le style de liste de bootstrap 5?

Apr 07, 2025 am 11:09 AM

Quels changements ont été apportés avec le style de liste de bootstrap 5?

Apr 07, 2025 am 11:09 AM

Les modifications de style de la liste Bootstrap 5 sont principalement dues à l'optimisation des détails et à l'amélioration sémantique, notamment: les marges par défaut des listes non ordonnées sont simplifiées, et les effets visuels sont plus propres et soignés; Le style de liste met l'accent sur la sémantique, l'amélioration de l'accessibilité et la maintenabilité.

Comment afficher le système de grille de bootstrap

Apr 07, 2025 am 09:48 AM

Comment afficher le système de grille de bootstrap

Apr 07, 2025 am 09:48 AM

Le système de maillage de Bootstrap est une règle pour construire rapidement des dispositions réactives, composées de trois classes principales: conteneur (conteneur), ligne (ligne) et col (colonne). Par défaut, des grilles à 12 colonnes sont fournies et la largeur de chaque colonne peut être ajustée via des classes auxiliaires telles que Col-MD-, réalisant ainsi l'optimisation de mise en page pour différentes tailles d'écran. En utilisant des classes de décalage et des mailles imbriquées, la flexibilité de mise en page peut être étendue. Lorsque vous utilisez un système de grille, assurez-vous que chaque élément a la bonne structure de nidification et envisagez une optimisation des performances pour améliorer la vitesse de chargement des pages. Ce n'est que par une compréhension et une pratique approfondies que nous pouvons maîtriser avec compétence le système de grille bootstrap.

Comment centrer des images dans des conteneurs pour bootstrap

Apr 07, 2025 am 09:12 AM

Comment centrer des images dans des conteneurs pour bootstrap

Apr 07, 2025 am 09:12 AM

Présentation: Il existe de nombreuses façons de centrer des images à l'aide de bootstrap. Méthode de base: utilisez la classe MX-Auto pour centrer horizontalement. Utilisez la classe IMG-FLUID pour vous adapter au conteneur parent. Utilisez la classe D-Block pour définir l'image sur un élément de niveau bloc (centrage vertical). Méthode avancée: mise en page Flexbox: utilisez les propriétés Justify-Content-Center et Align-Items-Center. Disposition de la grille: Utilisez les éléments de lieu: propriété centrale. Meilleures pratiques: éviter les nidification et les styles inutiles. Choisissez la meilleure méthode pour le projet. Faites attention à la maintenabilité du code et évitez de sacrifier la qualité du code pour poursuivre l'excitation

Géospatial de Laravel: optimisation des cartes interactives et de grandes quantités de données

Apr 08, 2025 pm 12:24 PM

Géospatial de Laravel: optimisation des cartes interactives et de grandes quantités de données

Apr 08, 2025 pm 12:24 PM

Traiter efficacement 7 millions d'enregistrements et créer des cartes interactives avec la technologie géospatiale. Cet article explore comment traiter efficacement plus de 7 millions d'enregistrements en utilisant Laravel et MySQL et les convertir en visualisations de cartes interactives. Exigences initiales du projet de défi: extraire des informations précieuses en utilisant 7 millions d'enregistrements dans la base de données MySQL. Beaucoup de gens considèrent d'abord les langages de programmation, mais ignorent la base de données elle-même: peut-il répondre aux besoins? La migration des données ou l'ajustement structurel est-il requis? MySQL peut-il résister à une charge de données aussi importante? Analyse préliminaire: les filtres et les propriétés clés doivent être identifiés. Après analyse, il a été constaté que seuls quelques attributs étaient liés à la solution. Nous avons vérifié la faisabilité du filtre et établi certaines restrictions pour optimiser la recherche. Recherche de cartes basée sur la ville