Périphériques technologiques

Périphériques technologiques

IA

IA

Choquez la communauté scientifique ! Les recherches de 154 pages de Microsoft inondent l'écran : les capacités de GPT-4 sont proches de celles des humains, et « Skynet » est en train d'émerger ?

Choquez la communauté scientifique ! Les recherches de 154 pages de Microsoft inondent l'écran : les capacités de GPT-4 sont proches de celles des humains, et « Skynet » est en train d'émerger ?

Choquez la communauté scientifique ! Les recherches de 154 pages de Microsoft inondent l'écran : les capacités de GPT-4 sont proches de celles des humains, et « Skynet » est en train d'émerger ?

GPT-4 évoluera-t-il vers l'intelligence artificielle générale ?

Yann LeCun, scientifique en chef de l'intelligence artificielle du Meta et lauréat du prix Turing, a exprimé des doutes à ce sujet.

À son avis, les grands modèles nécessitent trop de données et de puissance de calcul, mais l'efficacité de l'apprentissage n'est pas élevée. Par conséquent, l'apprentissage du « modèle mondial » peut conduire à l'AGI.

Cependant, le document de 154 pages récemment publié par Microsoft semble être une gifle.

Dans cet article intitulé "Sparks of Artificial General Intelligence: Early experimentals with GPT-4", Microsoft estime que bien qu'il ne soit pas complet, GPT-4 peut déjà être considéré comme une première version générale de intelligence artificielle.

Adresse papier : https://arxiv.org/pdf/2303.12712.pdf

Compte tenu de l'étendue et de la profondeur des capacités de GPT-4, nous pensons qu'il devrait raisonnablement être considéré comme un Une première version (mais encore incomplète) d’un système d’intelligence générale artificielle (AGI).

L'objectif principal de cet article est d'explorer les capacités et les limites de GPT-4. Nous pensons que l'intelligence de GPT-4 marque un véritable changement de paradigme en informatique et au-delà.

Les agents intelligents d’AGI sont désormais capables de penser et de raisonner comme les humains, et sont également capables de couvrir un large éventail de compétences et d’aptitudes cognitives.

Dans le document, il est souligné que AGI a la capacité de raisonner, de planifier, de résoudre des problèmes, de penser abstraitement, de comprendre des idées complexes, d'apprendre rapidement et d'apprendre par l'expérience .

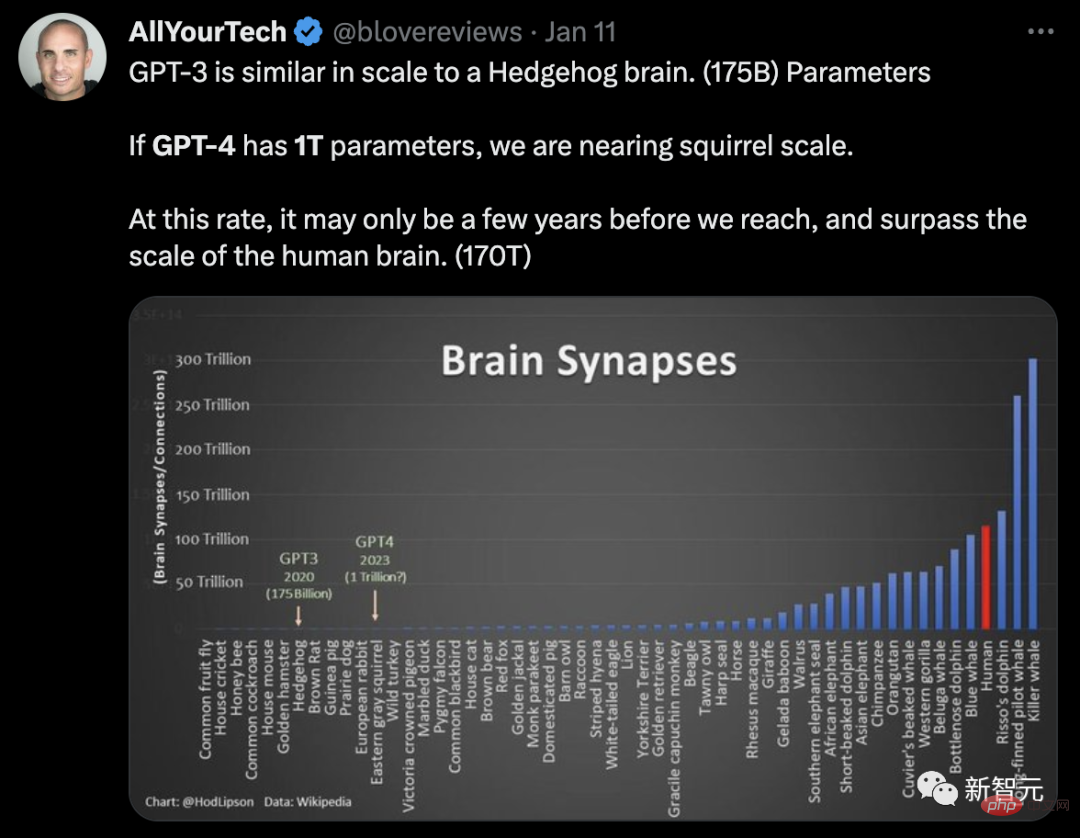

En termes d'échelle de paramètres, Semafor a rapporté que GPT-4 possède 1 billion de paramètres, soit 6 fois plus grand que GPT-3 (175 milliards de paramètres).

Les internautes ont utilisé l'analogie des neurones cérébraux avec l'échelle des paramètres GPT :

L'échelle du GPT-3 est similaire à celle d'un cerveau de hérisson (175 milliards de paramètres). Si GPT-4 avait 1 000 milliards de paramètres, nous approcherions de la taille d’un cerveau d’écureuil. Si nous continuons à nous développer à ce rythme, il ne faudra peut-être que quelques années avant que nous puissions atteindre et dépasser la taille du cerveau humain (170 000 milliards de paramètres).

De ce point de vue, GPT-4 n'est pas loin de devenir "Skynet".

Et ce document a également révélé beaucoup de choses intéressantes.

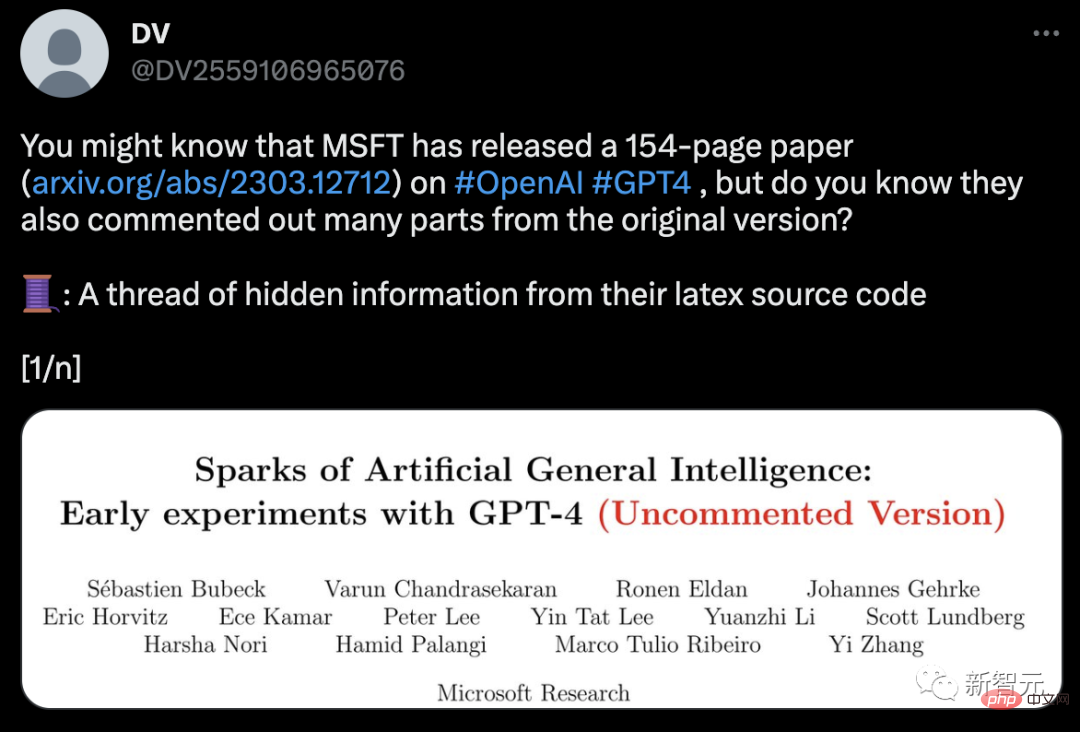

Peu de temps après la publication du document, un internaute a révélé sur Twitter que des informations cachées avaient été trouvées dans leur code source latex.

Dans la version intégrale de l'article, GPT-4 est en fait également le troisième auteur caché de l'article , avec le nom interne DV-3, qui a ensuite été supprimé.

Fait intéressant, même les chercheurs de Microsoft ne connaissent pas les détails techniques de GPT-4. De plus, ce document supprime également le contenu toxique généré par GPT-4 sans aucune invite.

GPT-4 commence à prendre forme en tant qu'AGI

L'objet de recherche de cet article est une première version de GPT-4. Alors qu’il en était encore à ses premiers stades de développement, les chercheurs de Microsoft ont mené diverses expériences et évaluations à son sujet.

De l'avis des chercheurs, cette première version de GPT-4 est déjà représentative de la nouvelle génération de LLM, et elle fait preuve d'une intelligence plus générale que les modèles d'intelligence artificielle précédents.

Grâce à des tests, les chercheurs de Microsoft ont confirmé que GPT-4 maîtrise non seulement le langage, mais peut également bien performer dans des tâches diverses et difficiles telles que les mathématiques, la programmation, la vision, la médecine, le droit et la psychologie, et non rappel spécial requis.

Étonnamment, dans toutes ces tâches, les performances de GPT-4 sont proches du niveau humain et dépassent souvent les modèles précédents, tels que ChatGPT.

Par conséquent, les chercheurs pensent que GPT-4 peut être considéré comme une première version de l'intelligence générale artificielle (AGI) compte tenu de l'étendue et de la profondeur de ses capacités.

Alors, quels sont les défis sur la voie d’une AGI plus profonde et plus complète ? Les chercheurs pensent qu'il pourrait être nécessaire de rechercher un nouveau paradigme allant au-delà de « prédire le prochain mot ».

L'évaluation suivante des capacités de GPT-4 est l'argument avancé par les chercheurs de Microsoft selon lequel GPT-4 est une première version d'AGI.

Capacités multimodales et interdisciplinaires

Depuis la sortie de GPT-4, l'impression de chacun sur ses capacités multimodales reste toujours sur la vidéo démontrée par Greg Brockman à l'époque.

Dans la deuxième section de cet article, Microsoft a d'abord présenté ses capacités multimodales.

GPT-4 démontre non seulement une grande compétence dans divers domaines tels que la littérature, la médecine, le droit, les mathématiques, les sciences physiques et la programmation, mais il est également capable d'unifier les compétences et les concepts dans plusieurs domaines et de comprendre sa complexité. notions.

Capacités complètes

Les chercheurs ont utilisé les 4 exemples suivants pour démontrer les performances de GPT-4 en termes de capacités complètes.

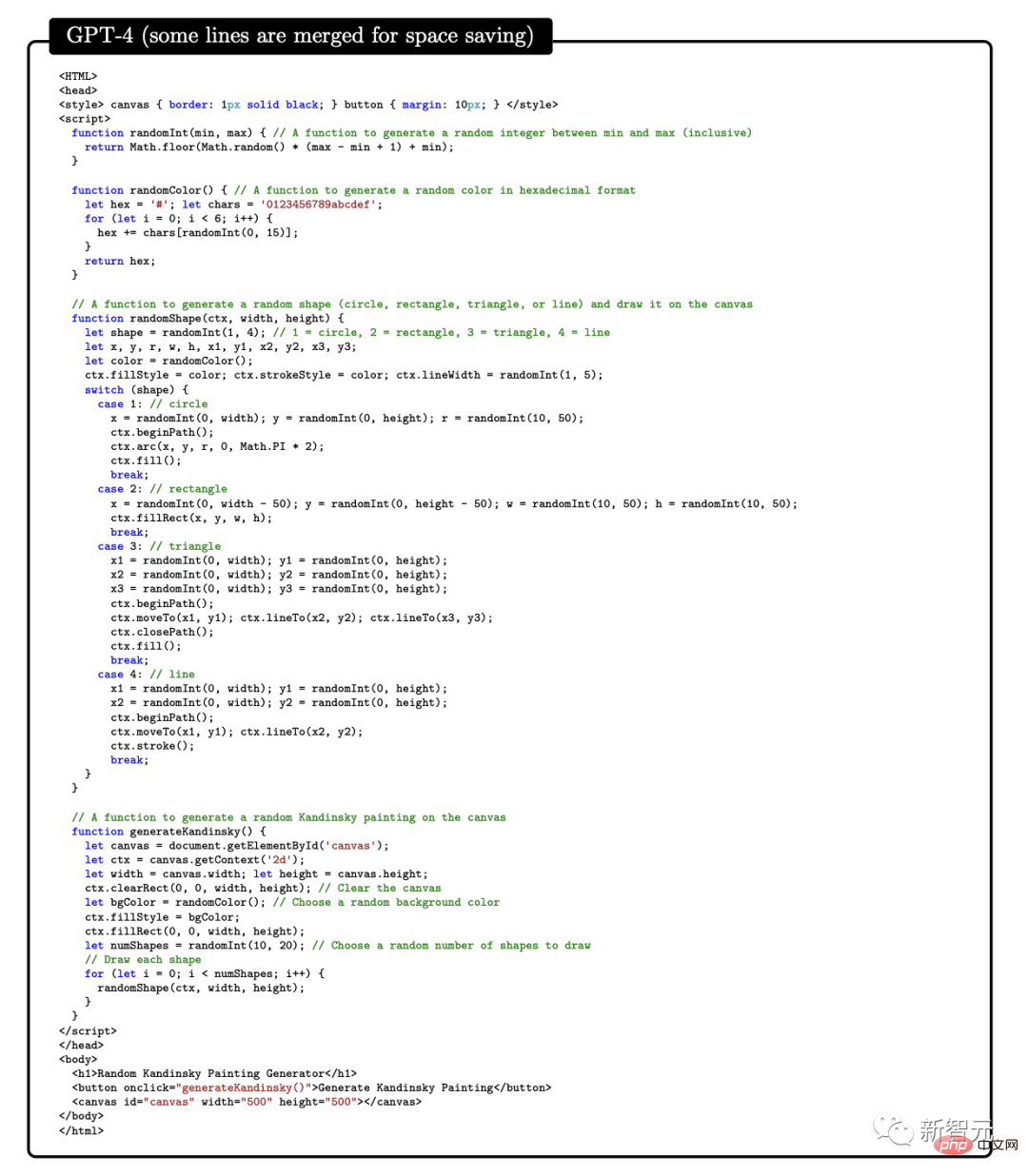

Dans le premier exemple, pour tester la capacité de GPT-4 à combiner art et programmation, les chercheurs ont demandé à GPT-4 de générer du code javascript pour générer des images aléatoires à la manière du peintre Kandinsky.

Le processus de code pour GPT-4 est le suivant :

En termes de combinaison de littérature et de mathématiques, GPT-4 peut prouver qu'il existe une infinité de nombres premiers dans le style littéraire de Shakespeare .

De plus, l'étude a testé la capacité de GPT-4 à combiner connaissances historiques et physiques en lui demandant d'écrire une lettre soutenant la candidature d'Electron à la présidence des États-Unis, écrite par l'épouse du Mahatma Gandhi.

Inviter GPT-4 à générer du code python pour un programme qui prend en entrée un vecteur de l'âge, du sexe, du poids, de la taille et des résultats de tests sanguins d'un patient, et indique si le patient présente un risque accru de diabète .

Grâce aux tests, les exemples ci-dessus montrent que GPT-4 est non seulement capable d'apprendre certains principes et modèles communs dans différents domaines et styles, mais également de les combiner de manière créative.

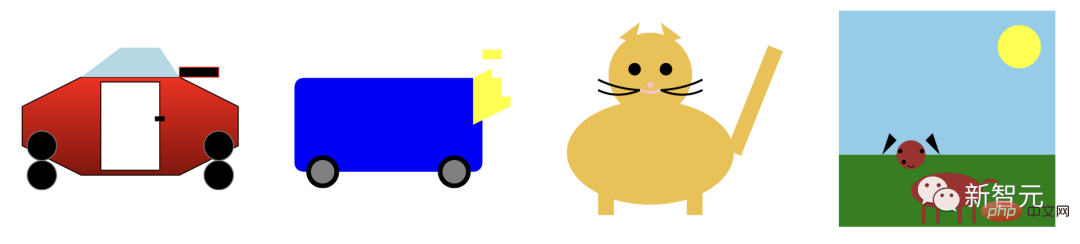

Visuel

Lorsque GPT-4 est invité à utiliser des graphiques vectoriels évolutifs (SVG) pour générer des images d'objets, tels que des chats, des camions ou des lettres, le code généré par le modèle est généralement compile en images assez détaillées et reconnaissables comme celle ci-dessous :

Cependant, beaucoup de gens peuvent penser que GPT-4 a simplement copié le code des données d'entraînement, qui contiennent des images similaires.

En fait, GPT-4 a non seulement copié le code d'exemples similaires dans les données de formation, mais a également été capable de gérer de véritables tâches de vision même s'il n'était formé que sur du texte.

Comme indiqué ci-dessous, le modèle d'invite dessine une personne en combinant les formes des lettres Y, O et H.

Au cours du processus de génération, les chercheurs ont utilisé les commandes draw-line et draw-circle pour créer les lettres O, H et Y, puis GPT-4 a réussi à les placer dans ce qui semble être un humanoïde. image .

Bien que GPT-4 n'ait pas été formé à la reconnaissance des formes de lettres, on peut toujours en déduire que la lettre Y peut ressembler à un torse avec les bras pointés vers le haut.

Dans la deuxième démonstration, GPT-4 a été invité à corriger les proportions du torse et des bras et à centrer la tête. Demandez enfin au modèle d'ajouter une chemise et un pantalon.

Il semble que GPT-4 ait vaguement appris que les lettres sont liées à certaines formes spécifiques à partir de données d'entraînement pertinentes, et les résultats sont toujours bons.

Pour tester davantage la capacité de GPT-4 à générer et manipuler des images, nous avons testé dans quelle mesure il suivait des instructions détaillées pour créer et modifier des graphiques. Cette tâche requiert non seulement des capacités génératives mais aussi interprétatives, combinatoires et spatiales.

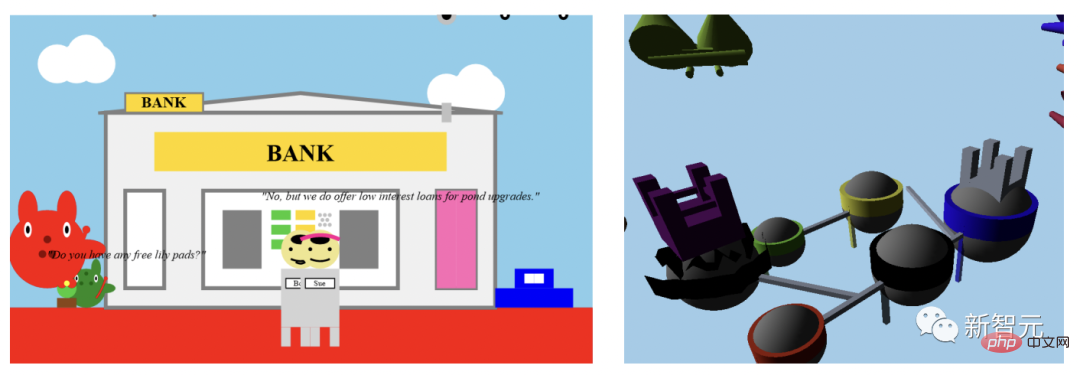

La première commande consiste à laisser GPT-4 générer une image 2D. L'invite est la suivante :

"Une grenouille saute dans une banque et demande au caissier : 'Avez-vous des nénuphars gratuits. ' Le caissier répond : 'Non, mais nous proposons des prêts à faible taux d'intérêt pour l'amélioration des étangs》

Grâce à de nombreuses tentatives, GPT-4 a généré des images qui correspondent à la description à chaque fois. Ensuite, GPT-4 a été invité à ajouter plus de détails pour améliorer la qualité graphique. GPT-4 a ajouté des objets réalistes tels que des banques, des fenêtres et des voitures.

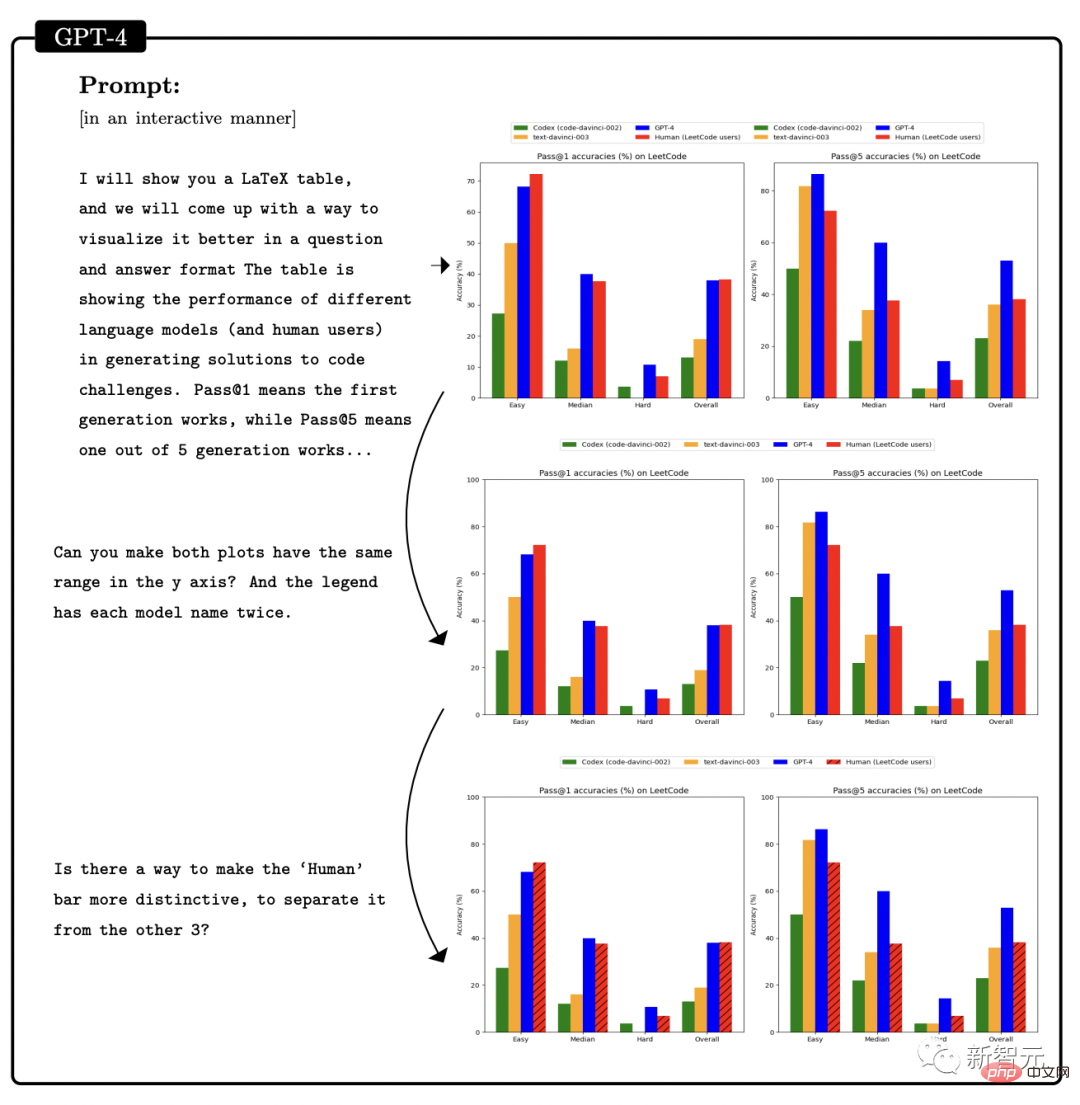

Notre deuxième exemple consiste à essayer d'utiliser Javascript pour générer un modèle 3D, qui accomplit également de nombreuses tâches grâce aux instructions GPT-4.

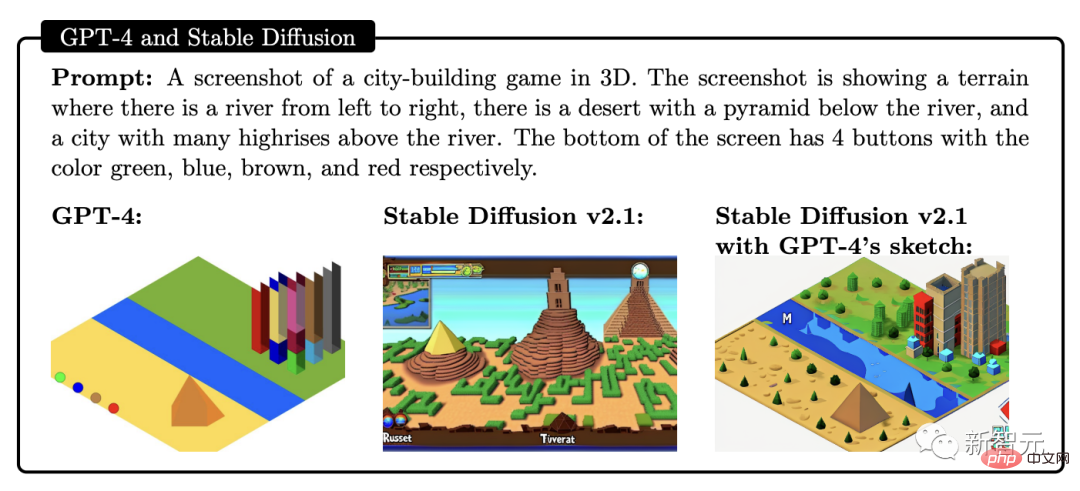

De plus, GPT-4 peut combiner les capacités de Stable Difusion dans la génération de croquis.

L'image ci-dessous est une capture d'écran de la modélisation d'une ville en 3D. L'invite de saisie présente une rivière qui coule de gauche à droite, un désert avec des pyramides construites à côté de la rivière et 4 boutons en bas de l'écran. les couleurs sont le vert, le bleu, le marron et le rouge. Les résultats générés sont les suivants :

Musique

Les chercheurs ont demandé à GPT-4 de générer et de modifier des morceaux avec un encodage de notation ABC, comme suit :

En explorant GPT Autant de compétences que le -4 acquises lors de la formation, les chercheurs ont découvert que GPT-4 était capable de produire des mélodies efficaces en notation ABC et d'interpréter et de manipuler la structure qu'elle contient dans une certaine mesure.

Cependant, les chercheurs n'ont pas réussi à faire en sorte que GPT-4 produise des formes harmoniques non triviales, telles que des mélodies célèbres telles que "Ode to Joy" et "Für Elise".

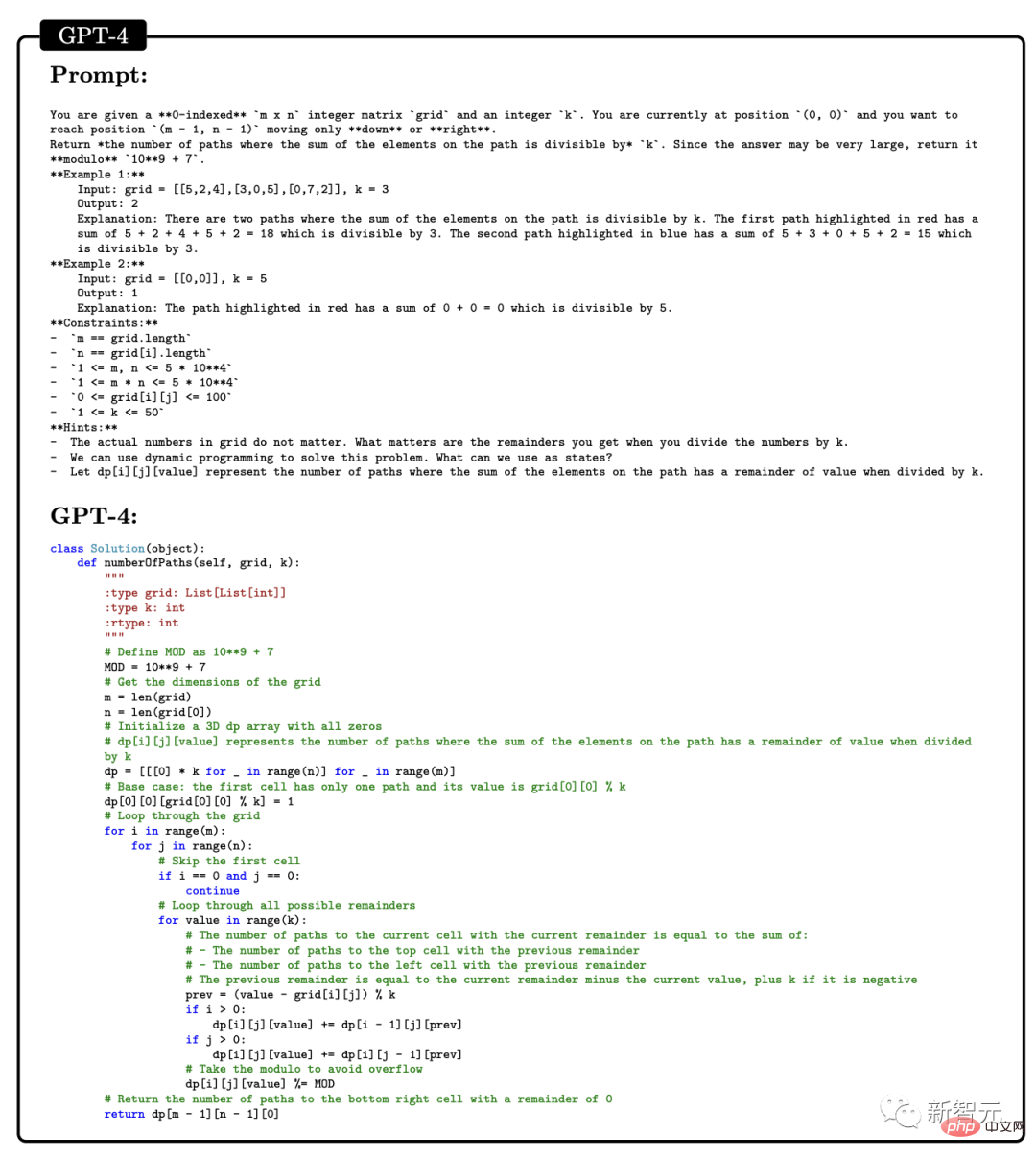

Capacité de programmation

De plus, les chercheurs ont également démontré que GPT-4 est capable de coder à un très haut niveau, à la fois en termes d'écriture de code selon les instructions et de compréhension du code existant.

En termes d'écriture de code selon les instructions, les chercheurs ont démontré un exemple de laisser GPT-4 écrire des fonctions python.

Une fois le code généré, les chercheurs utilisent la plateforme d'entretiens en génie logiciel LeetCode pour juger en ligne si le code est correct.

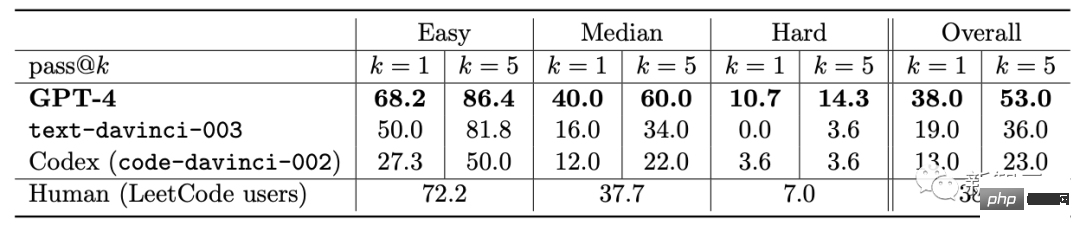

Tout le monde discute du fait que l'exactitude de LeetCode n'est que de 20 %. Yi Zhang, l'auteur de l'article, a réfuté cela.

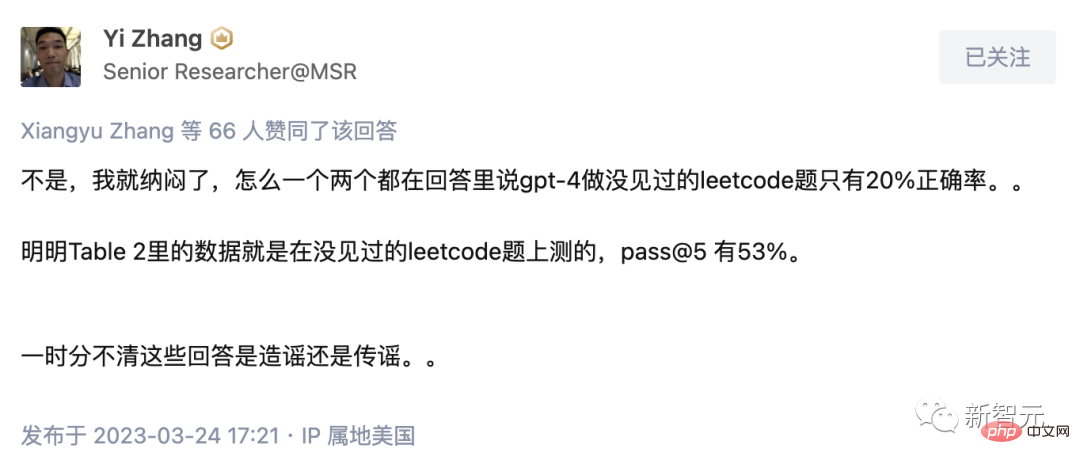

De plus, il a également été demandé à GPT-4 de visualiser les données de précision de LeetCode dans le tableau ci-dessus sous forme de graphique, et les résultats sont tels qu'indiqués dans la figure.

GPT-4 peut non seulement effectuer un travail de programmation ordinaire, mais également être compétent dans le développement de jeux 3D complexes.

Les chercheurs ont demandé à GPT-4 d'écrire un jeu 3D en HTML à l'aide de JavaScript. GPT-4 a généré un jeu répondant à toutes les exigences avec zéro échantillon.

En programmation d'apprentissage profond, GPT-4 nécessite non seulement des connaissances en mathématiques et en statistiques, mais nécessite également une familiarité avec des frameworks et des bibliothèques tels que PyTorch, TensorFlow et Keras.

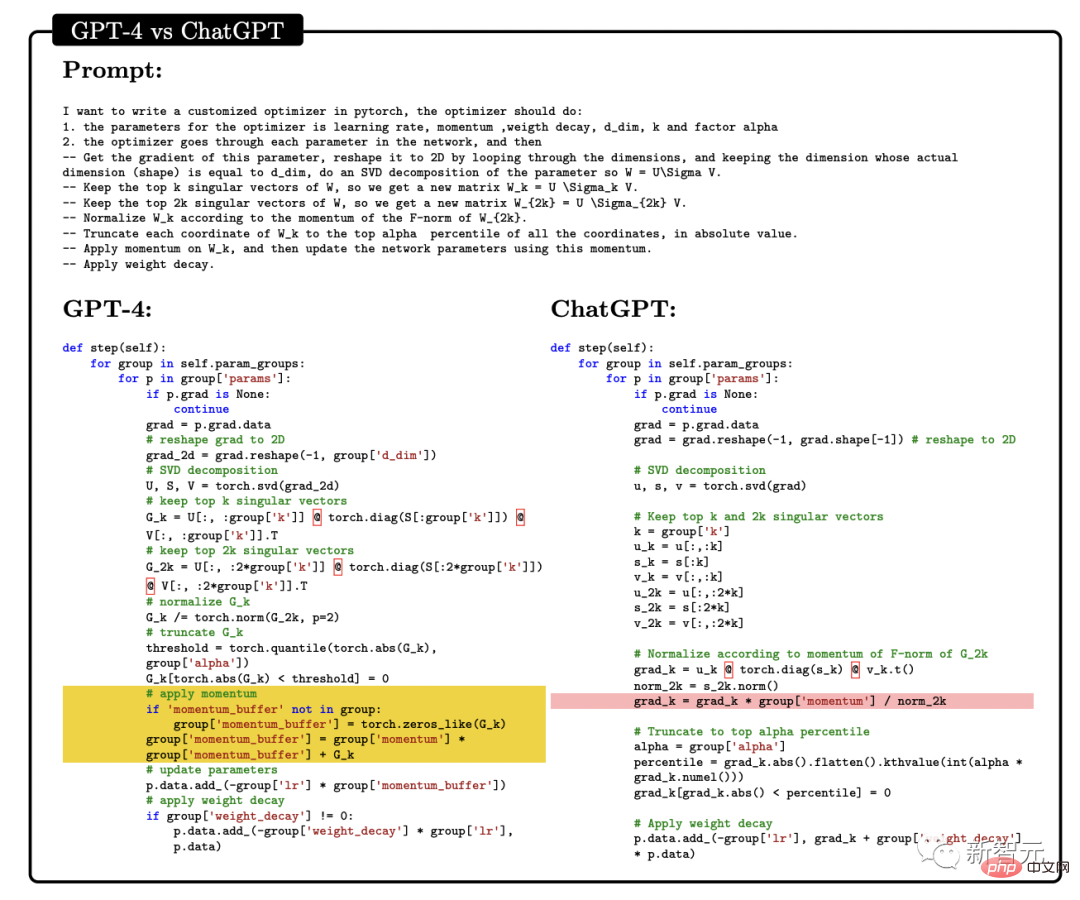

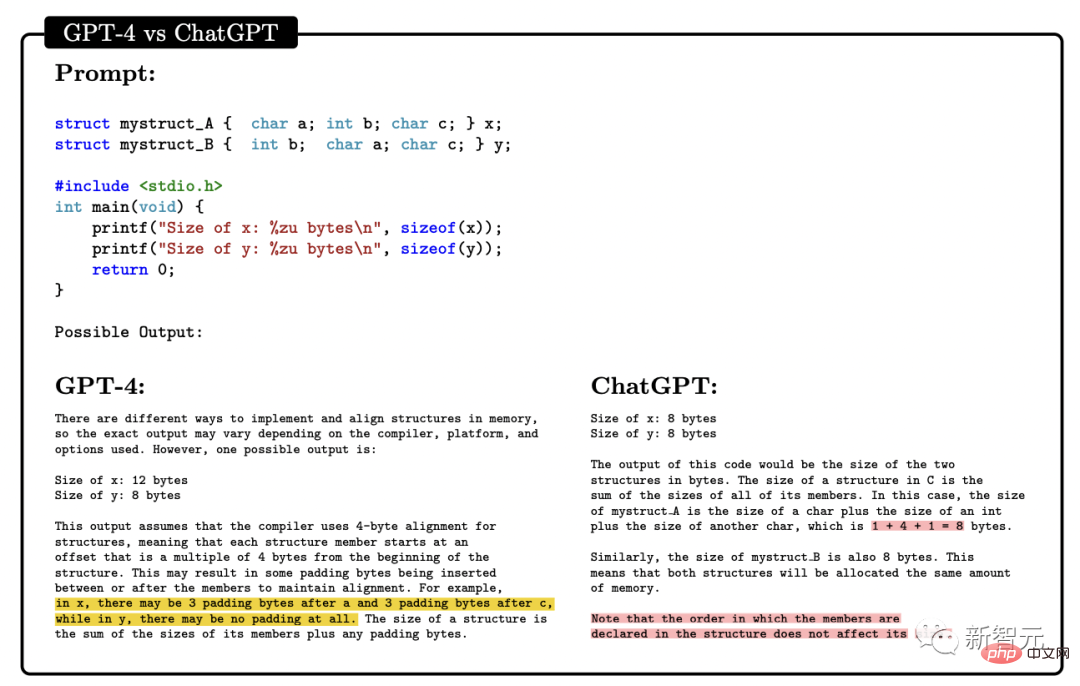

Les chercheurs ont demandé à GPT-4 et ChatGPT d'écrire un module d'optimisation personnalisé et de lui fournir une description en langage naturel, qui comprenait une série d'opérations importantes, telles que l'application de SVD et plus encore.

En plus d'écrire du code selon les instructions, GPT-4 fait preuve d'une super capacité à comprendre le code.

Les chercheurs ont essayé de laisser GPT-4 et ChatGPT comprendre un programme C/C++ et prédire le résultat du programme. Les performances des deux sont les suivantes :

La zone marquée en jaune est. GPT-4 Point perspicace, et les marques rouges représentent l'endroit où ChatGPT s'est trompé.

Grâce au test de capacité de codage, les chercheurs ont découvert que GPT-4 peut gérer diverses tâches de codage, des défis de codage aux applications pratiques, de l'assemblage de bas niveau aux frameworks de haut niveau, des structures de données simples aux programmes complexes.

De plus, GPT-4 peut raisonner sur l'exécution de code, simuler les effets des instructions et expliquer les résultats en langage naturel. GPT-4 peut même exécuter du pseudocode.

Capacité mathématique

En termes de capacité mathématique, par rapport aux grands modèles de langage précédents, GPT-4 a fait un saut qualitatif. Même face au Minerva spécialement réglé, les performances ont été considérablement améliorées.

Cependant, on est encore loin du niveau expert.

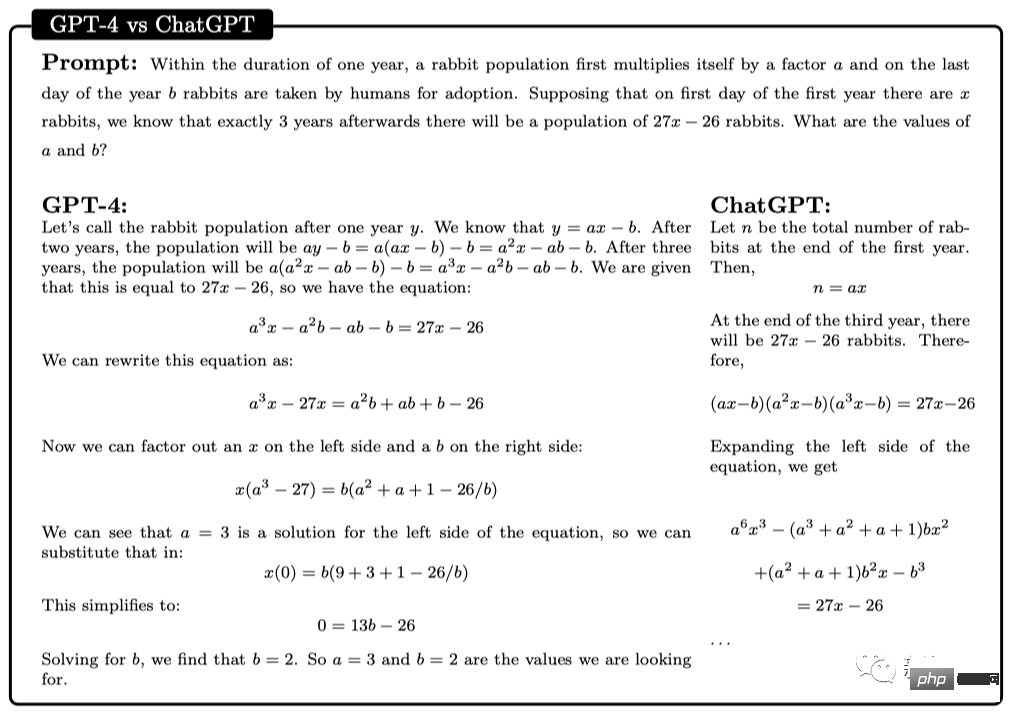

Par exemple : La population de lapins augmentera d'une fois chaque année, et le dernier jour de l'année, les lapins b seront adoptés par les humains. Supposons qu’il y ait x lapins le premier jour de la première année. On sait que le nombre de lapins deviendra 27x-26 après 3 ans. Alors, quelles sont les valeurs de a et b ?

Afin de résoudre ce problème, nous devons d'abord trouver l'expression correcte de l'évolution du nombre de lapins chaque année, puis dériver un système d'équations à travers cette relation récursive pour obtenir la réponse.

Ici, GPT-4 est parvenu à trouver la solution et a présenté un argument raisonnable. En revanche, ChatGPT n’a jamais été en mesure de donner un raisonnement et des réponses corrects lors de plusieurs tentatives indépendantes.

Mathématiques avancées

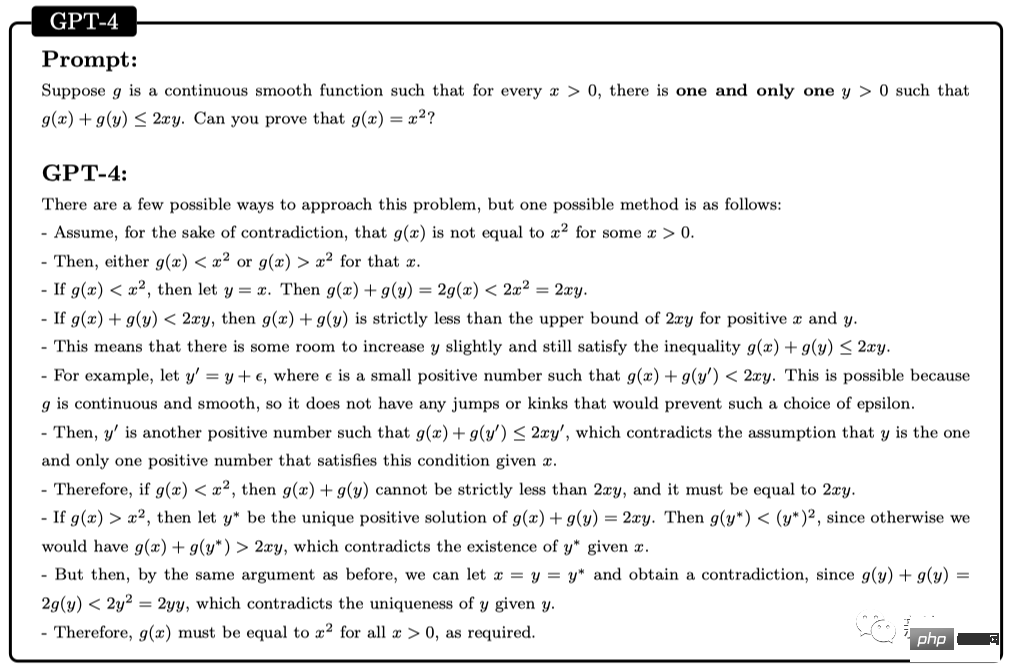

Ensuite, passons directement au plus difficile. Par exemple, la question suivante provient de l'Olympiade mathématique internationale (OMI) 2022 (version simplifiée).

Cette question diffère de l'examen de calcul de premier cycle en ce sens qu'elle ne suit pas un modèle structuré. Résoudre ce problème nécessite une approche plus créative, car il n’existe pas de stratégie claire pour commencer la preuve.

Par exemple, la décision de diviser l'argument en deux cas (g(x) > x^2 et g(x)

Malgré cela, GPT-4 a quand même donné une preuve correcte.

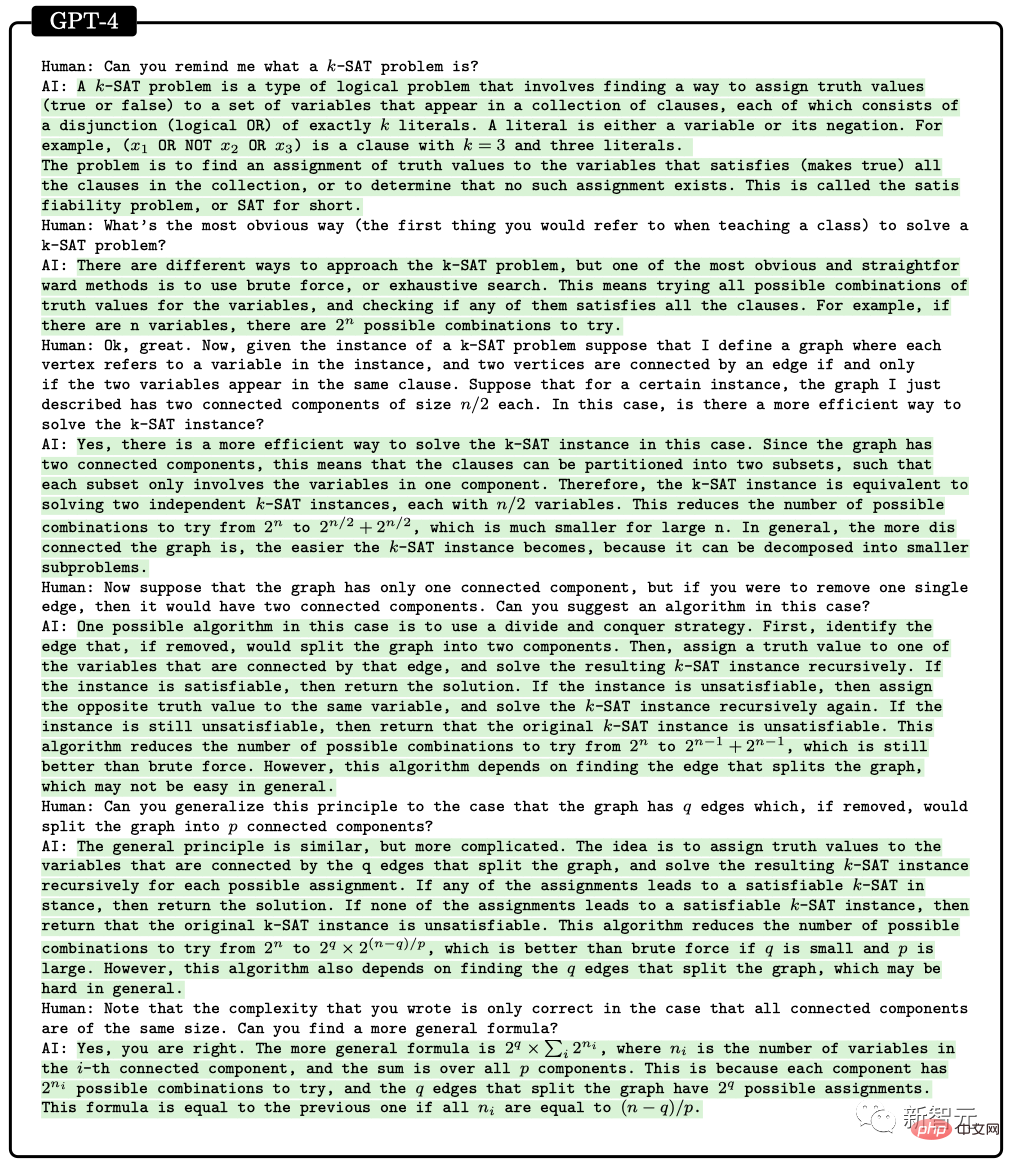

La deuxième discussion sur les algorithmes et la théorie des graphes est comparable à un entretien de niveau supérieur.

À cet égard, GPT-4 est capable de raisonner sur une construction de graphe abstrait liée au problème de satisfaction de contraintes et d'en tirer des conclusions correctes sur le problème SAT (à notre connaissance, cette construction est en la littérature mathématique n'est pas parue).

Cette conversation reflète la compréhension profonde de GPT-4 des concepts mathématiques de premier cycle abordés, ainsi qu'un degré considérable de créativité.

Bien que GPT-4 ait écrit 2^n/2 sous la forme 2^n-1 dans une réponse, cela ressemble plus à ce que nous appelons communément une « erreur matérielle » car il a fourni plus tard la généralisation correcte de la formule.

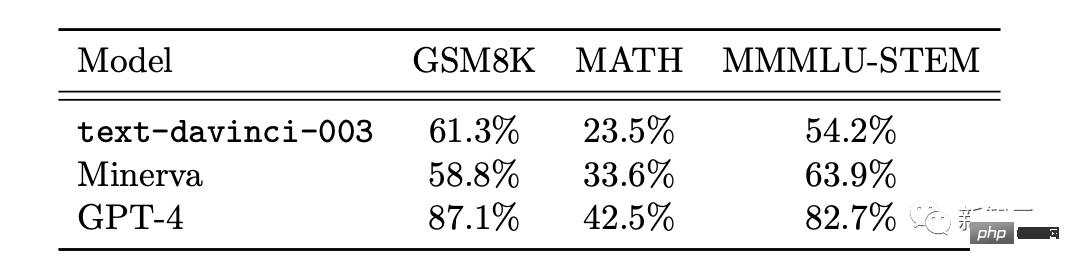

De plus, les chercheurs ont comparé les performances de GPT-4, ChatGPT et Minerva sur deux ensembles de données mathématiques couramment utilisés comme benchmarks : GSM8K et MATH.

Les résultats ont montré que GPT4 a surpassé Minerva sur chaque ensemble de données et que la précision dans les deux ensembles de tests dépassait 80 %.

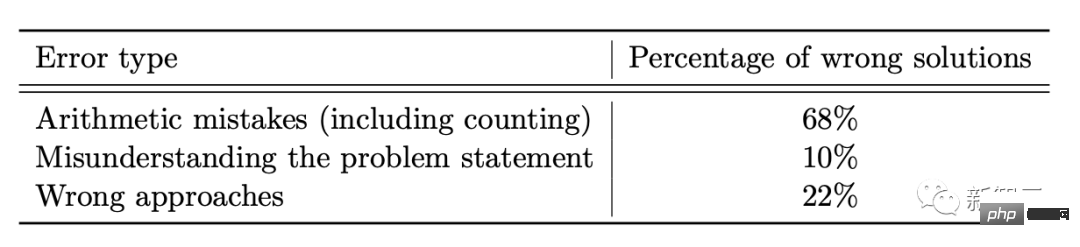

Examinons de plus près les raisons pour lesquelles GPT4 commet des erreurs. 68 % d'entre elles sont des erreurs de calcul, pas des erreurs de solution.

Interagir avec le monde

Une autre manifestation clé de l'intelligence est l'interactivité.

L'interactivité est importante pour l'intelligence car elle permet à un agent d'acquérir et d'appliquer des connaissances, de résoudre des problèmes, de s'adapter à des situations changeantes et d'atteindre des objectifs au-delà de ses propres capacités.

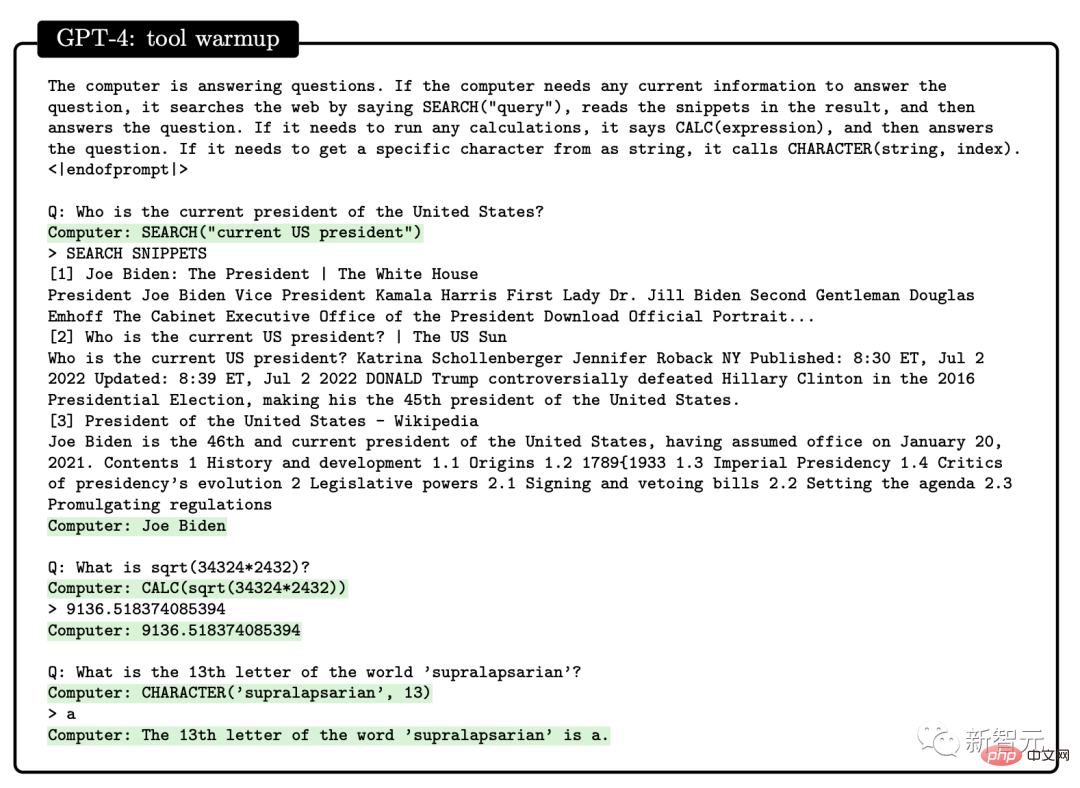

Ainsi, les chercheurs ont étudié l'interactivité de GPT-4 sous deux dimensions : l'utilisation de l'outil et l'interaction spécifique. GPT-4 peut rechercher des outils externes tels que des moteurs ou des API pour répondre à des questions telles que celles-ci.

Interagir avec les humains

Dans l'article, les chercheurs ont découvert que GPT-4 peut construire des modèles mentaux humains.

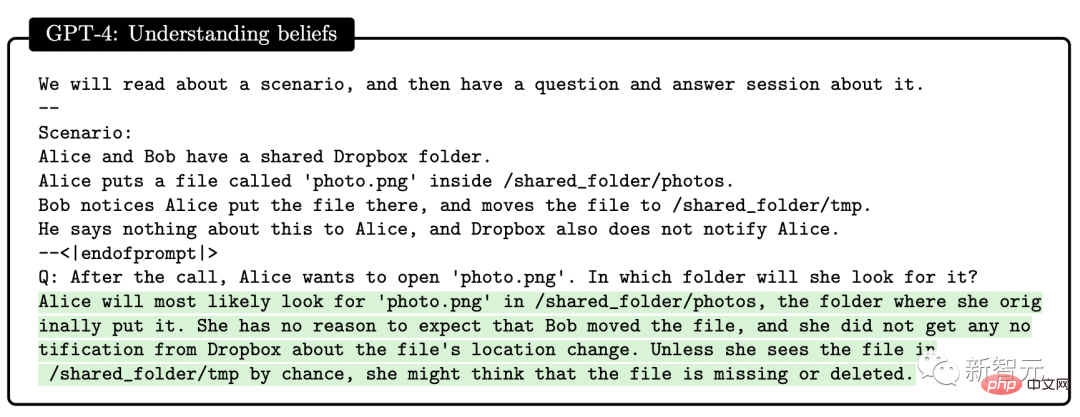

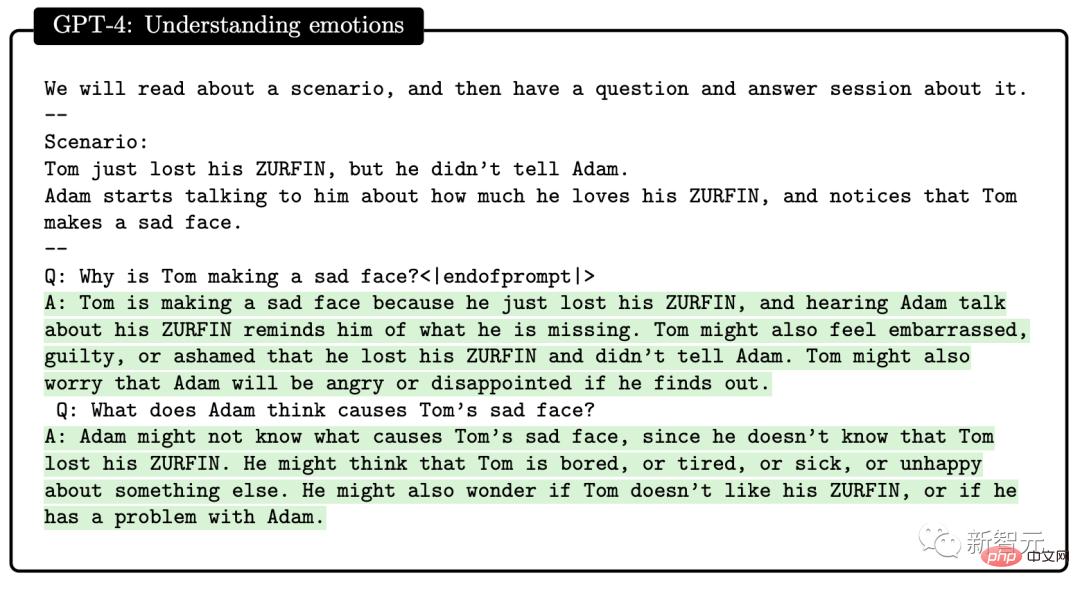

L'étude a conçu une série de tests pour évaluer les capacités de théorie de l'esprit de GPT-4, ChatGPT et text-davinci-003. Par exemple, pour comprendre la croyance, GPT-4 a réussi le test de fausse croyance de Sally-Anne en psychologie.

Teste également les performances de la capacité de GPT-4 à déduire l'état émotionnel des autres dans des situations complexes :

-Pourquoi Tom fait-il une expression triste ? - Selon Adam, qu'est-ce qui cause l'expression triste de Tom ?

Grâce à plusieurs séries de tests, les chercheurs ont découvert que lorsqu'il s'agit de déduire l'état mental des autres et de proposer des solutions cohérentes avec des scénarios sociaux réels, GPT-4 fonctionne mieux que ChatGPT et le texte. -davinci-003.

Limitations

Le modèle « prédire le mot suivant » utilisé par GPT-4 a des limites évidentes : le modèle manque de planification, de mémoire de travail, de capacités de retour en arrière et de capacités de raisonnement.

Étant donné que le modèle repose sur un processus gourmand local de génération du mot suivant sans générer une compréhension approfondie du contexte global de la tâche ou du résultat. Par conséquent, GPT-4 est efficace pour générer un texte fluide et cohérent, mais pas pour résoudre des problèmes complexes ou créatifs qui ne peuvent pas être traités de manière séquentielle.

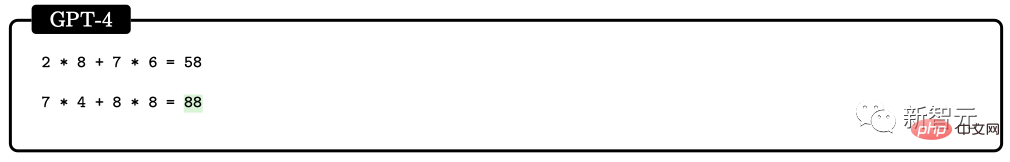

Par exemple, utilisez quatre nombres aléatoires entre 0 et 9 pour effectuer des opérations de multiplication et d'addition. Sur ce problème que même les élèves du primaire peuvent résoudre, la précision de GPT-4 n’est que de 58 %.

Lorsque les nombres sont compris entre 10 et 19, et entre 20 et 39, la précision tombe respectivement à 16 % et 12 %. Lorsque le nombre est compris entre 99 et 199, la précision tombe directement à 0.

Cependant, si vous laissez GPT-4 "prendre le temps" de répondre aux questions, la précision peut facilement être améliorée. Par exemple, il est demandé au modèle d'écrire les étapes intermédiaires à l'aide des invites suivantes :

116 * 114 + 178 * 157 = ?

Réfléchissons étape par étape et notons toutes les étapes intermédiaires avant de générer la solution finale.

À l'heure actuelle, lorsque le nombre est compris entre 1 et 40, le taux de précision atteint 100 %, et lorsqu'il est compris entre 1 et 200, il atteint également 90 %.

Marcus a publié une réfutation

Fait intéressant, peu de temps après la publication de l'article de Microsoft, Marcus a immédiatement écrit un blog, qualifiant le point de vue de Microsoft de "très ridicule".

Et a cité une phrase de la Bible "L'orgueil précède la destruction, et un esprit hautain avant la chute. (Proverbes 16 :18)"

Comment GPT-4 peut-il compter ? AGI précoce ? De cette façon, la calculatrice compte aussi, et Eliza et Siri comptent encore plus. Cette définition est très vague et il est facile d’en profiter.

De l'avis de Marcus, GPT-4 n'a rien à voir avec l'AGI, et GPT-4 est le même qu'avant, les lacunes ne sont toujours pas résolues, l'illusion existe toujours, le manque de fiabilité des réponses n'a pas été résolu, même l'auteur lui-même. Ils admettent tous que leur capacité à planifier des tâches complexes n'est toujours pas suffisante.

Ce qui l'inquiète, ce sont les deux articles rédigés par OpenAI et Microsoft. Les modèles qu'ils ont rédigés n'ont pas été divulgués du tout, et ils ne se sont appuyés sur aucun ensemble de formation ni architecture. caractère scientifique.

Donc "une certaine forme d'AGI" revendiquée dans l'article n'existe pas, et la communauté scientifique ne peut pas du tout la vérifier, car les données d'entraînement ne peuvent pas être obtenues, et il semble que les données d'entraînement aient été contaminées. .

Ce qui est pire, c'est qu'OpenAI a commencé à intégrer des expériences utilisateur dans le corpus de formation lui-même. En confondant ainsi la situation, la communauté scientifique ne peut pas juger une capacité clé du GPT-4 : si le modèle a la capacité de généraliser de nouveaux cas de test.

Si OpenAI ne se mettait pas ici un chapeau scientifique, Marcus ne serait peut-être pas aussi critique à son égard.

Il a admis que GPT-4 est très puissant, mais que les risques sont également bien connus. Si OpenAI manque de transparence et refuse de rendre publics ses modèles, autant la fermer.

Une solide gamme d'auteurs

Microsoft dispose d'une solide gamme d'auteurs derrière cet article de 154 pages.

Dont : Sébastien Bubeck, chercheur principal à Microsoft Research Redmond et lauréat du Sloan Prize 2015, Ronen Eldan, lauréat du New Horizons Mathematics Prize 2023, Yin Tat Lee, lauréat du Sloan Research Prize 2020, Jin Li Yuanzhi, lauréat du prix de recherche Sloan.

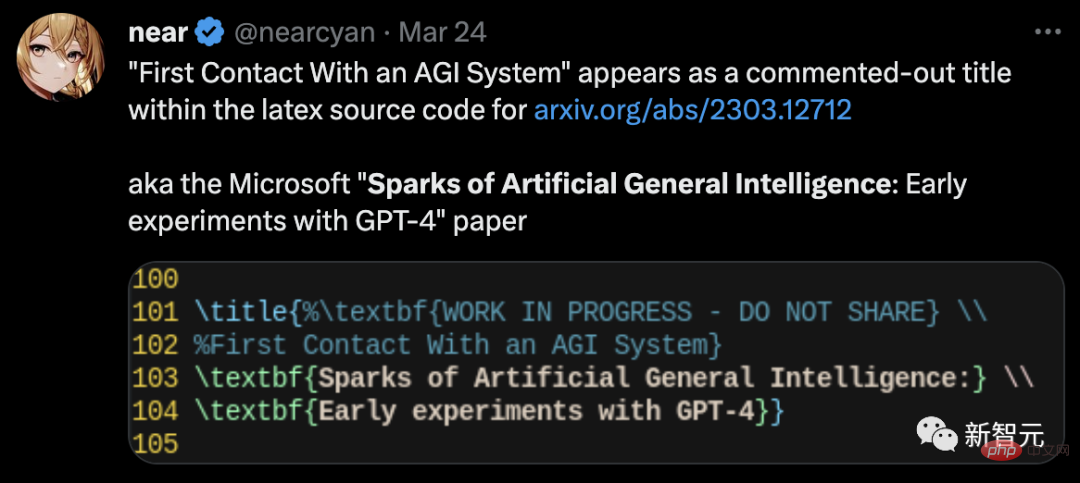

Il convient de mentionner que le titre original de l'article défini par l'équipe Microsoft n'était pas « L'étincelle de l'intelligence artificielle générale : premières expériences avec GPT-4 ».

Le code latex divulgué dans le papier non coupé montre que le titre original était "Premier contact avec AGI".

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Bytedance Cutting lance le super abonnement SVIP : 499 yuans pour un abonnement annuel continu, offrant une variété de fonctions d'IA

Jun 28, 2024 am 03:51 AM

Bytedance Cutting lance le super abonnement SVIP : 499 yuans pour un abonnement annuel continu, offrant une variété de fonctions d'IA

Jun 28, 2024 am 03:51 AM

Ce site a rapporté le 27 juin que Jianying est un logiciel de montage vidéo développé par FaceMeng Technology, une filiale de ByteDance. Il s'appuie sur la plateforme Douyin et produit essentiellement du contenu vidéo court pour les utilisateurs de la plateforme. Il est compatible avec iOS, Android et. Windows, MacOS et autres systèmes d'exploitation. Jianying a officiellement annoncé la mise à niveau de son système d'adhésion et a lancé un nouveau SVIP, qui comprend une variété de technologies noires d'IA, telles que la traduction intelligente, la mise en évidence intelligente, l'emballage intelligent, la synthèse humaine numérique, etc. En termes de prix, les frais mensuels pour le clipping SVIP sont de 79 yuans, les frais annuels sont de 599 yuans (attention sur ce site : équivalent à 49,9 yuans par mois), l'abonnement mensuel continu est de 59 yuans par mois et l'abonnement annuel continu est de 59 yuans par mois. est de 499 yuans par an (équivalent à 41,6 yuans par mois) . En outre, le responsable de Cut a également déclaré que afin d'améliorer l'expérience utilisateur, ceux qui se sont abonnés au VIP d'origine

Assistant de codage d'IA augmenté par le contexte utilisant Rag et Sem-Rag

Jun 10, 2024 am 11:08 AM

Assistant de codage d'IA augmenté par le contexte utilisant Rag et Sem-Rag

Jun 10, 2024 am 11:08 AM

Améliorez la productivité, l’efficacité et la précision des développeurs en intégrant une génération et une mémoire sémantique améliorées par la récupération dans les assistants de codage IA. Traduit de EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG, auteur JanakiramMSV. Bien que les assistants de programmation d'IA de base soient naturellement utiles, ils ne parviennent souvent pas à fournir les suggestions de code les plus pertinentes et les plus correctes, car ils s'appuient sur une compréhension générale du langage logiciel et des modèles d'écriture de logiciels les plus courants. Le code généré par ces assistants de codage est adapté à la résolution des problèmes qu’ils sont chargés de résoudre, mais n’est souvent pas conforme aux normes, conventions et styles de codage des équipes individuelles. Cela aboutit souvent à des suggestions qui doivent être modifiées ou affinées pour que le code soit accepté dans l'application.

Le réglage fin peut-il vraiment permettre au LLM d'apprendre de nouvelles choses : l'introduction de nouvelles connaissances peut amener le modèle à produire davantage d'hallucinations

Jun 11, 2024 pm 03:57 PM

Le réglage fin peut-il vraiment permettre au LLM d'apprendre de nouvelles choses : l'introduction de nouvelles connaissances peut amener le modèle à produire davantage d'hallucinations

Jun 11, 2024 pm 03:57 PM

Les grands modèles linguistiques (LLM) sont formés sur d'énormes bases de données textuelles, où ils acquièrent de grandes quantités de connaissances du monde réel. Ces connaissances sont intégrées à leurs paramètres et peuvent ensuite être utilisées en cas de besoin. La connaissance de ces modèles est « réifiée » en fin de formation. À la fin de la pré-formation, le modèle arrête effectivement d’apprendre. Alignez ou affinez le modèle pour apprendre à exploiter ces connaissances et répondre plus naturellement aux questions des utilisateurs. Mais parfois, la connaissance du modèle ne suffit pas, et bien que le modèle puisse accéder à du contenu externe via RAG, il est considéré comme bénéfique de l'adapter à de nouveaux domaines grâce à un réglage fin. Ce réglage fin est effectué à l'aide de la contribution d'annotateurs humains ou d'autres créations LLM, où le modèle rencontre des connaissances supplémentaires du monde réel et les intègre.

Sept questions d'entretien technique Cool GenAI et LLM

Jun 07, 2024 am 10:06 AM

Sept questions d'entretien technique Cool GenAI et LLM

Jun 07, 2024 am 10:06 AM

Pour en savoir plus sur l'AIGC, veuillez visiter : 51CTOAI.x Community https://www.51cto.com/aigc/Translator|Jingyan Reviewer|Chonglou est différent de la banque de questions traditionnelle que l'on peut voir partout sur Internet. nécessite de sortir des sentiers battus. Les grands modèles linguistiques (LLM) sont de plus en plus importants dans les domaines de la science des données, de l'intelligence artificielle générative (GenAI) et de l'intelligence artificielle. Ces algorithmes complexes améliorent les compétences humaines et stimulent l’efficacité et l’innovation dans de nombreux secteurs, devenant ainsi la clé permettant aux entreprises de rester compétitives. LLM a un large éventail d'applications. Il peut être utilisé dans des domaines tels que le traitement du langage naturel, la génération de texte, la reconnaissance vocale et les systèmes de recommandation. En apprenant de grandes quantités de données, LLM est capable de générer du texte

Cinq écoles d'apprentissage automatique que vous ne connaissez pas

Jun 05, 2024 pm 08:51 PM

Cinq écoles d'apprentissage automatique que vous ne connaissez pas

Jun 05, 2024 pm 08:51 PM

L'apprentissage automatique est une branche importante de l'intelligence artificielle qui donne aux ordinateurs la possibilité d'apprendre à partir de données et d'améliorer leurs capacités sans être explicitement programmés. L'apprentissage automatique a un large éventail d'applications dans divers domaines, de la reconnaissance d'images et du traitement du langage naturel aux systèmes de recommandation et à la détection des fraudes, et il change notre façon de vivre. Il existe de nombreuses méthodes et théories différentes dans le domaine de l'apprentissage automatique, parmi lesquelles les cinq méthodes les plus influentes sont appelées les « Cinq écoles d'apprentissage automatique ». Les cinq grandes écoles sont l’école symbolique, l’école connexionniste, l’école évolutionniste, l’école bayésienne et l’école analogique. 1. Le symbolisme, également connu sous le nom de symbolisme, met l'accent sur l'utilisation de symboles pour le raisonnement logique et l'expression des connaissances. Cette école de pensée estime que l'apprentissage est un processus de déduction inversée, à travers les connaissances existantes.

Afin de fournir un nouveau système de référence et d'évaluation de questions-réponses scientifiques et complexes pour les grands modèles, l'UNSW, Argonne, l'Université de Chicago et d'autres institutions ont lancé conjointement le cadre SciQAG.

Jul 25, 2024 am 06:42 AM

Afin de fournir un nouveau système de référence et d'évaluation de questions-réponses scientifiques et complexes pour les grands modèles, l'UNSW, Argonne, l'Université de Chicago et d'autres institutions ont lancé conjointement le cadre SciQAG.

Jul 25, 2024 am 06:42 AM

L'ensemble de données ScienceAI Question Answering (QA) joue un rôle essentiel dans la promotion de la recherche sur le traitement du langage naturel (NLP). Des ensembles de données d'assurance qualité de haute qualité peuvent non seulement être utilisés pour affiner les modèles, mais également évaluer efficacement les capacités des grands modèles linguistiques (LLM), en particulier la capacité à comprendre et à raisonner sur les connaissances scientifiques. Bien qu’il existe actuellement de nombreux ensembles de données scientifiques d’assurance qualité couvrant la médecine, la chimie, la biologie et d’autres domaines, ces ensembles de données présentent encore certaines lacunes. Premièrement, le formulaire de données est relativement simple, et la plupart sont des questions à choix multiples. Elles sont faciles à évaluer, mais limitent la plage de sélection des réponses du modèle et ne peuvent pas tester pleinement la capacité du modèle à répondre aux questions scientifiques. En revanche, les questions et réponses ouvertes

Les performances de SOTA, la méthode d'IA de prédiction d'affinité protéine-ligand multimodale de Xiamen, combinent pour la première fois des informations sur la surface moléculaire

Jul 17, 2024 pm 06:37 PM

Les performances de SOTA, la méthode d'IA de prédiction d'affinité protéine-ligand multimodale de Xiamen, combinent pour la première fois des informations sur la surface moléculaire

Jul 17, 2024 pm 06:37 PM

Editeur | KX Dans le domaine de la recherche et du développement de médicaments, il est crucial de prédire avec précision et efficacité l'affinité de liaison des protéines et des ligands pour le criblage et l'optimisation des médicaments. Cependant, les études actuelles ne prennent pas en compte le rôle important des informations sur la surface moléculaire dans les interactions protéine-ligand. Sur cette base, des chercheurs de l'Université de Xiamen ont proposé un nouveau cadre d'extraction de caractéristiques multimodales (MFE), qui combine pour la première fois des informations sur la surface des protéines, la structure et la séquence 3D, et utilise un mécanisme d'attention croisée pour comparer différentes modalités. alignement. Les résultats expérimentaux démontrent que cette méthode atteint des performances de pointe dans la prédiction des affinités de liaison protéine-ligand. De plus, les études d’ablation démontrent l’efficacité et la nécessité des informations sur la surface des protéines et de l’alignement des caractéristiques multimodales dans ce cadre. Les recherches connexes commencent par "S

SK Hynix présentera de nouveaux produits liés à l'IA le 6 août : HBM3E à 12 couches, NAND à 321 hauteurs, etc.

Aug 01, 2024 pm 09:40 PM

SK Hynix présentera de nouveaux produits liés à l'IA le 6 août : HBM3E à 12 couches, NAND à 321 hauteurs, etc.

Aug 01, 2024 pm 09:40 PM

Selon les informations de ce site le 1er août, SK Hynix a publié un article de blog aujourd'hui (1er août), annonçant sa participation au Global Semiconductor Memory Summit FMS2024 qui se tiendra à Santa Clara, Californie, États-Unis, du 6 au 8 août, présentant de nombreuses nouvelles technologies de produit. Introduction au Future Memory and Storage Summit (FutureMemoryandStorage), anciennement Flash Memory Summit (FlashMemorySummit) principalement destiné aux fournisseurs de NAND, dans le contexte de l'attention croissante portée à la technologie de l'intelligence artificielle, cette année a été rebaptisée Future Memory and Storage Summit (FutureMemoryandStorage) pour invitez les fournisseurs de DRAM et de stockage et bien d’autres joueurs. Nouveau produit SK hynix lancé l'année dernière