Périphériques technologiques

Périphériques technologiques

IA

IA

Tâches courantes ! Tsinghua propose le réseau fédérateur Flowformer pour atteindre une complexité linéaire ICML2022

Tâches courantes ! Tsinghua propose le réseau fédérateur Flowformer pour atteindre une complexité linéaire ICML2022

Tâches courantes ! Tsinghua propose le réseau fédérateur Flowformer pour atteindre une complexité linéaire ICML2022

L'universalité des tâches est l'un des objectifs fondamentaux de la recherche sur les modèles fondamentaux, et c'est également le seul moyen pour la recherche sur l'apprentissage profond de conduire à une intelligence avancée. Ces dernières années, grâce aux capacités de modélisation de clés universelles du mécanisme d'attention, Transformer a obtenu de bons résultats dans de nombreux domaines et a progressivement montré une tendance à l'architecture universelle. Cependant, à mesure que la longueur de la séquence augmente, le calcul du mécanisme d’attention standard présente une complexité quadratique, ce qui entrave sérieusement son application dans la modélisation de séquences longues et les grands modèles.

À cette fin, une équipe de l'École de logiciel de l'Université Tsinghua a exploré en profondeur cette question clé et a proposé un réseau fédérateur à complexité linéaire universelle, Flowformer, qui réduit sa complexité au transformateur standard tout en conservant la polyvalence linéaire. le document a été accepté par l'ICML 2022.

Liste des auteurs: Wu Haixu, Wu Jialong, Xu Jiehui, Wang Jianmin, Long Mingsheng

link: https://arxiv.org/pdf/2202.06258.pdf

Code : https://github.com/thuml/Flowformer

Par rapport au Transformer standard, le modèle Flowformer proposé dans cet article présente les caractéristiques suivantes :

- Complexité linéaire, et peut gérer des entrées de milliers de longueurs Séquence ;

- n'introduit pas de nouvelles préférences d'induction et maintient la capacité de modélisation universelle du mécanisme d'attention d'origine

- Tâche universelle, dans séquences longues, vision, naturel ; langage, séries chronologiques, apprentissage par renforcementobtient d'excellents résultats sur cinq tâches principales.

1. Analyse du problème

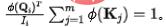

L'entrée du mécanisme d'attention standard contient trois parties : requêtes(), clés() et valeurs(), et sa méthode de calcul est la suivante : où est la matrice de poids d'attention et la valeur finale le résultat du calcul est obtenu à partir d'une fusion pondérée, la complexité informatique du processus ci-dessus est. Il est à noter qu'il existe de nombreuses études sur le problème de la multiplication continue de matrices multinomiales dans les algorithmes classiques. En particulier, pour le mécanisme d'attention, nous pouvons utiliser la loi associative de multiplication matricielle pour réaliser une optimisation, par exemple, la complexité quadratique originale peut être réduite à linéaire. Mais la fonction dans le mécanisme d’attention rend impossible l’application directe de la loi associative. Par conséquent, la manière de supprimer des fonctions dans le mécanisme d’attention est la clé pour atteindre une complexité linéaire. Cependant, de nombreux travaux récents ont démontré que les fonctions jouent un rôle clé pour éviter un apprentissage attentionnel trivial. En résumé, nous attendons avec impatience une solution de conception de modèle qui atteint les objectifs suivants : (1) supprimer des fonctions ; (2) éviter une attention triviale (3) maintenir la polyvalence du modèle ;

2. Motivation

Visant l'objectif (1), dans des travaux antérieurs, la méthode du noyau est souvent utilisée pour remplacer la fonction, c'est-à-dire calculée par attention approximative (qui est une fonction non linéaire), mais en la supprimant directement suscitera une attention triviale. À cette fin, pour l'objectif (2), les travaux antérieurs ont dû introduire certaines préférences inductives, ce qui a limité la polyvalence du modèle et n'a donc pas atteint l'objectif (3), comme l'hypothèse de localité dans cosFormer.

Mécanisme de compétition dans Softmax

Afin d'atteindre les objectifs ci-dessus, nous partons des propriétés de base de l'analyse. Nous notons qu'il a été initialement proposé d'étendre l'opération maximale « le gagnant remporte tout » sous une forme différentiable. Par conséquent, Grâce à son mécanisme de « compétition » inhérent, il peut différencier les poids d'attention entre les jetons, évitant ainsi les problèmes d'attention ordinaires. Sur la base des considérations ci-dessus, nous essayons d'introduire le mécanisme de compétition dans la conception du mécanisme d'attention pour éviter les problèmes d'attention triviaux causés par la décomposition des méthodes du noyau.

Mécanisme de compétition dans le flux de réseau

Nous prêtons attention au modèle classique de flux de réseau (Flow network) dans la théorie des graphes, "Conservation" (Conservation) est un phénomène important, c'est-à-dire que l'afflux de chaque nœud est égal à la sortie. Inspiré par "Dans le cas de ressources fixes, la concurrence se produira inévitablement", dans cet article, nous essayons de réanalyser le flux d'informations dans le mécanisme d'attention classique du point de vue du flux de réseau, et d'introduire la concurrence dans le mécanisme d'attention grâce à des propriétés de conservationConception, pour éviter les problèmes d'attention banals.

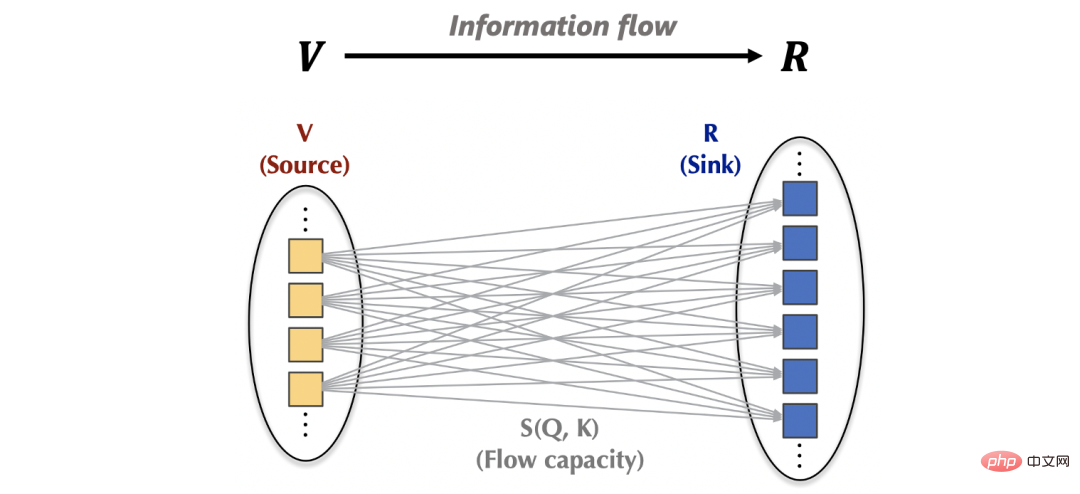

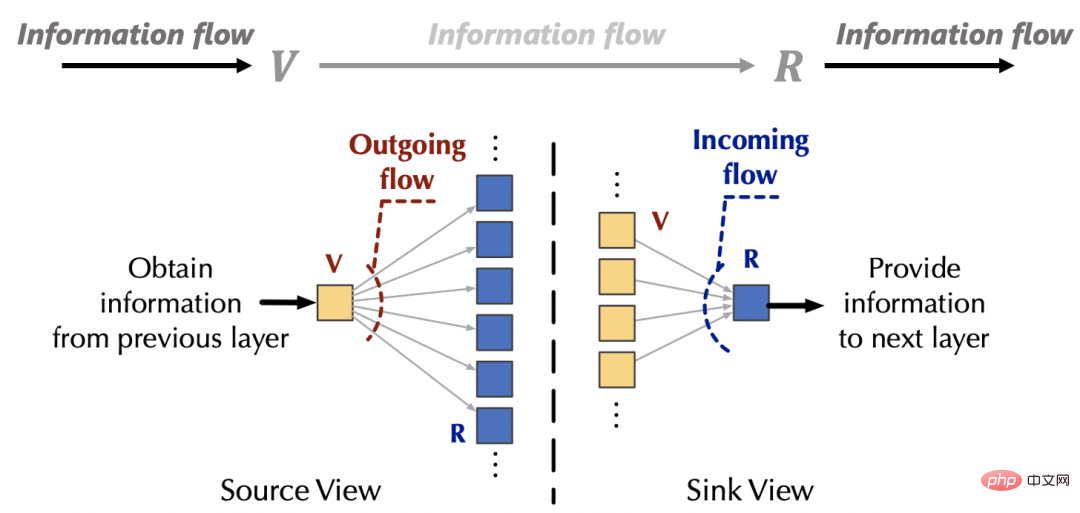

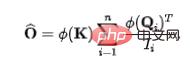

3. Flowformer3.1 Mécanisme d'attention du point de vue du flux du réseauÀ l'intérieur du mécanisme d'attention : le flux d'informations peut être exprimé comme : depuis source (source, correspondant) en fonction de la capacité de flux apprise (capacité de débit, correspondant au poids d'attention) converge vers évier (évier, correspondant).

En dehors du mécanisme d'attention, les informations de la source (v) proviennent de la couche supérieure du réseau, et les informations du récepteur (R) seront également fournies à la couche de rétroaction située en dessous.

3.2 Flux-Attention

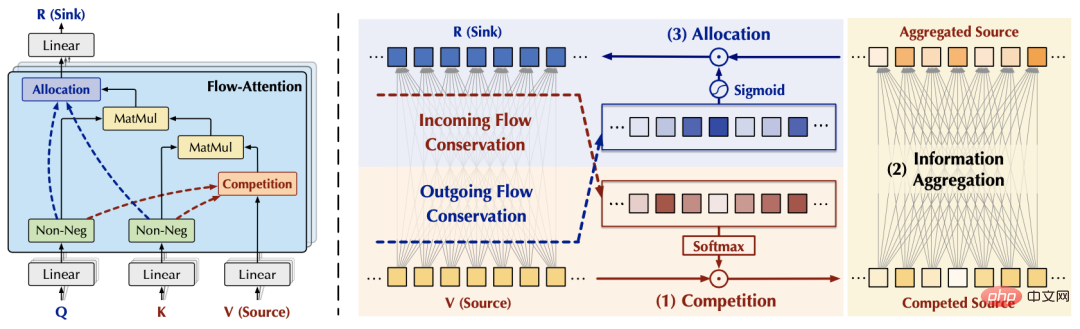

Sur la base des observations ci-dessus, nous pouvons réaliser des « ressources fixes » en contrôlant l'interaction entre le mécanisme d'attention et le réseau externe sous deux angles : l'entrée et la sortie. provoque une concurrence au sein des sources et des puits, respectivement, pour éviter une attention triviale. Sans perte de généralité, nous fixons la quantité d'informations d'interaction entre le mécanisme d'attention et le réseau externe à la valeur par défaut de 1.

(1) La conservation du flux entrant du puits (R) :

n'est pas difficile à obtenir, avant conservation, pour le ème évier, la quantité d'informations qui arrive est de :  . Afin de fixer la quantité d'informations circulant dans chaque puits à l'unité 1, nous introduisons

. Afin de fixer la quantité d'informations circulant dans chaque puits à l'unité 1, nous introduisons  comme normalisation dans le calcul du flux d'informations (poids d'attention). Après normalisation, la quantité d'informations entrantes du ème puits est :

comme normalisation dans le calcul du flux d'informations (poids d'attention). Après normalisation, la quantité d'informations entrantes du ème puits est :

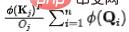

A ce moment, en raison de la conservation du flux entrant du puits, il existe une relation de compétition naturelle entre les différentes sources (V). chaque source à ce moment ( La quantité d'informations fournies par V) peut être obtenue : la quantité d'informations fournies par chaque source dans des conditions concurrentielles, qui représente également l'importance de chaque source.

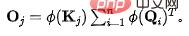

(2) Conservation du flux sortant de la source (V) : Similaire au processus susmentionné, avant conservation, pour la ème source, la quantité d'informations sortant est :  . Afin de fixer la quantité d'informations sortant de chaque source vers l'unité 1, nous présenterons le calcul du flux d'informations (poids d'attention) comme normalisation. Après normalisation, la quantité d'informations de sortie de la jème source est :

. Afin de fixer la quantité d'informations sortant de chaque source vers l'unité 1, nous présenterons le calcul du flux d'informations (poids d'attention) comme normalisation. Après normalisation, la quantité d'informations de sortie de la jème source est :  . À l'heure actuelle, en raison de la conservation des flux sortants de la source, il existe une relation de compétition naturelle entre les puits () Nous calculons la quantité d'informations reçues par chaque puits () à ce moment-là, et nous pouvons obtenir : Dans le cas. de compétition, le résultat final requis pour chaque résultat est la quantité d'informations reçues.

. À l'heure actuelle, en raison de la conservation des flux sortants de la source, il existe une relation de compétition naturelle entre les puits () Nous calculons la quantité d'informations reçues par chaque puits () à ce moment-là, et nous pouvons obtenir : Dans le cas. de compétition, le résultat final requis pour chaque résultat est la quantité d'informations reçues.

(3) Conception globale

Sur la base des résultats ci-dessus, nous concevons le mécanisme Flux-Attention suivant, qui comprend spécifiquement trois parties : Concurrence, Agrégation et Allocation : La concurrence sera en concurrence Lorsque le mécanisme est introduite, les informations importantes sont mises en évidence ; l'agrégation est basée sur la loi associative matricielle pour atteindre une complexité linéaire ; l'allocation contrôle la quantité d'informations transmises à la couche suivante en introduisant un mécanisme de concurrence. Toutes les opérations du processus ci-dessus ont une complexité linéaire. Dans le même temps, la conception de Flow-Attention repose uniquement sur le principe de conservation dans le flux réseau et réintègre le flux d'information. Elle n'introduit donc pas de nouvelles préférences inductives, garantissant la polyvalence du modèle. Flowformer est obtenu en remplaçant la complexité quadratique Attention dans le Transformer standard par Flow-Attention.

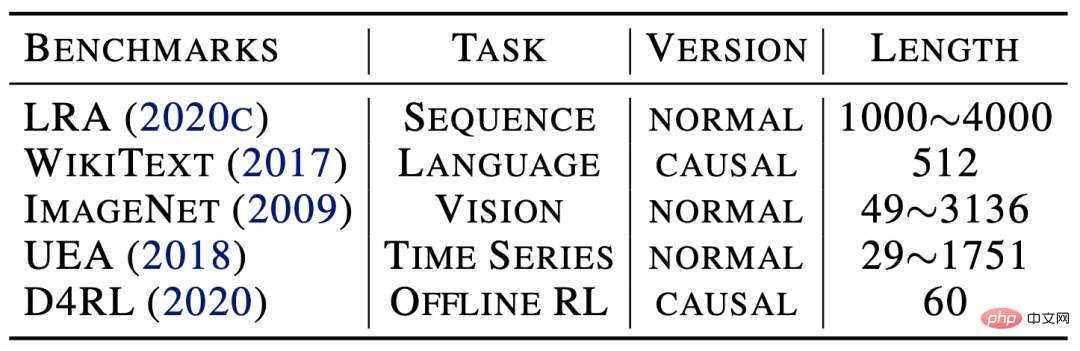

4. ExpériencesCet article a mené des expériences approfondies sur des ensembles de données standard :

- a couvert les cinq tâches principales de la séquence longue, de la vision, du langage naturel, des séries temporelles et de l'apprentissage par renforcement ; Il existe deux types de mécanismes d'attention : les tâches normales et autorégressives (causales).

- Couvre les situations de saisie de différentes longueurs de séquence (20-4000).

- Compare diverses méthodes de base telles que les modèles classiques dans divers domaines, les modèles profonds traditionnels, Transformer et ses variantes.

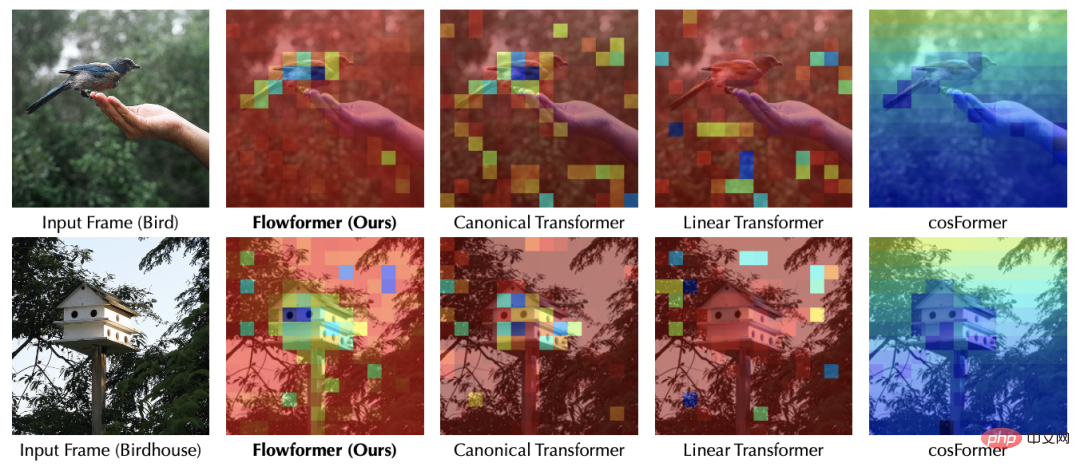

Afin d'expliquer davantage le principe de fonctionnement de Flowformer, nous avons mené une expérience visuelle sur l'attention dans la tâche de classification ImageNet (correspondant à Flow-Attention), à partir de laquelle nous pouvons retrouver : La visualisation ci-dessus montre que l'introduction de la concurrence dans la conception du mécanisme d'attention via Flow-Attention peut efficacement éviter une attention triviale. D’autres expériences de visualisation peuvent être trouvées dans l’article. Le Flowformer proposé dans cet article introduit le principe de conservation dans le flux de réseau dans la conception et introduit naturellement le mécanisme de compétition dans le calcul de l'attention, évitant ainsi le problème d'attention trivial et atteignant une complexité linéaire. en même temps, la polyvalence du transformateur standard est conservée. Flowformer a obtenu d'excellents résultats sur cinq tâches majeures : les séquences longues, la vision, le langage naturel, les séries temporelles et l'apprentissage par renforcement. En outre, le concept de conception « aucune préférence d'induction particulière » dans Flowformer est également une source d'inspiration pour la recherche sur l'infrastructure générale. Dans les travaux futurs, nous explorerons davantage le potentiel de Flowformer pour la pré-formation à grande échelle. 5. Analyse

6. Résumé

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Le modèle MoE open source le plus puissant au monde est ici, avec des capacités chinoises comparables à celles du GPT-4, et le prix ne représente que près d'un pour cent de celui du GPT-4-Turbo.

May 07, 2024 pm 04:13 PM

Le modèle MoE open source le plus puissant au monde est ici, avec des capacités chinoises comparables à celles du GPT-4, et le prix ne représente que près d'un pour cent de celui du GPT-4-Turbo.

May 07, 2024 pm 04:13 PM

Imaginez un modèle d'intelligence artificielle qui non seulement a la capacité de surpasser l'informatique traditionnelle, mais qui permet également d'obtenir des performances plus efficaces à moindre coût. Ce n'est pas de la science-fiction, DeepSeek-V2[1], le modèle MoE open source le plus puissant au monde est ici. DeepSeek-V2 est un puissant mélange de modèle de langage d'experts (MoE) présentant les caractéristiques d'une formation économique et d'une inférence efficace. Il est constitué de 236B paramètres, dont 21B servent à activer chaque marqueur. Par rapport à DeepSeek67B, DeepSeek-V2 offre des performances plus élevées, tout en économisant 42,5 % des coûts de formation, en réduisant le cache KV de 93,3 % et en augmentant le débit de génération maximal à 5,76 fois. DeepSeek est une entreprise explorant l'intelligence artificielle générale

L'IA bouleverse la recherche mathématique ! Le lauréat de la médaille Fields et mathématicien sino-américain a dirigé 11 articles les mieux classés | Aimé par Terence Tao

Apr 09, 2024 am 11:52 AM

L'IA bouleverse la recherche mathématique ! Le lauréat de la médaille Fields et mathématicien sino-américain a dirigé 11 articles les mieux classés | Aimé par Terence Tao

Apr 09, 2024 am 11:52 AM

L’IA change effectivement les mathématiques. Récemment, Tao Zhexuan, qui a prêté une attention particulière à cette question, a transmis le dernier numéro du « Bulletin de l'American Mathematical Society » (Bulletin de l'American Mathematical Society). En se concentrant sur le thème « Les machines changeront-elles les mathématiques ? », de nombreux mathématiciens ont exprimé leurs opinions. L'ensemble du processus a été plein d'étincelles, intense et passionnant. L'auteur dispose d'une équipe solide, comprenant Akshay Venkatesh, lauréat de la médaille Fields, le mathématicien chinois Zheng Lejun, l'informaticien de l'Université de New York Ernest Davis et de nombreux autres universitaires bien connus du secteur. Le monde de l’IA a radicalement changé. Vous savez, bon nombre de ces articles ont été soumis il y a un an.

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas entre officiellement dans l’ère des robots électriques ! Hier, l'Atlas hydraulique s'est retiré "en larmes" de la scène de l'histoire. Aujourd'hui, Boston Dynamics a annoncé que l'Atlas électrique était au travail. Il semble que dans le domaine des robots humanoïdes commerciaux, Boston Dynamics soit déterminé à concurrencer Tesla. Après la sortie de la nouvelle vidéo, elle a déjà été visionnée par plus d’un million de personnes en seulement dix heures. Les personnes âgées partent et de nouveaux rôles apparaissent. C'est une nécessité historique. Il ne fait aucun doute que cette année est l’année explosive des robots humanoïdes. Les internautes ont commenté : Les progrès des robots ont fait ressembler la cérémonie d'ouverture de cette année à des êtres humains, et le degré de liberté est bien plus grand que celui des humains. Mais n'est-ce vraiment pas un film d'horreur ? Au début de la vidéo, Atlas est allongé calmement sur le sol, apparemment sur le dos. Ce qui suit est à couper le souffle

KAN, qui remplace MLP, a été étendu à la convolution par des projets open source

Jun 01, 2024 pm 10:03 PM

KAN, qui remplace MLP, a été étendu à la convolution par des projets open source

Jun 01, 2024 pm 10:03 PM

Plus tôt ce mois-ci, des chercheurs du MIT et d'autres institutions ont proposé une alternative très prometteuse au MLP – KAN. KAN surpasse MLP en termes de précision et d’interprétabilité. Et il peut surpasser le MLP fonctionnant avec un plus grand nombre de paramètres avec un très petit nombre de paramètres. Par exemple, les auteurs ont déclaré avoir utilisé KAN pour reproduire les résultats de DeepMind avec un réseau plus petit et un degré d'automatisation plus élevé. Plus précisément, le MLP de DeepMind compte environ 300 000 paramètres, tandis que le KAN n'en compte qu'environ 200. KAN a une base mathématique solide comme MLP est basé sur le théorème d'approximation universelle, tandis que KAN est basé sur le théorème de représentation de Kolmogorov-Arnold. Comme le montre la figure ci-dessous, KAN a

Que se passe-t-il lorsque le réseau ne parvient pas à se connecter au wifi ?

Apr 03, 2024 pm 12:11 PM

Que se passe-t-il lorsque le réseau ne parvient pas à se connecter au wifi ?

Apr 03, 2024 pm 12:11 PM

1. Vérifiez le mot de passe wifi : assurez-vous que le mot de passe wifi que vous avez saisi est correct et faites attention à la casse. 2. Confirmez si le wifi fonctionne correctement : Vérifiez si le routeur wifi fonctionne normalement. Vous pouvez connecter d'autres appareils au même routeur pour déterminer si le problème vient de l'appareil. 3. Redémarrez l'appareil et le routeur : Parfois, il y a un dysfonctionnement ou un problème de réseau avec l'appareil ou le routeur, et le redémarrage de l'appareil et du routeur peut résoudre le problème. 4. Vérifiez les paramètres de l'appareil : assurez-vous que la fonction sans fil de l'appareil est activée et que la fonction Wi-Fi n'est pas désactivée.

Google est ravi : les performances de JAX surpassent Pytorch et TensorFlow ! Cela pourrait devenir le choix le plus rapide pour la formation à l'inférence GPU

Apr 01, 2024 pm 07:46 PM

Google est ravi : les performances de JAX surpassent Pytorch et TensorFlow ! Cela pourrait devenir le choix le plus rapide pour la formation à l'inférence GPU

Apr 01, 2024 pm 07:46 PM

Les performances de JAX, promu par Google, ont dépassé celles de Pytorch et TensorFlow lors de récents tests de référence, se classant au premier rang sur 7 indicateurs. Et le test n’a pas été fait sur le TPU présentant les meilleures performances JAX. Bien que parmi les développeurs, Pytorch soit toujours plus populaire que Tensorflow. Mais à l’avenir, des modèles plus volumineux seront peut-être formés et exécutés sur la base de la plate-forme JAX. Modèles Récemment, l'équipe Keras a comparé trois backends (TensorFlow, JAX, PyTorch) avec l'implémentation native de PyTorch et Keras2 avec TensorFlow. Premièrement, ils sélectionnent un ensemble de

Les robots Tesla travaillent dans les usines, Musk : Le degré de liberté des mains atteindra 22 cette année !

May 06, 2024 pm 04:13 PM

Les robots Tesla travaillent dans les usines, Musk : Le degré de liberté des mains atteindra 22 cette année !

May 06, 2024 pm 04:13 PM

La dernière vidéo du robot Optimus de Tesla est sortie, et il peut déjà fonctionner en usine. À vitesse normale, il trie les batteries (les batteries 4680 de Tesla) comme ceci : Le responsable a également publié à quoi cela ressemble à une vitesse 20 fois supérieure - sur un petit "poste de travail", en sélectionnant et en sélectionnant et en sélectionnant : Cette fois, il est publié L'un des points forts de la vidéo est qu'Optimus réalise ce travail en usine, de manière totalement autonome, sans intervention humaine tout au long du processus. Et du point de vue d'Optimus, il peut également récupérer et placer la batterie tordue, en se concentrant sur la correction automatique des erreurs : concernant la main d'Optimus, le scientifique de NVIDIA Jim Fan a donné une évaluation élevée : la main d'Optimus est l'un des robots à cinq doigts du monde. le plus adroit. Ses mains ne sont pas seulement tactiles

FisheyeDetNet : le premier algorithme de détection de cible basé sur une caméra fisheye

Apr 26, 2024 am 11:37 AM

FisheyeDetNet : le premier algorithme de détection de cible basé sur une caméra fisheye

Apr 26, 2024 am 11:37 AM

La détection de cibles est un problème relativement mature dans les systèmes de conduite autonome, parmi lesquels la détection des piétons est l'un des premiers algorithmes à être déployés. Des recherches très complètes ont été menées dans la plupart des articles. Cependant, la perception de la distance à l’aide de caméras fisheye pour une vue panoramique est relativement moins étudiée. En raison de la distorsion radiale importante, la représentation standard du cadre de délimitation est difficile à mettre en œuvre dans les caméras fisheye. Pour alléger la description ci-dessus, nous explorons les conceptions étendues de boîtes englobantes, d'ellipses et de polygones généraux dans des représentations polaires/angulaires et définissons une métrique de segmentation d'instance mIOU pour analyser ces représentations. Le modèle fisheyeDetNet proposé avec une forme polygonale surpasse les autres modèles et atteint simultanément 49,5 % de mAP sur l'ensemble de données de la caméra fisheye Valeo pour la conduite autonome.