Périphériques technologiques

Périphériques technologiques

IA

IA

Erreur de développement de la méta intelligence artificielle, le fait de ne pas utiliser le GPU à temps a entraîné un retard par rapport aux adversaires

Erreur de développement de la méta intelligence artificielle, le fait de ne pas utiliser le GPU à temps a entraîné un retard par rapport aux adversaires

Erreur de développement de la méta intelligence artificielle, le fait de ne pas utiliser le GPU à temps a entraîné un retard par rapport aux adversaires

Une note interne montre qu'à la fin de l'été 2022, le PDG de Meta, Mark Zuckerberg, a convoqué une équipe de dirigeants de l'entreprise pour analyser la puissance de calcul de l'entreprise pendant cinq heures, notamment pour gérer les capacités intelligentes de pointe de l'intelligence artificielle.

Le mémo souligne que malgré l'investissement important de Meta dans la recherche sur l'intelligence artificielle et la dépendance croissante de l'entreprise à l'intelligence artificielle pour soutenir sa croissance, la société de médias sociaux n'a pas encore adopté de systèmes logiciels et matériels coûteux optimisés pour l'intelligence artificielle pour son principal Les géants sont plus lents, ce qui entrave leur capacité à suivre le rythme de l’innovation à mesure qu’ils évoluent. Meta devra « modifier fondamentalement la conception de notre infrastructure physique, nos systèmes logiciels et notre approche pour fournir des plates-formes stables » si elle veut soutenir ses efforts en matière d'IA.

Le remaniement a augmenté les dépenses en capital de Meta d'environ 4 milliards de dollars par trimestre, soit près du double de 2021, et l'a amenée à suspendre ou à annuler ses projets de construction de centres de données sur quatre sites, a révélé la société.

Meta est confrontée à de graves difficultés financières depuis novembre de l'année dernière, l'entreprise a procédé à des licenciements sans précédent.

Dans le même temps, l'émergence de ChatGPT en novembre de l'année dernière a déclenché une concurrence entre les géants de la technologie, qui ont lancé des produits d'IA générative. Cinq sources ont déclaré que l'IA générative nécessite beaucoup de puissance de calcul, ce qui intensifie l'urgence de l'expansion des méta.

Des sources ont révélé que la lenteur de l’application des GPU dans l’intelligence artificielle par Meta est l’un des principaux problèmes. Les puces GPU sont idéales pour le traitement de l'IA car elles peuvent effectuer un grand nombre de tâches simultanément, réduisant ainsi le temps nécessaire au traitement de milliards de données. Cependant, les puces GPU sont plus chères et le fabricant de puces Nvidia contrôle 80 % du marché et conserve une avance dans les logiciels correspondants, ont indiqué des sources.

Jusqu'à l'année dernière, Meta utilisait principalement de grandes quantités de processeurs standards pour exécuter des charges de travail d'IA. Le processeur est la puce la plus performante dans le monde informatique. Bien qu’il domine les centres de données depuis des décennies, il ne fonctionne pas bien dans le domaine de l’intelligence artificielle.

Cela a amené les concurrents à devancer Meta dans le domaine de l'IA. Ils utilisent des puces GPU et disposent de meilleurs logiciels d’IA, ce qui leur permet de développer plus rapidement de nouveaux produits et services d’IA.

Selon deux sources, Meta a également commencé à utiliser ses propres puces personnalisées conçues en interne pour entraîner l'IA. Mais en 2021, cette approche à deux volets s’avère plus lente et moins efficace que celle construite avec des GPU en son cœur. Les puces GPU sont également plus flexibles que les puces Meta pour exécuter différents types de modèles, ont indiqué les deux sources.

Plus tard, alors que Zuckerberg faisait pivoter l'entreprise vers le métaverse, un manque de puissance de calcul a empêché l'entreprise de répondre aux menaces, notamment la montée en puissance de TikTok et les changements de confidentialité publicitaire menés par Apple.

Ces problèmes ont attiré l'attention de Peter Thiel, ancien membre du conseil d'administration de Meta. Début 2022, il a démissionné de son poste sans expliquer pourquoi. Selon deux personnes proches du dossier, lors d'une réunion du conseil d'administration avant son départ, Thiel a souligné que Zuckerberg et ses dirigeants étaient trop concentrés sur le développement du Metaverse et négligeaient le cœur de métier des médias sociaux de Meta, laissant l'entreprise vulnérable aux défis des concurrents. comme TikTok.

Meta avait prévu de lancer une puce personnalisée en 2022, mais a ensuite abandonné et a commandé des milliards de dollars en puces GPU Nvidia la même année. À ce stade, Meta est à la traîne par rapport à ses pairs tels que Google, qui a commencé en 2015 à déployer sa propre version personnalisée du GPU, appelée TPU.

Meta a ensuite commencé à réorganiser le département d'intelligence artificielle et a nommé deux nouveaux ingénieurs pour le diriger. Pendant cette période, des dizaines de dirigeants ont quitté Meta, et la quasi-totalité d’entre eux ont remplacé la direction de l’infrastructure d’IA.

Ensuite, Meta a commencé à réorganiser ses centres de données pour s'adapter à l'introduction des GPU. Ces puces nécessitent plus de puissance et génèrent plus de chaleur, et doivent être regroupées étroitement avec des connexions réseau dédiées entre elles. Les travaux nécessitent une capacité de réseau importante et de nouveaux systèmes de refroidissement liquide pour gérer la chaleur du cluster, nécessitant une « refonte complète » de ceux-ci.

Au fur et à mesure que les travaux progressent, Meta lance des plans internes pour développer une nouvelle puce plus ambitieuse, similaire à un GPU, capable à la fois de former des modèles d'intelligence artificielle et d'effectuer des inférences. Deux sources ont indiqué que le projet serait achevé vers 2025.

Le porte-parole de Meta, Jon Carvill, a refusé de commenter le projet de puce.

Bien que Meta développe les GPU, des sociétés telles que Microsoft et Google font la promotion de produits commerciaux d'IA générative, et Meta n'a pas fait beaucoup de progrès substantiels à cet égard.

Le directeur financier de Meta a admis en février que l'entreprise ne consacrait pas actuellement l'essentiel de sa puissance de calcul au travail génératif. "En gros, toutes nos capacités d'intelligence artificielle sont utilisées dans la publicité, les flux d'actualités et les Reels", a-t-elle déclaré. Reels est le format vidéo court de type TikTok de Meta, populaire auprès des jeunes utilisateurs.

Selon quatre sources, Meta n'a commencé à donner la priorité au développement de produits d'IA générative qu'après le lancement de ChatGPT en novembre de l'année dernière. Bien que la branche de recherche en IA de l'entreprise publie des prototypes technologiques depuis fin 2021, elle ne s'est pas concentrée sur leur transformation en produits. Cependant, alors que l'intérêt des investisseurs continue de croître, Zuckerberg a annoncé en février la création d'une nouvelle équipe d'IA générative de haut niveau qui, selon lui, « accélérerait » le travail de l'entreprise dans ce domaine.

Andrew Bosworth, directeur de la technologie, a également déclaré ce mois-ci que l'intelligence artificielle générative est le domaine dans lequel lui et Zuckerberg passent le plus de temps, et a prédit que Meta lancerait de nouveaux produits cette année.

Deux personnes proches de la nouvelle équipe ont déclaré que le travail de l'équipe en est à ses débuts et se concentre sur la construction d'un modèle de base, un programme de base qui peut ensuite être affiné et adapté à différents produits.

Le porte-parole de Meta, Carvill, a déclaré que la société développait des produits d'intelligence artificielle générative au sein de différentes équipes depuis plus d'un an. Il a confirmé que les travaux se sont accélérés au cours des mois qui ont suivi le lancement de ChatGPT.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

Video Face Swap

Échangez les visages dans n'importe quelle vidéo sans effort grâce à notre outil d'échange de visage AI entièrement gratuit !

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

Bytedance Cutting lance le super abonnement SVIP : 499 yuans pour un abonnement annuel continu, offrant une variété de fonctions d'IA

Jun 28, 2024 am 03:51 AM

Bytedance Cutting lance le super abonnement SVIP : 499 yuans pour un abonnement annuel continu, offrant une variété de fonctions d'IA

Jun 28, 2024 am 03:51 AM

Ce site a rapporté le 27 juin que Jianying est un logiciel de montage vidéo développé par FaceMeng Technology, une filiale de ByteDance. Il s'appuie sur la plateforme Douyin et produit essentiellement du contenu vidéo court pour les utilisateurs de la plateforme. Il est compatible avec iOS, Android et. Windows, MacOS et autres systèmes d'exploitation. Jianying a officiellement annoncé la mise à niveau de son système d'adhésion et a lancé un nouveau SVIP, qui comprend une variété de technologies noires d'IA, telles que la traduction intelligente, la mise en évidence intelligente, l'emballage intelligent, la synthèse humaine numérique, etc. En termes de prix, les frais mensuels pour le clipping SVIP sont de 79 yuans, les frais annuels sont de 599 yuans (attention sur ce site : équivalent à 49,9 yuans par mois), l'abonnement mensuel continu est de 59 yuans par mois et l'abonnement annuel continu est de 59 yuans par mois. est de 499 yuans par an (équivalent à 41,6 yuans par mois) . En outre, le responsable de Cut a également déclaré que afin d'améliorer l'expérience utilisateur, ceux qui se sont abonnés au VIP d'origine

Assistant de codage d'IA augmenté par le contexte utilisant Rag et Sem-Rag

Jun 10, 2024 am 11:08 AM

Assistant de codage d'IA augmenté par le contexte utilisant Rag et Sem-Rag

Jun 10, 2024 am 11:08 AM

Améliorez la productivité, l’efficacité et la précision des développeurs en intégrant une génération et une mémoire sémantique améliorées par la récupération dans les assistants de codage IA. Traduit de EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG, auteur JanakiramMSV. Bien que les assistants de programmation d'IA de base soient naturellement utiles, ils ne parviennent souvent pas à fournir les suggestions de code les plus pertinentes et les plus correctes, car ils s'appuient sur une compréhension générale du langage logiciel et des modèles d'écriture de logiciels les plus courants. Le code généré par ces assistants de codage est adapté à la résolution des problèmes qu’ils sont chargés de résoudre, mais n’est souvent pas conforme aux normes, conventions et styles de codage des équipes individuelles. Cela aboutit souvent à des suggestions qui doivent être modifiées ou affinées pour que le code soit accepté dans l'application.

Le réglage fin peut-il vraiment permettre au LLM d'apprendre de nouvelles choses : l'introduction de nouvelles connaissances peut amener le modèle à produire davantage d'hallucinations

Jun 11, 2024 pm 03:57 PM

Le réglage fin peut-il vraiment permettre au LLM d'apprendre de nouvelles choses : l'introduction de nouvelles connaissances peut amener le modèle à produire davantage d'hallucinations

Jun 11, 2024 pm 03:57 PM

Les grands modèles linguistiques (LLM) sont formés sur d'énormes bases de données textuelles, où ils acquièrent de grandes quantités de connaissances du monde réel. Ces connaissances sont intégrées à leurs paramètres et peuvent ensuite être utilisées en cas de besoin. La connaissance de ces modèles est « réifiée » en fin de formation. À la fin de la pré-formation, le modèle arrête effectivement d’apprendre. Alignez ou affinez le modèle pour apprendre à exploiter ces connaissances et répondre plus naturellement aux questions des utilisateurs. Mais parfois, la connaissance du modèle ne suffit pas, et bien que le modèle puisse accéder à du contenu externe via RAG, il est considéré comme bénéfique de l'adapter à de nouveaux domaines grâce à un réglage fin. Ce réglage fin est effectué à l'aide de la contribution d'annotateurs humains ou d'autres créations LLM, où le modèle rencontre des connaissances supplémentaires du monde réel et les intègre.

Un nouveau casque VR Meta Quest 3S abordable apparaît sur FCC, suggérant un lancement imminent

Sep 04, 2024 am 06:51 AM

Un nouveau casque VR Meta Quest 3S abordable apparaît sur FCC, suggérant un lancement imminent

Sep 04, 2024 am 06:51 AM

L'événement Meta Connect 2024 est prévu du 25 au 26 septembre et lors de cet événement, la société devrait dévoiler un nouveau casque de réalité virtuelle abordable. Selon la rumeur, il s'agirait du Meta Quest 3S, le casque VR serait apparemment apparu sur la liste FCC. Cela suggère

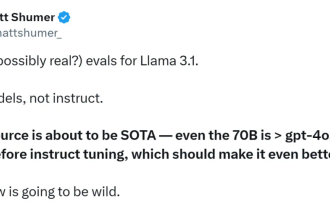

Le premier modèle open source à dépasser le niveau GPT4o ! Llama 3.1 fuite : 405 milliards de paramètres, liens de téléchargement et cartes de modèles sont disponibles

Jul 23, 2024 pm 08:51 PM

Le premier modèle open source à dépasser le niveau GPT4o ! Llama 3.1 fuite : 405 milliards de paramètres, liens de téléchargement et cartes de modèles sont disponibles

Jul 23, 2024 pm 08:51 PM

Préparez votre GPU ! Llama3.1 est finalement apparu, mais la source n'est pas officielle de Meta. Aujourd'hui, la nouvelle divulguée du nouveau grand modèle Llama est devenue virale sur Reddit. En plus du modèle de base, elle comprend également des résultats de référence de 8B, 70B et le paramètre maximum de 405B. La figure ci-dessous montre les résultats de comparaison de chaque version de Llama3.1 avec OpenAIGPT-4o et Llama38B/70B. On peut voir que même la version 70B dépasse GPT-4o sur plusieurs benchmarks. Source de l'image : https://x.com/mattshumer_/status/1815444612414087294 Évidemment, version 3.1 de 8B et 70

Afin de fournir un nouveau système de référence et d'évaluation de questions-réponses scientifiques et complexes pour les grands modèles, l'UNSW, Argonne, l'Université de Chicago et d'autres institutions ont lancé conjointement le cadre SciQAG.

Jul 25, 2024 am 06:42 AM

Afin de fournir un nouveau système de référence et d'évaluation de questions-réponses scientifiques et complexes pour les grands modèles, l'UNSW, Argonne, l'Université de Chicago et d'autres institutions ont lancé conjointement le cadre SciQAG.

Jul 25, 2024 am 06:42 AM

L'ensemble de données ScienceAI Question Answering (QA) joue un rôle essentiel dans la promotion de la recherche sur le traitement du langage naturel (NLP). Des ensembles de données d'assurance qualité de haute qualité peuvent non seulement être utilisés pour affiner les modèles, mais également évaluer efficacement les capacités des grands modèles linguistiques (LLM), en particulier la capacité à comprendre et à raisonner sur les connaissances scientifiques. Bien qu’il existe actuellement de nombreux ensembles de données scientifiques d’assurance qualité couvrant la médecine, la chimie, la biologie et d’autres domaines, ces ensembles de données présentent encore certaines lacunes. Premièrement, le formulaire de données est relativement simple, et la plupart sont des questions à choix multiples. Elles sont faciles à évaluer, mais limitent la plage de sélection des réponses du modèle et ne peuvent pas tester pleinement la capacité du modèle à répondre aux questions scientifiques. En revanche, les questions et réponses ouvertes

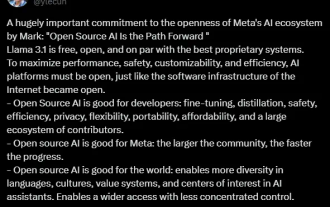

Le modèle le plus puissant Llama 3.1 405B est officiellement lancé, Zuckerberg : l'Open source mène une nouvelle ère

Jul 24, 2024 pm 08:23 PM

Le modèle le plus puissant Llama 3.1 405B est officiellement lancé, Zuckerberg : l'Open source mène une nouvelle ère

Jul 24, 2024 pm 08:23 PM

Tout à l'heure, le très attendu Llama 3.1 est officiellement sorti ! Meta a officiellement déclaré que "l'open source mène une nouvelle ère". Sur le blog officiel, Meta a déclaré : « Jusqu'à aujourd'hui, les grands modèles de langage open source étaient pour la plupart à la traîne des modèles fermés en termes de fonctionnalités et de performances. Nous inaugurons désormais une nouvelle ère dirigée par l'open source. Nous avons rendu public MetaLlama3.1405B. , qui, selon nous, est le modèle de base open source le plus grand et le plus puissant au monde, à ce jour, le nombre total de téléchargements de toutes les versions de Llama a dépassé les 300 millions de fois, et nous venons de commencer, le fondateur et PDG de Meta, Zuckerberg. article long "OpenSourceAIIsthePathForward",

Un analyste discute du prix de lancement du casque VR Meta Quest 3S

Aug 27, 2024 pm 09:35 PM

Un analyste discute du prix de lancement du casque VR Meta Quest 3S

Aug 27, 2024 pm 09:35 PM

Plus d'un an s'est écoulé depuis la sortie initiale du Quest 3 par Meta (499,99 $ sur Amazon). Depuis lors, Apple a commercialisé le Vision Pro, considérablement plus cher, tandis que Byte Dance a dévoilé le Pico 4 Ultra en Chine. Cependant, il y a