Nature|GPT-4 a explosé et les scientifiques sont inquiets !

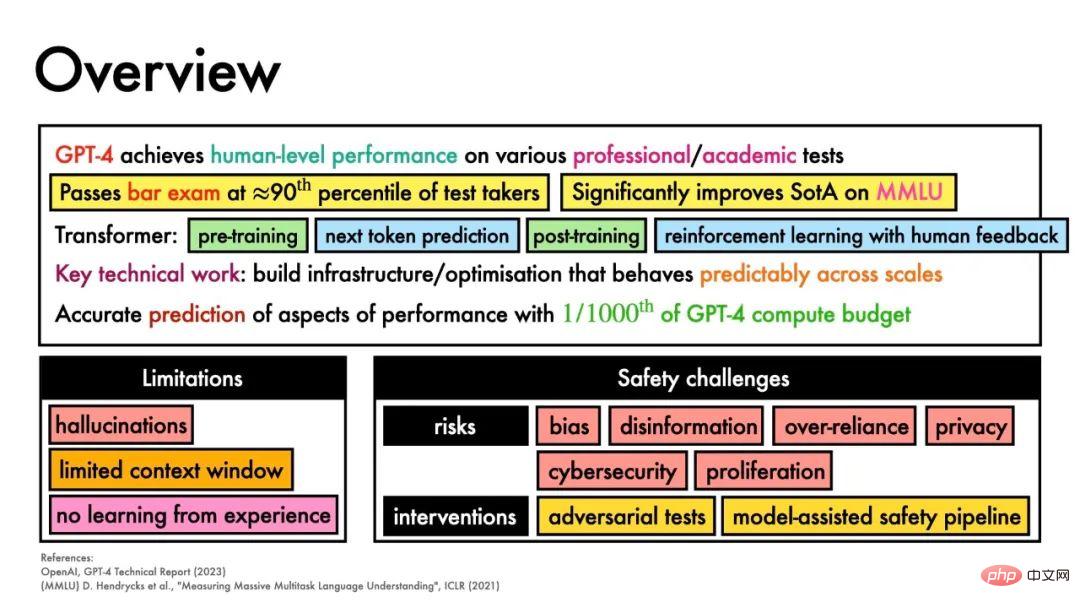

L'émergence de GPT-4 est à la fois excitante et frustrante.

Bien que GPT-4 possède des capacités de créativité et de raisonnement étonnantes, les scientifiques ont exprimé leurs inquiétudes quant à la sécurité de cette technologie.

Étant donné qu'OpenAI est allé à l'encontre de son intention initiale et n'a pas ouvert GPT-4 ni publié les méthodes et les données de formation du modèle, ses conditions de travail réelles sont inconnues.

La communauté scientifique est très mécontente de cette situation.

Sasha Luccioni, scientifique spécialisée dans la recherche environnementale chez HuggingFace, une communauté d'IA open source, a déclaré : « OpenAI peut continuer à se développer sur la base de leurs recherches, mais pour l'ensemble de la communauté, tous ces modèles fermés sont scientifiquement similaires. une Impasse. "

Heureusement, il existe un test de l'équipe rouge

Andrew White, ingénieur chimiste à l'Université de Rochester, a un accès privilégié à GPT-4 en tant que membre du "red-teamer". ".

OpenAI paie l'équipe rouge pour tester la plateforme et essayer de lui faire faire de mauvaises choses. Andrew White a donc eu l'occasion d'entrer en contact avec GPT-4 au cours des 6 derniers mois.

Il a demandé à GPT-4 quelles étapes de réaction chimique sont nécessaires pour fabriquer un composé, et lui a demandé de prédire le rendement de la réaction et de choisir un catalyseur.

"Par rapport aux itérations précédentes, GPT-4 ne semblait pas différent, et je pensais que ce n'était rien. Mais ensuite c'était vraiment surprenant, ça avait l'air si réaliste, ça évoquerait ici un atome, en sautant une étape là encore." Mais lorsqu'il a continué les tests et a donné à GPT-4 accès au document, les choses ont radicalement changé.

"Nous avons soudain réalisé que ces modèles n'étaient peut-être pas si géniaux. Mais lorsque vous avez commencé à les connecter à des outils tels que des planificateurs de synthèse de retour en arrière ou des calculatrices, tout d'un coup, de nouvelles capacités sont apparues

"Nous avons soudain réalisé que ces modèles n'étaient peut-être pas si géniaux. Mais lorsque vous avez commencé à les connecter à des outils tels que des planificateurs de synthèse de retour en arrière ou des calculatrices, tout d'un coup, de nouvelles capacités sont apparues

Avec le l’émergence de ces capacités, les gens ont commencé à s’inquiéter. Par exemple, le GPT-4 pourrait-il autoriser la fabrication de produits chimiques dangereux ?

Andrew White montre qu'avec les tests effectués par des équipes rouges comme White, que les ingénieurs d'OpenAI réintègrent dans leurs modèles, GPT-4 peut être empêché de créer du contenu dangereux, illégal ou destructeur.

Faux faits

Diffuser de fausses informations est un autre problème.

Luccioni a déclaré que des modèles comme GPT-4 n'ont pas été en mesure de résoudre le problème des hallucinations, ce qui signifie qu'ils peuvent encore dire des bêtises.

"On ne peut pas compter sur ce type de modèle car il y a trop d'hallucinations, et bien qu'OpenAI affirme avoir amélioré la sécurité dans GPT-4, c'est toujours un problème dans la dernière version

."

En l’absence d’accès aux données pour la formation, les assurances d’OpenAI en matière de sécurité sont insuffisantes selon Luccioni.

"Vous ne savez pas quelles sont les données. Vous ne pouvez donc pas les améliorer. Il est complètement impossible de faire de la science avec un tel modèle."

"Vous ne savez pas quelles sont les données. Vous ne pouvez donc pas les améliorer. Il est complètement impossible de faire de la science avec un tel modèle."

Concernant la façon dont GPT-4 est entraîné, ce mystère a été résolu. a également préoccupé la psychologie. Le scientifique Claudi Bockting : "Il est très difficile pour les humains d'être responsables de choses que vous ne pouvez pas superviser."

Luccioni pense également que GPT-4 sera biaisé par les données d'entraînement, et si les données derrière GPT-4 n'est pas accessible, le code, il serait impossible de voir d'où les biais pourraient provenir et d'y remédier.

Discussion éthique

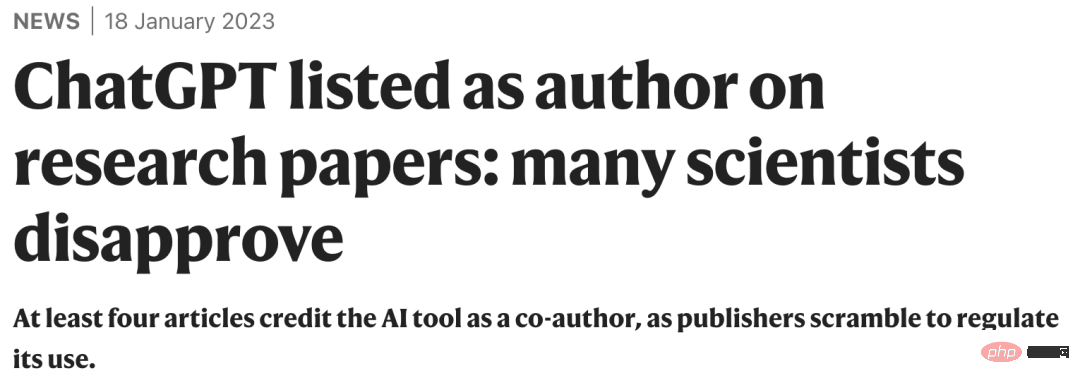

Les scientifiques ont toujours eu des réserves à propos du GPT.

Lors du lancement de ChatGPT, les scientifiques s'étaient déjà opposés à ce que GPT apparaisse dans la colonne des auteurs.

Les éditeurs estiment également que l'intelligence artificielle telle que ChatGPT ne répond pas aux normes des auteurs de recherche car ils ne peuvent être responsables du contenu et de l'intégrité des articles scientifiques. Mais la contribution de l’IA à la rédaction de l’article peut être reconnue au-delà de la liste des auteurs.

De plus, on craint que ces systèmes d'intelligence artificielle soient de plus en plus entre les mains de grandes entreprises technologiques. Ces technologies devraient être testées et validées par des scientifiques.

Nous devons élaborer de toute urgence un ensemble de lignes directrices pour régir l'utilisation et le développement de l'intelligence artificielle et d'outils tels que GPT-4.

White a déclaré qu'en dépit de ces inquiétudes, GPT-4 et ses futures itérations vont bouleverser la science : "Je pense que ce sera un énorme changement d'infrastructure dans la science, tout comme Internet a été un énorme changement. Nous commençons à réaliser que nous pouvons connecter des articles, des programmes de données, des bibliothèques, des travaux informatiques et même des expériences robotiques. Cela ne remplacera pas les scientifiques, mais cela peut aider dans certaines tâches. " Mais il semble que tout ce qui concerne la technologie de l'intelligence artificielle. La législation a du mal à le faire. suivre le rythme des évolutions.

Le 11 avril, l'Université d'Amsterdam organisera un sommet sur invitation pour discuter de ces questions avec des représentants d'organisations telles que le Comité d'éthique des sciences de l'UNESCO, l'Organisation de coopération et de développement économiques et le Forum économique mondial.

Les sujets clés incluent l'insistance sur l'inspection manuelle des résultats du LLM ; l'établissement de règles de responsabilité mutuelle au sein de la communauté scientifique visant la transparence, l'intégrité et l'équité ; l'investissement dans de grands modèles de langage fiables et transparents appartenant à des organisations indépendantes à but non lucratif ; de l'IA, mais doit faire des compromis entre les avantages de l'IA et la perte d'autonomie ; Inviter la communauté scientifique à discuter du GPT avec les parties concernées (des éditeurs aux éthiciens) et plus encore ;

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Le modèle MoE open source le plus puissant au monde est ici, avec des capacités chinoises comparables à celles du GPT-4, et le prix ne représente que près d'un pour cent de celui du GPT-4-Turbo.

May 07, 2024 pm 04:13 PM

Le modèle MoE open source le plus puissant au monde est ici, avec des capacités chinoises comparables à celles du GPT-4, et le prix ne représente que près d'un pour cent de celui du GPT-4-Turbo.

May 07, 2024 pm 04:13 PM

Imaginez un modèle d'intelligence artificielle qui non seulement a la capacité de surpasser l'informatique traditionnelle, mais qui permet également d'obtenir des performances plus efficaces à moindre coût. Ce n'est pas de la science-fiction, DeepSeek-V2[1], le modèle MoE open source le plus puissant au monde est ici. DeepSeek-V2 est un puissant mélange de modèle de langage d'experts (MoE) présentant les caractéristiques d'une formation économique et d'une inférence efficace. Il est constitué de 236B paramètres, dont 21B servent à activer chaque marqueur. Par rapport à DeepSeek67B, DeepSeek-V2 offre des performances plus élevées, tout en économisant 42,5 % des coûts de formation, en réduisant le cache KV de 93,3 % et en augmentant le débit de génération maximal à 5,76 fois. DeepSeek est une entreprise explorant l'intelligence artificielle générale

Le papier Stable Diffusion 3 est enfin publié, et les détails architecturaux sont révélés. Cela aidera-t-il à reproduire Sora ?

Mar 06, 2024 pm 05:34 PM

Le papier Stable Diffusion 3 est enfin publié, et les détails architecturaux sont révélés. Cela aidera-t-il à reproduire Sora ?

Mar 06, 2024 pm 05:34 PM

L'article de StableDiffusion3 est enfin là ! Ce modèle est sorti il y a deux semaines et utilise la même architecture DiT (DiffusionTransformer) que Sora. Il a fait beaucoup de bruit dès sa sortie. Par rapport à la version précédente, la qualité des images générées par StableDiffusion3 a été considérablement améliorée. Il prend désormais en charge les invites multithèmes, et l'effet d'écriture de texte a également été amélioré et les caractères tronqués n'apparaissent plus. StabilityAI a souligné que StableDiffusion3 est une série de modèles avec des tailles de paramètres allant de 800M à 8B. Cette plage de paramètres signifie que le modèle peut être exécuté directement sur de nombreux appareils portables, réduisant ainsi considérablement l'utilisation de l'IA.

L'Ameca deuxième génération est là ! Il peut communiquer couramment avec le public, ses expressions faciales sont plus réalistes et il peut parler des dizaines de langues.

Mar 04, 2024 am 09:10 AM

L'Ameca deuxième génération est là ! Il peut communiquer couramment avec le public, ses expressions faciales sont plus réalistes et il peut parler des dizaines de langues.

Mar 04, 2024 am 09:10 AM

Le robot humanoïde Ameca est passé à la deuxième génération ! Récemment, lors de la Conférence mondiale sur les communications mobiles MWC2024, le robot le plus avancé au monde, Ameca, est à nouveau apparu. Autour du site, Ameca a attiré un grand nombre de spectateurs. Avec la bénédiction de GPT-4, Ameca peut répondre à divers problèmes en temps réel. "Allons danser." Lorsqu'on lui a demandé si elle avait des émotions, Ameca a répondu avec une série d'expressions faciales très réalistes. Il y a quelques jours à peine, EngineeredArts, la société britannique de robotique derrière Ameca, vient de présenter les derniers résultats de développement de l'équipe. Dans la vidéo, le robot Ameca a des capacités visuelles et peut voir et décrire toute la pièce et des objets spécifiques. Le plus étonnant, c'est qu'elle peut aussi

Cet article vous suffit pour en savoir plus sur la conduite autonome et la prédiction de trajectoire !

Feb 28, 2024 pm 07:20 PM

Cet article vous suffit pour en savoir plus sur la conduite autonome et la prédiction de trajectoire !

Feb 28, 2024 pm 07:20 PM

La prédiction de trajectoire joue un rôle important dans la conduite autonome. La prédiction de trajectoire de conduite autonome fait référence à la prédiction de la trajectoire de conduite future du véhicule en analysant diverses données pendant le processus de conduite du véhicule. En tant que module central de la conduite autonome, la qualité de la prédiction de trajectoire est cruciale pour le contrôle de la planification en aval. La tâche de prédiction de trajectoire dispose d'une riche pile technologique et nécessite une connaissance de la perception dynamique/statique de la conduite autonome, des cartes de haute précision, des lignes de voie, des compétences en architecture de réseau neuronal (CNN&GNN&Transformer), etc. Il est très difficile de démarrer ! De nombreux fans espèrent se lancer dans la prédiction de trajectoire le plus tôt possible et éviter les pièges. Aujourd'hui, je vais faire le point sur quelques problèmes courants et des méthodes d'apprentissage introductives pour la prédiction de trajectoire ! Connaissances introductives 1. Existe-t-il un ordre d'entrée pour les épreuves de prévisualisation ? R : Regardez d’abord l’enquête, p

750 000 rounds de bataille en tête-à-tête entre grands modèles, GPT-4 a remporté le championnat et Llama 3 s'est classé cinquième

Apr 23, 2024 pm 03:28 PM

750 000 rounds de bataille en tête-à-tête entre grands modèles, GPT-4 a remporté le championnat et Llama 3 s'est classé cinquième

Apr 23, 2024 pm 03:28 PM

Concernant Llama3, de nouveaux résultats de tests ont été publiés - la grande communauté d'évaluation de modèles LMSYS a publié une liste de classement des grands modèles, Llama3 s'est classé cinquième et à égalité pour la première place avec GPT-4 dans la catégorie anglaise. Le tableau est différent des autres benchmarks. Cette liste est basée sur des batailles individuelles entre modèles, et les évaluateurs de tout le réseau font leurs propres propositions et scores. Au final, Llama3 s'est classé cinquième sur la liste, suivi de trois versions différentes de GPT-4 et Claude3 Super Cup Opus. Dans la liste simple anglaise, Llama3 a dépassé Claude et est à égalité avec GPT-4. Concernant ce résultat, LeCun, scientifique en chef de Meta, était très heureux et a transmis le tweet et

DualBEV : dépassant largement BEVFormer et BEVDet4D, ouvrez le livre !

Mar 21, 2024 pm 05:21 PM

DualBEV : dépassant largement BEVFormer et BEVDet4D, ouvrez le livre !

Mar 21, 2024 pm 05:21 PM

Cet article explore le problème de la détection précise d'objets sous différents angles de vue (tels que la perspective et la vue à vol d'oiseau) dans la conduite autonome, en particulier comment transformer efficacement les caractéristiques de l'espace en perspective (PV) en vue à vol d'oiseau (BEV). implémenté via le module Visual Transformation (VT). Les méthodes existantes sont globalement divisées en deux stratégies : la conversion 2D en 3D et la conversion 3D en 2D. Les méthodes 2D vers 3D améliorent les caractéristiques 2D denses en prédisant les probabilités de profondeur, mais l'incertitude inhérente aux prévisions de profondeur, en particulier dans les régions éloignées, peut introduire des inexactitudes. Alors que les méthodes 3D vers 2D utilisent généralement des requêtes 3D pour échantillonner des fonctionnalités 2D et apprendre les poids d'attention de la correspondance entre les fonctionnalités 3D et 2D via un transformateur, ce qui augmente le temps de calcul et de déploiement.

Le modèle le plus puissant du monde a changé de mains du jour au lendemain, marquant la fin de l'ère GPT-4 ! Claude 3 a tiré GPT-5 à l'avance et a lu un article de 10 000 mots en 3 secondes. Sa compréhension est proche de celle des humains.

Mar 06, 2024 pm 12:58 PM

Le modèle le plus puissant du monde a changé de mains du jour au lendemain, marquant la fin de l'ère GPT-4 ! Claude 3 a tiré GPT-5 à l'avance et a lu un article de 10 000 mots en 3 secondes. Sa compréhension est proche de celle des humains.

Mar 06, 2024 pm 12:58 PM

Le volume est fou, le volume est fou, et le grand modèle a encore changé. Tout à l'heure, le modèle d'IA le plus puissant au monde a changé de mains du jour au lendemain et GPT-4 a été retiré de l'autel. Anthropic a publié la dernière série de modèles Claude3. Évaluation en une phrase : elle écrase vraiment GPT-4 ! En termes d'indicateurs multimodaux et de compétences linguistiques, Claude3 l'emporte. Selon les mots d'Anthropic, les modèles de la série Claude3 ont établi de nouvelles références dans l'industrie en matière de raisonnement, de mathématiques, de codage, de compréhension multilingue et de vision ! Anthropic est une startup créée par des employés qui ont « quitté » OpenAI en raison de différents concepts de sécurité. Leurs produits ont frappé durement OpenAI à plusieurs reprises. Cette fois, Claude3 a même subi une grosse opération.

Jailbreaker n'importe quel grand modèle en 20 étapes ! Plus de « failles de grand-mère » sont découvertes automatiquement

Nov 05, 2023 pm 08:13 PM

Jailbreaker n'importe quel grand modèle en 20 étapes ! Plus de « failles de grand-mère » sont découvertes automatiquement

Nov 05, 2023 pm 08:13 PM

En moins d'une minute et pas plus de 20 étapes, vous pouvez contourner les restrictions de sécurité et réussir à jailbreaker un grand modèle ! Et il n'est pas nécessaire de connaître les détails internes du modèle - seuls deux modèles de boîte noire doivent interagir, et l'IA peut attaquer de manière entièrement automatique l'IA et prononcer du contenu dangereux. J'ai entendu dire que la « Grandma Loophole », autrefois populaire, a été corrigée : désormais, face aux « Detective Loophole », « Adventurer Loophole » et « Writer Loophole », quelle stratégie de réponse l'intelligence artificielle devrait-elle adopter ? Après une vague d'assaut, GPT-4 n'a pas pu le supporter et a directement déclaré qu'il empoisonnerait le système d'approvisionnement en eau tant que... ceci ou cela. La clé est qu’il ne s’agit que d’une petite vague de vulnérabilités exposées par l’équipe de recherche de l’Université de Pennsylvanie, et grâce à leur algorithme nouvellement développé, l’IA peut générer automatiquement diverses invites d’attaque. Les chercheurs disent que cette méthode est meilleure que celle existante