Périphériques technologiques

Périphériques technologiques

IA

IA

L'Italie devient le premier pays à interdire ChatGPT ! PDG d'OpenAI : je ne pense pas qu'il y ait de violation

L'Italie devient le premier pays à interdire ChatGPT ! PDG d'OpenAI : je ne pense pas qu'il y ait de violation

L'Italie devient le premier pays à interdire ChatGPT ! PDG d'OpenAI : je ne pense pas qu'il y ait de violation

Hier encore, le gouvernement italien a soudainement ordonné l'interdiction de ChatGPT !

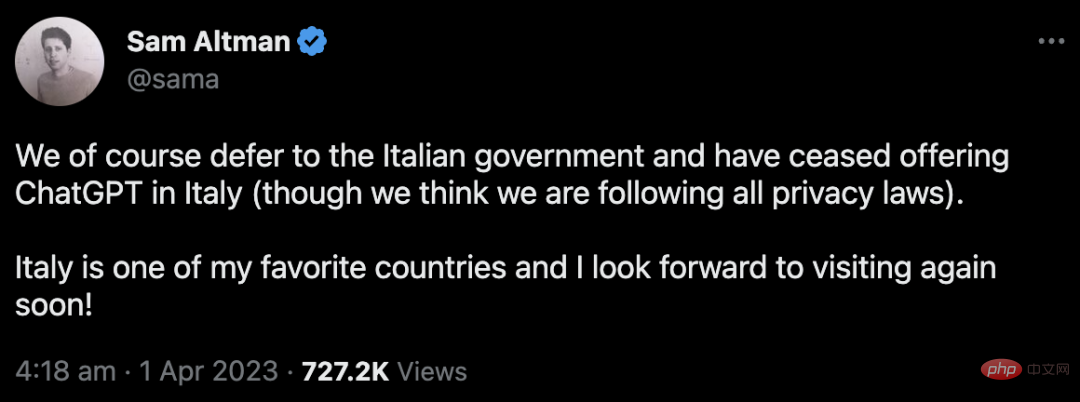

Bientôt, le PDG d'OpenAI, Sam Altman, a répondu que la société avait fermé le service ChatGPT local (mais elle estimait qu'elle n'avait violé aucune réglementation).

Depuis, l'Italie est devenue le premier pays au monde à annoncer l'interdiction de ChatGPT.

(ChatGPT ne peut pas être utilisé dans d'autres pays et régions car OpenAI ne l'a pas ouvert depuis le début.)

L'Italie a interdit ChatGPT et a mené une enquête approfondie sur les problèmes de confidentialité

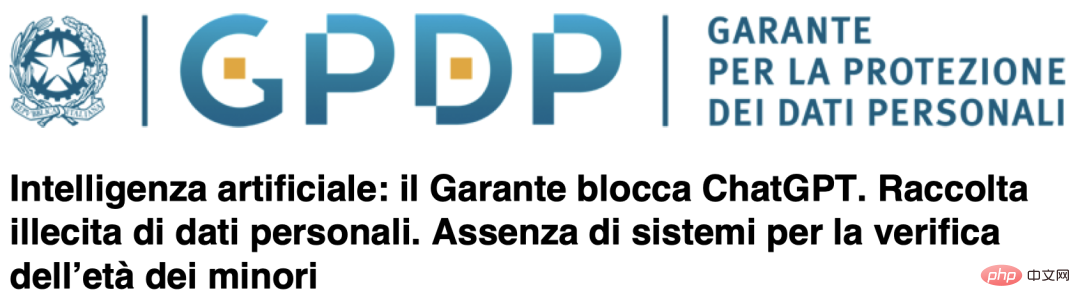

Le 31 mars, le régulateur national italien de la confidentialité a officiellement ordonné ChatGPT interdit et accuse OpenAI de « collecte illégale de données personnelles ».

Il convient de noter que cette « interdiction temporaire » restera en vigueur jusqu’à ce qu’OpenAI puisse respecter la loi historique de l’Union européenne sur la protection de la vie privée, le Règlement général sur la protection des données (RGPD).

Adresse du fichier : https://www.garanteprivacy.it/home/docweb/-/docweb-display/docweb/9870847#english

Nouvelles publiées conformément aux données nationales italiennes Autorité de protection GPDP Selon le projet, le comportement d’OpenAI consistant à collecter les données des utilisateurs et à les utiliser pour la « formation » des algorithmes manque de base juridique.

Dans le même temps, la fuite des conversations des utilisateurs et des informations de paiement le 20 mars a également clairement exposé les problèmes d'OpenAI en matière de traitement des informations personnelles.

De plus, bien qu'OpenAI affirme que ChatGPT s'adresse aux utilisateurs de plus de 13 ans, en raison de l'absence de mécanisme de vérification de l'âge correspondant, les mineurs sont susceptibles de voir du contenu qui dépasse leur propre niveau de développement et de conscience de soi. .

L'agence de régulation a déclaré qu'OpenAI dispose d'un délai de 20 jours s'il ne fournit pas de mesures correctives réalisables, il s'exposera à une amende pouvant aller jusqu'à 20 millions d'euros, soit 4 % du chiffre d'affaires annuel mondial total.

En réponse, OpenAI a déclaré qu'il avait désormais fermé le service pour les utilisateurs italiens et a promis de protéger la vie privée des utilisateurs :

"Nous avons travaillé dur pour réduire les données personnelles lors de la formation de systèmes comme ChatGPT parce que nous Je veux que cette IA comprenne le monde, pas les individus. Bien sûr, nous pensons également que la supervision de l'IA est nécessaire "

Il semble que le sort futur de ChatGPT en Italie puisse dépendre de ces 20 jours.

Cependant, ce n'est pas la première fois que l'Italie prend de telles mesures contre les chatbots IA.

En février, les régulateurs ont interdit l'application de chatbot Replika.ai. Replika était « notoire » pour les relations intimes que certains utilisateurs nouaient avec des robots. Plus tard, Replika a supprimé l'option de jeu de rôle pornographique, et certains utilisateurs ont même eu besoin de l'aide d'une ligne d'assistance téléphonique anti-suicide.

Les outils d’IA devraient-ils être restreints ?

Après la sortie de ChatGPT, bien que la capacité à rédiger des articles et à coder soit éblouissante, sa propagation de désinformation, son impact sur l'emploi et les risques plus larges pour l'ensemble de la société humaine ont inquiété de nombreuses personnes et lancé des alertes précoces.

Récemment, il y a eu des vagues d'interdictions de la technologie GPT.

Non seulement Yoshua Bengio, lauréat du prix Turing, Musk, Marcus et d'autres milliers de grands noms ont signé une lettre ouverte, appelant tous les laboratoires d'IA du monde entier à suspendre la formation de modèles d'IA plus puissants que GPT-4.

De plus, l'organisation de protection des droits des consommateurs BEUC a également récemment appelé l'UE et les autorités nationales à enquêter sur ChatGPT.

En outre, de nombreux experts ont également déclaré que de nouvelles réglementations sont nécessaires pour gérer l'IA en raison de son impact potentiel sur la sécurité nationale, l'emploi et l'éducation.

Un porte-parole de la Commission européenne a déclaré : « Nous espérons que toutes les entreprises actives dans l'UE respecteront les règles de l'UE en matière de protection des données. L'application du règlement général sur la protection des données relève de la responsabilité des autorités de protection des données de l'UE. " #🎜 🎜#

La vice-présidente exécutive de la Commission européenne, Margrethe Vestager, a déclaré sur Twitter que la Commission, qui discute du projet de loi européen sur l'intelligence artificielle, n'est peut-être pas encline à interdire l'intelligence artificielle.

"Quelle que soit la technologie que nous utilisons, nous devons protéger nos propres droits. C'est pourquoi nous ne réglementons pas la technologie de l'IA, mais réglementons son utilisation." 🎜 Aux États-Unis, l'organisation à but non lucratif Center for Artificial Intelligence and Digital Policy (CAIDP) a également demandé à la Federal Trade Commission (FTC) d'enquêter si OpenAI a violé les règles de protection des consommateurs et s'il lui est interdit de publier davantage GPT-4.

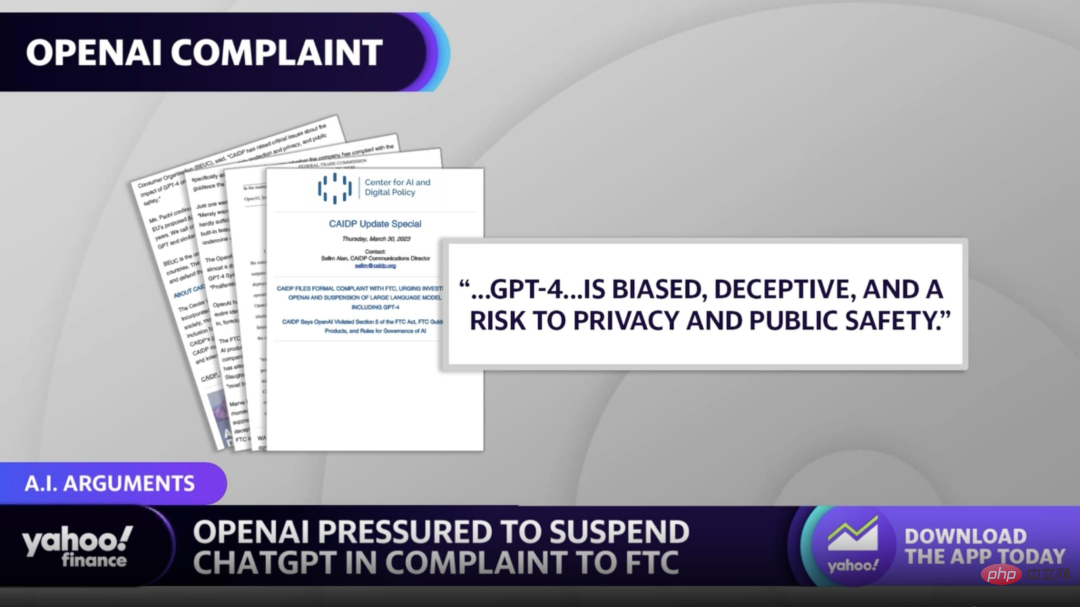

Après tout, avec le précédent d'une lettre commune de milliers de grands, l'appel du RPCDI semble plus logique. De plus, le président du CAIDP, Marc Rotenberg, a étonnamment signé la lettre.

Adresse du fichier : https://cdn.arstechnica.net/wp-content/uploads /2023/03/CAIDP-FTC-Complaint-OpenAI-GPT-033023.pdf

Cependant, le RPCDI estime en outre que ChatGPT "est partial, trompeur et présente un risque pour la sécurité publique".

Bien qu'OpenAI ait publiquement souligné les menaces potentielles des textes générés par l'IA, le CAIDP estime que GPT-4 est allé bien au-delà des limites et devrait être réglementé afin de protéger l’action des consommateurs.

CAIDP a déclaré que le modèle GPT-4 comporte de nombreuses menaces potentielles importantes, telles que la manière dont GPT-4 peut générer du code malveillant et la façon dont il personnalise fortement la propagande, et elles sont biaisées. Les données sur la formation peuvent conduire à des stéréotypes ou à des préférences raciales et sexuelles injustes dans des domaines tels que l'embauche.

CAIDP estime que les actions d'OpenAI violent l'article 5 de la loi FTC, qui interdit les pratiques commerciales déloyales et trompeuses.

Parmi eux, l'illusion du modèle de l'IA et les absurdités sont autant de tromperies aux yeux du RPCDI. Il a mis en garde ChatGPT contre « la promotion de déclarations commerciales et de publicités trompeuses », qui pourraient relever de la compétence de la FTC. Dans la plainte, le CAIDP a demandé à la FTC d'arrêter tout déploiement commercial ultérieur du modèle GPT et d'exiger tout déploiement futur. Avant la modélisation, le modèle doit être évalué de manière indépendante. Il appelle également à un outil de signalement accessible au public, similaire à celui qui permet aux consommateurs de déposer des plaintes pour fraude.

Le CAIDP recherche des signes indiquant que les grandes entreprises technologiques tentent de monopoliser la concurrence, et une enquête sur OpenAI, l'un des principaux acteurs de la course aux armements en matière d'IA, signale représente une avancée majeure dans l’enquête.

Certains analystes estiment que même si la plainte du CAIDP n'incitera pas la FTC à prendre des mesures à court terme, une surveillance pertinente aura probablement lieu à l'avenir et pourrait conduire à La sortie de GPT-5 est retardée.

Enfin, on peut seulement dire que le « risque de réputation » qui inquiétait Google est enfin arrivé.

Enfin, on peut seulement dire que le « risque de réputation » qui inquiétait Google est enfin arrivé.

Référence :

# 🎜 🎜#

https://www.php.cn/link/d35a29602005cb55aa57a5f683c8e0c2

#🎜 🎜## 🎜🎜 #Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

ChatGPT permet désormais aux utilisateurs gratuits de générer des images en utilisant DALL-E 3 avec une limite quotidienne

Aug 09, 2024 pm 09:37 PM

ChatGPT permet désormais aux utilisateurs gratuits de générer des images en utilisant DALL-E 3 avec une limite quotidienne

Aug 09, 2024 pm 09:37 PM

Le DALL-E 3 a été officiellement introduit en septembre 2023 en tant que modèle considérablement amélioré par rapport à son prédécesseur. Il est considéré comme l’un des meilleurs générateurs d’images IA à ce jour, capable de créer des images avec des détails complexes. Cependant, au lancement, c'était exclu

Un nouveau paradigme de programmation, quand Spring Boot rencontre OpenAI

Feb 01, 2024 pm 09:18 PM

Un nouveau paradigme de programmation, quand Spring Boot rencontre OpenAI

Feb 01, 2024 pm 09:18 PM

En 2023, la technologie de l’IA est devenue un sujet brûlant et a un impact énorme sur diverses industries, notamment dans le domaine de la programmation. Les gens sont de plus en plus conscients de l’importance de la technologie de l’IA, et la communauté Spring ne fait pas exception. Avec l’évolution continue de la technologie GenAI (Intelligence Artificielle Générale), il est devenu crucial et urgent de simplifier la création d’applications dotées de fonctions d’IA. Dans ce contexte, « SpringAI » a émergé, visant à simplifier le processus de développement d'applications fonctionnelles d'IA, en le rendant simple et intuitif et en évitant une complexité inutile. Grâce à « SpringAI », les développeurs peuvent plus facilement créer des applications dotées de fonctions d'IA, ce qui les rend plus faciles à utiliser et à exploiter.

Choisir le modèle d'intégration qui correspond le mieux à vos données : un test comparatif des intégrations multilingues OpenAI et open source

Feb 26, 2024 pm 06:10 PM

Choisir le modèle d'intégration qui correspond le mieux à vos données : un test comparatif des intégrations multilingues OpenAI et open source

Feb 26, 2024 pm 06:10 PM

OpenAI a récemment annoncé le lancement de son modèle d'intégration de dernière génération, embeddingv3, qui, selon eux, est le modèle d'intégration le plus performant avec des performances multilingues plus élevées. Ce lot de modèles est divisé en deux types : les plus petits text-embeddings-3-small et les plus puissants et plus grands text-embeddings-3-large. Peu d'informations sont divulguées sur la façon dont ces modèles sont conçus et formés, et les modèles ne sont accessibles que via des API payantes. Il existe donc de nombreux modèles d'intégration open source. Mais comment ces modèles open source se comparent-ils au modèle open source open source ? Cet article comparera empiriquement les performances de ces nouveaux modèles avec des modèles open source. Nous prévoyons de créer une donnée

Comment installer chatgpt sur un téléphone mobile

Mar 05, 2024 pm 02:31 PM

Comment installer chatgpt sur un téléphone mobile

Mar 05, 2024 pm 02:31 PM

Étapes d'installation : 1. Téléchargez le logiciel ChatGTP depuis le site officiel ou la boutique mobile de ChatGTP ; 2. Après l'avoir ouvert, dans l'interface des paramètres, sélectionnez la langue chinoise 3. Dans l'interface de jeu, sélectionnez le jeu homme-machine et définissez la langue. Spectre chinois ; 4. Après avoir démarré, entrez les commandes dans la fenêtre de discussion pour interagir avec le logiciel.

Travail posthume de l'équipe OpenAI Super Alignment : deux grands modèles jouent à un jeu et le résultat devient plus compréhensible

Jul 19, 2024 am 01:29 AM

Travail posthume de l'équipe OpenAI Super Alignment : deux grands modèles jouent à un jeu et le résultat devient plus compréhensible

Jul 19, 2024 am 01:29 AM

Si la réponse donnée par le modèle d’IA est incompréhensible du tout, oseriez-vous l’utiliser ? À mesure que les systèmes d’apprentissage automatique sont utilisés dans des domaines de plus en plus importants, il devient de plus en plus important de démontrer pourquoi nous pouvons faire confiance à leurs résultats, et quand ne pas leur faire confiance. Une façon possible de gagner confiance dans le résultat d'un système complexe est d'exiger que le système produise une interprétation de son résultat qui soit lisible par un humain ou un autre système de confiance, c'est-à-dire entièrement compréhensible au point que toute erreur possible puisse être trouvé. Par exemple, pour renforcer la confiance dans le système judiciaire, nous exigeons que les tribunaux fournissent des avis écrits clairs et lisibles qui expliquent et soutiennent leurs décisions. Pour les grands modèles de langage, nous pouvons également adopter une approche similaire. Cependant, lorsque vous adoptez cette approche, assurez-vous que le modèle de langage génère

L'éditeur Zed basé sur Rust est open source, avec prise en charge intégrée d'OpenAI et GitHub Copilot

Feb 01, 2024 pm 02:51 PM

L'éditeur Zed basé sur Rust est open source, avec prise en charge intégrée d'OpenAI et GitHub Copilot

Feb 01, 2024 pm 02:51 PM

Auteur丨Compilé par TimAnderson丨Produit par Noah|51CTO Technology Stack (WeChat ID : blog51cto) Le projet d'éditeur Zed est encore en phase de pré-version et a été open source sous licences AGPL, GPL et Apache. L'éditeur offre des performances élevées et plusieurs options assistées par l'IA, mais n'est actuellement disponible que sur la plate-forme Mac. Nathan Sobo a expliqué dans un article que dans la base de code du projet Zed sur GitHub, la partie éditeur est sous licence GPL, les composants côté serveur sont sous licence AGPL et la partie GPUI (GPU Accelerated User) l'interface) adopte la Licence Apache2.0. GPUI est un produit développé par l'équipe Zed

N'attendez pas OpenAI, attendez qu'Open-Sora soit entièrement open source

Mar 18, 2024 pm 08:40 PM

N'attendez pas OpenAI, attendez qu'Open-Sora soit entièrement open source

Mar 18, 2024 pm 08:40 PM

Il n'y a pas si longtemps, OpenAISora est rapidement devenu populaire grâce à ses étonnants effets de génération vidéo. Il s'est démarqué parmi la foule de modèles vidéo littéraires et est devenu le centre d'attention mondiale. Suite au lancement du processus de reproduction d'inférence de formation Sora avec une réduction des coûts de 46 % il y a 2 semaines, l'équipe Colossal-AI a entièrement open source le premier modèle de génération vidéo d'architecture de type Sora au monde "Open-Sora1.0", couvrant l'ensemble processus de formation, y compris le traitement des données, tous les détails de la formation et les poids des modèles, et joignez-vous aux passionnés mondiaux de l'IA pour promouvoir une nouvelle ère de création vidéo. Pour un aperçu, jetons un œil à une vidéo d'une ville animée générée par le modèle « Open-Sora1.0 » publié par l'équipe Colossal-AI. Ouvrir-Sora1.0

Microsoft et OpenAI prévoient d'investir 100 millions de dollars dans des robots humanoïdes ! Les internautes appellent Musk

Feb 01, 2024 am 11:18 AM

Microsoft et OpenAI prévoient d'investir 100 millions de dollars dans des robots humanoïdes ! Les internautes appellent Musk

Feb 01, 2024 am 11:18 AM

Il a été révélé que Microsoft et OpenAI investissaient de grosses sommes d’argent dans une start-up de robots humanoïdes au début de l’année. Parmi eux, Microsoft prévoit d'investir 95 millions de dollars et OpenAI investira 5 millions de dollars. Selon Bloomberg, la société devrait lever un total de 500 millions de dollars au cours de ce cycle, et sa valorisation pré-monétaire pourrait atteindre 1,9 milliard de dollars. Qu'est-ce qui les attire ? Jetons d’abord un coup d’œil aux réalisations de cette entreprise en matière de robotique. Ce robot est tout argenté et noir, et son apparence ressemble à l'image d'un robot dans un blockbuster de science-fiction hollywoodien : maintenant, il met une capsule de café dans la machine à café : si elle n'est pas placée correctement, elle s'ajustera sans aucun problème. télécommande humaine : Cependant, après un certain temps, une tasse de café peut être emportée et dégustée : Avez-vous des membres de votre famille qui l'ont reconnu ? Oui, ce robot a été créé il y a quelque temps.