Périphériques technologiques

Périphériques technologiques

IA

IA

OpenAI a débauché professionnellement près de 100 patrons ! De grandes entreprises comme Google et Meta sont devenues des « réserves de talents »

OpenAI a débauché professionnellement près de 100 patrons ! De grandes entreprises comme Google et Meta sont devenues des « réserves de talents »

OpenAI a débauché professionnellement près de 100 patrons ! De grandes entreprises comme Google et Meta sont devenues des « réserves de talents »

ChatGPT est devenu un succès instantané, brisant complètement openAI, une startup en seulement 5 jours, le nombre d'utilisateurs enregistrés dans le monde a dépassé le million, et il est toujours populaire aujourd'hui.

Mais pourquoi OpenAI a-t-il créé ChatGPT ? Quel est le parcours des employés d’OpenAI ?

La bataille pour attirer les gens, openAI a gagné

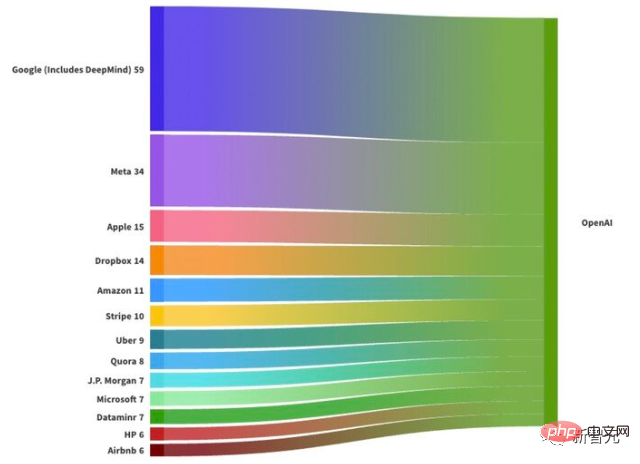

Selon les médias étrangers, l'enquête de Leadgenious Punks & Pinstripes sur les 736 actuels Employés d'OpenAI Après avoir analysé le contexte, nous pouvons constater que presque tous les principaux talents d'OpenAI proviennent de grandes entreprises technologiques.

Parmi eux, 59 personnes travaillaient auparavant chez Google, suivi par Meta (34 personnes), Apple (15 personnes), Dropbox (14 personnes) et Amazon (11 personnes).

Parmi les employés d'OpenAI, 389 ont travaillé dans des sociétés de matériel ou de logiciels ; 39 sont issus du secteur des services financiers, dont JPMorgan Chase (7 employés étrangers), Robin des Bois (5 personnes) et UBS (3 personnes).

OpenAI a déjà gagné la bataille des talents techniques.

Les résultats de la recherche de LeadGenius sonnent également une « alarme de talent » pour les grandes entreprises technologiques, en particulier Google, qui n'accordent pas suffisamment d'attention à leurs employés.

Beaucoup de ceux qui ont démissionné de Google développent des produits secondaires dans des laboratoires d'innovation (comme Alphabet X), ce qui signifie qu'ils ne peuvent pratiquement pas voir les résultats de leur travail avoir un impact significatif sur l'entreprise. produits ou revenus de base.

Et openAI peut leur offrir cette opportunité.

De plus, OpenAI a recruté 39 employés financiers, dépassant de loin les attentes du secteur. Cela signifie-t-il que la prochaine étape d'OpenAI consiste à « défier le secteur des services financiers » ?

Lisa Wardlaw, présidente et fondatrice de 360 Digital Immersion, a déclaré : "Il est trop tôt pour le dire, mais ils offrent une option viable aux talents de Wall Street à la recherche de nouvelles options." 🎜🎜#À l'époque où Mark Zuckerberg a fondé Facebook, il suffisait d'un dortoir universitaire ou d'un garage pour démarrer une entreprise de classe mondiale et le succès d'OpenAI consistait à « débaucher les employés » des grandes entreprises.

Google : la réserve de talents d'OpenAI

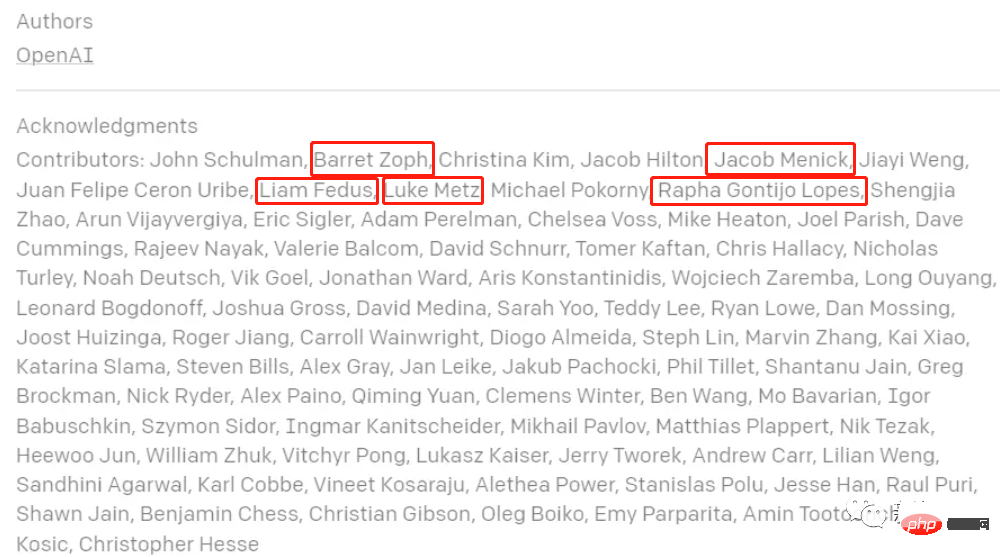

Dès novembre dernier, dans le billet de blog publié par ChatGPT, les noms de cinq employés de Google figuraient dans la section remerciements : Barret Zoph, Liam Fedus, Luke Metz, Jacob Menick, Rapha Gontijo Lope

LinkedIn montre que Barret Zoph a quitté Google Brain en août 2022 et a rejoint OpenAI pour participer à la création La principale direction de recherche de ChatGPT est la formation de grands modèles de langage clairsemé et d'AuoML, tels que la recherche de structure neuronale (NAS).

LinkedIn montre que Barret Zoph a quitté Google Brain en août 2022 et a rejoint OpenAI pour participer à la création La principale direction de recherche de ChatGPT est la formation de grands modèles de langage clairsemé et d'AuoML, tels que la recherche de structure neuronale (NAS).

Liam Fedus a rejoint Google Brain en 2018 et OpenAI vers septembre 2022. Durant ses études doctorales à l'Université de Montréal, son mentor était Yoshua, lauréat du prix Turing Les intérêts de recherche de Bengio couvrent l'apprentissage supervisé, non supervisé et par renforcement.

Liam Fedus a rejoint Google Brain en 2018 et OpenAI vers septembre 2022. Durant ses études doctorales à l'Université de Montréal, son mentor était Yoshua, lauréat du prix Turing Les intérêts de recherche de Bengio couvrent l'apprentissage supervisé, non supervisé et par renforcement.

Luke Metz a rejoint Google Brain en 2016 en tant que chercheur scientifique senior. Il n'a pas encore montré qu'il avait rejoint OpenAI sur ses profils LinkedIn et Twitter.

Luke Metz a rejoint Google Brain en 2016 en tant que chercheur scientifique senior. Il n'a pas encore montré qu'il avait rejoint OpenAI sur ses profils LinkedIn et Twitter.

Jacob Menick a rejoint DeepMind en septembre 2015 et OpenAI en tant que chercheur en septembre 2022. Il a obtenu un doctorat de l'University College de Londres. Ses principales orientations de recherche. sont l’apprentissage automatique et les modèles de génération, l’apprentissage profond à grande échelle, l’inférence variationnelle, la théorie de l’information et les modèles clairsemés.

Jacob Menick a rejoint DeepMind en septembre 2015 et OpenAI en tant que chercheur en septembre 2022. Il a obtenu un doctorat de l'University College de Londres. Ses principales orientations de recherche. sont l’apprentissage automatique et les modèles de génération, l’apprentissage profond à grande échelle, l’inférence variationnelle, la théorie de l’information et les modèles clairsemés.

Rapha Gontijo Lope est diplômé du Georgia Institute of Technology en juin 2018 et a ensuite rejoint Google Brain, au cours duquel il a participé à un stage de deux ans sur Google AI Plan de résidence, rejoignant OpenAI en septembre 2022

Rapha Gontijo Lope est diplômé du Georgia Institute of Technology en juin 2018 et a ensuite rejoint Google Brain, au cours duquel il a participé à un stage de deux ans sur Google AI Plan de résidence, rejoignant OpenAI en septembre 2022

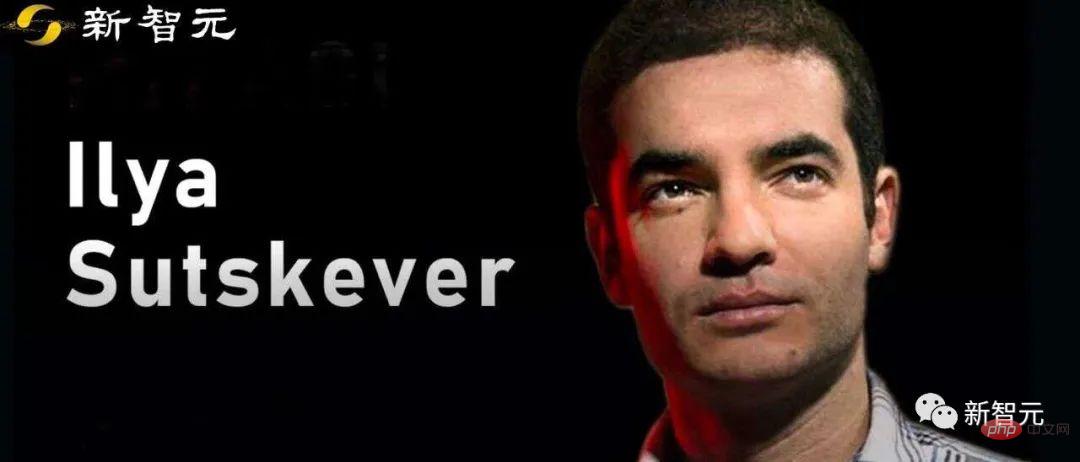

Mais le plus grand patron est le co-fondateur et scientifique en chef d'OpenAI, Ilya Sutskever, diplômé en 2005 en informatique de l'Université de Toronto en 2012.

Mais le plus grand patron est le co-fondateur et scientifique en chef d'OpenAI, Ilya Sutskever, diplômé en 2005 en informatique de l'Université de Toronto en 2012.

Depuis l'obtention de son diplôme, il a travaillé à l'Université de Stanford, DNNResearch et Google Brain, engagé dans des recherches liées à l'apprentissage automatique et à l'apprentissage profond. En 2015, il a abandonné son poste bien rémunéré chez Google et a cofondé OpenAI avec. Greg Brockman et d'autres OpenAI dirigent la recherche et le développement des modèles des séries GPT-1, 2, 3 et DALLE.

Google a encore trop peur des risques

La plupart des employés mentionnés ci-dessus ont travaillé chez Google Brain. Certains employés du département ont déclaré lors d'entretiens que la culture de travail de Google Brain était vraiment peu inspirante, la bureaucratie était inconfortable et l'entreprise était trop prudente. sur les propositions de nouveaux produits, et de nombreux employés ont pensé à partir.

De plus, certains employés se sont plaints d'avoir suggéré un jour que l'entreprise ajoute une fonction de conversation au moteur de recherche, mais personne n'y a prêté attention.

Cependant, Google Brain regorge toujours de talents, et il compte encore plus de 800 scientifiques de haut niveau du monde entier.

De plus, le fondateur d'AppSheet, Praveen Seshadri, a également publié un blog après avoir quitté Google. Il pensait que Google était piégé dans un labyrinthe et que les employés perdaient beaucoup d'énergie en approbations, en processus de démarrage, en évaluations juridiques et en évaluations de performances. , documentation, réunions, rapports de bogues, classification, OKR, plan H1, plan H2 ultérieur, sommet de tout le personnel et réorganisation, très peu de choses peuvent réellement être faites.

Surtout face à l'encerclement et à la répression par OpenAI et Microsoft, Google est non seulement confronté à des pressions techniques, mais aussi à des problèmes tels que des licenciements massifs, qui reflètent dans une certaine mesure le manque général de conscience de soi de la direction. et les employés.

Le plus gros problème réside toujours dans la culture fondamentale de Google :

- Pas de mission (pas de mission)

- Pas d'urgence (pas d'urgence)

- Révision excessive (illusions d'exception)

- Mauvaise gestion (mauvaise gestion)

Bien que deux des Les valeurs fondamentales de Google sont le « respect des utilisateurs » et le « respect des opportunités ». En pratique, ces systèmes et processus sont intentionnellement conçus pour « respecter les risques ».

L'atténuation des risques l'emporte sur tout, si tout se passe bien, le plus important est d'éviter les problèmes et de continuer à avancer avec des revenus publicitaires croissants :

- Chaque ligne de code que vous modifiez est risquée, donc beaucoup de Un processus intermédiaire pour garantir que chaque changement de code est parfaitement sans risque ;

- Tout ce qui est publié est risqué, donc beaucoup d'examen et d'approbation sont nécessaires, même s'il ne s'agit que d'un petit changement publié sur un petit produit ;

- Toute décision qui n'est pas évidente est ; un risque et doit être décidé par le groupe ;

- Toute façon de faire les choses qui est différente du passé est un risque, alors restez fidèle à la manière originale

- Tout employé qui n'est pas satisfait de vous est un risque de carrière, donc ; l'objectif des managers est de satisfaire à 100 % les employés, et ils doivent être prudents lorsqu'ils traitent avec les employés les moins performants

- Tout désaccord avec la chaîne de gestion est un risque de carrière, alors assurez-vous de vous conformer à vos supérieurs

Si ; la clé Passez à la création de valeur, et tout deviendra différent. Par exemple, demandez-vous chaque jour : « Pour qui ai-je créé de la valeur aujourd'hui ? » Si vous pouvez créer plus de valeur et avoir un plus grand impact, les employés travailleront plus dur.

Dans les premières années, Google débauchait frénétiquement les coins de grandes entreprises telles que Meta pour étendre ses propres ressources de talents dans la « guerre des talents ». Aujourd'hui, il est devenu le vivier de talents de réserve d'OpenAI.

Pas étonnant que Google ait lancé une "alerte rouge" après la popularité de ChatGPT. S'il ne prête pas attention à la protection des talents, tous les chercheurs seniors qu'il a formés seront tôt ou tard débauchés !

Référence :https://www.php.cn/link/2287c6b8641dd2d21ab050eb9ff795f3

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

1363

1363

52

52

ChatGPT permet désormais aux utilisateurs gratuits de générer des images en utilisant DALL-E 3 avec une limite quotidienne

Aug 09, 2024 pm 09:37 PM

ChatGPT permet désormais aux utilisateurs gratuits de générer des images en utilisant DALL-E 3 avec une limite quotidienne

Aug 09, 2024 pm 09:37 PM

Le DALL-E 3 a été officiellement introduit en septembre 2023 en tant que modèle considérablement amélioré par rapport à son prédécesseur. Il est considéré comme l’un des meilleurs générateurs d’images IA à ce jour, capable de créer des images avec des détails complexes. Cependant, au lancement, c'était exclu

Choisir le modèle d'intégration qui correspond le mieux à vos données : un test comparatif des intégrations multilingues OpenAI et open source

Feb 26, 2024 pm 06:10 PM

Choisir le modèle d'intégration qui correspond le mieux à vos données : un test comparatif des intégrations multilingues OpenAI et open source

Feb 26, 2024 pm 06:10 PM

OpenAI a récemment annoncé le lancement de son modèle d'intégration de dernière génération, embeddingv3, qui, selon eux, est le modèle d'intégration le plus performant avec des performances multilingues plus élevées. Ce lot de modèles est divisé en deux types : les plus petits text-embeddings-3-small et les plus puissants et plus grands text-embeddings-3-large. Peu d'informations sont divulguées sur la façon dont ces modèles sont conçus et formés, et les modèles ne sont accessibles que via des API payantes. Il existe donc de nombreux modèles d'intégration open source. Mais comment ces modèles open source se comparent-ils au modèle open source open source ? Cet article comparera empiriquement les performances de ces nouveaux modèles avec des modèles open source. Nous prévoyons de créer une donnée

Un nouveau paradigme de programmation, quand Spring Boot rencontre OpenAI

Feb 01, 2024 pm 09:18 PM

Un nouveau paradigme de programmation, quand Spring Boot rencontre OpenAI

Feb 01, 2024 pm 09:18 PM

En 2023, la technologie de l’IA est devenue un sujet brûlant et a un impact énorme sur diverses industries, notamment dans le domaine de la programmation. Les gens sont de plus en plus conscients de l’importance de la technologie de l’IA, et la communauté Spring ne fait pas exception. Avec l’évolution continue de la technologie GenAI (Intelligence Artificielle Générale), il est devenu crucial et urgent de simplifier la création d’applications dotées de fonctions d’IA. Dans ce contexte, « SpringAI » a émergé, visant à simplifier le processus de développement d'applications fonctionnelles d'IA, en le rendant simple et intuitif et en évitant une complexité inutile. Grâce à « SpringAI », les développeurs peuvent plus facilement créer des applications dotées de fonctions d'IA, ce qui les rend plus faciles à utiliser et à exploiter.

Comment installer chatgpt sur un téléphone mobile

Mar 05, 2024 pm 02:31 PM

Comment installer chatgpt sur un téléphone mobile

Mar 05, 2024 pm 02:31 PM

Étapes d'installation : 1. Téléchargez le logiciel ChatGTP depuis le site officiel ou la boutique mobile de ChatGTP ; 2. Après l'avoir ouvert, dans l'interface des paramètres, sélectionnez la langue chinoise 3. Dans l'interface de jeu, sélectionnez le jeu homme-machine et définissez la langue. Spectre chinois ; 4. Après avoir démarré, entrez les commandes dans la fenêtre de discussion pour interagir avec le logiciel.

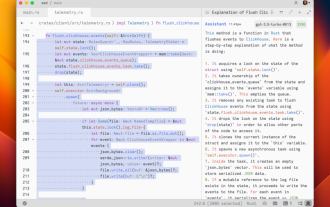

L'éditeur Zed basé sur Rust est open source, avec prise en charge intégrée d'OpenAI et GitHub Copilot

Feb 01, 2024 pm 02:51 PM

L'éditeur Zed basé sur Rust est open source, avec prise en charge intégrée d'OpenAI et GitHub Copilot

Feb 01, 2024 pm 02:51 PM

Auteur丨Compilé par TimAnderson丨Produit par Noah|51CTO Technology Stack (WeChat ID : blog51cto) Le projet d'éditeur Zed est encore en phase de pré-version et a été open source sous licences AGPL, GPL et Apache. L'éditeur offre des performances élevées et plusieurs options assistées par l'IA, mais n'est actuellement disponible que sur la plate-forme Mac. Nathan Sobo a expliqué dans un article que dans la base de code du projet Zed sur GitHub, la partie éditeur est sous licence GPL, les composants côté serveur sont sous licence AGPL et la partie GPUI (GPU Accelerated User) l'interface) adopte la Licence Apache2.0. GPUI est un produit développé par l'équipe Zed

Travail posthume de l'équipe OpenAI Super Alignment : deux grands modèles jouent à un jeu et le résultat devient plus compréhensible

Jul 19, 2024 am 01:29 AM

Travail posthume de l'équipe OpenAI Super Alignment : deux grands modèles jouent à un jeu et le résultat devient plus compréhensible

Jul 19, 2024 am 01:29 AM

Si la réponse donnée par le modèle d’IA est incompréhensible du tout, oseriez-vous l’utiliser ? À mesure que les systèmes d’apprentissage automatique sont utilisés dans des domaines de plus en plus importants, il devient de plus en plus important de démontrer pourquoi nous pouvons faire confiance à leurs résultats, et quand ne pas leur faire confiance. Une façon possible de gagner confiance dans le résultat d'un système complexe est d'exiger que le système produise une interprétation de son résultat qui soit lisible par un humain ou un autre système de confiance, c'est-à-dire entièrement compréhensible au point que toute erreur possible puisse être trouvé. Par exemple, pour renforcer la confiance dans le système judiciaire, nous exigeons que les tribunaux fournissent des avis écrits clairs et lisibles qui expliquent et soutiennent leurs décisions. Pour les grands modèles de langage, nous pouvons également adopter une approche similaire. Cependant, lorsque vous adoptez cette approche, assurez-vous que le modèle de langage génère

N'attendez pas OpenAI, attendez qu'Open-Sora soit entièrement open source

Mar 18, 2024 pm 08:40 PM

N'attendez pas OpenAI, attendez qu'Open-Sora soit entièrement open source

Mar 18, 2024 pm 08:40 PM

Il n'y a pas si longtemps, OpenAISora est rapidement devenu populaire grâce à ses étonnants effets de génération vidéo. Il s'est démarqué parmi la foule de modèles vidéo littéraires et est devenu le centre d'attention mondiale. Suite au lancement du processus de reproduction d'inférence de formation Sora avec une réduction des coûts de 46 % il y a 2 semaines, l'équipe Colossal-AI a entièrement open source le premier modèle de génération vidéo d'architecture de type Sora au monde "Open-Sora1.0", couvrant l'ensemble processus de formation, y compris le traitement des données, tous les détails de la formation et les poids des modèles, et joignez-vous aux passionnés mondiaux de l'IA pour promouvoir une nouvelle ère de création vidéo. Pour un aperçu, jetons un œil à une vidéo d'une ville animée générée par le modèle « Open-Sora1.0 » publié par l'équipe Colossal-AI. Ouvrir-Sora1.0

Les performances d'exécution locale du service Embedding dépassent celles d'OpenAI Text-Embedding-Ada-002, ce qui est très pratique !

Apr 15, 2024 am 09:01 AM

Les performances d'exécution locale du service Embedding dépassent celles d'OpenAI Text-Embedding-Ada-002, ce qui est très pratique !

Apr 15, 2024 am 09:01 AM

Ollama est un outil super pratique qui vous permet d'exécuter facilement des modèles open source tels que Llama2, Mistral et Gemma localement. Dans cet article, je vais vous présenter comment utiliser Ollama pour vectoriser du texte. Si vous n'avez pas installé Ollama localement, vous pouvez lire cet article. Dans cet article, nous utiliserons le modèle nomic-embed-text[2]. Il s'agit d'un encodeur de texte qui surpasse OpenAI text-embedding-ada-002 et text-embedding-3-small sur les tâches à contexte court et à contexte long. Démarrez le service nomic-embed-text lorsque vous avez installé avec succès o