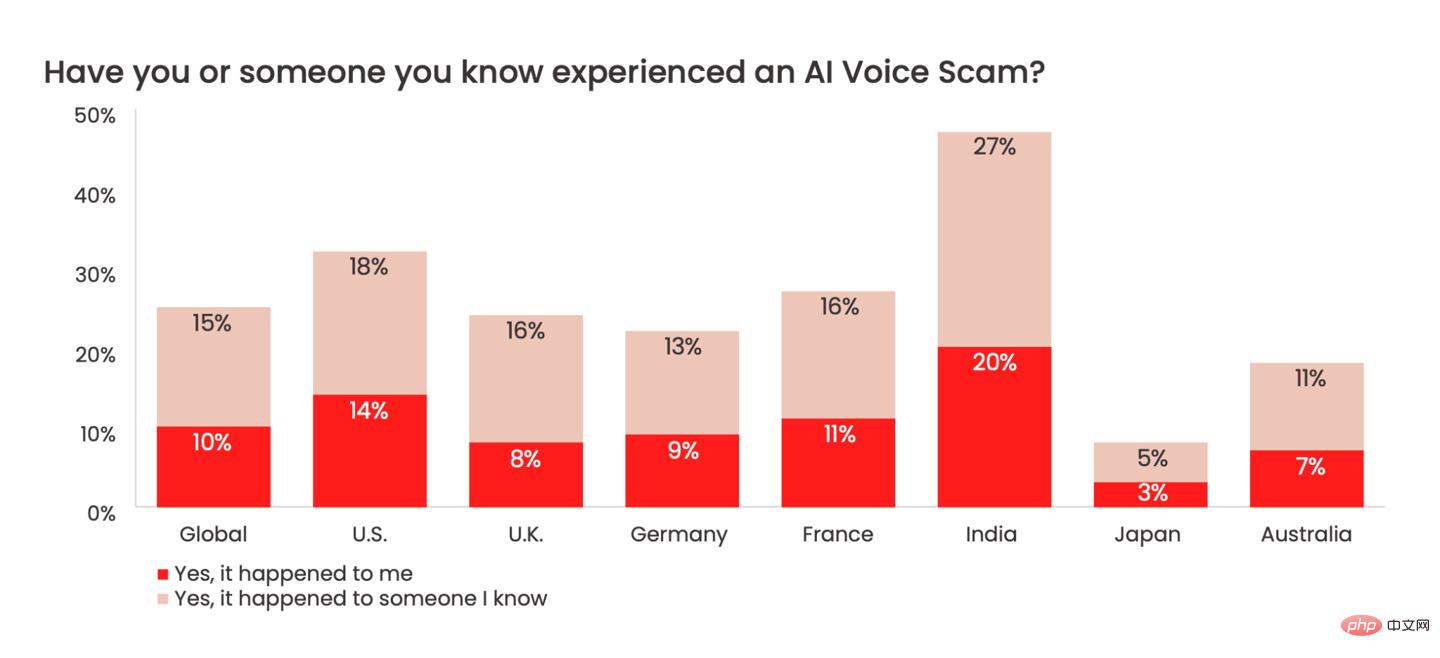

Selon le dernier rapport publié par McAfee, la fraude vocale basée sur l'intelligence artificielle (IA) est de plus en plus répandue. Parmi ceux qui reçoivent des appels frauduleux, 77 % en seront la cause. pertes économiques.

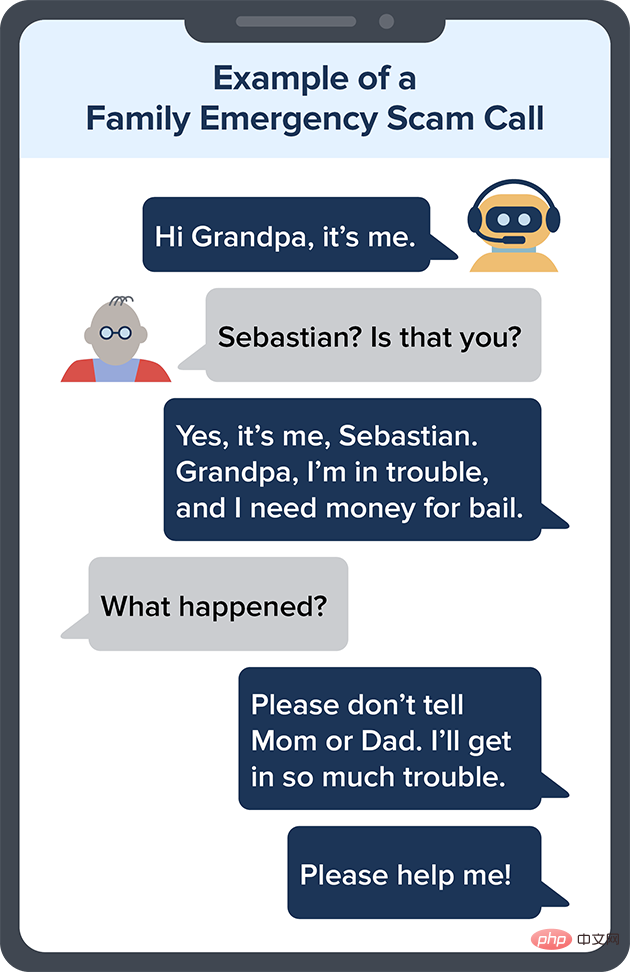

Le rapport mentionnait deux cas réels, dont l'un utilisait l'IA pour simuler les proches de la victime et exprimait qu'ils avaient un besoin urgent d'argent pour quelque chose ; AI simule une fille et extorque une rançon à sa mère, mais en réalité sa fille n'a pas été kidnappée.

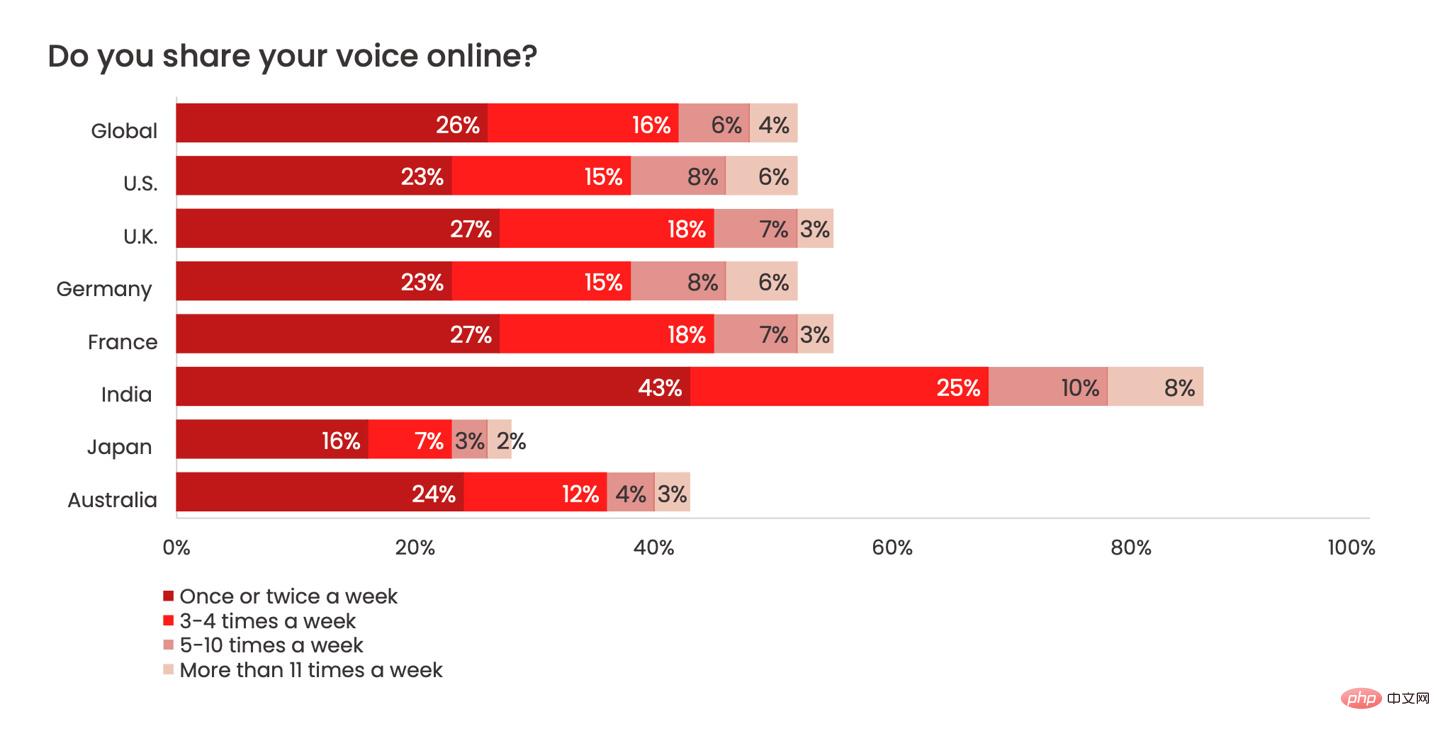

Les outils de clonage vocal de l'IA étant si bon marché et disponibles, les parties malveillantes peuvent créer des clones vocaux rapidement et facilement. La façon dont ils obtiennent des échantillons audio provient de personnes partageant leurs voix sur les réseaux sociaux. Plus vous partagez votre voix en ligne, plus il est facile pour les acteurs malveillants de trouver et de cloner votre voix.

Le contenu du rapport ci-joint est le suivant :

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Quels sont les espaces sans inscription en Chine ?

Quels sont les espaces sans inscription en Chine ?

Le rôle du mode Ne pas déranger d'Apple

Le rôle du mode Ne pas déranger d'Apple

La différence entre l'API de repos et l'API

La différence entre l'API de repos et l'API

que signifie Facebook

que signifie Facebook

Pourquoi ne puis-je pas voir les visiteurs sur mon TikTok

Pourquoi ne puis-je pas voir les visiteurs sur mon TikTok

Utilisation de la fonction exit en langage C

Utilisation de la fonction exit en langage C

Comment vérifier la mémoire vidéo de Win11

Comment vérifier la mémoire vidéo de Win11

Raisons pour lesquelles les ordinateurs ont souvent des écrans bleus

Raisons pour lesquelles les ordinateurs ont souvent des écrans bleus