développement back-end

développement back-end

Tutoriel Python

Tutoriel Python

Comment créer un jeu visuel de hockey sur table en utilisant Python

Comment créer un jeu visuel de hockey sur table en utilisant Python

Comment créer un jeu visuel de hockey sur table en utilisant Python

Introduction

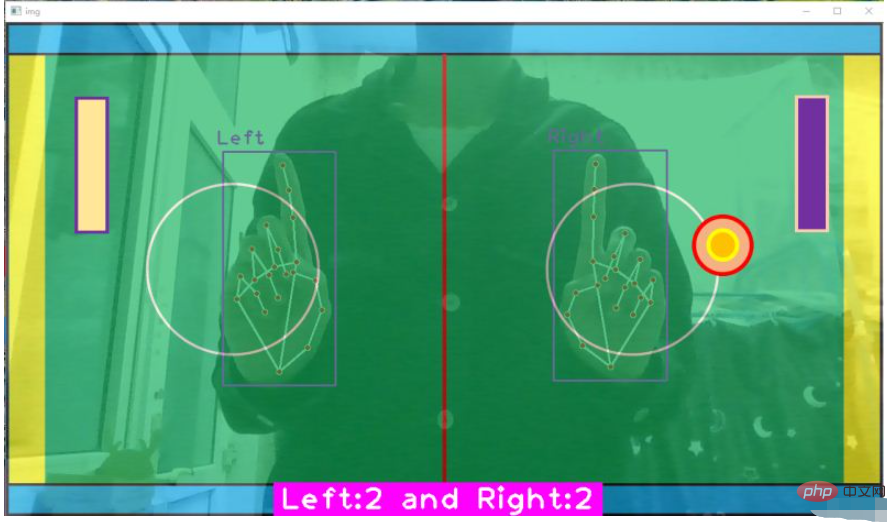

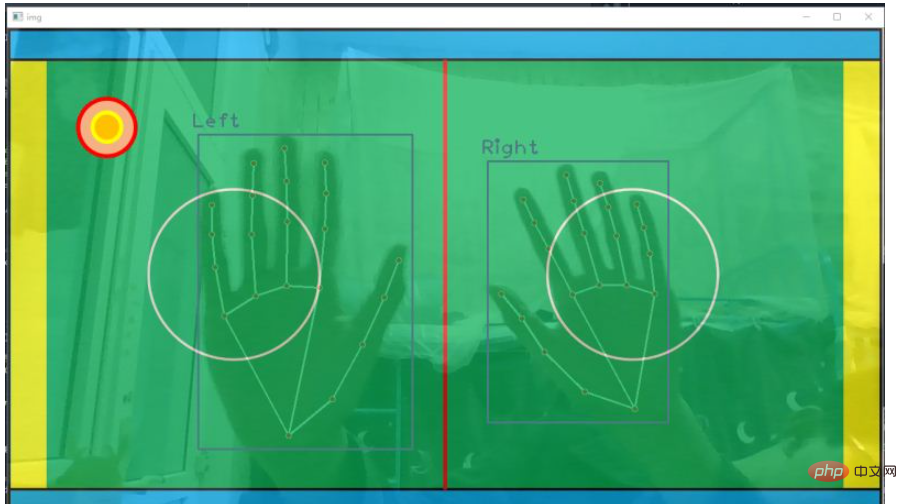

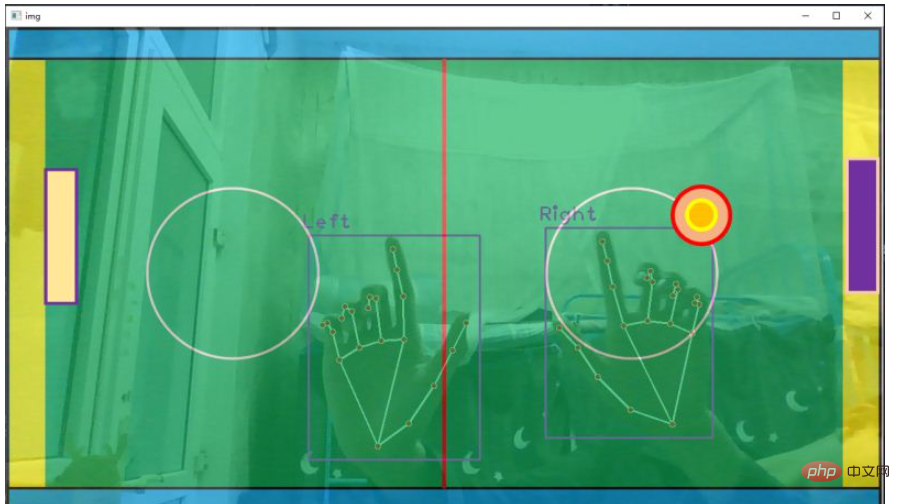

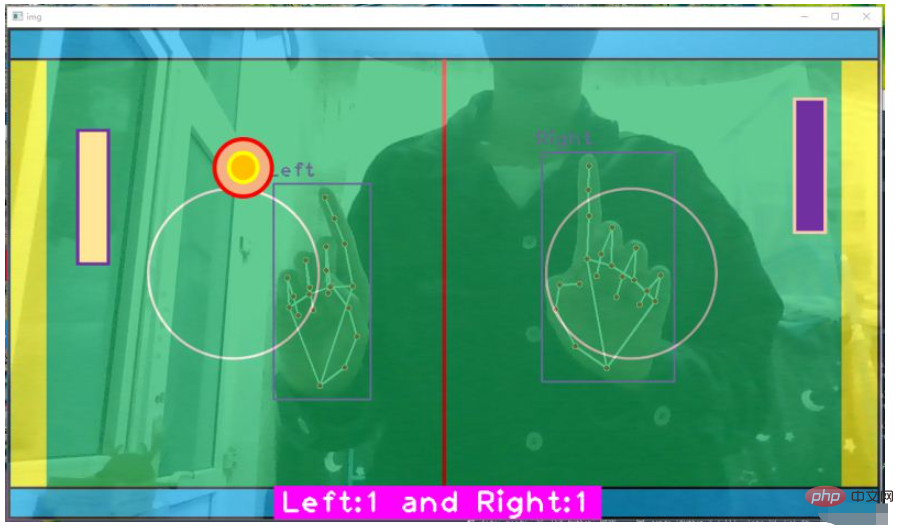

Les règles sont les suivantes : la main gauche contrôle la raquette blanche ; la main droite contrôle la raquette violette ; la raquette ne peut que monter et descendre ; le cercle rouge est la boule de glace qui entre en collision avec les bordures bleues ; sur les côtés supérieur et inférieur, et les raquettes des deux côtés rebondiront ; si la balle entre dans la zone jaune et que le jeu se termine ; le tableau de comptage rose ci-dessous enregistre le nombre de fois où chaque balle est frappée sur les côtés gauche et droit.

1. Configuration des fichiers

1.1 Boîte à outils d'importation

pip install opencv_python==4.2.0.34 # 安装opencv pip install mediapipe # 安装mediapipe # pip install mediapipe --user #有user报错的话试试这个 pip install cvzone # 安装cvzone # 导入工具包 import cv2 import cvzone from cvzone.HandTrackingModule import HandDetector # 导入手部检测模块

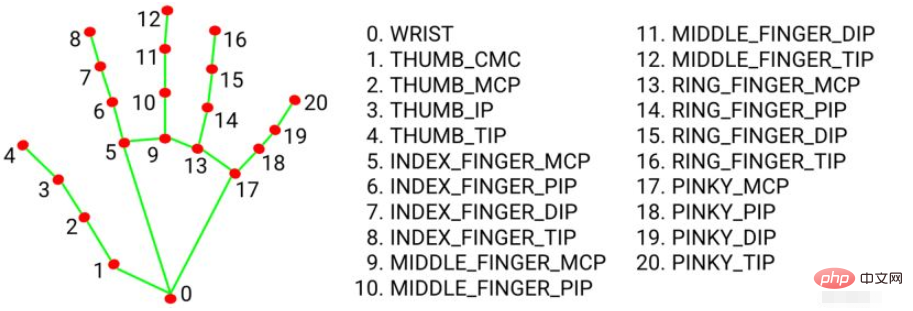

Les coordonnées des 21 points clés de la main sont les suivantes :

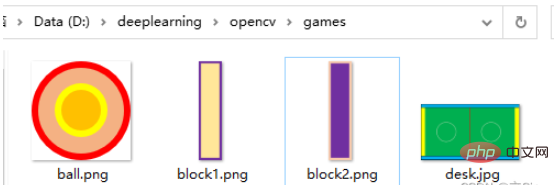

1.2 Préparation de l'image matérielle

Avant de commencer, préparez l'image du tableau et la balle. Des photos, des photos de raquettes. J'ai dessiné l'image en utilisant PPT, et les images de la balle et de la raquette doivent être enregistrées au format .png. Placez-le dans le même dossier pour une lecture facile.

2. Détection des points clés de la main et importation de matériel

2.1 Introduction à la méthode

(1) cvzone.HandTrackingModule.HandDetector()Méthode de détection des points clés de la mainvzone.HandTrackingModule.HandDetector()手部关键点检测方法

参数:

mode: 默认为 False,将输入图像视为视频流。它将尝试在第一个输入图像中检测手,并在成功检测后进一步定位手的坐标。在随后的图像中,一旦检测到所有 maxHands 手并定位了相应的手的坐标,它就会跟踪这些坐标,而不会调用另一个检测,直到它失去对任何一只手的跟踪。这减少了延迟,非常适合处理视频帧。如果设置为 True,则在每个输入图像上运行手部检测,用于处理一批静态的、可能不相关的图像。

maxHands: 最多检测几只手,默认为 2

detectionCon: 手部检测模型的最小置信值(0-1之间),超过阈值则检测成功。默认为 0.5

minTrackingCon: 坐标跟踪模型的最小置信值 (0-1之间),用于将手部坐标视为成功跟踪,不成功则在下一个输入图像上自动调用手部检测。将其设置为更高的值可以提高解决方案的稳健性,但代价是更高的延迟。如果 mode 为 True,则忽略这个参数,手部检测将在每个图像上运行。默认为 0.5

它的参数和返回值类似于官方函数 mediapipe.solutions.hands.Hands()

MULTI_HAND_LANDMARKS: 被检测/跟踪的手的集合,其中每只手被表示为21个手部地标的列表,每个地标由x, y, z组成。

MULTI_HANDEDNESS: 被检测/追踪的手是左手还是右手的集合。每只手由label(标签)和score(分数)组成。 label 是 'Left' 或 'Right' 值的字符串。 score 是预测左右手的估计概率。

(2)cvzone.HandTrackingModule.HandDetector.findHands() 找到手部关键点并绘图

参数:

img: 需要检测关键点的帧图像,格式为BGR

draw: 是否需要在原图像上绘制关键点及识别框

flipType: 图像是否需要翻转,当视频图像和我们自己不是镜像关系时,设为True就可以了

返回值:

hands: 检测到的手部信息,由0或1或2个字典组成的列表。如果检测到两只手就是由两个字典组成的列表。字典中包含:21个关键点坐标(x,y,z),检测框左上坐标及其宽高,检测框中心点坐标,检测出是哪一只手。

img: 返回绘制了关键点及连线后的图像

(3)cv2.addWeighted()

MULTI_HAND_LANDMARKS : Une collection de mains détectées/suivies, où chaque main est représentée sous la forme d'une liste de 21 points de repère, chaque point de repère se compose de x, y, z.

MULTI_HAND_LANDMARKS : Une collection de mains détectées/suivies, où chaque main est représentée sous la forme d'une liste de 21 points de repère, chaque point de repère se compose de x, y, z.

MULTI_HANDEDNESS : indique si la main détectée/suivie est gauche ou droite. Chaque main se compose d'une étiquette et d'un score. label est une chaîne avec une valeur « Gauche » ou « Droite ». le score est la probabilité estimée de prédire la main gauche ou droite.

(2) cvzone.HandTrackingModule.HandDetector.findHands() Trouvez les points clés de la main et dessinez

Paramètres :

.

Valeur de retour :hands : informations sur la main détectée, une liste de 0, 1 ou 2 dictionnaires. Si deux mains sont détectées, il s'agit d'une liste composée de deux dictionnaires. Le dictionnaire contient : 21 coordonnées de points clés (x, y, z), la coordonnée supérieure gauche du cadre de détection ainsi que sa largeur et sa hauteur, les coordonnées du point central du cadre de détection et quelle main est détectée.

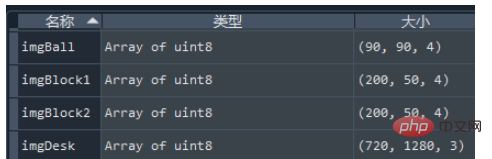

img : Renvoie l'image avec les points clés et les connexions dessinées🎜🎜(3)cv2.addWeighted()Fusion d'images🎜🎜Fusionner les deux images ensemble selon un certain ratio, deux images sont nécessaires. la taille de l'image et le nombre de canaux sont les mêmes🎜🎜Les deux images sont fusionnées selon un certain rapport : cv2.addWeighted (image 1, poids 1, image 2, poids 2, décalage de luminosité)🎜🎜équivalent à y = a x1 + b x2 + c , où a et b représentent le poids, et c représente le degré d'éclaircissement de la luminosité🎜🎜2.2 Affichage du code🎜🎜Tout d'abord, le paramètre cv2.IMREAD_UNCHANGED dans cv2.imread() fait référence à l'ouverture du image dans son format original, y compris le canal Alpha. Autrement dit, ouvrez l'image sans la modifier. Si l'image est en couleur, alors elle sera lue en couleur. Si l'image est en niveaux de gris, alors elle sera lue en niveaux de gris. La forme de l'image lue est la suivante : 🎜 🎜🎜🎜🎜Cette partie du code est principalement responsable de l'écriture manuscrite, de la détection partielle des points clés, de la fusion de l'image d'arrière-plan et de l'image de l'image vidéo🎜import cv2

import cvzone

from cvzone.HandTrackingModule import HandDetector # 导入手部检测模块

#(1)捕获摄像头

cap = cv2.VideoCapture(0) # 0代表电脑自带的摄像头

cap.set(3, 1280) # 读入的图像的宽

cap.set(4, 720) # 读入的图像的高

#(2)文件配置

# 导入所有需要对图片文件

imgDesk = cv2.imread('games/desk.jpg') # 球桌的图片

imgBall = cv2.imread('games/ball.png', cv2.IMREAD_UNCHANGED) # 球的图片

imgBlock1 = cv2.imread('games/block1', cv2.IMREAD_UNCHANGED) # 球拍的图片

imgBlock2 = cv2.imread('games/block2', cv2.IMREAD_UNCHANGED) # 球拍的图片

# 调整球桌图片的size

imgDesk = cv2.resize(imgDesk, dsize=(1280,720))

#(3)参数设置

# 接收手部关键点识别的方法,最小手部检测模块置信度0.8,最多检测2只手

detector = HandDetector(detectionCon=0.8, maxHands=2)

#(4)处理帧图像

while True:

# 返回是否读取成功,以及读取后的帧图像

success, img = cap.read() # 每次执行读取一帧

# 图片翻转呈镜像关系,1代表左右翻转,0代表上下翻转

img = cv2.flip(img, flipCode=1)

# 手部关键点检测,返回每个只手的信息和绘制后的图像

hands, img = detector.findHands(img, flipType=False) # 上面翻转过了这里就不用翻转了

# 将球桌图片和视频帧图像融合在一起, 两张图的shape要相同

# 给出每张图片的融合权重, 亮度偏置为0,这样就变成了半透明的显示形式

img = cv2.addWeighted(img, 0.3, imgDesk, 0.7, 0)

#(5)添加桌球的图片,将imgBall放在球桌img的指定坐标位置

img = cvzone.overlayPNG(img, imgBall, (100,100))

# 图像展示

cv2.imshow('img', img)

# 每帧滞留1ms后消失

k = cv2.waitKey(1)

# ESC键退出程序

if k & 0XFF==27:

break

# 释放视频资源

cap.release()

cv2.destroyAllWindows()hand['bbox'] 中包含了手部检测框的左上角坐标和检测框的宽高,使用手掌中心点的 y 坐标来控制球拍的上下移动。由于两个球拍的shape是相同的,因此只要获取一个球拍的高度 h2 即可。使用掌心中点 y 坐标控制球拍中点的 y1 坐标,公式为:y1 = (y + h) // 2 - h2 // 2

接着使用 cvzone.overlayPNG() 就可以将球拍图片覆盖在原图片的指定区域,其中坐标参数是指覆盖区域的左上角坐标。固定横坐标,只上下移动。

(2)球移动

首先要规定球的移动速度 speedx, speedy = 10, 10 代表球每一帧沿x轴正方向移动10个像素,沿y轴正方向移动10个像素,那么球的初始合速度方向是沿图片的正右下角移动

如果球碰撞到了球桌的上下边框,就反弹。speedy = -speedy。代表x方向每帧移动的步长不变,y方向每帧移动的方向反转,即入射角等于出射角。

3.2 代码展示

在上述代码中补充

import cv2

import cvzone

import numpy as np

from cvzone.HandTrackingModule import HandDetector # 导入手部检测模块

#(1)捕获摄像头

cap = cv2.VideoCapture(0) # 0代表电脑自带的摄像头

cap.set(3, 1280) # 读入的图像的宽

cap.set(4, 720) # 读入的图像的高

#(2)文件配置

# 导入所有需要对图片文件

imgDesk = cv2.imread('games/desk.jpg') # 球桌的图片

imgBall = cv2.imread('games/ball.png', cv2.IMREAD_UNCHANGED) # 球的图片

imgBlock1 = cv2.imread('games/block1.png', cv2.IMREAD_UNCHANGED) # 球拍的图片

imgBlock2 = cv2.imread('games/block2.png', cv2.IMREAD_UNCHANGED) # 球拍的图片

# 调整球桌图片的size

imgDesk = cv2.resize(imgDesk, dsize=(1280,720))

# 调整球拍的size

imgBlock1 = cv2.resize(imgBlock1, dsize=(50,200))

imgBlock2 = cv2.resize(imgBlock2, dsize=(50,200))

#(3)参数设置

# 接收手部关键点识别的方法,最小手部检测模块置信度0.8,最多检测2只手

detector = HandDetector(detectionCon=0.8, maxHands=2)

# 球的默认位置

ballpos = [100, 100]

# 球的移动速度,每帧15个像素

speedx, speedy = 10, 10

#(4)处理帧图像

while True:

# 返回是否读取成功,以及读取后的帧图像

success, img = cap.read() # 每次执行读取一帧

# 图片翻转呈镜像关系,1代表左右翻转,0代表上下翻转

img = cv2.flip(img, flipCode=1)

# 手部关键点检测,返回每个只手的信息和绘制后的图像

hands, img = detector.findHands(img, flipType=False) # 上面翻转过了这里就不用翻转了

# 将球桌图片和视频帧图像融合在一起, 两张图的shape要相同

# 给出每张图片的融合权重, 亮度偏置为0,这样就变成了半透明的显示形式

img = cv2.addWeighted(img, 0.4, imgDesk, 0.6, 0)

#(5)处理手部关键点,如果检测到手了就进行下一步

if hands:

# 遍历每检测的2只手,获取每一只手的坐标

for hand in hands:

# 获取手部检测框的左上坐标xy,宽高wh

x, y, w, h = hand['bbox']

# 获取球拍的宽高

h2, w1 = imgBlock1.shape[0:2]

# 球拍的中心y坐标,随着掌心移动

y1 = (y + h) // 2 - h2 // 2

# 如果检测到了左手

if hand['type'] == 'Left':

# 左侧的球拍x轴固定,y坐标随左手掌间中点移动

img = cvzone.overlayPNG(img, imgBlock1, (55,y1))

# 如果检测到了右手

if hand['type'] == 'Right':

# 右侧的球拍x轴固定,y坐标随右手掌间中点移动

img = cvzone.overlayPNG(img, imgBlock2, (1280-55,y1))

#(6)改变球的位置

# 如果球的y坐标在超出了桌面的上或下边框范围,调整移动方向

if ballpos[1] >= 600 or ballpos[1] <= 50:

# y方向的速度调整为反方向,那么x方向和y方向的合速度方向调整了

speedy = -speedy

ballpos[0] = ballpos[0] + speedx # 调整球的x坐标

ballpos[1] = ballpos[1] + speedy # 调整球的y坐标

#(5)添加桌球的图片,将imgBall放在球桌img的指定坐标位置

img = cvzone.overlayPNG(img, imgBall, ballpos)

# 图像展示

cv2.imshow('img', img)

# 每帧滞留1ms后消失

k = cv2.waitKey(1)

# ESC键退出程序

if k & 0XFF==27:

break

# 释放视频资源

cap.release()

cv2.destroyAllWindows()效果图如下:

4. 球拍击球、游戏完善

4.1 方法介绍

这一部分主要完成三项工作,第一是球拍击打到球,球需要反弹;第二是如果球进入黄色区域,游戏结束;第三是左右侧击球得分计数器。

(1)球拍击球

看到代码中的第(5)步,ballpos 代表球的左上角坐标(x,y),100 < ballpos[0] < 100+w1 代表球到了球拍横坐标区域范围内部了,y1 < ballpos[1] < y1+h2 代表球的y坐标在球拍y坐标内部,这时表明击球成功,speedx = -speedx 只改变沿x轴的速度方向,不改变沿y轴的速度方向。

(2)球进黄区,游戏结束

if ballpos[0] < 50 or ballpos[0] > 1150,如果球图片的左上坐标的 x 坐标,在黄区边缘,整个程序退出。当然也可以做一个游戏结束界面,我之前的博文里也有介绍,我偷个懒不写了。

(3)计数器

首先定义个变量初始化记录左右侧的击球次数 score = [0, 0],如果有一侧的球拍击中球,那么对应该侧计数加一。

4.2 代码展示

上面代码是掌心控制球拍,这里改成食指指尖控制球拍中点移动。

import cv2

import cvzone

from cvzone.HandTrackingModule import HandDetector # 导入手部检测模块

#(1)捕获摄像头

cap = cv2.VideoCapture(0) # 0代表电脑自带的摄像头

cap.set(3, 1280) # 读入的图像的宽

cap.set(4, 720) # 读入的图像的高

#(2)文件配置

# 导入所有需要对图片文件

imgDesk = cv2.imread('games/desk.jpg') # 球桌的图片

imgBall = cv2.imread('games/ball.png', cv2.IMREAD_UNCHANGED) # 球的图片

imgBlock1 = cv2.imread('games/block1.png', cv2.IMREAD_UNCHANGED) # 球拍的图片

imgBlock2 = cv2.imread('games/block2.png', cv2.IMREAD_UNCHANGED) # 球拍的图片

# 调整球桌图片的size

imgDesk = cv2.resize(imgDesk, dsize=(1280,720))

# 调整球拍的size

imgBlock1 = cv2.resize(imgBlock1, dsize=(50,200))

imgBlock2 = cv2.resize(imgBlock2, dsize=(50,200))

#(3)参数设置

# 接收手部关键点识别的方法,最小手部检测模块置信度0.8,最多检测2只手

detector = HandDetector(detectionCon=0.8, maxHands=2)

# 球的默认位置

ballpos = [100, 100]

# 球的移动速度,每帧15个像素

speedx, speedy = 10, 10

# 记录是否游戏结束

gameover = False

# 记录左右的击球数

score = [0, 0]

#(4)处理帧图像

while True:

# 返回是否读取成功,以及读取后的帧图像

success, img = cap.read() # 每次执行读取一帧

# 图片翻转呈镜像关系,1代表左右翻转,0代表上下翻转

img = cv2.flip(img, flipCode=1)

# 手部关键点检测,返回每个只手的信息和绘制后的图像

hands, img = detector.findHands(img, flipType=False) # 上面翻转过了这里就不用翻转了

# 将球桌图片和视频帧图像融合在一起, 两张图的shape要相同

# 给出每张图片的融合权重, 亮度偏置为0,这样就变成了半透明的显示形式

img = cv2.addWeighted(img, 0.4, imgDesk, 0.6, 0)

#(5)处理手部关键点,如果检测到手了就进行下一步

if hands:

# 遍历每检测的2只手,获取每一只手的坐标

for hand in hands:

# 获取食指坐标(x,y,z)

x, y, z = hand['lmList'][8]

# 获取球拍的宽高

h2, w1 = imgBlock1.shape[0:2]

# 球拍的中心y坐标,随着掌心移动

y1 = y - h2 // 2

# 如果检测到了左手

if hand['type'] == 'Left':

# 左侧的球拍x轴固定,y坐标随左手掌间中点移动

img = cvzone.overlayPNG(img, imgBlock1, (100,y1))

# 检查球是否被左球拍击中, 球的xy坐标是否在球拍xy坐标附近

if 100 < ballpos[0] < 100+w1 and y1 < ballpos[1] < y1+h2:

# 满足条件代表球拍击中了,改变球的移动方向

speedx = -speedx # x方向设为反方向

# 得分加一

score[0] += 1

# 如果检测到了右手

if hand['type'] == 'Right':

# 右侧的球拍x轴固定,y坐标随右手掌间中点移动

img = cvzone.overlayPNG(img, imgBlock2, (1150,y1))

# 检查球是否被右球拍击中

if 1050 < ballpos[0] < 1050+w1 and y1 < ballpos[1] < y1+h2:

# 满足条件代表球拍击中了,改变球的移动方向

speedx = -speedx # x方向设为反方向

# 得分加一

score[1] += 1

#(6)检查球是否没接到,那么游戏结束

if ballpos[0] < 50 or ballpos[0] > 1150:

gameover = True

# 游戏结束,画面就不动了

if gameover is True:

break

# 游戏没结束就接下去执行

else:

#(7)调整球的坐标

# 如果球的y坐标在超出了桌面的上或下边框范围,调整移动方向

if ballpos[1] >= 600 or ballpos[1] <= 50:

# y方向的速度调整为反方向,那么x方向和y方向的合速度方向调整了

speedy = -speedy

# 每一整都调整xy坐标

ballpos[0] = ballpos[0] + speedx # 调整球的x坐标

ballpos[1] = ballpos[1] + speedy # 调整球的y坐标

#(8)添加桌球的图片,将imgBall放在球桌img的指定坐标位置

img = cvzone.overlayPNG(img, imgBall, ballpos)

#(9)显示记分板

cvzone.putTextRect(img, f'Left:{score[0]} and Right:{score[1]}', (400,710))

#(10)图像展示

cv2.imshow('img', img)

# 每帧滞留1ms后消失

k = cv2.waitKey(1)

# ESC键退出程序

if k & 0XFF==27:

break

# 释放视频资源

cap.release()

cv2.destroyAllWindows()效果图如下:

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

Comment résoudre le problème des autorisations rencontré lors de la visualisation de la version Python dans le terminal Linux?

Apr 01, 2025 pm 05:09 PM

Comment résoudre le problème des autorisations rencontré lors de la visualisation de la version Python dans le terminal Linux?

Apr 01, 2025 pm 05:09 PM

Solution aux problèmes d'autorisation Lors de la visualisation de la version Python dans Linux Terminal Lorsque vous essayez d'afficher la version Python dans Linux Terminal, entrez Python ...

Comment copier efficacement la colonne entière d'une dataframe dans une autre dataframe avec différentes structures dans Python?

Apr 01, 2025 pm 11:15 PM

Comment copier efficacement la colonne entière d'une dataframe dans une autre dataframe avec différentes structures dans Python?

Apr 01, 2025 pm 11:15 PM

Lorsque vous utilisez la bibliothèque Pandas de Python, comment copier des colonnes entières entre deux frames de données avec différentes structures est un problème courant. Supposons que nous ayons deux dats ...

Dessin graphique de sablier Python: comment éviter les erreurs variables non définies?

Apr 01, 2025 pm 06:27 PM

Dessin graphique de sablier Python: comment éviter les erreurs variables non définies?

Apr 01, 2025 pm 06:27 PM

Précision avec Python: Source de sablier Dessin graphique et vérification d'entrée Cet article résoudra le problème de définition variable rencontré par un novice Python dans le programme de dessin graphique de sablier. Code...

Python multiplateform de bureau de bureau de bureau: quelle bibliothèque GUI est la meilleure pour vous?

Apr 01, 2025 pm 05:24 PM

Python multiplateform de bureau de bureau de bureau: quelle bibliothèque GUI est la meilleure pour vous?

Apr 01, 2025 pm 05:24 PM

Choix de la bibliothèque de développement d'applications de bureau multiplateforme Python De nombreux développeurs Python souhaitent développer des applications de bureau pouvant s'exécuter sur Windows et Linux Systems ...

Google et AWS fournissent-ils des sources publiques d'image PYPI?

Apr 01, 2025 pm 05:15 PM

Google et AWS fournissent-ils des sources publiques d'image PYPI?

Apr 01, 2025 pm 05:15 PM

De nombreux développeurs s'appuient sur PYPI (PythonPackageIndex) ...

Comment compter et trier efficacement de grands ensembles de données de produit dans Python?

Apr 01, 2025 pm 08:03 PM

Comment compter et trier efficacement de grands ensembles de données de produit dans Python?

Apr 01, 2025 pm 08:03 PM

Conversion et statistiques de données: traitement efficace des grands ensembles de données Cet article introduira en détail comment convertir une liste de données contenant des informations sur le produit en une autre contenant ...

Comment optimiser le traitement des images à haute résolution dans Python pour trouver des zones circulaires blanches précises?

Apr 01, 2025 pm 06:12 PM

Comment optimiser le traitement des images à haute résolution dans Python pour trouver des zones circulaires blanches précises?

Apr 01, 2025 pm 06:12 PM

Comment gérer les images haute résolution à Python pour trouver des zones blanches? Traitement d'une image haute résolution de 9000x7000 pixels, comment trouver avec précision deux de l'image ...

Comment résoudre le problème de l'encodage du nom de fichier lors de la connexion au serveur FTP dans Python?

Apr 01, 2025 pm 06:21 PM

Comment résoudre le problème de l'encodage du nom de fichier lors de la connexion au serveur FTP dans Python?

Apr 01, 2025 pm 06:21 PM

Lorsque vous utilisez Python pour se connecter à un serveur FTP, vous pouvez rencontrer des problèmes d'encodage lors de l'obtention de fichiers dans le répertoire spécifié et de les télécharger, en particulier du texte sur le serveur FTP ...