Périphériques technologiques

Périphériques technologiques

IA

IA

Présentation de huit solutions de grands modèles gratuites et open source car ChatGPT et Bard sont trop chers.

Présentation de huit solutions de grands modèles gratuites et open source car ChatGPT et Bard sont trop chers.

Présentation de huit solutions de grands modèles gratuites et open source car ChatGPT et Bard sont trop chers.

1.LLaMA

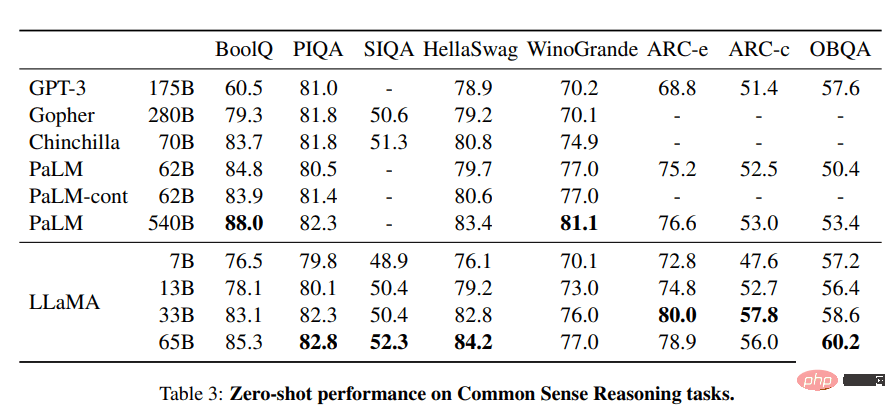

Le projet LLaMA contient un ensemble de modèles de langage de base avec des tailles allant de 7 milliards à 65 milliards de paramètres. Ces modèles sont formés sur des millions de jetons et sont entièrement formés sur des ensembles de données accessibles au public. En conséquence, le LLaMA-13B a surpassé le GPT-3 (175B), tandis que le LLaMA-65B a eu des performances similaires aux meilleurs modèles tels que le Chinchilla-70B et le PaLM-540B.

Image de LLaMA

Source :

- Document de recherche : "LLaMA : Modèles de langage de fondation ouverts et efficaces (arxiv.org)" [https://arxiv.org/abs/2302.13971]

- GitHub : facebookresearch/llama [https://github.com/facebookresearch/llama]

- Démo : Baize Lora 7B [https://huggingface.co/spaces/project-baize/Baize-7B]

2.Alpaca

Alpaca de l'Université de Stanford affirme qu'il peut rivaliser avec ChatGPT et que n'importe qui peut le copier pour moins de 600 $. Alpaca 7B est affiné à partir du modèle LLaMA 7B sur une démonstration de suivi d'instructions de 52K.

Contenu de la formation|Photos du CRFM de l'Université de Stanford

Ressources :

- Blog : CRFM de l'Université de Stanford. [https://crfm.stanford.edu/2023/03/13/alpaca.html]

- GitHub : tatsu-lab/stanford_alpaca [https://github.com/tatsu-lab/stanford_alpaca]

- Démo : Alpaga -LoRA (la démo officielle a été perdue, c'est une reproduction du modèle Alpaca) [https://huggingface.co/spaces/tloen/alpaca-lora]

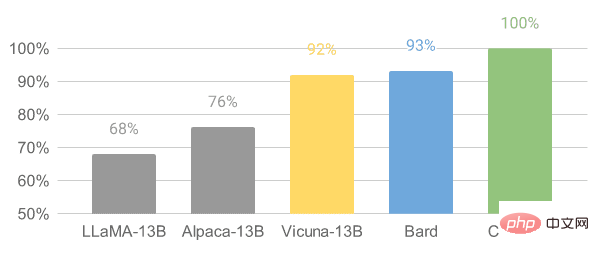

3.Vicuna

Vicuna est collectés auprès de ShareGPT Affinez le modèle LLaMA en fonction des conversations utilisateur partagées. Le modèle Vicuna-13B a atteint plus de 90 % de la qualité d'OpenAI ChatGPT et de Google Bard. Il a également surpassé les modèles LLaMA et Stanford Alpaca dans 90 % des cas. Le coût de formation d’une vigogne est d’environ 300 $.

Image de Vicuna

Source :

- Article de blog : "Vicuna : un chatbot open source impressionnant GPT-4 avec 90 %* de qualité ChatGPT" [https://vicuna.lmsys.org/]

- GitHub : lm-sys/FastChat [https://github.com/lm-sys/FastChat#fine-tuning]

- Démo : FastChat (lmsys.org) [https://chat.lmsys.org/]

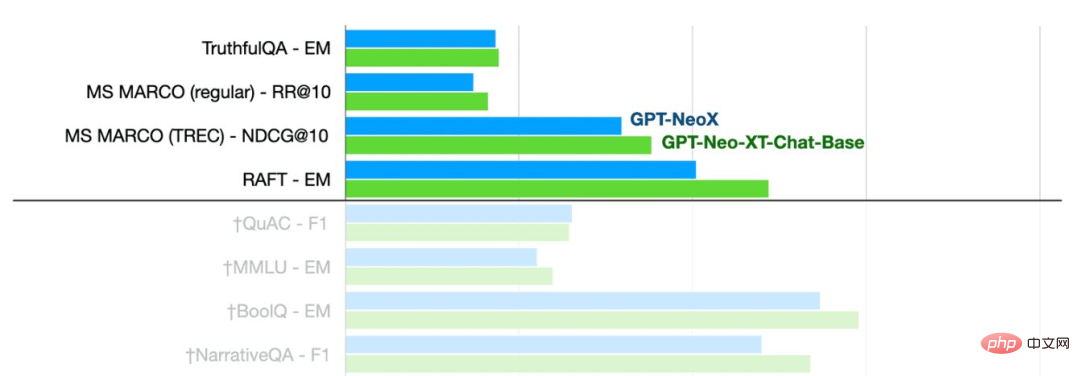

4.OpenChatKit

OpenChatKit : Alternative open source à ChatGPT, c'est une boîte à outils complète pour créer des chatbots. Il fournit de grands modèles de langage pour former les utilisateurs aux propres ajustements des instructions, des modèles affinés, un système de récupération évolutif pour mettre à jour les réponses des robots et des instructions pour filtrer l'examen des questions par les robots.

Photos de TOGETHER

On peut voir que le modèle GPT-NeoXT-Chat-Base-20B est plus performant que le modèle de base GPT-NoeX dans les tâches de questions et réponses, d'extraction et de classification.

Ressources :

- Article de blog : "Annonce d'OpenChatKit" - ENSEMBLE [https://www.together.xyz/blog/openchatkit]

- GitHub : ensemblecomputer/OpenChatKit [https://github.com/togethercomputer/OpenChatKit ]

- Démo : OpenChatKit [https://huggingface.co/spaces/togethercomputer/OpenChatKit]

- Carte modèle : Togethercomputer/GPT-NeoXT-Chat-Base-20B [https://huggingface.co/togethercomputer/GPT- NeoXT-Chat-Base-20B]

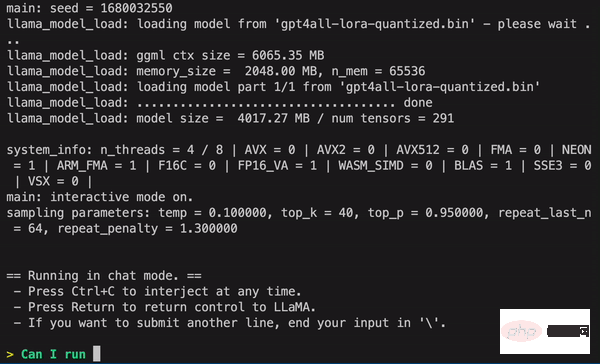

5.GPT4ALL

GPT4ALL est un projet piloté par la communauté et formé sur un corpus d'interactions auxiliaires à grande échelle, comprenant du code, des histoires, des descriptions et des dialogues à plusieurs tours. L'équipe a fourni l'ensemble de données, les pondérations du modèle, le processus de gestion des données et le code de formation pour faciliter l'open source. De plus, ils ont publié une version quantifiée 4 bits du modèle qui peut être exécutée sur un ordinateur portable. Vous pouvez même utiliser un client Python pour exécuter l'inférence de modèle.

Photos de GPT4ALL

Source :

- Rapport technique : GPT4All [https://s3.amazonaws.com/static.nomic.ai/gpt4all/2023_GPT4All_Technical_Report.pdf]

- GitHub : nomic-ai/gpt4al [https://github.com/nomic-ai /gpt4all]

- Démo : GPT4All (non officiel). [https://huggingface.co/spaces/rishiraj/GPT4All]

- Carte modèle : nomic-ai/gpt4all-lora · Hugging Face [https://huggingface.co/nomic-ai/gpt4all-lora]

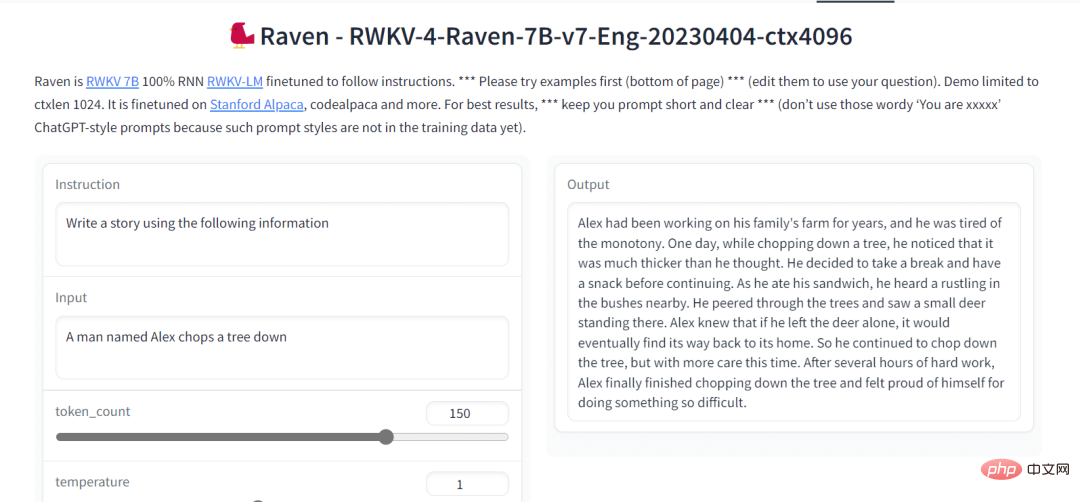

6.Raven RWKV

Raven RWKV 7B est un chatbot open source piloté par le modèle de langage RWKV et génère des résultats similaires à ChatGPT. Ce modèle utilise RNN, qui peut égaler le transformateur en termes de qualité et d'évolutivité, tout en étant plus rapide et en économisant de la VRAM. Raven est affiné sur Stanford Alpaca, code-alpaca et d'autres ensembles de données.

Image de Raven RWKV 7B

Source :

- GitHub : BlinkDL/ChatRWKV [https://github.com/BlinkDL/ChatRWKV]

- Démo : Raven RWKV 7B [https://huggingface.co /spaces/BlinkDL/Raven-RWKV-7B]

- Carte modèle : BlinkDL/rwkv-4-raven [https://huggingface.co/BlinkDL/rwkv-4-raven]

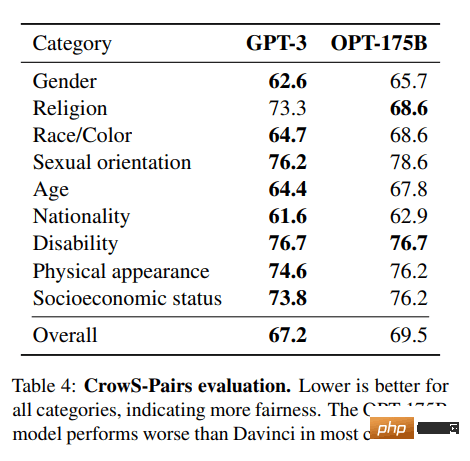

7.OPT

OPT : Le modèle de langage Open Pre-trained Transformer n'est pas aussi puissant que ChatGPT, mais il montre d'excellentes capacités en matière d'apprentissage zéro et peu de tirs et d'analyse des biais stéréotypés. Il peut également être intégré à Alpa, Colossal-AI, CTranslate2 et FasterTransformer pour de meilleurs résultats. REMARQUE : La raison pour laquelle il figure sur la liste est sa popularité, car il compte 624 710 téléchargements par mois dans la catégorie génération de texte.

Image de (arxiv.org)

Ressource :

- Document de recherche : "OPT : modèles de langage de transformateur pré-entraînés ouverts (arxiv.org)" [https://arxiv.org/abs/2205.01068 ]

- GitHub : facebookresearch/metaseq [https://github.com/facebookresearch/metaseq]

- Démo : un filigrane pour les LLM [https://huggingface.co/spaces/tomg-group-umd/lm-watermarking]

- Carte modèle : facebook/opt-1.3b [https://huggingface.co/facebook/opt-1.3b]

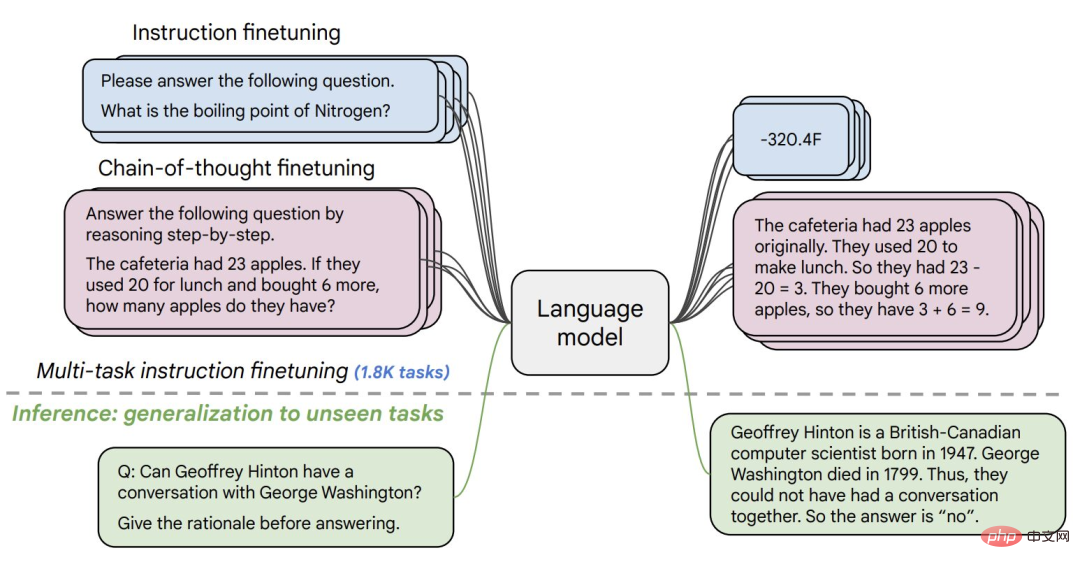

8.Flan-T5-XXL

Flan-T5-XXL Le T5 Le modèle est affiné sur l’ensemble de données exprimé sous forme d’instructions. Le réglage fin des instructions améliore considérablement les performances de diverses classes de modèles, telles que PaLM, T5 et U-PaLM. Le modèle Flan-T5-XXL est affiné sur plus de 1000 tâches supplémentaires, couvrant davantage de langues.

Image de Flan-T5-XXL

Source :

- Document de recherche : "Mise à l'échelle des modèles de langage à réglage fin" [https://arxiv.org/pdf/2210.11416.pdf]

- GitHub : google-research/t5x [https://github.com/google-research/t5x]

- Démo : Chat Llm Streaming [https://huggingface.co/spaces/olivierdehaene/chat-llm-streaming]

- Carte modèle :google/flan-t5-xxl [https://huggingface.co/google/flan-t5-xxl?text=Q%3A+%28+False+or+not+False+or+False+%29+is%3F +A%3A+Let%27s+think+step+by+step]

Résumé

Il existe de nombreux grands modèles open source parmi lesquels choisir.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Dix outils d'annotation de texte gratuits open source recommandés

Mar 26, 2024 pm 08:20 PM

Dix outils d'annotation de texte gratuits open source recommandés

Mar 26, 2024 pm 08:20 PM

L'annotation de texte est le travail d'étiquettes ou de balises correspondant à un contenu spécifique dans le texte. Son objectif principal est d’apporter des informations complémentaires au texte pour une analyse et un traitement plus approfondis, notamment dans le domaine de l’intelligence artificielle. L'annotation de texte est cruciale pour les tâches d'apprentissage automatique supervisées dans les applications d'intelligence artificielle. Il est utilisé pour entraîner des modèles d'IA afin de mieux comprendre les informations textuelles en langage naturel et d'améliorer les performances de tâches telles que la classification de texte, l'analyse des sentiments et la traduction linguistique. Grâce à l'annotation de texte, nous pouvons apprendre aux modèles d'IA à reconnaître les entités dans le texte, à comprendre le contexte et à faire des prédictions précises lorsque de nouvelles données similaires apparaissent. Cet article recommande principalement de meilleurs outils d'annotation de texte open source. 1.LabelStudiohttps://github.com/Hu

ChatGPT permet désormais aux utilisateurs gratuits de générer des images en utilisant DALL-E 3 avec une limite quotidienne

Aug 09, 2024 pm 09:37 PM

ChatGPT permet désormais aux utilisateurs gratuits de générer des images en utilisant DALL-E 3 avec une limite quotidienne

Aug 09, 2024 pm 09:37 PM

Le DALL-E 3 a été officiellement introduit en septembre 2023 en tant que modèle considérablement amélioré par rapport à son prédécesseur. Il est considéré comme l’un des meilleurs générateurs d’images IA à ce jour, capable de créer des images avec des détails complexes. Cependant, au lancement, c'était exclu

15 outils d'annotation d'images gratuits open source recommandés

Mar 28, 2024 pm 01:21 PM

15 outils d'annotation d'images gratuits open source recommandés

Mar 28, 2024 pm 01:21 PM

L'annotation d'images est le processus consistant à associer des étiquettes ou des informations descriptives à des images pour donner une signification et une explication plus profondes au contenu de l'image. Ce processus est essentiel à l’apprentissage automatique, qui permet d’entraîner les modèles de vision à identifier plus précisément les éléments individuels des images. En ajoutant des annotations aux images, l'ordinateur peut comprendre la sémantique et le contexte derrière les images, améliorant ainsi la capacité de comprendre et d'analyser le contenu de l'image. L'annotation d'images a un large éventail d'applications, couvrant de nombreux domaines, tels que la vision par ordinateur, le traitement du langage naturel et les modèles de vision graphique. Elle a un large éventail d'applications, telles que l'assistance aux véhicules pour identifier les obstacles sur la route, en aidant à la détection. et le diagnostic des maladies grâce à la reconnaissance d'images médicales. Cet article recommande principalement de meilleurs outils d'annotation d'images open source et gratuits. 1.Makesens

Recommandé : Excellent projet de détection et de reconnaissance des visages open source JS

Apr 03, 2024 am 11:55 AM

Recommandé : Excellent projet de détection et de reconnaissance des visages open source JS

Apr 03, 2024 am 11:55 AM

La technologie de détection et de reconnaissance des visages est déjà une technologie relativement mature et largement utilisée. Actuellement, le langage d'application Internet le plus utilisé est JS. La mise en œuvre de la détection et de la reconnaissance faciale sur le front-end Web présente des avantages et des inconvénients par rapport à la reconnaissance faciale back-end. Les avantages incluent la réduction de l'interaction réseau et de la reconnaissance en temps réel, ce qui réduit considérablement le temps d'attente des utilisateurs et améliore l'expérience utilisateur. Les inconvénients sont les suivants : il est limité par la taille du modèle et la précision est également limitée ; Comment utiliser js pour implémenter la détection de visage sur le web ? Afin de mettre en œuvre la reconnaissance faciale sur le Web, vous devez être familier avec les langages et technologies de programmation associés, tels que JavaScript, HTML, CSS, WebRTC, etc. Dans le même temps, vous devez également maîtriser les technologies pertinentes de vision par ordinateur et d’intelligence artificielle. Il convient de noter qu'en raison de la conception du côté Web

Le document multimodal Alibaba 7B comprenant le grand modèle remporte le nouveau SOTA

Apr 02, 2024 am 11:31 AM

Le document multimodal Alibaba 7B comprenant le grand modèle remporte le nouveau SOTA

Apr 02, 2024 am 11:31 AM

Nouveau SOTA pour des capacités de compréhension de documents multimodaux ! L'équipe Alibaba mPLUG a publié le dernier travail open source mPLUG-DocOwl1.5, qui propose une série de solutions pour relever les quatre défis majeurs que sont la reconnaissance de texte d'image haute résolution, la compréhension générale de la structure des documents, le suivi des instructions et l'introduction de connaissances externes. Sans plus tarder, examinons d’abord les effets. Reconnaissance et conversion en un clic de graphiques aux structures complexes au format Markdown : Des graphiques de différents styles sont disponibles : Une reconnaissance et un positionnement de texte plus détaillés peuvent également être facilement traités : Des explications détaillées sur la compréhension du document peuvent également être données : Vous savez, « Compréhension du document " est actuellement un scénario important pour la mise en œuvre de grands modèles linguistiques. Il existe de nombreux produits sur le marché pour aider à la lecture de documents. Certains d'entre eux utilisent principalement des systèmes OCR pour la reconnaissance de texte et coopèrent avec LLM pour le traitement de texte.

Comment installer chatgpt sur un téléphone mobile

Mar 05, 2024 pm 02:31 PM

Comment installer chatgpt sur un téléphone mobile

Mar 05, 2024 pm 02:31 PM

Étapes d'installation : 1. Téléchargez le logiciel ChatGTP depuis le site officiel ou la boutique mobile de ChatGTP ; 2. Après l'avoir ouvert, dans l'interface des paramètres, sélectionnez la langue chinoise 3. Dans l'interface de jeu, sélectionnez le jeu homme-machine et définissez la langue. Spectre chinois ; 4. Après avoir démarré, entrez les commandes dans la fenêtre de discussion pour interagir avec le logiciel.

Fraichement publié! Un modèle open source pour générer des images de style anime en un seul clic

Apr 08, 2024 pm 06:01 PM

Fraichement publié! Un modèle open source pour générer des images de style anime en un seul clic

Apr 08, 2024 pm 06:01 PM

Permettez-moi de vous présenter le dernier projet open source AIGC-AnimagineXL3.1. Ce projet est la dernière itération du modèle texte-image sur le thème de l'anime, visant à offrir aux utilisateurs une expérience de génération d'images d'anime plus optimisée et plus puissante. Dans AnimagineXL3.1, l'équipe de développement s'est concentrée sur l'optimisation de plusieurs aspects clés pour garantir que le modèle atteigne de nouveaux sommets en termes de performances et de fonctionnalités. Premièrement, ils ont élargi les données d’entraînement pour inclure non seulement les données des personnages du jeu des versions précédentes, mais également les données de nombreuses autres séries animées bien connues dans l’ensemble d’entraînement. Cette décision enrichit la base de connaissances du modèle, lui permettant de mieux comprendre les différents styles et personnages d'anime. AnimagineXL3.1 introduit un nouvel ensemble de balises et d'esthétiques spéciales

Une seule carte exécute Llama 70B plus rapidement que deux cartes, Microsoft vient de mettre le FP6 dans l'Open source A100 |

Apr 29, 2024 pm 04:55 PM

Une seule carte exécute Llama 70B plus rapidement que deux cartes, Microsoft vient de mettre le FP6 dans l'Open source A100 |

Apr 29, 2024 pm 04:55 PM

Le FP8 et la précision de quantification inférieure en virgule flottante ne sont plus le « brevet » du H100 ! Lao Huang voulait que tout le monde utilise INT8/INT4, et l'équipe Microsoft DeepSpeed a commencé à exécuter FP6 sur A100 sans le soutien officiel de NVIDIA. Les résultats des tests montrent que la quantification FP6 de la nouvelle méthode TC-FPx sur A100 est proche ou parfois plus rapide que celle de INT4, et a une précision supérieure à celle de cette dernière. En plus de cela, il existe également une prise en charge de bout en bout des grands modèles, qui ont été open source et intégrés dans des cadres d'inférence d'apprentissage profond tels que DeepSpeed. Ce résultat a également un effet immédiat sur l'accélération des grands modèles : dans ce cadre, en utilisant une seule carte pour exécuter Llama, le débit est 2,65 fois supérieur à celui des cartes doubles. un