Périphériques technologiques

Périphériques technologiques

IA

IA

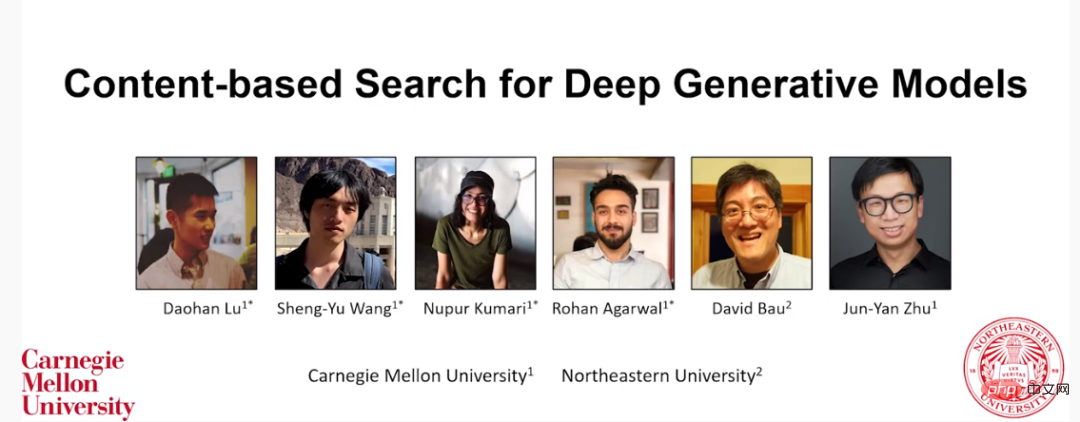

L'équipe de CMU Zhu Junyan a développé un système de classement automatique pour évaluer les avantages et les inconvénients des différents modèles de génération d'IA.

L'équipe de CMU Zhu Junyan a développé un système de classement automatique pour évaluer les avantages et les inconvénients des différents modèles de génération d'IA.

L'équipe de CMU Zhu Junyan a développé un système de classement automatique pour évaluer les avantages et les inconvénients des différents modèles de génération d'IA.

Cet article est reproduit à partir de Lei Feng.com Si vous devez le réimprimer, veuillez vous rendre sur le site officiel de Lei Feng.com pour demander une autorisation.

L'IA générative est très populaire ces derniers temps, et il existe tellement de nouveaux modèles de génération d'images pré-entraînés que c'est vertigineux à voir. Qu'il s'agisse de portraits, de paysages, de dessins animés, d'éléments du style d'un artiste spécifique, etc., chaque modèle a quelque chose qu'il sait générer.

Avec autant de modèles, comment trouver rapidement le meilleur modèle qui puisse satisfaire vos envies créatives ?

Récemment, Zhu Junyan, professeur adjoint à l'Université Carnegie Mellon, et d'autres ont proposé pour la première fois l'algorithme de recherche de modèles basé sur le contenu 🎜🎜 #, permettant Vous pouvez rechercher le modèle de génération d'image de profondeur le plus correspondant en un seul clic.

Adresse papier : https://arxiv.org/pdf/2210.03116.pdf#🎜 🎜#

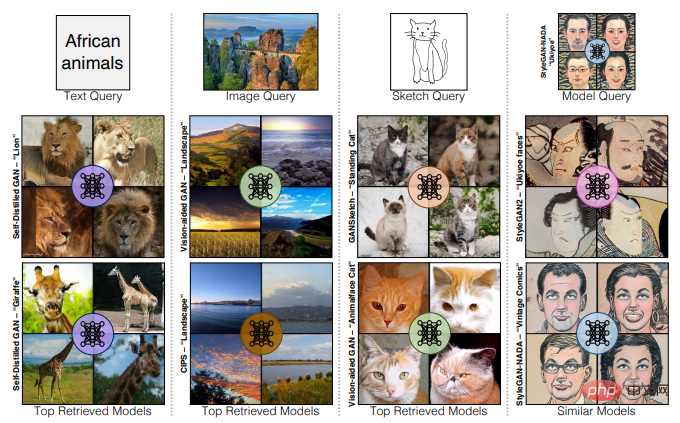

Sur Modelverse, une plateforme de partage et de recherche de modèles en ligne développée par l'équipe sur la base de cet ensemble d'algorithmes de recherche de modèles, vous pouvezsaisir du texte, images, croquis et étant donné un modèle, recherche le modèle associé le plus correspondant ou similaire.

Adresse de la plateforme Modelverse : https://modelverse.cs.cmu.edu/#🎜 🎜#

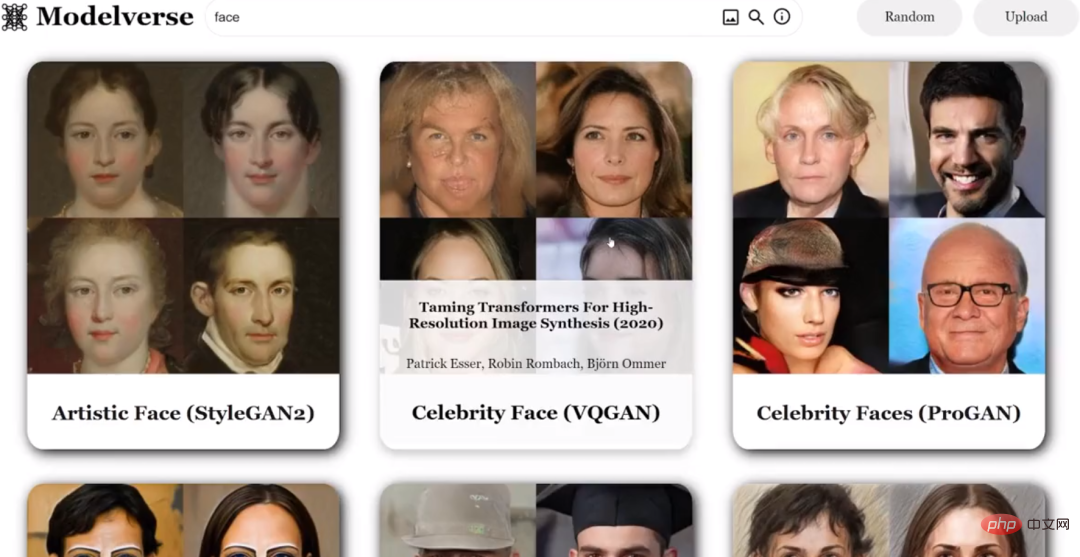

Par exemple, saisissez le texte "visage", le résultat est le suivant :

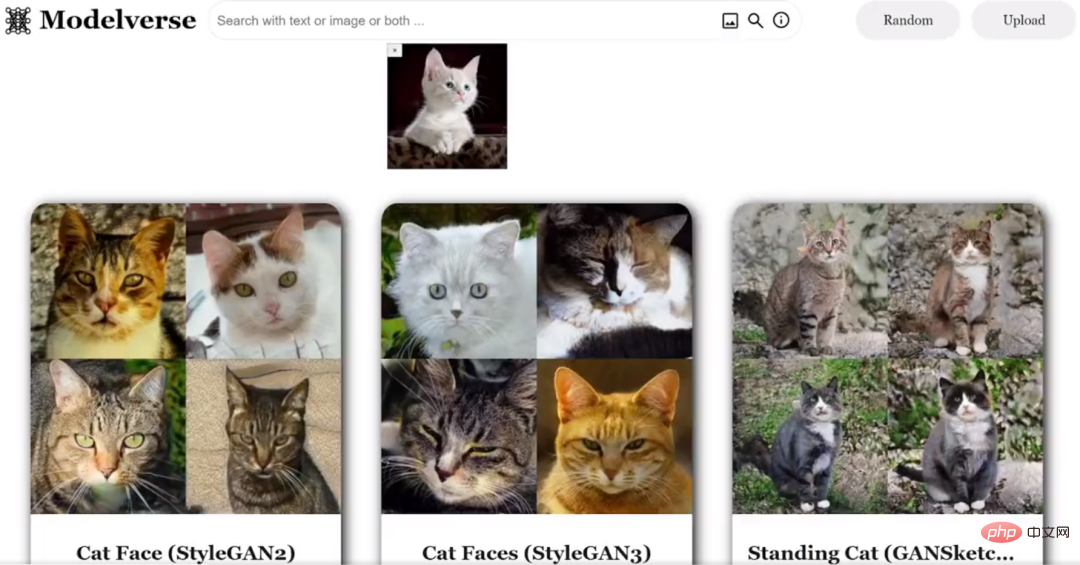

Entrez une image de chat :

Entrez une image de chat :

# 🎜🎜 #

Saisissez un croquis d'un cheval :

#🎜 🎜#1

Recherche de modèles basée sur le contenu

Comme la recherche multimédia traditionnelle, la recherche de modèles peut aider les utilisateurs à trouver le modèle qui correspond le mieux à leurs besoins spécifiques. Cependant, la tâche de recherche de modèle basée sur le contenu présente ses propres difficultés particulières :

Déterminer si un modèle peut générer une image spécifique est un problème informatiquement difficile, et de nombreux problèmes génératifs profonds modèles Il ne fournit pas une méthode efficace pour estimer la densité et ne prend pas non plus en charge l’évaluation de la similarité intermodale. La méthode de Monte Carlo basée sur l'échantillonnage rendra le processus de recherche de modèle très lent.

À cette fin, l'équipe de Zhu Junyan a proposé un nouveau système de recherche de modèles.

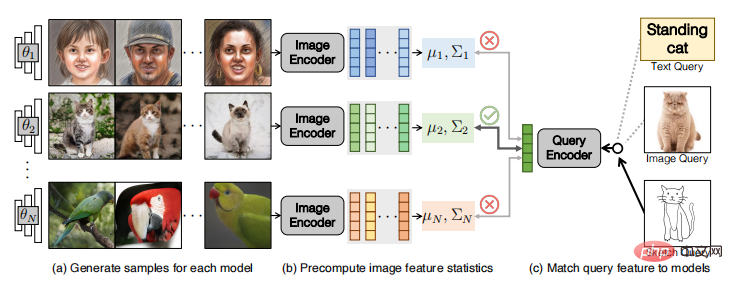

Chaque modèle génératif produit une distribution d'images, les auteurs abordent donc le problème de recherche comme une optimisation pour maximiser le nombre d'images générées qui correspondent à la requête étant donné la probabilité du modèle. Comme le montre la figure ci-dessous, le système se compose d'une étape de pré-mise en cache (a, b) et d'une étape d'inférence (c).

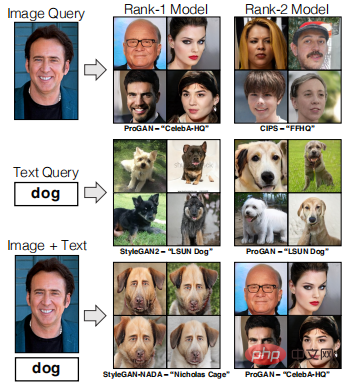

Légende : Aperçu des méthodes de recherche de modèles

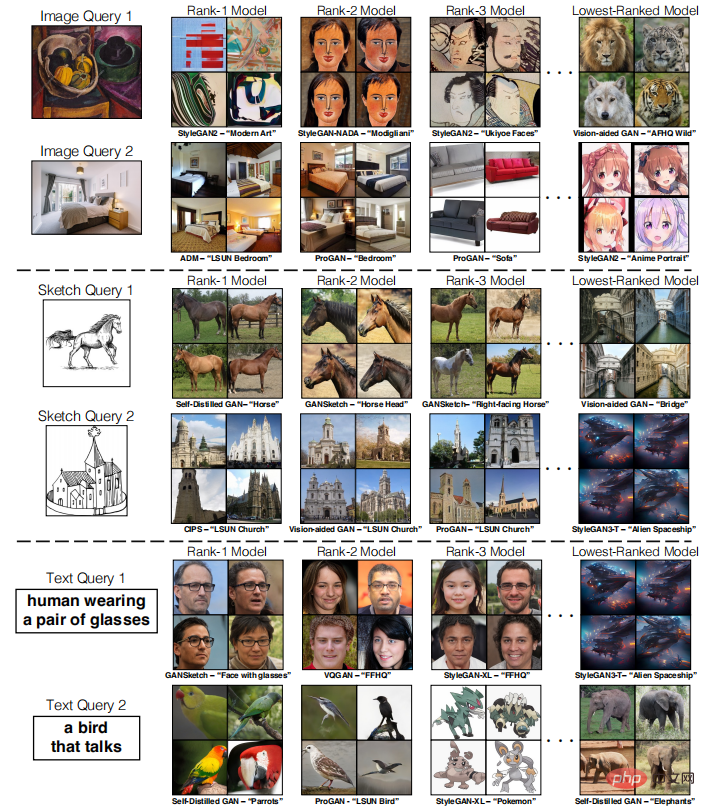

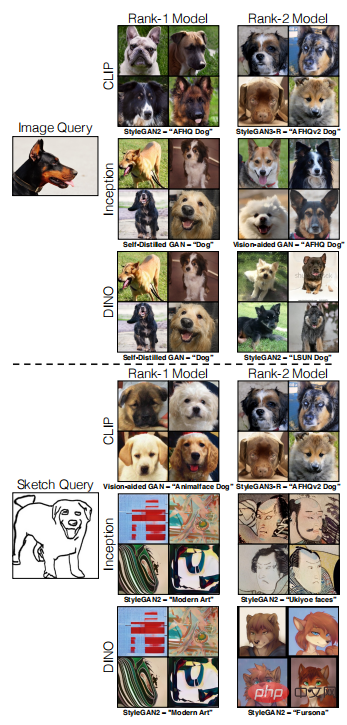

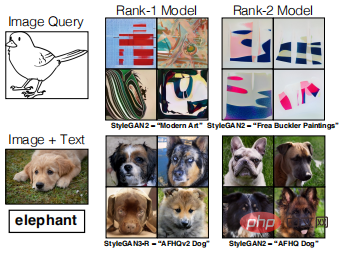

Étant donné un ensemble de modèles, (a) générez d'abord 50 000 échantillons pour chaque modèle ; (b) codez ensuite les images en caractéristiques d'image et calculez les statistiques de caractéristiques de premier et de deuxième ordre pour chacun ; modèle . Les statistiques sont mises en cache dans le système pour améliorer l'efficacité ; (c) pendant la phase d'inférence, des requêtes de différentes modalités sont prises en charge, notamment des images, des croquis, des descriptions textuelles, un autre modèle génératif ou une combinaison de ces types de requêtes. Les auteurs introduisent ici une approximation dans laquelle la requête est codée sous forme de vecteur de caractéristiques et le modèle avec la meilleure mesure de similarité est récupéré en évaluant la similarité entre les caractéristiques de la requête et les statistiques de chaque modèle. L'auteur évalue l'algorithme sur 133 modèles génératifs profonds (dont GAN, modèle de diffusion et modèle autorégressif) réalisés en ablation analyse expérimentale. Par rapport à la ligne de base de Monte Carlo, cette méthode permet d'obtenir une recherche plus efficace, avec une vitesse améliorée de 5 fois en 0,08 milliseconde, tout en maintenant haute précision . En comparant les résultats de récupération des modèles, nous pouvons également avoir une idée approximative des modèles qui peuvent générer des images de meilleure qualité pour différentes entrées de requête. Par exemple, la figure ci-dessous montre la comparaison des résultats de récupération du modèle. Illustration : Exemple de résultats de récupération de modèle#🎜🎜 # La ligne supérieure est une requête d'image, la saisie de natures mortes, la récupération de modèles de styles artistiques associés et l'obtention du modèle StyleGAN2 classé en premier et du modèle GAN assisté par vision classé en dernier. La rangée du milieu est une requête d'esquisse, saisissez des croquis de chevaux et d'églises et obtenez des modèles tels que ADM et ProGAN. La ligne du bas est une requête textuelle. Saisissez « personne portant des lunettes » et « oiseau qui parle » pour récupérer respectivement le modèle GANSketch et le modèle GAN auto-distillé les mieux classés. L'auteur a également constaté que Il existe des différences dans les performances des modèles dans différents espaces de fonctionnalités réseau. Comme le montre la figure ci-dessous, lors de la saisie de requêtes d'images, les résultats montrent que les trois réseaux CLIP, DINO et Inception ont tous des performances similaires ; lors de la saisie de requêtes d'esquisse, CLIP fonctionne nettement mieux, contrairement à DINO et Inception. Trop adaptés à une requête donnée, ils fonctionnent mieux sur les modèles de style artistique. Remarque : Comparaison de la récupération de modèles basée sur des images et des croquis dans différents espaces de fonctionnalités du réseau# 🎜 🎜# Par exemple, une requête multimodale peut aider à affiner la recherche de modèle Lorsqu'il n'y a que des images de "Nicolas Cage", seul le modèle du visage peut être récupéré mais ; lors de l'utilisation des deux Lorsque « Nicolas Cage » et « chien » sont utilisés comme entrée, le modèle StyleGAN-NADA qui peut générer l'image « Nicolas Cage chien » peut être récupéré. (Comme indiqué ci-dessous)

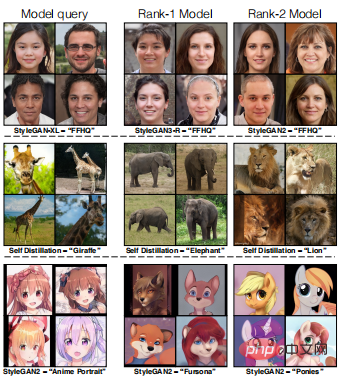

Remarque : Requête utilisateur multimodale #🎜 🎜#Lorsque l'entrée est un modèle de visage, davantage de modèles de génération de visage peuvent être récupérés et les catégories restent similaires. (Comme indiqué ci-dessous)

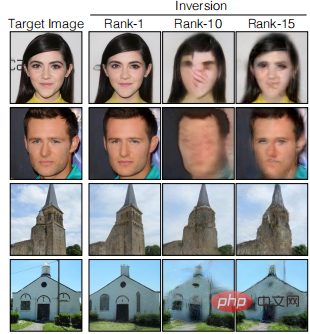

À partir d'une image de requête d'un visage réel, l'utilisation d'un modèle de rang supérieur entraîne une reconstruction d'image plus précise. La figure ci-dessous est un exemple de mappage inverse d'images d'images CelebA-HQ et LSUN Church à l'aide de différents modèles de classement.

Dans la tâche d'édition d'images réelles, les performances des différents modèles varient également. Dans la figure ci-dessous, le modèle le mieux classé dans l'algorithme de récupération de modèle basé sur l'image est utilisé pour cartographier inversement l'image réelle, puis modifié à l'aide de GANspace pour transformer le visage renfrogné de l'image Ukiyoe en un visage souriant.

Légende : Image réelle éditée Cette étude La faisabilité La recherche de modèles a fait ses preuves, mais il reste encore beaucoup d'espace de recherche pour la recherche de modèles générés à partir de texte, d'audio ou d'autres contenus. Mais à l'heure actuelle, la méthode proposée dans ce travail présente encore certaines limites. Par exemple, lors de l'interrogation d'un croquis spécifique, parfois un modèle d'une forme abstraite sera mis en correspondance ; et parfois lors de l'exécution d'une requête multimodale, un seul modèle peut être récupéré, et le système peut avoir des difficultés à traiter des images comme un chien + "les grandes requêtes multimodales comme". (Comme indiqué ci-dessous) Remarque : Cas d'échec # 🎜🎜# De plus, sur sa plateforme de recherche de modèles, la liste de modèles récupérée n'est pas automatiquement triée en fonction de son effet, comme la résolution, la fidélité, le degré de correspondance de l'image générée, etc. et le classement des différents modèles facilitera la recherche des utilisateurs et les aidera à mieux comprendre les avantages et les inconvénients des modèles actuellement générés. Nous attendons avec impatience les travaux de suivi dans ce domaine.

2 Effet de recherche de modèle

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Géospatial de Laravel: optimisation des cartes interactives et de grandes quantités de données

Apr 08, 2025 pm 12:24 PM

Géospatial de Laravel: optimisation des cartes interactives et de grandes quantités de données

Apr 08, 2025 pm 12:24 PM

Traiter efficacement 7 millions d'enregistrements et créer des cartes interactives avec la technologie géospatiale. Cet article explore comment traiter efficacement plus de 7 millions d'enregistrements en utilisant Laravel et MySQL et les convertir en visualisations de cartes interactives. Exigences initiales du projet de défi: extraire des informations précieuses en utilisant 7 millions d'enregistrements dans la base de données MySQL. Beaucoup de gens considèrent d'abord les langages de programmation, mais ignorent la base de données elle-même: peut-il répondre aux besoins? La migration des données ou l'ajustement structurel est-il requis? MySQL peut-il résister à une charge de données aussi importante? Analyse préliminaire: les filtres et les propriétés clés doivent être identifiés. Après analyse, il a été constaté que seuls quelques attributs étaient liés à la solution. Nous avons vérifié la faisabilité du filtre et établi certaines restrictions pour optimiser la recherche. Recherche de cartes basée sur la ville

Comment définir le délai de Vue Axios

Apr 07, 2025 pm 10:03 PM

Comment définir le délai de Vue Axios

Apr 07, 2025 pm 10:03 PM

Afin de définir le délai d'expiration de Vue Axios, nous pouvons créer une instance AxiOS et spécifier l'option Timeout: dans les paramètres globaux: vue.prototype. $ Axios = axios.create ({timeout: 5000}); Dans une seule demande: ce. $ axios.get ('/ api / utilisateurs', {timeout: 10000}).

Comment résoudre MySQL ne peut pas être démarré

Apr 08, 2025 pm 02:21 PM

Comment résoudre MySQL ne peut pas être démarré

Apr 08, 2025 pm 02:21 PM

Il existe de nombreuses raisons pour lesquelles la startup MySQL échoue, et elle peut être diagnostiquée en vérifiant le journal des erreurs. Les causes courantes incluent les conflits de port (vérifier l'occupation du port et la configuration de modification), les problèmes d'autorisation (vérifier le service exécutant les autorisations des utilisateurs), les erreurs de fichier de configuration (vérifier les paramètres des paramètres), la corruption du répertoire de données (restaurer les données ou reconstruire l'espace de la table), les problèmes d'espace de la table InNODB (vérifier les fichiers IBDATA1), la défaillance du chargement du plug-in (vérification du journal des erreurs). Lors de la résolution de problèmes, vous devez les analyser en fonction du journal d'erreur, trouver la cause profonde du problème et développer l'habitude de sauvegarder régulièrement les données pour prévenir et résoudre des problèmes.

Comment utiliser MySQL après l'installation

Apr 08, 2025 am 11:48 AM

Comment utiliser MySQL après l'installation

Apr 08, 2025 am 11:48 AM

L'article présente le fonctionnement de la base de données MySQL. Tout d'abord, vous devez installer un client MySQL, tel que MySQLWorkBench ou le client de ligne de commande. 1. Utilisez la commande MySQL-UROot-P pour vous connecter au serveur et connecter avec le mot de passe du compte racine; 2. Utilisez Createdatabase pour créer une base de données et utilisez Sélectionner une base de données; 3. Utilisez CreateTable pour créer une table, définissez des champs et des types de données; 4. Utilisez InsertInto pour insérer des données, remettre en question les données, mettre à jour les données par mise à jour et supprimer les données par Supprimer. Ce n'est qu'en maîtrisant ces étapes, en apprenant à faire face à des problèmes courants et à l'optimisation des performances de la base de données que vous pouvez utiliser efficacement MySQL.

Les ingénieurs de backend senior à distance (plates-formes) ont besoin de cercles

Apr 08, 2025 pm 12:27 PM

Les ingénieurs de backend senior à distance (plates-formes) ont besoin de cercles

Apr 08, 2025 pm 12:27 PM

Ingénieur backend à distance Emploi Vacant Société: Emplacement du cercle: Bureau à distance Type d'emploi: Salaire à temps plein: 130 000 $ - 140 000 $ Description du poste Participez à la recherche et au développement des applications mobiles Circle et des fonctionnalités publiques liées à l'API couvrant l'intégralité du cycle de vie de développement logiciel. Les principales responsabilités complètent indépendamment les travaux de développement basés sur RubyOnRails et collaborent avec l'équipe frontale React / Redux / Relay. Créez les fonctionnalités de base et les améliorations des applications Web et travaillez en étroite collaboration avec les concepteurs et le leadership tout au long du processus de conception fonctionnelle. Promouvoir les processus de développement positifs et hiérarchiser la vitesse d'itération. Nécessite plus de 6 ans de backend d'applications Web complexe

Mysql peut-il renvoyer JSON

Apr 08, 2025 pm 03:09 PM

Mysql peut-il renvoyer JSON

Apr 08, 2025 pm 03:09 PM

MySQL peut renvoyer les données JSON. La fonction JSON_Extract extrait les valeurs de champ. Pour les requêtes complexes, envisagez d'utiliser la clause pour filtrer les données JSON, mais faites attention à son impact sur les performances. Le support de MySQL pour JSON augmente constamment, et il est recommandé de faire attention aux dernières versions et fonctionnalités.

Comprendre les propriétés acides: les piliers d'une base de données fiable

Apr 08, 2025 pm 06:33 PM

Comprendre les propriétés acides: les piliers d'une base de données fiable

Apr 08, 2025 pm 06:33 PM

Une explication détaillée des attributs d'acide de base de données Les attributs acides sont un ensemble de règles pour garantir la fiabilité et la cohérence des transactions de base de données. Ils définissent comment les systèmes de bases de données gérent les transactions et garantissent l'intégrité et la précision des données même en cas de plantages système, d'interruptions d'alimentation ou de plusieurs utilisateurs d'accès simultanément. Présentation de l'attribut acide Atomicité: une transaction est considérée comme une unité indivisible. Toute pièce échoue, la transaction entière est reculée et la base de données ne conserve aucune modification. Par exemple, si un transfert bancaire est déduit d'un compte mais pas augmenté à un autre, toute l'opération est révoquée. BeginTransaction; UpdateAccountSsetBalance = Balance-100Wh

La clé principale de MySQL peut être nul

Apr 08, 2025 pm 03:03 PM

La clé principale de MySQL peut être nul

Apr 08, 2025 pm 03:03 PM

La clé primaire MySQL ne peut pas être vide car la clé principale est un attribut de clé qui identifie de manière unique chaque ligne dans la base de données. Si la clé primaire peut être vide, l'enregistrement ne peut pas être identifié de manière unique, ce qui entraînera une confusion des données. Lorsque vous utilisez des colonnes entières ou des UUIdes auto-incrémentales comme clés principales, vous devez considérer des facteurs tels que l'efficacité et l'occupation de l'espace et choisir une solution appropriée.