Périphériques technologiques

Périphériques technologiques

IA

IA

Solution technologique de détection LiDAR dans des conditions météorologiques extrêmes

Solution technologique de détection LiDAR dans des conditions météorologiques extrêmes

Solution technologique de détection LiDAR dans des conditions météorologiques extrêmes

01 Résumé

Les véhicules autonomes s'appuient sur divers capteurs pour collecter des informations sur l'environnement qui les entoure. Le comportement du véhicule est planifié en fonction de la conscience environnementale, sa fiabilité est donc cruciale pour des raisons de sécurité. Les capteurs lidar actifs sont capables de créer des représentations 3D précises de scènes, ce qui en fait un complément précieux à la conscience environnementale des véhicules autonomes. Les performances du LiDAR changent dans des conditions météorologiques défavorables telles que le brouillard, la neige ou la pluie en raison de la diffusion de la lumière et de l'occlusion. Cette limitation a récemment suscité des recherches considérables sur les méthodes permettant d'atténuer la dégradation des performances perceptuelles.

Cet article rassemble, analyse et discute de différents aspects de la détection environnementale basée sur LiDAR pour faire face aux conditions météorologiques défavorables. Des sujets tels que la disponibilité de données appropriées, le traitement et le débruitage des nuages de points bruts, des algorithmes de perception robustes et la fusion de capteurs pour atténuer les déficiences causées par des conditions météorologiques défavorables sont abordés. En outre, le document identifie en outre les lacunes les plus pressantes de la littérature actuelle et identifie des orientations de recherche prometteuses.

02 Introduction

Les capteurs LiDAR ont récemment reçu de plus en plus d'attention dans le domaine de la conduite autonome [1]. Il fournit des informations de profondeur rares mais précises, ce qui en fait un complément précieux aux capteurs plus étudiés tels que les caméras et les radars. Un capteur lidar est un capteur actif, c’est-à-dire qu’il émet des impulsions lumineuses réfléchies par l’environnement. Le capteur capture ensuite la lumière réfléchie et mesure la distance par rapport à l'environnement en fonction du temps écoulé. Outre le temps, d'autres caractéristiques peuvent être évaluées, telles que la quantité de lumière et l'allongement du signal. Dans la plupart des cas, des composants mécaniques sont combinés à plusieurs diodes laser pour créer un nuage de points clairsemé d'une scène complète [1]. Il existe différents capteurs sur le marché.

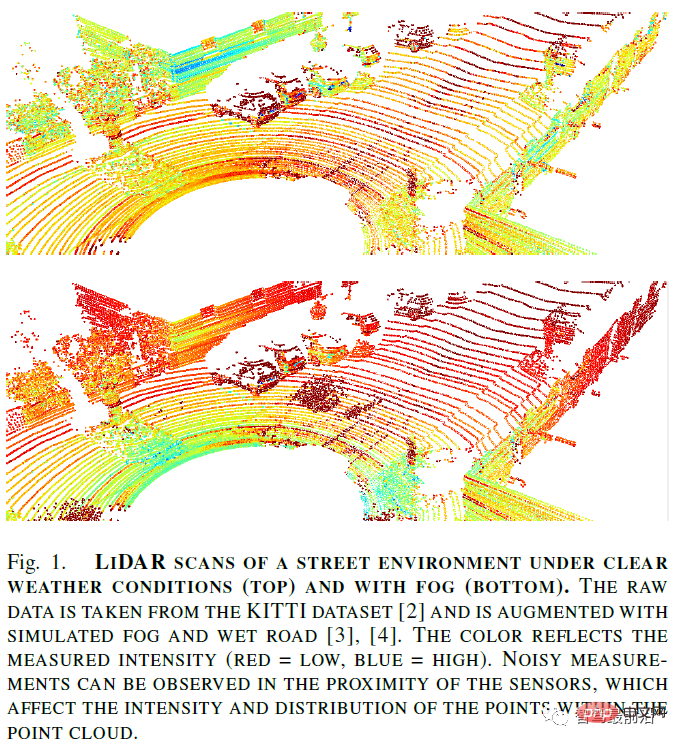

Les capteurs LiDAR présentent différents inconvénients dans des conditions météorologiques défavorables. Premièrement, le gel du capteur ou d’autres complications mécaniques peuvent survenir à des températures glaciales. Des facteurs internes et structurels tels que la technologie des capteurs, le modèle et le lieu de montage jouent un rôle dans le degré de détérioration. De plus, des conditions météorologiques défavorables peuvent affecter les valeurs d'intensité, les points d'écoute et d'autres caractéristiques des nuages de points (voir Figure 1). D'une manière générale, lorsque des particules sont rencontrées dans l'air en raison de la poussière ou de conditions météorologiques extrêmes, la lumière émise est rétrodiffusée ou détournée. Cela entraîne des mesures de distance et de réflectivité bruyantes dans le nuage de points, car certaines impulsions laser reviennent prématurément au capteur ou sont perdues dans l'atmosphère. Le bruit est particulièrement nocif lors de l’application d’algorithmes de compréhension de scène. Dans de tels cas d’utilisation critiques pour la sécurité, il est particulièrement important de maintenir des performances prédictives élevées et fiables. Par conséquent, des contre-mesures sont nécessaires pour minimiser la dégradation des performances de détection lidar dans des conditions météorologiques défavorables, ou au moins détecter les limites du capteur dans des scénarios réels.

La plupart des algorithmes de pointe s'appuient sur des algorithmes d'apprentissage profond (DL), qui s'appuient sur de grandes quantités de données pour dériver des caractéristiques universelles de l'environnement. Bien qu'il existe une ligne de recherche axée sur la perception non supervisée, les travaux les plus récents nécessitent un étiquetage correspondant des données brutes. Cela inclut des cadres de délimitation pour la détection d'objets et des étiquettes de classe par points pour la segmentation sémantique. L’étiquetage manuel des nuages de points clairsemés et bruyants est non seulement difficile, mais également coûteux et sujet aux erreurs. Par conséquent, la question de savoir comment simuler ou améliorer les nuages de points existants avec un bruit spécifique à la météo est particulièrement intéressante.

Bien qu'il existe de nombreuses recherches sur l'analyse de la dégradation des performances des capteurs lidar dans des conditions météorologiques extrêmes, il manque un résumé complet sur les contre-mesures algorithmiques visant à améliorer la perception. De plus, les enquêtes sur la conduite autonome dans des conditions météorologiques extrêmes ont porté sur la dégradation des capteurs induite par les conditions météorologiques, mais n'ont pas identifié de problèmes liés aux conditions météorologiques spécifiques aux capteurs lidar. Cet article résume et analyse diverses méthodes permettant de faire face à des conditions météorologiques défavorables pour la détection lidar. Par conséquent, l'article aborde ce sujet sous trois angles différents :

- Disponibilité des données : ensembles de données réelles et synthétiques pour développer des algorithmes robustes de perception lidar

- Manipulation des nuages de points : robustesse météorologique spécifique au capteur et indépendante de la perception ; traitement des nuages de points (tels que la classification météorologique, le débruitage des nuages de points)

- Perception robuste : un algorithme de perception robuste qui peut ajuster ou améliorer la perception en fusionnant plusieurs capteurs, en ajustant pendant l'entraînement la robustesse globale du modèle pour gérer les conditions météorologiques bruit dans les nuages de points.

Enfin, nous résumons les lacunes manquantes de la technologie actuelle et les orientations de recherche les plus prometteuses.

03 Données météorologiques défavorables

Pour entraîner un modèle DL sur tout type de tâche de perception, une grande quantité de données est nécessaire. Pour les méthodes supervisées qui dominent encore, ces données doivent même être étiquetées par des méthodes d’étiquetage automatisées ou manuellement. Quoi qu’il en soit, l’obtention de données lidar clairsemées et étiquetées avec précision est coûteuse et fastidieuse, et est encore plus entravée lorsque le nuage de points brut est corrompu par le bruit induit par les conditions météorologiques.

Par conséquent, des ensembles de données précieux avec des étiquettes de haute qualité sont nécessaires. Généralement, il existe trois options pour obtenir des nuages de points lidar avec des modèles de bruit caractéristiques du temps : des enregistrements du monde réel, des nuages de points améliorés et des nuages de points simulés. Le premier a été généré à l’aide d’un véhicule d’essai doté d’une configuration de capteurs appropriée dans des conditions météorologiques extrêmes. Cette dernière approche nécessite des modèles physiques ou des méthodes basées sur DL pour créer des parties ou des nuages de points entiers.

Ensembles de données du monde réel

La plupart des ensembles de données existants pour les références de perception lidar ont été enregistrés dans des conditions météorologiques favorables. Afin d'utiliser les algorithmes de perception développés dans le monde réel, l'ensemble de données sous-jacent doit refléter toutes les conditions météorologiques. En plus des conditions météorologiques claires, il existe de nombreux ensembles de données qui incluent explicitement la pluie, la neige et le brouillard.

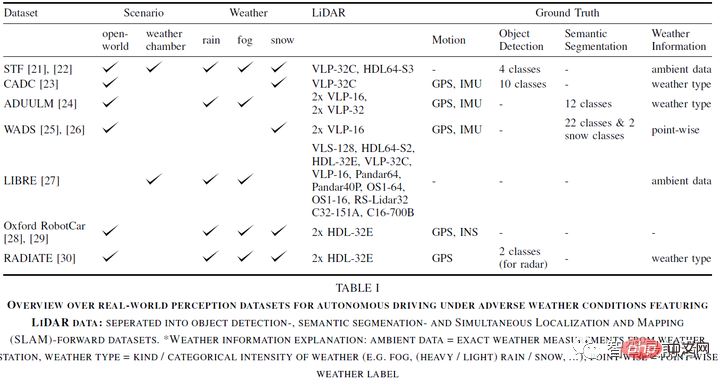

Le Tableau I présente un aperçu des ensembles de données accessibles au public utilisés pour étudier la perception lidar dans des conditions météorologiques extrêmes. Les ensembles de données ont été enregistrés dans des conditions différentes et leur taille varie considérablement. La plupart d’entre eux ont été enregistrés dans des scénarios de conduite réels, tandis que deux d’entre eux provenaient (en partie) de chambres météorologiques. Les chambres météorologiques ont l’avantage d’avoir un contrôle total sur les conditions météorologiques et sur le milieu environnant, c’est-à-dire en termes d’obstacles. Néanmoins, ils ne reflètent pas pleinement les situations réelles.

De plus, chaque ensemble de données utilise une configuration de capteur différente. [27] ont spécifiquement comparé les fabricants et les modèles de lidar dans des conditions météorologiques extrêmes. En plus des capteurs LiDAR, tous les ensembles de données fournissent des enregistrements de caméras RVB, et certains ensembles de données incluent même des caméras radar, stéréo, événementielles, fermées ou infrarouges.

Ces ensembles de données sont conçus pour résoudre différentes tâches de perception et de conduite des véhicules autonomes. Presque toutes les configurations de capteurs (sauf [21]) incluent des capteurs de positionnement et de mouvement, à savoir GPS/GNSS et IMU. Ils conviennent donc au développement et au test d’algorithmes SLAM. Tous les ensembles de données fournissent des étiquettes pour la détection d'objets ou la segmentation ponctuelle, sauf [29] qui ne fournit que le mouvement GT.

Enfin, tous les ensembles de données incluent des métadonnées sur les conditions météorologiques. Ceci est essentiel pour développer presque tout type de modèle de perception dans des conditions météorologiques extrêmes. Comprendre l’intensité et la nature des conditions météorologiques environnantes est crucial, du moins pour une vérification approfondie. Un seul ensemble de données fournit des étiquettes météorologiques ponctuelles, à savoir les chutes de neige en bordure de route et l'accumulation de neige.

L'avantage d'un ensemble de données composé d'enregistrements du monde réel est qu'il est très réaliste. L’inconvénient est que les étiquettes des scènes enregistrées ne sont que partiellement disponibles (point par point) ou, si les données sont enregistrées dans une chambre météorologique, limitées à des scénarios réels plus complexes. L'étiquetage manuel point par point des nuages de points lidar dans des conditions météorologiques défavorables est particulièrement difficile car, dans de nombreux cas, il est peu pratique de distinguer le fouillis ou le bruit du signal réfléchi réel.

Augmentation météorologique

L'extension des effets météorologiques défavorables aux ensembles de données existants constitue un moyen efficace de générer de grandes quantités de données, plutôt que de collecter et d'étiqueter fastidieusement de nouveaux ensembles de données avec différents effets météorologiques défavorables. En règle générale, des modèles d'augmentation basés sur des données physiques ou empiriques sont utilisés pour augmenter certains effets météorologiques défavorables en nuages de points météorologiques clairs, qu'ils soient issus du monde réel ou de simulations. Cela permet d'obtenir des scènes corrompues par du bruit spécifique à la météo, tout en préservant tous les cas limites intéressants et les annotations déjà présentes dans l'ensemble de données.

La méthode d'augmentation définit la cartographie des points météorologiques clairs aux points correspondants dans des conditions météorologiques défavorables. À cette fin, on fait souvent référence au modèle théorique lidar de [32], qui modélise les effets de la pluie, du brouillard et de la neige défavorables. Il modélise la distribution d'intensité reçue comme un système linéaire en convoluant l'impulsion émise avec la réponse de la scène. La réponse de la scène modélise les réflexions des objets solides ainsi que la rétrodiffusion et l'atténuation dues aux intempéries.

Une amélioration du brouillard plus pratique est introduite dans [9], qui peut être directement appliquée aux nuages de points. Elle est basée sur la portée de visée maximale qui est fonction de l'intensité de la mesure, des paramètres lidar et de la visibilité optique dans le brouillard. Si la distance d'un point par temps clair est inférieure à la distance d'observation maximale, un point de dispersion aléatoire apparaîtra ou le point sera manquant avec une certaine probabilité. Le modèle prend en compte les précipitations en convertissant les paramètres de visibilité et les probabilités de diffusion en taux de précipitations.

Cependant, ces modèles ignorent la divergence du faisceau des impulsions lidar émises prises en compte pour l'amélioration de la pluie. Ici, le nombre d'intersections d'un faisceau suréchantillonné simulant la divergence du faisceau avec une goutte de pluie sphérique est calculé. Si le nombre d'intersections dépasse un certain seuil, un point de dispersion est ajouté. La méthode d'augmentation de [35] étend cette approche de telle sorte que des points manquants sont possibles. De plus, il fonctionne bien dans la neige et le brouillard.

Une autre amélioration pour le brouillard, la neige et la pluie est introduite dans [36]. Le modèle fonctionne dans le domaine de la puissance et ne repose pas, par exemple, sur le calcul de points de croisement comme les méthodes évoquées précédemment. De plus, une stratégie d’échantillonnage de distance de point de diffusion plus efficace sur le plan informatique est utilisée pour simuler la divergence du faisceau. Généralement, le modèle compare d'abord la puissance atténuée réfléchie par les objets solides et les diffuseurs échantillonnés de manière aléatoire à un seuil de bruit dépendant de la distance. Des points de dispersion sont ajoutés si leur puissance dépasse la puissance de l'objet solide. Si un point est inférieur au seuil de bruit dépendant de la distance, le point est perdu.

En plus des modèles basés sur la physique, des modèles empiriques peuvent également être utilisés à des fins d'amélioration. Des méthodes empiriques d'amélioration des pulvérisations enroulées par d'autres véhicules peuvent être trouvées dans [38]. Au cœur de ce modèle se trouve l’observation, issue d’expériences dédiées, selon laquelle les pulvérisations sont organisées en groupes. Une autre approche basée sur les données est proposée dans [39], qui s'appuie sur des scènes de pulvérisation de l'ensemble de données Waymo. Dans [40], une méthode d'amélioration de la pulvérisation plus coûteuse en termes de calcul est proposée, qui repose sur un moteur de rendu doté d'un moteur physique.

Enfin, les méthodes basées sur DL peuvent être appliquées à l'amélioration des conditions météorologiques défavorables. Dans [41], inspirée de la traduction image à image, une méthode basée sur les réseaux contradictoires génératifs (GAN) est proposée, capable de transformer les nuages de points des jours ensoleillés en jours brumeux ou pluvieux. Ils ont comparé qualitativement leurs résultats à de vrais nuages de brouillard et de pluie provenant de chambres météorologiques.

Cependant, évaluer la qualité et le réalisme des méthodes d'augmentation est un défi. Certains auteurs utilisent des chambres météorologiques ou d'autres environnements contrôlés pour permettre des comparaisons avec les effets météorologiques réels. De plus, une méthode d’augmentation est généralement considérée comme réaliste si elle contribue à la performance perçue dans des conditions météorologiques défavorables réelles.

04 Traitement et débruitage des nuages de points

Cette section présente des méthodes pour faire face à des conditions météorologiques défavorables, qui sont basées sur la technologie des capteurs ou des nuages de points, c'est-à-dire indépendantes de la tâche de détection réelle. Par conséquent, l'article analyse la robustesse générale des capteurs liée aux conditions météorologiques et la possibilité d'estimer le degré de dégradation des performances en fonction des conditions météorologiques. En outre, il existe de nombreuses études sur la suppression du bruit induit par les conditions météorologiques des nuages de points lidar à l'aide de méthodes classiques de débruitage et de DL.

Robustesse météo liée aux capteurs

Selon la technologie, les fonctionnalités et la configuration, les différents modèles de lidar sont plus ou moins affectés par les conditions météorologiques. En raison des restrictions de sécurité oculaire et de la suppression de la lumière ambiante, deux longueurs d'onde de fonctionnement des capteurs lidar dominent : 905 nm et 1 550 nm, 905 nm étant le capteur le plus disponible. Cela est dû en partie à de meilleures performances dans des conditions météorologiques défavorables, c'est-à-dire une moindre absorption par les gouttes de pluie, une meilleure réflectivité dans la neige et une moindre dégradation dans le brouillard. Pour une discussion complète de la technologie lidar et des longueurs d'onde dans des conditions météorologiques extrêmes, nous nous référons à [17].

De plus, les performances du lidar à forme d'onde complète (FWL) dans des conditions météorologiques extrêmes ont été étudiées. FWL mesure non seulement un ou deux échos, mais tous les échos les plus faibles, mesurant ainsi plus de bruit mais collectant également plus d'informations sur l'environnement. Bien que FWL nécessite des ressources informatiques élevées, il s’est avéré utile pour analyser le milieu environnant, ce qui peut servir de base à la compréhension de conditions même changeantes et à leur ajustement dynamique.

Estimation de la dégradation des capteurs et classification météorologique

Étant donné que les capteurs lidar se dégradent différemment selon les conditions météorologiques, l'estimation du degré de dégradation du capteur est la première étape du traitement des nuages de points lidar endommagés. Des progrès ont été réalisés dans le développement de méthodes permettant de mieux identifier les limites de détection afin d'empêcher les fausses détections de se propager aux tâches en aval.

Premièrement, certaines études sur la caractérisation de la dégradation des capteurs dans diverses conditions météorologiques constituent une base solide pour l'étalonnage et le développement ultérieur des capteurs dans des conditions météorologiques extrêmes, bien que leurs capacités de classification météorologique n'aient pas encore été évaluées. Le premier travail visant à simuler réellement l'impact des précipitations sur les capteurs lidar est présenté dans

[33]. Les auteurs proposent un modèle mathématique dérivé de l'équation lidar et permettent d'estimer la dégradation des performances en fonction du taux de précipitation et de la plage de détection maximale.

Dans des travaux de recherche ultérieurs, l'estimation de la dégradation des capteurs dans des conditions météorologiques extrêmes a été formulée comme une tâche de détection d'anomalies et une tâche de vérification. Le premier utilise un modèle basé sur DL conçu pour apprendre une représentation latente qui distingue une analyse LiDAR claire d'une analyse LiDAR pluvieuse, permettant ainsi de quantifier l'étendue de la dégradation des performances. Cette dernière approche propose d'utiliser des modèles d'apprentissage par renforcement (RL) pour identifier les échecs dans les modèles de détection et de suivi d'objets.

Alors que les méthodes ci-dessus visent à quantifier la dégradation des performances du capteur lui-même, une autre série d'études se concentre sur la classification des conditions météorologiques ambiantes (c'est-à-dire clair, pluvieux, brouillard et neige). Des résultats satisfaisants ont été obtenus à l’aide de méthodes classiques d’apprentissage automatique (k-voisins les plus proches et machines à vecteurs de support) basées sur des fonctionnalités artisanales de nuages de points LiDAR : [10] ont proposé un ensemble de fonctionnalités pour effectuer une classification météorologique par points.

[51] a développé un modèle probabiliste pour la régression image par image du taux de précipitation. En collaboration avec des experts, ils ont déduit avec précision les taux de précipitations à partir des nuages de points lidar.

Il est à noter que la plupart des méthodes sont entraînées et évaluées sur des données collectées dans des chambres météorologiques. Même si la capacité de contrôler soigneusement les conditions météorologiques permet une grande reproductibilité, les données ne reflètent souvent pas avec précision les conditions réelles. Afin d’évaluer la capacité de classification de chaque méthode, une étude approfondie sur des données réelles est nécessaire [50].

Débruitage des nuages de points

Les effets météorologiques se reflètent dans les nuages de points LiDAR sous forme de modèles de bruit spécifiques. Comme mentionné dans la section 1, ils peuvent affecter des facteurs tels que le nombre de mesures dans le nuage de points et la plage de détection maximale. Les nuages de points peuvent être débruités par diverses méthodes pour reconstruire des mesures claires plutôt que d'augmenter le nuage de points avec un bruit spécifique à la météo. En plus des algorithmes de filtrage classiques, certains travaux de débruitage basés sur DL ont récemment vu le jour.

En plus d'appliquer des tâches de perception telles que la détection d'objets sur des nuages de points débruités, des mesures telles que la précision (préservation des caractéristiques environnementales) et le rappel (filtrage du bruit induit par les conditions météorologiques) sont cruciales pour évaluer les performances des méthodes de filtrage classiques. Pour calculer ces mesures, des marqueurs point par point sont nécessaires pour prendre en compte les catégories météorologiques telles que les particules de neige.

Radius Outlier Removal (ROR) filtre le bruit en fonction du voisinage de n'importe quel point. Cela devient problématique pour les mesures LiDAR d’objets distants, car les nuages de points deviennent naturellement clairsemés. Les méthodes avancées résolvent ce problème en ajustant dynamiquement le seuil en fonction de la distance de détection (Suppression dynamique des valeurs aberrantes du rayon (DROR)) ou en prenant en compte la distance moyenne par rapport aux voisins de chaque point du nuage de points (Suppression statistique des valeurs aberrantes). Les deux méthodes présentent des durées de fonctionnement élevées, ce qui les rend presque inadaptées à la conduite autonome. La suppression rapide des valeurs aberrantes statistiques de clustering (FCSOR) et la suppression dynamique des valeurs aberrantes statistiques (DSOR) proposent toutes deux des méthodes permettant de réduire la charge de calcul tout en supprimant les artefacts météorologiques des nuages de points.

La méthode de débruitage du lidar routier s'appuie sur un modèle de fond de données historiques (qui peuvent être utilisées pour fixer les capteurs routiers), combiné aux principes de base utilisés dans le débruitage classique pour identifier les points dynamiques. [57] ont filtré le bruit météorologique d'objets réels à l'aide de seuils d'intensité. Malheureusement, cela n’est pas facilement applicable aux capteurs lidar montés sur des véhicules en mouvement.

Contrairement aux méthodes de débruitage classiques, le débruitage des nuages de points lidar basé sur DL est populaire en raison de la capacité du modèle à comprendre directement la structure sous-jacente du bruit météorologique : Premièrement, les modèles basés sur les réseaux neuronaux convolutifs (CNN) ont permis un débruitage météorologique efficace. L'utilisation de données temporelles pour la différenciation exploite davantage la suppression du bruit spécifique à la météo car, naturellement, le bruit météorologique change plus fréquemment que l'arrière-plan de la scène ou même les objets à l'intérieur de la scène. Les méthodes basées sur CNN (en particulier les méthodes basées sur les voxels) surpassent les méthodes de débruitage classiques en termes de filtrage du bruit. De plus, comme les GPU calculent plus rapidement, leurs temps d’inférence sont plus courts.

En plus des méthodes CNN supervisées, les méthodes non supervisées comme CycleGAN sont capables de transformer les entrées bruyantes de nuages de points en analyses lidar claires. Cependant, leur nature reste bruitée et les nuages de points résultants sont difficiles à vérifier quant à leur authenticité.

05 Perception LiDAR robuste

Bien que de bons efforts soient déployés pour réduire le décalage de champ causé par des conditions météorologiques défavorables, il existe plusieurs façons possibles de rendre les modèles de perception LiDAR plus robustes dans des conditions météorologiques défavorables, quelle que soit la qualité des données et. niveau de bruit. Il existe trois flux de travail ici : tirer parti de la fusion de capteurs, améliorer la formation grâce à l'augmentation des données avec un bruit spécifique à la météo, ou une approche générale de la robustesse du modèle contre les changements de domaine pour compenser la dégradation des performances. Il convient de noter que les méthodes de fusion de capteurs sont les seules à résoudre plusieurs tâches de détection en plus de la détection d'objets. À la connaissance de cet article, il n'existe aucune littérature sur d'autres tâches de perception telles que la segmentation sémantique.

Utiliser la fusion de capteurs pour faire face aux intempéries

On peut généralement dire que chaque capteur du groupe des capteurs de conduite autonome a ses avantages et ses inconvénients. Les capteurs les plus courants dans ce groupe de capteurs sont les caméras RVB, les radars et les lidar. Comme mentionné dans la section 1, la perception lidar est affectée lors de la rencontre de particules visibles en suspension dans l'air telles que la poussière, la pluie, la neige ou le brouillard. La caméra est plus sensible aux fortes incidences de lumière et aux effets de halo. Le radar, quant à lui, est immunisé contre les deux, mais n’a pas la capacité de détecter des objets statiques et des structures fines. Par conséquent, il s’oblige à fusionner différents capteurs afin d’atténuer leurs défauts respectifs et de favoriser une perception robuste dans différentes conditions environnementales.

Les premiers travaux sur la fusion de capteurs pour lutter contre les effets néfastes de la météo sur la perception des capteurs se sont concentrés sur le développement de cadres robustes de corrélation de données. Les courants de recherche récents utilisent des méthodes basées sur DL pour une perception multimodale robuste et abordent principalement la question de la fusion précoce ou tardive pour obtenir une robustesse dans des conditions météorologiques défavorables.

Le choix de la fusion avant ou arrière semble dépendre de la sélection du capteur, de la représentation des données et du taux de défaillance attendu. En supposant que tous les capteurs fusionnés ne soient pas dégradés dans la même mesure et qu’au moins l’un d’entre eux soit pleinement fonctionnel, une fusion tardive semble être meilleure qu’une fusion précoce. Dans ce cas, le modèle est capable de traiter le flux du capteur de manière indépendante, il peut s'appuyer sur des capteurs fonctionnels et ignorer les capteurs défectueux. Au lieu de cela, la fusion précoce des cartes de profondeur radar et lidar permet de filtrer les fausses détections pour obtenir des analyses nettes.

La représentation des données est un autre facteur qui aide en partie à répondre à la question de la fusion précoce ou tardive. La vue à vol d'oiseau (BEV) des capteurs LiDAR facilite grandement la détection d'objets en améliorant la résolvabilité des objets. Par conséquent, tout modèle ayant appris à s’appuyer sur les fonctionnalités lidar respectives subira une perte de performances lorsque les données lidar seront corrompues. Une défaillance complète du capteur a été résolue avec succès grâce à un réseau enseignant-élève.

En fin de compte, certaines méthodes de fusion de capteurs reposent sur la combinaison de fusions précoces et tardives en un seul modèle et exploitent des concepts tels que les données temporelles et la fusion basée sur les régions [72] ou les cartes d'attention [73]. Une autre possibilité est la fusion du contrôle adaptatif de l'entropie proposée dans [21].

En plus des performances prédictives, le temps d'exécution du modèle doit également être pris en compte lors du développement de nouvelles méthodes de perception. [68] ont introduit une nouvelle métrique qui combine les performances prédictives qui pilotent la segmentation spatiale avec le temps d'exécution d'inférence. Il est intéressant de noter que le modèle lidar uniquement a obtenu le score le plus élevé pour cette métrique.

Il ne fait aucun doute qu'il est pratique de compenser une défaillance du capteur dans des conditions météorologiques défavorables avec un capteur non affecté. Cependant, en travaillant à améliorer la perception dans des conditions météorologiques défavorables en utilisant uniquement le lidar, les applications critiques pour la sécurité telles que la conduite autonome peuvent devenir plus fiables.

Améliorer l'entraînement grâce à l'augmentation des données

Bien que l'augmentation des données soit largement utilisée dans les stratégies d'entraînement DL, ce qui est particulièrement difficile est la génération de bruit spécifique à la météo. La section 2 présente diverses méthodes pour générer du bruit spécifique à la météo dans les nuages de points lidar. L'utilisation de l'augmentation des données lors de la formation de modèles perceptuels est une approche radiale du débruitage des nuages de points, qui a été discutée dans III. L'objectif n'est pas de supprimer le bruit induit par les conditions météorologiques, mais d'habituer le modèle à ce bruit précis. Il a été démontré que l’amélioration des conditions météorologiques est plus efficace que le débruitage en termes de robustesse, ce qui fournit des indications précieuses sur les orientations de recherche sur lesquelles il conviendrait de se concentrer à l’avenir.

De manière générale, certains travaux ont démontré les bénéfices d'une telle augmentation de données au moment de l'entraînement en évaluant ces données dans la tâche de détection d'objets 3D.

De nombreux travaux portent sur le problème de la sélection du meilleur extracteur de caractéristiques pour une perception lidar robuste dans des conditions météorologiques extrêmes. Les méthodes basées sur des points et voxelisées semblent être moins affectées par les effets météorologiques accrus, du moins en ce qui concerne la détection d'objets, ce qui suggère qu'une certaine robustesse peut être obtenue grâce à un choix judicieux de modèles de perception. De plus, il semble y avoir une interaction entre l’architecture du modèle et les dommages causés aux nuages de points par des conditions météorologiques extrêmes. L'extension des zones humides proposée dans [4] n'a aidé que certains modèles, montrant que les problèmes de détection causés par la diffusion des rayons sont plus ou moins sévères, selon l'architecture du modèle.

De plus, la taille et la forme des objets semblent jouer un rôle dans le degré de dégradation des performances de tout modèle de détection. Cela signifie que les classes plus petites et sous-représentées, comme la classe des cyclistes dans l'ensemble de données STF, sont plus sensibles aux améliorations météorologiques que les classes mieux représentées, comme les voitures et les piétons. Par conséquent, le nombre d’objets annotés (clairs) dans l’ensemble d’apprentissage est un bon indicateur des performances de détection d’objets, même dans des conditions météorologiques défavorables. Cela montre que l’entraînement amélioré en fonction des conditions météorologiques contribue non seulement à améliorer les performances de détection par temps clair, mais qu’il est intéressant de noter qu’il semble également avoir l’effet inverse.

Algorithme de perception robuste

Bien que les méthodes de fusion avec des capteurs complémentaires puissent atténuer la dégradation des performances de chaque capteur due aux conditions météorologiques, elles ne peuvent servir que de solutions aux problèmes pratiques actuels. Les changements dans les conditions météorologiques peuvent être considérés comme un cas particulier de transfert de domaine, et par conséquent les méthodes développées pour combler l'écart de domaine peuvent être appliquées au transfert de domaine météo à météo (par exemple, ensoleillé/brouillard/neige). [77] fournissent un aperçu complet des méthodes adaptatives dans l'état actuel de l'art, mais elles abordent principalement des problèmes liés aux différentes résolutions de capteurs ou aux données disponibles et à leurs étiquettes.

Dans [78], les auteurs ont proposé un transfert de domaine d'ensemble de données à ensemble de données, qui inclut indirectement les changements météorologiques. Ils ont utilisé un environnement enseignant-élève pour la détection d'objets, où les enseignants ont été formés sur Waymo Open (jours ensoleillés) et ont généré des étiquettes pour une partie de Waymo Open et une partie de Kirkland (jours de pluie), et les étudiants ont été formés sur toutes les étiquettes et appliqués à Kirkland. Il est intéressant de noter que les étudiants semblaient mieux généraliser au domaine cible, ce qui suggère qu’ils étaient capables de faire face à des conditions météorologiques extrêmes. Cependant, il convient de noter que les écarts de domaine ne se limitent pas aux changements entre les conditions météorologiques et que d'autres facteurs tels que la résolution des capteurs et les stratégies d'étiquetage peuvent masquer les écarts causés par les conditions météorologiques. Les auteurs de

[79] ont proposé un pipeline de détection d'objets robuste qui comprend un mécanisme d'attention et une extraction de caractéristiques contextuelles globales, permettant au modèle d'ignorer le bruit induit par les conditions météorologiques tout en comprenant l'ensemble de la scène. Bien que leur méthode ne fonctionne pas bien sur les deux domaines (KITTI, ensoleillé et CADC, pluvieux) en même temps, un entraînement conjoint basé sur la perte de différence maximale donne des résultats prometteurs et fonctionne bien sur les domaines source et cible. Là encore, il n’est pas clair quels éléments du modèle sont imputables aux changements des conditions météorologiques elles-mêmes, car la variation d’un ensemble de données à l’autre semble être très forte.

[80] se concentre sur l'atténuation de la dégradation des capteurs induite par les conditions météorologiques des caméras RVB et du lidar. Bien qu’ils exploitent la fusion de capteurs (dérivée de la fusion entropique proposée dans [21]) ainsi que l’augmentation des données de deux capteurs, leurs travaux favorisent fortement l’utilisation d’un ensemble de méthodes pour combler le fossé avec plusieurs domaines cibles inconnus, pour la détection de cibles. Ils y parviennent en introduisant des discriminateurs de domaine et un apprentissage auto-supervisé grâce à des stratégies de pré-formation. Leurs résultats montrent que leur méthode d’adaptation de domaine multimodale et multi-objets se généralise bien, par exemple, aux scènes de brouillard.

06 Discussion et conclusion

Dans ce document d'enquête, cet article décrit les orientations actuelles de la recherche en matière de perception de l'environnement basée sur le lidar pour la conduite autonome dans des conditions météorologiques extrêmes. L'article fournit une analyse et une discussion approfondies de la disponibilité des données de formation pour les algorithmes d'apprentissage profond, des techniques de traitement des nuages de points indépendantes de la perception pour détecter les conditions météorologiques et débruiter les analyses lidar, ainsi que des méthodes de pointe pour une perception lidar robuste. . Ci-après, les orientations de recherche les plus prometteuses sont résumées et les lacunes restantes sont identifiées.

Données météorologiques défavorables : Il existe plusieurs ensembles de données de conduite autonome, notamment des capteurs lidar qui couvrent également les conditions météorologiques défavorables. La plupart d'entre eux fournissent des étiquettes d'objet, mais un seul a des étiquettes de classe par points. De toute évidence, des ensembles de données appropriées du monde réel sont nécessaires pour former et valider le nombre croissant d’algorithmes de détection lidar basés sur l’apprentissage profond. Certains travaux utilisent une augmentation de données météorologiques spécifiques pour simuler des effets météorologiques défavorables, mais il manque une méthode permettant d'évaluer le réalisme des augmentations générées.

Traitement et débruitage des nuages de points : différentes technologies lidar réagissent différemment aux conditions météorologiques défavorables. Bien que la dégradation des capteurs dans des conditions météorologiques extrêmes ait été étudiée de manière approfondie, il manque une analyse systématique de l'impact sur les algorithmes de détection. Ici, les méthodes d’estimation de la dégradation des capteurs seront utiles. De plus, des recherches sont actuellement en cours sur le débruitage des nuages, mais les méthodes statistiques existantes se sont révélées moins efficaces que l'utilisation de méthodes d'augmentation météorologique dans le cadre de la formation. Les méthodes modernes, telles que celles basées sur CNN ou GAN, pourraient combler cette lacune.

Détection lidar robuste : de nombreuses recherches se concentrent sur l'atténuation de la dégradation des capteurs à l'aide de la fusion des capteurs. Bien que cela ait produit des résultats convaincants, il ne faut pas négliger l’amélioration des capacités de perception en utilisant uniquement le lidar dans des conditions météorologiques défavorables. Des méthodes sophistiquées d'adaptation de domaine telles que la détection d'anomalies ou la modélisation de l'incertitude peuvent aider à résoudre ce problème. Observer la présence de bruit induit par les conditions météorologiques dans les nuages de points lidar sous un angle différent pourrait ouvrir de nouveaux axes de recherche qui combleraient les lacunes dans le domaine causées par des conditions météorologiques défavorables. La qualité de l’étude des lacunes dans ce domaine suggérera le potentiel d’une approche générale d’adaptation au domaine.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

1369

1369

52

52

Le papier Stable Diffusion 3 est enfin publié, et les détails architecturaux sont révélés. Cela aidera-t-il à reproduire Sora ?

Mar 06, 2024 pm 05:34 PM

Le papier Stable Diffusion 3 est enfin publié, et les détails architecturaux sont révélés. Cela aidera-t-il à reproduire Sora ?

Mar 06, 2024 pm 05:34 PM

L'article de StableDiffusion3 est enfin là ! Ce modèle est sorti il y a deux semaines et utilise la même architecture DiT (DiffusionTransformer) que Sora. Il a fait beaucoup de bruit dès sa sortie. Par rapport à la version précédente, la qualité des images générées par StableDiffusion3 a été considérablement améliorée. Il prend désormais en charge les invites multithèmes, et l'effet d'écriture de texte a également été amélioré et les caractères tronqués n'apparaissent plus. StabilityAI a souligné que StableDiffusion3 est une série de modèles avec des tailles de paramètres allant de 800M à 8B. Cette plage de paramètres signifie que le modèle peut être exécuté directement sur de nombreux appareils portables, réduisant ainsi considérablement l'utilisation de l'IA.

Avez-vous vraiment maîtrisé la conversion des systèmes de coordonnées ? Des enjeux multi-capteurs indispensables à la conduite autonome

Oct 12, 2023 am 11:21 AM

Avez-vous vraiment maîtrisé la conversion des systèmes de coordonnées ? Des enjeux multi-capteurs indispensables à la conduite autonome

Oct 12, 2023 am 11:21 AM

Le premier article pilote et clé présente principalement plusieurs systèmes de coordonnées couramment utilisés dans la technologie de conduite autonome, et comment compléter la corrélation et la conversion entre eux, et enfin construire un modèle d'environnement unifié. L'objectif ici est de comprendre la conversion du véhicule en corps rigide de caméra (paramètres externes), la conversion de caméra en image (paramètres internes) et la conversion d'image en unité de pixel. La conversion de 3D en 2D aura une distorsion, une traduction, etc. Points clés : Le système de coordonnées du véhicule et le système de coordonnées du corps de la caméra doivent être réécrits : le système de coordonnées planes et le système de coordonnées des pixels Difficulté : la distorsion de l'image doit être prise en compte. La dé-distorsion et l'ajout de distorsion sont compensés sur le plan de l'image. 2. Introduction Il existe quatre systèmes de vision au total : système de coordonnées du plan de pixels (u, v), système de coordonnées d'image (x, y), système de coordonnées de caméra () et système de coordonnées mondiales (). Il existe une relation entre chaque système de coordonnées,

Cet article vous suffit pour en savoir plus sur la conduite autonome et la prédiction de trajectoire !

Feb 28, 2024 pm 07:20 PM

Cet article vous suffit pour en savoir plus sur la conduite autonome et la prédiction de trajectoire !

Feb 28, 2024 pm 07:20 PM

La prédiction de trajectoire joue un rôle important dans la conduite autonome. La prédiction de trajectoire de conduite autonome fait référence à la prédiction de la trajectoire de conduite future du véhicule en analysant diverses données pendant le processus de conduite du véhicule. En tant que module central de la conduite autonome, la qualité de la prédiction de trajectoire est cruciale pour le contrôle de la planification en aval. La tâche de prédiction de trajectoire dispose d'une riche pile technologique et nécessite une connaissance de la perception dynamique/statique de la conduite autonome, des cartes de haute précision, des lignes de voie, des compétences en architecture de réseau neuronal (CNN&GNN&Transformer), etc. Il est très difficile de démarrer ! De nombreux fans espèrent se lancer dans la prédiction de trajectoire le plus tôt possible et éviter les pièges. Aujourd'hui, je vais faire le point sur quelques problèmes courants et des méthodes d'apprentissage introductives pour la prédiction de trajectoire ! Connaissances introductives 1. Existe-t-il un ordre d'entrée pour les épreuves de prévisualisation ? R : Regardez d’abord l’enquête, p

DualBEV : dépassant largement BEVFormer et BEVDet4D, ouvrez le livre !

Mar 21, 2024 pm 05:21 PM

DualBEV : dépassant largement BEVFormer et BEVDet4D, ouvrez le livre !

Mar 21, 2024 pm 05:21 PM

Cet article explore le problème de la détection précise d'objets sous différents angles de vue (tels que la perspective et la vue à vol d'oiseau) dans la conduite autonome, en particulier comment transformer efficacement les caractéristiques de l'espace en perspective (PV) en vue à vol d'oiseau (BEV). implémenté via le module Visual Transformation (VT). Les méthodes existantes sont globalement divisées en deux stratégies : la conversion 2D en 3D et la conversion 3D en 2D. Les méthodes 2D vers 3D améliorent les caractéristiques 2D denses en prédisant les probabilités de profondeur, mais l'incertitude inhérente aux prévisions de profondeur, en particulier dans les régions éloignées, peut introduire des inexactitudes. Alors que les méthodes 3D vers 2D utilisent généralement des requêtes 3D pour échantillonner des fonctionnalités 2D et apprendre les poids d'attention de la correspondance entre les fonctionnalités 3D et 2D via un transformateur, ce qui augmente le temps de calcul et de déploiement.

Le premier modèle mondial de génération de vidéos de scènes de conduite autonomes multi-vues DrivingDiffusion : nouvelles idées pour les données et la simulation BEV

Oct 23, 2023 am 11:13 AM

Le premier modèle mondial de génération de vidéos de scènes de conduite autonomes multi-vues DrivingDiffusion : nouvelles idées pour les données et la simulation BEV

Oct 23, 2023 am 11:13 AM

Quelques réflexions personnelles de l'auteur Dans le domaine de la conduite autonome, avec le développement de sous-tâches/solutions de bout en bout basées sur BEV, les données d'entraînement multi-vues de haute qualité et la construction de scènes de simulation correspondantes sont devenues de plus en plus importantes. En réponse aux problèmes des tâches actuelles, la « haute qualité » peut être divisée en trois aspects : des scénarios à longue traîne dans différentes dimensions : comme les véhicules à courte portée dans les données sur les obstacles et les angles de cap précis lors du découpage des voitures, et les données sur les lignes de voie. . Scènes telles que des courbes avec des courbures différentes ou des rampes/fusions/fusions difficiles à capturer. Celles-ci reposent souvent sur de grandes quantités de données collectées et sur des stratégies complexes d’exploration de données, qui sont coûteuses. Valeur réelle 3D - image hautement cohérente : l'acquisition actuelle des données BEV est souvent affectée par des erreurs d'installation/calibrage du capteur, des cartes de haute précision et l'algorithme de reconstruction lui-même. cela m'a amené à

GSLAM | Une architecture générale et un benchmark

Oct 20, 2023 am 11:37 AM

GSLAM | Une architecture générale et un benchmark

Oct 20, 2023 am 11:37 AM

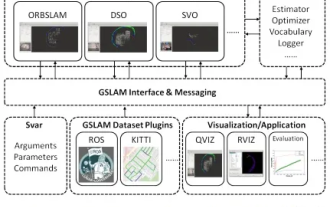

J'ai soudainement découvert un article vieux de 19 ans GSLAM : A General SLAM Framework and Benchmark open source code : https://github.com/zdzhaoyong/GSLAM Accédez directement au texte intégral et ressentez la qualité de ce travail ~ 1 Technologie SLAM abstraite a remporté de nombreux succès récemment et a attiré de nombreuses entreprises de haute technologie. Cependant, la question de savoir comment s'interfacer avec les algorithmes existants ou émergents pour effectuer efficacement des analyses comparatives en termes de vitesse, de robustesse et de portabilité reste une question. Dans cet article, une nouvelle plateforme SLAM appelée GSLAM est proposée, qui fournit non seulement des capacités d'évaluation, mais fournit également aux chercheurs un moyen utile de développer rapidement leurs propres systèmes SLAM.

Comprenez facilement les images 4K HD ! Ce grand modèle multimodal analyse automatiquement le contenu des affiches Web, ce qui le rend très pratique pour les travailleurs.

Apr 23, 2024 am 08:04 AM

Comprenez facilement les images 4K HD ! Ce grand modèle multimodal analyse automatiquement le contenu des affiches Web, ce qui le rend très pratique pour les travailleurs.

Apr 23, 2024 am 08:04 AM

Un modèle volumineux capable d'analyser automatiquement le contenu des PDF, des pages Web, des affiches et des graphiques Excel n'est pas très pratique pour les travailleurs. Le modèle InternLM-XComposer2-4KHD (en abrégé IXC2-4KHD) proposé par Shanghai AILab, l'Université chinoise de Hong Kong et d'autres instituts de recherche en fait une réalité. Par rapport à d'autres grands modèles multimodaux qui ont une limite de résolution ne dépassant pas 1 500 x 1 500, ce travail augmente l'image d'entrée maximale des grands modèles multimodaux à une résolution supérieure à 4K (3 840 x 1 600) et prend en charge n'importe quel rapport d'aspect et 336 pixels en 4K. Changements de résolution dynamiques. Trois jours après sa sortie, le modèle était en tête de la liste de popularité des modèles de réponses visuelles aux questions HuggingFace. Facile à manier

'Minecraft' se transforme en une ville IA et les habitants des PNJ jouent comme de vraies personnes

Jan 02, 2024 pm 06:25 PM

'Minecraft' se transforme en une ville IA et les habitants des PNJ jouent comme de vraies personnes

Jan 02, 2024 pm 06:25 PM

Veuillez noter que cet homme carré fronça les sourcils, pensant à l'identité des « invités non invités » devant lui. Il s’est avéré qu’elle se trouvait dans une situation dangereuse, et une fois qu’elle s’en est rendu compte, elle a rapidement commencé une recherche mentale pour trouver une stratégie pour résoudre le problème. Finalement, elle a décidé de fuir les lieux, de demander de l'aide le plus rapidement possible et d'agir immédiatement. En même temps, la personne de l'autre côté pensait la même chose qu'elle... Il y avait une telle scène dans "Minecraft" où tous les personnages étaient contrôlés par l'intelligence artificielle. Chacun d’eux a un cadre identitaire unique. Par exemple, la jeune fille mentionnée précédemment est une coursière de 17 ans mais intelligente et courageuse. Ils ont la capacité de se souvenir, de penser et de vivre comme des humains dans cette petite ville de Minecraft. Ce qui les anime est une toute nouvelle,