Périphériques technologiques

Périphériques technologiques

IA

IA

Résolvez complètement l'amnésie ChatGPT ! Dépasser la limite d'entrée du transformateur : mesuré pour prendre en charge 2 millions de jetons valides

Résolvez complètement l'amnésie ChatGPT ! Dépasser la limite d'entrée du transformateur : mesuré pour prendre en charge 2 millions de jetons valides

Résolvez complètement l'amnésie ChatGPT ! Dépasser la limite d'entrée du transformateur : mesuré pour prendre en charge 2 millions de jetons valides

ChatGPT, ou le modèle de classe Transformer, présente un défaut fatal, à savoir qu'il est trop facile à oublier. Une fois que le jeton de la séquence d'entrée dépasse le seuil de la fenêtre contextuelle, le contenu de sortie ultérieur ne correspondra pas à la logique précédente.

ChatGPT ne peut prendre en charge que la saisie de 4 000 jetons (environ 3 000 mots). Même le nouveau GPT-4 ne prend en charge qu'une fenêtre de jetons maximale de 32 000. Si vous continuez à augmenter la longueur de la séquence de saisie, la complexité de calcul deviendra croissance quadratique.

Récemment, des chercheurs de DeepPavlov, AIRI et du London Institute of Mathematical Sciences ont publié un rapport technique utilisant le Recurrent Memory Transformer (RMT) pour augmenter la longueur effective du contexte de BERT à « un niveau sans précédent de 2 millions de jetons » tout en maintenant une récupération de mémoire élevée. précision.

Lien papier : https://www.php.cn/link/459ad054a6417248a1166b30f6393301

Cette méthode peut stocker et traiter des informations locales et globales, et permettre aux informations de circuler entre les segments de la séquence d'entrée en utilisant des boucles.

La section expérimentale démontre l'efficacité de cette approche, qui a un potentiel extraordinaire pour améliorer le traitement des dépendances à long terme dans les tâches de compréhension et de génération du langage naturel, permettant un traitement contextuel à grande échelle pour les applications gourmandes en mémoire.

Cependant, il n'y a pas de repas gratuit dans le monde. Bien que RMT n'augmente pas la consommation de mémoire et puisse être étendu à des longueurs de séquence presque illimitées, le problème de la dégradation de la mémoire dans RNN persiste et un temps d'inférence plus long est nécessaire.

Mais certains internautes ont proposé une solution, RMT est utilisé pour la mémoire à long terme, un grand contexte est utilisé pour la mémoire à court terme, puis l'entraînement du modèle est effectué la nuit/pendant la maintenance.

Recurrent Memory Transformer

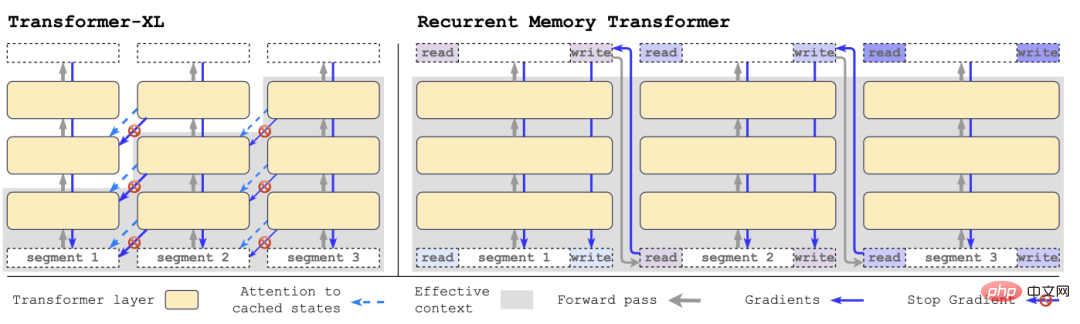

En 2022, l'équipe a proposé le modèle Recurrent Memory Transformer (RMT) en ajoutant un jeton de mémoire spécial à la séquence d'entrée ou de sortie, puis en entraînant le modèle pour contrôler les opérations de mémoire et le traitement de la représentation de séquence. peut implémenter un nouveau mécanisme de mémoire sans modifier le modèle original du Transformer.

Lien papier : https://arxiv.org/abs/2207.06881

Conférence de publication : NeurIPS 2022

Par rapport à Transformer-XL, RMT nécessite moins de mémoire et peut gérer des tâches avec des séquences plus longues.

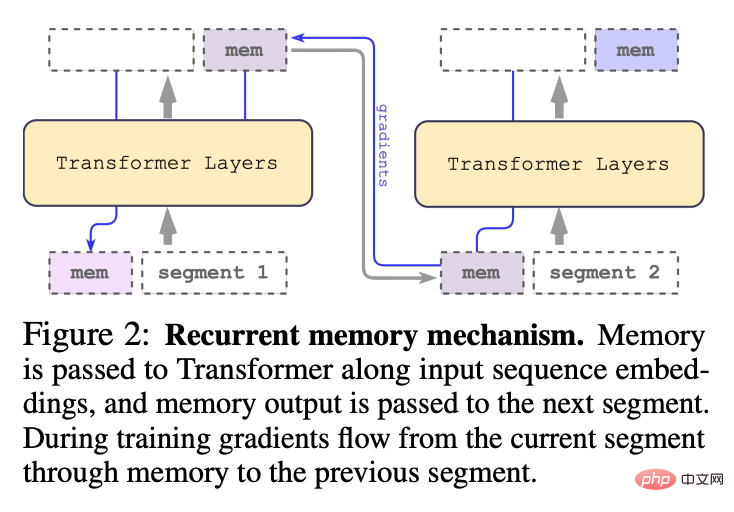

Plus précisément, RMT se compose de m vecteurs entraînables à valeur réelle. La séquence d'entrée trop longue est divisée en plusieurs segments. Le vecteur mémoire est prédéfini pour l'intégration du premier segment et combiné avec les jetons de segment. .

Différent du modèle RMT original proposé en 2022, pour les modèles d'encodeurs purs comme BERT, la mémoire n'est ajoutée qu'une seule fois au début du segment ; le modèle de décodage divise la mémoire en parties de lecture et d'écriture.

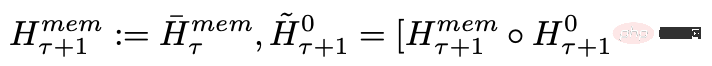

Dans chaque pas de temps et segment, bouclez comme suit, où N est le nombre de couches de Transformer, t est le pas de temps et H est le segment

Après avoir traité les segments de la séquence d'entrée dans l'ordre, afin de réaliser une connexion récursive, les chercheurs transmettent la sortie du jeton mémoire du segment actuel à l'entrée du segment suivant :

La mémoire et la boucle dans RMT sont uniquement basées sur le jeton mémoire global, qui peut conservez le modèle de base du Transformer inchangé, ce qui rend les capacités d'amélioration de la mémoire RMT compatibles avec n'importe quel modèle de Transformer.

Efficacité informatique

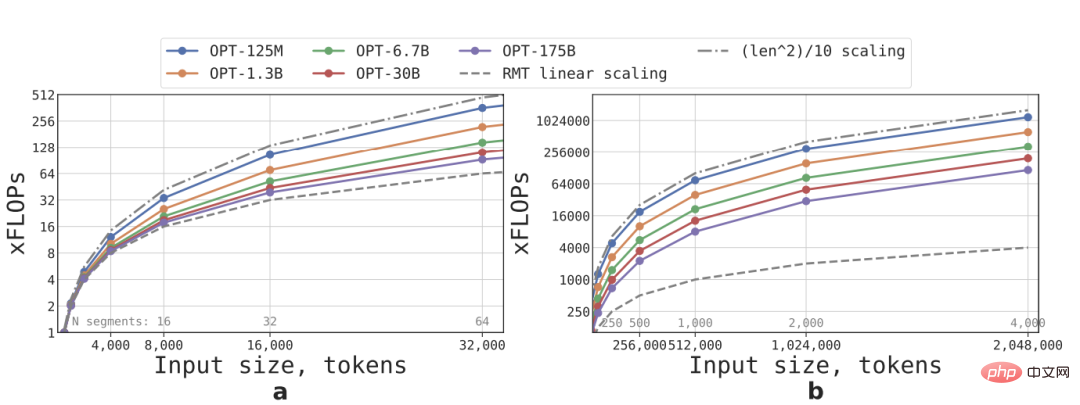

Selon la formule, les FLOP requis pour les modèles RMT et Transformer de différentes tailles et longueurs de séquence peuvent être estimés

Recherche sur la configuration des paramètres de taille du vocabulaire, nombre de couches, taille cachée, taille cachée intermédiaire et nombre de têtes d'attention.Nous avons suivi la configuration du modèle OPT et calculé le nombre de FLOP après la passe avant, en tenant compte de l'impact du cycle RMT.

L'expansion linéaire est obtenue en divisant une séquence d'entrée en plusieurs segments et en calculant toutes les matrices d'attention uniquement dans les limites du segment. Les résultats peuvent voir que si la longueur du segment est fixe, la vitesse d'inférence du RMT est meilleure. pour n’importe quelle taille de modèle. Tous grandissent de manière linéaire.

En raison de la grande quantité de calculs de la couche FFN, les modèles Transformer plus grands ont tendance à montrer un taux de croissance quadratique plus lent par rapport à la longueur de la séquence. Cependant, sur les séquences extrêmement longues d'une longueur supérieure à 32 000, les FLOP reviennent au statut de croissance quadratique. .

Pour les séquences comportant plus d'un segment (plus de 512 dans cette étude), le RMT a des FLOP inférieurs à ceux du modèle acyclique et peut augmenter l'efficacité des FLOP jusqu'à × 295 fois sur des modèles de plus petite taille ; modèles Les grands modèles tels que l'OPT-175B peuvent être améliorés de 29 fois.

Tâche de mémoire

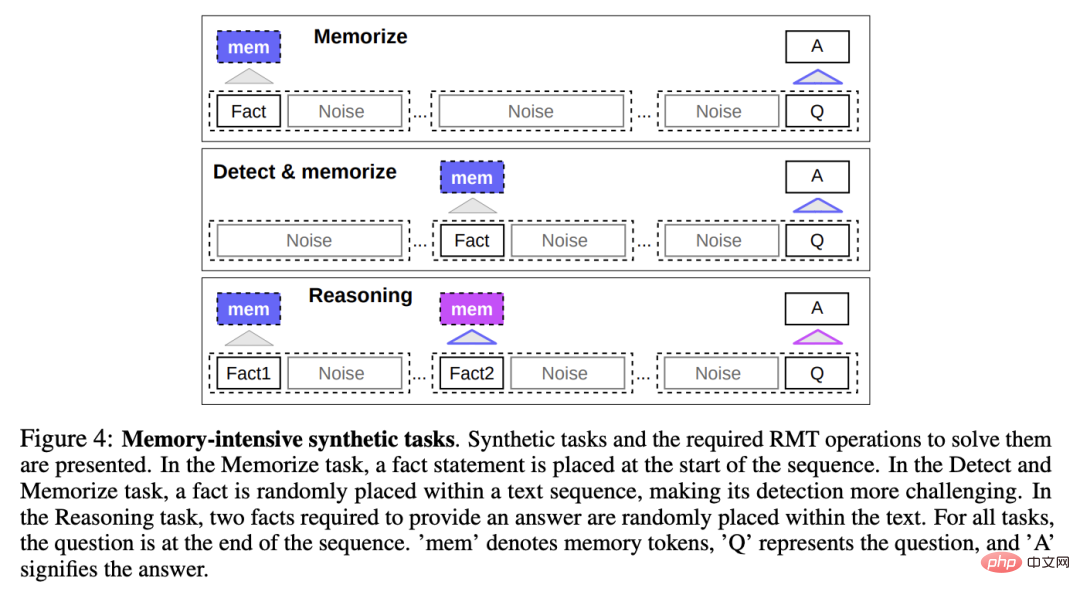

Pour tester les capacités de mémoire, les chercheurs ont construit un ensemble de données synthétiques qui nécessitait que le modèle mémorise des faits simples et des raisonnements de base.

La saisie des tâches consiste en un ou plusieurs faits et une question à laquelle on ne peut répondre qu'avec tous ces faits.

Pour augmenter la difficulté de la tâche, un texte en langage naturel qui n'est pas lié à la question ou à la réponse est également ajouté à la tâche. Ces textes peuvent être considérés comme du bruit, la tâche du modèle est donc en fait de séparer les faits des faits. le texte non pertinent et utilisez le texte des faits pour répondre à la question.

Mémoire des faits

Teste la capacité du RMT à écrire et stocker des informations en mémoire pendant de longues périodes : dans le cas le plus simple, les faits sont au début de la saisie, les questions sont au début fin de la saisie, et augmentez progressivement la quantité de texte non pertinent entre les questions et les réponses jusqu'à ce que le modèle ne puisse pas accepter toutes les saisies en même temps.

Détection des faits et mémoire

La détection des faits augmente la difficulté de la tâche en déplaçant le fait vers une position aléatoire dans l'entrée, obligeant le modèle à d'abord distinguer le fait du texte non pertinent et à l'écrire en mémoire, puis répondez à la question à la fin.

Raisonnement basé sur des faits mémorisés

Une autre opération importante de la mémoire consiste à raisonner en utilisant des faits mémorisés et le contexte actuel.

Pour évaluer cette fonctionnalité, les chercheurs ont introduit une tâche plus complexe dans laquelle deux faits sont générés et placés aléatoirement dans la séquence d'entrée ; une question posée à la fin de la séquence doit être choisie pour répondre à la question avec le fait correct.

Résultats expérimentaux

Les chercheurs ont utilisé le modèle pré-entraîné à base de Bert dans HuggingFace Transformers comme épine dorsale du RMT dans toutes les expériences, et tous les modèles ont été améliorés avec une taille de mémoire de 10.

Entraînez-vous et évaluez sur 4 à 8 GPU NVIDIA 1080Ti ; pour des séquences plus longues, passez à un seul NVIDIA A100 de 40 Go pour une évaluation accélérée.

Curriculum Learning

Les chercheurs ont observé que l'utilisation de la planification de la formation peut améliorer considérablement la précision et la stabilité de la solution.

Commencez simplement la formation RMT sur une version plus courte de la tâche. Une fois la formation converge, augmentez la durée de la tâche en ajoutant un segment et continuez le processus d'apprentissage du cours jusqu'à ce que la longueur d'entrée idéale soit atteinte.

Démarrez l'expérience avec une séquence qui correspond à un seul segment. La taille réelle du segment est de 499 car 3 jetons spéciaux de BERT et 10 espaces réservés de mémoire sont conservés de l'entrée du modèle, ce qui donne une taille totale de 512.

On peut remarquer qu'après un entraînement sur des tâches plus courtes, le RMT est plus facile à résoudre des tâches plus longues car il converge vers une solution parfaite en utilisant moins d'étapes d'entraînement.

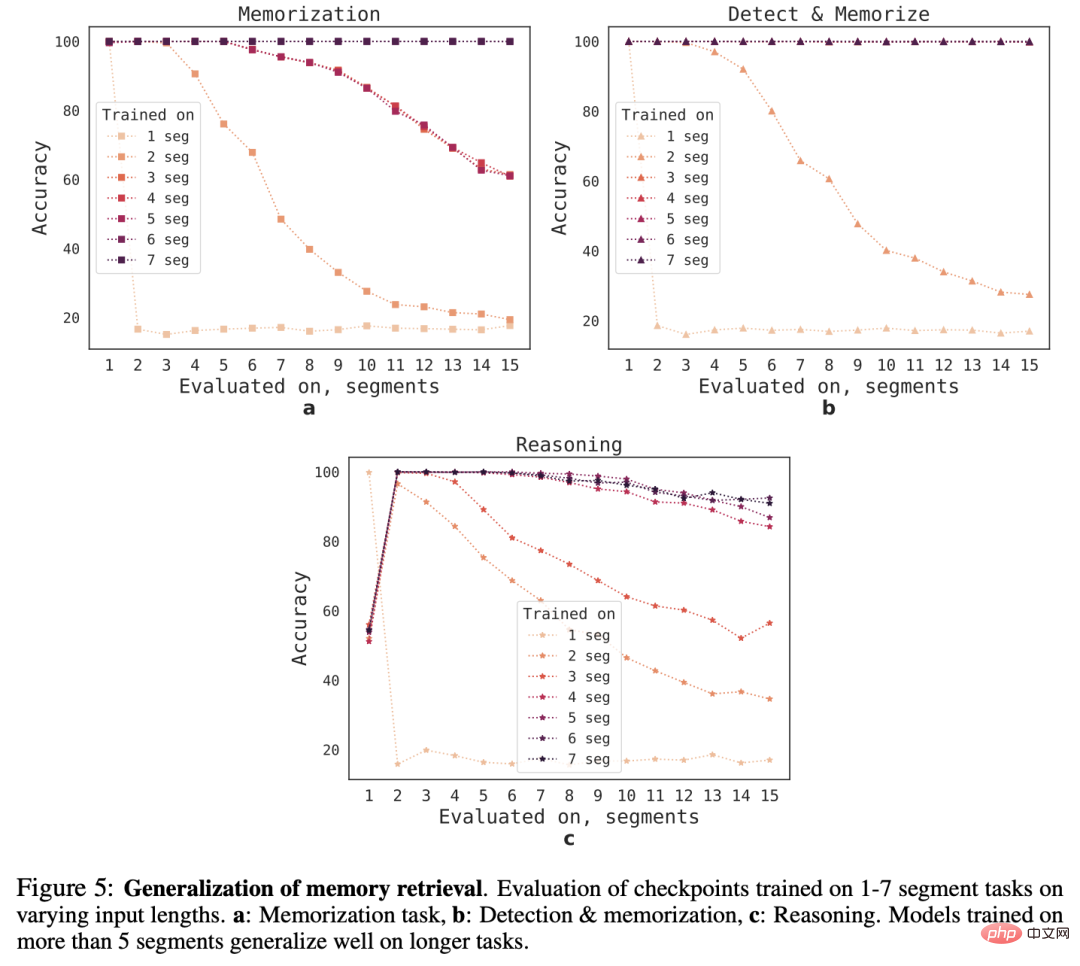

Capacités d'extrapolation

Afin d'observer la capacité de généralisation du RMT à différentes longueurs de séquence, les chercheurs ont évalué des modèles entraînés sur différents nombres de segments pour résoudre des tâches de plus grandes longueurs.

On peut observer que le modèle fonctionne souvent bien sur des tâches plus courtes, mais après avoir entraîné le modèle sur des séquences plus longues, il devient difficile de gérer des tâches d'inférence sur un seul segment.

Une explication possible est que, comme la taille de la tâche dépasse un segment, le modèle cesse d'anticiper le problème dans le premier segment, ce qui entraîne une baisse de qualité.

Fait intéressant, à mesure que le nombre de segments d'entraînement augmente, la capacité de généralisation du RMT sur des séquences plus longues apparaît également. Après un entraînement sur 5 segments ou plus, le RMT peut effectuer près de deux fois plus de temps sur des tâches de généralisation parfaite.

Pour tester la limite de généralisation, les chercheurs ont augmenté la taille de la tâche de vérification à 4096 segments (soit 2 043 904 tokens).

RMT résiste étonnamment bien sur des séquences aussi longues, parmi lesquelles la tâche « détection et mémoire » est la plus simple et la tâche d'inférence est la plus complexe.

Référence : https://www.php.cn/link/459ad054a6417248a1166b30f6393301

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

ChatGPT permet désormais aux utilisateurs gratuits de générer des images en utilisant DALL-E 3 avec une limite quotidienne

Aug 09, 2024 pm 09:37 PM

ChatGPT permet désormais aux utilisateurs gratuits de générer des images en utilisant DALL-E 3 avec une limite quotidienne

Aug 09, 2024 pm 09:37 PM

Le DALL-E 3 a été officiellement introduit en septembre 2023 en tant que modèle considérablement amélioré par rapport à son prédécesseur. Il est considéré comme l’un des meilleurs générateurs d’images IA à ce jour, capable de créer des images avec des détails complexes. Cependant, au lancement, c'était exclu

Le modèle MoE open source le plus puissant au monde est ici, avec des capacités chinoises comparables à celles du GPT-4, et le prix ne représente que près d'un pour cent de celui du GPT-4-Turbo.

May 07, 2024 pm 04:13 PM

Le modèle MoE open source le plus puissant au monde est ici, avec des capacités chinoises comparables à celles du GPT-4, et le prix ne représente que près d'un pour cent de celui du GPT-4-Turbo.

May 07, 2024 pm 04:13 PM

Imaginez un modèle d'intelligence artificielle qui non seulement a la capacité de surpasser l'informatique traditionnelle, mais qui permet également d'obtenir des performances plus efficaces à moindre coût. Ce n'est pas de la science-fiction, DeepSeek-V2[1], le modèle MoE open source le plus puissant au monde est ici. DeepSeek-V2 est un puissant mélange de modèle de langage d'experts (MoE) présentant les caractéristiques d'une formation économique et d'une inférence efficace. Il est constitué de 236B paramètres, dont 21B servent à activer chaque marqueur. Par rapport à DeepSeek67B, DeepSeek-V2 offre des performances plus élevées, tout en économisant 42,5 % des coûts de formation, en réduisant le cache KV de 93,3 % et en augmentant le débit de génération maximal à 5,76 fois. DeepSeek est une entreprise explorant l'intelligence artificielle générale

KAN, qui remplace MLP, a été étendu à la convolution par des projets open source

Jun 01, 2024 pm 10:03 PM

KAN, qui remplace MLP, a été étendu à la convolution par des projets open source

Jun 01, 2024 pm 10:03 PM

Plus tôt ce mois-ci, des chercheurs du MIT et d'autres institutions ont proposé une alternative très prometteuse au MLP – KAN. KAN surpasse MLP en termes de précision et d’interprétabilité. Et il peut surpasser le MLP fonctionnant avec un plus grand nombre de paramètres avec un très petit nombre de paramètres. Par exemple, les auteurs ont déclaré avoir utilisé KAN pour reproduire les résultats de DeepMind avec un réseau plus petit et un degré d'automatisation plus élevé. Plus précisément, le MLP de DeepMind compte environ 300 000 paramètres, tandis que le KAN n'en compte qu'environ 200. KAN a une base mathématique solide comme MLP est basé sur le théorème d'approximation universelle, tandis que KAN est basé sur le théorème de représentation de Kolmogorov-Arnold. Comme le montre la figure ci-dessous, KAN a

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas entre officiellement dans l’ère des robots électriques ! Hier, l'Atlas hydraulique s'est retiré "en larmes" de la scène de l'histoire. Aujourd'hui, Boston Dynamics a annoncé que l'Atlas électrique était au travail. Il semble que dans le domaine des robots humanoïdes commerciaux, Boston Dynamics soit déterminé à concurrencer Tesla. Après la sortie de la nouvelle vidéo, elle a déjà été visionnée par plus d’un million de personnes en seulement dix heures. Les personnes âgées partent et de nouveaux rôles apparaissent. C'est une nécessité historique. Il ne fait aucun doute que cette année est l’année explosive des robots humanoïdes. Les internautes ont commenté : Les progrès des robots ont fait ressembler la cérémonie d'ouverture de cette année à des êtres humains, et le degré de liberté est bien plus grand que celui des humains. Mais n'est-ce vraiment pas un film d'horreur ? Au début de la vidéo, Atlas est allongé calmement sur le sol, apparemment sur le dos. Ce qui suit est à couper le souffle

Les robots Tesla travaillent dans les usines, Musk : Le degré de liberté des mains atteindra 22 cette année !

May 06, 2024 pm 04:13 PM

Les robots Tesla travaillent dans les usines, Musk : Le degré de liberté des mains atteindra 22 cette année !

May 06, 2024 pm 04:13 PM

La dernière vidéo du robot Optimus de Tesla est sortie, et il peut déjà fonctionner en usine. À vitesse normale, il trie les batteries (les batteries 4680 de Tesla) comme ceci : Le responsable a également publié à quoi cela ressemble à une vitesse 20 fois supérieure - sur un petit "poste de travail", en sélectionnant et en sélectionnant et en sélectionnant : Cette fois, il est publié L'un des points forts de la vidéo est qu'Optimus réalise ce travail en usine, de manière totalement autonome, sans intervention humaine tout au long du processus. Et du point de vue d'Optimus, il peut également récupérer et placer la batterie tordue, en se concentrant sur la correction automatique des erreurs : concernant la main d'Optimus, le scientifique de NVIDIA Jim Fan a donné une évaluation élevée : la main d'Optimus est l'un des robots à cinq doigts du monde. le plus adroit. Ses mains ne sont pas seulement tactiles

FisheyeDetNet : le premier algorithme de détection de cible basé sur une caméra fisheye

Apr 26, 2024 am 11:37 AM

FisheyeDetNet : le premier algorithme de détection de cible basé sur une caméra fisheye

Apr 26, 2024 am 11:37 AM

La détection de cibles est un problème relativement mature dans les systèmes de conduite autonome, parmi lesquels la détection des piétons est l'un des premiers algorithmes à être déployés. Des recherches très complètes ont été menées dans la plupart des articles. Cependant, la perception de la distance à l’aide de caméras fisheye pour une vue panoramique est relativement moins étudiée. En raison de la distorsion radiale importante, la représentation standard du cadre de délimitation est difficile à mettre en œuvre dans les caméras fisheye. Pour alléger la description ci-dessus, nous explorons les conceptions étendues de boîtes englobantes, d'ellipses et de polygones généraux dans des représentations polaires/angulaires et définissons une métrique de segmentation d'instance mIOU pour analyser ces représentations. Le modèle fisheyeDetNet proposé avec une forme polygonale surpasse les autres modèles et atteint simultanément 49,5 % de mAP sur l'ensemble de données de la caméra fisheye Valeo pour la conduite autonome.

Une seule carte exécute Llama 70B plus rapidement que deux cartes, Microsoft vient de mettre le FP6 dans l'Open source A100 |

Apr 29, 2024 pm 04:55 PM

Une seule carte exécute Llama 70B plus rapidement que deux cartes, Microsoft vient de mettre le FP6 dans l'Open source A100 |

Apr 29, 2024 pm 04:55 PM

Le FP8 et la précision de quantification inférieure en virgule flottante ne sont plus le « brevet » du H100 ! Lao Huang voulait que tout le monde utilise INT8/INT4, et l'équipe Microsoft DeepSpeed a commencé à exécuter FP6 sur A100 sans le soutien officiel de NVIDIA. Les résultats des tests montrent que la quantification FP6 de la nouvelle méthode TC-FPx sur A100 est proche ou parfois plus rapide que celle de INT4, et a une précision supérieure à celle de cette dernière. En plus de cela, il existe également une prise en charge de bout en bout des grands modèles, qui ont été open source et intégrés dans des cadres d'inférence d'apprentissage profond tels que DeepSpeed. Ce résultat a également un effet immédiat sur l'accélération des grands modèles : dans ce cadre, en utilisant une seule carte pour exécuter Llama, le débit est 2,65 fois supérieur à celui des cartes doubles. un

Les dernières nouvelles de l'Université d'Oxford ! Mickey : correspondance d'images 2D en 3D SOTA ! (CVPR\'24)

Apr 23, 2024 pm 01:20 PM

Les dernières nouvelles de l'Université d'Oxford ! Mickey : correspondance d'images 2D en 3D SOTA ! (CVPR\'24)

Apr 23, 2024 pm 01:20 PM

Lien du projet écrit devant : https://nianticlabs.github.io/mickey/ Étant donné deux images, la pose de la caméra entre elles peut être estimée en établissant la correspondance entre les images. En règle générale, ces correspondances sont 2D à 2D et nos poses estimées sont à échelle indéterminée. Certaines applications, telles que la réalité augmentée instantanée, à tout moment et en tout lieu, nécessitent une estimation de pose des métriques d'échelle, elles s'appuient donc sur des estimateurs de profondeur externes pour récupérer l'échelle. Cet article propose MicKey, un processus de correspondance de points clés capable de prédire les correspondances métriques dans l'espace d'une caméra 3D. En apprenant la correspondance des coordonnées 3D entre les images, nous sommes en mesure de déduire des métriques relatives.