Périphériques technologiques

Périphériques technologiques

IA

IA

Un article expliquant les principales difficultés techniques de la conduite autonome

Un article expliquant les principales difficultés techniques de la conduite autonome

Un article expliquant les principales difficultés techniques de la conduite autonome

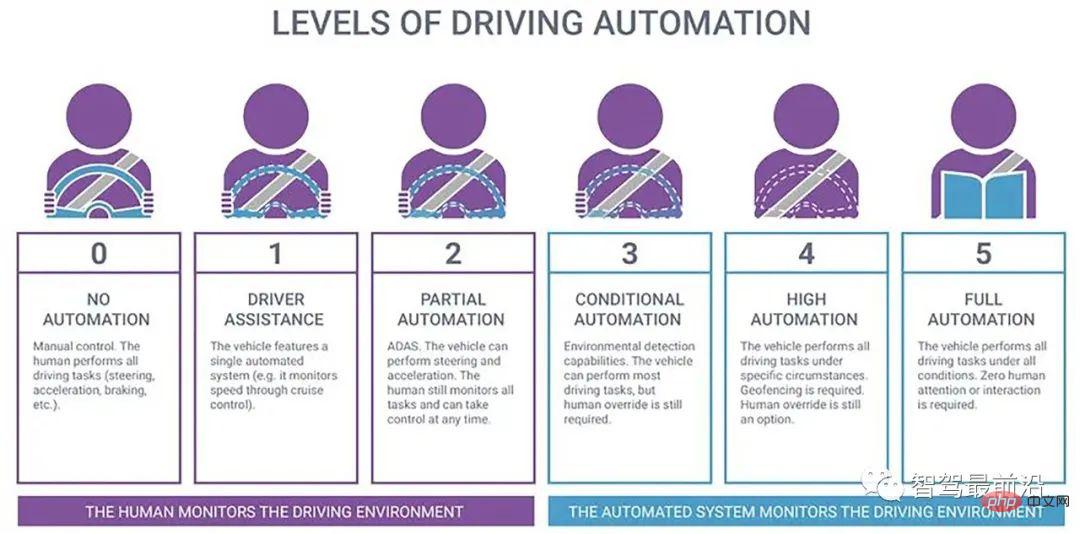

L'American Society of Automotive Engineers divise la conduite autonome en 6 niveaux, L0 à L5, en fonction du degré d'intelligence du véhicule :

-

L0 est No Automation (NA), c'est-à-dire une voiture traditionnelle, où le conducteur effectue toutes les opérations Tâches, telles que la direction, le freinage, l'accélération, la décélération ou le stationnement

-

L1 est un assistant de conduite (DA), qui peut fournir au conducteur un avertissement ou une assistance à la conduite, comme le volant ou l'accélération. en décélération est pris en charge, et le reste est actionné par le conducteur

-

L2 est une automatisation partielle (PA), le véhicule assure la conduite du volant et de multiples opérations en accélération et décélération, et le conducteur est responsable de autre opération de conduite ;

-

L3 est l'automatisation conditionnelle (CA), c'est-à-dire que le système de conduite automatique effectue la plupart des opérations de conduite et que le conducteur doit se concentrer en cas d'urgence

-

L4 ; Il s'agit d'une haute automatisation (HA), où toutes les opérations de conduite sont effectuées par le véhicule, et le conducteur n'a pas besoin de se concentrer, mais les conditions routières et environnementales sont limitées

- L5 est une automatisation complète (FA), où Dans toutes les conditions routières et environnementales, le système de conduite autonome effectue toutes les opérations de conduite et le conducteur n'a pas besoin de se concentrer.

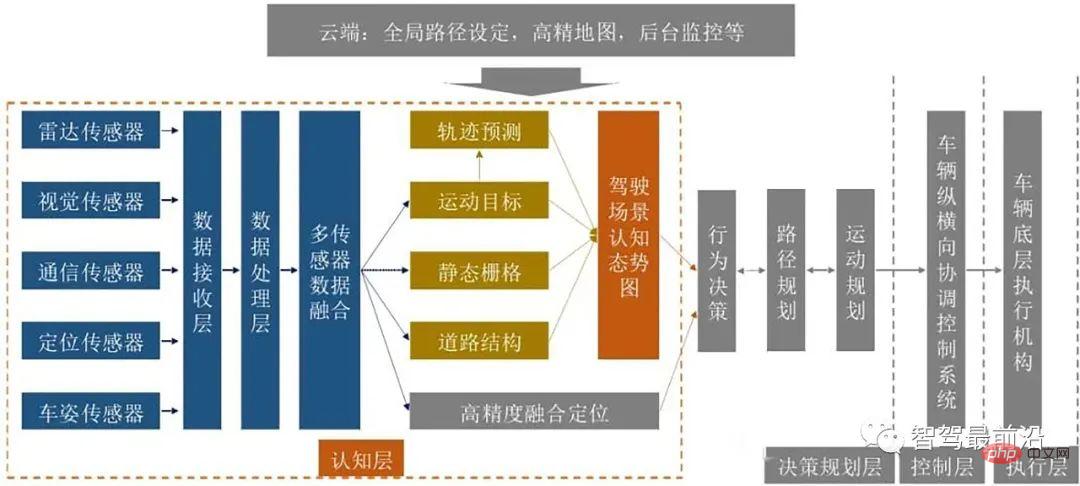

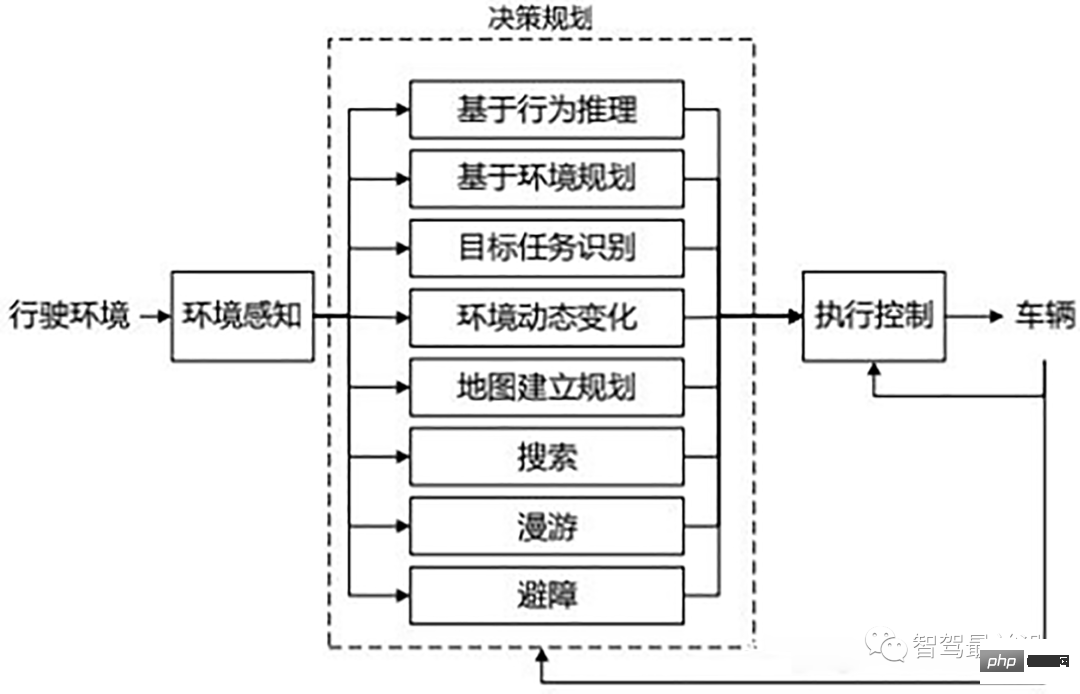

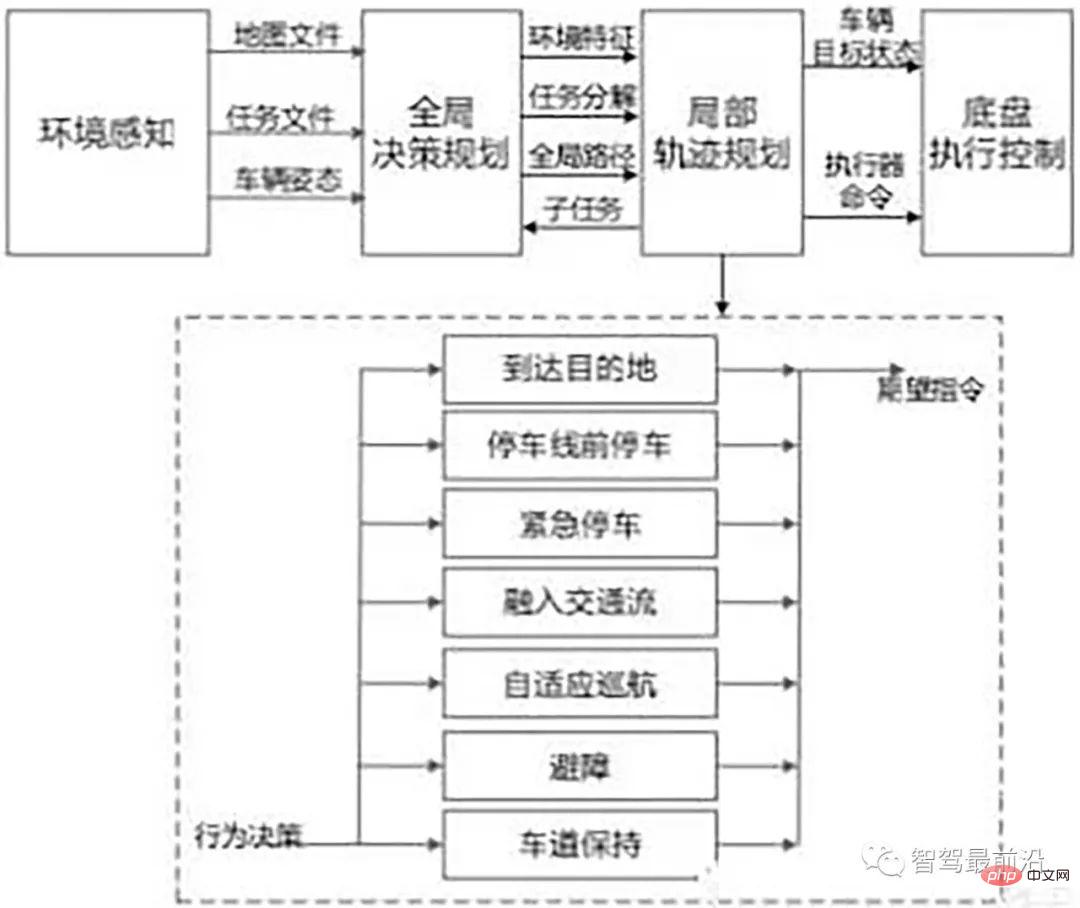

L'architecture logicielle et matérielle d'un véhicule autonome est présentée dans la figure 2, qui est principalement divisée en couche de sensibilisation à l'environnement, couche de prise de décision et de planification, couche de contrôle et couche d'exécution. La couche de reconnaissance (détection) de l'environnement obtient principalement les informations environnementales du véhicule et les informations sur l'état du véhicule via des capteurs tels que le lidar, le radar à ondes millimétriques, le radar à ultrasons, les caméras du véhicule, les systèmes de vision nocturne, le GPS et les gyroscopes. Plus précisément, elle comprend : la détection des lignes de voie. , reconnaissance des feux de circulation, reconnaissance des panneaux de signalisation, détection des piétons, détection des véhicules, reconnaissance des obstacles et positionnement des véhicules, etc. la couche de prise de décision et de planification est divisée en planification des tâches, planification du comportement et planification de la trajectoire, sur la base de la planification d'itinéraire définie et ; l'environnement et l'état du véhicule pour planifier les prochaines tâches de conduite spécifiques (maintien de voie, changement de voie, suivi, dépassement, évitement de collision, etc.), les comportements (accélération, décélération, virage, freinage, etc.) et les trajectoires (conduite). trajectoires) ; couche de contrôle et exécution. La couche contrôle la conduite, le freinage, la direction, etc. du véhicule en fonction du modèle du système dynamique du véhicule, afin que le véhicule suive la trajectoire de conduite prescrite.

La technologie de conduite autonome implique de nombreuses technologies clés. Cet article présente principalement la technologie de perception de l'environnement, la technologie de positionnement de haute précision, la technologie de prise de décision et de planification, ainsi que la technologie de contrôle et d'exécution.

01 Technologie de perception de l'environnement

La perception de l'environnement fait référence à la capacité de comprendre la scène de l'environnement, telle que les types d'obstacles, les panneaux et marquages routiers, la détection des véhicules en marche, la classification linguistique des informations routières et d'autres données. . Le positionnement est le post-traitement des résultats de perception, qui aide le véhicule à comprendre sa position par rapport à son environnement grâce à la fonction de positionnement. La perception de l'environnement nécessite d'obtenir une grande quantité d'informations sur l'environnement via des capteurs pour garantir une compréhension correcte de l'environnement du véhicule et prendre les décisions et planifications correspondantes sur cette base.

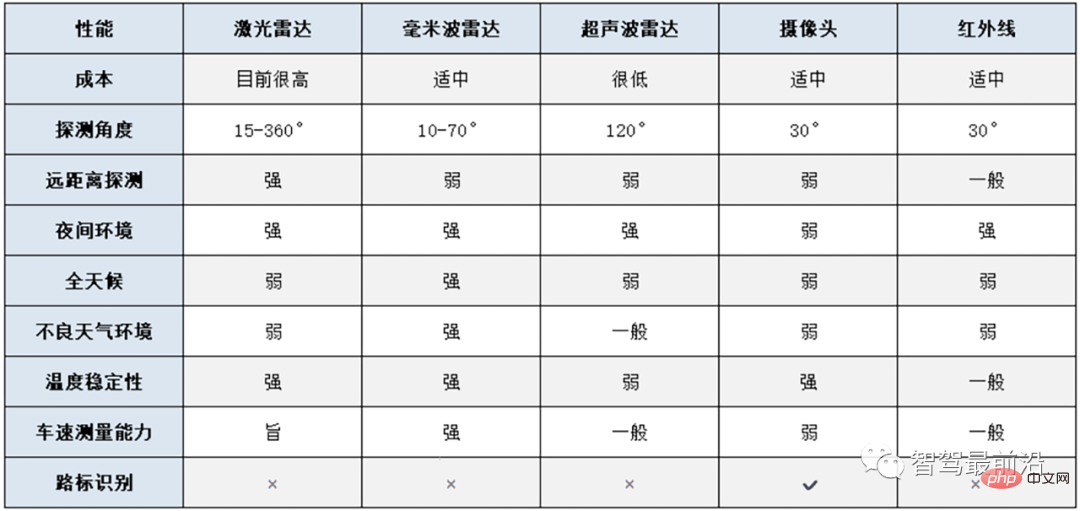

Les capteurs de perception de l'environnement couramment utilisés pour les véhicules autonomes comprennent : les caméras, le lidar, le radar à ondes millimétriques, le radar infrarouge et ultrasonique, etc. Les caméras sont les plus couramment utilisées, les plus simples et les plus proches du principe d’imagerie de l’œil humain des capteurs de perception de l’environnement pour les véhicules autonomes. En capturant l'environnement autour du véhicule en temps réel, la technologie CV est utilisée pour analyser les images capturées afin de réaliser des fonctions telles que la détection des véhicules et des piétons et la reconnaissance des panneaux de signalisation autour du véhicule.

Les principaux avantages de la caméra sont sa haute résolution et son faible coût. Cependant, par mauvais temps comme la nuit, la pluie, la neige, la brume, etc., les performances de la caméra diminueront rapidement. De plus, la distance de visualisation de la caméra est limitée et elle n'est pas adaptée à l'observation à longue distance.

Le radar à ondes millimétriques est également un capteur couramment utilisé pour les véhicules autonomes. Le radar à ondes millimétriques fait référence au radar qui fonctionne dans la bande d'ondes millimétriques (longueur d'onde 1-10 mm, domaine de fréquence 30-300 GHz). de vol). Les objets cibles sont détectés. Le radar à ondes millimétriques envoie en continu des signaux à ondes millimétriques au monde extérieur et reçoit le signal renvoyé par la cible. Il détermine la distance entre la cible et le véhicule en fonction de la différence de temps entre l'envoi et la réception du signal. Par conséquent, le radar à ondes millimétriques est principalement utilisé pour éviter les collisions entre les voitures et les objets environnants, comme la détection des angles morts, l'aide à l'évitement d'obstacles, l'aide au stationnement, la croisière adaptative, etc. Le radar à ondes millimétriques a une forte capacité anti-interférence, et sa capacité à pénétrer les précipitations, le sable, la poussière, la fumée et le plasma est beaucoup plus puissante que le laser et l'infrarouge, et il peut fonctionner par tous les temps. Cependant, il présente également des inconvénients tels qu'une atténuation importante du signal, une facilité de blocage par les bâtiments, les corps humains, etc., une courte distance de transmission, une faible résolution et des difficultés d'imagerie.

Lidar utilise également la technologie ToF pour déterminer l'emplacement et la distance de la cible. Le LiDAR détecte les cibles en émettant des faisceaux laser. Sa précision et sa sensibilité de détection sont plus élevées et sa plage de détection est plus large. Cependant, le LiDAR est plus sensible aux interférences de la pluie, de la neige, de la brume, etc. dans l'air, et son coût élevé limite également. son application. Le lidar monté sur véhicule peut être divisé en lidar à une ligne, 4 lignes, 8 lignes, 16 lignes et 64 lignes en fonction du nombre de faisceaux laser émis. Vous pouvez utiliser le tableau suivant (Tableau 1) pour comparer les avantages et les inconvénients des capteurs traditionnels.

La perception de l'environnement de conduite autonome adopte généralement deux voies techniques : « perception faible + super intelligence » et « perception forte + intelligence forte ». La technologie « perception faible + super intelligence » s'appuie principalement sur des caméras et une technologie d'apprentissage profond pour obtenir une perception environnementale, plutôt que sur le lidar. Cette technologie estime que les humains peuvent conduire avec une paire d'yeux et que la voiture peut également s'appuyer sur des caméras pour voir clairement l'environnement. Si la super intelligence est temporairement difficile à atteindre, afin de parvenir à une conduite sans conducteur, il est nécessaire d'améliorer les capacités de perception. Il s'agit de la voie technique dite « perception forte + intelligence forte ».

Par rapport à la voie technologique « perception faible + super intelligence », la plus grande caractéristique de la voie technologique « perception forte + intelligence forte » est l'ajout d'un capteur lidar, améliorant ainsi considérablement les capacités de perception. Tesla adopte la voie technique « intelligence faible + super intelligence », tandis que Google Waymo, Baidu Apollo, Uber, Ford Motor et d'autres sociétés d'intelligence artificielle, agences de voyage et constructeurs automobiles traditionnels adoptent toutes la voie technique « perception forte + intelligence forte ».

02 Technologie de positionnement de haute précision

Le but du positionnement est d'obtenir la position précise d'un véhicule autonome par rapport à l'environnement extérieur, ce qui constitue une base essentielle pour les véhicules autonomes. Lors de la conduite sur des routes urbaines complexes, la précision du positionnement nécessite une erreur ne dépassant pas 10 cm. Par exemple : ce n'est qu'en connaissant avec précision la distance entre le véhicule et l'intersection que nous pouvons faire des prévisions et des préparations plus précises. Ce n'est qu'en positionnant avec précision le véhicule que nous pouvons déterminer la voie dans laquelle se trouve le véhicule ; Si l'erreur de positionnement est élevée, cela peut provoquer un accident de la route complet.

Le GPS est actuellement la méthode de positionnement la plus utilisée. Plus la précision du GPS est élevée, plus le capteur GPS est cher. Cependant, la précision de positionnement actuelle de la technologie GPS commerciale est loin d'être suffisante. Sa précision n'est que d'un mètre et est facilement perturbée par des facteurs tels que l'obstruction du tunnel et le retard du signal. Afin de résoudre ce problème, Qualcomm a développé une technologie de positionnement de haute précision (VEPP) améliorée par la vision, qui intègre les informations de plusieurs composants automobiles tels que la navigation globale GNSS, les caméras, la navigation inertielle IMU et les capteurs de vitesse de roue et l'étalonnage mutuel. fusion pour obtenir un positionnement global en temps réel précis par rapport aux lignes de voie.

03 Technologie de décision et de planification

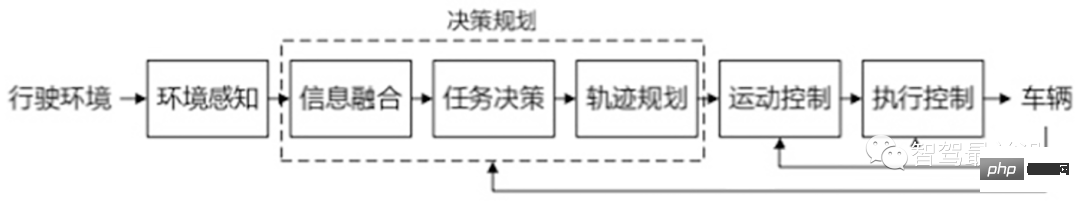

La planification décisionnelle est l'un des éléments clés de la conduite autonome. Elle fusionne d'abord les informations multicapteurs, puis prend des décisions de tâches en fonction des besoins de conduite, puis peut éviter les obstacles existants ci-dessous. , à travers certaines contraintes spécifiques, planifier plusieurs chemins sûrs qui peuvent être sélectionnés entre deux points, et sélectionner un chemin optimal parmi ces chemins comme trajectoire de conduite du véhicule, c'est-à-dire la planification. Selon différents niveaux de division, elle peut être divisée en deux types : la planification globale et la planification locale consiste à planifier un chemin optimal sans collision dans des conditions spécifiques sur la base des informations cartographiques obtenues. Par exemple, il existe de nombreuses routes entre Shanghai et Pékin. En planifier une comme itinéraire routier est la planification globale.

Algorithmes de planification de chemin statique tels que la méthode de la grille, la méthode du diagramme visuel, la méthode de la topologie, la méthode de l'espace libre, la méthode du réseau neuronal, etc. La planification locale est basée sur la planification globale et sur la base de certaines informations environnementales locales, c'est un processus qui peut éviter une collision avec des obstacles inconnus et finalement atteindre le point cible. Par exemple, il y aura d'autres véhicules ou obstacles sur l'itinéraire planifié globalement de Shanghai à Pékin. Si vous souhaitez éviter ces obstacles ou véhicules, vous devez tourner et ajuster la voie. Il s'agit d'une planification d'itinéraire locale. Les méthodes de planification de chemin local comprennent : la méthode du champ de potentiel artificiel, la méthode de l'histogramme de domaine vectoriel, la méthode du champ de force virtuel, l'algorithme génétique et d'autres algorithmes de planification de chemin dynamique.

La couche de prise de décision et de planification est le système de conduite autonome. Elle est le reflet direct de l'intelligence et joue un rôle décisif dans la sécurité de conduite du véhicule et de l'ensemble du véhicule. Les architectures de planification décisionnelle communes incluent une hiérarchie progressive. et réactif et un hybride des deux.

L'architecture progressive hiérarchique est la structure d'un système en série. Dans ce système, les modules du système de conduite intelligent sont dans un ordre clair. La sortie du module précédent est donc l'entrée du module suivant. appelée structure d’action de planification perceptive. Cependant, la fiabilité de cette structure n'est pas élevée. Lorsqu'une panne logicielle ou matérielle se produit dans un certain module, l'ensemble du flux d'informations sera affecté et l'ensemble du système risque de s'effondrer, voire d'être paralysé.

L'architecture réactive adopte une structure parallèle. La couche de contrôle peut prendre des décisions directement en fonction de l'entrée du capteur. Par conséquent, les actions qu'elle génère sont le résultat de l'action directe des données du capteur, qui peut mettre en évidence les fonctionnalités des actions perçues, adaptées à des environnements totalement inconnus. De nombreux comportements dans l'architecture réactive impliquent principalement une tâche spéciale simple, il semble donc que la planification et le contrôle peuvent être étroitement intégrés, et l'espace de stockage occupé n'est pas grand, ce qui permet de produire des réponses rapides et de fortes performances en temps réel. En même temps, chaque couche doit seulement être responsable d'un certain comportement du système. L'ensemble du système peut réaliser la transition du niveau bas au niveau haut de manière pratique et flexible. De plus, si l'un des modules présente une panne inattendue, le reste. Même si les différentes couches de contrôle peuvent encore produire des résultats significatifs, la robustesse du système a été grandement améliorée. La difficulté est qu'en raison de la flexibilité de l'exécution des actions du système, un mécanisme de coordination spécifique est nécessaire pour résoudre les conflits entre les différentes boucles de contrôle et s'entendre sur les résultats. contention de l'actionneur, afin d'obtenir un résultat significatif.

La structure du système hiérarchique et la structure du système réactif ont toutes deux leurs propres avantages et inconvénients, et il leur est difficile de répondre seuls aux exigences complexes et changeantes de l'environnement de conduite, donc De plus en plus de professionnels de l'industrie ont commencé à étudier les architectures hybrides, combinant efficacement les avantages des deux pour générer des comportements hiérarchiques définis par des objectifs au niveau de la planification globale et une recherche orientée vers les objectifs au niveau de la planification locale des systèmes réactifs.

04 Technologie de contrôle et d'exécution

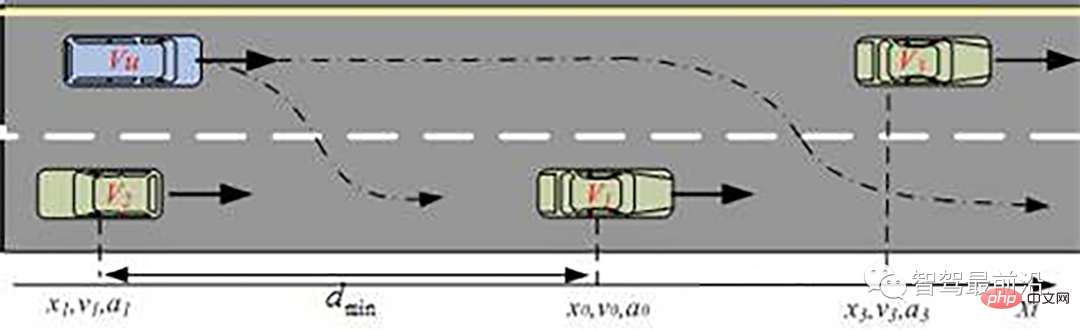

La technologie de contrôle de base de la conduite autonome est le contrôle longitudinal, le contrôle latéral, le contrôle longitudinal et le contrôle de conduite et de freinage du véhicule, et le contrôle latéral est la direction roue Le réglage de l'angle et le contrôle de la force des pneus réalisent un contrôle automatique longitudinal et transversal, et le fonctionnement du véhicule peut être automatiquement contrôlé en fonction d'objectifs et de contraintes donnés.

Le contrôle longitudinal du véhicule est le contrôle dans le sens de la vitesse de conduite, c'est-à-dire le contrôle automatique de la vitesse du véhicule et de la distance entre le véhicule et les véhicules qui le précèdent ou le suivent ou obstacles. Le régulateur de vitesse et le contrôle du freinage d’urgence sont tous deux des exemples typiques de contrôle longitudinal en conduite autonome. De tels problèmes de contrôle peuvent être attribués au contrôle des entraînements motorisés, des moteurs, des systèmes de transmission et de freinage. Divers modèles de moteur-moteur-transmission, modèles de fonctionnement de véhicule et modèles de processus de freinage sont combinés avec différents algorithmes de contrôleur pour former divers modes de commande longitudinale.

Le contrôle latéral du véhicule fait référence au contrôle perpendiculaire à la direction du mouvement. L'objectif est de contrôler la voiture pour maintenir automatiquement l'itinéraire de conduite souhaité et obtenir un bon confort de conduite et une bonne stabilité sous différentes vitesses, charges, résistance au vent et conditions routières du véhicule. Il existe deux méthodes de conception de base pour le contrôle latéral du véhicule. L'une est basée sur la simulation du conducteur (l'une consiste à utiliser un modèle dynamique plus simple et des règles de manipulation du conducteur pour concevoir le contrôleur ; l'autre consiste à utiliser le processus de manipulation du conducteur. Le contrôleur de formation des données obtient le algorithme de contrôle) ; l'autre est une méthode de contrôle qui donne le modèle mécanique de mouvement latéral de la voiture (un modèle précis de mouvement latéral d'une voiture doit être établi. Un modèle typique est tel qu'un modèle à voie unique, qui prend en compte les caractéristiques de la gauche et les côtés droits de la voiture doivent être identiques)

Résumé 05

En plus de la perception environnementale, du positionnement précis, de la planification des décisions et de l'exécution des contrôles présentés ci-dessus, les véhicules autonomes impliquent également des technologies clés telles que des cartes de haute précision , V2X et tests de véhicules autonomes. La technologie de conduite autonome est une combinaison d'intelligence artificielle, de puces hautes performances, de technologie de communication, de technologie de capteurs, de technologie de contrôle des véhicules, de technologie Big Data et d'autres technologies multi-domaines. En outre, pour la mise en œuvre de la technologie de conduite autonome, il est nécessaire de mettre en place des installations de transport de base répondant aux exigences de la conduite autonome et de prendre en compte les lois et réglementations concernant la conduite autonome.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Pourquoi le Gaussian Splatting est-il si populaire dans la conduite autonome que le NeRF commence à être abandonné ?

Jan 17, 2024 pm 02:57 PM

Pourquoi le Gaussian Splatting est-il si populaire dans la conduite autonome que le NeRF commence à être abandonné ?

Jan 17, 2024 pm 02:57 PM

Écrit ci-dessus et compréhension personnelle de l'auteur Le Gaussiansplatting tridimensionnel (3DGS) est une technologie transformatrice qui a émergé dans les domaines des champs de rayonnement explicites et de l'infographie ces dernières années. Cette méthode innovante se caractérise par l’utilisation de millions de gaussiennes 3D, ce qui est très différent de la méthode du champ de rayonnement neuronal (NeRF), qui utilise principalement un modèle implicite basé sur les coordonnées pour mapper les coordonnées spatiales aux valeurs des pixels. Avec sa représentation explicite de scènes et ses algorithmes de rendu différenciables, 3DGS garantit non seulement des capacités de rendu en temps réel, mais introduit également un niveau de contrôle et d'édition de scène sans précédent. Cela positionne 3DGS comme un révolutionnaire potentiel pour la reconstruction et la représentation 3D de nouvelle génération. À cette fin, nous fournissons pour la première fois un aperçu systématique des derniers développements et préoccupations dans le domaine du 3DGS.

Comment résoudre le problème de la longue traîne dans les scénarios de conduite autonome ?

Jun 02, 2024 pm 02:44 PM

Comment résoudre le problème de la longue traîne dans les scénarios de conduite autonome ?

Jun 02, 2024 pm 02:44 PM

Hier, lors de l'entretien, on m'a demandé si j'avais posé des questions à longue traîne, j'ai donc pensé faire un bref résumé. Le problème à longue traîne de la conduite autonome fait référence aux cas extrêmes dans les véhicules autonomes, c'est-à-dire à des scénarios possibles avec une faible probabilité d'occurrence. Le problème perçu de la longue traîne est l’une des principales raisons limitant actuellement le domaine de conception opérationnelle des véhicules autonomes intelligents à véhicule unique. L'architecture sous-jacente et la plupart des problèmes techniques de la conduite autonome ont été résolus, et les 5 % restants des problèmes à longue traîne sont progressivement devenus la clé pour restreindre le développement de la conduite autonome. Ces problèmes incluent une variété de scénarios fragmentés, de situations extrêmes et de comportements humains imprévisibles. La « longue traîne » des scénarios limites dans la conduite autonome fait référence aux cas limites dans les véhicules autonomes (VA). Les cas limites sont des scénarios possibles avec une faible probabilité d'occurrence. ces événements rares

Choisir une caméra ou un lidar ? Une étude récente sur la détection robuste d'objets 3D

Jan 26, 2024 am 11:18 AM

Choisir une caméra ou un lidar ? Une étude récente sur la détection robuste d'objets 3D

Jan 26, 2024 am 11:18 AM

0. Écrit à l'avant&& Compréhension personnelle que les systèmes de conduite autonome s'appuient sur des technologies avancées de perception, de prise de décision et de contrôle, en utilisant divers capteurs (tels que caméras, lidar, radar, etc.) pour percevoir l'environnement et en utilisant des algorithmes et des modèles pour une analyse et une prise de décision en temps réel. Cela permet aux véhicules de reconnaître les panneaux de signalisation, de détecter et de suivre d'autres véhicules, de prédire le comportement des piétons, etc., permettant ainsi de fonctionner en toute sécurité et de s'adapter à des environnements de circulation complexes. Cette technologie attire actuellement une grande attention et est considérée comme un domaine de développement important pour l'avenir des transports. . un. Mais ce qui rend la conduite autonome difficile, c'est de trouver comment faire comprendre à la voiture ce qui se passe autour d'elle. Cela nécessite que l'algorithme de détection d'objets tridimensionnels du système de conduite autonome puisse percevoir et décrire avec précision les objets dans l'environnement, y compris leur emplacement,

Le papier Stable Diffusion 3 est enfin publié, et les détails architecturaux sont révélés. Cela aidera-t-il à reproduire Sora ?

Mar 06, 2024 pm 05:34 PM

Le papier Stable Diffusion 3 est enfin publié, et les détails architecturaux sont révélés. Cela aidera-t-il à reproduire Sora ?

Mar 06, 2024 pm 05:34 PM

L'article de StableDiffusion3 est enfin là ! Ce modèle est sorti il y a deux semaines et utilise la même architecture DiT (DiffusionTransformer) que Sora. Il a fait beaucoup de bruit dès sa sortie. Par rapport à la version précédente, la qualité des images générées par StableDiffusion3 a été considérablement améliorée. Il prend désormais en charge les invites multithèmes, et l'effet d'écriture de texte a également été amélioré et les caractères tronqués n'apparaissent plus. StabilityAI a souligné que StableDiffusion3 est une série de modèles avec des tailles de paramètres allant de 800M à 8B. Cette plage de paramètres signifie que le modèle peut être exécuté directement sur de nombreux appareils portables, réduisant ainsi considérablement l'utilisation de l'IA.

Cet article vous suffit pour en savoir plus sur la conduite autonome et la prédiction de trajectoire !

Feb 28, 2024 pm 07:20 PM

Cet article vous suffit pour en savoir plus sur la conduite autonome et la prédiction de trajectoire !

Feb 28, 2024 pm 07:20 PM

La prédiction de trajectoire joue un rôle important dans la conduite autonome. La prédiction de trajectoire de conduite autonome fait référence à la prédiction de la trajectoire de conduite future du véhicule en analysant diverses données pendant le processus de conduite du véhicule. En tant que module central de la conduite autonome, la qualité de la prédiction de trajectoire est cruciale pour le contrôle de la planification en aval. La tâche de prédiction de trajectoire dispose d'une riche pile technologique et nécessite une connaissance de la perception dynamique/statique de la conduite autonome, des cartes de haute précision, des lignes de voie, des compétences en architecture de réseau neuronal (CNN&GNN&Transformer), etc. Il est très difficile de démarrer ! De nombreux fans espèrent se lancer dans la prédiction de trajectoire le plus tôt possible et éviter les pièges. Aujourd'hui, je vais faire le point sur quelques problèmes courants et des méthodes d'apprentissage introductives pour la prédiction de trajectoire ! Connaissances introductives 1. Existe-t-il un ordre d'entrée pour les épreuves de prévisualisation ? R : Regardez d’abord l’enquête, p

SIMPL : un benchmark de prédiction de mouvement multi-agents simple et efficace pour la conduite autonome

Feb 20, 2024 am 11:48 AM

SIMPL : un benchmark de prédiction de mouvement multi-agents simple et efficace pour la conduite autonome

Feb 20, 2024 am 11:48 AM

Titre original : SIMPL : ASimpleandEfficientMulti-agentMotionPredictionBaselineforAutonomousDriving Lien article : https://arxiv.org/pdf/2402.02519.pdf Lien code : https://github.com/HKUST-Aerial-Robotics/SIMPL Affiliation de l'auteur : Université des sciences de Hong Kong et technologie Idée DJI Paper : cet article propose une base de référence de prédiction de mouvement (SIMPL) simple et efficace pour les véhicules autonomes. Par rapport au cent agent traditionnel

NuScenes dernier SOTA SparseAD : les requêtes clairsemées contribuent à une conduite autonome efficace de bout en bout !

Apr 17, 2024 pm 06:22 PM

NuScenes dernier SOTA SparseAD : les requêtes clairsemées contribuent à une conduite autonome efficace de bout en bout !

Apr 17, 2024 pm 06:22 PM

Écrit à l'avant et point de départ Le paradigme de bout en bout utilise un cadre unifié pour réaliser plusieurs tâches dans les systèmes de conduite autonome. Malgré la simplicité et la clarté de ce paradigme, les performances des méthodes de conduite autonome de bout en bout sur les sous-tâches sont encore loin derrière les méthodes à tâche unique. Dans le même temps, les fonctionnalités de vue à vol d'oiseau (BEV) denses, largement utilisées dans les méthodes de bout en bout précédentes, rendent difficile l'adaptation à davantage de modalités ou de tâches. Un paradigme de conduite autonome de bout en bout (SparseAD) centré sur la recherche clairsemée est proposé ici, dans lequel la recherche clairsemée représente entièrement l'ensemble du scénario de conduite, y compris l'espace, le temps et les tâches, sans aucune représentation BEV dense. Plus précisément, une architecture clairsemée unifiée est conçue pour la connaissance des tâches, notamment la détection, le suivi et la cartographie en ligne. De plus, lourd

Parlons des systèmes de conduite autonome de bout en bout et de nouvelle génération, ainsi que de quelques malentendus sur la conduite autonome de bout en bout ?

Apr 15, 2024 pm 04:13 PM

Parlons des systèmes de conduite autonome de bout en bout et de nouvelle génération, ainsi que de quelques malentendus sur la conduite autonome de bout en bout ?

Apr 15, 2024 pm 04:13 PM

Au cours du mois dernier, pour des raisons bien connues, j'ai eu des échanges très intensifs avec divers professeurs et camarades de classe du secteur. Un sujet inévitable dans l'échange est naturellement le populaire Tesla FSDV12 de bout en bout. Je voudrais profiter de cette occasion pour trier certaines de mes pensées et opinions en ce moment pour votre référence et votre discussion. Comment définir un système de conduite autonome de bout en bout et quels problèmes devraient être résolus de bout en bout ? Selon la définition la plus traditionnelle, un système de bout en bout fait référence à un système qui saisit les informations brutes des capteurs et génère directement les variables pertinentes pour la tâche. Par exemple, en reconnaissance d'images, CNN peut être appelé de bout en bout par rapport à la méthode traditionnelle d'extraction de caractéristiques + classificateur. Dans les tâches de conduite autonome, saisir les données de divers capteurs (caméra/LiDAR