Maintenant, vous pouvez gagner de l'argent en trouvant des vulnérabilités dans ChatGPT.

Tôt ce matin, OpenAI a annoncé le lancement d'un programme de bug bounty :

Signalez les vulnérabilités de ChatGPT et vous pouvez recevoir une récompense en espèces pouvant aller jusqu'à 20 000 US$.

Plus précisément, OpenAI coopérera avec la plateforme de commentaires sur les bogues Bugcrowd pour collecter des informations sur l'expérience des gens dans l'utilisation de ses produits Bug. trouvé.

Découvrez et signalez les vulnérabilités via cette plateforme pour recevoir des récompenses en espèces :

Nous attribuerons des récompenses en espèces en fonction de la gravité et de l'étendue de la vulnérabilité. Les vulnérabilités moins graves recevront 200 $, tandis que pour les vulnérabilités spéciales, la prime est plafonnée à 20 000 $. Nous apprécions vos contributions et nous engageons à publier les résultats de vos efforts (au public).

Plus précisément, les vulnérabilités signalées par les utilisateurs seront classées selon la taxonomie de notation Bugcrowd.

OpenAI admet que l'émergence de vulnérabilités est inévitable :

OpenAI a pour mission de créer des systèmes d'intelligence artificielle qui profitent à tous. À cette fin, nous avons investi massivement dans la recherche et l’ingénierie pour garantir la sécurité et la fiabilité de nos systèmes d’IA. Cependant, comme toute technologie complexe, nous comprenons que des bugs et des défauts peuvent survenir.

Matthew Knight, chef du département de sécurité d'OpenAI, a expliqué que le processus de découverte des vulnérabilités nécessite l'aide des internautes :

Cette initiative est notre engagement à développer une intelligence artificielle sûre et avancée une partie importante de. Nous avons besoin de votre aide pour créer des technologies et des services sûrs, fiables et dignes de confiance.

Ils ont également promis à l'ensemble du réseau qu'ils corrigeraient la vulnérabilité dès que possible après avoir reçu des commentaires et féliciteraient celui qui l'a soumis.

Les internautes ayant expérimenté ChatGPT doivent savoir que ses performances ne sont pas toujours satisfaisantes.

Si la question est légèrement plus difficile, ChatGPT sera confus et donnera même des réponses ridicules.

En voyant les choses sous cet angle, trouver des bugs n'est-il pas trop facile ? N'est-ce pas une opportunité de gagner beaucoup d'argent ?

Ne soyez pas heureux trop tôt.

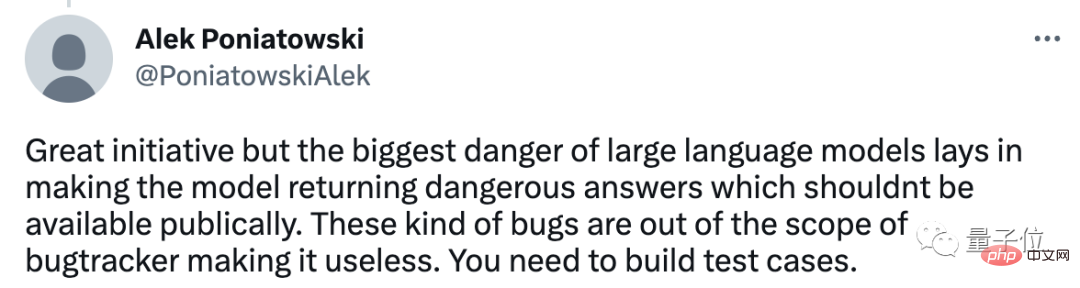

Dans l'annonce, OpenAI a déclaré qu'en raison de la faisabilité de la réparation, le problème du modèle lui-même n'entre pas dans le cadre de ce plan.

Le laisser dire de mauvaises choses, faire de mauvaises choses, générer du code malveillant et d'autres comportements qui contournent les mesures de sécurité ou créer des hallucinations machine sont autant de problèmes liés au modèle lui-même.

Sans parler des réponses fausses ou inexactes.

Les vulnérabilités qu'OpenAI espère collecter à propos de ChatGPT sont principalement liées à ses problèmes de compte, d'authentification, d'abonnement, de paiement, d'adhésion et de plug-in.

Pour les utilisateurs ordinaires, il est quelque peu difficile de découvrir les vulnérabilités de ce point de vue.

Les problèmes tels que le contournement des restrictions de sécurité mentionnés dans l'article précédent sont une grande préoccupation pour les pratiquants.

Les programmes d'IA ont des restrictions de sécurité intégrées qui les empêchent de faire des commentaires dangereux ou offensants.

Mais de différentes manières, ces restrictions peuvent être contournées ou brisées.

Ce phénomène est vivement qualifié de « jailbreak » par les praticiens.

Si vous demandez à ChatGPT comment faire quelque chose d'illégal, indiquez à l'avance que vous lui demandez de "jouer" le méchant.

Dans le domaine de l'intelligence artificielle, il existe un groupe de personnes spécialisées dans la recherche sur le "jailbreaking" pour améliorer les mesures de sécurité.

Bien qu'OpenAI ne collecte pas les vulnérabilités dans le modèle lui-même, cela ne veut pas dire qu'ils ne prêtent pas attention à cet aspect.

La nouvelle version de ChatGPT équipée du modèle GPT-4.0 a des restrictions plus strictes.

Dès que le programme de primes d'OpenAI a été annoncé, il a attiré de nombreux internautes à le regarder.

Non, un internaute a immédiatement levé la main et a dit qu'il avait découvert un bug :

Rapport, seules 25 questions peuvent être posées à ChatGPT dans les 3 heures Problème, c'est un bug !

Certains internautes ont également ridiculisé, ChatGPT ne devrait-il pas être autorisé à se déboguer tout seul ?

# 🎜 🎜#

# 🎜 🎜#

[1]

https://www.php.cn/link/92c4661685bf6681f6a33b78ef729658[ 2]

https://www.php.cn/link/52ff52aa56d10a1287274ecf02dccb5f[3]

https://www.php .cn/link/bb44c2e24438b59f0d2109fec67f6b20[4]

https://www.php.cn/link/a3b36cb25e2e0b93b5f334ffb4e4064e #🎜 🎜#

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!