Périphériques technologiques

Périphériques technologiques

IA

IA

Si ChatGPT est soupçonné de diffamation, OpenAI peut-il être exonéré de toute responsabilité ?

Si ChatGPT est soupçonné de diffamation, OpenAI peut-il être exonéré de toute responsabilité ?

Si ChatGPT est soupçonné de diffamation, OpenAI peut-il être exonéré de toute responsabilité ?

L'article 230 de la loi américaine sur la décence en matière de communications, publiée en 1996, stipule que les entreprises n'ont pas à assumer la responsabilité légale du contenu publié par des tiers ou des utilisateurs sur leurs plateformes (article 230). Cependant, la Cour suprême des États-Unis décidera dans les mois à venir s’il convient d’affaiblir cette protection, ce qui pourrait également avoir un impact sur les chatbots à intelligence artificielle tels que ChatGPT.

Il semblerait que les juges rendront une décision avant la fin du mois de juin pour déterminer si YouTube d'Alphabet peut être poursuivi en justice pour avoir recommandé des vidéos aux utilisateurs. Bien que la plateforme soit exonérée de responsabilité pour les vidéos mises en ligne par les utilisateurs, la protection de la « Section 230 » s'applique-t-elle toujours lorsqu'elle utilise des algorithmes pour recommander du contenu aux utilisateurs ?

Les experts en technologie et en droit affirment que l'impact de l'affaire s'étend au-delà des plateformes de médias sociaux, et le verdict pourrait déclencher de nouveaux débats sur la question de savoir si les entreprises telles qu'OpenAI et Google qui développent des chatbots IA sont à l'abri de poursuites judiciaires pour diffamation ou atteinte à la vie privée. Les experts soulignent que cela est dû au fait que les algorithmes utilisés par ChatGPT et d'autres sont similaires à la manière dont les vidéos sont recommandées aux utilisateurs de YouTube.

Cameron Carey, chercheur invité et expert en intelligence artificielle au groupe de réflexion Brookings Institution à Washington, a déclaré : « Au cœur de ce débat se pose la question de savoir si les moteurs de recommandation sont si importants pour organiser l'information et façonner le contenu en ligne qu'ils le sont. "J'ai les mêmes inquiétudes concernant les chatbots."

Les représentants d'OpenAI et de Google n'ont pas répondu aux demandes de commentaires.

Les chatbots IA sont formés pour produire des quantités massives de contenu original, et la « Section 230 » s'applique souvent au contenu tiers. Le tribunal n’a pas encore examiné si les réponses des chatbots IA seraient protégées. Un sénateur démocrate a déclaré que les droits d'immunité ne peuvent pas s'appliquer aux outils d'IA générative car ces outils « créent du contenu ». Il a déclaré : « L'article 230 vise à protéger les utilisateurs et les sites Web hébergeant et organisant la parole des utilisateurs. Il ne devrait pas exempter les entreprises des conséquences de leurs propres actions et produits.

L'industrie technologique a fait pression pour maintenir l'article 230. » Certains considèrent des outils comme ChatGPT comme des moteurs de recherche, proposant du contenu existant aux utilisateurs en fonction de requêtes. "L'IA ne crée pas vraiment quoi que ce soit. Elle restitue simplement le contenu existant d'une manière différente ou dans un format différent", a déclaré Carl Szabo, vice-président et avocat général de NetChoice, un groupe professionnel de l'industrie technologique.

Saab a déclaré que si l'article 230 est affaibli, cela créera une tâche impossible pour les développeurs d'IA et les exposera à un torrent de poursuites qui pourraient étouffer l'innovation.

Certains experts pensent que les tribunaux pourraient adopter une position neutre et examiner le contexte dans lequel un modèle d'IA génère une réponse potentiellement nuisible.

Dans les cas où le modèle d'IA semble être capable d'expliquer les sources existantes, la clause de non-responsabilité peut toujours s'appliquer. Mais les chatbots comme ChatGPT sont connus pour générer des réponses fictives, qui, selon les experts, pourraient ne pas être protégées.

Hanni Farid, technologue et professeur à l'Université de Californie à Berkeley, a déclaré qu'il était exagéré de penser que les développeurs d'IA devraient être à l'abri de poursuites judiciaires pour les modèles qu'ils « programment, entraînent et déploient ».

"Si les entreprises peuvent être tenues responsables dans le cadre de poursuites civiles, elles fabriquent des produits plus sûrs ; si elles en sont exemptées, les produits ont tendance à être moins sûrs", a déclaré Farid.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

ChatGPT permet désormais aux utilisateurs gratuits de générer des images en utilisant DALL-E 3 avec une limite quotidienne

Aug 09, 2024 pm 09:37 PM

ChatGPT permet désormais aux utilisateurs gratuits de générer des images en utilisant DALL-E 3 avec une limite quotidienne

Aug 09, 2024 pm 09:37 PM

Le DALL-E 3 a été officiellement introduit en septembre 2023 en tant que modèle considérablement amélioré par rapport à son prédécesseur. Il est considéré comme l’un des meilleurs générateurs d’images IA à ce jour, capable de créer des images avec des détails complexes. Cependant, au lancement, c'était exclu

Choisir le modèle d'intégration qui correspond le mieux à vos données : un test comparatif des intégrations multilingues OpenAI et open source

Feb 26, 2024 pm 06:10 PM

Choisir le modèle d'intégration qui correspond le mieux à vos données : un test comparatif des intégrations multilingues OpenAI et open source

Feb 26, 2024 pm 06:10 PM

OpenAI a récemment annoncé le lancement de son modèle d'intégration de dernière génération, embeddingv3, qui, selon eux, est le modèle d'intégration le plus performant avec des performances multilingues plus élevées. Ce lot de modèles est divisé en deux types : les plus petits text-embeddings-3-small et les plus puissants et plus grands text-embeddings-3-large. Peu d'informations sont divulguées sur la façon dont ces modèles sont conçus et formés, et les modèles ne sont accessibles que via des API payantes. Il existe donc de nombreux modèles d'intégration open source. Mais comment ces modèles open source se comparent-ils au modèle open source open source ? Cet article comparera empiriquement les performances de ces nouveaux modèles avec des modèles open source. Nous prévoyons de créer une donnée

Un nouveau paradigme de programmation, quand Spring Boot rencontre OpenAI

Feb 01, 2024 pm 09:18 PM

Un nouveau paradigme de programmation, quand Spring Boot rencontre OpenAI

Feb 01, 2024 pm 09:18 PM

En 2023, la technologie de l’IA est devenue un sujet brûlant et a un impact énorme sur diverses industries, notamment dans le domaine de la programmation. Les gens sont de plus en plus conscients de l’importance de la technologie de l’IA, et la communauté Spring ne fait pas exception. Avec l’évolution continue de la technologie GenAI (Intelligence Artificielle Générale), il est devenu crucial et urgent de simplifier la création d’applications dotées de fonctions d’IA. Dans ce contexte, « SpringAI » a émergé, visant à simplifier le processus de développement d'applications fonctionnelles d'IA, en le rendant simple et intuitif et en évitant une complexité inutile. Grâce à « SpringAI », les développeurs peuvent plus facilement créer des applications dotées de fonctions d'IA, ce qui les rend plus faciles à utiliser et à exploiter.

Comment installer chatgpt sur un téléphone mobile

Mar 05, 2024 pm 02:31 PM

Comment installer chatgpt sur un téléphone mobile

Mar 05, 2024 pm 02:31 PM

Étapes d'installation : 1. Téléchargez le logiciel ChatGTP depuis le site officiel ou la boutique mobile de ChatGTP ; 2. Après l'avoir ouvert, dans l'interface des paramètres, sélectionnez la langue chinoise 3. Dans l'interface de jeu, sélectionnez le jeu homme-machine et définissez la langue. Spectre chinois ; 4. Après avoir démarré, entrez les commandes dans la fenêtre de discussion pour interagir avec le logiciel.

Travail posthume de l'équipe OpenAI Super Alignment : deux grands modèles jouent à un jeu et le résultat devient plus compréhensible

Jul 19, 2024 am 01:29 AM

Travail posthume de l'équipe OpenAI Super Alignment : deux grands modèles jouent à un jeu et le résultat devient plus compréhensible

Jul 19, 2024 am 01:29 AM

Si la réponse donnée par le modèle d’IA est incompréhensible du tout, oseriez-vous l’utiliser ? À mesure que les systèmes d’apprentissage automatique sont utilisés dans des domaines de plus en plus importants, il devient de plus en plus important de démontrer pourquoi nous pouvons faire confiance à leurs résultats, et quand ne pas leur faire confiance. Une façon possible de gagner confiance dans le résultat d'un système complexe est d'exiger que le système produise une interprétation de son résultat qui soit lisible par un humain ou un autre système de confiance, c'est-à-dire entièrement compréhensible au point que toute erreur possible puisse être trouvé. Par exemple, pour renforcer la confiance dans le système judiciaire, nous exigeons que les tribunaux fournissent des avis écrits clairs et lisibles qui expliquent et soutiennent leurs décisions. Pour les grands modèles de langage, nous pouvons également adopter une approche similaire. Cependant, lorsque vous adoptez cette approche, assurez-vous que le modèle de langage génère

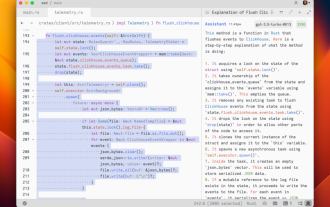

L'éditeur Zed basé sur Rust est open source, avec prise en charge intégrée d'OpenAI et GitHub Copilot

Feb 01, 2024 pm 02:51 PM

L'éditeur Zed basé sur Rust est open source, avec prise en charge intégrée d'OpenAI et GitHub Copilot

Feb 01, 2024 pm 02:51 PM

Auteur丨Compilé par TimAnderson丨Produit par Noah|51CTO Technology Stack (WeChat ID : blog51cto) Le projet d'éditeur Zed est encore en phase de pré-version et a été open source sous licences AGPL, GPL et Apache. L'éditeur offre des performances élevées et plusieurs options assistées par l'IA, mais n'est actuellement disponible que sur la plate-forme Mac. Nathan Sobo a expliqué dans un article que dans la base de code du projet Zed sur GitHub, la partie éditeur est sous licence GPL, les composants côté serveur sont sous licence AGPL et la partie GPUI (GPU Accelerated User) l'interface) adopte la Licence Apache2.0. GPUI est un produit développé par l'équipe Zed

N'attendez pas OpenAI, attendez qu'Open-Sora soit entièrement open source

Mar 18, 2024 pm 08:40 PM

N'attendez pas OpenAI, attendez qu'Open-Sora soit entièrement open source

Mar 18, 2024 pm 08:40 PM

Il n'y a pas si longtemps, OpenAISora est rapidement devenu populaire grâce à ses étonnants effets de génération vidéo. Il s'est démarqué parmi la foule de modèles vidéo littéraires et est devenu le centre d'attention mondiale. Suite au lancement du processus de reproduction d'inférence de formation Sora avec une réduction des coûts de 46 % il y a 2 semaines, l'équipe Colossal-AI a entièrement open source le premier modèle de génération vidéo d'architecture de type Sora au monde "Open-Sora1.0", couvrant l'ensemble processus de formation, y compris le traitement des données, tous les détails de la formation et les poids des modèles, et joignez-vous aux passionnés mondiaux de l'IA pour promouvoir une nouvelle ère de création vidéo. Pour un aperçu, jetons un œil à une vidéo d'une ville animée générée par le modèle « Open-Sora1.0 » publié par l'équipe Colossal-AI. Ouvrir-Sora1.0

Les performances d'exécution locale du service Embedding dépassent celles d'OpenAI Text-Embedding-Ada-002, ce qui est très pratique !

Apr 15, 2024 am 09:01 AM

Les performances d'exécution locale du service Embedding dépassent celles d'OpenAI Text-Embedding-Ada-002, ce qui est très pratique !

Apr 15, 2024 am 09:01 AM

Ollama est un outil super pratique qui vous permet d'exécuter facilement des modèles open source tels que Llama2, Mistral et Gemma localement. Dans cet article, je vais vous présenter comment utiliser Ollama pour vectoriser du texte. Si vous n'avez pas installé Ollama localement, vous pouvez lire cet article. Dans cet article, nous utiliserons le modèle nomic-embed-text[2]. Il s'agit d'un encodeur de texte qui surpasse OpenAI text-embedding-ada-002 et text-embedding-3-small sur les tâches à contexte court et à contexte long. Démarrez le service nomic-embed-text lorsque vous avez installé avec succès o