Périphériques technologiques

Périphériques technologiques

IA

IA

Obtenez 23 000 pour la publication d'un article ! Les 42 rédacteurs en chef de la revue ont démissionné en signe de protestation : les éditeurs sont trop cupides et leurs marges bénéficiaires sont supérieures à celles de Google et d'Amazon.

Obtenez 23 000 pour la publication d'un article ! Les 42 rédacteurs en chef de la revue ont démissionné en signe de protestation : les éditeurs sont trop cupides et leurs marges bénéficiaires sont supérieures à celles de Google et d'Amazon.

Obtenez 23 000 pour la publication d'un article ! Les 42 rédacteurs en chef de la revue ont démissionné en signe de protestation : les éditeurs sont trop cupides et leurs marges bénéficiaires sont supérieures à celles de Google et d'Amazon.

Top neuroscience journalNeuroimage, les 42 scientifiques du comité de rédaction ont démissionné en signe de protestation.

La revue adopte un modèle d'accès ouvert et facture les universitaires qui publient des articles plutôt que les lecteurs.

Publier un article dessus nécessite de payer des frais de page (APC, Article Processing Charge) de plus de USD (23 000 RMB) .

L'ensemble du comité de rédaction, y compris des professeurs de l'Université d'Oxford, du King's College de Londres et de l'Université de Cardiff, a démissionné après que l'éditeur a refusé de réduire les frais.

Ils ont qualifié l'accusation de « contraire à l'éthique » et n'avait rien à voir avec les coûts impliqués.

Les bénéfices de l'éditeur sont supérieurs à ceux de Google et d'Amazon

Selon l'Observer, filiale de The Guardian, l'éditeur derrière la revue affirme publier 25% des articles scientifiques mondiaux l'année dernière, ses revenus ont augmenté de 10. % à 2,9 milliards de livres (253 milliards de RMB).

Les données financières de 2019 montrent que sa marge bénéficiaire atteint 40 %, ce qui est supérieur à celui de Google et d'Amazon.

Les universitaires sont indignés que leurs recherches soient souvent financées par des œuvres caritatives et des deniers publics et n'aient rien à voir avec les éditeurs. Les rédacteurs universitaires révisent mutuellement leurs articles gratuitement ou ne reçoivent qu'une petite allocation.

Ensuite, soit les universités paieront des frais d'abonnement élevés, soit les universitaires qui publient des articles se verront facturer des frais de publication élevés.

Le responsable de la stimulation cérébrale à l'Université de Cardiff et l'un des professeurs démissionnairesChris Chambers a déclaré :

Les éditeurs s'attaquent au monde universitaire et réalisent d'énormes profits sans ajouter aucune valeur à la science

Précédent rédacteur en chef de Neuroimage- chef et professeur de génie biomédical à l'Université d'Oxford Stephen Smith a déclaré :

La communauté universitaire dans son ensemble n'aime vraiment pas la situation actuelle, mais en tant qu'individus, je me sens impuissant parce que je ne peux pas inciter davantage les grands éditeurs éthique.

Un porte-parole de la maison d'édition a également répondu :

Nous accordons une grande importance à nos rédacteurs et sommes déçus de [cette démission], surtout après les discussions en cours que nous avons eues avec eux au cours des dernières années.

Le porte-parole de l’éditeur a également déclaré que les frais de publication de la revue sont « inférieurs à la moyenne du marché en termes de qualité » et « inférieurs à ceux facturés par les revues comparables les plus proches dans son domaine ».

L'équipe d'origine a fondé une nouvelle revue

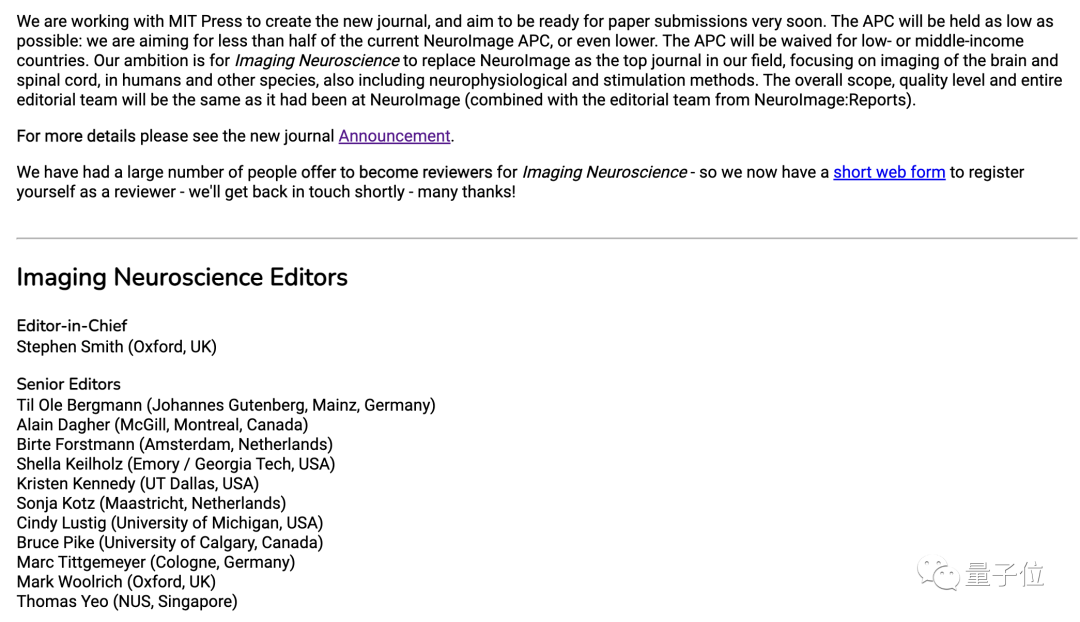

Les rédacteurs démissionnaires ont discuté et ont décidé de créer une nouvelle revue au MIT Press, une organisation d'édition à but non lucratif.

La nouvelle revue, nommée Imaging Neuroscience, se concentre sur l'imagerie du cerveau et de la moelle épinière chez l'homme et d'autres espèces, et inclut également la neurophysiologie et les méthodes de stimulation.

La nouvelle revue choisit également le modèle du libre accès et vise à remplacer NeuroImage en tant que revue leader sur le sujet.

Selon le communiqué officiel du site Web qui a été lancé, l'objectif de frais de page de la nouvelle revue est la moitié, voire inférieur, à celui de NeuroImage.

Dans le même temps, les frais de publication seront supprimés pour les pays à revenu faible ou intermédiaire.

Le professeur Stephen Smith est toujours rédacteur en chef de la nouvelle revue.

Il estime que les chercheurs du passé étaient capables de tolérer des honoraires élevés précisément parce qu'ils voulaient publier dans des revues prestigieuses pour soutenir leur carrière et s'assurer que leurs travaux soient largement lus et cités.

Maintenant qu'il a supprimé toute la rédaction, la réputation qu'il a bâtie sera également transférée à la nouvelle revue.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

Le papier Stable Diffusion 3 est enfin publié, et les détails architecturaux sont révélés. Cela aidera-t-il à reproduire Sora ?

Mar 06, 2024 pm 05:34 PM

Le papier Stable Diffusion 3 est enfin publié, et les détails architecturaux sont révélés. Cela aidera-t-il à reproduire Sora ?

Mar 06, 2024 pm 05:34 PM

L'article de StableDiffusion3 est enfin là ! Ce modèle est sorti il y a deux semaines et utilise la même architecture DiT (DiffusionTransformer) que Sora. Il a fait beaucoup de bruit dès sa sortie. Par rapport à la version précédente, la qualité des images générées par StableDiffusion3 a été considérablement améliorée. Il prend désormais en charge les invites multithèmes, et l'effet d'écriture de texte a également été amélioré et les caractères tronqués n'apparaissent plus. StabilityAI a souligné que StableDiffusion3 est une série de modèles avec des tailles de paramètres allant de 800M à 8B. Cette plage de paramètres signifie que le modèle peut être exécuté directement sur de nombreux appareils portables, réduisant ainsi considérablement l'utilisation de l'IA.

Prix papier ICCV'23 'Combat des Dieux' ! Meta Divide Everything et ControlNet ont été sélectionnés conjointement, et un autre article a surpris les juges.

Oct 04, 2023 pm 08:37 PM

Prix papier ICCV'23 'Combat des Dieux' ! Meta Divide Everything et ControlNet ont été sélectionnés conjointement, et un autre article a surpris les juges.

Oct 04, 2023 pm 08:37 PM

ICCV2023, la plus grande conférence sur la vision par ordinateur qui s'est tenue à Paris, en France, vient de se terminer ! Le prix du meilleur article de cette année est simplement un « combat entre dieux ». Par exemple, les deux articles qui ont remporté le prix du meilleur article incluaient ControlNet, un travail qui a bouleversé le domaine de l'IA graphique vincentienne. Depuis qu'il est open source, ControlNet a reçu 24 000 étoiles sur GitHub. Qu'il s'agisse des modèles de diffusion ou de l'ensemble du domaine de la vision par ordinateur, le prix de cet article est bien mérité. La mention honorable du prix du meilleur article a été décernée à un autre article tout aussi célèbre, le modèle SAM « Séparez tout » de Meta. Depuis son lancement, « Segment Everything » est devenu la « référence » pour divers modèles d'IA de segmentation d'images, y compris ceux venus de derrière.

NeRF et le passé et le présent de la conduite autonome, résumé de près de 10 articles !

Nov 14, 2023 pm 03:09 PM

NeRF et le passé et le présent de la conduite autonome, résumé de près de 10 articles !

Nov 14, 2023 pm 03:09 PM

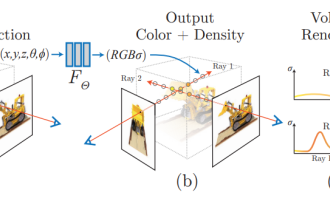

Depuis que Neural Radiance Fields a été proposé en 2020, le nombre d'articles connexes a augmenté de façon exponentielle. Il est non seulement devenu une branche importante de la reconstruction tridimensionnelle, mais est également progressivement devenu actif à la frontière de la recherche en tant qu'outil important pour la conduite autonome. . NeRF a soudainement émergé au cours des deux dernières années, principalement parce qu'il ignore l'extraction et la mise en correspondance des points caractéristiques, la géométrie et la triangulation épipolaires, le PnP plus l'ajustement du faisceau et d'autres étapes du pipeline de reconstruction CV traditionnel, et ignore même la reconstruction du maillage, la cartographie et le traçage de la lumière. , directement à partir de la 2D L'image d'entrée est utilisée pour apprendre un champ de rayonnement, puis une image rendue qui se rapproche d'une photo réelle est sortie du champ de rayonnement. En d’autres termes, supposons qu’un modèle tridimensionnel implicite basé sur un réseau neuronal s’adapte à la perspective spécifiée.

Les illustrations papier peuvent également être générées automatiquement, en utilisant le modèle de diffusion, et sont également acceptées par l'ICLR.

Jun 27, 2023 pm 05:46 PM

Les illustrations papier peuvent également être générées automatiquement, en utilisant le modèle de diffusion, et sont également acceptées par l'ICLR.

Jun 27, 2023 pm 05:46 PM

L'IA générative a pris d'assaut la communauté de l'intelligence artificielle. Les particuliers et les entreprises ont commencé à s'intéresser à la création d'applications de conversion modale associées, telles que les images Vincent, les vidéos Vincent, la musique Vincent, etc. Récemment, plusieurs chercheurs d'institutions de recherche scientifique telles que ServiceNow Research et LIVIA ont tenté de générer des graphiques dans des articles basés sur des descriptions textuelles. À cette fin, ils ont proposé une nouvelle méthode de FigGen, et l’article correspondant a également été inclus dans ICLR2023 sous le nom de TinyPaper. Adresse du document illustré : https://arxiv.org/pdf/2306.00800.pdf Certaines personnes peuvent se demander : pourquoi est-il si difficile de générer les graphiques dans le document ? En quoi cela aide-t-il la recherche scientifique ?

Les captures d'écran du chat révèlent les règles cachées de l'examen de l'IA ! AAAI 3000 yuans, c'est fort accepté ?

Apr 12, 2023 am 08:34 AM

Les captures d'écran du chat révèlent les règles cachées de l'examen de l'IA ! AAAI 3000 yuans, c'est fort accepté ?

Apr 12, 2023 am 08:34 AM

Alors que la date limite de soumission des articles pour l'AAAI 2023 approchait, une capture d'écran d'une discussion anonyme dans le groupe de soumission d'IA est soudainement apparue sur Zhihu. L'un d'eux a affirmé qu'il pouvait fournir un service « 3 000 yuans par acceptation forte ». Dès que la nouvelle est sortie, elle a immédiatement suscité l’indignation du public parmi les internautes. Cependant, ne vous précipitez pas encore. Le patron de Zhihu, "Fine Tuning", a déclaré qu'il s'agissait probablement simplement d'un "plaisir verbal". Selon "Fine Tuning", les salutations et les délits de gangs sont des problèmes inévitables dans tous les domaines. Avec l'essor de l'openreview, les différents inconvénients du cmt sont devenus de plus en plus évidents. L'espace laissé aux petits cercles pour fonctionner deviendra plus petit à l'avenir, mais il y aura toujours de la place. Parce qu'il s'agit d'un problème personnel, pas d'un problème avec le système et le mécanisme de soumission. Présentation de l'open r

Classement CVPR 2023 publié, le taux d'acceptation est de 25,78% ! 2 360 articles ont été acceptés et le nombre de soumissions a grimpé à 9 155

Apr 13, 2023 am 09:37 AM

Classement CVPR 2023 publié, le taux d'acceptation est de 25,78% ! 2 360 articles ont été acceptés et le nombre de soumissions a grimpé à 9 155

Apr 13, 2023 am 09:37 AM

Tout à l'heure, le CVPR 2023 a publié un article disant : Cette année, nous avons reçu un nombre record de 9 155 articles (12 % de plus que le CVPR2022) et accepté 2 360 articles, avec un taux d'acceptation de 25,78 %. Selon les statistiques, le nombre de soumissions au CVPR n'a augmenté que de 1 724 à 2 145 au cours des 7 années allant de 2010 à 2016. Après 2017, il a grimpé en flèche et est entré dans une période de croissance rapide. En 2019, il a dépassé les 5 000 pour la première fois, et en 2022, le nombre de candidatures avait atteint 8 161. Comme vous pouvez le constater, un total de 9 155 articles ont été soumis cette année, ce qui constitue un record. Une fois l’épidémie atténuée, le sommet CVPR de cette année se tiendra au Canada. Cette année, il s'agira d'une conférence à voie unique et la traditionnelle sélection orale sera annulée. recherche Google

Le nouveau papier brûlant de Microsoft : Transformer s'étend à 1 milliard de jetons

Jul 22, 2023 pm 03:34 PM

Le nouveau papier brûlant de Microsoft : Transformer s'étend à 1 milliard de jetons

Jul 22, 2023 pm 03:34 PM

Alors que chacun continue de mettre à niveau et d'itérer ses propres grands modèles, la capacité du LLM (grand modèle de langage) à traiter les fenêtres contextuelles est également devenue un indicateur d'évaluation important. Par exemple, le modèle vedette GPT-4 prend en charge 32 000 jetons, ce qui équivaut à 50 pages de texte ; Anthropic, fondée par un ancien membre d'OpenAI, a augmenté les capacités de traitement des jetons de Claude à 100 000, soit environ 75 000 mots, soit environ équivalent à résumer "Harry Potter" en un clic 》Première partie. Dans les dernières recherches de Microsoft, ils ont cette fois directement étendu Transformer à 1 milliard de jetons. Cela ouvre de nouvelles possibilités pour modéliser des séquences très longues, comme par exemple traiter un corpus entier ou même l'ensemble d'Internet comme une seule séquence. A titre de comparaison, commun

L'équipe chinoise a remporté les prix du meilleur article et du meilleur article système, et les résultats de la recherche CoRL ont été annoncés.

Nov 10, 2023 pm 02:21 PM

L'équipe chinoise a remporté les prix du meilleur article et du meilleur article système, et les résultats de la recherche CoRL ont été annoncés.

Nov 10, 2023 pm 02:21 PM

Depuis sa première tenue en 2017, CoRL est devenue l'une des conférences universitaires les plus importantes au monde à l'intersection de la robotique et de l'apprentissage automatique. CoRL est une conférence à thème unique pour la recherche sur l'apprentissage des robots, couvrant plusieurs sujets tels que la robotique, l'apprentissage automatique et le contrôle, y compris la théorie et l'application. La conférence CoRL 2023 se tiendra à Atlanta, aux États-Unis, du 6 au 9 novembre. Selon les données officielles, 199 articles provenant de 25 pays ont été sélectionnés pour CoRL cette année. Les sujets populaires incluent les opérations, l’apprentissage par renforcement, etc. Bien que CoRL soit à plus petite échelle que les grandes conférences universitaires sur l'IA telles que l'AAAI et le CVPR, à mesure que la popularité de concepts tels que les grands modèles, l'intelligence incarnée et les robots humanoïdes augmente cette année, des recherches pertinentes dignes d'attention seront également