Périphériques technologiques

Périphériques technologiques

IA

IA

L'autorégulation est désormais la norme de contrôle de l'intelligence artificielle

L'autorégulation est désormais la norme de contrôle de l'intelligence artificielle

L'autorégulation est désormais la norme de contrôle de l'intelligence artificielle

Craignez-vous que l’intelligence artificielle se développe trop vite et puisse avoir des conséquences négatives ? Souhaitez-vous qu’il y ait une loi nationale le réglementant ? Aujourd’hui, il n’existe aucune nouvelle loi pour restreindre l’utilisation de l’IA, et l’autorégulation devient souvent la meilleure option pour les entreprises qui adoptent l’IA – du moins pour le moment.

Bien que de nombreuses années se soient écoulées depuis que « l'intelligence artificielle » a remplacé le « big data » en tant que mot à la mode dans le monde de la technologie, le lancement de ChatGPT fin novembre 2022 a déclenché une ruée vers l'or de l'intelligence artificielle, qui a inclus De nombreux observateurs de l’IA, dont nous, sont surpris. En quelques mois seulement, une multitude de puissants modèles d’IA générative ont attiré l’attention du monde entier, grâce à leur remarquable capacité à imiter le langage et la compréhension humains.

L'extraordinaire montée en puissance des modèles génératifs dans la culture dominante, alimentée par l'émergence de ChatGPT, soulève de nombreuses questions sur la direction que tout cela mène. Le phénomène étonnant de l’intelligence artificielle, capable de produire une poésie captivante et un art fantaisiste, cède la place aux inquiétudes quant aux conséquences négatives de l’intelligence artificielle, allant du préjudice causé aux consommateurs et aux pertes d’emplois, jusqu’à l’emprisonnement abusif et même à la destruction de l’humanité.

Cela inquiète beaucoup certaines personnes. Le mois dernier, une coalition de chercheurs en IA a demandé un moratoire de six mois sur le développement de nouveaux modèles génératifs plus grands que GPT-4 (Lectures complémentaires : Une lettre ouverte demande un moratoire sur la recherche en IA), GPT-4, le modèle massif OpenAI lancé le mois dernier. Modèle de langage (LLM).

Une lettre ouverte signée par Yoshua Bengio, lauréat du prix Turing, et Elon Musk, co-fondateur d'OpenAI, entre autres, déclare : « L'intelligence artificielle avancée pourrait représenter de profonds changements dans l'histoire de la vie sur Terre et devrait être planifiée avec la prudence et la prudence appropriées. "Malheureusement, ce niveau de planification et de gestion n'est pas atteint."

Les appels en faveur d'une réglementation de l'IA se multiplient. Les sondages montrent que les Américains ne pensent pas qu’on puisse faire confiance à l’intelligence artificielle et souhaitent qu’elle soit réglementée, en particulier sur des sujets importants comme les voitures autonomes et l’accès aux prestations gouvernementales.

Cependant, malgré plusieurs nouvelles lois locales ciblant l'IA – comme celle de New York qui se concentre sur l'utilisation de l'IA dans les efforts de recrutement et d'application qui ont été retardées jusqu'à ce mois – le Congrès n'a pas spécifiquement adopté de nouvelles réglementations fédérales sur l'intelligence artificielle. la ligne d'arrivée (même si l'IA a déjà fait son chemin dans le domaine juridique de secteurs hautement réglementés comme les services financiers et les soins de santé).

Sous l'impulsion de l'intelligence artificielle, que doit faire une entreprise ? Il n’est pas surprenant que les entreprises souhaitent partager les avantages de l’intelligence artificielle. Après tout, l’envie de s’orienter vers les données est considérée comme une nécessité pour survivre à l’ère numérique. Cependant, les entreprises souhaitent également éviter les conséquences négatives, réelles ou perçues, qui peuvent résulter d’une utilisation inappropriée de l’IA.

L'IA est sauvage dans « Westworld ». Andrew Burt, fondateur du cabinet d'avocats en intelligence artificielle BNH.AI, a déclaré un jour : « Personne ne sait comment gérer les risques. Tout le monde le fait différemment

Cela étant dit, il existe plusieurs cadres que les entreprises peuvent utiliser pour aider à gérer les risques. Intelligence artificielle. Burt recommande d'utiliser le cadre de gestion des risques d'intelligence artificielle (RMF : Risk Management Framework), qui provient du National Institute of Standards and Technology (NIST) et a été finalisé plus tôt cette année.

RMF aide les entreprises à réfléchir au fonctionnement de leur IA et aux conséquences négatives potentielles qu'elle peut avoir. Il utilise une approche « cartographier, mesurer, gérer et gouverner » pour comprendre et finalement atténuer les risques liés à l’utilisation de l’intelligence artificielle dans une variété d’offres de services.

Un autre cadre de gestion des risques liés à l'IA vient de Cathy O'Neil, PDG d'O'Neil Risk Advisory & Algorithmic Auditing (ORCAA). ORCAA a proposé un cadre appelé « Explicable Fairness ».

L'équité explicable donne aux organisations un moyen non seulement de tester les biais de leurs algorithmes, mais également d'étudier ce qui se passe lorsque des différences dans les résultats sont détectées. Par exemple, si une banque détermine l’éligibilité à un prêt étudiant, quels facteurs peuvent légalement être utilisés pour approuver ou refuser le prêt ou facturer des intérêts plus ou moins élevés ?

Évidemment, les banques doivent utiliser les données pour répondre à ces questions. Mais quelles données peuvent-ils utiliser, c’est-à-dire quels facteurs reflètent un demandeur de prêt ? Quels facteurs devraient être légalement autorisés à être utilisés et quels facteurs ne devraient pas être utilisés ? Répondre à ces questions n'est ni facile ni simple, a déclaré O'Neil.

O'Neil a déclaré lors d'une discussion lors de la Nvidia GPU Technology Conference (GTC) le mois dernier : "C'est l'objectif de ce cadre, c'est que ces facteurs juridiques doivent être légalisés

Même sans données." Avec les nouvelles lois sur l'IA, les entreprises devraient commencer à se demander comment mettre en œuvre l'IA de manière équitable et éthique pour se conformer aux lois existantes, a déclaré Triveni Gandhi, responsable de l'analyse et fournisseur de logiciels d'IA Dataiku AI.

« Les gens doivent commencer à réfléchir, d'accord, comment pouvons-nous examiner les lois existantes et les appliquer aux cas d'utilisation de l'IA qui existent actuellement ? « Il y a certaines réglementations, mais il y a aussi beaucoup de réflexion sur quoi ? nous voulons construire l'intelligence artificielle Une approche de l'intelligence éthique et axée sur les valeurs. Ce sont en fait les questions que les entreprises commencent à se poser, même sans réglementation globale

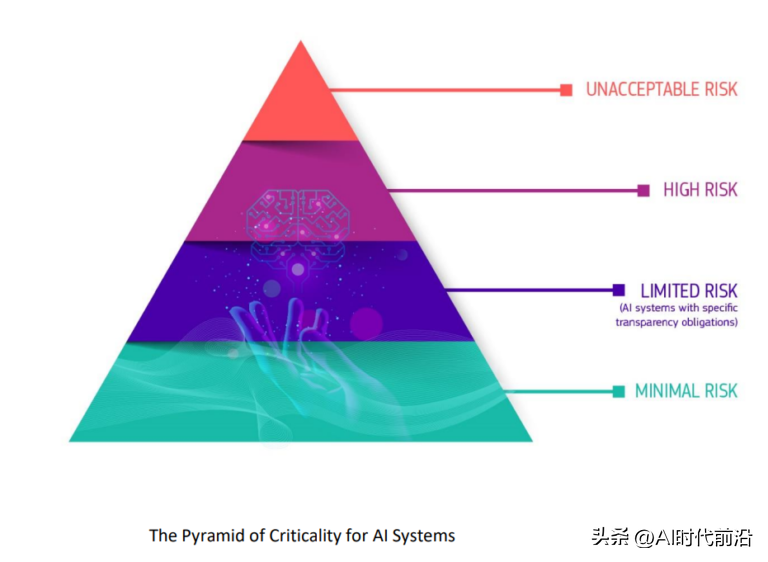

L'UE classe les méfaits potentiels de l'IA comme une menace. « pyramide de criticité »

L'UE avance déjà avec sa propre réglementation, la loi sur l'intelligence artificielle, qui pourrait entrer en vigueur plus tard cette année.

Le projet de loi sur l'intelligence artificielle créera un cadre réglementaire et juridique commun pour l'utilisation de l'intelligence artificielle qui affectera les résidents de l'UE, y compris la manière dont l'IA est développée, les fins pour lesquelles les entreprises peuvent l'utiliser et les lois en cas de non-respect des exigences. en conséquence de. La loi pourrait obliger les entreprises à obtenir une autorisation avant d’adopter l’IA dans certains cas d’usage et interdire certaines autres utilisations de l’IA jugées trop risquées.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Bytedance Cutting lance le super abonnement SVIP : 499 yuans pour un abonnement annuel continu, offrant une variété de fonctions d'IA

Jun 28, 2024 am 03:51 AM

Bytedance Cutting lance le super abonnement SVIP : 499 yuans pour un abonnement annuel continu, offrant une variété de fonctions d'IA

Jun 28, 2024 am 03:51 AM

Ce site a rapporté le 27 juin que Jianying est un logiciel de montage vidéo développé par FaceMeng Technology, une filiale de ByteDance. Il s'appuie sur la plateforme Douyin et produit essentiellement du contenu vidéo court pour les utilisateurs de la plateforme. Il est compatible avec iOS, Android et. Windows, MacOS et autres systèmes d'exploitation. Jianying a officiellement annoncé la mise à niveau de son système d'adhésion et a lancé un nouveau SVIP, qui comprend une variété de technologies noires d'IA, telles que la traduction intelligente, la mise en évidence intelligente, l'emballage intelligent, la synthèse humaine numérique, etc. En termes de prix, les frais mensuels pour le clipping SVIP sont de 79 yuans, les frais annuels sont de 599 yuans (attention sur ce site : équivalent à 49,9 yuans par mois), l'abonnement mensuel continu est de 59 yuans par mois et l'abonnement annuel continu est de 59 yuans par mois. est de 499 yuans par an (équivalent à 41,6 yuans par mois) . En outre, le responsable de Cut a également déclaré que afin d'améliorer l'expérience utilisateur, ceux qui se sont abonnés au VIP d'origine

Assistant de codage d'IA augmenté par le contexte utilisant Rag et Sem-Rag

Jun 10, 2024 am 11:08 AM

Assistant de codage d'IA augmenté par le contexte utilisant Rag et Sem-Rag

Jun 10, 2024 am 11:08 AM

Améliorez la productivité, l’efficacité et la précision des développeurs en intégrant une génération et une mémoire sémantique améliorées par la récupération dans les assistants de codage IA. Traduit de EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG, auteur JanakiramMSV. Bien que les assistants de programmation d'IA de base soient naturellement utiles, ils ne parviennent souvent pas à fournir les suggestions de code les plus pertinentes et les plus correctes, car ils s'appuient sur une compréhension générale du langage logiciel et des modèles d'écriture de logiciels les plus courants. Le code généré par ces assistants de codage est adapté à la résolution des problèmes qu’ils sont chargés de résoudre, mais n’est souvent pas conforme aux normes, conventions et styles de codage des équipes individuelles. Cela aboutit souvent à des suggestions qui doivent être modifiées ou affinées pour que le code soit accepté dans l'application.

Sept questions d'entretien technique Cool GenAI et LLM

Jun 07, 2024 am 10:06 AM

Sept questions d'entretien technique Cool GenAI et LLM

Jun 07, 2024 am 10:06 AM

Pour en savoir plus sur l'AIGC, veuillez visiter : 51CTOAI.x Community https://www.51cto.com/aigc/Translator|Jingyan Reviewer|Chonglou est différent de la banque de questions traditionnelle que l'on peut voir partout sur Internet. nécessite de sortir des sentiers battus. Les grands modèles linguistiques (LLM) sont de plus en plus importants dans les domaines de la science des données, de l'intelligence artificielle générative (GenAI) et de l'intelligence artificielle. Ces algorithmes complexes améliorent les compétences humaines et stimulent l’efficacité et l’innovation dans de nombreux secteurs, devenant ainsi la clé permettant aux entreprises de rester compétitives. LLM a un large éventail d'applications. Il peut être utilisé dans des domaines tels que le traitement du langage naturel, la génération de texte, la reconnaissance vocale et les systèmes de recommandation. En apprenant de grandes quantités de données, LLM est capable de générer du texte

Le réglage fin peut-il vraiment permettre au LLM d'apprendre de nouvelles choses : l'introduction de nouvelles connaissances peut amener le modèle à produire davantage d'hallucinations

Jun 11, 2024 pm 03:57 PM

Le réglage fin peut-il vraiment permettre au LLM d'apprendre de nouvelles choses : l'introduction de nouvelles connaissances peut amener le modèle à produire davantage d'hallucinations

Jun 11, 2024 pm 03:57 PM

Les grands modèles linguistiques (LLM) sont formés sur d'énormes bases de données textuelles, où ils acquièrent de grandes quantités de connaissances du monde réel. Ces connaissances sont intégrées à leurs paramètres et peuvent ensuite être utilisées en cas de besoin. La connaissance de ces modèles est « réifiée » en fin de formation. À la fin de la pré-formation, le modèle arrête effectivement d’apprendre. Alignez ou affinez le modèle pour apprendre à exploiter ces connaissances et répondre plus naturellement aux questions des utilisateurs. Mais parfois, la connaissance du modèle ne suffit pas, et bien que le modèle puisse accéder à du contenu externe via RAG, il est considéré comme bénéfique de l'adapter à de nouveaux domaines grâce à un réglage fin. Ce réglage fin est effectué à l'aide de la contribution d'annotateurs humains ou d'autres créations LLM, où le modèle rencontre des connaissances supplémentaires du monde réel et les intègre.

Afin de fournir un nouveau système de référence et d'évaluation de questions-réponses scientifiques et complexes pour les grands modèles, l'UNSW, Argonne, l'Université de Chicago et d'autres institutions ont lancé conjointement le cadre SciQAG.

Jul 25, 2024 am 06:42 AM

Afin de fournir un nouveau système de référence et d'évaluation de questions-réponses scientifiques et complexes pour les grands modèles, l'UNSW, Argonne, l'Université de Chicago et d'autres institutions ont lancé conjointement le cadre SciQAG.

Jul 25, 2024 am 06:42 AM

L'ensemble de données ScienceAI Question Answering (QA) joue un rôle essentiel dans la promotion de la recherche sur le traitement du langage naturel (NLP). Des ensembles de données d'assurance qualité de haute qualité peuvent non seulement être utilisés pour affiner les modèles, mais également évaluer efficacement les capacités des grands modèles linguistiques (LLM), en particulier la capacité à comprendre et à raisonner sur les connaissances scientifiques. Bien qu’il existe actuellement de nombreux ensembles de données scientifiques d’assurance qualité couvrant la médecine, la chimie, la biologie et d’autres domaines, ces ensembles de données présentent encore certaines lacunes. Premièrement, le formulaire de données est relativement simple, et la plupart sont des questions à choix multiples. Elles sont faciles à évaluer, mais limitent la plage de sélection des réponses du modèle et ne peuvent pas tester pleinement la capacité du modèle à répondre aux questions scientifiques. En revanche, les questions et réponses ouvertes

Cinq écoles d'apprentissage automatique que vous ne connaissez pas

Jun 05, 2024 pm 08:51 PM

Cinq écoles d'apprentissage automatique que vous ne connaissez pas

Jun 05, 2024 pm 08:51 PM

L'apprentissage automatique est une branche importante de l'intelligence artificielle qui donne aux ordinateurs la possibilité d'apprendre à partir de données et d'améliorer leurs capacités sans être explicitement programmés. L'apprentissage automatique a un large éventail d'applications dans divers domaines, de la reconnaissance d'images et du traitement du langage naturel aux systèmes de recommandation et à la détection des fraudes, et il change notre façon de vivre. Il existe de nombreuses méthodes et théories différentes dans le domaine de l'apprentissage automatique, parmi lesquelles les cinq méthodes les plus influentes sont appelées les « Cinq écoles d'apprentissage automatique ». Les cinq grandes écoles sont l’école symbolique, l’école connexionniste, l’école évolutionniste, l’école bayésienne et l’école analogique. 1. Le symbolisme, également connu sous le nom de symbolisme, met l'accent sur l'utilisation de symboles pour le raisonnement logique et l'expression des connaissances. Cette école de pensée estime que l'apprentissage est un processus de déduction inversée, à travers les connaissances existantes.

Les performances de SOTA, la méthode d'IA de prédiction d'affinité protéine-ligand multimodale de Xiamen, combinent pour la première fois des informations sur la surface moléculaire

Jul 17, 2024 pm 06:37 PM

Les performances de SOTA, la méthode d'IA de prédiction d'affinité protéine-ligand multimodale de Xiamen, combinent pour la première fois des informations sur la surface moléculaire

Jul 17, 2024 pm 06:37 PM

Editeur | KX Dans le domaine de la recherche et du développement de médicaments, il est crucial de prédire avec précision et efficacité l'affinité de liaison des protéines et des ligands pour le criblage et l'optimisation des médicaments. Cependant, les études actuelles ne prennent pas en compte le rôle important des informations sur la surface moléculaire dans les interactions protéine-ligand. Sur cette base, des chercheurs de l'Université de Xiamen ont proposé un nouveau cadre d'extraction de caractéristiques multimodales (MFE), qui combine pour la première fois des informations sur la surface des protéines, la structure et la séquence 3D, et utilise un mécanisme d'attention croisée pour comparer différentes modalités. alignement. Les résultats expérimentaux démontrent que cette méthode atteint des performances de pointe dans la prédiction des affinités de liaison protéine-ligand. De plus, les études d’ablation démontrent l’efficacité et la nécessité des informations sur la surface des protéines et de l’alignement des caractéristiques multimodales dans ce cadre. Les recherches connexes commencent par "S

Préparant des marchés tels que l'IA, GlobalFoundries acquiert la technologie du nitrure de gallium de Tagore Technology et les équipes associées

Jul 15, 2024 pm 12:21 PM

Préparant des marchés tels que l'IA, GlobalFoundries acquiert la technologie du nitrure de gallium de Tagore Technology et les équipes associées

Jul 15, 2024 pm 12:21 PM

Selon les informations de ce site Web du 5 juillet, GlobalFoundries a publié un communiqué de presse le 1er juillet de cette année, annonçant l'acquisition de la technologie de nitrure de gallium (GaN) et du portefeuille de propriété intellectuelle de Tagore Technology, dans l'espoir d'élargir sa part de marché dans l'automobile et Internet. des objets et des domaines d'application des centres de données d'intelligence artificielle pour explorer une efficacité plus élevée et de meilleures performances. Alors que des technologies telles que l’intelligence artificielle générative (GenerativeAI) continuent de se développer dans le monde numérique, le nitrure de gallium (GaN) est devenu une solution clé pour une gestion durable et efficace de l’énergie, notamment dans les centres de données. Ce site Web citait l'annonce officielle selon laquelle, lors de cette acquisition, l'équipe d'ingénierie de Tagore Technology rejoindrait GF pour développer davantage la technologie du nitrure de gallium. g