Périphériques technologiques

Périphériques technologiques

IA

IA

Décrire brièvement les cinq types d'accélérateurs d'apprentissage automatique

Décrire brièvement les cinq types d'accélérateurs d'apprentissage automatique

Décrire brièvement les cinq types d'accélérateurs d'apprentissage automatique

Traducteur | Bugatti

Critique | Sun Shujuan

Les dix dernières années ont été l'ère de l'apprentissage profond. Nous sommes enthousiasmés par une série de grands événements, d'AlphaGo au DELL-E 2. D’innombrables produits ou services basés sur l’intelligence artificielle (IA) sont apparus dans la vie quotidienne, notamment les appareils Alexa, les recommandations publicitaires, les robots d’entrepôt et les voitures autonomes. Ces dernières années, la taille des modèles d’apprentissage profond a augmenté de façon exponentielle. Ce n'est pas une nouveauté : le modèle Wu Dao 2.0 contient 1 750 milliards de paramètres et la formation de GPT-3 sur des instances de 240 ml.p4d.24xlarge dans la plateforme de formation SageMaker ne prend qu'environ 25 jours.

Mais à mesure que la formation et le déploiement du deep learning évoluent, cela devient de plus en plus difficile. À mesure que les modèles d’apprentissage profond évoluent, l’évolutivité et l’efficacité constituent deux défis majeurs en matière de formation et de déploiement.

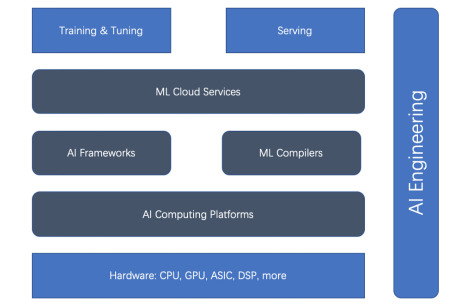

Figure 1. La relation entre formation et accélérateur de déploiement

On le voit , Les accélérateurs matériels et les frameworks d'IA sont le courant dominant de l'accélération. Mais récemment, les compilateurs ML, les plateformes informatiques d’IA et les services cloud ML sont devenus de plus en plus importants.

TensorFlow :

TensorFlow est le framework phare d'IA. TensorFlow domine la communauté open source du deep learning depuis le début. TensorFlow Serving est une plateforme bien définie et mature. Pour Internet et l'IoT, TensorFlow.js et TensorFlow Lite sont également matures. Mais en raison des limites de l'exploration précoce du deep learning, TensorFlow 1.x a été conçu pour créer des graphiques statiques d'une manière non Python. Cela devient un obstacle à une évaluation immédiate en utilisant le mode « impatient », qui permet à PyTorch de s'améliorer rapidement dans le domaine de la recherche. TensorFlow 2.x essaie de rattraper son retard, mais malheureusement, la mise à niveau de TensorFlow 1.x vers 2.x est fastidieuse. TensorFlow introduit également Keras pour faciliter son utilisation globale, et XLA (Accelerated Linear Algebra), un compilateur d'optimisation, pour accélérer la couche inférieure.PyTorch :

Avec son mode enthousiaste et son approche de type Python, PyTorch est un cheval de bataille dans la communauté du deep learning d'aujourd'hui, utilisé dans tout, de la recherche à la production. En plus de TorchServe, PyTorch s'intègre également à des plates-formes indépendantes du framework telles que Kubeflow. De plus, la popularité de PyTorch est indissociable du succès de la bibliothèque Transformers de Hugging Face.JAX :

Google présente JAX, NumPy et JIT accélérés par les appareils. Tout comme PyTorch l'a fait il y a quelques années, il s'agit d'un cadre d'apprentissage profond plus natif qui gagne rapidement en popularité dans la communauté des chercheurs. Mais ce n'est pas encore un produit Google « officiel », comme le prétend Google.2. Accélérateur matériel

Il ne fait aucun doute que le GPU de Nvidia peut accélérer la formation en deep learning, mais il a été conçu à l'origine pour les cartes vidéo.Après l'émergence des GPU à usage général, les cartes graphiques utilisées pour l'entraînement des réseaux neuronaux sont devenues extrêmement populaires. Ces GPU à usage général peuvent exécuter du code arbitraire, pas seulement le rendu des sous-programmes. Le langage de programmation CUDA de NVIDIA permet d'écrire du code arbitraire dans un langage de type C. Le GPU à usage général dispose d'un modèle de programmation relativement pratique, d'un mécanisme de parallélisme à grande échelle et d'une bande passante mémoire élevée, et constitue désormais une plate-forme idéale pour la programmation de réseaux neuronaux.

Aujourd'hui, NVIDIA prend en charge une gamme de GPU allant du bureau au mobile, en passant par la station de travail, la station de travail mobile, la console de jeu et le centre de données. Avec le grand succès du GPU NVIDIA, de nombreux successeurs sont en cours de route, comme le GPU d'AMD et le TPU ASIC de Google.3. AI Computing Platform

Comme mentionné précédemment, la vitesse de formation et de déploiement du ML dépend fortement du matériel (tel que le GPU et le TPU). Ces plates-formes pilotes (c'est-à-dire les plates-formes informatiques d'IA) sont essentielles à la performance. Il existe deux plates-formes informatiques d'IA bien connues : CUDA et OpenCL.

CUDA : CUDA (Compute Unified Device Architecture) est un paradigme de programmation parallèle publié par NVIDIA en 2007. Il est conçu pour de nombreuses applications générales sur processeurs graphiques et GPU. CUDA est une API propriétaire qui prend uniquement en charge les GPU à architecture Tesla de NVIDIA. Les cartes graphiques prises en charge par CUDA incluent les séries GeForce 8, Tesla et Quadro.

OpenCL : OpenCL (Open Computing Language) a été initialement développé par Apple et maintenant maintenu par l'équipe Khronos pour l'informatique hétérogène, y compris les CPU, GPU, DSP et autres types de processeurs. Ce langage portable est suffisamment adaptable pour permettre des performances élevées sur toutes les plates-formes matérielles, y compris les GPU de Nvidia.

NVIDIA est désormais compatible OpenCL 3.0 pour une utilisation avec les pilotes R465 et supérieurs. À l'aide de l'API OpenCL, on peut lancer des noyaux de calcul écrits dans un sous-ensemble limité du langage de programmation C sur le GPU.

4. ML Compiler

Le compilateur ML joue un rôle essentiel dans l'accélération de la formation et du déploiement. Les compilateurs ML peuvent améliorer considérablement l'efficacité du déploiement de modèles à grande échelle. Il existe de nombreux compilateurs populaires tels que Apache TVM, LLVM, Google MLIR, TensorFlow XLA, Meta Glow, PyTorch nvFuser et Intel PlaidML.

5. ML Cloud Services

La plateforme et les services cloud ML gèrent la plateforme ML dans le cloud. Ils peuvent être optimisés de plusieurs manières pour augmenter l’efficacité.

Prenons Amazon SageMaker comme exemple. Il s'agit d'un service de plate-forme cloud ML de premier plan. SageMaker fournit une large gamme de fonctionnalités pour le cycle de vie du ML : de la préparation, de la création, de la formation/réglage au déploiement/gestion.

Il optimise de nombreux aspects pour améliorer l'efficacité de la formation et du déploiement, tels que les points de terminaison multimodèles sur GPU, une formation rentable utilisant des clusters hétérogènes et un processeur Graviton propriétaire adapté à l'inférence ML basée sur le CPU.

Conclusion

À mesure que l'ampleur de la formation et du déploiement du deep learning continue de s'étendre, les défis deviennent de plus en plus grands. Améliorer l’efficacité de la formation et du déploiement du deep learning est complexe. Sur la base du cycle de vie du ML, cinq aspects peuvent accélérer la formation et le déploiement du ML : le cadre d'IA, l'accélérateur matériel, la plate-forme informatique, le compilateur ML et le service cloud. L’ingénierie de l’IA peut coordonner tous ces éléments et utiliser des principes d’ingénierie pour améliorer l’efficacité à tous les niveaux.

Titre original : 5 types d'accélérateurs de ML, auteur : Luhui Hu

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

1359

1359

52

52

Bytedance Cutting lance le super abonnement SVIP : 499 yuans pour un abonnement annuel continu, offrant une variété de fonctions d'IA

Jun 28, 2024 am 03:51 AM

Bytedance Cutting lance le super abonnement SVIP : 499 yuans pour un abonnement annuel continu, offrant une variété de fonctions d'IA

Jun 28, 2024 am 03:51 AM

Ce site a rapporté le 27 juin que Jianying est un logiciel de montage vidéo développé par FaceMeng Technology, une filiale de ByteDance. Il s'appuie sur la plateforme Douyin et produit essentiellement du contenu vidéo court pour les utilisateurs de la plateforme. Il est compatible avec iOS, Android et. Windows, MacOS et autres systèmes d'exploitation. Jianying a officiellement annoncé la mise à niveau de son système d'adhésion et a lancé un nouveau SVIP, qui comprend une variété de technologies noires d'IA, telles que la traduction intelligente, la mise en évidence intelligente, l'emballage intelligent, la synthèse humaine numérique, etc. En termes de prix, les frais mensuels pour le clipping SVIP sont de 79 yuans, les frais annuels sont de 599 yuans (attention sur ce site : équivalent à 49,9 yuans par mois), l'abonnement mensuel continu est de 59 yuans par mois et l'abonnement annuel continu est de 59 yuans par mois. est de 499 yuans par an (équivalent à 41,6 yuans par mois) . En outre, le responsable de Cut a également déclaré que afin d'améliorer l'expérience utilisateur, ceux qui se sont abonnés au VIP d'origine

Assistant de codage d'IA augmenté par le contexte utilisant Rag et Sem-Rag

Jun 10, 2024 am 11:08 AM

Assistant de codage d'IA augmenté par le contexte utilisant Rag et Sem-Rag

Jun 10, 2024 am 11:08 AM

Améliorez la productivité, l’efficacité et la précision des développeurs en intégrant une génération et une mémoire sémantique améliorées par la récupération dans les assistants de codage IA. Traduit de EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG, auteur JanakiramMSV. Bien que les assistants de programmation d'IA de base soient naturellement utiles, ils ne parviennent souvent pas à fournir les suggestions de code les plus pertinentes et les plus correctes, car ils s'appuient sur une compréhension générale du langage logiciel et des modèles d'écriture de logiciels les plus courants. Le code généré par ces assistants de codage est adapté à la résolution des problèmes qu’ils sont chargés de résoudre, mais n’est souvent pas conforme aux normes, conventions et styles de codage des équipes individuelles. Cela aboutit souvent à des suggestions qui doivent être modifiées ou affinées pour que le code soit accepté dans l'application.

Le réglage fin peut-il vraiment permettre au LLM d'apprendre de nouvelles choses : l'introduction de nouvelles connaissances peut amener le modèle à produire davantage d'hallucinations

Jun 11, 2024 pm 03:57 PM

Le réglage fin peut-il vraiment permettre au LLM d'apprendre de nouvelles choses : l'introduction de nouvelles connaissances peut amener le modèle à produire davantage d'hallucinations

Jun 11, 2024 pm 03:57 PM

Les grands modèles linguistiques (LLM) sont formés sur d'énormes bases de données textuelles, où ils acquièrent de grandes quantités de connaissances du monde réel. Ces connaissances sont intégrées à leurs paramètres et peuvent ensuite être utilisées en cas de besoin. La connaissance de ces modèles est « réifiée » en fin de formation. À la fin de la pré-formation, le modèle arrête effectivement d’apprendre. Alignez ou affinez le modèle pour apprendre à exploiter ces connaissances et répondre plus naturellement aux questions des utilisateurs. Mais parfois, la connaissance du modèle ne suffit pas, et bien que le modèle puisse accéder à du contenu externe via RAG, il est considéré comme bénéfique de l'adapter à de nouveaux domaines grâce à un réglage fin. Ce réglage fin est effectué à l'aide de la contribution d'annotateurs humains ou d'autres créations LLM, où le modèle rencontre des connaissances supplémentaires du monde réel et les intègre.

Sept questions d'entretien technique Cool GenAI et LLM

Jun 07, 2024 am 10:06 AM

Sept questions d'entretien technique Cool GenAI et LLM

Jun 07, 2024 am 10:06 AM

Pour en savoir plus sur l'AIGC, veuillez visiter : 51CTOAI.x Community https://www.51cto.com/aigc/Translator|Jingyan Reviewer|Chonglou est différent de la banque de questions traditionnelle que l'on peut voir partout sur Internet. nécessite de sortir des sentiers battus. Les grands modèles linguistiques (LLM) sont de plus en plus importants dans les domaines de la science des données, de l'intelligence artificielle générative (GenAI) et de l'intelligence artificielle. Ces algorithmes complexes améliorent les compétences humaines et stimulent l’efficacité et l’innovation dans de nombreux secteurs, devenant ainsi la clé permettant aux entreprises de rester compétitives. LLM a un large éventail d'applications. Il peut être utilisé dans des domaines tels que le traitement du langage naturel, la génération de texte, la reconnaissance vocale et les systèmes de recommandation. En apprenant de grandes quantités de données, LLM est capable de générer du texte

Afin de fournir un nouveau système de référence et d'évaluation de questions-réponses scientifiques et complexes pour les grands modèles, l'UNSW, Argonne, l'Université de Chicago et d'autres institutions ont lancé conjointement le cadre SciQAG.

Jul 25, 2024 am 06:42 AM

Afin de fournir un nouveau système de référence et d'évaluation de questions-réponses scientifiques et complexes pour les grands modèles, l'UNSW, Argonne, l'Université de Chicago et d'autres institutions ont lancé conjointement le cadre SciQAG.

Jul 25, 2024 am 06:42 AM

L'ensemble de données ScienceAI Question Answering (QA) joue un rôle essentiel dans la promotion de la recherche sur le traitement du langage naturel (NLP). Des ensembles de données d'assurance qualité de haute qualité peuvent non seulement être utilisés pour affiner les modèles, mais également évaluer efficacement les capacités des grands modèles linguistiques (LLM), en particulier la capacité à comprendre et à raisonner sur les connaissances scientifiques. Bien qu’il existe actuellement de nombreux ensembles de données scientifiques d’assurance qualité couvrant la médecine, la chimie, la biologie et d’autres domaines, ces ensembles de données présentent encore certaines lacunes. Premièrement, le formulaire de données est relativement simple, et la plupart sont des questions à choix multiples. Elles sont faciles à évaluer, mais limitent la plage de sélection des réponses du modèle et ne peuvent pas tester pleinement la capacité du modèle à répondre aux questions scientifiques. En revanche, les questions et réponses ouvertes

Cinq écoles d'apprentissage automatique que vous ne connaissez pas

Jun 05, 2024 pm 08:51 PM

Cinq écoles d'apprentissage automatique que vous ne connaissez pas

Jun 05, 2024 pm 08:51 PM

L'apprentissage automatique est une branche importante de l'intelligence artificielle qui donne aux ordinateurs la possibilité d'apprendre à partir de données et d'améliorer leurs capacités sans être explicitement programmés. L'apprentissage automatique a un large éventail d'applications dans divers domaines, de la reconnaissance d'images et du traitement du langage naturel aux systèmes de recommandation et à la détection des fraudes, et il change notre façon de vivre. Il existe de nombreuses méthodes et théories différentes dans le domaine de l'apprentissage automatique, parmi lesquelles les cinq méthodes les plus influentes sont appelées les « Cinq écoles d'apprentissage automatique ». Les cinq grandes écoles sont l’école symbolique, l’école connexionniste, l’école évolutionniste, l’école bayésienne et l’école analogique. 1. Le symbolisme, également connu sous le nom de symbolisme, met l'accent sur l'utilisation de symboles pour le raisonnement logique et l'expression des connaissances. Cette école de pensée estime que l'apprentissage est un processus de déduction inversée, à travers les connaissances existantes.

Les performances de SOTA, la méthode d'IA de prédiction d'affinité protéine-ligand multimodale de Xiamen, combinent pour la première fois des informations sur la surface moléculaire

Jul 17, 2024 pm 06:37 PM

Les performances de SOTA, la méthode d'IA de prédiction d'affinité protéine-ligand multimodale de Xiamen, combinent pour la première fois des informations sur la surface moléculaire

Jul 17, 2024 pm 06:37 PM

Editeur | KX Dans le domaine de la recherche et du développement de médicaments, il est crucial de prédire avec précision et efficacité l'affinité de liaison des protéines et des ligands pour le criblage et l'optimisation des médicaments. Cependant, les études actuelles ne prennent pas en compte le rôle important des informations sur la surface moléculaire dans les interactions protéine-ligand. Sur cette base, des chercheurs de l'Université de Xiamen ont proposé un nouveau cadre d'extraction de caractéristiques multimodales (MFE), qui combine pour la première fois des informations sur la surface des protéines, la structure et la séquence 3D, et utilise un mécanisme d'attention croisée pour comparer différentes modalités. alignement. Les résultats expérimentaux démontrent que cette méthode atteint des performances de pointe dans la prédiction des affinités de liaison protéine-ligand. De plus, les études d’ablation démontrent l’efficacité et la nécessité des informations sur la surface des protéines et de l’alignement des caractéristiques multimodales dans ce cadre. Les recherches connexes commencent par "S

AlphaFold 3 est lancé, prédisant de manière exhaustive les interactions et les structures des protéines et de toutes les molécules de la vie, avec une précision bien plus grande que jamais

Jul 16, 2024 am 12:08 AM

AlphaFold 3 est lancé, prédisant de manière exhaustive les interactions et les structures des protéines et de toutes les molécules de la vie, avec une précision bien plus grande que jamais

Jul 16, 2024 am 12:08 AM

Editeur | Radis Skin Depuis la sortie du puissant AlphaFold2 en 2021, les scientifiques utilisent des modèles de prédiction de la structure des protéines pour cartographier diverses structures protéiques dans les cellules, découvrir des médicaments et dresser une « carte cosmique » de chaque interaction protéique connue. Tout à l'heure, Google DeepMind a publié le modèle AlphaFold3, capable d'effectuer des prédictions de structure conjointe pour des complexes comprenant des protéines, des acides nucléiques, de petites molécules, des ions et des résidus modifiés. La précision d’AlphaFold3 a été considérablement améliorée par rapport à de nombreux outils dédiés dans le passé (interaction protéine-ligand, interaction protéine-acide nucléique, prédiction anticorps-antigène). Cela montre qu’au sein d’un cadre unique et unifié d’apprentissage profond, il est possible de réaliser