Périphériques technologiques

Périphériques technologiques

IA

IA

360+ Wisdom AI, la version chinoise de 'Microsoft + OpenAI' est ici

360+ Wisdom AI, la version chinoise de 'Microsoft + OpenAI' est ici

360+ Wisdom AI, la version chinoise de 'Microsoft + OpenAI' est ici

Dans la recherche et le développement de la technologie de base des grands modèles, 360 adopte une recherche et un développement indépendants + une recherche et un développement coopératif de l'entraînement « double moteur » pour améliorer la compétitivité du « moteur » de base.

Auteur/Luo Zhi Nanming

revue des produits/nouvelles affaires

Le succès de ChatGPT n'est en aucun cas dû à ses propres efforts. Derrière cette application qui connaît la croissance la plus rapide de l'histoire, le collaborateur Microsoft joue un rôle essentiel. C'est la coopération entre l'industrie et la recherche qui a contribué à la subversion de. technologie de grand modèle de langage. La Chine a lancé une grande guerre de modèles. Cependant, après plusieurs mois d'agitation, aucune entreprise ne s'est engagée dans cette voie éprouvée. La question de savoir si la version chinoise de « Microsoft + OpenAI » apparaîtra est la préoccupation de l'industrie.

Aujourd'hui, 360 Company et Zhipu AI ont annoncé une coopération stratégique et ont finalement annoncé le plan de coopération. Le modèle à grande échelle « 360GLM » développé conjointement par les deux parties a atteint le niveau d'une nouvelle génération de modèle général d'intelligence cognitive.

1. L'ère des grands modèles en Chine arrive

La sortie de ChatGPT a déclenché un grand changement. Microsoft a annoncé que ChatGPT serait intégré dans la famille Office, ce qui a apporté une innovation disruptive dans les applications et a choqué le monde entier.

En regardant la Chine, après la sortie et l'application de ChatGPT, les grands fabricants ont rapidement suivi Wen Xinyiyan de Baidu, Tongyi Qianwen d'Alibaba, Xinghuo d'iFlytek, etc. une nouvelle percée.

Dans le même temps, les grands fabricants ont également reconnu l'urgence d'intégrer la technologie des modèles à grande échelle dans des applications pratiques. Alibaba Cloud a annoncé que tous les produits Alibaba seront entièrement mis à niveau en accédant au grand modèle « Tongyi Qianwen » à l'avenir ; le grand modèle Spark d'iFlytek possède des fonctionnalités de base telles que la génération de texte, les questions et réponses de connaissances et les capacités mathématiques.

La réalité est que bien que de nombreuses entreprises aient lancé de grands modèles, les capacités de chaque grand modèle sont presque les mêmes. Personne ne peut être loin en avance et dominer le monde, mais ce qui est sûr, c'est que lorsque tout le monde « peint le monde ». tarte", l'atterrissage est la clé.

Il existe un consensus dans l'industrie selon lequel le facteur décisif pour gagner est le "scénario". Seules les entreprises disposant de scénarios peuvent occuper une position de leader dans la future compétition de la grande industrie du mannequinat.

La technologie des grands modèles en elle-même n'est plus un seuil. Comment mieux combiner industrie et recherche et comment mieux la mettre en œuvre sont des questions auxquelles tous les acteurs entrant dans l'industrie du grand modèle doivent réfléchir davantage.

Évidemment, il est plus facile de réussir en suivant un chemin éprouvé.

La coopération entre 360 et Zhipu AI peut être considérée comme la version chinoise de « Microsoft + OpenAI ».

S'il n'y a que des entreprises industrielles, les idéaux à long terme des scientifiques de l'Open AI manqueront, et personne ne pourra penser à aller plus loin sur la voie de l'encodage de toutes les connaissances humaines dans de grands modèles.

L'inverse est le même. S'il n'y a que l'Open AI, cela ne sert à rien de publier des articles en continu. Après tout, si les articles et les technologies ne peuvent pas être combinés avec les scénarios des utilisateurs, ils ne réussiront pas.

Microsoft et Open AI ont une très bonne division du travail : Microsoft regroupe les services Open AI dans ses produits, permettant aux services Open AI d'être véritablement conçus, basés sur des scénarios, des produits et même commercialisés.

Open AI n'est pas nécessairement bon en commercialisation, ni en développement de produits et de scénarios, mais il passe constamment de GPT3.5 à GPT4.0 en termes de technologie de base. Peut-être que GPT5 est déjà en route. .

Les pays étrangers se sont déjà engagés sur la voie réussie de l'intégration de la production et de la recherche, et 360 n'a aucune raison de refuser d'imiter cette voie réussie.

2. "Combinaison GPT Chine" de technologie + scène

Zhipu AI est une entreprise issue des réalisations technologiques du département d'informatique de l'Université Tsinghua. Elle a été classée comme l'entreprise ayant le « tempérament et le niveau le plus OpenAI » en Chine en novembre de l'année dernière, par l'Université de Stanford. Model Center a mené une enquête auprès de 30 grandes entreprises à travers le monde. Les grands modèles font l'objet d'une évaluation complète. Le modèle de pré-formation bilingue à très grande échelle de 100 milliards de dollars GLM-130B développé par Zhipu AI est le seul grand modèle sélectionné en Asie. .

Les résultats d'évaluation professionnelle montrent que les indicateurs clés du GLM-130B, tels que la précision, sont proches ou identiques à ceux des grands modèles d'entreprises telles que OpenAI, Google Brain, Microsoft et Nvidia. Plus de 1 000 institutions dans 70 pays à travers le monde. demandé pour utilisation.

En tant que grande entreprise technologique de modèle de premier plan, Zhipu AI est en tête pour rattraper OpenAI. Cependant, il ne suffit pas d'être techniquement compétent. La réussite la plus importante réside dans son application dans des scénarios réels.

Cette coopération entre 360 et Zhipu AI est une pratique importante dans la combinaison de grands modèles avec des scènes. Zhou Hongyi, fondateur de 360, a toujours souligné l'importance des scénarios dans le développement de grands modèles. Il a dit un jour que si la technologie ne pouvait pas être combinée avec les scénarios des utilisateurs, elle ne réussirait pas.

Alors que l'impact de ChatGPT sur l'humanité continue de s'approfondir, de plus en plus d'entreprises nationales se lancent dans le domaine des grands modèles. À cet égard, Zhou Hongyi a déclaré : La chose la plus importante n'est pas d'avoir une technologie de grands modèles, mais de savoir comment en tirer des leçons. Mode de coopération Microsoft et OpenAI, comment obtenir de meilleures données pour la formation, comment mettre en œuvre de meilleures méthodes de formation en ingénierie et comment trouver de meilleurs scénarios utilisateur pour utiliser votre grand modèle.

Il est entendu que la MAU moyenne du navigateur 360 est de 416 millions et que le volume quotidien moyen des requêtes de 360 Search dépasse 1 milliard de fois, ce qui jette les bases de l'exploitation ultérieure du trafic, des commentaires des utilisateurs et de l'optimisation du modèle du grand modèle.

L'application complète de 360, comparable au « Family Bucket » de Microsoft, offre des opportunités technologiques pour Zhipu AI En même temps, grâce aux données de l'application complète, elle peut aider la technologie des grands modèles à fournir un support de données. les grands modèles, une prise en charge accrue des données et un retour d'informations sur les scénarios constituent également une étape importante pour contribuer à son amélioration. La technologie et les données travaillent ensemble pour créer un effet de volant.

Dans une certaine mesure, le « volume » des grands modèles n'est pas seulement la technologie, mais aussi la combinaison de la technologie et de l'application.

Le modèle de coopération entre Microsoft et OpenAI s'est avéré réalisable, prouvant ce point. La mise en œuvre de la technologie des modèles à grande échelle en Chine nécessite un examen plus approfondi de son application et ne doit pas se limiter à un domaine ou à un scénario donné.

Ayant des scénarios d'utilisation comparables à ceux de Microsoft, La coopération entre 360 et Zhipu AI deviendra le meilleur exemple de la version chinoise du modèle "Microsoft + OpenAI", occupant un certain avantage dans la concurrence dans la grande industrie du modèle La technique. avantages des deux parties Une alliance forte, basée sur la complémentarité de la technologie et des scénarios, peut élever la concurrence dans l'industrie nationale du grand modélisme à une toute nouvelle dimension.

3. L'ère de l'IA, deux lignes de 360

La stratégie de l’intelligence artificielle de360 est de « voler des deux côtés ». D’une part, elle développe des technologies de base, et d’autre part, elle s’empare des scénarios utilisateurs.

Afin d'améliorer la compétitivité du « moteur » principal, 360 a adopté une stratégie de conduite « double moteur » de recherche et développement indépendante et de recherche et développement coopératif.

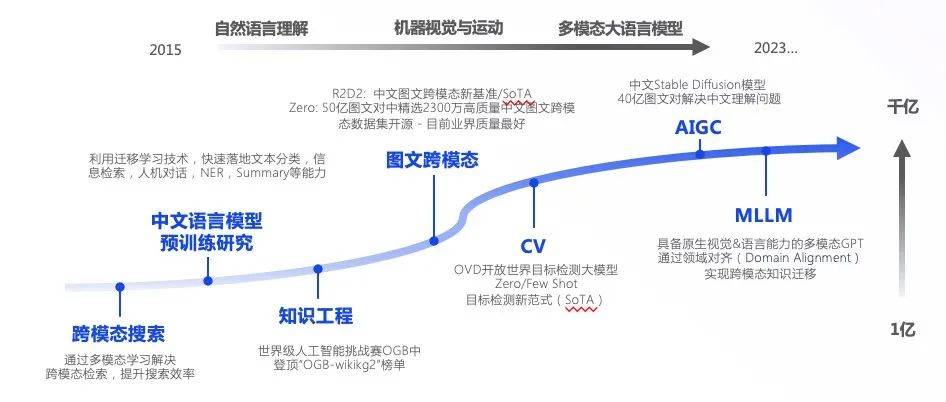

360 a toujours été connu pour son leadership en matière de sécurité et a été au premier échelon de la technologie nationale d'intelligence artificielle de pointe, avec une accumulation continue. Dès 2015, 360 a créé un institut de recherche sur l'intelligence artificielle pour appliquer les technologies de pointe de l'IA telles que le CV et la PNL à l'IoT, à la sécurité du Big Data et à d'autres domaines. Parallèlement, il a entrepris le projet de plateforme ouverte d’intelligence artificielle Safe Brain-National.

Grâce à son équipe de R&D multimodale avancée au niveau national, 360 a atteint le leadership de l'industrie dans les domaines de la compréhension du langage naturel, de la vision industrielle, du mouvement et de l'interaction parole-sémantique. Ses principaux membres et son équipe ont remporté plusieurs prix de compétition/nomination liés à l'IA.

En termes de technologies liées aux grands modèles, 360 résout la récupération multimodale grâce à l'apprentissage multimodal et améliore l'efficacité de la recherche. Ensuite, il utilise la technologie d'apprentissage par transfert, la mise en œuvre rapide de la classification de texte, la récupération d'informations, le dialogue homme-machine, le NER, Résumé et autres capacités pour mener des recherches sur la pré-formation des modèles de langue chinoise.

Plus tard, 360 a commencé à étudier la multimodalité des images et des textes et a sélectionné 23 millions d'images et de textes chinois de haute qualité parmi 5 milliards d'images et de textes pour des ensembles de données multimodales open source. Des recherches ultérieures sur CV, AIGC et MLLM ont donné à 360 une base plus solide pour ses premières préparations sur de grands modèles.

Sur CV, OVD a ouvert Zero/Few Shot, un grand modèle mondial de détection de cibles ; sur AIGC, le modèle chinois de diffusion stable a tenté de résoudre 4 milliards de paires image-texte pour résoudre les problèmes de compréhension chinois sur MLLM ; capacités visuelles et linguistiques Le GPT multimodal réalise un transfert de connaissances intermodal grâce à l'alignement des domaines.

Ensemble, la recherche et le développement indépendants de 360 sont passés par des processus tels que la compréhension du langage naturel, la vision et le mouvement automatiques, ainsi que de grands modèles de langage multimodaux, et sont devenus de plus en plus sophistiqués.

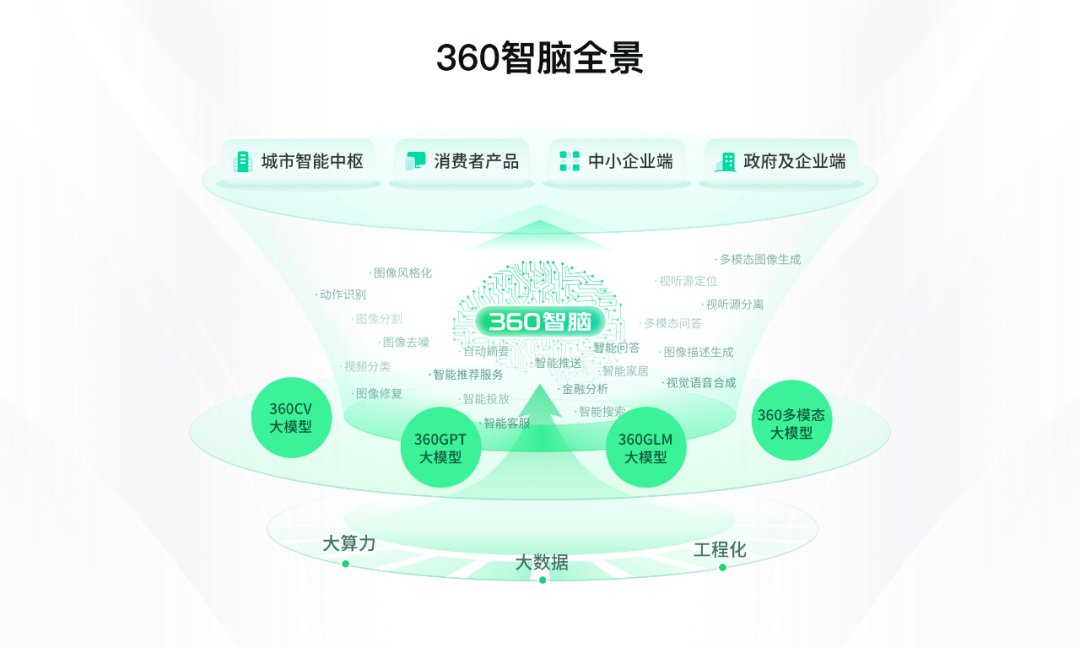

Basé sur la technologie de base de l'IA, 360 exploite ses propres scénarios avantageux pour mettre en œuvre des modèles à grande échelle de « concurrence à quatre voies », fournissant des produits et services liés aux modèles à grande échelle aux consommateurs, aux petites et moyennes entreprises, aux industries et aux entreprises gouvernementales. et les villes.

La matrice de produits de 360GPT est 360 Intelligent Brain. Le panorama 360 Intelligent Brain comprend un grand modèle 360CV, un grand modèle 360GPT, un grand modèle 360GLM et un grand modèle multimodal 360.

Zhou Hongyi a un plan clair pour la mise en œuvre de son propre grand modèle. Après que « 360 Intelligent Brain » ait pris la tête de la scène de recherche, le navigateur intelligent, l'outil de cartographie IA et le cloud de marketing intelligent d'entreprise combinés aux capacités GPT seront bientôt ouverts. aux utilisateurs finaux B pour les tests. Évidemment en termes de stratégie, 360 n'est pas pressé de réussir, mais se concentre sur les besoins rigides des utilisateurs, mûrit un scénario et ouvre un scénario.

Zhou Hongyi a souligné à plusieurs reprises que les modèles chinois à grande échelle sont en retard d'environ deux ans sur GPT en termes de développement. Pour promouvoir leur développement, le soutien, la compréhension et la tolérance des utilisateurs sont nécessaires. En ce qui concerne certains problèmes et compétences, les joueurs chinois pourraient rattraper leur retard. Certaines capacités, telles qu’une forte capacité de raisonnement, une chaîne de pensée et des capacités émergentes, nécessitent le développement d’un certain processus.

Il est vrai que le développement du GPT en Chine n'est pas assez mature, mais qui sait comment émergera le vainqueur final, et cet acteur sera-t-il le 360 qui a copié le modèle à succès de « Microsoft + OpenAI » ? Nous verrons.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Ligne de commande de l'arrêt CentOS

Apr 14, 2025 pm 09:12 PM

Ligne de commande de l'arrêt CentOS

Apr 14, 2025 pm 09:12 PM

La commande de fermeture CENTOS est arrêtée et la syntaxe est la fermeture de [options] le temps [informations]. Les options incluent: -H Arrêtez immédiatement le système; -P éteignez l'alimentation après l'arrêt; -r redémarrer; -t temps d'attente. Les temps peuvent être spécifiés comme immédiats (maintenant), minutes (minutes) ou une heure spécifique (HH: mm). Des informations supplémentaires peuvent être affichées dans les messages système.

Quelles sont les méthodes de sauvegarde pour Gitlab sur Centos

Apr 14, 2025 pm 05:33 PM

Quelles sont les méthodes de sauvegarde pour Gitlab sur Centos

Apr 14, 2025 pm 05:33 PM

La politique de sauvegarde et de récupération de GitLab dans le système CentOS afin d'assurer la sécurité et la récupérabilité des données, Gitlab on CentOS fournit une variété de méthodes de sauvegarde. Cet article introduira plusieurs méthodes de sauvegarde courantes, paramètres de configuration et processus de récupération en détail pour vous aider à établir une stratégie complète de sauvegarde et de récupération de GitLab. 1. MANUEL BACKUP Utilisez le Gitlab-RakegitLab: Backup: Créer la commande pour exécuter la sauvegarde manuelle. Cette commande sauvegarde des informations clés telles que le référentiel Gitlab, la base de données, les utilisateurs, les groupes d'utilisateurs, les clés et les autorisations. Le fichier de sauvegarde par défaut est stocké dans le répertoire / var / opt / gitlab / backups. Vous pouvez modifier / etc / gitlab

Comment vérifier la configuration de CentOS HDFS

Apr 14, 2025 pm 07:21 PM

Comment vérifier la configuration de CentOS HDFS

Apr 14, 2025 pm 07:21 PM

Guide complet pour vérifier la configuration HDFS dans les systèmes CentOS Cet article vous guidera comment vérifier efficacement la configuration et l'état de l'exécution des HDF sur les systèmes CentOS. Les étapes suivantes vous aideront à bien comprendre la configuration et le fonctionnement des HDF. Vérifiez la variable d'environnement Hadoop: Tout d'abord, assurez-vous que la variable d'environnement Hadoop est correctement définie. Dans le terminal, exécutez la commande suivante pour vérifier que Hadoop est installé et configuré correctement: HadoopVersion Check HDFS Fichier de configuration: Le fichier de configuration de base de HDFS est situé dans le répertoire / etc / hadoop / conf / le répertoire, où Core-site.xml et hdfs-site.xml sont cruciaux. utiliser

Comment est la prise en charge du GPU pour Pytorch sur Centos

Apr 14, 2025 pm 06:48 PM

Comment est la prise en charge du GPU pour Pytorch sur Centos

Apr 14, 2025 pm 06:48 PM

Activer l'accélération du GPU Pytorch sur le système CentOS nécessite l'installation de versions CUDA, CUDNN et GPU de Pytorch. Les étapes suivantes vous guideront tout au long du processus: CUDA et CUDNN Installation détermineront la compatibilité de la version CUDA: utilisez la commande NVIDIA-SMI pour afficher la version CUDA prise en charge par votre carte graphique NVIDIA. Par exemple, votre carte graphique MX450 peut prendre en charge CUDA11.1 ou plus. Téléchargez et installez Cudatoolkit: visitez le site officiel de Nvidiacudatoolkit et téléchargez et installez la version correspondante selon la version CUDA la plus élevée prise en charge par votre carte graphique. Installez la bibliothèque CUDNN:

Explication détaillée du principe docker

Apr 14, 2025 pm 11:57 PM

Explication détaillée du principe docker

Apr 14, 2025 pm 11:57 PM

Docker utilise les fonctionnalités du noyau Linux pour fournir un environnement de fonctionnement d'application efficace et isolé. Son principe de travail est le suivant: 1. Le miroir est utilisé comme modèle en lecture seule, qui contient tout ce dont vous avez besoin pour exécuter l'application; 2. Le Système de fichiers Union (UnionFS) empile plusieurs systèmes de fichiers, ne stockant que les différences, l'économie d'espace et l'accélération; 3. Le démon gère les miroirs et les conteneurs, et le client les utilise pour l'interaction; 4. Les espaces de noms et les CGROUP implémentent l'isolement des conteneurs et les limitations de ressources; 5. Modes de réseau multiples prennent en charge l'interconnexion du conteneur. Ce n'est qu'en comprenant ces concepts principaux que vous pouvez mieux utiliser Docker.

CentOS installe MySQL

Apr 14, 2025 pm 08:09 PM

CentOS installe MySQL

Apr 14, 2025 pm 08:09 PM

L'installation de MySQL sur CENTOS implique les étapes suivantes: Ajout de la source MySQL YUM appropriée. Exécutez la commande YUM Install MySQL-Server pour installer le serveur MySQL. Utilisez la commande mysql_secure_installation pour créer des paramètres de sécurité, tels que la définition du mot de passe de l'utilisateur racine. Personnalisez le fichier de configuration MySQL selon les besoins. Écoutez les paramètres MySQL et optimisez les bases de données pour les performances.

Comment afficher les journaux Gitlab sous Centos

Apr 14, 2025 pm 06:18 PM

Comment afficher les journaux Gitlab sous Centos

Apr 14, 2025 pm 06:18 PM

Un guide complet pour consulter les journaux GitLab sous Centos System Cet article vous guidera comment afficher divers journaux GitLab dans le système CentOS, y compris les journaux principaux, les journaux d'exception et d'autres journaux connexes. Veuillez noter que le chemin du fichier journal peut varier en fonction de la version Gitlab et de la méthode d'installation. Si le chemin suivant n'existe pas, veuillez vérifier le répertoire d'installation et les fichiers de configuration de GitLab. 1. Afficher le journal GitLab principal Utilisez la commande suivante pour afficher le fichier journal principal de l'application GitLabRails: Commande: sudocat / var / log / gitlab / gitlab-rails / production.log Cette commande affichera le produit

Comment faire fonctionner la formation distribuée de Pytorch sur CentOS

Apr 14, 2025 pm 06:36 PM

Comment faire fonctionner la formation distribuée de Pytorch sur CentOS

Apr 14, 2025 pm 06:36 PM

La formation distribuée par Pytorch sur le système CentOS nécessite les étapes suivantes: Installation de Pytorch: La prémisse est que Python et PIP sont installés dans le système CentOS. Selon votre version CUDA, obtenez la commande d'installation appropriée sur le site officiel de Pytorch. Pour la formation du processeur uniquement, vous pouvez utiliser la commande suivante: pipinstalltorchtorchVisionTorChaudio Si vous avez besoin d'une prise en charge du GPU, assurez-vous que la version correspondante de CUDA et CUDNN est installée et utilise la version Pytorch correspondante pour l'installation. Configuration de l'environnement distribué: la formation distribuée nécessite généralement plusieurs machines ou des GPU multiples uniques. Lieu