Périphériques technologiques

Périphériques technologiques

IA

IA

Elephant P se retourne et fonctionne dès la sortie de la boîte ! HKU, NTU, l'Université Tsinghua, etc. sont les premiers à ouvrir la version 'réplique' de DragGAN

Elephant P se retourne et fonctionne dès la sortie de la boîte ! HKU, NTU, l'Université Tsinghua, etc. sont les premiers à ouvrir la version 'réplique' de DragGAN

Elephant P se retourne et fonctionne dès la sortie de la boîte ! HKU, NTU, l'Université Tsinghua, etc. sont les premiers à ouvrir la version 'réplique' de DragGAN

Vous vous souvenez du DragGAN sorti il y a quelques jours ?

C'est vrai, c'est l'outil qui permet de retoucher des photos en seulement deux secondes.

La photo que vous avez prise n'a pas l'air bien ? construire! La forme du visage n'est pas assez fine ? construire! Votre visage est-il face à la caméra sous le mauvais angle ? construire!

Peut-être, "Laissez l'ancien La blague PS "L'éléphant se retourne" pourrait bientôt devenir réalité

Dès que cette vidéo de démonstration de l'outil de retouche photo AI a été publiée, elle est instantanément devenue populaire dans Chine C'était le désordre dehors.

De nombreux internautes ont déclaré : "Le PS n'existe plus".

En quelques jours seulement, l'implémentation non officielle de DragGAN est disponible pour une utilisation à l'essai. Cette fonctionnalité a été intégrée à InternGPT, et l'interface ressemble à ceci↓

#🎜🎜 # Adresse de l'expérience : https://igpt.opengvlab.com/

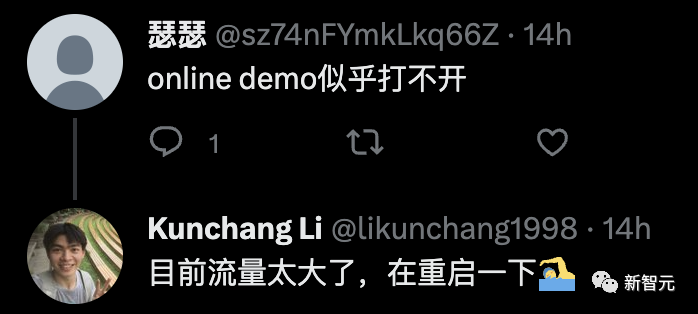

De façon inattendue, dès l'ouverture de l'entrée de la démo, c'était emballé.

À en juger par la vidéo de démonstration officielle, le DragGAN reproduit L'effet est incroyable. # 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 # grin # 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 # # # # 🎜🎜#Tout d'abord, comment faire rire une personne qui ne sourit pas. Sélectionnez simplement les deux coins de la bouche et faites-les glisser directement.

Vous pouvez voir que le résultat final n'a aucun sentiment de violation. Parce que les muscles du visage changent également ensemble, pas seulement un sourire. # 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 # Fermez votre bouche # 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 #faceedit

Tout le monde adore cette fonction amincissante du visage vous le connaissez, vous pouvez sélectionner deux faces et les insérer. Le résultat sera toujours très naturel.

Minceur visage homme. Mais celui-ci est un peu trop fin, le rendu est faux à première vue, et le menton est trop pointu.

Cela doit être fortement recommandé ! Greffe de cheveux ! Quelle bénédiction pour les chauves.

Cependant, à en juger par les résultats de sortie, même si le front est sélectionné, les cheveux pousseront de manière égale partout, et le résultat final ressemble un peu au singe Roi.

Cependant, à en juger par les résultats de sortie, même si le front est sélectionné, les cheveux pousseront de manière égale partout, et le résultat final ressemble un peu au singe Roi.

Face Turn

La rotation du visage est également une fonction très pratique, et la partie terminée est très naturelle.

Autres fonctions

En plus de la retouche photo à petite échelle, InternGPT lui-même propose de nombreuses autres opérations accrocheuses qui peuvent être effectuées.

Supprimer les objets couverts

Cliquez sur la partie de l'image que vous souhaitez utiliser et entrez « supprimer » dans l'invite.

Génération d'image

Cette fonction est plus intéressante. Téléchargez d'abord une image, entrez une invite pour laisser DragGAN la segmenter, puis entrez une invite pour générer l'image souhaitée.

Pieds noirs exposés ? (Non)

Commentaire des faits saillants de la vidéo

Vous pouvez également éditer des vidéos en un seul clic à l'aide de l'invite.

Questions et réponses visuelles interactives

Même après avoir identifié les informations sur l'image, vous pouvez les interroger directement en ligne.

Génération d'images interactives

Chaque doodle aléatoire peut être transformé en une belle image en un seul clic.

Quoi qu'il en soit, l'éditeur a été vraiment choqué après avoir lu ces fonctions. Toutes les fonctions mettent en évidence deux caractéristiques : « un fonctionnement insensé et une utilité ultime ».

Qui ne peut pas aimer ça ?

Mise en œuvre technique

Après avoir vu tant de fonctionnalités intéressantes, qu'est-ce qu'InternGPT exactement ?

InternGPT (iGPT en abrégé)/InternChat (iChat en abrégé) est un système d'interaction visuelle piloté par un langage de pointage. Les utilisateurs peuvent interagir avec ChatGPT en cliquant, en faisant glisser et en dessinant.

Contrairement aux systèmes d'interaction existants qui s'appuient sur le langage pur, en intégrant des instructions de pointage, iGPT améliore considérablement l'efficacité de la communication entre les utilisateurs et les chatbots, ainsi que la précision des chatbots dans les tâches centrées sur la vision, notamment dans les tâches complexes. particulièrement vrai dans les scènes visuelles.

Adresse papier : https://arxiv.org/pdf/2305.05662.pdf

La figure suivante est l'architecture globale d'InternGPT.

Nous pouvons voir que ce GPT peut traiter non seulement des images et des vidéos, mais aussi de la voix et du texte.

Pour l'entrée d'image ou vidéo, InternGPT utilisera SAM (modèle de segmentation d'image), OCR (modèle de reconnaissance d'image), etc.

Après avoir identifié le lieu géographique, l'objet ou la ligne, il existe toute une boîte à outils pour un traitement ultérieur, qui sont tous des outils qui nous sont familiers.

Tels que BLIP (audio), Stable Diffusion (image), Pix2Pix (traduction d'image) et ainsi de suite.

De même, pour la saisie de texte ou de voix, InternGPT appellera GPT-4, LLaMA et d'autres modèles ou outils pour le traitement, et il y aura également toute une boîte à outils plus tard.

L'architecture globale d'InternGPT# 🎜 🎜#

Conseils d'utilisationL'ensemble du processus est également très pratique pendant l'utilisation.

Une fois l'image téléchargée avec succès, l'utilisateur peut envoyer le message suivant pour avoir des conversations multimodales avec iGPT :

"what is it in the image?" or "what is the background color of image?".

· Cliquez n'importe où sur l'image, puis appuyez sur Choisir pour prévisualiser la zone divisée. Vous pouvez également appuyer sur le bouton OCR pour identifier tous les mots présents à un endroit précis #

“remove the masked region”

“replace the masked region with {your prompt}”“generate a new image based on its segmentation describing {your prompt}”

DragGAN a été intégré à InternGPT, il est sorti si vite, corrigez ce Artefact d'image.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Comment vérifier la configuration de CentOS HDFS

Apr 14, 2025 pm 07:21 PM

Comment vérifier la configuration de CentOS HDFS

Apr 14, 2025 pm 07:21 PM

Guide complet pour vérifier la configuration HDFS dans les systèmes CentOS Cet article vous guidera comment vérifier efficacement la configuration et l'état de l'exécution des HDF sur les systèmes CentOS. Les étapes suivantes vous aideront à bien comprendre la configuration et le fonctionnement des HDF. Vérifiez la variable d'environnement Hadoop: Tout d'abord, assurez-vous que la variable d'environnement Hadoop est correctement définie. Dans le terminal, exécutez la commande suivante pour vérifier que Hadoop est installé et configuré correctement: HadoopVersion Check HDFS Fichier de configuration: Le fichier de configuration de base de HDFS est situé dans le répertoire / etc / hadoop / conf / le répertoire, où Core-site.xml et hdfs-site.xml sont cruciaux. utiliser

Ligne de commande de l'arrêt CentOS

Apr 14, 2025 pm 09:12 PM

Ligne de commande de l'arrêt CentOS

Apr 14, 2025 pm 09:12 PM

La commande de fermeture CENTOS est arrêtée et la syntaxe est la fermeture de [options] le temps [informations]. Les options incluent: -H Arrêtez immédiatement le système; -P éteignez l'alimentation après l'arrêt; -r redémarrer; -t temps d'attente. Les temps peuvent être spécifiés comme immédiats (maintenant), minutes (minutes) ou une heure spécifique (HH: mm). Des informations supplémentaires peuvent être affichées dans les messages système.

Quelles sont les méthodes de sauvegarde pour Gitlab sur Centos

Apr 14, 2025 pm 05:33 PM

Quelles sont les méthodes de sauvegarde pour Gitlab sur Centos

Apr 14, 2025 pm 05:33 PM

La politique de sauvegarde et de récupération de GitLab dans le système CentOS afin d'assurer la sécurité et la récupérabilité des données, Gitlab on CentOS fournit une variété de méthodes de sauvegarde. Cet article introduira plusieurs méthodes de sauvegarde courantes, paramètres de configuration et processus de récupération en détail pour vous aider à établir une stratégie complète de sauvegarde et de récupération de GitLab. 1. MANUEL BACKUP Utilisez le Gitlab-RakegitLab: Backup: Créer la commande pour exécuter la sauvegarde manuelle. Cette commande sauvegarde des informations clés telles que le référentiel Gitlab, la base de données, les utilisateurs, les groupes d'utilisateurs, les clés et les autorisations. Le fichier de sauvegarde par défaut est stocké dans le répertoire / var / opt / gitlab / backups. Vous pouvez modifier / etc / gitlab

CentOS installe MySQL

Apr 14, 2025 pm 08:09 PM

CentOS installe MySQL

Apr 14, 2025 pm 08:09 PM

L'installation de MySQL sur CENTOS implique les étapes suivantes: Ajout de la source MySQL YUM appropriée. Exécutez la commande YUM Install MySQL-Server pour installer le serveur MySQL. Utilisez la commande mysql_secure_installation pour créer des paramètres de sécurité, tels que la définition du mot de passe de l'utilisateur racine. Personnalisez le fichier de configuration MySQL selon les besoins. Écoutez les paramètres MySQL et optimisez les bases de données pour les performances.

Comment faire fonctionner la formation distribuée de Pytorch sur CentOS

Apr 14, 2025 pm 06:36 PM

Comment faire fonctionner la formation distribuée de Pytorch sur CentOS

Apr 14, 2025 pm 06:36 PM

La formation distribuée par Pytorch sur le système CentOS nécessite les étapes suivantes: Installation de Pytorch: La prémisse est que Python et PIP sont installés dans le système CentOS. Selon votre version CUDA, obtenez la commande d'installation appropriée sur le site officiel de Pytorch. Pour la formation du processeur uniquement, vous pouvez utiliser la commande suivante: pipinstalltorchtorchVisionTorChaudio Si vous avez besoin d'une prise en charge du GPU, assurez-vous que la version correspondante de CUDA et CUDNN est installée et utilise la version Pytorch correspondante pour l'installation. Configuration de l'environnement distribué: la formation distribuée nécessite généralement plusieurs machines ou des GPU multiples uniques. Lieu

Explication détaillée du principe docker

Apr 14, 2025 pm 11:57 PM

Explication détaillée du principe docker

Apr 14, 2025 pm 11:57 PM

Docker utilise les fonctionnalités du noyau Linux pour fournir un environnement de fonctionnement d'application efficace et isolé. Son principe de travail est le suivant: 1. Le miroir est utilisé comme modèle en lecture seule, qui contient tout ce dont vous avez besoin pour exécuter l'application; 2. Le Système de fichiers Union (UnionFS) empile plusieurs systèmes de fichiers, ne stockant que les différences, l'économie d'espace et l'accélération; 3. Le démon gère les miroirs et les conteneurs, et le client les utilise pour l'interaction; 4. Les espaces de noms et les CGROUP implémentent l'isolement des conteneurs et les limitations de ressources; 5. Modes de réseau multiples prennent en charge l'interconnexion du conteneur. Ce n'est qu'en comprenant ces concepts principaux que vous pouvez mieux utiliser Docker.

Comment afficher les journaux Gitlab sous Centos

Apr 14, 2025 pm 06:18 PM

Comment afficher les journaux Gitlab sous Centos

Apr 14, 2025 pm 06:18 PM

Un guide complet pour consulter les journaux GitLab sous Centos System Cet article vous guidera comment afficher divers journaux GitLab dans le système CentOS, y compris les journaux principaux, les journaux d'exception et d'autres journaux connexes. Veuillez noter que le chemin du fichier journal peut varier en fonction de la version Gitlab et de la méthode d'installation. Si le chemin suivant n'existe pas, veuillez vérifier le répertoire d'installation et les fichiers de configuration de GitLab. 1. Afficher le journal GitLab principal Utilisez la commande suivante pour afficher le fichier journal principal de l'application GitLabRails: Commande: sudocat / var / log / gitlab / gitlab-rails / production.log Cette commande affichera le produit

Comment est la prise en charge du GPU pour Pytorch sur Centos

Apr 14, 2025 pm 06:48 PM

Comment est la prise en charge du GPU pour Pytorch sur Centos

Apr 14, 2025 pm 06:48 PM

Activer l'accélération du GPU Pytorch sur le système CentOS nécessite l'installation de versions CUDA, CUDNN et GPU de Pytorch. Les étapes suivantes vous guideront tout au long du processus: CUDA et CUDNN Installation détermineront la compatibilité de la version CUDA: utilisez la commande NVIDIA-SMI pour afficher la version CUDA prise en charge par votre carte graphique NVIDIA. Par exemple, votre carte graphique MX450 peut prendre en charge CUDA11.1 ou plus. Téléchargez et installez Cudatoolkit: visitez le site officiel de Nvidiacudatoolkit et téléchargez et installez la version correspondante selon la version CUDA la plus élevée prise en charge par votre carte graphique. Installez la bibliothèque CUDNN: