Périphériques technologiques

Périphériques technologiques

IA

IA

Les cœurs d'IA se vendent ! NVIDIA annonce un rapport financier épique, le cours de l'action bondit de 30 %

Les cœurs d'IA se vendent ! NVIDIA annonce un rapport financier épique, le cours de l'action bondit de 30 %

Les cœurs d'IA se vendent ! NVIDIA annonce un rapport financier épique, le cours de l'action bondit de 30 %

Cette vague d'engouement pour l'IA a fait rire NVIDIA, le leader mondial de la puissance de calcul de l'IA !

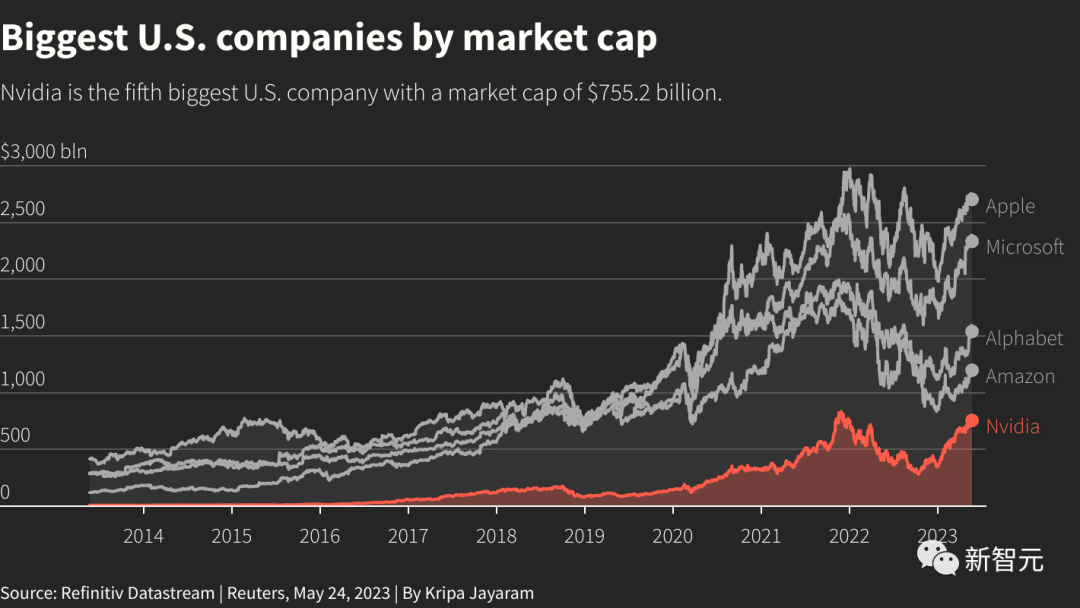

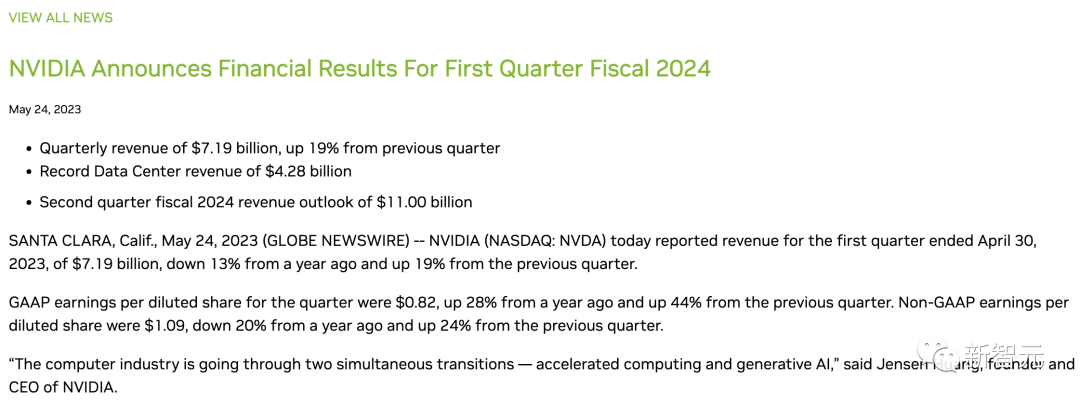

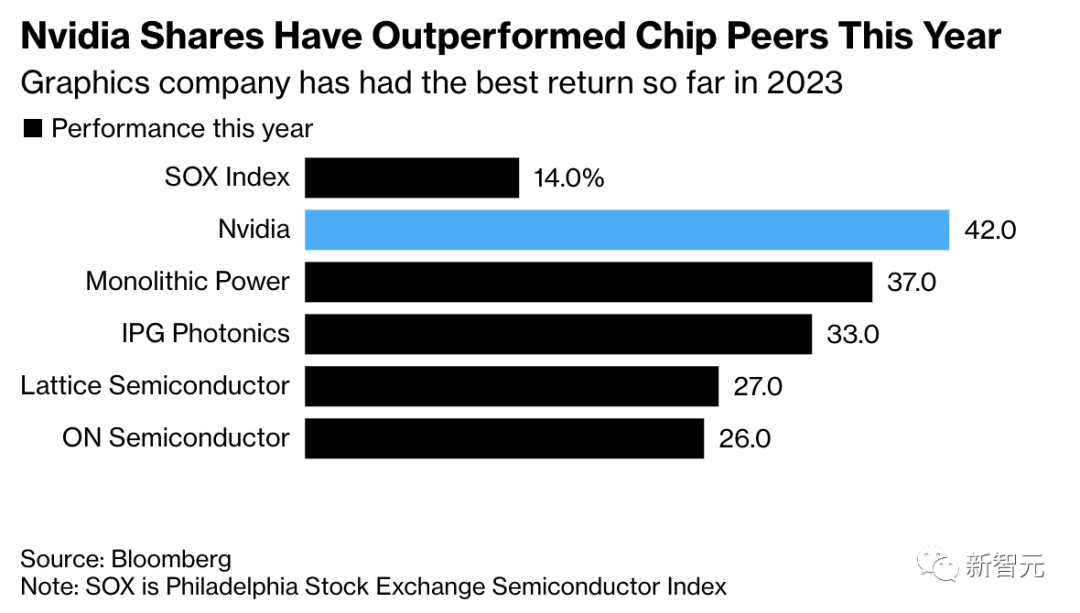

Hier soir, après que Nvidia a annoncé son rapport financier du premier trimestre 2024, c'était comme être sur une fusée, avec le cours de son action grimpant de 30 % pour atteindre un niveau record.

Avant cela, le cours de son action avait augmenté de 109% en 2023.

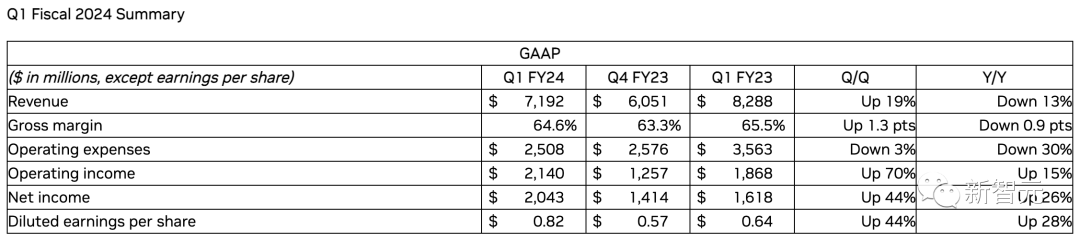

Le rapport financier a montré que le chiffre d'affaires de Nvidia au premier trimestre était de 7,19 milliards de dollars, un une augmentation de 19% par rapport au trimestre précédent, dépassant largement les attentes de 10%. Le bénéfice net du premier trimestre s'est élevé à 2,713 milliards de dollars.

a été créée en 1993. À l'heure actuelle, NVIDIA a une valeur marchande de plus de 755,2 milliards de dollars américains. Classé cinquième au monde, loin devant Meta et Tesla.

Le succès de Nvidia est dû à sa réussite dans ce concours de grands modèles d'IA, contrôle la « porte vitale » de la puissance de calcul.

Lao Huang peut fièrement annoncer : "Le monde entier achète nos chips".

Après ChatGPT, Nvidia a soumis sa première soumission

Les géants de la technologie tels que Microsoft et Google Silicon Valley se livrent une concurrence féroce dans la compétition de l'IA et sont obligés d'utiliser la formation GPU. La demande en IA augmente rapidement.

Alors que la demande de puissance de calcul augmente, les GPU de Nvidia sont presque devenus la seule « monnaie forte ».

Dans le rapport financier de Nvidia, le résultat le plus frappant est « l’activité des centres de données ».

Cette fois, le chiffre d'affaires des centres de données de Nvidia a bondi à 42,8 milliards, soit une hausse que prévu de 3,9 milliards de dollars, établissant un nouveau record.

"L'industrie informatique subit deux transformations en même temps : accélérer l'informatique et générer de l'intelligence artificielle", a déclaré Huang dans le rapport financier.

L'augmentation des revenus des centres de données est principalement due à la demande croissante d'IA générative et de grands modèles de langage utilisant les GPU à architecture Hopper et Ampere.

Dans le même temps, la solide performance des revenus des centres de données a encore a prouvé que les puces d'IA sont importantes pour l'approvisionnement en cloud et que d'autres entreprises exploitant un grand nombre de serveurs deviennent de plus en plus importantes.

Il convient de mentionner que l'avenir de Nvidia est sans limites.

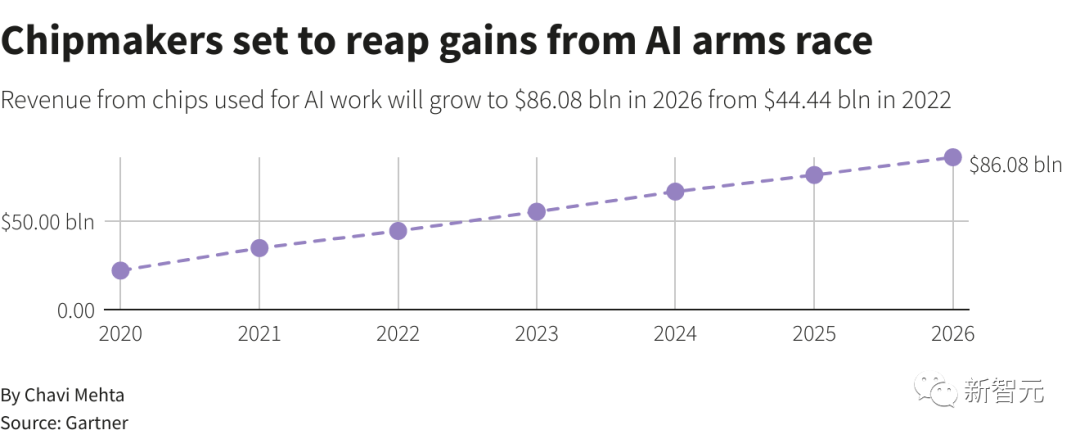

Gartner prédit que d'ici 2026, la part des puces professionnelles telles que les GPU utilisées dans les centres de données devrait augmenter de plus de 15 % contre moins de 3 % en 2020. .

Bien qu'il soit difficile d'identifier exactement le rôle que joue l'IA dans les revenus de Nvidia aujourd'hui Il s’agit d’un faible pourcentage, mais l’IA a le potentiel de croître de façon exponentielle à mesure que les grandes entreprises technologiques se précipitent pour développer des applications d’IA similaires.

Huang Renxun a dit un jour :

ChatGPT permet aux géants de la technologie de voir la puissance illimitée de l'IA. Mais maintenant, c'est surtout un logiciel à usage général. Ce n'est qu'en améliorant les services et les produits adaptés aux besoins propres d'une entreprise que sa véritable valeur peut être réalisée.

En plus du centre de données, bien que l'activité principale du jeu ait été touchée par le ralentissement économique, les revenus sont tombés à seulement 2,24 milliards de dollars américains à deux chiffres, mais ils ont été nettement supérieurs aux attentes du marché, dépassant 13 %.

Par ailleurs, la division automobile de Nvidia, qui comprend le développement de puces et de logiciels pour les voitures autonomes, a connu une croissance de 114 % sur un an, mais reste modeste, avec un chiffre d'affaires inférieur à 300 millions de dollars.

NVIDIA s'empare de la domination du marché des GPU

New Street Research affirme que NVIDIA occupe 95 % des parts de marché des processeurs graphiques.

Les investisseurs affluent vers Nvidia, pariant que la demande de systèmes d’intelligence artificielle comme ChatGPT fera augmenter les commandes de produits de l’entreprise, ce qui en fera à nouveau le fabricant de puces le plus précieux au monde.

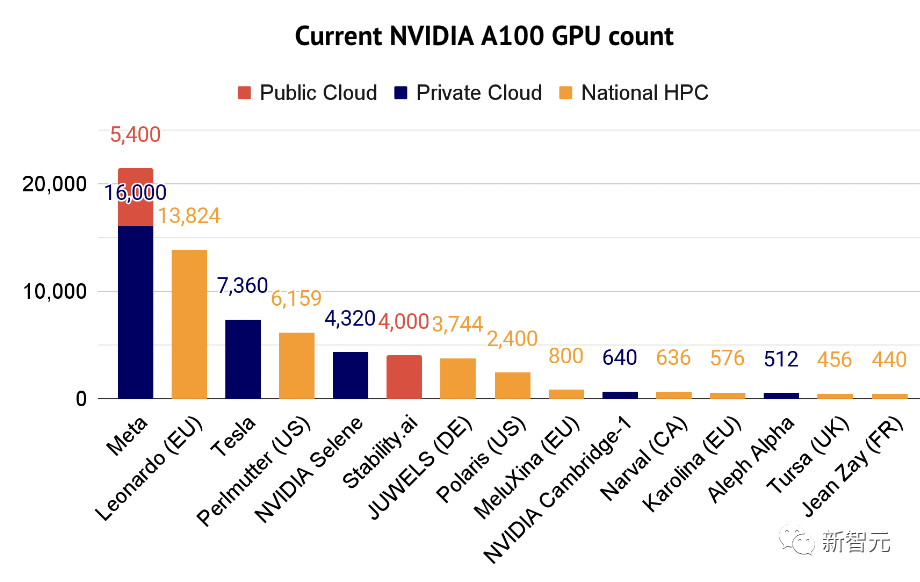

Depuis longtemps, qu'il s'agisse du top ChatGPT, ou de modèles comme Bard et Stable Diffusion, la puissance de calcul est assurée par une puce Nvidia A100 d'une valeur d'environ 10 000 $ US.

NVIDIA A100 est capable d'effectuer de nombreux calculs simples en même temps, ce qui est très important pour la formation et l'utilisation de modèles de réseaux neuronaux.

La technologie derrière l'A100 était à l'origine utilisée pour restituer des graphiques 3D complexes dans les jeux. Désormais, l’objectif est de gérer les tâches d’apprentissage automatique et de les exécuter dans des centres de données.

L'investisseur Nathan Benaich a déclaré que l'A100 est désormais devenu le « principal cheval de bataille » des professionnels de l'intelligence artificielle. Son rapport répertorie également certaines des entreprises utilisant le supercalculateur A100.

Les tâches d'apprentissage automatique peuvent consommer la puissance de traitement entière d'un ordinateur, parfois pendant des heures ou des jours.

Cela signifie que les entreprises proposant un produit d'IA le plus vendu doivent souvent acheter plus de GPU pour faire face aux périodes de pointe d'accès ou pour améliorer leurs modèles.

De nombreux centres de données utilisent également un système contenant 8 processeurs graphiques A100 - Nvidia DGX A100, avec un seul système vendu jusqu'à 200 000 $.

En plus de l'A100, le successeur H100 lancé par NVIDIA en 2022 est devenu une star populaire.

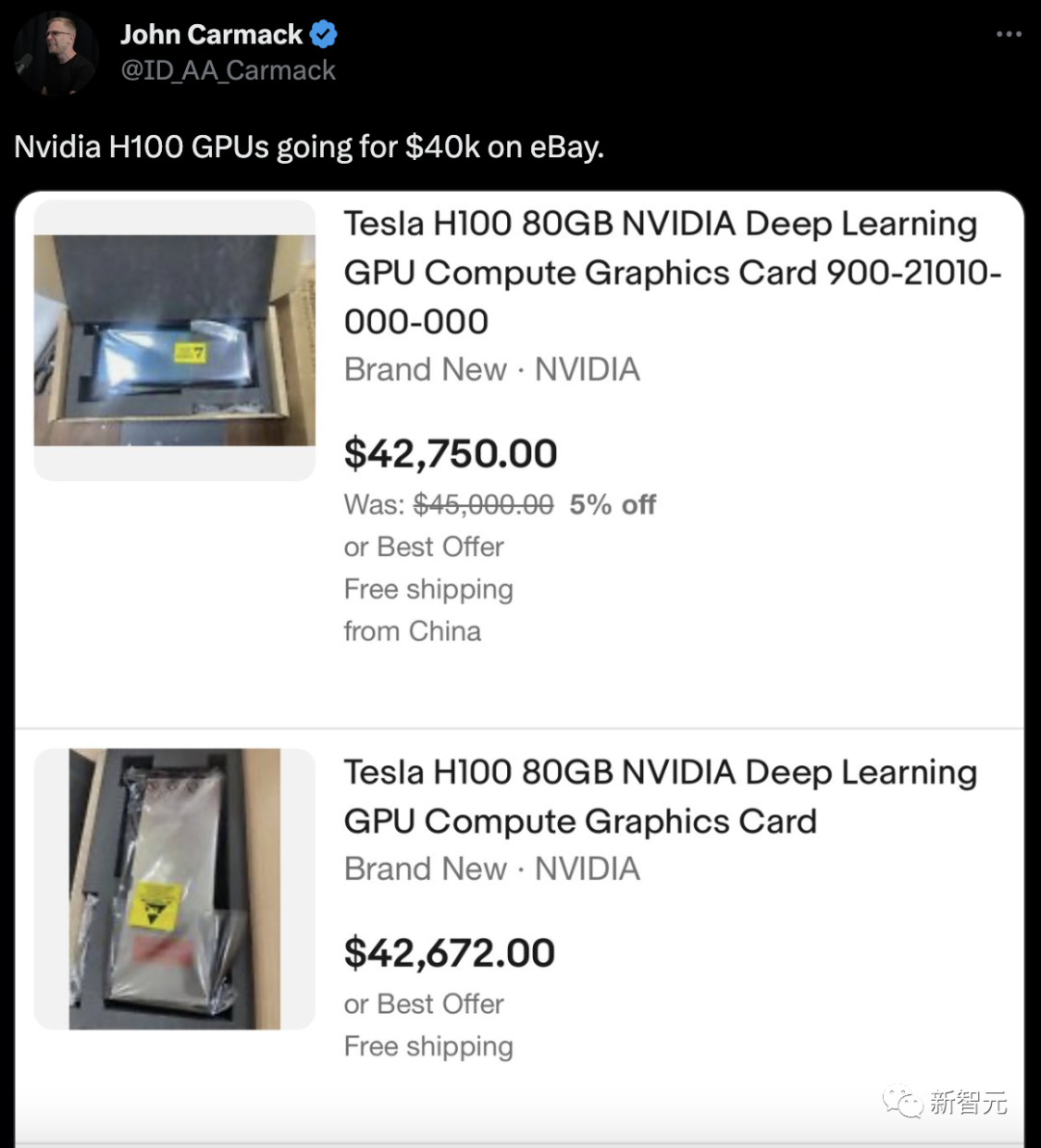

Il y a quelque temps, John Carmack a déclaré sur Twitter que le prix de la puce phare d'IA de Nvidia, H100, était vendu à 40 000 $ US dans plusieurs magasins.

On peut constater qu'avec le chatbot ChatGPT développé par OpenAI qui prend d'assaut le monde, les GPU A100 et H100 deviennent rapidement un produit très prisé, et dans le passé, ce produit était vendu pour 36 000 $.

En Chine, en raison de restrictions, les puces personnalisées A800 et H800 de Nvidia sont devenues les « éditions spéciales » de la Chine. Certains fabricants nationaux de cloud ont rapidement emboîté le pas et utilisent également les nouveaux GPU de Nvidia.

Intel a la « loi de Moore ». Huang Renxun a déjà proposé la « loi de Huang » et a déclaré que les GPU permettraient de doubler les performances de l'IA d'année en année.

Aujourd'hui, le développement rapide de l'intelligence artificielle par Microsoft, OpenAI et Google en a donné la meilleure preuve.

La façon de percer de NVIDIA est de gagner grâce à la technologie et à la R&D.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Comment configurer le format de journal debian Apache

Apr 12, 2025 pm 11:30 PM

Comment configurer le format de journal debian Apache

Apr 12, 2025 pm 11:30 PM

Cet article décrit comment personnaliser le format de journal d'Apache sur les systèmes Debian. Les étapes suivantes vous guideront à travers le processus de configuration: Étape 1: Accédez au fichier de configuration Apache Le fichier de configuration apache principal du système Debian est généralement situé dans /etc/apache2/apache2.conf ou /etc/apache2/httpd.conf. Ouvrez le fichier de configuration avec les autorisations racinaires à l'aide de la commande suivante: sudonano / etc / apache2 / apache2.conf ou sudonano / etc / apache2 / httpd.conf Étape 2: définir les formats de journal personnalisés à trouver ou

Comment les journaux Tomcat aident à dépanner les fuites de mémoire

Apr 12, 2025 pm 11:42 PM

Comment les journaux Tomcat aident à dépanner les fuites de mémoire

Apr 12, 2025 pm 11:42 PM

Les journaux TomCat sont la clé pour diagnostiquer les problèmes de fuite de mémoire. En analysant les journaux TomCat, vous pouvez avoir un aperçu de l'utilisation de la mémoire et du comportement de collecte des ordures (GC), localiser et résoudre efficacement les fuites de mémoire. Voici comment dépanner les fuites de mémoire à l'aide des journaux Tomcat: 1. Analyse des journaux GC d'abord, activez d'abord la journalisation GC détaillée. Ajoutez les options JVM suivantes aux paramètres de démarrage TomCat: -xx: printgcdetails-xx: printgcdatestamps-xloggc: gc.log Ces paramètres généreront un journal GC détaillé (GC.Log), y compris des informations telles que le type GC, la taille et le temps des objets de recyclage. Analyse GC.Log

Comment implémenter le tri des fichiers par Debian Readdir

Apr 13, 2025 am 09:06 AM

Comment implémenter le tri des fichiers par Debian Readdir

Apr 13, 2025 am 09:06 AM

Dans Debian Systems, la fonction ReadDir est utilisée pour lire le contenu du répertoire, mais l'ordre dans lequel il revient n'est pas prédéfini. Pour trier les fichiers dans un répertoire, vous devez d'abord lire tous les fichiers, puis les trier à l'aide de la fonction QSORT. Le code suivant montre comment trier les fichiers de répertoire à l'aide de ReadDir et QSort dans Debian System: # include # include # include # include # include // Fonction de comparaison personnalisée, utilisée pour qsortintCompare (constvoid * a, constvoid * b) {returnstrcmp (* (

Comment optimiser les performances de Debian Readdir

Apr 13, 2025 am 08:48 AM

Comment optimiser les performances de Debian Readdir

Apr 13, 2025 am 08:48 AM

Dans Debian Systems, les appels du système ReadDir sont utilisés pour lire le contenu des répertoires. Si ses performances ne sont pas bonnes, essayez la stratégie d'optimisation suivante: simplifiez le nombre de fichiers d'annuaire: divisez les grands répertoires en plusieurs petits répertoires autant que possible, en réduisant le nombre d'éléments traités par appel ReadDir. Activer la mise en cache de contenu du répertoire: construire un mécanisme de cache, mettre à jour le cache régulièrement ou lorsque le contenu du répertoire change et réduire les appels fréquents à Readdir. Les caches de mémoire (telles que Memcached ou Redis) ou les caches locales (telles que les fichiers ou les bases de données) peuvent être prises en compte. Adoptez une structure de données efficace: si vous implémentez vous-même la traversée du répertoire, sélectionnez des structures de données plus efficaces (telles que les tables de hachage au lieu de la recherche linéaire) pour stocker et accéder aux informations du répertoire

Comment configurer les règles de pare-feu pour Debian Syslog

Apr 13, 2025 am 06:51 AM

Comment configurer les règles de pare-feu pour Debian Syslog

Apr 13, 2025 am 06:51 AM

Cet article décrit comment configurer les règles de pare-feu à l'aide d'iptables ou UFW dans Debian Systems et d'utiliser Syslog pour enregistrer les activités de pare-feu. Méthode 1: Utiliser iptableIpTable est un puissant outil de pare-feu de ligne de commande dans Debian System. Afficher les règles existantes: utilisez la commande suivante pour afficher les règles iptables actuelles: Sudoiptables-L-N-V permet un accès IP spécifique: Par exemple, permettez l'adresse IP 192.168.1.100 pour accéder au port 80: Sudoiptables-Ainput-PTCP - DPORT80-S192.16

Comment apprendre Debian Syslog

Apr 13, 2025 am 11:51 AM

Comment apprendre Debian Syslog

Apr 13, 2025 am 11:51 AM

Ce guide vous guidera pour apprendre à utiliser Syslog dans Debian Systems. Syslog est un service clé dans les systèmes Linux pour les messages du système de journalisation et du journal d'application. Il aide les administrateurs à surveiller et à analyser l'activité du système pour identifier et résoudre rapidement les problèmes. 1. Connaissance de base de Syslog Les fonctions principales de Syslog comprennent: la collecte et la gestion des messages journaux de manière centralisée; Prise en charge de plusieurs formats de sortie de journal et des emplacements cibles (tels que les fichiers ou les réseaux); Fournir des fonctions de visualisation et de filtrage des journaux en temps réel. 2. Installer et configurer syslog (en utilisant RSYSLOG) Le système Debian utilise RSYSLOG par défaut. Vous pouvez l'installer avec la commande suivante: SudoaptupDatesud

Où est le chemin de journal debian nginx

Apr 12, 2025 pm 11:33 PM

Où est le chemin de journal debian nginx

Apr 12, 2025 pm 11:33 PM

Dans le système Debian, les emplacements de stockage par défaut du journal d'accès et du journal d'erreur de Nginx sont les suivants: Log d'accès (AccessLog): / var / log / nginx / access.log error log (errorLog): / var / log / nginx / error.log Le chemin ci-dessus est la configuration par défaut de l'installation standard de DebianNginx. Si vous avez modifié l'emplacement de stockage du fichier journal pendant le processus d'installation, veuillez vérifier votre fichier de configuration Nginx (généralement situé dans /etc/nginx/nginx.conf ou / etc / nginx / sites-louable / répertoire). Dans le fichier de configuration

Conseils de configuration du pare-feu Debian Mail Server

Apr 13, 2025 am 11:42 AM

Conseils de configuration du pare-feu Debian Mail Server

Apr 13, 2025 am 11:42 AM

La configuration du pare-feu d'un serveur de courrier Debian est une étape importante pour assurer la sécurité du serveur. Voici plusieurs méthodes de configuration de pare-feu couramment utilisées, y compris l'utilisation d'iptables et de pare-feu. Utilisez les iptables pour configurer le pare-feu pour installer iptables (sinon déjà installé): Sudoapt-getUpDaSuDoapt-getinstalliptableView Règles actuelles iptables: Sudoiptable-L Configuration