Périphériques technologiques

Périphériques technologiques

IA

IA

La fraude à l'IA a-t-elle un taux de réussite de 100 % ? Le modèle anti-deep fake de Du Xiaoman « vainc la magie par la magie »

La fraude à l'IA a-t-elle un taux de réussite de 100 % ? Le modèle anti-deep fake de Du Xiaoman « vainc la magie par la magie »

La fraude à l'IA a-t-elle un taux de réussite de 100 % ? Le modèle anti-deep fake de Du Xiaoman « vainc la magie par la magie »

2023-05-26 10:22:19 Auteur : Song Junyi

Récemment, un sujet #AIFraud Success Rate Near 100%# était à la mode sur Weibo. Le représentant légal d'une entreprise technologique du Fujian a été escroqué de 4,3 millions de yuans grâce à une vidéo d'IA qui a changé son visage. L'incident n'a duré que 10 minutes.

Une arnaque liée à l'IA s'est également produite à l'étranger. Un e-mail contenant une vidéo du PDG de Google a poussé de nombreux blogueurs YouTube à télécharger des fichiers contenant des virus dangereux.

Ces deux incidents de fraude impliquaient une technologie deepfake. Il s'agit d'une méthode révolutionnaire qui existe depuis 6 ans. De nos jours, l'explosion de la technologie AIGC a rendu de plus en plus facile la création de vidéos deepfake difficiles à identifier. Pour le secteur financier, où la reconnaissance faciale est largement utilisée, la prévention des fausses attaques est également particulièrement importante.

Dans le secteur financier, la fraude causée par le deepfake est principalement la fraude à l'identité, c'est-à-dire l'utilisation d'images et de vidéos profondément fausses pour usurper l'identité d'autrui, tromper le système de vérification d'identité dans le processus de crédit financier, puis commettre une fraude et enregistrement malveillant, attendez. À l'heure actuelle, le secteur financier dispose de méthodes et de solutions techniques relativement matures pour lutter contre les deepfakes, et Du Xiaoman a accumulé une riche expérience dans la lutte contre les deepfakes.

Du Xiaoman a expliqué qu'au cours des dernières années, la tendance à utiliser une technologie de contrefaçon profonde pour contourner le processus de reconnaissance faciale s'est accrue, ce qui constitue une certaine menace pour le système d'authentification du nom réel des institutions financières. La meilleure façon d’identifier et de confirmer si un contenu est faux est de développer des algorithmes de détection IA « anti-deepfake ». En partant de trois dimensions, la stratégie d'algorithme de modèle de détection approfondie anti-contrefaçon de Du Xiaoman a réussi à déchiffrer la fausse vidéo.

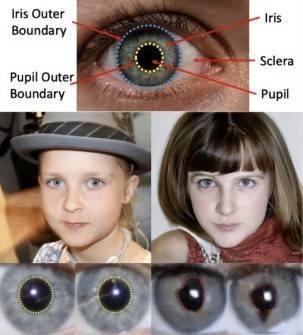

La première est de générer des défauts. Plus précisément, en raison du manque de données d'entraînement pertinentes, le modèle deepfake peut ne pas être en mesure de restituer correctement certains traits du visage humain, allant d'une fréquence de clignement anormale à une incohérence entre la forme de la bouche et la voix, etc. En concevant des algorithmes d'analyse spécifiques, le modèle de détection peut extraire ces caractéristiques « fondamentalement visibles » pour une analyse et un jugement plus approfondis.

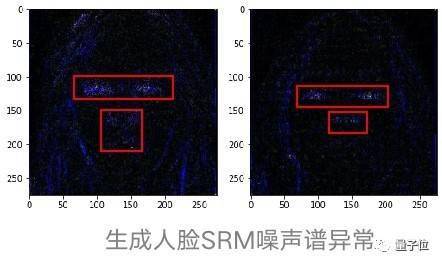

La seconde concerne les attributs inhérents. Étant donné que différentes caméras ont des empreintes digitales différentes, des modèles comme GAN laisseront également des empreintes digitales uniques pour identifier le générateur lors de la génération de visages, afin que des indices puissent être trouvés par comparaison.

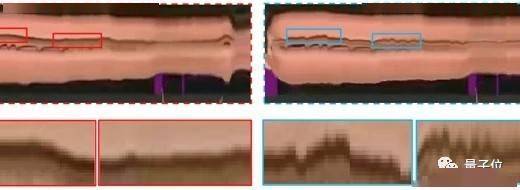

Le troisième détail est la sémantique de haut niveau. Il fait référence à des problèmes tels que la détection de la coordination des unités d'action faciale (groupes musculaires), la cohérence de l'orientation des différentes régions du visage et la continuité microscopique des vidéos. Ces détails étant difficiles à modéliser et à copier, il est facile de s'y faire prendre.

Bien sûr, puisqu'une seule fonctionnalité est difficile à adapter à un contenu deepfake complexe, le cadre global du modèle de détection utilise la fusion multi-fonctionnalités pour garantir la robustesse de la prise de décision.

En plus des avantages des échantillons de données, Du Xiaoman intègre également sa propre originalité, notamment des algorithmes de recherche et d'optimisation de réseaux neuronaux, la technologie d'analyse de micro-expression et de convolution graphique (GCN), et des méthodes de pré-formation auto-supervisées basées sur sur la reconstruction. Laissons le modèle réaliser la transformation de la « contrefaçon » en « authenticité ».

C'est pour cette raison que le modèle de détection anti-deep fake de Xiaoman a réussi avec succès l'évaluation spéciale de sécurité de reconnaissance faciale de l'Académie des technologies de l'information et des communications en septembre de l'année dernière et a obtenu l'excellente certification pour les capacités de protection de sécurité de détection en direct. En termes d'effets spécifiques, il peut couvrir diverses formes de contrefaçons profondes, y compris l'activation d'images de portrait statiques, le changement de visage par l'IA, la synthèse de faux visages, etc., atteignant un rappel de plus de 90 % avec un taux de fausses alarmes d'un millième, ce qui est un taux de précision de 99 %+.

À mesure que de nouveaux outils de deepfake continuent d'émerger, le secteur financier devra faire face à davantage d'attaques de deepfake. Du Xiaoman estime qu'à l'avenir, davantage de technologies de détection de contrefaçon devraient se concentrer sur l'exploration de caractéristiques sémantiques, de caractéristiques intermodales, etc., afin que le modèle puisse utiliser une sémantique de haut niveau avec une forte interprétabilité pour détecter la contrefaçon. En tant que société de technologie financière innovante, Du Xiaoman fournira également davantage de soutien technologique au développement constant du secteur financier.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

J'ai essayé le codage d'ambiance avec Cursor Ai et c'est incroyable!

Mar 20, 2025 pm 03:34 PM

J'ai essayé le codage d'ambiance avec Cursor Ai et c'est incroyable!

Mar 20, 2025 pm 03:34 PM

Le codage des ambiances est de remodeler le monde du développement de logiciels en nous permettant de créer des applications en utilisant le langage naturel au lieu de lignes de code sans fin. Inspirée par des visionnaires comme Andrej Karpathy, cette approche innovante permet de dev

Top 5 Genai Lunets de février 2025: GPT-4.5, Grok-3 et plus!

Mar 22, 2025 am 10:58 AM

Top 5 Genai Lunets de février 2025: GPT-4.5, Grok-3 et plus!

Mar 22, 2025 am 10:58 AM

Février 2025 a été un autre mois qui change la donne pour une IA générative, nous apportant certaines des mises à niveau des modèles les plus attendues et de nouvelles fonctionnalités révolutionnaires. De Xai's Grok 3 et Anthropic's Claude 3.7 Sonnet, à Openai's G

Comment utiliser YOLO V12 pour la détection d'objets?

Mar 22, 2025 am 11:07 AM

Comment utiliser YOLO V12 pour la détection d'objets?

Mar 22, 2025 am 11:07 AM

Yolo (vous ne regardez qu'une seule fois) a été un cadre de détection d'objets en temps réel de premier plan, chaque itération améliorant les versions précédentes. La dernière version Yolo V12 introduit des progrès qui améliorent considérablement la précision

Meilleurs générateurs d'art AI (gratuit & amp; payé) pour des projets créatifs

Apr 02, 2025 pm 06:10 PM

Meilleurs générateurs d'art AI (gratuit & amp; payé) pour des projets créatifs

Apr 02, 2025 pm 06:10 PM

L'article passe en revue les meilleurs générateurs d'art AI, discutant de leurs fonctionnalités, de leur aptitude aux projets créatifs et de la valeur. Il met en évidence MidJourney comme la meilleure valeur pour les professionnels et recommande Dall-E 2 pour un art personnalisable de haute qualité.

Chatgpt 4 o est-il disponible?

Mar 28, 2025 pm 05:29 PM

Chatgpt 4 o est-il disponible?

Mar 28, 2025 pm 05:29 PM

Chatgpt 4 est actuellement disponible et largement utilisé, démontrant des améliorations significatives dans la compréhension du contexte et la génération de réponses cohérentes par rapport à ses prédécesseurs comme Chatgpt 3.5. Les développements futurs peuvent inclure un interg plus personnalisé

Meilleurs chatbots AI comparés (Chatgpt, Gemini, Claude & amp; plus)

Apr 02, 2025 pm 06:09 PM

Meilleurs chatbots AI comparés (Chatgpt, Gemini, Claude & amp; plus)

Apr 02, 2025 pm 06:09 PM

L'article compare les meilleurs chatbots d'IA comme Chatgpt, Gemini et Claude, en se concentrant sur leurs fonctionnalités uniques, leurs options de personnalisation et leurs performances dans le traitement et la fiabilité du langage naturel.

Comment utiliser Mistral OCR pour votre prochain modèle de chiffon

Mar 21, 2025 am 11:11 AM

Comment utiliser Mistral OCR pour votre prochain modèle de chiffon

Mar 21, 2025 am 11:11 AM

Mistral OCR: révolutionner la génération de la récupération avec une compréhension du document multimodal Les systèmes de génération (RAG) (RAG) de la récupération ont considérablement avancé les capacités d'IA, permettant à de vastes magasins de données pour une responsabilité plus éclairée

Assistants d'écriture de l'IA pour augmenter votre création de contenu

Apr 02, 2025 pm 06:11 PM

Assistants d'écriture de l'IA pour augmenter votre création de contenu

Apr 02, 2025 pm 06:11 PM

L'article traite des meilleurs assistants d'écriture d'IA comme Grammarly, Jasper, Copy.ai, WireSonic et Rytr, en se concentrant sur leurs fonctionnalités uniques pour la création de contenu. Il soutient que Jasper excelle dans l'optimisation du référencement, tandis que les outils d'IA aident à maintenir le ton