Périphériques technologiques

Périphériques technologiques

IA

IA

Google lance une contre-attaque à grande échelle ! Officiellement annoncé que l'IA reconstruit la recherche, le nouveau modèle est comparable à GPT-4 et Microsoft cible ChatGPT

Google lance une contre-attaque à grande échelle ! Officiellement annoncé que l'IA reconstruit la recherche, le nouveau modèle est comparable à GPT-4 et Microsoft cible ChatGPT

Google lance une contre-attaque à grande échelle ! Officiellement annoncé que l'IA reconstruit la recherche, le nouveau modèle est comparable à GPT-4 et Microsoft cible ChatGPT

La contre-attaque tant attendue de Google arrive.

Maintenant, la recherche Google ajoute enfin la fonction de conversation AI et le canal de file d'attente est ouvert.

Bien sûr, ce n'est que la première étape.

Le grand est encore à venir :

Le nouveau grand modèle de langage PaLM 2 est officiellement dévoilé et Google affirme qu'il surpasse GPT-4 dans certaines tâches.

Les capacités de Bard ont été considérablement mises à jour, plus besoin de faire la queue et il prend en charge de nouvelles langues.

La version Google de AI Office Assistant a également été lancée et sera la première à apparaître dans Gmail.

Google Cloud a également lancé plusieurs modèles de base à grande échelle pour fournir davantage de services d'IA générative à l'industrie...

Lors de la dernière conférence des développeurs I/O, la grande annonce de Google a été vraiment choquante.

Certains internautes ont dit directement :

La guerre de l'IA bat son plein.

Certaines personnes ont même dit :

Maintenant, je regrette d'avoir payé pour ChatGPT.

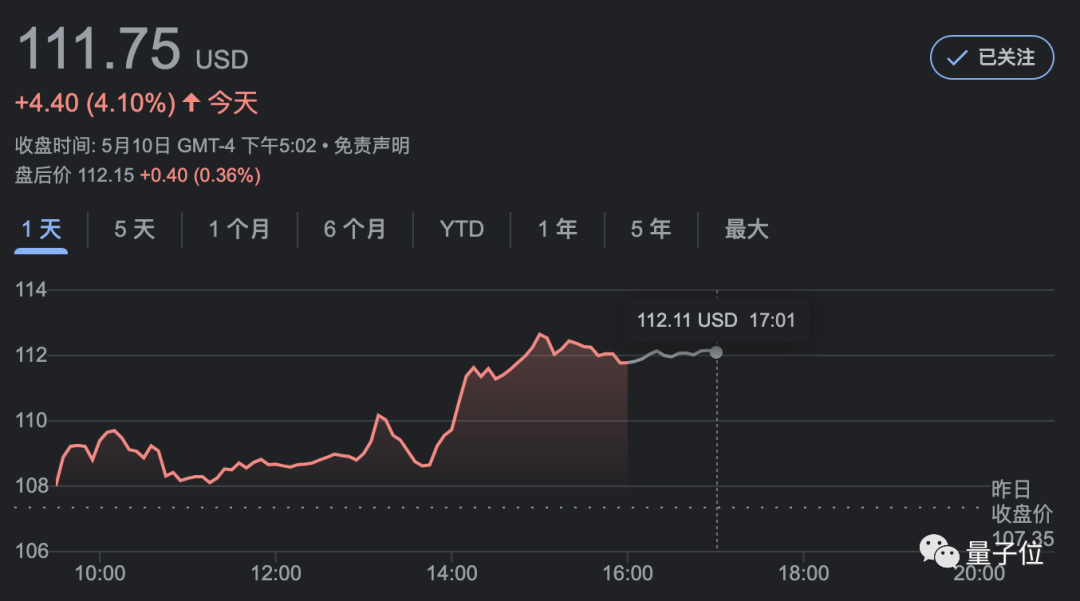

Après une conférence de presse, le cours de l'action Google a augmenté de plus de 4%.

Certaines tâches de PaLM 2 dépassent GPT-4

Il ne fait aucun doute que PaLM 2 est la priorité absolue de la conférence I/O de cette année, et Pichai lui-même l'a présenté.

Le Bard actuel et plus de 25 produits et fonctionnalités Google AI sont désormais pris en charge par PaLM 2 en tant que technologie sous-jacente.

En tant que grand modèle le plus avancé de Google à l'heure actuelle, PaLM 2 est basé sur l'architecture Pathways et est une version améliorée de PaLM, construite sur TPU v4 via JAX.

Selon les rapports, PaLM 2 a reçu une formation dans plus de 100 langues, ce qui le rend plus fort dans la compréhension, la génération et la traduction des langues, et sera meilleur dans le raisonnement de bon sens et l'analyse de la logique mathématique.

L'ensemble de données de PaLM 2 contient un grand nombre d'articles et de pages Web couvrant de nombreuses expressions mathématiques, a déclaré Google. Après avoir été formé sur ces données, PaLM 2 peut facilement résoudre des problèmes mathématiques et même créer des graphiques.

En termes de programmation, PaLM 2 prend désormais en charge 20 langages de programmation, tels que Python, JavaScript et d'autres langages courants, ainsi que Prolog, Fortran et Verilog.

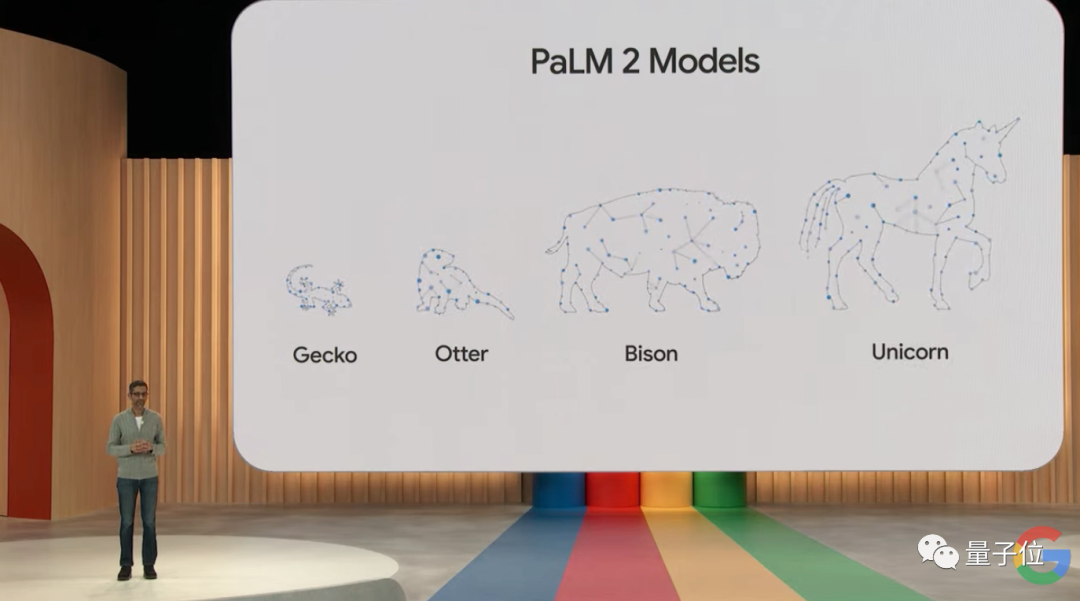

Cette fois, Google a lancé PaLM 2 en quatre tailles différentes.

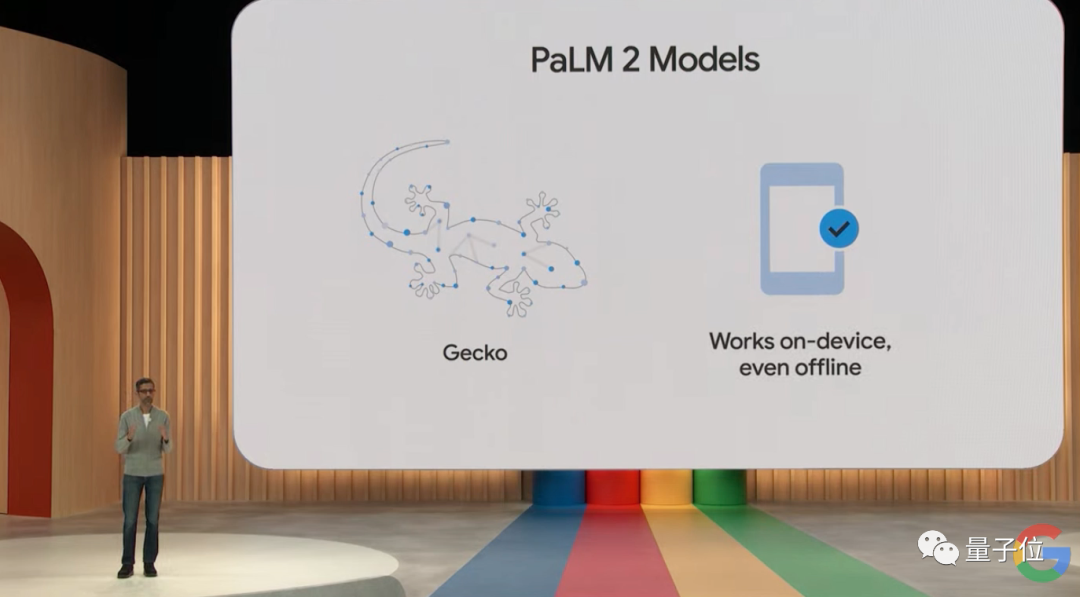

Ils utilisent différents animaux pour représenter l'échelle. Le plus petit est le « gecko » et le plus grand est la « licorne ».

La version "Gecko" est très légère et peut fonctionner rapidement sur les appareils mobiles, y compris hors ligne ; elle peut traiter 20 jetons par seconde.

Le vice-président de DeepMind a déclaré lors de la conférence de presse précédant la conférence I/O :

Nous avons constaté que les modèles plus grands ne sont pas toujours meilleurs, c'est pourquoi nous avons décidé de proposer une gamme de modèles de différentes tailles.

Cela signifie qu'il sera plus facile d'affiner PaLM 2 afin qu'il puisse prendre en charge davantage de produits et d'applications.

Lors de la conférence I/O, Google a annoncé que plus de 25 produits et applications utilisent désormais les capacités de PaLM 2.

La forme d'expression spécifique est Duet AI.

Il peut être compris comme le produit de référence de Microsoft 365 Copilot, un assistant IA qui peut être intégré dans divers logiciels bureautiques.

Google a démontré les capacités de Duet AI dans Gmail, Google Docs et Google Sheets lors de la conférence de presse.

Y compris compléter le contenu des e-mails en fonction des invites, générer des PPT, générer des images en fonction des invites, générer des formulaires en un seul clic, etc.

De même, cet assistant IA peut également fournir une aide à la programmation. Basé sur Google Cloud, il peut recommander et corriger des blocs de code en temps réel et répondre aux questions de programmation de manière conversationnelle. Il prend actuellement en charge Go, JavaScript, Python et SQL.

De plus, sur la base de PaLM 2, Google a également lancé quelques grands modèles dans les domaines professionnels.

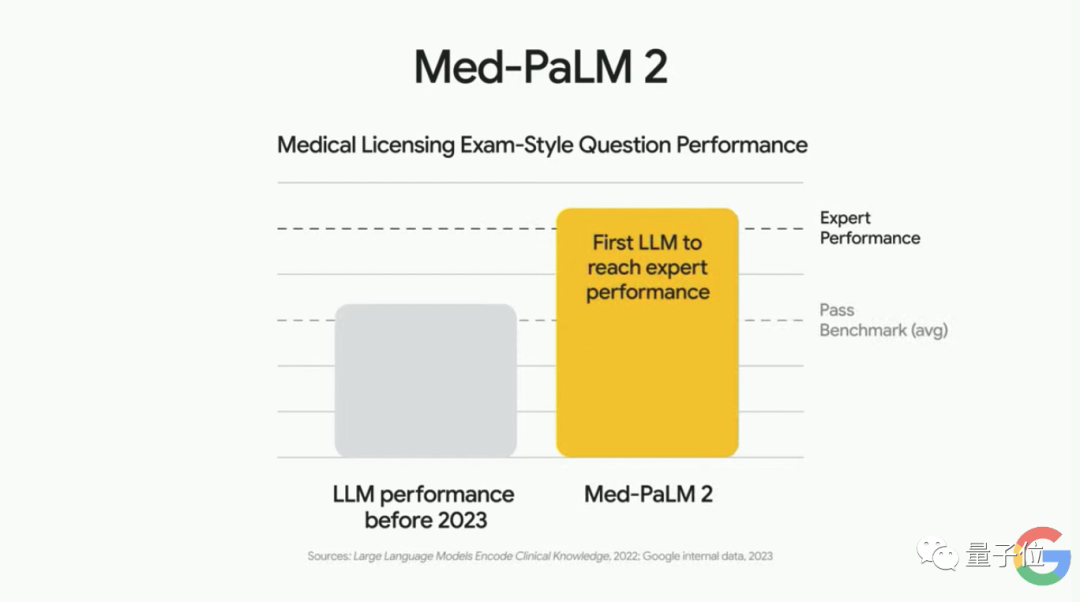

L'équipe de santé de Google a créé Med-PaLM 2. Il s’agirait du premier modèle linguistique à grande échelle à atteindre le niveau expert lors de l’examen de licence médicale des États-Unis, et il serait capable de répondre à une variété de questions médicales.

Google tente actuellement d'améliorer ses capacités multimodales, par exemple en examinant de manière autonome les radiographies et en établissant des diagnostics. Le modèle sera disponible pour un petit groupe d'utilisateurs de Google Cloud plus tard cet été.

Un autre grand modèle professionnel est le Sec-PaLM 2.

Il s'agit d'un grand modèle pour la maintenance de la sécurité du réseau. Il peut analyser et interpréter les scripts malveillants potentiels et détecter les dangers des scripts.

Ainsi, après avoir démontré les capacités exceptionnelles de PaLM 2, il est temps de parler de la façon de l'ouvrir pour l'utiliser.

Google a indiqué que PaLM 2 est désormais disponible via l'interface API PaLM, Firebase et Colab.

Bard est entièrement ouvert, prenant en charge des applications telles que des images et intégrant ses propres cartes.

Bard, qui est comparé à ChatGPT, a finalement annulé la file d'attente d'essai et est entièrement ouvert dans plus de 180 pays et régions du monde.

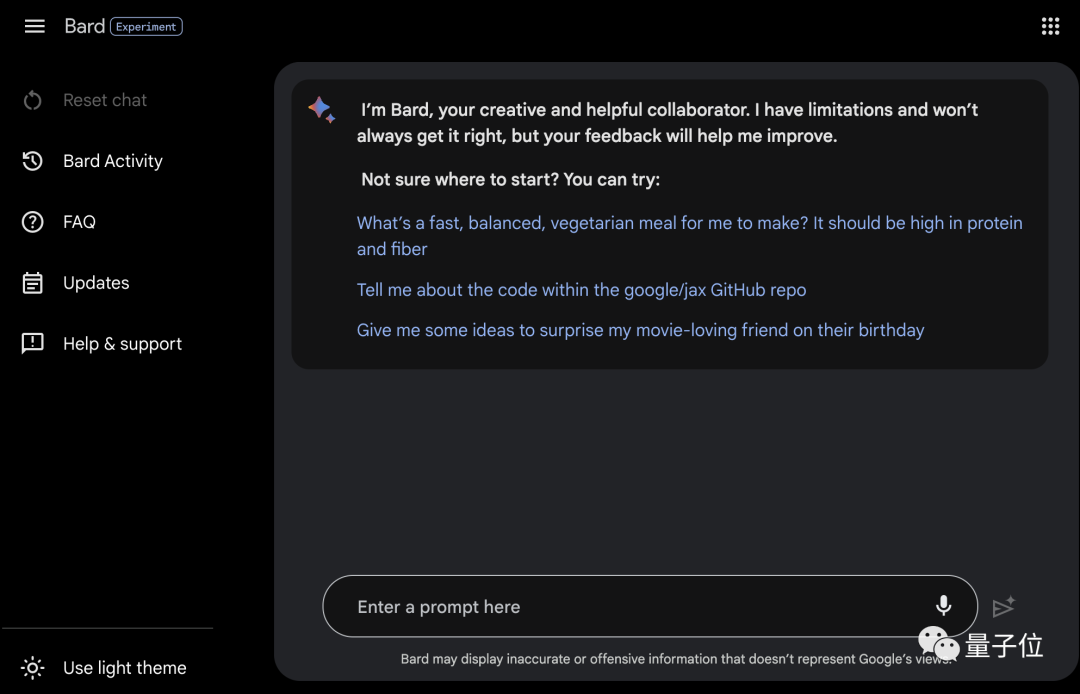

Nouveau mode sombre, très apprécié par les programmeurs : (tête de chien manuelle)

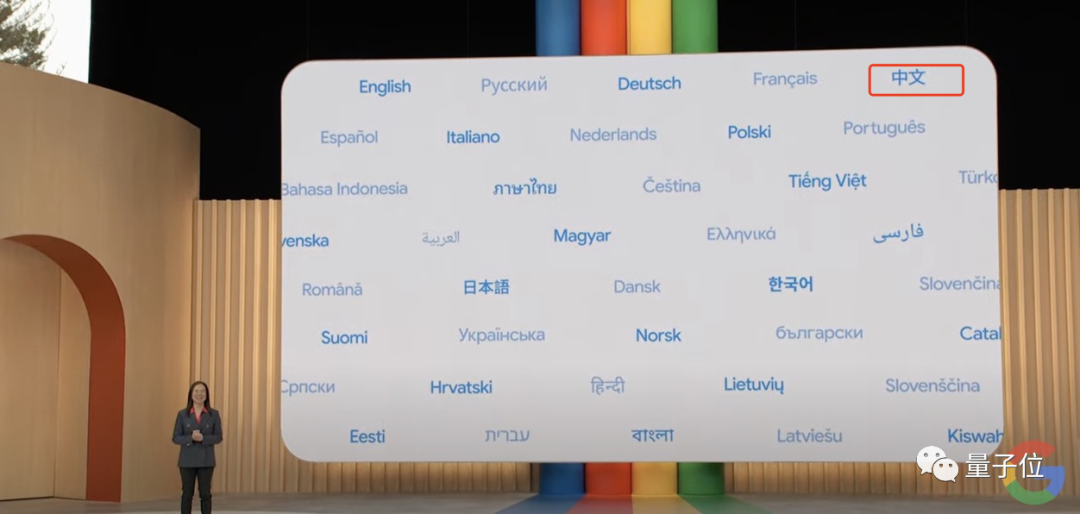

Bard a ajouté la fonctionnalité de conversation directe en japonais et en coréen, en plus d'élargir la plage d'accès au-delà de l'anglais. Google a annoncé qu'il ajouterait bientôt 40 versions linguistiques, dont le chinois.

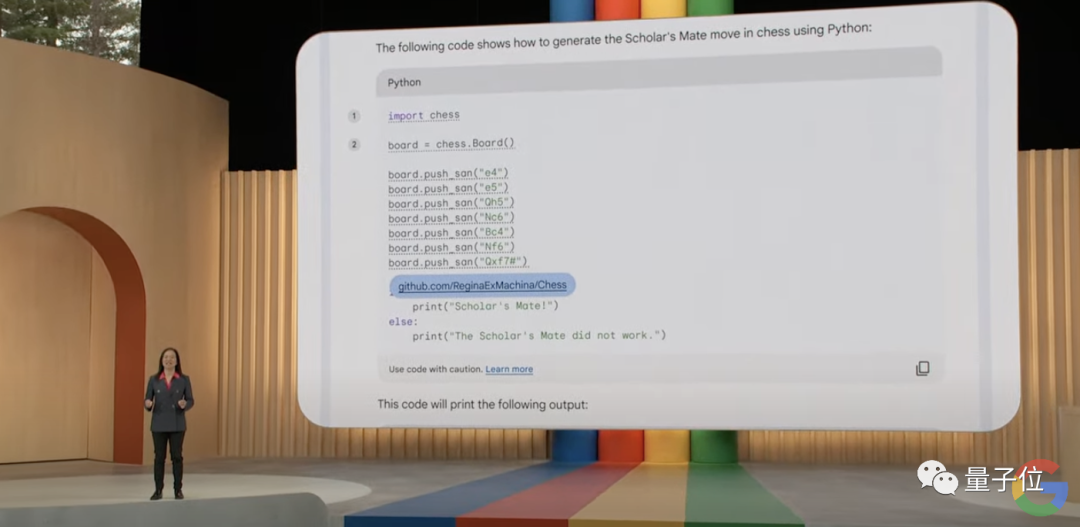

Depuis que Bard sera entièrement connecté à PaLM 2 à partir d'aujourd'hui, ses capacités de programmation et de raisonnement ont également été grandement améliorées, et la génération de code, le débogage et l'interprétation sont du genre plus professionnels (ceux reconnus par les programmeurs).

Lorsque vous lui demandez d'utiliser Python pour écrire un coup de « camarade d'érudit » aux échecs, qui fait référence à d'autres codes, il vous donnera des liens pertinents pour votre commodité.

Vous pouvez poser d'autres questions sur une fonction que vous ne comprenez pas dans le code qu'elle donne, lui demander si elle peut être améliorée ou lui demander de tout fusionner en un seul bloc de code.

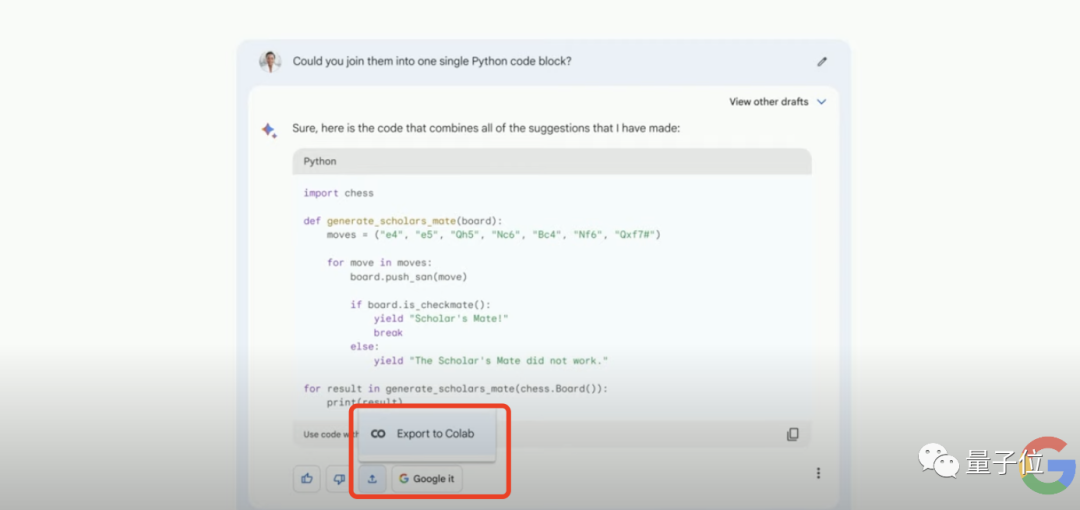

Cependant, le plus surprenant est l'ajout d'une fonction d'importation en un clic en réponse aux demandes des développeurs.

Vous pouvez désormais exporter le code généré par Bard directement vers Colab.

En plus du code, tout contenu que vous générez avec Bard, tel que les brouillons d'e-mails, les formulaires, etc., peut également être glissé directement dans Gmail, Docs et Sheets.

D'ailleurs, Bard prend désormais également en charge les images dans ses réponses. La chose la plus pratique à poser sur les guides de voyage :

En plus de vous répondre avec des images, vous pouvez également lui lancer directement des images, comme télécharger une photo de deux chiens, et le laisser vous aider à inventer des histoires intéressantes :

Cette fonctionnalité est optimisée par Google Lens (une application d'IA qui permet aux machines d'apprendre à « parler en regardant des images »).

En plus de Google Lens, de nombreuses fonctionnalités d'application propres à Google telles que Docs, Drive, Gmail et Maps sont également intégrées à Bard.

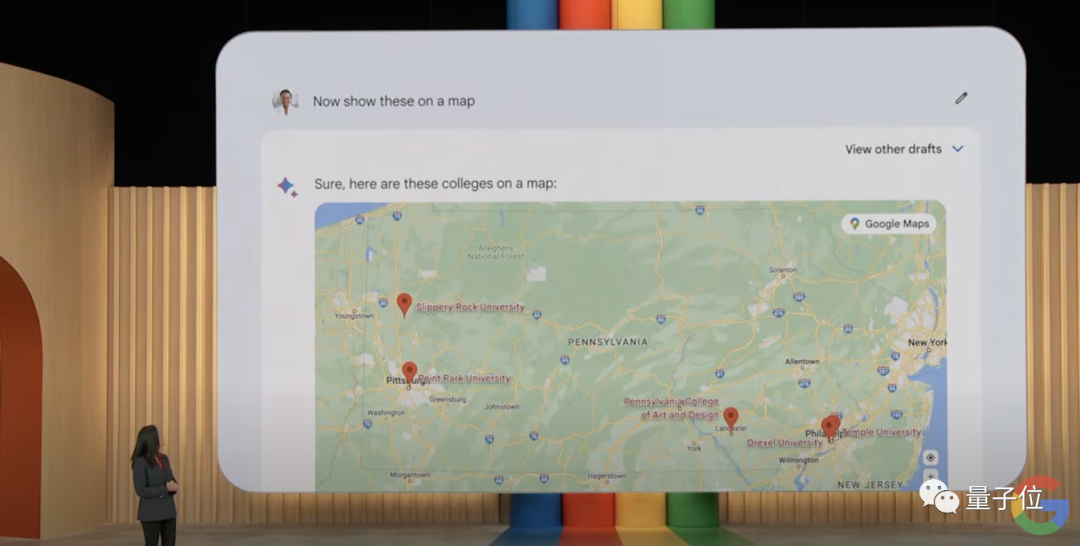

Par exemple, dans la réponse de Bard, vous pouvez utiliser directement Google Maps pour vérifier la localisation géographique de plusieurs universités :

On a l'impression que maintenant que vous devez utiliser divers produits Google, seul Bard suffit.

En plus de sa propre application, Bard a également déplacé Adobe Firefly cette fois. Toutes sortes d'images créatives protégées par le droit d'auteur peuvent être « à portée de main » grâce au dialogue :

Recherchez une reconstruction et rejoignez le. Dialogue IA

Après de nombreux appels, la recherche Google a finalement ouvert la capacité de conversation IA.

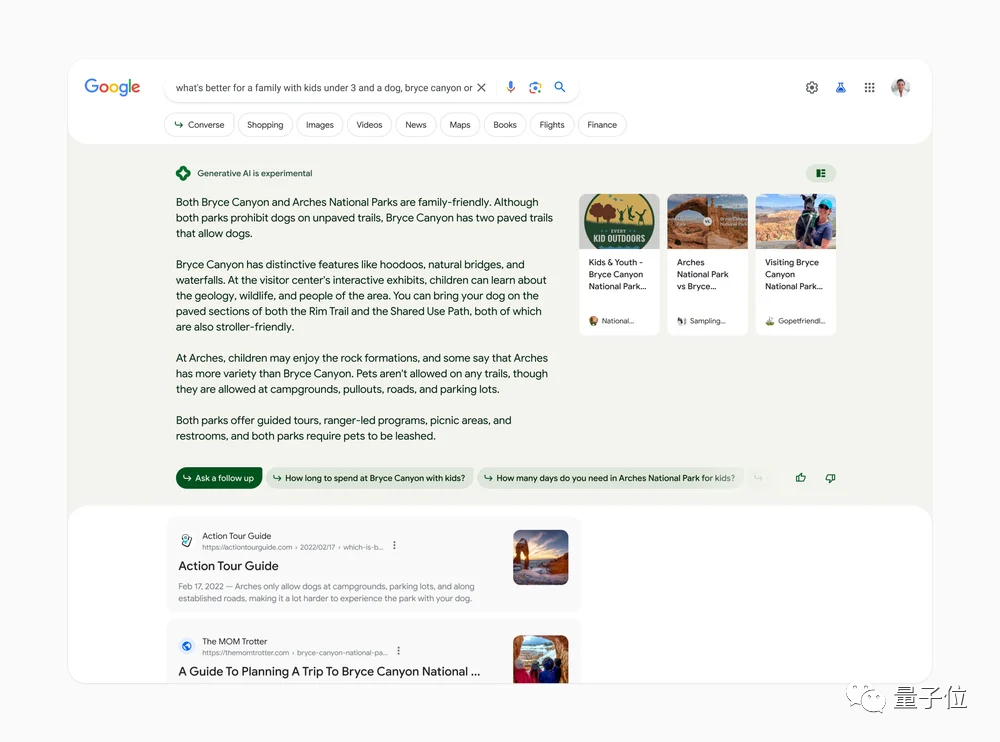

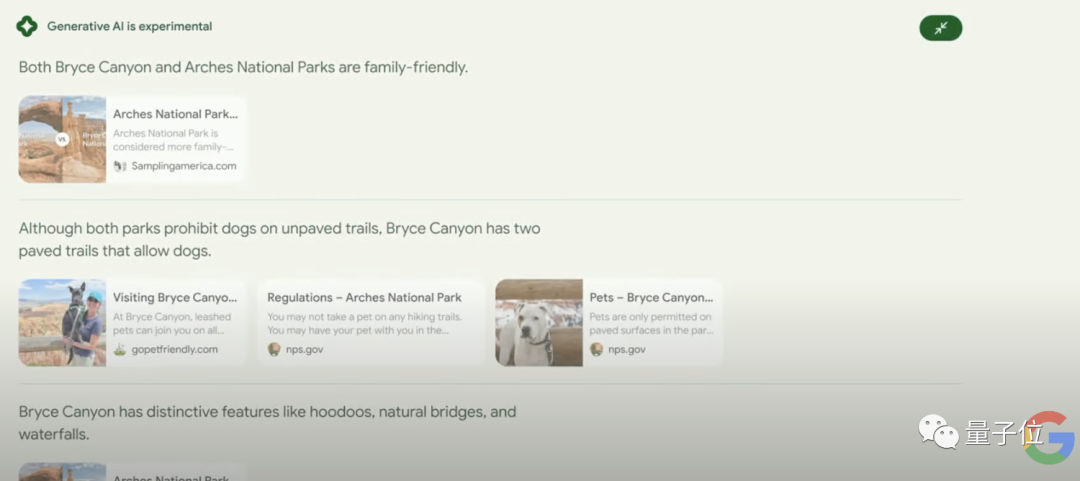

« Pour une famille avec un enfant de moins de 3 ans et un chien, vaut-il mieux aller à Bryce Canyon ou au parc national des Arches ? »

Pour Autrefois, vous devrez peut-être diviser cette question en plusieurs petites questions et utiliser des moteurs de recherche pour trier une grande quantité d'informations avant de pouvoir enfin trouver la réponse.

Maintenant, Google vous permet d'essayer de réussir en une seule étape.

Comme le montre l'image, la recherche Google ne transfère pas simplement les réponses trouvées, mais prend en compte les deux facteurs des enfants et des chiens pour donner des réponses organisées. Par exemple, elle dit : #🎜 🎜#.

Bryce Canyon possède deux boucles acceptant les chiens et est également très convivial pour les poussettes ; le parc national des Arches n'autorise pas les animaux domestiques sur la plupart des sections de la route ; les deux endroits exigent que les animaux soient tenus en laisse, etc.

#🎜 🎜# En outre, il affichera également des liens vers des guides publiés par les internautes à partir de différents sites Web.

#🎜 🎜# En outre, il affichera également des liens vers des guides publiés par les internautes à partir de différents sites Web.

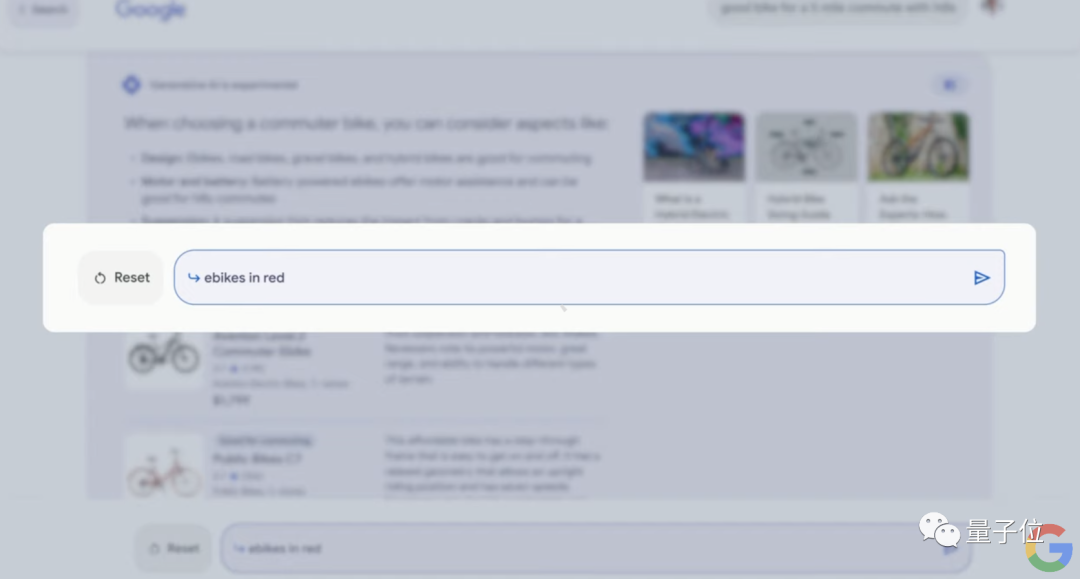

Le plus important est que vous puissiez poser d'autres questions conversationnelles sur sa réponse en cliquant sur le bouton "demander un suivi".

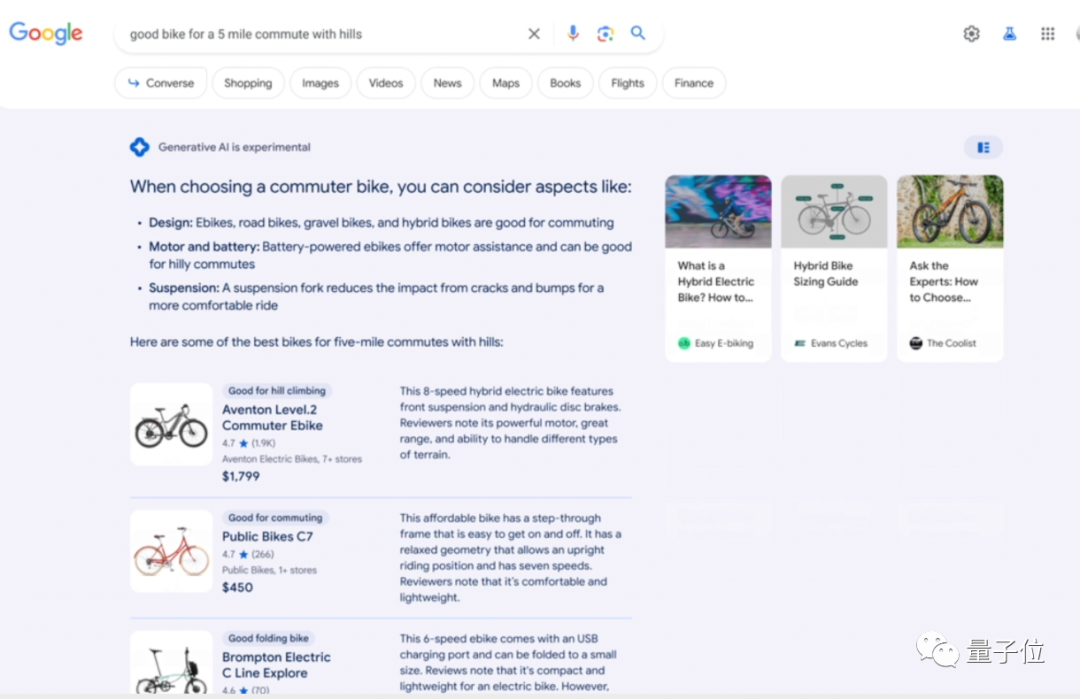

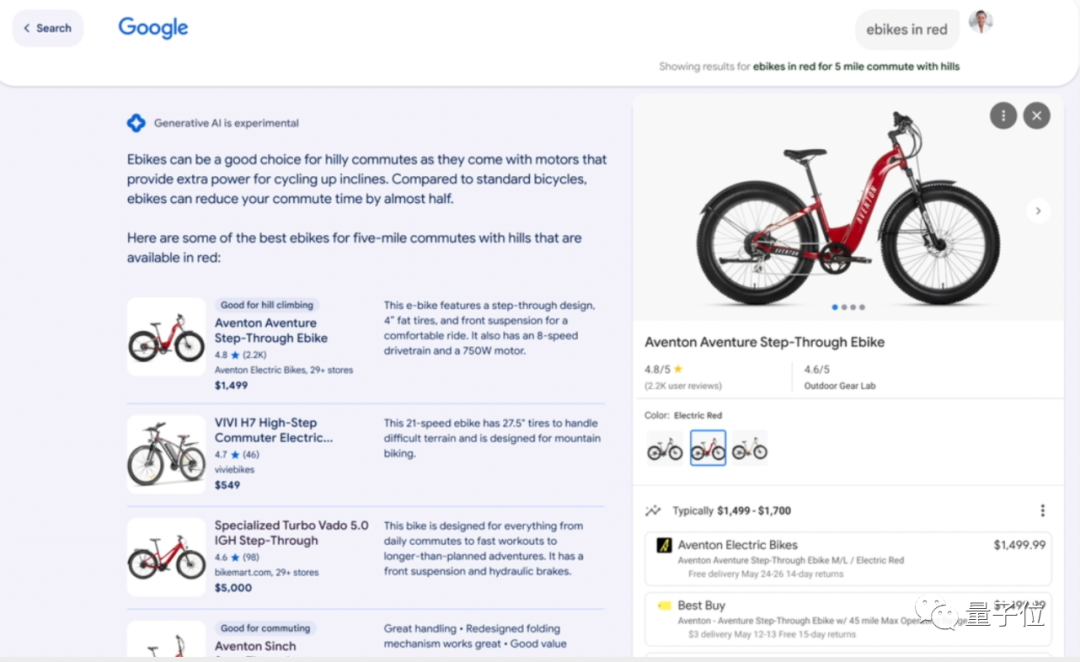

C'est aussi amusant de faire des achats avec la nouvelle recherche Google, qui prétend vous aider à prendre rapidement des décisions d'achat rationnelles.

Par exemple, lorsque vous souhaitez un "vélo adapté aux déplacements domicile-travail de 5 miles en montagne", il vous indiquera d'abord les facteurs importants à prendre en compte avant de choisir, tels que :

Jetez un oeil Conception : les vélos électriques, les vélos de route et les vélos hybrides sont adaptés aux déplacements domicile-travail ;

Le deuxième est le moteur et la batterie, et le troisième est la suspension pour l'absorption des chocs. avec des fissures et des bosses, etc.

Ensuite, nous vous recommanderons une voiture adaptée. Lors de la recommandation, nous fournirons également des informations complètes telles que des descriptions de produits spécifiques, les derniers avis, les prix et les photos.

Vous pouvez également poser d'autres questions, comme par exemple tant que le vélo électrique rouge, cela optimisera encore la réponse. Cette fonctionnalité est alimentée par Google Shopping. Les produits de comparaison de prix sont alimentés par Shopping Graph, qui collecte et met à jour en permanence les listes de produits du monde entier.

Vous pouvez également poser d'autres questions, comme par exemple tant que le vélo électrique rouge, cela optimisera encore la réponse. Cette fonctionnalité est alimentée par Google Shopping. Les produits de comparaison de prix sont alimentés par Shopping Graph, qui collecte et met à jour en permanence les listes de produits du monde entier.

Il convient de mentionner que Google a déclaré sans ambages que l'interface de recherche AI mise à jour intégrera toujours des publicités, mais ne vous inquiétez pas : elle n'apparaîtra que dans des emplacements publicitaires dédiés et ne sera pas mélangée à vos résultats de recherche. .

Enfin, cette nouvelle fonctionnalité ne peut être appliquée qu'à titre d'essai dans Google Search Labs et est limitée aux utilisateurs aux États-Unis.

Lors de la conférence I/O de cette année, le contenu de Google Cloud est tout aussi accrocheur.

Lors de la conférence I/O de cette année, le contenu de Google Cloud est tout aussi accrocheur.

Après avoir mis à jour un grand nombre de capacités d'IA, Google a lancé trois nouveaux grands modèles pour sa plateforme cloud de machine learning Vertex AI :

#🎜 🎜#

Les capacités de ces trois modèles ont effectivement été démontrées lors de la conférence de presse d'aujourd'hui, comme la génération de code, l'édition intelligente de Google Photo, etc.Sur Vertex AI, les API de texte et d'image intégrées sont également actuellement disponibles. En convertissant les données texte et image en vecteurs numériques multidimensionnels et en cartographiant les relations sémantiques, cet outil permet aux développeurs de créer des applications plus intéressantes.

Google affirme être le premier à intégrer les capacités RLHF dans une plate-forme d'apprentissage automatique de bout en bout dans un service géré. L'avantage est qu'il permet aux entreprises de former rapidement des modèles de récompense avec RLHF pour affiner les modèles de base, ce qui est essentiel pour améliorer la précision des grands modèles dans les applications industrielles.

En plus des modèles, Google Cloud a également lancé le supercalculateur GPU A3 de nouvelle génération pour la formation. En combinant les machines virtuelles A3 avec Nvidia H100, Google Cloud peut fournir un débit informatique et une bande passante supérieurs, permettant aux entreprises de développer plus rapidement des modèles d'apprentissage automatique.

En plus de cela, Google a également introduit de nouveaux produits matériels tels que le premier téléphone à écran pliable au prix de 1 799 $ US (environ 12 000 RMB), ainsi que le système Android 14 avec des fonctions d'IA (telles que la fourniture de suggestions pour répondre aux messages). ), nous ne les montrerons pas un par un ici.

De manière générale, à l'occasion de la 15ème conférence I/O, Google vous a vraiment apporté cette fois-ci beaucoup d'informations utiles.

Il est à noter que l'orateur invité présenté sur scène cette fois-ci n'est plus Jeff Dean. Il vient de changer de rang il y a quelques jours.

En tant que dirigeant le plus représentatif ayant parlé de l'IA de Google dans le passé, où sera-t-il dans la vague de l'IA 2.0 ?

Il convient également d'attendre avec impatience de savoir si Google peut encore rattraper son retard dans le domaine des grands modèles et de la recherche par IA.

Êtes-vous satisfait de la contre-attaque de Google cette fois-ci ?

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

Comment utiliser Char Array dans la langue C

Apr 03, 2025 pm 03:24 PM

Comment utiliser Char Array dans la langue C

Apr 03, 2025 pm 03:24 PM

Le Array Char stocke des séquences de caractères en C et est déclaré Char Array_name [Taille]. L'élément d'accès est passé par l'opérateur d'indice, et l'élément se termine par le terminateur nul «\ 0», qui représente le point final de la chaîne. Le langage C fournit une variété de fonctions de manipulation de cordes, telles que strlen (), strcpy (), strcat () et strcmp ().

Évitez les erreurs causées par défaut dans les instructions du commutateur C

Apr 03, 2025 pm 03:45 PM

Évitez les erreurs causées par défaut dans les instructions du commutateur C

Apr 03, 2025 pm 03:45 PM

Une stratégie pour éviter les erreurs causées par défaut dans les instructions de commutateur C: utilisez des énumérations au lieu des constantes, limitant la valeur de l'instruction de cas à un membre valide de l'énumération. Utilisez Fallthrough dans la dernière instruction de cas pour permettre au programme de continuer à exécuter le code suivant. Pour les instructions de commutation sans tomber, ajoutez toujours une instruction par défaut pour la gestion des erreurs ou fournissez un comportement par défaut.

Quelle est la fonction de la somme du langage C?

Apr 03, 2025 pm 02:21 PM

Quelle est la fonction de la somme du langage C?

Apr 03, 2025 pm 02:21 PM

Il n'y a pas de fonction de somme intégrée dans le langage C, il doit donc être écrit par vous-même. La somme peut être obtenue en traversant le tableau et en accumulant des éléments: Version de boucle: la somme est calculée à l'aide de la longueur de boucle et du tableau. Version du pointeur: Utilisez des pointeurs pour pointer des éléments de tableau, et un résumé efficace est réalisé grâce à des pointeurs d'auto-incitation. Allouer dynamiquement la version du tableau: allouer dynamiquement les tableaux et gérer la mémoire vous-même, en veillant à ce que la mémoire allouée soit libérée pour empêcher les fuites de mémoire.

Comment inverser le résultat de! X en C?

Apr 03, 2025 pm 01:57 PM

Comment inverser le résultat de! X en C?

Apr 03, 2025 pm 01:57 PM

Dans le langage C, vous pouvez utiliser !! X, mais il n'utilise que deux conversions booléennes, et il est plus concis et efficace pour utiliser x directement.

Quelle est la priorité de la langue C! X?

Apr 03, 2025 pm 02:06 PM

Quelle est la priorité de la langue C! X?

Apr 03, 2025 pm 02:06 PM

Le non-opérateur logique (!) A la priorité à côté des parenthèses, ce qui signifie que dans les expressions, il précédera la plupart des autres opérateurs. Comprendre la priorité nécessite non seulement une mémorisation par cœur, mais plus important encore, la compréhension de la logique et des pièges potentiels derrière lui pour éviter les erreurs indétectables dans les expressions complexes. L'ajout de supports peut clarifier l'intention d'expression, améliorer la clarté du code et la maintenabilité et empêcher un comportement inattendu.

Comment comprendre! X en C?

Apr 03, 2025 pm 02:33 PM

Comment comprendre! X en C?

Apr 03, 2025 pm 02:33 PM

! x Compréhension! X est un non-opérateur logique dans le langage C. Il booléen la valeur de x, c'est-à-dire que les véritables modifications sont fausses et fausses modifient true. Mais sachez que la vérité et le mensonge en C sont représentés par des valeurs numériques plutôt que par les types booléens, le non-zéro est considéré comme vrai, et seul 0 est considéré comme faux. Par conséquent,! X traite des nombres négatifs de la même manière que des nombres positifs et est considéré comme vrai.

L'importance de la valeur par défaut dans l'instruction de cas de commutation (langue C)

Apr 03, 2025 pm 03:57 PM

L'importance de la valeur par défaut dans l'instruction de cas de commutation (langue C)

Apr 03, 2025 pm 03:57 PM

L'instruction par défaut est cruciale dans l'instruction de cas de commutateur car elle fournit un chemin de traitement par défaut qui garantit qu'un bloc de code est exécuté lorsque la valeur de variable ne correspond à aucune instruction de cas. Cela empêche un comportement ou des erreurs inattendu et améliore la robustesse du code.

Quel est l'impact du mot-clé externe sur les identifiants utilisateur dans le langage C?

Apr 03, 2025 pm 01:00 PM

Quel est l'impact du mot-clé externe sur les identifiants utilisateur dans le langage C?

Apr 03, 2025 pm 01:00 PM

Le mot-clé externe est utilisé dans le langage C pour déclarer des variables et des fonctions externes. Il indique au compilateur que la variable ou la fonction est définie ailleurs, demandant au compilateur de rechercher sa définition pendant l'étape de liaison. Lorsque Extern déclare les variables externes, l'espace mémoire n'est pas alloué et sa définition est effectuée dans d'autres fichiers; Lorsque Extern déclare les fonctions externes, elle n'inclut pas les implémentations de fonctions et son implémentation est également effectuée dans d'autres fichiers. L'utilisation de mots clés externes est généralement combinée avec des fichiers d'en-tête, ce qui est propice à la gestion du code et évite les déclarations répétées. Il est très important de comprendre la gestion par Extern des conflits de compilation et de dénomination multi-fichiers, et il joue un rôle clé dans le processus de liaison.