Cai Shuyue Guo Meiting, journaliste du 21st Century Business Herald, stagiaire Tan Yanwen Mai Zihao, reportage de Shanghai et Guangzhou

NDLR :

Au cours des derniers mois de 2023, les grandes entreprises se sont précipitées pour développer des modèles à grande échelle, ont exploré la commercialisation du GPT et l'infrastructure informatique a été optimiste... Tout comme l'ère de la découverte qui s'est ouverte au XVe siècle, l'humanité les interactions, le commerce et la richesse ont connu une croissance explosive. La révolution spatiale balaie le monde. Dans le même temps, le changement apporte également des défis à l'ordre, tels que les fuites de données, les risques pour la vie privée, la violation du droit d'auteur, les fausses informations... De plus, la crise post-humaniste provoquée par l'IA est déjà sur la table. Quelle attitude les gens doivent-ils adopter ? prenez-vous face aux mythes provoqués par le mélange des humains et des machines ?

À l’heure actuelle, la recherche d’un consensus sur la gouvernance de l’IA et la refonte d’un nouvel ordre sont devenus des problèmes auxquels sont confrontés tous les pays. Le Nancai Compliance Technology Research Institute lancera une série de rapports sur la théorie des contrats d'IA, analysant les modèles réglementaires chinois et étrangers, l'attribution des responsabilités par sujet, la conformité des données du corpus, l'éthique de l'IA, le développement de l'industrie et d'autres dimensions, en vue de fournir quelques idées pour la gouvernance de l'IA. plans et assurer une innovation responsable.

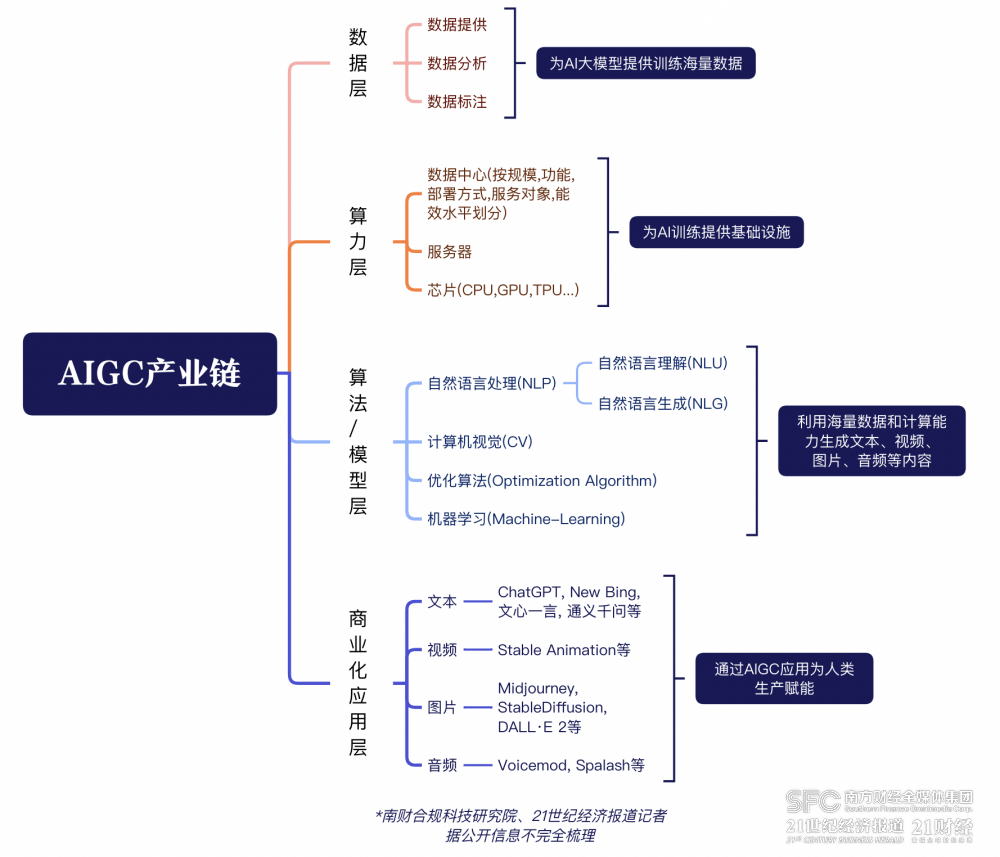

L'essor de la technologie d'IA auto-générée a conduit à la situation actuelle de « bataille de centaines de modèles », et la carte de la chaîne industrielle de cette technologie a également commencé à prendre forme.

(Carte de la chaîne industrielle AIGC. Dessin/Nancai Compliance Technology Research Institute, journaliste du 21st Century Business Herald)

Avant que l'IA générative ne devienne une technologie courante, chaque acteur de la chaîne de production doit réfléchir à la manière d'en faire un outil « contrôlable ».

Fin mars de cette année, une lettre signée par le PDG de Tesla, Elon Musk, le co-fondateur d'Apple Steve Wozniak et plus d'un millier d'entrepreneurs et d'universitaires "a suspendu les expériences d'intelligence artificielle à grande échelle" 》Lettre ouverte publiée.

La lettre note que même si les laboratoires d'IA du monde entier se sont engagés ces derniers mois dans une course effrénée pour développer et déployer des esprits numériques plus puissants, "personne, y compris les développeurs de la technologie", n'est capable de vraiment comprendre, prédire ou contrôler complètement cette technologie. »

Le Laboratoire culturel Yuanshi de l'École de journalisme et de communication de l'Université Tsinghua a également souligné dans le rapport "AIGC Development Research" que AIGC est fortement intervenu dans la chaîne industrielle mondiale et remplacera entièrement les programmeurs, les graphistes, le service client et autres tâches et fixer un plafond pour les coûts de main-d'œuvre, la chaîne industrielle du tiers monde en subira un impact énorme.

Cela signifie que AIGC soutenu par une grande puissance de calcul peut devenir une lame tranchante qui sépare la chaîne industrielle mondiale des entreprises multinationales, ou un poignard qui tranche l'illusion du « village mondial ».

Par conséquent, avec le développement rapide de l'AIGC, placer la technologie d'IA générative qui la sous-tend dans une cage réglementaire et clarifier les responsabilités de toutes les parties de la chaîne industrielle est devenu une proposition urgente à laquelle les pays du monde entier doivent faire face.

Révision de la politique réglementaire : tracez des résultats clairs pour la R&D industrielle

Actuellement, notre pays est sur la voie d’une réglementation des technologies d’IA générative. En avril de cette année, l'Administration du cyberespace de Chine a publié les « Mesures pour l'administration des services d'intelligence artificielle générative (projet pour commentaires) » (ci-après dénommées les « Mesures »), qui est le premier document réglementaire de mon pays ciblant la technologie de l'IA générative. .

En général, les « Mesures » sont basées sur le cadre réglementaire de synthèse profonde existant, qui réglemente le « Règlement de gestion sur la synthèse profonde des services d'information Internet », le « Règlement de gestion sur les algorithmes recommandés pour les services d'information Internet », le « Règlement de gestion sur les services d'information Internet ». Services audio et vidéo", "Règlement de gestion des services d'information sur les réseaux" L'affinement des "Dispositions de gouvernance écologique du contenu", En plus des obligations générales de protection des informations personnelles, les fournisseurs de services d'intelligence artificielle sont également tenus de s'acquitter davantage d'obligations telles que évaluation de la sécurité, classement des algorithmes et identification du contenu.

Concernant la promulgation des documents politiques pertinents ci-dessus, Xiao Sa, associé principal du cabinet d'avocats Beijing Dacheng, a souligné dans une interview avec un journaliste du 21st Century Business Herald que les entreprises concernées devraient prêter attention à la connexion des services de recommandation d'algorithmes existants, en profondeur les services de synthèse et d'autres exigences réglementaires en matière d'intelligence artificielle, s'efforcent d'atteindre la conformité interne, combinent la technologie et le pouvoir juridique pour proposer des solutions de conformité créatives et gagnent plus d'espace institutionnel pour le développement industriel.

La plupart des acteurs de l'industrie ont une attitude favorable et soutiennent les « mesures » et autres projets de loi successivement introduits pour réglementer le développement de la technologie de l'intelligence artificielle. Dans une interview avec 21 journalistes, Wei Chaoqun, directeur produit principal de Liangfengtai, a partagé son point de vue. Il estime qu'à l'heure où la technologie de l'IA générative vient tout juste de démarrer, la mise en œuvre de méthodes de gestion pertinentes est cruciale pour le développement sain de l'ensemble de l'industrie, et ces méthodes joueront un rôle important dans sa promotion.

"D'une part, la promulgation des "Mesures" signifie que l'ensemble du secteur dispose de spécifications opérationnelles claires, qui peuvent guider un ensemble complet de processus de R&D pour les entreprises. D'un autre côté, cela définit également un objectif de R&D pour l'ensemble de l'industrie, énumérant ce qu'il faut faire et ce qu'il ne faut pas faire ?", a souligné Wei Chaoqun.

Par exemple, l'article 17 des « Mesures » exige que les fournisseurs de services d'intelligence artificielle « fournissent les informations nécessaires pouvant affecter la confiance et le choix des utilisateurs, y compris des descriptions de la source, de l'ampleur, du type, de la qualité, etc. de la pré-formation et de la formation optimisée. données et règles d'annotation manuelles. , l'échelle et le type de données annotées manuellement, les algorithmes de base et les systèmes techniques, etc. "pour parvenir à la gouvernance de la technologie de l'intelligence artificielle avec de grandes quantités de données et des règles volatiles.Cependant, certaines personnes estiment que les lois, réglementations et documents politiques nationaux actuels liés à l'intelligence artificielle doivent encore être améliorés.

Xiao Sa a mentionné dans l'interview que même si les « Mesures » répondaient aux risques et aux impacts apportés par l'intelligence artificielle générative, en parcourant son contenu, nous constaterons qu'elles présentent de nombreux problèmes en termes de sujets responsables, de champ d'application, obligations de conformité, etc. Les réglementations sont relativement larges.

Par exemple, l'article 5 des « Mesures » stipule que les prestataires de services (c'est-à-dire les sujets) qui utilisent des produits d'intelligence artificielle générative doivent assumer les responsabilités des producteurs de contenu.

L'article original mentionnait que les organisations et les individus qui utilisent des produits d'intelligence artificielle générative pour fournir des services tels que le chat et la génération de textes, d'images et de sons, notamment en aidant d'autres à générer du texte, des images, des sons, etc. en fournissant des interfaces programmables et d'autres méthodes. , sont responsables de la génération de produits. Responsabilités du producteur de contenu. Cependant, les « Mesures » n'ont pas encore précisé les responsabilités juridiques spécifiques que devraient assumer les prestataires de services.

Difficultés de développement : comment équilibrer réglementation et technologie

Comment améliorer le système de supervision de l'intelligence artificielle et renforcer sa connexion et sa coordination avec la conformité des données et la gouvernance des algorithmes sur la base de l'innovation et du développement technologiques sont actuellement des problèmes urgents à résoudre.

Parmi eux, la clarification des entités responsables de chaque maillon de la chaîne industrielle de l'AIGC et la création d'une technologie d'IA « responsable » sont l'un des points clés auxquels la supervision doit prêter une attention particulière.

En plus de la question de la répartition des responsabilités en matière de sujets mentionnée à l'article 5 des « Mesures », l'UE a également récemment mentionné dans la « Loi sur l'intelligence artificielle » révisée que En termes de répartition des responsabilités dans la chaîne de valeur de l'intelligence artificielle , tout distributeur ou importateur, déployeur ou autre tiers doit être considéré comme un fournisseur de systèmes d'intelligence artificielle à haut risque et doit s'acquitter des obligations correspondantes. Par exemple, indiquez le nom et les coordonnées des systèmes d'intelligence artificielle à haut risque, fournissez des spécifications de données ou des informations relatives aux ensembles de données, enregistrez des journaux, etc.

Pei Yi, professeur adjoint à la faculté de droit de l'Institut de technologie de Pékin, a également souligné à 21 journalistes qu'en tant qu'entité clé dans la fourniture de services d'IA, les entreprises D'une part, elles doivent garantir la collecte et le traitement transparents des données - informer clairement la personne concernée aux fins de la collecte et du traitement des données, et obtenir les consentements ou autorisations nécessaires. Mettre en œuvre des mesures appropriées de sécurité des données et de protection de la vie privée pour garantir la confidentialité et l’intégrité des données. D’un autre côté, un partage de données conforme est également requis. Lorsque vous effectuez un partage de données ou des transactions de données multipartites, assurez-vous que les droits d'utilisation des données et les mécanismes d'autorisation sont conformes, et respectez les lois et réglementations applicables en matière de protection des données.

21 L’observation d’un journaliste a révélé que certaines sociétés d’intelligence artificielle clarifient actuellement leurs obligations en tant qu’entités responsables.

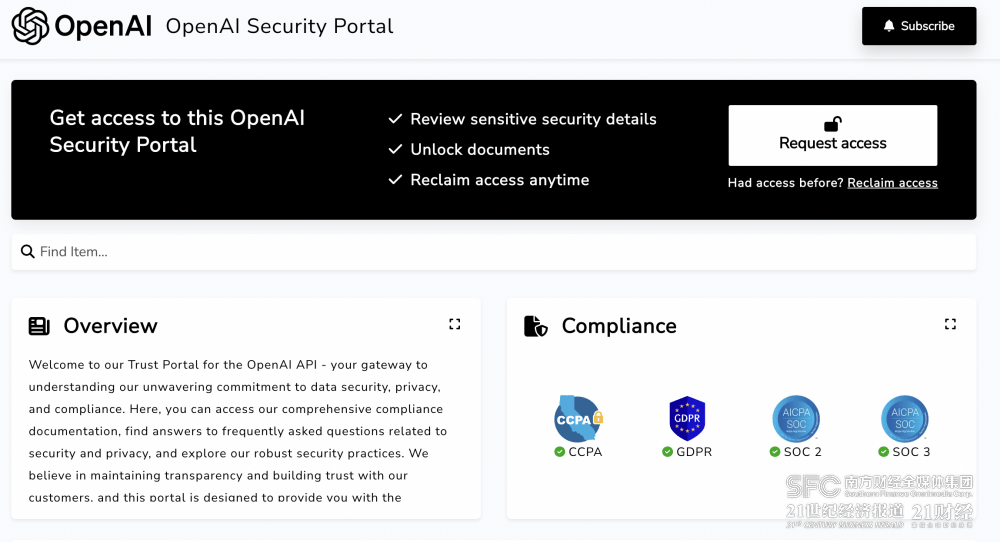

Par exemple, OpenAI a spécialement ouvert un « Portail de sécurité » pour les utilisateurs. Dans cette page, les utilisateurs peuvent parcourir les documents de conformité de l'entreprise, y compris les informations de sauvegarde, de suppression, de cryptage statique dans « Sécurité des données » et « Analyse du code, gestion des informations d'identification, et plus encore dans la sécurité des applications.

(Page « Portail sécurisé » d'OpenAI. Source/Site officiel d'OpenAI)

Dans la politique de confidentialité publiée par le site officiel de l'outil de peinture AI Midjourney, fournit également une description détaillée des scénarios de partage, de conservation, de transmission et d'utilisation des données des utilisateurs. En même temps, il répertorie également en détail les. besoin de collecter des identités dans le processus de fourniture de services aux utilisateurs. 11 types d'informations personnelles, notamment des logos, des informations commerciales et des informations biométriques.

Il convient de mentionner que le responsable des affaires juridiques d'une entreprise de technologie émergente à Shanghai a déclaré lors d'une conversation avec 21 journalistes que les conditions de service pour les activités internes liées à l'intelligence artificielle de l'entreprise sont en cours de formulation Une partie des règles pour. l'attribution des responsabilités est basée sur la pratique d'OpenAI.

D’un autre côté, en tant que fournisseurs de services d’IA générative, les entreprises doivent également prêter attention à la conformité interne. Xiao Sa a souligné que les activités des entreprises liées à l'AIGC doivent s'appuyer sur des données massives et des algorithmes complexes, et que les scénarios d'application sont complexes et diversifiés. Les entreprises sont sujettes à divers risques et il est très difficile de s'y fier entièrement. surveillance externe. Par conséquent, les sociétés liées doivent renforcer la gestion interne de la conformité de l’AIGC.

D'une part, les agences de régulation devraient profiter de l'occasion pour mettre en œuvre globalement la réforme de la conformité des entreprises, explorer activement la promotion de la réforme de la conformité des entreprises impliquées dans le domaine numérique des réseaux et mettre en œuvre des mécanismes de surveillance et d'évaluation par des tiers, établir et améliorer les systèmes et mécanismes. pour la gestion de la conformité et prévenir efficacement les violations du réseau. D'un autre côté, nous devons également explorer activement les voies réglementaires pour promouvoir la construction de la conformité ex ante grâce à la rectification de la conformité ex post, et encourager les autorités de régulation des réseaux et les sociétés Internet à étudier et formuler conjointement des lignes directrices en matière de conformité des données pour assurer le développement sain du numérique. économie.

"La tâche la plus importante des autorités de régulation est de tracer le résultat net. Parmi eux, "l'éthique technologique" et la "sécurité nationale" sont deux critères inaliénables. Dans le cadre du résultat net, nous pouvons essayer de donner à l'industrie le plus de "La technologie est timide et restreinte dans son développement dans un souci de conformité", a déclaré Pei Yi à 21 journalistes.

Coordinateur : Wang Jun

Reporters : Guo Meiting, Cai Shuyue, Tan Yanwen, Mai Zihao

Dessin : Cai Shuyue

Pour plus de contenu, veuillez télécharger l'application 21 Finance

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!