Périphériques technologiques

Périphériques technologiques

IA

IA

Trois étapes de l'intelligence artificielle : pourquoi les scientifiques unissent leurs forces pour restreindre la technologie de l'IA qui pourrait conduire à l'extinction de l'humanité

Trois étapes de l'intelligence artificielle : pourquoi les scientifiques unissent leurs forces pour restreindre la technologie de l'IA qui pourrait conduire à l'extinction de l'humanité

Trois étapes de l'intelligence artificielle : pourquoi les scientifiques unissent leurs forces pour restreindre la technologie de l'IA qui pourrait conduire à l'extinction de l'humanité

Des experts, dont les dirigeants d'OpenAI et de Google Deepmind, préviennent que l'intelligence artificielle pourrait conduire à l'extinction de l'humanité, mais comment les machines peuvent-elles remplacer les humains ?

Depuis son lancement en novembre 2022, ChatGPT - un chatbot qui utilise l'intelligence artificielle pour répondre à des questions ou générer du texte ou même du code en fonction des besoins de l'utilisateur, est devenue l'application Internet à la croissance la plus rapide de l'histoire.

En seulement deux mois, il a atteint 100 millions d'utilisateurs actifs. Selon la société de surveillance technologique Sensor Town, il a fallu à Instagram jusqu'à deux ans et demi pour atteindre cette étape.

ChatGPT, développé par OpenAI avec le financement de Microsoft, a gagné en popularité, déclenchant d'intenses spéculations sur l'impact de l'intelligence artificielle sur l'avenir de l'humanité.

Des dizaines d'experts ont soutenu une déclaration publiée sur la page du AI Safety Center, affirmant : « L'atténuation du risque d'extinction posé par l'IA devrait devenir une priorité mondiale aux côtés d'autres risques à l'échelle de la société tels que les épidémies et la guerre nucléaire. »

Mais certains disent que cette inquiétude est exagérée.

Imiter les humains

Les textes (allant de la prose, de la poésie et des blagues au code informatique) et les images (telles que les diagrammes, les photos et les illustrations) produits par l'intelligence artificielle telle que ChatGPT, DALL-E, Bard et AlphaCode sont presque identiques et impossibles à distinguer. du propre travail des humains.Les étudiants l'utilisent pour rédiger leurs devoirs, les politiciens l'utilisent pour rédiger des discours. Le représentant démocrate Jack Auchincloss a lancé cette ressource au Congrès américain.

Le géant de la technologie IBM a annoncé qu'il cesserait de recruter 7 800 postes pouvant être gérés par l'intelligence artificielle.

Si tous ces changements vous submergent, préparez-vous :

Nous n’en sommes qu’à la première étape de l’intelligence artificielle, avec deux autres étapes à venir, qui, craignent certains scientifiques, pourraient menacer la survie de l’humanité.

1. Intelligence artificielle étroite

L'IA faible, également connue sous le nom d'IA à domaine restreint, se concentre sur une seule tâche et effectue un travail répétitif sur une gamme de fonctions.Il apprend généralement à partir de grandes quantités de données, par exemple sur Internet, mais uniquement dans le domaine spécifique pour lequel il a été programmé.

Un exemple est un programme d'échecs capable de battre le champion du monde mais incapable d'effectuer d'autres tâches.

Des systèmes beaucoup plus complexes, tels que les voitures autonomes et ChatGPT, entrent toujours dans la catégorie des intelligences artificielles faibles. Ils ne peuvent pas opérer en dehors des limites du rôle qui leur est assigné et ne peuvent donc pas prendre de décisions par eux-mêmes.

Mais certains experts estiment que les systèmes programmés avec des capacités d'apprentissage automatique, tels que ChatGPT ou AutoGPT, pourraient entrer dans la prochaine étape de développement.

2. Intelligence générale artificielle

L'intelligence générale artificielle arrivera lorsque les machines pourront accomplir n'importe quelle tâche intellectuelle que les humains peuvent réaliser.On l’appelle aussi « Intelligence Artificielle Forte ».

6 mois de suspension

En mars 2023, plus de 1 000 experts techniques ont appelé « tous les laboratoires d'intelligence artificielle à suspendre immédiatement la formation des systèmes d'intelligence artificielle plus puissants que GPT-4 pendant au moins 6 mois », GPT-4 est la dernière version de ChatGPT.

Dans la lettre publiée par l'Institut à but non lucratif Future of Life, les experts affirment que si les entreprises refusent d'arrêter rapidement leurs projets, "le gouvernement devrait intervenir et imposer un moratoire" afin que des mesures de sécurité puissent être conçues et mises en œuvre.

"Intelligent et stupide"

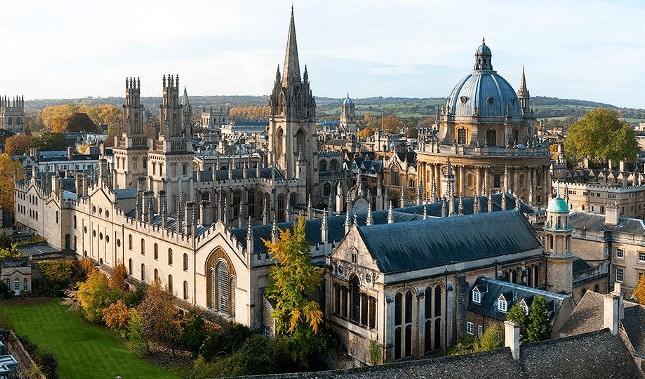

La lettre a été signée par Carissa Veliz de l'Institut pour l'éthique de l'intelligence artificielle de l'Université d'Oxford. Elle a refusé de signer parce qu’elle estimait que la déclaration d’avertissement finalement émise par le Center for Artificial Intelligence Safety était trop extrême.

"Le type d'IA que nous développons actuellement est à la fois intelligent et stupide", a-t-elle déclaré à Andrew Webb. "Si quelqu'un a essayé ChatGPT ou une autre IA, il remarquera qu'il a des limites très importantes

."Veliz a déclaré qu'elle craignait que l'intelligence artificielle ne crée de la désinformation à un rythme extrêmement élevé.

À l'approche de l'élection présidentielle américaine de 2024, je suis de plus en plus préoccupé par le fait que des plateformes importantes comme Twitter et d'autres plateformes majeures ont licencié leurs équipes d'éthique et de sécurité de l'IA. »

Le gouvernement américain reconnaît la menace potentielle. La Maison Blanche a déclaré dans un communiqué le 4 mai : « L'intelligence artificielle est l'une des technologies les plus puissantes de notre époque, mais pour saisir les opportunités qu'elle apporte, nous devons d'abord réduire ses risques

.Le Congrès américain a assigné à comparaître Sam Altman, PDG d'OpenAI, pour répondre aux questions sur ChatGPT.

Lors d'une audition au Sénat, Altman a déclaré que c'était "très important" pour la réglementation gouvernementale de son industrie à mesure que l'intelligence artificielle se développe.

Gutierrez, chercheur en politiques publiques au Future of Life Institute, a expliqué aux journalistes que l'un des grands défis posés par l'intelligence artificielle est qu'"il n'existe pas d'organisme commun d'experts pour décider comment la réglementer, comme le Groupe d'experts intergouvernemental sur le climat". Changer" le comité comme ça. "

Cela nous amène à la troisième et dernière étape de l’intelligence artificielle.

3. Super intelligence artificielle

Cette théorie veut qu'une fois que nous aurons atteint la deuxième étape, nous entrerons bientôt dans l'étape finale, qui est la « super intelligence artificielle ». C’est ce qui arrive lorsque l’intelligence artificielle dépasse l’intelligence humaine.

Bostrom, philosophe et expert en intelligence artificielle à l'Université d'Oxford, définit la superintelligence comme « une intelligence qui dépasse de loin les meilleurs cerveaux humains dans presque tous les domaines, y compris la créativité scientifique, l'intelligence générale et les compétences sociales ».

« Les humains doivent apprendre longtemps pour devenir ingénieurs, infirmiers ou avocats. La difficulté de l’intelligence artificielle générale est sa capacité à s’améliorer continuellement dans des situations où nous ne pouvons pas le faire », a expliqué Gutierrez. ».

Science-Fiction

Ce concept rappelle l'intrigue du film "Terminator", dans lequel des machines déclenchent une guerre nucléaire qui détruit l'humanité.

Narayanan, informaticien de l'Université de Princeton, a précédemment déclaré aux journalistes que les scénarios catastrophes de science-fiction sont irréalistes : « L'intelligence artificielle actuelle est loin d'être suffisante pour faire de ces risques une réalité. En fin de compte, elle détourne l'attention des gens de l'intelligence artificielle.

Bien qu'il y ait beaucoup de débats sur la question de savoir si les machines peuvent réellement atteindre le type d'intelligence large que possèdent les humains, notamment en termes d'intelligence émotionnelle, c'est l'une des plus grandes craintes de ceux qui pensent que nous sommes sur le point d'atteindre une intelligence artificielle générale. intelligence.

Récemment, le « Parrain de l'intelligence artificielle » Jeffrey Hinton a prévenu que nous approchions peut-être de cette étape importante. Hinton est un pionnier dans l’apprentissage des machines pour apprendre de l’expérience.

« Je ne pense pas que [les machines] soient plus intelligentes que nous en ce moment. Étant donné qu'il est à la retraite et qu'il a 75 ans, je pense qu'elles y arriveront probablement bientôt

.Dans une déclaration au New York Times annonçant son départ de Google, Hinton a déclaré qu'il regrettait désormais le travail qu'il avait accompli car il craignait que de "mauvais acteurs" n'utilisent l'IA pour faire de "mauvaises choses".

Il a prévenu que ces machines pourraient finir par « créer des sous-objectifs comme « J’ai besoin de plus de puissance » » ce qui poserait un « risque existentiel ».

Bien que Hinton reconnaisse que l'intelligence artificielle peut comporter des risques, il estime qu'à court terme, ses avantages l'emportent sur les risques et estime donc que nous ne devrions pas arrêter de développer cette technologie. ", a-t-il dit.

Extinction ou Immortalité

Le physicien britannique Stephen Hawking a lancé un sévère avertissement.

« Le plein développement de l’intelligence artificielle pourrait signifier la fin de l’humanité », a-t-il déclaré aux journalistes en 2014, quatre ans avant sa mort.

Les machines dotées de ce niveau d'intelligence "évolueront d'elles-mêmes et se redessineront à un rythme croissant", a-t-il déclaré.

Nano robots et immortalité

L'inventeur et auteur futuriste Kurzweil est l'un des plus grands passionnés de l'intelligence artificielle. Il est chercheur en intelligence artificielle chez Google et co-fondateur de la Singularity University dans la Silicon Valley.

Kurzweil pense que les humains seront capables d'utiliser une intelligence artificielle super intelligente pour surmonter les obstacles biologiques.

En 2015, il a prédit que d’ici 2030, les humains atteindront l’immortalité grâce aux nanobots (très petits robots) travaillant à l’intérieur de notre corps, capables de réparer et de guérir tout dommage ou maladie.

Gestion de l'intelligence artificielle

Gutierrez convient que la clé est de créer un système de gouvernance de l'IA.

"Imaginez un avenir dans lequel une entité dispose de tellement d'informations sur chaque personne sur la planète et ses habitudes (grâce aux recherches sur Internet) qu'elle peut nous contrôler d'une manière dont nous ignorons", a-t-il déclaré.

"Le pire des cas n'est pas une guerre entre humains et robots. Nous partageons cette planète avec un être plus intelligent que nous, et malheureusement, nous ne réalisons pas que nous sommes manipulés."

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Bytedance Cutting lance le super abonnement SVIP : 499 yuans pour un abonnement annuel continu, offrant une variété de fonctions d'IA

Jun 28, 2024 am 03:51 AM

Bytedance Cutting lance le super abonnement SVIP : 499 yuans pour un abonnement annuel continu, offrant une variété de fonctions d'IA

Jun 28, 2024 am 03:51 AM

Ce site a rapporté le 27 juin que Jianying est un logiciel de montage vidéo développé par FaceMeng Technology, une filiale de ByteDance. Il s'appuie sur la plateforme Douyin et produit essentiellement du contenu vidéo court pour les utilisateurs de la plateforme. Il est compatible avec iOS, Android et. Windows, MacOS et autres systèmes d'exploitation. Jianying a officiellement annoncé la mise à niveau de son système d'adhésion et a lancé un nouveau SVIP, qui comprend une variété de technologies noires d'IA, telles que la traduction intelligente, la mise en évidence intelligente, l'emballage intelligent, la synthèse humaine numérique, etc. En termes de prix, les frais mensuels pour le clipping SVIP sont de 79 yuans, les frais annuels sont de 599 yuans (attention sur ce site : équivalent à 49,9 yuans par mois), l'abonnement mensuel continu est de 59 yuans par mois et l'abonnement annuel continu est de 59 yuans par mois. est de 499 yuans par an (équivalent à 41,6 yuans par mois) . En outre, le responsable de Cut a également déclaré que afin d'améliorer l'expérience utilisateur, ceux qui se sont abonnés au VIP d'origine

Assistant de codage d'IA augmenté par le contexte utilisant Rag et Sem-Rag

Jun 10, 2024 am 11:08 AM

Assistant de codage d'IA augmenté par le contexte utilisant Rag et Sem-Rag

Jun 10, 2024 am 11:08 AM

Améliorez la productivité, l’efficacité et la précision des développeurs en intégrant une génération et une mémoire sémantique améliorées par la récupération dans les assistants de codage IA. Traduit de EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG, auteur JanakiramMSV. Bien que les assistants de programmation d'IA de base soient naturellement utiles, ils ne parviennent souvent pas à fournir les suggestions de code les plus pertinentes et les plus correctes, car ils s'appuient sur une compréhension générale du langage logiciel et des modèles d'écriture de logiciels les plus courants. Le code généré par ces assistants de codage est adapté à la résolution des problèmes qu’ils sont chargés de résoudre, mais n’est souvent pas conforme aux normes, conventions et styles de codage des équipes individuelles. Cela aboutit souvent à des suggestions qui doivent être modifiées ou affinées pour que le code soit accepté dans l'application.

Le réglage fin peut-il vraiment permettre au LLM d'apprendre de nouvelles choses : l'introduction de nouvelles connaissances peut amener le modèle à produire davantage d'hallucinations

Jun 11, 2024 pm 03:57 PM

Le réglage fin peut-il vraiment permettre au LLM d'apprendre de nouvelles choses : l'introduction de nouvelles connaissances peut amener le modèle à produire davantage d'hallucinations

Jun 11, 2024 pm 03:57 PM

Les grands modèles linguistiques (LLM) sont formés sur d'énormes bases de données textuelles, où ils acquièrent de grandes quantités de connaissances du monde réel. Ces connaissances sont intégrées à leurs paramètres et peuvent ensuite être utilisées en cas de besoin. La connaissance de ces modèles est « réifiée » en fin de formation. À la fin de la pré-formation, le modèle arrête effectivement d’apprendre. Alignez ou affinez le modèle pour apprendre à exploiter ces connaissances et répondre plus naturellement aux questions des utilisateurs. Mais parfois, la connaissance du modèle ne suffit pas, et bien que le modèle puisse accéder à du contenu externe via RAG, il est considéré comme bénéfique de l'adapter à de nouveaux domaines grâce à un réglage fin. Ce réglage fin est effectué à l'aide de la contribution d'annotateurs humains ou d'autres créations LLM, où le modèle rencontre des connaissances supplémentaires du monde réel et les intègre.

Sept questions d'entretien technique Cool GenAI et LLM

Jun 07, 2024 am 10:06 AM

Sept questions d'entretien technique Cool GenAI et LLM

Jun 07, 2024 am 10:06 AM

Pour en savoir plus sur l'AIGC, veuillez visiter : 51CTOAI.x Community https://www.51cto.com/aigc/Translator|Jingyan Reviewer|Chonglou est différent de la banque de questions traditionnelle que l'on peut voir partout sur Internet. nécessite de sortir des sentiers battus. Les grands modèles linguistiques (LLM) sont de plus en plus importants dans les domaines de la science des données, de l'intelligence artificielle générative (GenAI) et de l'intelligence artificielle. Ces algorithmes complexes améliorent les compétences humaines et stimulent l’efficacité et l’innovation dans de nombreux secteurs, devenant ainsi la clé permettant aux entreprises de rester compétitives. LLM a un large éventail d'applications. Il peut être utilisé dans des domaines tels que le traitement du langage naturel, la génération de texte, la reconnaissance vocale et les systèmes de recommandation. En apprenant de grandes quantités de données, LLM est capable de générer du texte

Cinq écoles d'apprentissage automatique que vous ne connaissez pas

Jun 05, 2024 pm 08:51 PM

Cinq écoles d'apprentissage automatique que vous ne connaissez pas

Jun 05, 2024 pm 08:51 PM

L'apprentissage automatique est une branche importante de l'intelligence artificielle qui donne aux ordinateurs la possibilité d'apprendre à partir de données et d'améliorer leurs capacités sans être explicitement programmés. L'apprentissage automatique a un large éventail d'applications dans divers domaines, de la reconnaissance d'images et du traitement du langage naturel aux systèmes de recommandation et à la détection des fraudes, et il change notre façon de vivre. Il existe de nombreuses méthodes et théories différentes dans le domaine de l'apprentissage automatique, parmi lesquelles les cinq méthodes les plus influentes sont appelées les « Cinq écoles d'apprentissage automatique ». Les cinq grandes écoles sont l’école symbolique, l’école connexionniste, l’école évolutionniste, l’école bayésienne et l’école analogique. 1. Le symbolisme, également connu sous le nom de symbolisme, met l'accent sur l'utilisation de symboles pour le raisonnement logique et l'expression des connaissances. Cette école de pensée estime que l'apprentissage est un processus de déduction inversée, à travers les connaissances existantes.

Afin de fournir un nouveau système de référence et d'évaluation de questions-réponses scientifiques et complexes pour les grands modèles, l'UNSW, Argonne, l'Université de Chicago et d'autres institutions ont lancé conjointement le cadre SciQAG.

Jul 25, 2024 am 06:42 AM

Afin de fournir un nouveau système de référence et d'évaluation de questions-réponses scientifiques et complexes pour les grands modèles, l'UNSW, Argonne, l'Université de Chicago et d'autres institutions ont lancé conjointement le cadre SciQAG.

Jul 25, 2024 am 06:42 AM

L'ensemble de données ScienceAI Question Answering (QA) joue un rôle essentiel dans la promotion de la recherche sur le traitement du langage naturel (NLP). Des ensembles de données d'assurance qualité de haute qualité peuvent non seulement être utilisés pour affiner les modèles, mais également évaluer efficacement les capacités des grands modèles linguistiques (LLM), en particulier la capacité à comprendre et à raisonner sur les connaissances scientifiques. Bien qu’il existe actuellement de nombreux ensembles de données scientifiques d’assurance qualité couvrant la médecine, la chimie, la biologie et d’autres domaines, ces ensembles de données présentent encore certaines lacunes. Premièrement, le formulaire de données est relativement simple, et la plupart sont des questions à choix multiples. Elles sont faciles à évaluer, mais limitent la plage de sélection des réponses du modèle et ne peuvent pas tester pleinement la capacité du modèle à répondre aux questions scientifiques. En revanche, les questions et réponses ouvertes

Les performances de SOTA, la méthode d'IA de prédiction d'affinité protéine-ligand multimodale de Xiamen, combinent pour la première fois des informations sur la surface moléculaire

Jul 17, 2024 pm 06:37 PM

Les performances de SOTA, la méthode d'IA de prédiction d'affinité protéine-ligand multimodale de Xiamen, combinent pour la première fois des informations sur la surface moléculaire

Jul 17, 2024 pm 06:37 PM

Editeur | KX Dans le domaine de la recherche et du développement de médicaments, il est crucial de prédire avec précision et efficacité l'affinité de liaison des protéines et des ligands pour le criblage et l'optimisation des médicaments. Cependant, les études actuelles ne prennent pas en compte le rôle important des informations sur la surface moléculaire dans les interactions protéine-ligand. Sur cette base, des chercheurs de l'Université de Xiamen ont proposé un nouveau cadre d'extraction de caractéristiques multimodales (MFE), qui combine pour la première fois des informations sur la surface des protéines, la structure et la séquence 3D, et utilise un mécanisme d'attention croisée pour comparer différentes modalités. alignement. Les résultats expérimentaux démontrent que cette méthode atteint des performances de pointe dans la prédiction des affinités de liaison protéine-ligand. De plus, les études d’ablation démontrent l’efficacité et la nécessité des informations sur la surface des protéines et de l’alignement des caractéristiques multimodales dans ce cadre. Les recherches connexes commencent par "S

SK Hynix présentera de nouveaux produits liés à l'IA le 6 août : HBM3E à 12 couches, NAND à 321 hauteurs, etc.

Aug 01, 2024 pm 09:40 PM

SK Hynix présentera de nouveaux produits liés à l'IA le 6 août : HBM3E à 12 couches, NAND à 321 hauteurs, etc.

Aug 01, 2024 pm 09:40 PM

Selon les informations de ce site le 1er août, SK Hynix a publié un article de blog aujourd'hui (1er août), annonçant sa participation au Global Semiconductor Memory Summit FMS2024 qui se tiendra à Santa Clara, Californie, États-Unis, du 6 au 8 août, présentant de nombreuses nouvelles technologies de produit. Introduction au Future Memory and Storage Summit (FutureMemoryandStorage), anciennement Flash Memory Summit (FlashMemorySummit) principalement destiné aux fournisseurs de NAND, dans le contexte de l'attention croissante portée à la technologie de l'intelligence artificielle, cette année a été rebaptisée Future Memory and Storage Summit (FutureMemoryandStorage) pour invitez les fournisseurs de DRAM et de stockage et bien d’autres joueurs. Nouveau produit SK hynix lancé l'année dernière