Périphériques technologiques

Périphériques technologiques

IA

IA

Génération de scènes 3D : générez divers résultats à partir d'un seul échantillon sans aucune formation sur le réseau neuronal

Génération de scènes 3D : générez divers résultats à partir d'un seul échantillon sans aucune formation sur le réseau neuronal

Génération de scènes 3D : générez divers résultats à partir d'un seul échantillon sans aucune formation sur le réseau neuronal

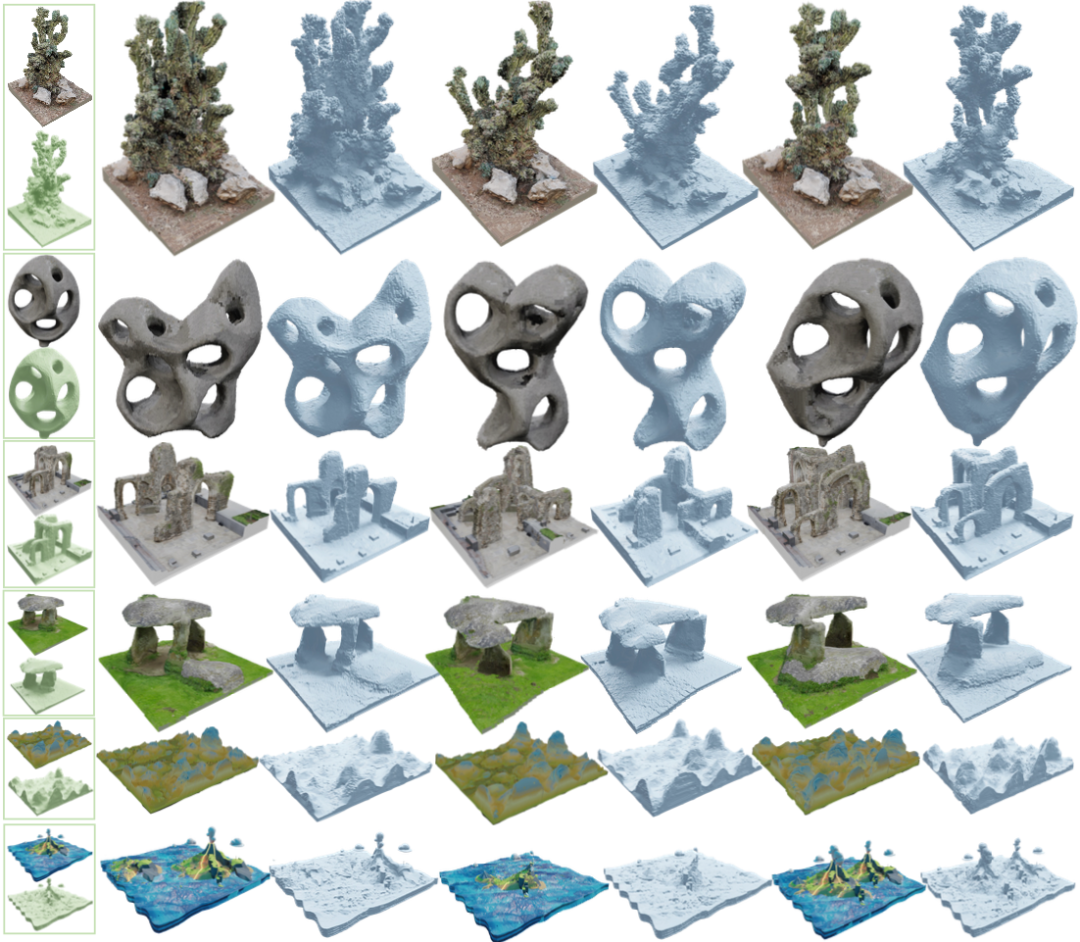

Résultats de génération de scènes tridimensionnelles diversifiés et de haute qualité

- Adresse papier : https://arxiv.org/abs/2304.12670

- Page d'accueil du projet : http:/ /weiyuli.xyz/Sin3DGen/

Introduction

Grâce à la génération de contenu assistée par intelligence artificielle (AIGC), de nombreux travaux ont vu le jour dans le domaine de la génération d'images, depuis les premiers auto-encodeurs variationnels (VAE) jusqu'aux génératifs. réseaux contradictoires (GAN)), puis au modèle de diffusion récemment populaire (modèle de diffusion), les capacités de génération de modèles se sont rapidement améliorées. Les modèles représentés par Stable Diffusion, Midjourney, etc. ont obtenu des résultats sans précédent en générant des images très réalistes. Dans le même temps, dans le domaine de la génération vidéo, de nombreux excellents travaux ont vu le jour récemment. Par exemple, le modèle génératif de Runway peut générer des clips vidéo imaginatifs. Ces applications ont considérablement abaissé le seuil de création de contenu, permettant à chacun de transformer facilement ses idées folles en réalité.

Cependant, à mesure que les médias porteurs de contenu deviennent de plus en plus abondants, les gens ne se contentent progressivement plus des contenus graphiques bidimensionnels tels que les images, les textes et les vidéos. Avec le développement continu de la technologie des jeux électroniques interactifs, en particulier la maturité progressive d'applications telles que la réalité virtuelle et augmentée, les gens espèrent de plus en plus interagir avec des scènes et des objets dans une perspective tridimensionnelle, ce qui entraîne le besoin d'un contenu tridimensionnel. Générer de plus grandes demandes.

Comment générer rapidement du contenu tridimensionnel de haute qualité avec une structure géométrique fine et une apparence très réaliste a toujours été une question clé explorée par les chercheurs de la communauté de l'infographie. La génération intelligente de contenu tridimensionnel via des ordinateurs peut aider à la production d'actifs numériques importants dans la production de jeux, de films et de télévision dans des applications de production réelles, réduisant considérablement le temps de développement du personnel de production artistique, réduisant considérablement les coûts d'acquisition d'actifs et raccourcissant le production globale Le cycle offre également des possibilités techniques aux utilisateurs pour apporter des milliers d'expériences visuelles personnalisées. Pour les utilisateurs ordinaires, l'émergence d'outils de création de contenu 3D rapides et pratiques, combinés à des applications telles que les imprimantes 3D de bureau, apporteront à l'avenir une imagination plus illimitée à la vie de divertissement des consommateurs ordinaires.

Actuellement, bien que les utilisateurs ordinaires puissent facilement créer du contenu 2D tel que des images et des vidéos via des appareils tels que des caméras portables, et puissent même modéliser et numériser des scènes 3D, en général, la création de contenu 3D de haute qualité nécessite souvent des professionnels expérimentés. utilisez des logiciels tels que 3ds Max, Maya, Blender, etc. pour modéliser et rendre manuellement, mais ceux-ci ont des coûts d'apprentissage élevés et des courbes de croissance abruptes.

L'une des principales raisons est que l'expression de contenus tridimensionnels est très complexe, comme les modèles géométriques, les cartes de textures ou les animations de squelettes de personnages. Même en termes d'expression géométrique, cela peut prendre diverses formes telles que des nuages de points, des voxels et des maillages. La complexité de l’expression tridimensionnelle limite considérablement la collecte ultérieure de données et la conception d’algorithmes.

D'un autre côté, les données 3D sont naturellement rares et le coût d'acquisition des données est élevé. Cela nécessite souvent des équipements coûteux et des processus de collecte complexes, et il est difficile de collecter une grande quantité de données 3D dans un format unifié. . Cela rend difficile l’utilisation de la plupart des modèles génératifs profonds basés sur les données.

Au niveau de l'algorithme, comment introduire les données tridimensionnelles collectées dans le modèle de calcul est également un problème difficile à résoudre. La puissance de calcul du traitement des données tridimensionnelles est exponentiellement supérieure à celle des données bidimensionnelles. L'extension violente de l'algorithme de génération bidimensionnelle à trois dimensions est difficile à traiter, même pour les processeurs informatiques parallèles les plus avancés, dans un délai acceptable.

Les raisons ci-dessus font que la plupart des travaux actuels de génération de contenu 3D sont limités à une catégorie spécifique ou ne peuvent générer que du contenu de résolution inférieure, ce qui est difficile à appliquer dans des processus de production réels.

Afin de résoudre les problèmes ci-dessus, L'équipe de Chen Baoquan de l'Université de Pékin s'est associée à des chercheurs de l'Université du Shandong et du Tencent AI Lab pour proposer la première méthode permettant de générer diverses scènes 3D de haute qualité basées sur un seul échantillon de scène. sans formation. Cet algorithme présente les avantages suivants :

1. Il ne nécessite pas de données d'entraînement similaires à grande échelle ni d'entraînement à long terme, et peut générer rapidement des scènes tridimensionnelles de haute qualité en utilisant un seul échantillon

;2, en utilisant des Plenoxels basés sur des champs de rayonnement neuronal comme expression tridimensionnelle, la scène a une apparence très réaliste et peut restituer des images photo-réalistes multi-perspectives. La scène générée conserve également parfaitement toutes les caractéristiques de l'échantillon, telles que l'effet de réflexion sur la surface de l'eau changeant avec l'angle de vue

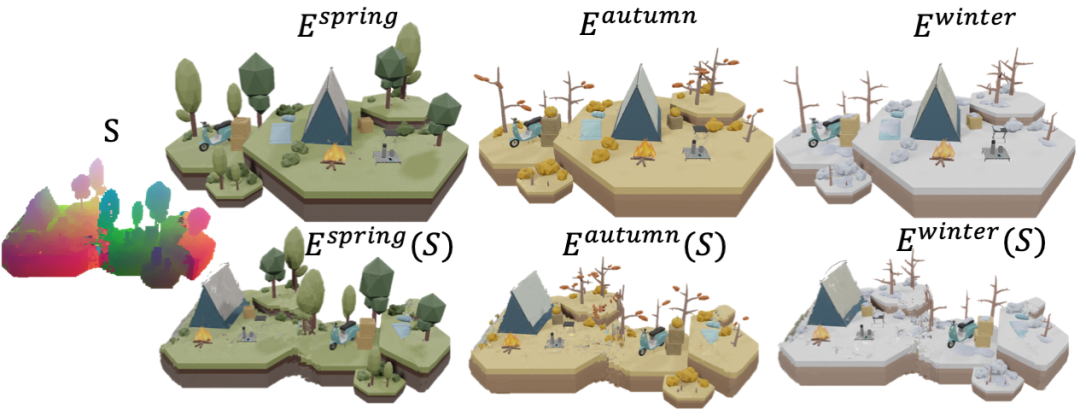

3, prend en charge une variété de scénarios de production d'applications, tels que l'édition de scènes 3D, redirection de taille, structure de la scène Analogie et changement d'apparence de la scène, etc.

Introduction à la méthode

Les chercheurs ont proposé un cadre de génération progressive multi-échelle, comme le montre la figure ci-dessous. L'idée principale de l'algorithme est de démanteler la scène échantillon en plusieurs blocs, d'introduire du bruit gaussien, puis de les réassembler en de nouvelles scènes similaires d'une manière similaire aux blocs de construction.

L'auteur utilise un champ de mappage de coordonnées, une expression hétérogène avec les échantillons, pour représenter la scène générée, rendant possible une génération de haute qualité. Afin de rendre plus robuste le processus d'optimisation de l'algorithme, cette étude propose également une méthode d'optimisation basée sur un mélange de valeurs et de coordonnées. Dans le même temps, afin de résoudre le problème de la consommation massive de ressources dans les calculs tridimensionnels, cette recherche utilise une stratégie d'optimisation précise à approximative, qui permet de générer de nouvelles scènes de haute qualité en quelques minutes sans aucune formation. Veuillez vous référer au document original pour plus de détails techniques.

Génération de scènes aléatoires

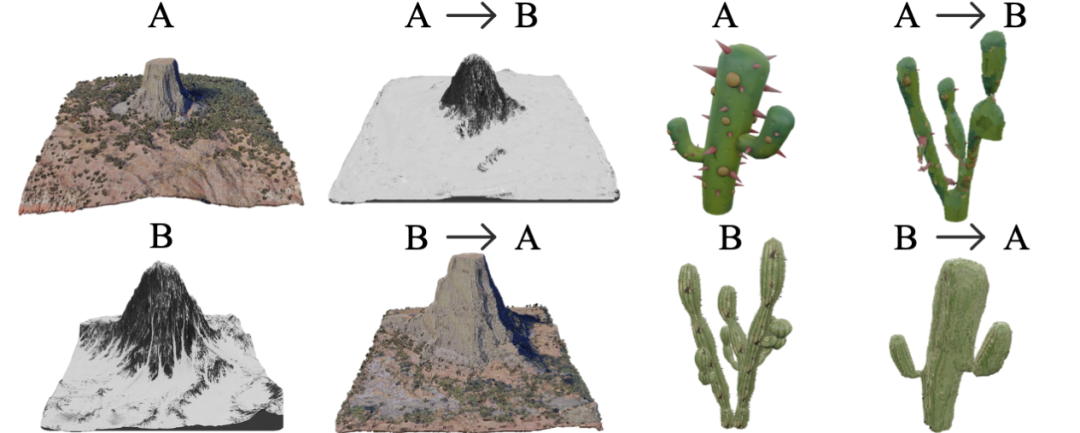

Avec un seul exemple de scène 3D comme celui de la case de gauche, vous pouvez rapidement générer de nouvelles scènes avec une géométrie complexe et une apparence réaliste . Cette méthode peut gérer des objets à topologie complexe, tels que des cactus, des arches et des bancs de pierre, et les scènes générées préservent parfaitement la géométrie fine et l'apparence de haute qualité des exemples de scènes. Aucun modèle génératif actuel basé sur les réseaux de neurones n’atteint une qualité et une diversité similaires.

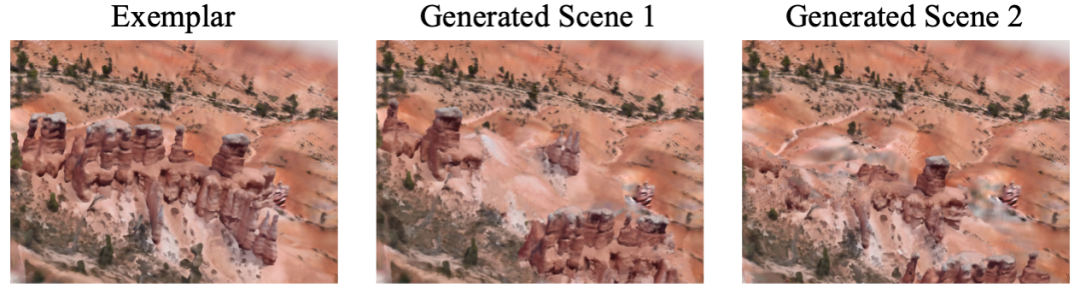

Génération de grandes scènes haute résolution

Cette méthode peut générer efficacement un contenu tridimensionnel extrêmement haute résolution. Comme indiqué ci-dessus, nous pouvons générer une partie « Milles de milles de rivières et de montagnes » d'une résolution de 1 328 x 512 x 200 en saisissant une seule partie des « Milles de milles de rivières et de montagnes » tridimensionnelles avec une résolution de 512 x 512 x. 200 dans le coin supérieur gauche et restituez des images multi-vues 2D 4096 x 1024 avec une haute résolution.

Génération de scènes sans frontières du monde réel

L'auteur a également vérifié la méthode de génération proposée sur des scènes naturelles réelles. En utilisant une méthode de traitement similaire à NeRF++, après avoir explicitement séparé le premier plan et l'arrière-plan tel que le ciel, et généré le contenu du premier plan séparément, de nouvelles scènes peuvent être générées dans des scènes sans bordures dans le monde réel.

Autres scénarios d'application

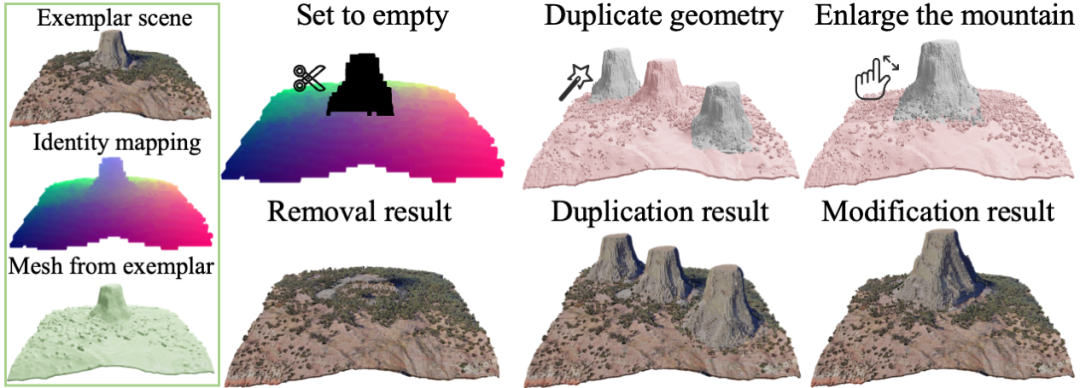

Édition de scène

En ajoutant des restrictions artificiellement spécifiées, les objets de la scène tridimensionnelle peuvent être supprimés et copiés et modifications et autres opérations d’édition. Comme le montre l'image, vous pouvez supprimer la montagne de la scène et remplir automatiquement les trous, la dupliquer pour créer trois sommets ou agrandir la montagne.

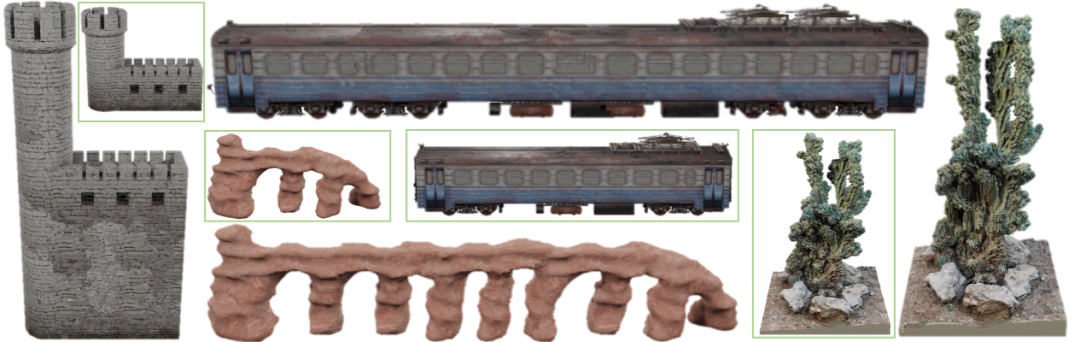

Redirection de taille

Cette méthode permet également d'étirer ou de comprimer un objet tridimensionnel tout en conservant sa forme locale. Le cadre vert de l'image montre l'exemple de scène original, qui allonge un train tridimensionnel tout en conservant la taille locale de la fenêtre.

génération d'analogie structurelle

Semblable au transfert de style d'image, étant donné deux scènes A et B, nous pouvons créer une scène qui a l'apparence et la géométrie de A Un nouveau scénario avec des fonctionnalités mais une structure similaire à B. Par exemple, nous pouvons nous référer à une montagne de neige pour transformer une autre montagne en une montagne de neige tridimensionnelle.

Changer l'exemple de scène

#🎜🎜 #

Summary

Ce travail s'oriente vers le domaine de la génération de contenu tridimensionnel. Pour la première fois, une scène naturelle tridimensionnelle. Un modèle de génération basé sur un échantillon unique est proposé. Résoudre les problèmes liés aux exigences de données volumineuses, à la surcharge de puissance de calcul élevée et à la mauvaise qualité de génération dans les méthodes de génération 3D actuelles. Ce travail se concentre sur des scènes naturelles plus générales avec une faible information sémantique, en accordant plus d'attention à la diversité et à la qualité du contenu généré. L'algorithme s'inspire principalement des technologies liées à la génération d'images de texture dans l'infographie traditionnelle et, combiné au récent champ de rayonnement neuronal, il peut générer rapidement des scènes tridimensionnelles de haute qualité et a démontré une variété d'applications pratiques.Future Outlook

Ce travail a une forte polyvalence et peut non seulement être combiné avec les expressions neuronales actuelles, mais également adapté aux pipelines de rendu traditionnels Géométrique expression, telle qu'un maillage polygonal (Mesh). Tandis que nous nous concentrons sur des données et des modèles volumineux, nous devrions également revoir de temps en temps les outils graphiques traditionnels. Les chercheurs pensent que dans un avenir proche, dans le domaine de l'AIGC 3D, les outils graphiques traditionnels combinés à des expressions neuronales de haute qualité et à des modèles de génération puissants créeront des étincelles plus brillantes, favorisant davantage la qualité et la vitesse de génération de contenu 3D et libérant la créativité des gens. .Cette recherche a été discutée par la majorité des internautes :

Certains internautes ont déclaré : (Cette recherche ) est idéal pour le développement de jeux, car il vous suffit de créer un seul modèle pour générer de nombreuses nouvelles versions.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

1359

1359

52

52

Open source! Au-delà de ZoeDepth ! DepthFM : estimation rapide et précise de la profondeur monoculaire !

Apr 03, 2024 pm 12:04 PM

Open source! Au-delà de ZoeDepth ! DepthFM : estimation rapide et précise de la profondeur monoculaire !

Apr 03, 2024 pm 12:04 PM

0. À quoi sert cet article ? Nous proposons DepthFM : un modèle d'estimation de profondeur monoculaire génératif de pointe, polyvalent et rapide. En plus des tâches traditionnelles d'estimation de la profondeur, DepthFM démontre également des capacités de pointe dans les tâches en aval telles que l'inpainting en profondeur. DepthFM est efficace et peut synthétiser des cartes de profondeur en quelques étapes d'inférence. Lisons ce travail ensemble ~ 1. Titre des informations sur l'article : DepthFM : FastMonocularDepthEstimationwithFlowMatching Auteur : MingGui, JohannesS.Fischer, UlrichPrestel, PingchuanMa, Dmytr

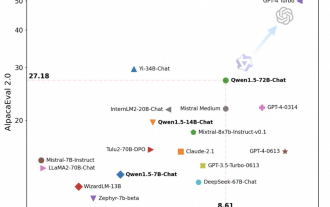

Tongyi Qianwen est à nouveau open source, Qwen1.5 propose six modèles de volume et ses performances dépassent GPT3.5

Feb 07, 2024 pm 10:15 PM

Tongyi Qianwen est à nouveau open source, Qwen1.5 propose six modèles de volume et ses performances dépassent GPT3.5

Feb 07, 2024 pm 10:15 PM

À temps pour la Fête du Printemps, la version 1.5 du modèle Tongyi Qianwen (Qwen) est en ligne. Ce matin, la nouvelle de la nouvelle version a attiré l'attention de la communauté IA. La nouvelle version du grand modèle comprend six tailles de modèle : 0,5B, 1,8B, 4B, 7B, 14B et 72B. Parmi eux, les performances de la version la plus puissante surpassent GPT3.5 et Mistral-Medium. Cette version inclut le modèle de base et le modèle Chat et fournit une prise en charge multilingue. L'équipe Tongyi Qianwen d'Alibaba a déclaré que la technologie pertinente avait également été lancée sur le site officiel de Tongyi Qianwen et sur l'application Tongyi Qianwen. De plus, la version actuelle de Qwen 1.5 présente également les points forts suivants : prend en charge une longueur de contexte de 32 Ko ; ouvre le point de contrôle du modèle Base+Chat ;

Abandonnez l'architecture codeur-décodeur et utilisez le modèle de diffusion pour la détection des contours avec de meilleurs résultats. L'Université nationale de technologie de la défense a proposé DiffusionEdge.

Feb 07, 2024 pm 10:12 PM

Abandonnez l'architecture codeur-décodeur et utilisez le modèle de diffusion pour la détection des contours avec de meilleurs résultats. L'Université nationale de technologie de la défense a proposé DiffusionEdge.

Feb 07, 2024 pm 10:12 PM

Les réseaux actuels de détection des contours profonds adoptent généralement une architecture d'encodeur-décodeur, qui contient des modules d'échantillonnage ascendant et descendant pour mieux extraire les fonctionnalités à plusieurs niveaux. Cependant, cette structure limite le réseau à produire des résultats de détection de contour précis et détaillés. En réponse à ce problème, un article sur AAAI2024 propose une nouvelle solution. Titre de la thèse : DiffusionEdge : DiffusionProbabilisticModelforCrispEdgeDetection Auteurs : Ye Yunfan (Université nationale de technologie de la défense), Xu Kai (Université nationale de technologie de la défense), Huang Yuxing (Université nationale de technologie de la défense), Yi Renjiao (Université nationale de technologie de la défense), Cai Zhiping (Université nationale de technologie de la défense) Lien vers l'article : https ://ar

Les grands modèles peuvent également être découpés, et Microsoft SliceGPT augmente considérablement l'efficacité de calcul de LAMA-2.

Jan 31, 2024 am 11:39 AM

Les grands modèles peuvent également être découpés, et Microsoft SliceGPT augmente considérablement l'efficacité de calcul de LAMA-2.

Jan 31, 2024 am 11:39 AM

Les grands modèles de langage (LLM) comportent généralement des milliards de paramètres et sont formés sur des milliards de jetons. Cependant, ces modèles sont très coûteux à former et à déployer. Afin de réduire les besoins de calcul, diverses techniques de compression de modèles sont souvent utilisées. Ces techniques de compression de modèles peuvent généralement être divisées en quatre catégories : distillation, décomposition tensorielle (y compris la factorisation de bas rang), élagage et quantification. Les méthodes d'élagage existent depuis un certain temps, mais beaucoup nécessitent un réglage fin de la récupération (RFT) après l'élagage pour maintenir les performances, ce qui rend l'ensemble du processus coûteux et difficile à faire évoluer. Des chercheurs de l'ETH Zurich et de Microsoft ont proposé une solution à ce problème appelée SliceGPT. L'idée principale de cette méthode est de réduire l'intégration du réseau en supprimant des lignes et des colonnes dans la matrice de pondération.

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas entre officiellement dans l’ère des robots électriques ! Hier, l'Atlas hydraulique s'est retiré "en larmes" de la scène de l'histoire. Aujourd'hui, Boston Dynamics a annoncé que l'Atlas électrique était au travail. Il semble que dans le domaine des robots humanoïdes commerciaux, Boston Dynamics soit déterminé à concurrencer Tesla. Après la sortie de la nouvelle vidéo, elle a déjà été visionnée par plus d’un million de personnes en seulement dix heures. Les personnes âgées partent et de nouveaux rôles apparaissent. C'est une nécessité historique. Il ne fait aucun doute que cette année est l’année explosive des robots humanoïdes. Les internautes ont commenté : Les progrès des robots ont fait ressembler la cérémonie d'ouverture de cette année à des êtres humains, et le degré de liberté est bien plus grand que celui des humains. Mais n'est-ce vraiment pas un film d'horreur ? Au début de la vidéo, Atlas est allongé calmement sur le sol, apparemment sur le dos. Ce qui suit est à couper le souffle

La vitalité de la super intelligence s'éveille ! Mais avec l'arrivée de l'IA qui se met à jour automatiquement, les mères n'ont plus à se soucier des goulots d'étranglement des données.

Apr 29, 2024 pm 06:55 PM

La vitalité de la super intelligence s'éveille ! Mais avec l'arrivée de l'IA qui se met à jour automatiquement, les mères n'ont plus à se soucier des goulots d'étranglement des données.

Apr 29, 2024 pm 06:55 PM

Je pleure à mort. Le monde construit à la folie de grands modèles. Les données sur Internet ne suffisent pas du tout. Le modèle de formation ressemble à « The Hunger Games », et les chercheurs en IA du monde entier se demandent comment nourrir ces personnes avides de données. Ce problème est particulièrement important dans les tâches multimodales. À une époque où rien ne pouvait être fait, une équipe de start-up du département de l'Université Renmin de Chine a utilisé son propre nouveau modèle pour devenir la première en Chine à faire de « l'auto-alimentation des données générées par le modèle » une réalité. De plus, il s’agit d’une approche à deux volets, du côté compréhension et du côté génération, les deux côtés peuvent générer de nouvelles données multimodales de haute qualité et fournir un retour de données au modèle lui-même. Qu'est-ce qu'un modèle ? Awaker 1.0, un grand modèle multimodal qui vient d'apparaître sur le Forum Zhongguancun. Qui est l'équipe ? Moteur Sophon. Fondé par Gao Yizhao, doctorant à la Hillhouse School of Artificial Intelligence de l’Université Renmin.

La version Kuaishou de Sora 'Ke Ling' est ouverte aux tests : génère plus de 120 s de vidéo, comprend mieux la physique et peut modéliser avec précision des mouvements complexes

Jun 11, 2024 am 09:51 AM

La version Kuaishou de Sora 'Ke Ling' est ouverte aux tests : génère plus de 120 s de vidéo, comprend mieux la physique et peut modéliser avec précision des mouvements complexes

Jun 11, 2024 am 09:51 AM

Quoi? Zootopie est-elle concrétisée par l’IA domestique ? Avec la vidéo est exposé un nouveau modèle de génération vidéo domestique à grande échelle appelé « Keling ». Sora utilise une voie technique similaire et combine un certain nombre d'innovations technologiques auto-développées pour produire des vidéos qui comportent non seulement des mouvements larges et raisonnables, mais qui simulent également les caractéristiques du monde physique et possèdent de fortes capacités de combinaison conceptuelle et d'imagination. Selon les données, Keling prend en charge la génération de vidéos ultra-longues allant jusqu'à 2 minutes à 30 ips, avec des résolutions allant jusqu'à 1080p, et prend en charge plusieurs formats d'image. Un autre point important est que Keling n'est pas une démo ou une démonstration de résultats vidéo publiée par le laboratoire, mais une application au niveau produit lancée par Kuaishou, un acteur leader dans le domaine de la vidéo courte. De plus, l'objectif principal est d'être pragmatique, de ne pas faire de chèques en blanc et de se mettre en ligne dès sa sortie. Le grand modèle de Ke Ling est déjà sorti à Kuaiying.

L'US Air Force présente son premier avion de combat IA de grande envergure ! Le ministre a personnellement effectué l'essai routier sans intervenir pendant tout le processus, et 100 000 lignes de code ont été testées 21 fois.

May 07, 2024 pm 05:00 PM

L'US Air Force présente son premier avion de combat IA de grande envergure ! Le ministre a personnellement effectué l'essai routier sans intervenir pendant tout le processus, et 100 000 lignes de code ont été testées 21 fois.

May 07, 2024 pm 05:00 PM

Récemment, le milieu militaire a été submergé par la nouvelle : les avions de combat militaires américains peuvent désormais mener des combats aériens entièrement automatiques grâce à l'IA. Oui, tout récemment, l’avion de combat IA de l’armée américaine a été rendu public pour la première fois, dévoilant ainsi son mystère. Le nom complet de ce chasseur est Variable Stability Simulator Test Aircraft (VISTA). Il a été personnellement piloté par le secrétaire de l'US Air Force pour simuler une bataille aérienne en tête-à-tête. Le 2 mai, le secrétaire de l'US Air Force, Frank Kendall, a décollé à bord d'un X-62AVISTA à la base aérienne d'Edwards. Notez que pendant le vol d'une heure, toutes les actions de vol ont été effectuées de manière autonome par l'IA ! Kendall a déclaré : "Au cours des dernières décennies, nous avons réfléchi au potentiel illimité du combat air-air autonome, mais cela a toujours semblé hors de portée." Mais maintenant,