Périphériques technologiques

Périphériques technologiques

IA

IA

En ajoutant des fonctionnalités audiovisuelles complètes à de grands modèles de langage, DAMO Academy ouvre la source Video-LLaMA

En ajoutant des fonctionnalités audiovisuelles complètes à de grands modèles de langage, DAMO Academy ouvre la source Video-LLaMA

En ajoutant des fonctionnalités audiovisuelles complètes à de grands modèles de langage, DAMO Academy ouvre la source Video-LLaMA

La vidéo joue un rôle de plus en plus important dans la culture des médias sociaux et Internet d'aujourd'hui. Douyin, Kuaishou, Bilibili, etc. sont devenus des plateformes populaires pour des centaines de millions d'utilisateurs. Les utilisateurs partagent leurs moments de vie, leurs œuvres créatives, leurs moments intéressants et d'autres contenus autour de vidéos pour interagir et communiquer avec les autres.

Récemment, de grands modèles de langage ont démontré des capacités impressionnantes. Peut-on équiper les grands modèles d’« yeux » et d’« oreilles » pour qu’ils puissent comprendre les vidéos et interagir avec les utilisateurs ?

Partant de ce problème, des chercheurs de la DAMO Academy ont proposé Video-LLaMA, un grand modèle doté de capacités audiovisuelles complètes. Video-LLaMA peut percevoir et comprendre les signaux vidéo et audio dans les vidéos, et peut comprendre les instructions de saisie de l'utilisateur pour effectuer une série de tâches complexes basées sur l'audio et la vidéo, telles que la description audio/vidéo, l'écriture, les questions et réponses, etc. Actuellement, les articles, les codes et les démos interactives sont tous ouverts. De plus, sur la page d'accueil du projet Video-LLaMA, l'équipe de recherche propose également une version chinoise du modèle pour rendre l'expérience des utilisateurs chinois plus fluide.

- Lien papier : https://arxiv.org/abs/2306.02858

- Adresse du code : https://github.com/DAMO-NLP-SG/Video- LLaMA

- Adresse de démonstration :

- Modelscope : https://modelscope.cn/studios/damo/video-llama/summary

- Huggingface : https : //huggingface.co/spaces/DAMO-NLP-SG/Video-LLaMA

- Exemple d'adresse du fichier d'entrée :

- https://www.php.cn/link/0fbce6c74ff376d18cb352e7fdc627 3b

Conception de modèle

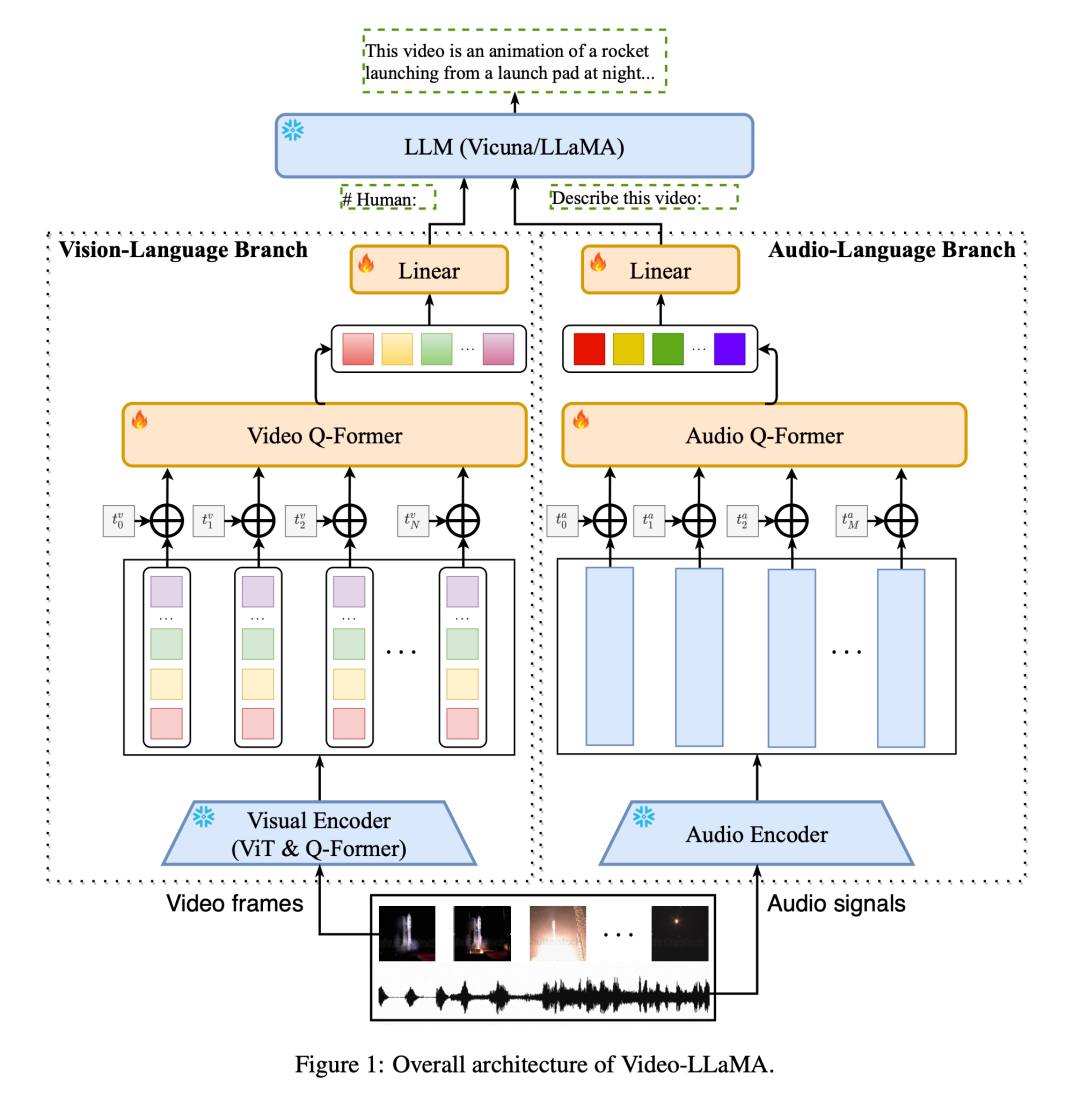

Video-LLaMA adopte des principes de conception modulaire pour mapper les informations modales visuelles et audio de la vidéo à l'espace d'entrée du grand modèle de langage afin d'obtenir la capacité de suivre des instructions intermodales. Contrairement aux recherches précédentes sur de grands modèles (MiNIGPT4, LLaVA) axées sur la compréhension des images statiques, Video-LLaMA est confrontée à deux défis en matière de compréhension vidéo : capturer les changements dynamiques de scène dans la vision et intégrer les signaux audiovisuels.

Pour capturer les changements de scène dynamiques dans les vidéos, Video-LLaMA introduit une branche de langage visuel enfichable. Cette branche utilise d'abord l'encodeur d'image pré-entraîné dans BLIP-2 pour obtenir les caractéristiques individuelles de chaque image d'image, puis la combine avec l'intégration de position d'image correspondante. Toutes les caractéristiques de l'image sont envoyées à Video Q-Former et Video Q. -Former regroupera les représentations d'images au niveau de l'image et générera des représentations vidéo synthétiques de longueur fixe. Enfin, une couche linéaire est utilisée pour aligner la représentation vidéo sur l'espace d'intégration du grand modèle de langage.

Quant aux signaux sonores dans la vidéo, Video-LLaMA utilise la branche audio-langage pour le traitement. Tout d'abord, plusieurs clips audio de deux secondes sont uniformément échantillonnés à partir de la vidéo originale et chaque clip est converti en un spectrogramme Mel à 128 dimensions. Ensuite, le puissant ImageBind est utilisé comme encodeur audio pour extraire les caractéristiques de chaque clip audio individuellement. Après avoir ajouté des intégrations positionnelles apprenables, Audio Q-Former regroupe les fonctionnalités de segment dans leur ensemble et génère des fonctionnalités audio de longueur fixe. Semblable à la branche du langage visuel, une couche linéaire est finalement utilisée pour aligner la représentation audio sur l'espace d'intégration du grand modèle de langage.

Afin de réduire les coûts de formation, Video-LLaMA fige l'encodeur image/audio pré-entraîné et met à jour uniquement les paramètres suivants dans les branches visuelles et audio : Vidéo/Audio Q-Former, couche d'encodage positionnel et couche linéaire ( Comme le montre la figure 1).

Pour apprendre la relation d'alignement entre la vision et le texte, les auteurs ont d'abord pré-entraîné la branche vision à l'aide d'un ensemble de données vidéo-texte à grande échelle (WebVid-2M) et d'un ensemble de données image-texte (CC-595K). Ensuite, les auteurs ont utilisé des ensembles de données de commandes d'image de MiniGPT-4, LLaVA et des ensembles de données de commandes vidéo de Video-Chat pour affiner afin d'obtenir de meilleures capacités de suivi de commandes intermodales.

En ce qui concerne l'apprentissage des relations d'alignement audio-texte, en raison du manque de données audio-texte à grande échelle et de haute qualité, les auteurs ont adopté une stratégie de contournement pour atteindre cet objectif. Premièrement, l’objectif des paramètres apprenables dans la branche audio-linguistique peut être compris comme l’alignement de la sortie de l’encodeur audio avec l’espace d’intégration du LLM. L'encodeur audio ImageBind possède une très forte capacité d'alignement multimodal, qui peut aligner les intégrations de différentes modalités dans un espace commun. Par conséquent, les auteurs utilisent des données de texte visuel pour entraîner la branche du langage audio, en alignant l'espace d'intégration commun d'ImageBind sur l'espace d'intégration de texte de LLM, obtenant ainsi une modalité audio sur l'alignement de l'espace d'intégration de texte LLM. De cette manière intelligente, Video-LLaMA est capable de démontrer sa capacité à comprendre l'audio lors de l'inférence, même s'il n'a jamais été formé sur des données audio.

Exemple de démonstration

L'auteur montre quelques exemples de dialogue vidéo/audio/image Video-LLaMA.

(1) Les deux exemples suivants démontrent les capacités de perception audiovisuelle complètes de Video-LLaMA. La conversation dans l'exemple tourne autour de l'audio-vidéo. Dans l'exemple 2, seul l'artiste est affiché à l'écran, mais le son est constitué des acclamations et des applaudissements du public. Si le modèle ne peut recevoir que des signaux visuels, il ne pourra pas déduire la réponse positive du public. aucun son d'instruments de musique dans l'audio. Mais il y a un saxophone dans l'image. Si le modèle ne peut recevoir que des signaux auditifs, il ne saura pas que le joueur a joué du saxophone.

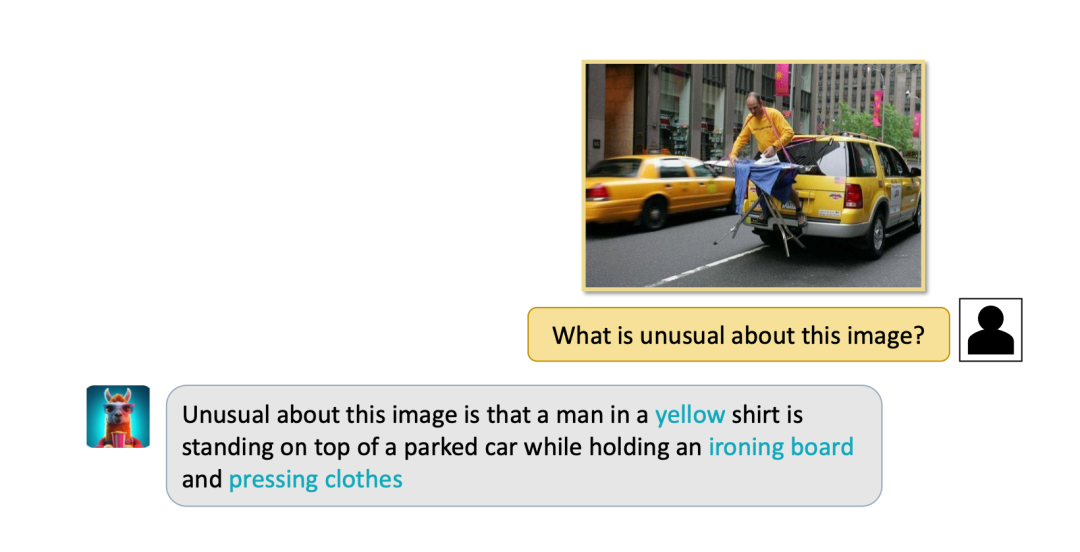

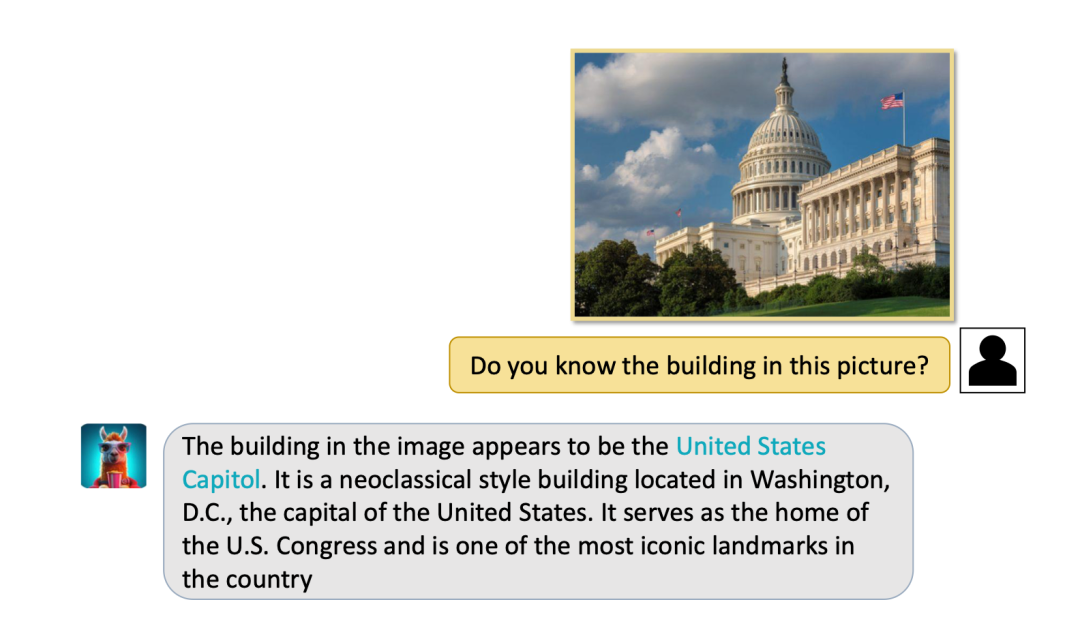

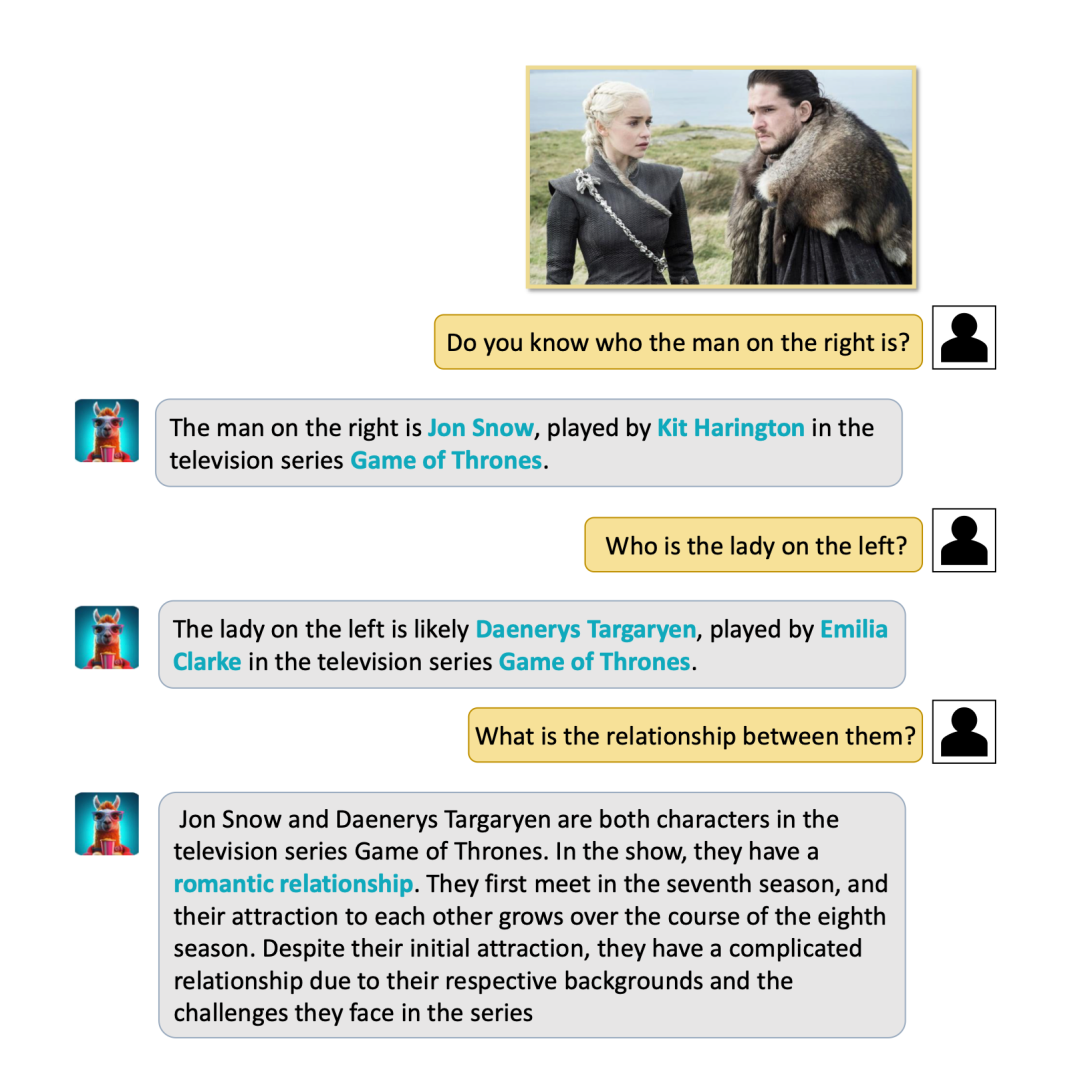

(2) Video-LLaMA possède également de fortes capacités de compréhension perceptuelle des images statiques et peut effectuer des tâches telles que la description d'une image, des questions et réponses, etc.

(3) Étonnamment, Video-LLaMA peut identifier avec succès des monuments et des personnes célèbres et poser des questions et réponses de bon sens. Par exemple, VIdeo-LLaMA ci-dessous a réussi à identifier la Maison Blanche et à présenter la situation de la Maison Blanche. Un autre exemple est la saisie d'une photo de Long Ma et Jon Snow (personnages du film et de la série télévisée classiques "Game of Thrones"). VIdeo-LLaMA peut non seulement les identifier, mais aussi leur parler de leur relation qui est constamment en cours. édité et foiré.

(4) Video-llama peut également capturer des événements dynamiques dans la vidéo, tels que le mouvement des cris et la direction du bateau.

Résumé

À l'heure actuelle, la compréhension de l'audio et de la vidéo reste un problème de recherche très complexe sans solution mature. Bien que Video-LLaMA ait montré des capacités impressionnantes, l'auteur a également mentionné qu'il présente certaines limites.

(1) Capacité de perception limitée : Les capacités visuelles et auditives de Video-LLaMA sont encore relativement rudimentaires, et il est encore difficile d'identifier des informations visuelles et sonores complexes. Cela s’explique en partie par le fait que la qualité et la taille des ensembles de données ne sont pas suffisantes. Ce groupe de recherche travaille dur pour créer un ensemble de données d'alignement audio-vidéo-texte de haute qualité afin d'améliorer les capacités de perception du modèle.

(2) Difficulté à traiter de longues vidéos : les vidéos longues (telles que les films et les émissions de télévision) contiennent une grande quantité d'informations, ce qui nécessite des capacités de raisonnement et des ressources informatiques élevées pour le modèle.

(3) Le problème d'hallucination inhérent aux modèles de langage existe toujours dans Video-LLaMA.

En général, Video-LLaMA, en tant que grand modèle doté de capacités audiovisuelles complètes, a obtenu des résultats impressionnants dans le domaine de la compréhension audio et vidéo. À mesure que les chercheurs continuent de travailler dur, les défis ci-dessus seront surmontés un par un, ce qui donnera au modèle de compréhension audio et vidéo une grande valeur pratique.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

1359

1359

52

52

Le modèle MoE open source le plus puissant au monde est ici, avec des capacités chinoises comparables à celles du GPT-4, et le prix ne représente que près d'un pour cent de celui du GPT-4-Turbo.

May 07, 2024 pm 04:13 PM

Le modèle MoE open source le plus puissant au monde est ici, avec des capacités chinoises comparables à celles du GPT-4, et le prix ne représente que près d'un pour cent de celui du GPT-4-Turbo.

May 07, 2024 pm 04:13 PM

Imaginez un modèle d'intelligence artificielle qui non seulement a la capacité de surpasser l'informatique traditionnelle, mais qui permet également d'obtenir des performances plus efficaces à moindre coût. Ce n'est pas de la science-fiction, DeepSeek-V2[1], le modèle MoE open source le plus puissant au monde est ici. DeepSeek-V2 est un puissant mélange de modèle de langage d'experts (MoE) présentant les caractéristiques d'une formation économique et d'une inférence efficace. Il est constitué de 236B paramètres, dont 21B servent à activer chaque marqueur. Par rapport à DeepSeek67B, DeepSeek-V2 offre des performances plus élevées, tout en économisant 42,5 % des coûts de formation, en réduisant le cache KV de 93,3 % et en augmentant le débit de génération maximal à 5,76 fois. DeepSeek est une entreprise explorant l'intelligence artificielle générale

KAN, qui remplace MLP, a été étendu à la convolution par des projets open source

Jun 01, 2024 pm 10:03 PM

KAN, qui remplace MLP, a été étendu à la convolution par des projets open source

Jun 01, 2024 pm 10:03 PM

Plus tôt ce mois-ci, des chercheurs du MIT et d'autres institutions ont proposé une alternative très prometteuse au MLP – KAN. KAN surpasse MLP en termes de précision et d’interprétabilité. Et il peut surpasser le MLP fonctionnant avec un plus grand nombre de paramètres avec un très petit nombre de paramètres. Par exemple, les auteurs ont déclaré avoir utilisé KAN pour reproduire les résultats de DeepMind avec un réseau plus petit et un degré d'automatisation plus élevé. Plus précisément, le MLP de DeepMind compte environ 300 000 paramètres, tandis que le KAN n'en compte qu'environ 200. KAN a une base mathématique solide comme MLP est basé sur le théorème d'approximation universelle, tandis que KAN est basé sur le théorème de représentation de Kolmogorov-Arnold. Comme le montre la figure ci-dessous, KAN a

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas entre officiellement dans l’ère des robots électriques ! Hier, l'Atlas hydraulique s'est retiré "en larmes" de la scène de l'histoire. Aujourd'hui, Boston Dynamics a annoncé que l'Atlas électrique était au travail. Il semble que dans le domaine des robots humanoïdes commerciaux, Boston Dynamics soit déterminé à concurrencer Tesla. Après la sortie de la nouvelle vidéo, elle a déjà été visionnée par plus d’un million de personnes en seulement dix heures. Les personnes âgées partent et de nouveaux rôles apparaissent. C'est une nécessité historique. Il ne fait aucun doute que cette année est l’année explosive des robots humanoïdes. Les internautes ont commenté : Les progrès des robots ont fait ressembler la cérémonie d'ouverture de cette année à des êtres humains, et le degré de liberté est bien plus grand que celui des humains. Mais n'est-ce vraiment pas un film d'horreur ? Au début de la vidéo, Atlas est allongé calmement sur le sol, apparemment sur le dos. Ce qui suit est à couper le souffle

L'IA bouleverse la recherche mathématique ! Le lauréat de la médaille Fields et mathématicien sino-américain a dirigé 11 articles les mieux classés | Aimé par Terence Tao

Apr 09, 2024 am 11:52 AM

L'IA bouleverse la recherche mathématique ! Le lauréat de la médaille Fields et mathématicien sino-américain a dirigé 11 articles les mieux classés | Aimé par Terence Tao

Apr 09, 2024 am 11:52 AM

L’IA change effectivement les mathématiques. Récemment, Tao Zhexuan, qui a prêté une attention particulière à cette question, a transmis le dernier numéro du « Bulletin de l'American Mathematical Society » (Bulletin de l'American Mathematical Society). En se concentrant sur le thème « Les machines changeront-elles les mathématiques ? », de nombreux mathématiciens ont exprimé leurs opinions. L'ensemble du processus a été plein d'étincelles, intense et passionnant. L'auteur dispose d'une équipe solide, comprenant Akshay Venkatesh, lauréat de la médaille Fields, le mathématicien chinois Zheng Lejun, l'informaticien de l'Université de New York Ernest Davis et de nombreux autres universitaires bien connus du secteur. Le monde de l’IA a radicalement changé. Vous savez, bon nombre de ces articles ont été soumis il y a un an.

Google est ravi : les performances de JAX surpassent Pytorch et TensorFlow ! Cela pourrait devenir le choix le plus rapide pour la formation à l'inférence GPU

Apr 01, 2024 pm 07:46 PM

Google est ravi : les performances de JAX surpassent Pytorch et TensorFlow ! Cela pourrait devenir le choix le plus rapide pour la formation à l'inférence GPU

Apr 01, 2024 pm 07:46 PM

Les performances de JAX, promu par Google, ont dépassé celles de Pytorch et TensorFlow lors de récents tests de référence, se classant au premier rang sur 7 indicateurs. Et le test n’a pas été fait sur le TPU présentant les meilleures performances JAX. Bien que parmi les développeurs, Pytorch soit toujours plus populaire que Tensorflow. Mais à l’avenir, des modèles plus volumineux seront peut-être formés et exécutés sur la base de la plate-forme JAX. Modèles Récemment, l'équipe Keras a comparé trois backends (TensorFlow, JAX, PyTorch) avec l'implémentation native de PyTorch et Keras2 avec TensorFlow. Premièrement, ils sélectionnent un ensemble de

Les robots Tesla travaillent dans les usines, Musk : Le degré de liberté des mains atteindra 22 cette année !

May 06, 2024 pm 04:13 PM

Les robots Tesla travaillent dans les usines, Musk : Le degré de liberté des mains atteindra 22 cette année !

May 06, 2024 pm 04:13 PM

La dernière vidéo du robot Optimus de Tesla est sortie, et il peut déjà fonctionner en usine. À vitesse normale, il trie les batteries (les batteries 4680 de Tesla) comme ceci : Le responsable a également publié à quoi cela ressemble à une vitesse 20 fois supérieure - sur un petit "poste de travail", en sélectionnant et en sélectionnant et en sélectionnant : Cette fois, il est publié L'un des points forts de la vidéo est qu'Optimus réalise ce travail en usine, de manière totalement autonome, sans intervention humaine tout au long du processus. Et du point de vue d'Optimus, il peut également récupérer et placer la batterie tordue, en se concentrant sur la correction automatique des erreurs : concernant la main d'Optimus, le scientifique de NVIDIA Jim Fan a donné une évaluation élevée : la main d'Optimus est l'un des robots à cinq doigts du monde. le plus adroit. Ses mains ne sont pas seulement tactiles

FisheyeDetNet : le premier algorithme de détection de cible basé sur une caméra fisheye

Apr 26, 2024 am 11:37 AM

FisheyeDetNet : le premier algorithme de détection de cible basé sur une caméra fisheye

Apr 26, 2024 am 11:37 AM

La détection de cibles est un problème relativement mature dans les systèmes de conduite autonome, parmi lesquels la détection des piétons est l'un des premiers algorithmes à être déployés. Des recherches très complètes ont été menées dans la plupart des articles. Cependant, la perception de la distance à l’aide de caméras fisheye pour une vue panoramique est relativement moins étudiée. En raison de la distorsion radiale importante, la représentation standard du cadre de délimitation est difficile à mettre en œuvre dans les caméras fisheye. Pour alléger la description ci-dessus, nous explorons les conceptions étendues de boîtes englobantes, d'ellipses et de polygones généraux dans des représentations polaires/angulaires et définissons une métrique de segmentation d'instance mIOU pour analyser ces représentations. Le modèle fisheyeDetNet proposé avec une forme polygonale surpasse les autres modèles et atteint simultanément 49,5 % de mAP sur l'ensemble de données de la caméra fisheye Valeo pour la conduite autonome.

Une seule carte exécute Llama 70B plus rapidement que deux cartes, Microsoft vient de mettre le FP6 dans l'Open source A100 |

Apr 29, 2024 pm 04:55 PM

Une seule carte exécute Llama 70B plus rapidement que deux cartes, Microsoft vient de mettre le FP6 dans l'Open source A100 |

Apr 29, 2024 pm 04:55 PM

Le FP8 et la précision de quantification inférieure en virgule flottante ne sont plus le « brevet » du H100 ! Lao Huang voulait que tout le monde utilise INT8/INT4, et l'équipe Microsoft DeepSpeed a commencé à exécuter FP6 sur A100 sans le soutien officiel de NVIDIA. Les résultats des tests montrent que la quantification FP6 de la nouvelle méthode TC-FPx sur A100 est proche ou parfois plus rapide que celle de INT4, et a une précision supérieure à celle de cette dernière. En plus de cela, il existe également une prise en charge de bout en bout des grands modèles, qui ont été open source et intégrés dans des cadres d'inférence d'apprentissage profond tels que DeepSpeed. Ce résultat a également un effet immédiat sur l'accélération des grands modèles : dans ce cadre, en utilisant une seule carte pour exécuter Llama, le débit est 2,65 fois supérieur à celui des cartes doubles. un