Périphériques technologiques

Périphériques technologiques

IA

IA

2,8 millions de paires commande-réponse multimodales, communes en huit langues, le premier ensemble de données de commande couvrant le contenu vidéo MIMIC-IT est là

2,8 millions de paires commande-réponse multimodales, communes en huit langues, le premier ensemble de données de commande couvrant le contenu vidéo MIMIC-IT est là

2,8 millions de paires commande-réponse multimodales, communes en huit langues, le premier ensemble de données de commande couvrant le contenu vidéo MIMIC-IT est là

Ces derniers temps, les assistants de dialogue IA ont fait des progrès considérables dans les tâches linguistiques. Cette amélioration significative ne repose pas seulement sur la forte capacité de généralisation du LLM, mais doit également être attribuée au réglage des instructions. Cela implique d'affiner le LLM sur une gamme de tâches grâce à un enseignement diversifié et de haute qualité.

L'une des raisons potentielles pour atteindre des performances nulles avec le réglage des instructions est qu'il internalise le contexte. Ceci est particulièrement important lorsque la saisie de l'utilisateur ignore le contexte du bon sens. En intégrant le réglage des instructions, LLM acquiert un haut niveau de compréhension de l'intention de l'utilisateur et présente de meilleures capacités de tir zéro, même dans des tâches inédites.

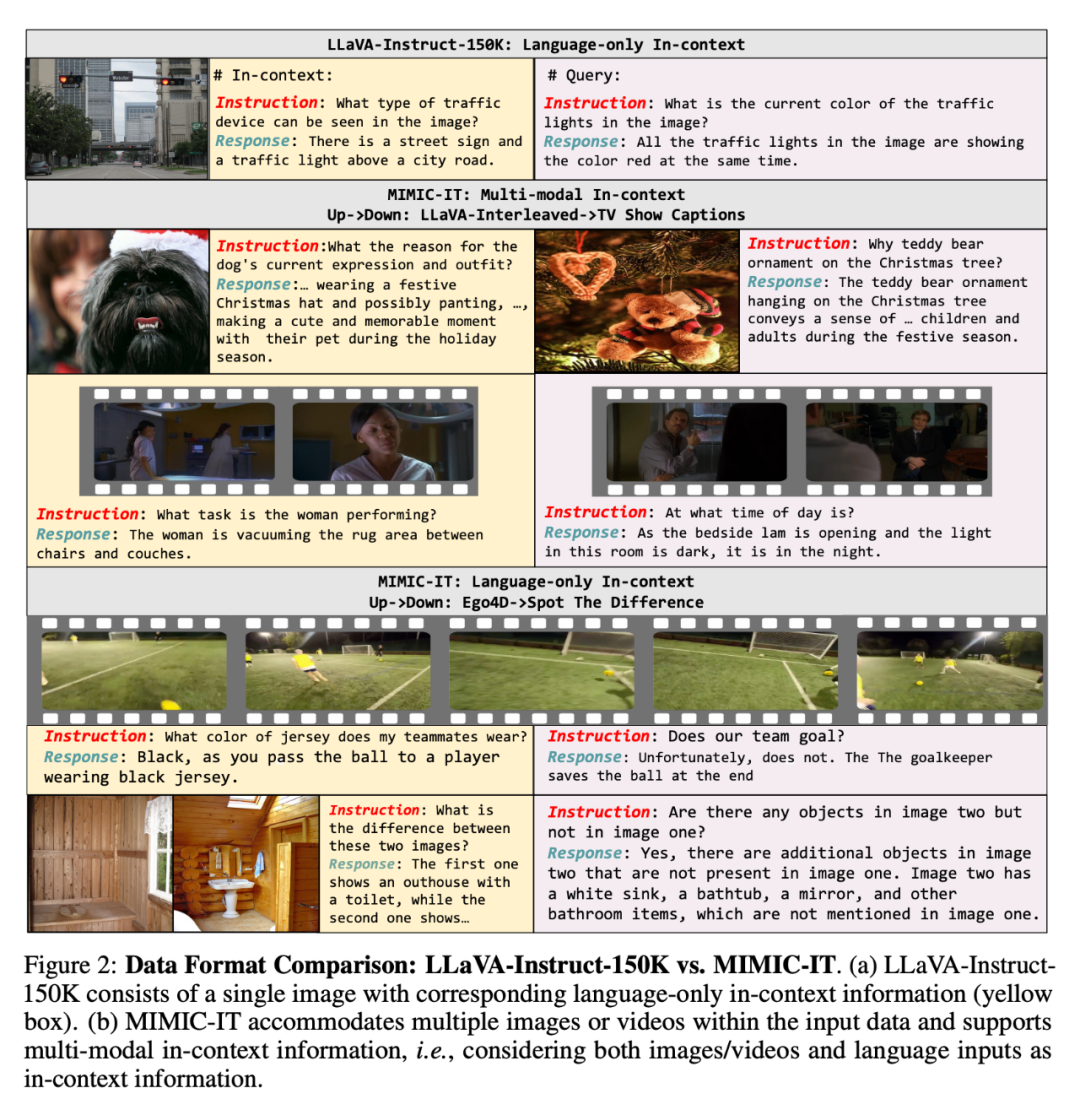

Cependant, un assistant conversationnel IA idéal devrait être capable de résoudre des tâches impliquant plusieurs modalités. Cela nécessite l’obtention d’un ensemble de données de suivi d’instructions multimodales diversifiées et de haute qualité. Par exemple, l'ensemble de données LLaVAInstruct-150K (également connu sous le nom de LLaVA) est un ensemble de données de suivi d'instructions visuo-verbales couramment utilisé, qui utilise des images COCO, des instructions et des réponses basées sur des légendes d'images et des cadres de délimitation cibles obtenus à partir de GPT-4 Constructed. Cependant, LLaVA-Instruct-150K présente trois limites : une diversité visuelle limitée ; l'utilisation d'images comme données visuelles uniques et d'informations contextuelles contenant uniquement la morphologie du langage ;

Afin de promouvoir les assistants de dialogue IA pour briser ces limitations, des chercheurs de l'Université technologique de Nanyang à Singapour et de Microsoft Research Redmond ont proposé l'ensemble de données de réglage des instructions contextuelles multimodales MIMIC-IT, qui contient 2,8 millions d'éléments contextuels multimodaux. instructions - un ensemble de données de paires correspondantes couvrant une variété de scénarios réels.

Adresse papier : https://arxiv.org/pdf/2306.05425.pdf

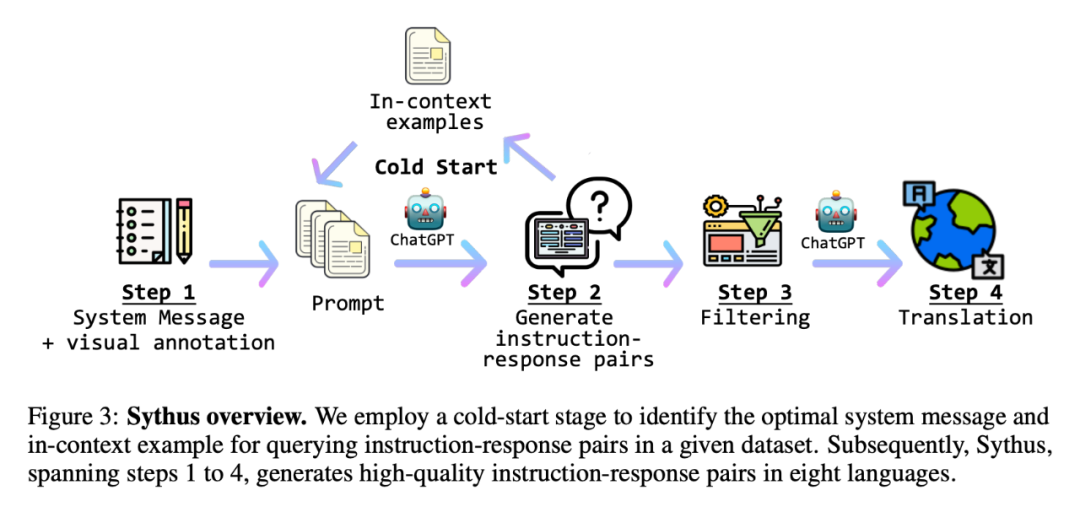

De plus, afin de générer efficacement des paires commande-réponse, le chercheur a également introduit "Sythus " , une instruction inspirée de la méthode d'auto-instruction - un pipeline automatisé qui répond aux commentaires. Sythus utilise des informations système, des annotations visuelles et des exemples en contexte pour guider un modèle de langage (GPT-4 ou ChatGPT) afin de générer des paires commande-réponse basées sur le contexte visuel, ciblant les trois capacités fondamentales des modèles de langage visuel : la perception, le raisonnement et planification. De plus, les commandes et réponses en anglais sont traduites en sept langues pour prendre en charge une utilisation multilingue.

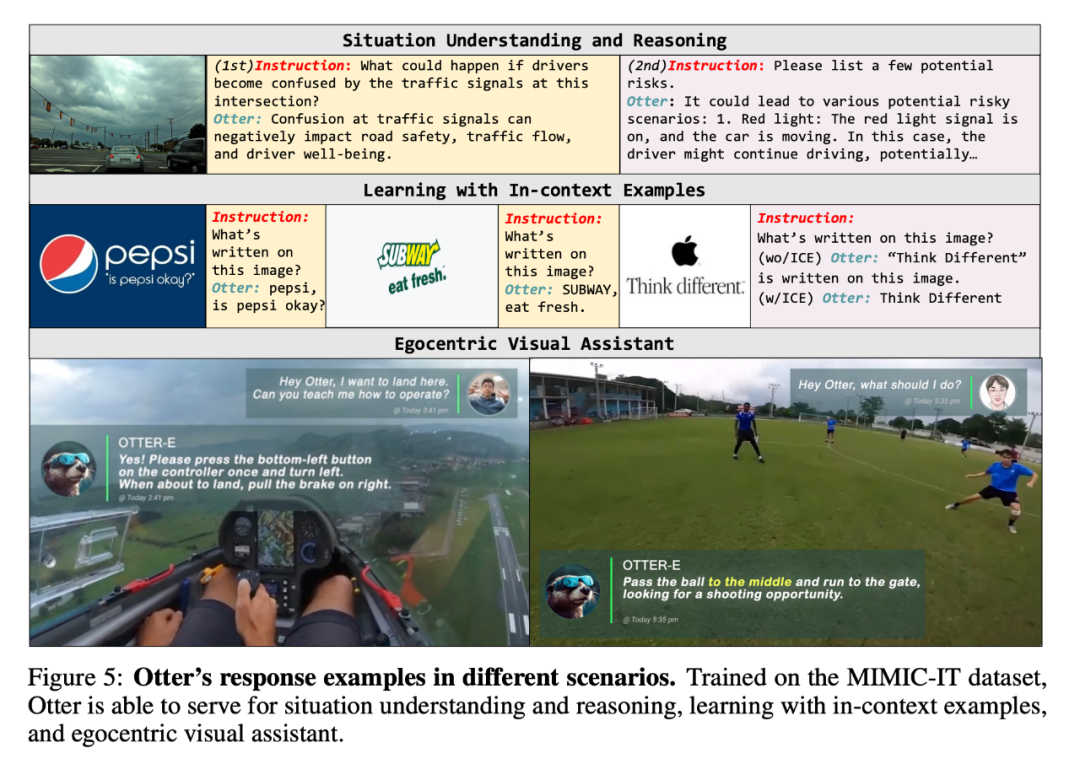

Il convient particulièrement de noter que les chercheurs ont formé le modèle multimodal "Otter" basé sur OpenFlamingo sur MIMIC-IT. Évaluées à la fois sur ChatGPT et sur les humains, les capacités multimodales d'Otter surpassent les autres modèles de langage visuel récents.

Dans une série de démos, les chercheurs ont démontré les capacités de questions et réponses multimodales d'Otter :

Q : Quelle carte sera jouée ensuite ?

A : Huit tubes. De cette façon, vous pouvez garder les quatre et les cinq en attendant une quinte.

Q : Je veux atterrir, que dois-je faire ?

A : Appuyez une fois sur le bouton inférieur gauche pour tourner à gauche, et lorsque vous souhaitez atterrir, tirez le frein à main à droite.

Q : Et ensuite ?

A : Passez le ballon au centre, courez vers le but et cherchez les opportunités de marquer.

Ensuite, regardons les détails de l'étude.

Ensemble de données MIMIC-IT

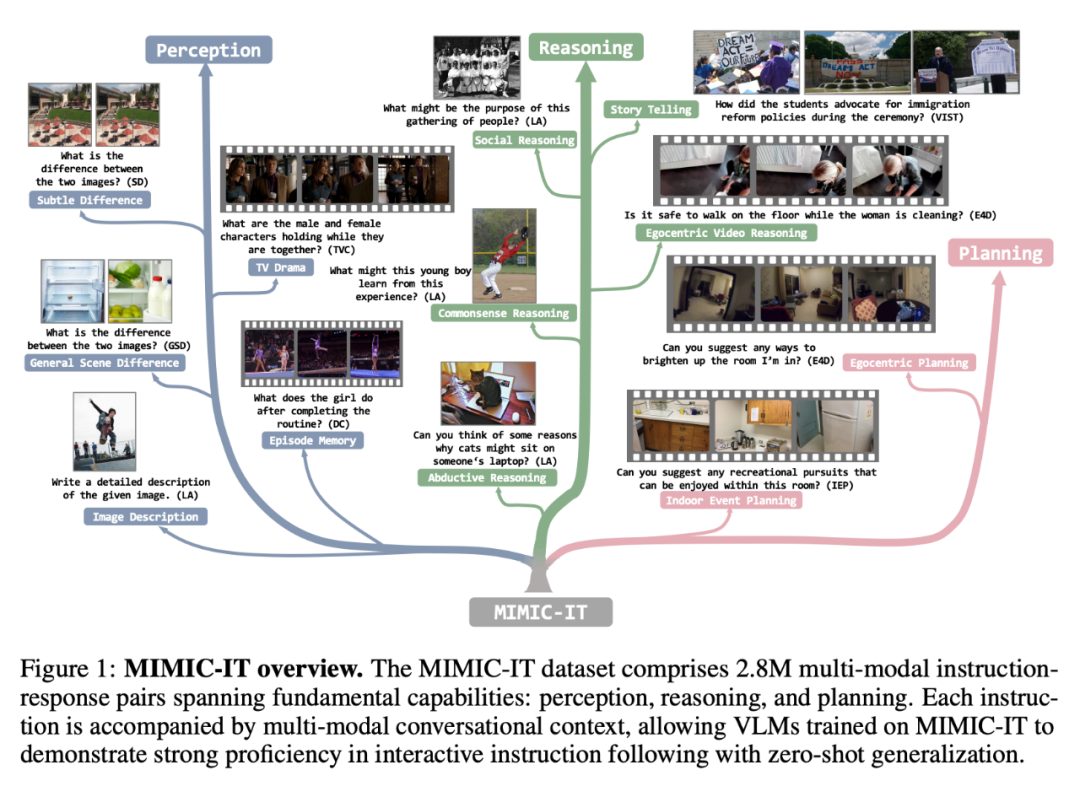

L'ensemble de données MIMIC-IT comprend 2,8 millions de paires instruction-réponse multimodales couvrant les capacités de base : perception, raisonnement et planification. Chaque instruction est accompagnée d'un contexte conversationnel multimodal, permettant à VLM formé sur MIMIC-IT de démontrer une bonne maîtrise des instructions interactives et d'effectuer une généralisation sans tir.

Par rapport à LLaVA, les fonctionnalités de MIMIC-IT incluent :

(1) Diverses scènes visuelles, y compris des scènes générales, des scènes de perspective égocentriques et des images RVB-D intérieures, etc. Images et des vidéos provenant de différents ensembles de données ;

(2) Plusieurs images (ou une vidéo) comme données visuelles ;

(3) Informations contextuelles multimodales, y compris plusieurs paires instruction-réponse et plusieurs images ou vidéos ;

(4) prend en charge huit langues, dont l'anglais, le chinois, l'espagnol, le japonais, le français, l'allemand, le coréen et l'arabe.La figure suivante montre en outre la comparaison commande-réponse des deux (la case jaune est LLaVA) :

Sythus : pipeline automatisé de génération de paires commande-réponse

Étant donné que la qualité de l'ensemble de base affectera le processus ultérieur de collecte de données, les chercheurs ont adopté une stratégie de démarrage à froid pour renforcer les échantillons dans leur contexte avant d'effectuer des requêtes à grande échelle. Pendant la phase de démarrage à froid, une approche heuristique est adoptée pour inciter ChatGPT à collecter des échantillons en contexte uniquement via des informations système et des annotations visuelles. Cette phase ne se termine qu'après identification des échantillons dans un contexte satisfaisant. Dans la quatrième étape, une fois les paires commande-réponse obtenues, le pipeline les étend en chinois (zh), japonais (ja), espagnol (es), allemand (de), français (fr), coréen (ko) et arabe. (ar). De plus amples détails peuvent être trouvés à l'annexe C, et des invites de tâches spécifiques peuvent être trouvées à l'annexe D.

La figure 5 est un exemple de la réponse d’Otter dans différents scénarios. Grâce à la formation sur l'ensemble de données MIMIC-IT, Otter est capable de servir la compréhension et le raisonnement situationnels, l'apprentissage d'échantillons contextuels et les assistants visuels égocentriques.

Enfin, les chercheurs ont mené une analyse comparative des performances d'Otter et d'autres VLM dans une série de tests de référence.

Évaluation ChatGPT

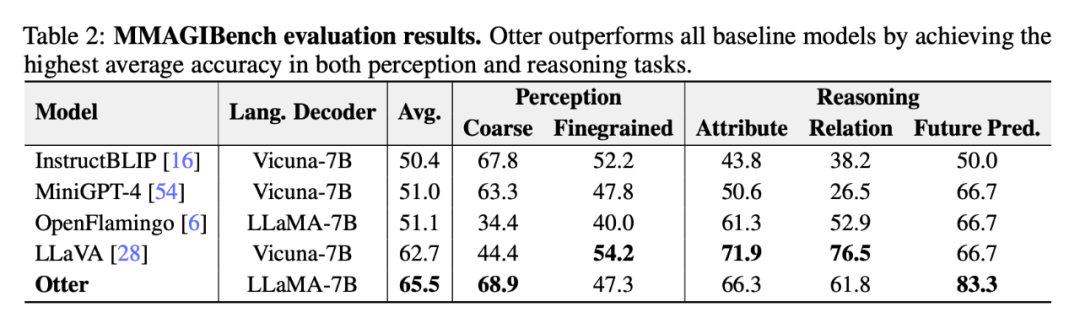

Le tableau 2 ci-dessous montre l'évaluation approfondie par les chercheurs des capacités de perception et de raisonnement des modèles de langage visuel à l'aide du cadre MMAGIBench [43].

Évaluation humaine

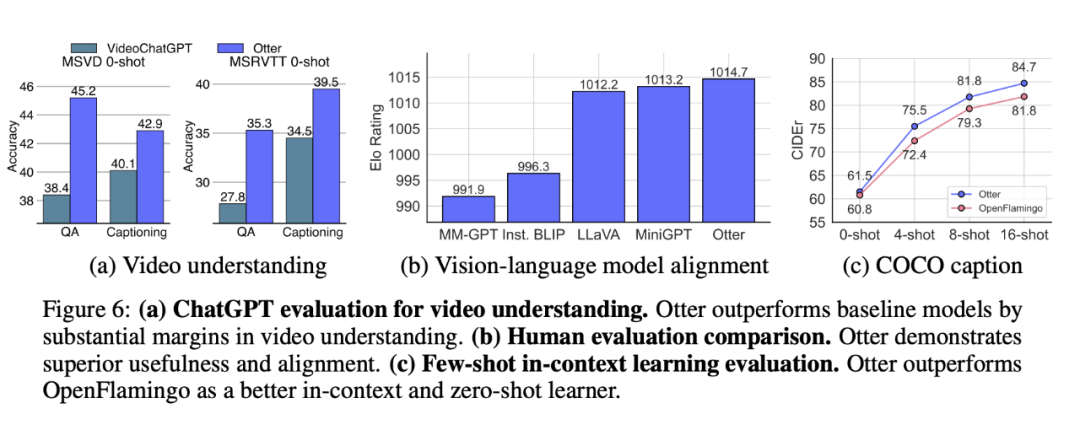

Multi-Modality Arena [32] utilise le système de notation Elo pour évaluer l'utilité et la cohérence des réponses VLM. La figure 6 (b) montre qu'Otter fait preuve d'une praticité et d'une cohérence supérieures, obtenant la note Elo la plus élevée dans les VLM récents.

Évaluation de référence d'apprentissage contextuel en quelques étapes

Otter est affiné sur OpenFlamingo, une architecture conçue pour l'apprentissage contextuel multimodal. Après un réglage fin à l'aide de l'ensemble de données MIMIC-IT, Otter surpasse considérablement OpenFlamingo lors de l'évaluation en quelques coups de COCO Captioning (CIDEr) [27] (voir Figure 6 (c)). Comme prévu, le réglage fin apporte également des gains de performances marginaux sur l'évaluation à échantillon nul.

Figure 6 : Évaluation de la compréhension de la vidéo ChatGPT.

Discutez des

défauts. Bien que les chercheurs aient amélioré de manière itérative les messages système et les exemples de réponses aux commandes, ChatGPT est sujet aux hallucinations linguistiques et peut donc générer des réponses erronées. Souvent, des modèles de langage plus fiables nécessitent une génération de données auto-instruite.

L'avenir du travail. À l’avenir, les chercheurs prévoient de prendre en charge des ensembles de données d’IA plus spécifiques, tels que LanguageTable et SayCan. Les chercheurs envisagent également d’utiliser des modèles de langage ou des techniques de génération plus fiables pour améliorer l’ensemble d’instructions.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

Comment obtenir des objets à l'aide de commandes dans Terraria ? -Comment collecter des objets dans Terraria ?

Mar 19, 2024 am 08:13 AM

Comment obtenir des objets à l'aide de commandes dans Terraria ? -Comment collecter des objets dans Terraria ?

Mar 19, 2024 am 08:13 AM

Comment obtenir des objets à l'aide de commandes dans Terraria ? 1. Quelle est la commande pour donner des objets dans Terraria ? Dans le jeu Terraria, donner des commandes à des objets est une fonction très pratique. Grâce à cette commande, les joueurs peuvent obtenir directement les objets dont ils ont besoin sans avoir à combattre des monstres ou à se téléporter vers un certain endroit. Cela peut grandement faire gagner du temps, améliorer l’efficacité du jeu et permettre aux joueurs de se concentrer davantage sur l’exploration et la construction du monde. Dans l’ensemble, cette fonctionnalité rend l’expérience de jeu plus fluide et plus agréable. 2. Comment utiliser Terraria pour donner des commandes d'objets 1. Ouvrez le jeu et entrez dans l'interface du jeu. 2. Appuyez sur la touche "Entrée" du clavier pour ouvrir la fenêtre de discussion. 3. Entrez le format de commande dans la fenêtre de discussion : "/give[player name][item ID][itemQuantity]".

Démarrage rapide de VUE3 : utiliser les instructions de Vue.js pour changer d'onglet

Jun 15, 2023 pm 11:45 PM

Démarrage rapide de VUE3 : utiliser les instructions de Vue.js pour changer d'onglet

Jun 15, 2023 pm 11:45 PM

Cet article vise à aider les débutants à démarrer rapidement avec Vue.js3 et à obtenir un simple effet de changement d'onglet. Vue.js est un framework JavaScript populaire qui peut être utilisé pour créer des composants réutilisables, gérer facilement l'état de votre application et gérer les interactions de l'interface utilisateur. Vue.js3 est la dernière version du framework Par rapport aux versions précédentes, il a subi des changements majeurs, mais les principes de base n'ont pas changé. Dans cet article, nous utiliserons les instructions de Vue.js pour implémenter l'effet de changement d'onglet, dans le but de familiariser les lecteurs avec Vue.js.

Classification d'images avec apprentissage en quelques prises de vue à l'aide de PyTorch

Apr 09, 2023 am 10:51 AM

Classification d'images avec apprentissage en quelques prises de vue à l'aide de PyTorch

Apr 09, 2023 am 10:51 AM

Ces dernières années, les modèles basés sur l’apprentissage profond ont donné de bons résultats dans des tâches telles que la détection d’objets et la reconnaissance d’images. Sur des ensembles de données de classification d'images complexes comme ImageNet, qui contient 1 000 classifications d'objets différentes, certains modèles dépassent désormais les niveaux humains. Mais ces modèles s'appuient sur un processus de formation supervisé, ils sont considérablement affectés par la disponibilité de données de formation étiquetées, et les classes que les modèles sont capables de détecter sont limitées aux classes sur lesquelles ils ont été formés. Puisqu’il n’y a pas suffisamment d’images étiquetées pour toutes les classes pendant la formation, ces modèles peuvent être moins utiles dans des contextes réels. Et nous voulons que le modèle soit capable de reconnaître les classes qu'il n'a pas vues lors de l'entraînement, car il est presque impossible de s'entraîner sur des images de tous les objets potentiels. Nous apprendrons de quelques exemples

Afin de fournir un nouveau système de référence et d'évaluation de questions-réponses scientifiques et complexes pour les grands modèles, l'UNSW, Argonne, l'Université de Chicago et d'autres institutions ont lancé conjointement le cadre SciQAG.

Jul 25, 2024 am 06:42 AM

Afin de fournir un nouveau système de référence et d'évaluation de questions-réponses scientifiques et complexes pour les grands modèles, l'UNSW, Argonne, l'Université de Chicago et d'autres institutions ont lancé conjointement le cadre SciQAG.

Jul 25, 2024 am 06:42 AM

L'ensemble de données ScienceAI Question Answering (QA) joue un rôle essentiel dans la promotion de la recherche sur le traitement du langage naturel (NLP). Des ensembles de données d'assurance qualité de haute qualité peuvent non seulement être utilisés pour affiner les modèles, mais également évaluer efficacement les capacités des grands modèles linguistiques (LLM), en particulier la capacité à comprendre et à raisonner sur les connaissances scientifiques. Bien qu’il existe actuellement de nombreux ensembles de données scientifiques d’assurance qualité couvrant la médecine, la chimie, la biologie et d’autres domaines, ces ensembles de données présentent encore certaines lacunes. Premièrement, le formulaire de données est relativement simple, et la plupart sont des questions à choix multiples. Elles sont faciles à évaluer, mais limitent la plage de sélection des réponses du modèle et ne peuvent pas tester pleinement la capacité du modèle à répondre aux questions scientifiques. En revanche, les questions et réponses ouvertes

Implémentation d'OpenAI CLIP sur des ensembles de données personnalisés

Sep 14, 2023 am 11:57 AM

Implémentation d'OpenAI CLIP sur des ensembles de données personnalisés

Sep 14, 2023 am 11:57 AM

En janvier 2021, OpenAI a annoncé deux nouveaux modèles : DALL-E et CLIP. Les deux modèles sont des modèles multimodaux qui relient le texte et les images d’une manière ou d’une autre. Le nom complet de CLIP est Contrastive Language-Image Pre-training (ContrastiveLanguage-ImagePre-training), qui est une méthode de pré-formation basée sur des paires texte-image contrastées. Pourquoi introduire CLIP ? Parce que le StableDiffusion actuellement populaire n'est pas un modèle unique, mais se compose de plusieurs modèles. L'un des composants clés est l'encodeur de texte, qui est utilisé pour encoder la saisie de texte de l'utilisateur. Cet encodeur de texte est l'encodeur de texte CL dans le modèle CLIP.

Modélisation des données à l'aide des processus gaussiens du modèle de noyau (KMGP)

Jan 30, 2024 am 11:15 AM

Modélisation des données à l'aide des processus gaussiens du modèle de noyau (KMGP)

Jan 30, 2024 am 11:15 AM

Les processus gaussiens du modèle de noyau (KMGP) sont des outils sophistiqués permettant de gérer la complexité de divers ensembles de données. Il étend le concept des processus gaussiens traditionnels à travers les fonctions du noyau. Cet article discutera en détail de la base théorique, des applications pratiques et des défis des KMGP. Le processus gaussien du modèle de noyau est une extension du processus gaussien traditionnel et est utilisé dans l'apprentissage automatique et les statistiques. Avant de comprendre kmgp, vous devez maîtriser les connaissances de base du processus gaussien, puis comprendre le rôle du modèle de noyau. Processus gaussiens (GP) Les processus gaussiens sont des ensembles de variables aléatoires, avec un nombre fini de variables distribuées conjointement par la distribution gaussienne, et sont utilisés pour définir des distributions de probabilité de fonctions. Les processus gaussiens sont couramment utilisés dans les tâches de régression et de classification en apprentissage automatique et peuvent être utilisés pour ajuster la distribution de probabilité des données. Une caractéristique importante des processus gaussiens est leur capacité à fournir des estimations et des prévisions d'incertitude.

Comment diviser correctement un ensemble de données ? Résumé de trois méthodes courantes

Apr 08, 2023 pm 06:51 PM

Comment diviser correctement un ensemble de données ? Résumé de trois méthodes courantes

Apr 08, 2023 pm 06:51 PM

La décomposition de l'ensemble de données en un ensemble d'apprentissage nous aide à comprendre le modèle, ce qui est important pour la façon dont le modèle se généralise à de nouvelles données invisibles. Un modèle peut ne pas se généraliser correctement à de nouvelles données invisibles s'il est surajusté. Il n’est donc pas possible de faire de bonnes prédictions. Avoir une stratégie de validation appropriée est la première étape pour réussir à créer de bonnes prédictions et à utiliser la valeur commerciale des modèles d'IA. Cet article a compilé quelques stratégies courantes de fractionnement des données. Une simple répartition de l'entraînement et des tests divise l'ensemble de données en parties de formation et de validation, avec 80 % de formation et 20 % de validation. Vous pouvez le faire en utilisant l'échantillonnage aléatoire de Scikit. Tout d’abord, la graine aléatoire doit être corrigée, sinon la même répartition des données ne pourra pas être comparée et les résultats ne pourront pas être reproduits pendant le débogage. Si l'ensemble de données

Le MoE modulaire deviendra le modèle de base pour l'apprentissage visuel multitâche

Apr 13, 2023 pm 12:40 PM

Le MoE modulaire deviendra le modèle de base pour l'apprentissage visuel multitâche

Apr 13, 2023 pm 12:40 PM

L'apprentissage multitâche (MTL) présente de nombreux défis car les gradients entre les différentes tâches peuvent être contradictoires. Pour exploiter la corrélation entre les tâches, les auteurs introduisent le modèle Mod-Squad, qui est un modèle modulaire composé de plusieurs experts. Le modèle peut optimiser de manière flexible la mise en correspondance des tâches et des experts, et sélectionner certains experts pour la tâche. Le modèle permet à chaque expert de correspondre seulement à une partie des tâches, et à chaque tâche de correspondre seulement à une partie des experts, maximisant ainsi l'utilisation des liens positifs entre les tâches. Mod-Squad intègre les couches Mixture of Experts (MoE) dans le modèle Vision Transformer et introduit une nouvelle fonction de perte qui encourage des dépendances clairsemées mais fortes entre les experts et les tâches. aussi