ChatGPT a encore évolué du jour au lendemain, et OpenAI a lancé un grand nombre de mises à jour en une seule fois !

Le cœur est la nouvelle capacité d'appel de fonctions de l'API. Semblable à la version Web du plug-in, l'API peut également utiliser des outils externes.

Cette capacité est mise entre les mains des développeurs, et les fonctionnalités que l'API ChatGPT ne possède pas à l'origine peuvent également être résolues par divers services tiers.

Certaines personnes pensent qu'il s'agit d'une fonctionnalité qui tue et de la mise à jour la plus importante depuis la sortie de l'API ChatGPT.

De plus, cette mise à jour de l'API ChatGPTTout le monde est très important, non seulement la capacité est augmentée, mais le prix est également inférieur :

La nouvelle a atteint la Chine, et certains internautes pensent qu'il s'agit d'un défi majeur auquel sont confrontés les grands modèles nationaux.

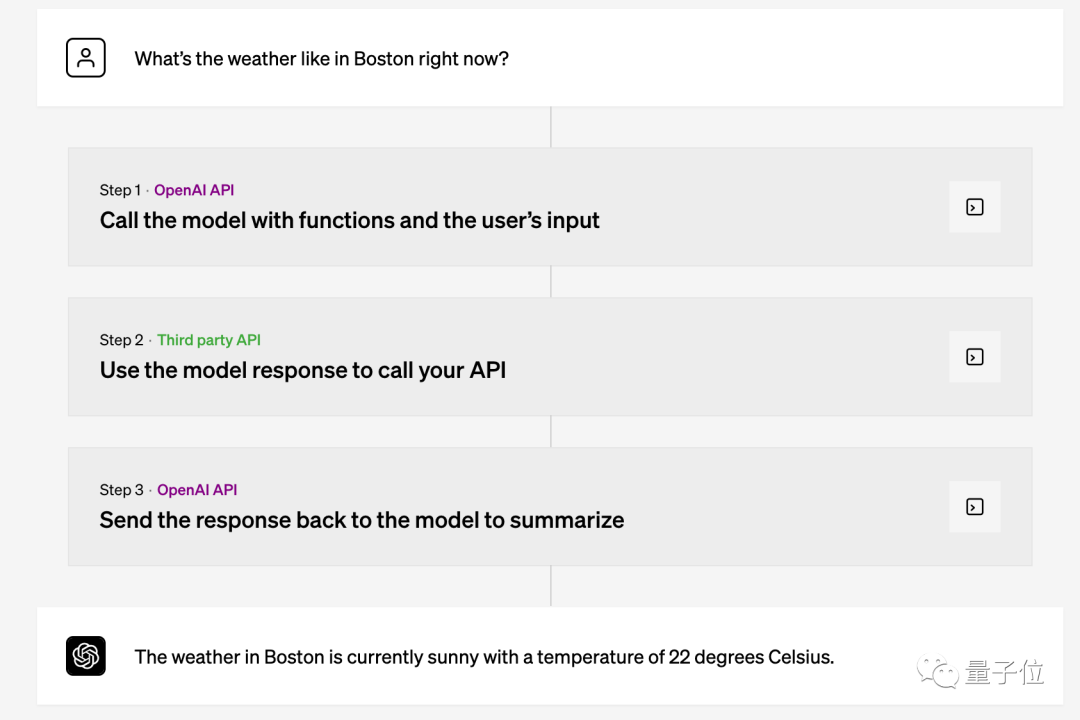

Selon l'introduction officielle d'OpenAI, les appels de fonction prennent en charge à la fois la nouvelle version de GPT-4 et GPT-3.5.

Les développeurs n'ont besoin du modèle que pour décrire les fonctions qui doivent être utilisées. Le moment d'appeler quelle fonction est déterminé par le modèle lui-même en fonction des mots d'invite, ce qui est le même que le mécanisme d'appel des plug-ins ChatGPT.

Pour des méthodes d'utilisation spécifiques, le responsable donne trois exemples :

Tout d'abord, le chatbot appelle une API externe pour effectuer des opérations ou répondre à des questions, telles que « Envoyer un e-mail à quelqu'un » ou « Quel temps fait-il aujourd'hui ? " ".

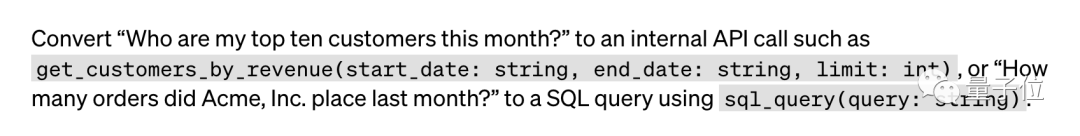

Deuxièmement , convertissez le langage naturel en appels API ou en requêtes de base de données, telles que "Combien de commandes y a-t-il eu le mois dernier ?" Les instructions de requête SQL seront automatiquement générées.

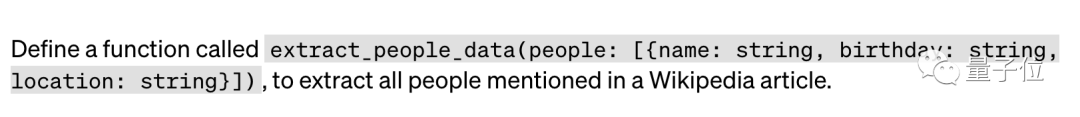

Troisièmement, extrayez automatiquement les données structurées du texte. Par exemple, il vous suffit de définir le "nom, date de naissance, lieu" requis et de donner un lien Web pour extraire automatiquement un article Wikipédia Informations sur tous. personnes mentionnées dans l'article.

Cette nouvelle fonctionnalité a applaudi la majorité des internautes, en particulier les développeurs, affirmant qu'avec elle, l'efficacité du travail sera grandement améliorée.

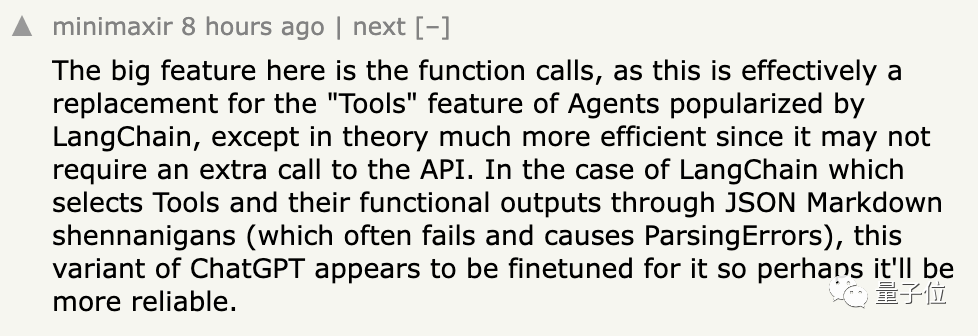

Dans le passé, si vous vouliez que GPT appelle des fonctions, vous deviez utiliser les outils de LangChain.

...

Bien que LangChain ait théoriquement une efficacité opérationnelle plus élevée, sa fiabilité est inférieure à celle du nouveau GPT spécialement réglé.

Actuellement, la nouvelle version du modèle a progressivement commencé à itérer.

Les dernières versions de gpt-4-0613, gpt-3.5-turbo-0613 et la longueur de contexte étendue gpt-4-32k-0613 prennent toutes en charge les appels de fonction.

gpt-3.5-turbo-16k ne prend pas en charge les appels de fonction et fournit 4 fois la longueur du contexte, ce qui signifie qu'une requête peut prendre en charge environ 20 pages de texte.

Les anciens modèles commencent également à être progressivement abandonnés.

Les applications utilisant les versions initiales de gpt-3.5-turbo et gpt-4 seront automatiquement mises à niveau vers la nouvelle version le 27 juin.

Les développeurs qui ont besoin de plus de temps pour la transition peuvent également spécifier manuellement de continuer à utiliser l'ancienne version, mais sur 13 septembre Toutes les demandes d'anciennes versions seront complètement rejetées à l'avenir.

Après avoir parlé de cette chronologie, jetons un œil au prix.

Après la mise à niveau, OpenAI non seulement n'a pas augmenté le prix du produit, mais l'a plutôt abaissé.

Le premier est le gpt-3.5-turbo le plus utilisé (version token 4k).

Le prix des jetons d'entrée a été réduit de 25 % et est désormais de 0,0015 $ US pour mille jetons, soit 666 000 jetons pour 1 $ US.

Le prix du jeton de sortie pour mille jetons est de 0,002 $ US, soit 500 000 jetons pour 1 $ US.

S'il est converti en texte anglais, il représente environ 1 dollar américain et 700 pages.

Le prix du modèle d'encastrement a chuté, directement réduit de 75%.

Chaque millier de jetons ne coûte que 0,0001 USD, soit 1 USD et 10 millions de jetons.

De plus, la nouvelle version de jeton 16K de GPT3.5-Turbo offre quatre fois la puissance de traitement de la version 4K, mais ne coûte que deux fois le prix.

Les prix des jetons d'entrée et de sortie sont respectivement de 0,003 et 0,004 dollars américains pour mille jetons.

De plus, quelques internautes ont rapporté que la facture mensuelle est passée de 100 à quelques centimes. On ne sait toujours pas quelle est la situation précise.

Enfin, n'oubliez pas de faire la queue pour les qualifications de test de l'API GPT-4 si nécessaire.

De nombreux internautes ont souligné que le nouvel "appel de fonction" d'OpenAI est fondamentalement une réplique des "Outils" de Langchain.

Peut-être qu'à l'avenir, OpenAI copiera également plus de fonctions de Langchain, telles que les chaînes et les index.

Langchain est le framework de développement open source le plus populaire dans le domaine des grands modèles, qui peut intégrer diverses capacités de grands modèles pour construire rapidement candidatures.

L'équipe a également récemment reçu 10 millions de dollars américains en financement d'amorçage.

Bien que cette mise à jour d'OpenAI ne "tue" pas directement le projet entrepreneurial Langchain.

Mais les développeurs avaient initialement besoin de LangChain pour implémenter certaines fonctions, mais maintenant ils n'en ont plus besoin.

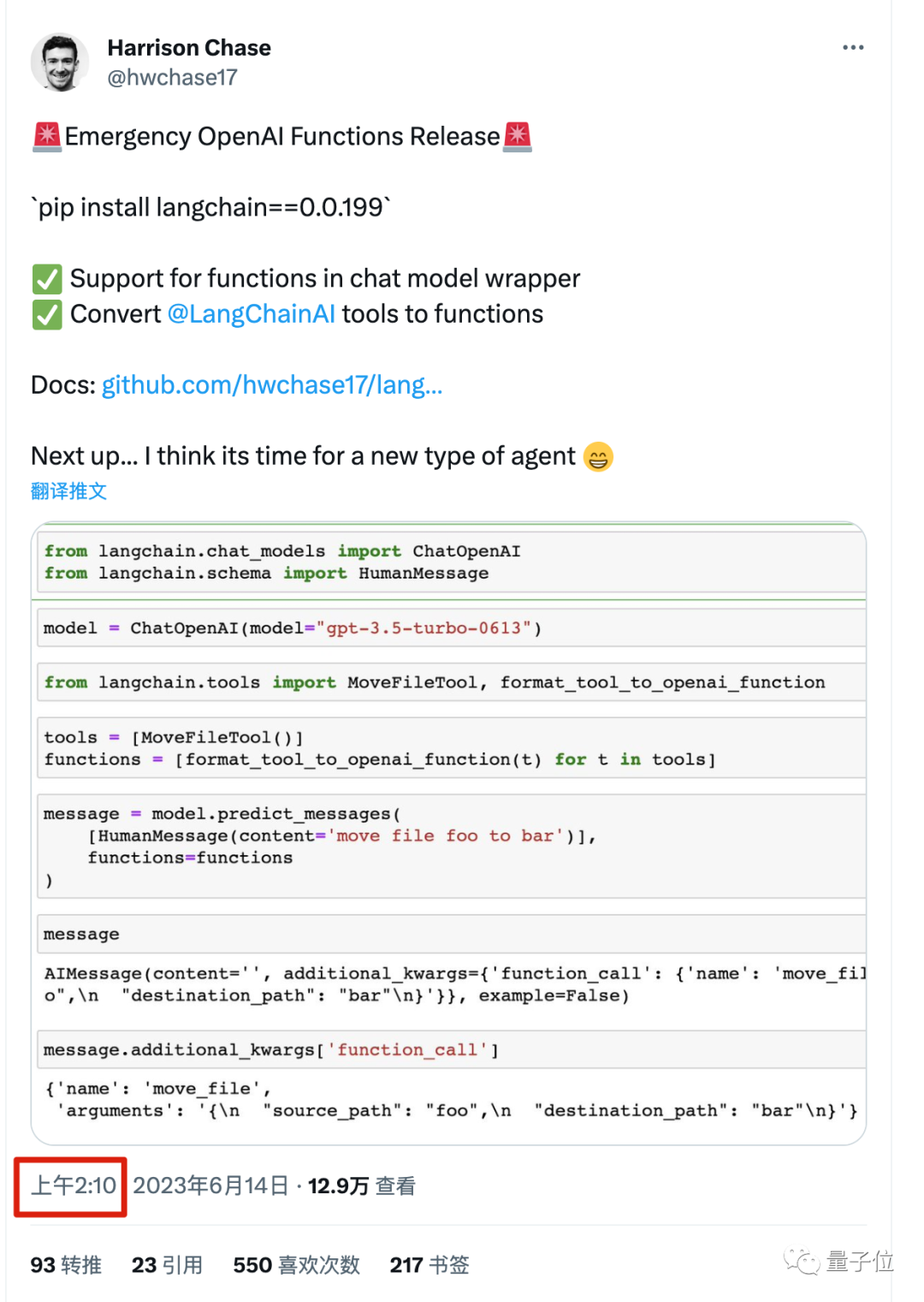

En regardant la réaction de Langchain, l'envie de survivre est effectivement très forte.

Dans les 10 minutes qui ont suivi la publication officielle de la mise à jour par OpenAI, Langchain a immédiatement annoncé qu'il "travaillait déjà sur la compatibilité".

Et une nouvelle version a été publiée en moins d'une heure. En plus de prendre en charge de nouvelles fonctions officielles, vous pouvez également convertir les outils dans lesquels les développeurs ont écrit. Fonctions OpenAI.

En plus de faire la queue pour déplorer la vitesse de développement ridiculement rapide, les internautes ont également réfléchi à une question incontournable :

#🎜🎜 ## 🎜🎜#Que faire si OpenAI détruit votre projet entrepreneurial ?

À cet égard, le PDG d'OpenAI, Sam Altman, vient de faire une déclaration récemment.

Lors de la réunion d'échange organisée par Humanloop fin mai, Altman a dit un jour :

Sauf pour les applications grand public de type ChatGPT, essayez de éviter de rivaliser avec les clients.Maintenant, il semble que les outils de développement ne soient pas inclus dans le but d'éviter la concurrence.

En plus des startups, il existe également une existence incontournable qui concurrence OpenAI :

Microsoft, le plus grand investisseur dans OpenAI, fournit également l'API OpenAI via Azure nuage. Servir.

Tout récemment, certains développeurs ont signalé qu'après le passage de l'API officielle OpenAI à la version Microsoft Azure, les performances avaient été considérablement améliorées.

Plus précisément :

Plus précisément :

En incluant certaines réductions d'Azure, c'est encore moins cher qu'avant.

Mais la vitesse de mise à jour de Microsoft Azure est généralement plusieurs semaines plus lente que celle d'OpenAI.

Utilisez OpenAI pour une itération rapide pendant la phase de développement et passez à Microsoft Azure pour un déploiement à grande échelle. Avez-vous appris quelque chose ?

Annonce de mise à jour https://openai.com/blog/function-calling-and-other-api-updates.

File d'attente API GPT-4 https://openai.com/waitlist/gpt-4-api.

Lien de référence :

[1]https://news.ycombinator.com/item?id=36313348.

[2]https://twitter.com/svpino/status/1668695130570903552.

[3]https://weibo.com/1727858283/N5cjr0jBq.

[4]https://twitter.com/LangChainAI/status/1668671302624747520.

[5]https://twitter.com/hwchase17/status/1668682373767020545.

[6]https://twitter.com/ItakGol/status/1668336193270865921.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Inscription ChatGPT

Inscription ChatGPT

Encyclopédie ChatGPT nationale gratuite

Encyclopédie ChatGPT nationale gratuite

Comment installer chatgpt sur un téléphone mobile

Comment installer chatgpt sur un téléphone mobile

Chatgpt peut-il être utilisé en Chine ?

Chatgpt peut-il être utilisé en Chine ?

La différence entre nohup et &

La différence entre nohup et &

Comment copier un tableau Excel pour lui donner la même taille que l'original

Comment copier un tableau Excel pour lui donner la même taille que l'original

Compatibilité du navigateur

Compatibilité du navigateur

Comment utiliser NSTimeInterval

Comment utiliser NSTimeInterval