interface Web

interface Web

uni-app

uni-app

Comment utiliser Uniapp pour développer la fonction de reconnaissance vocale

Comment utiliser Uniapp pour développer la fonction de reconnaissance vocale

Comment utiliser Uniapp pour développer la fonction de reconnaissance vocale

Comment utiliser Uniapp pour développer la fonction de reconnaissance vocale

La popularité et les applications de la technologie vocale sont de plus en plus répandues, et la reconnaissance vocale est devenue l'une des fonctions importantes de nombreuses applications. Dans le cadre uniapp, nous pouvons utiliser les capacités multiplateformes fournies par uniapp pour développer rapidement des applications dotées de capacités de reconnaissance vocale. Cet article expliquera comment utiliser uniapp pour développer des fonctions de reconnaissance vocale et fournira des exemples de code correspondants.

1. Préparation

Avant de commencer, nous devons nous assurer que l'environnement de développement uniapp a été installé et introduire le plug-in uniapp qui prend en charge la reconnaissance vocale dans le projet.

- Installez l'environnement de développement uniapp : Choisissez l'outil de développement approprié en fonction de votre système d'exploitation, tel que HBuilderX.

- Présentation du plug-in de reconnaissance vocale : cliquez sur "Plug-in Market" dans HBuilderX, recherchez et installez le plug-in "uni-speech-recognition". Ce plug-in est le plug-in de reconnaissance vocale officiellement recommandé par uniapp, qui peut nous aider à implémenter rapidement la fonction de reconnaissance vocale.

2. Implémenter la fonction de reconnaissance vocale

Après avoir terminé le travail de préparation, nous pouvons commencer à implémenter la fonction de reconnaissance vocale. Voici les étapes et exemples de code pour implémenter la fonction de reconnaissance vocale :

- Créer une page : créez une nouvelle page dans le projet uniapp, telle que "voiceRecognition".

-

Introduire le plug-in : Dans la page créée, introduisez le plug-in de reconnaissance vocale fourni par uniapp, le code est le suivant :

import uniSpeechRecognition from '@/uni-speech-recognition/uni-speech-recognition.js'; // 引入语音识别插件

Copier après la connexion Configurer les autorisations : Afin d'utiliser normalement la fonction de reconnaissance vocale, nous besoin de configurer les autorisations dans le fichier manifest.json, codez comme suit :

"permission": { "scope.userLocation": { "desc": "用于语音识别" } }Copier après la connexionInitialiser la reconnaissance vocale : dans le cycle de vie de la page, utilisez le code suivant pour initialiser la fonction de reconnaissance vocale et lier la fonction de rappel d'événement appropriée :

export default { onLoad() { uniSpeechRecognition.init(); // 初始化语音识别 // 绑定语音识别结束事件回调函数 uniSpeechRecognition.onStop(res => { console.log('识别结果:', res.result); }); // 绑定语音识别错误事件回调函数 uniSpeechRecognition.onError(res => { console.error('识别错误:', res.errMsg); }); } }Copier après la connexionDémarrer la reconnaissance vocale : lorsque vous devez démarrer la reconnaissance vocale, appelez le code suivant pour démarrer la reconnaissance vocale :

uniSpeechRecognition.start({ lang: 'zh_CN', // 语种,默认为中文 timeout: 5000 // 超时时间,默认为5秒 });Copier après la connexionArrêter la reconnaissance vocale : lorsqu'il n'est pas nécessaire de continuer à reconnaître la parole, vous pouvez appeler le code suivant pour arrêter la reconnaissance vocale :

uniSpeechRecognition.stop();

Copier après la connexion

3. Testez la fonction de reconnaissance vocale

Après avoir terminé les étapes ci-dessus, nous pouvons tester la fonction de reconnaissance vocale sur la page "voiceRecognition" du projet uniapp. Démarrez la reconnaissance vocale en cliquant sur le bouton, cliquez à nouveau sur le bouton pour arrêter la reconnaissance vocale, puis vous pourrez afficher les résultats de la reconnaissance sur la console.

<template>

<view>

<button @click="startRecognition">开始识别</button>

<button @click="stopRecognition">停止识别</button>

</view>

</template>

<script>

import uniSpeechRecognition from '@/uni-speech-recognition/uni-speech-recognition.js';

export default {

methods: {

startRecognition() {

uniSpeechRecognition.start({

lang: 'zh_CN',

timeout: 5000

});

},

stopRecognition() {

uniSpeechRecognition.stop();

},

},

onLoad() {

uniSpeechRecognition.init();

uniSpeechRecognition.onStop(res => {

console.log('识别结果:', res.result);

});

uniSpeechRecognition.onError(res => {

console.error('识别错误:', res.errMsg);

});

}

}

</script>Grâce aux étapes ci-dessus, nous avons implémenté avec succès la fonction de reconnaissance vocale dans uniapp et fourni des exemples de code correspondants pour référence. J'espère que cet article pourra être utile à tous ceux qui utilisent Uniapp pour développer des fonctions de reconnaissance vocale.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

Video Face Swap

Échangez les visages dans n'importe quelle vidéo sans effort grâce à notre outil d'échange de visage AI entièrement gratuit !

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

Comment reconnaître automatiquement la parole et générer des sous-titres dans un extrait de film Introduction à la méthode de génération automatique de sous-titres.

Mar 14, 2024 pm 08:10 PM

Comment reconnaître automatiquement la parole et générer des sous-titres dans un extrait de film Introduction à la méthode de génération automatique de sous-titres.

Mar 14, 2024 pm 08:10 PM

Comment implémentons-nous certaines fonctions de sous-titres générés par la voix sur cette plateforme ? Lorsque nous réalisons des vidéos, afin d'avoir plus de qualité, ou lors de la narration de certaines histoires, nous devons ajouter nos sous-titres, afin que chacun puisse mieux comprendre les informations de certaines. des vidéos ci-dessus. Cela joue également un rôle dans l'expression, mais de nombreux utilisateurs ne sont pas très familiers avec la reconnaissance vocale automatique et la génération de sous-titres. Peu importe où ils se trouvent, nous pouvons facilement vous permettre de faire de meilleurs choix dans divers aspects, si vous l'aimez aussi, vous devez le faire. ne le manquez pas. Nous devons lentement comprendre certaines compétences fonctionnelles, etc., alors dépêchez-vous et jetez un œil avec l'éditeur, ne le manquez pas.

Quatre outils de programmation assistés par IA recommandés

Apr 22, 2024 pm 05:34 PM

Quatre outils de programmation assistés par IA recommandés

Apr 22, 2024 pm 05:34 PM

Cet outil de programmation assistée par l'IA a mis au jour un grand nombre d'outils de programmation assistée par l'IA utiles à cette étape de développement rapide de l'IA. Les outils de programmation assistés par l'IA peuvent améliorer l'efficacité du développement, améliorer la qualité du code et réduire les taux de bogues. Ils constituent des assistants importants dans le processus de développement logiciel moderne. Aujourd'hui, Dayao partagera avec vous 4 outils de programmation assistés par l'IA (et tous prennent en charge le langage C#). J'espère que cela sera utile à tout le monde. https://github.com/YSGStudyHards/DotNetGuide1.GitHubCopilotGitHubCopilot est un assistant de codage IA qui vous aide à écrire du code plus rapidement et avec moins d'effort, afin que vous puissiez vous concentrer davantage sur la résolution de problèmes et la collaboration. Git

Méthode détaillée pour désactiver la reconnaissance vocale dans le système WIN10

Mar 27, 2024 pm 02:36 PM

Méthode détaillée pour désactiver la reconnaissance vocale dans le système WIN10

Mar 27, 2024 pm 02:36 PM

1. Entrez dans le panneau de configuration, recherchez l'option [Reconnaissance vocale] et activez-la. 2. Lorsque la page de reconnaissance vocale apparaît, sélectionnez [Options vocales avancées]. 3. Enfin, décochez [Exécuter la reconnaissance vocale au démarrage] dans la colonne Paramètres utilisateur de la fenêtre Propriétés vocales.

Comment démarrer l'aperçu du projet Uniapp développé par Webstorm

Apr 08, 2024 pm 06:42 PM

Comment démarrer l'aperçu du projet Uniapp développé par Webstorm

Apr 08, 2024 pm 06:42 PM

Étapes pour lancer l'aperçu du projet UniApp dans WebStorm : Installer le plugin UniApp Development Tools Se connecter aux paramètres de l'appareil Aperçu du lancement de WebSocket

Lequel est le meilleur, uniapp ou mui ?

Apr 06, 2024 am 05:18 AM

Lequel est le meilleur, uniapp ou mui ?

Apr 06, 2024 am 05:18 AM

De manière générale, uni-app est préférable lorsque des fonctions natives complexes sont nécessaires ; MUI est meilleur lorsque des interfaces simples ou hautement personnalisées sont nécessaires. De plus, uni-app possède : 1. Prise en charge de Vue.js/JavaScript ; 2. Composants/API natifs riches 3. Bon écosystème ; Les inconvénients sont : 1. Problèmes de performances ; 2. Difficulté à personnaliser l'interface ; MUI a : 1. Prise en charge de la conception matérielle ; 2. Grande flexibilité ; 3. Bibliothèque étendue de composants/thèmes. Les inconvénients sont : 1. Dépendance CSS ; 2. Ne fournit pas de composants natifs ; 3. Petit écosystème ;

Apprenez à développer des applications mobiles en utilisant le langage Go

Mar 28, 2024 pm 10:00 PM

Apprenez à développer des applications mobiles en utilisant le langage Go

Mar 28, 2024 pm 10:00 PM

Didacticiel d'application mobile de développement du langage Go Alors que le marché des applications mobiles continue de croître, de plus en plus de développeurs commencent à explorer comment utiliser le langage Go pour développer des applications mobiles. En tant que langage de programmation simple et efficace, le langage Go a également montré un fort potentiel dans le développement d'applications mobiles. Cet article présentera en détail comment utiliser le langage Go pour développer des applications mobiles et joindra des exemples de code spécifiques pour aider les lecteurs à démarrer rapidement et à commencer à développer leurs propres applications mobiles. 1. Préparation Avant de commencer, nous devons préparer l'environnement et les outils de développement. tête

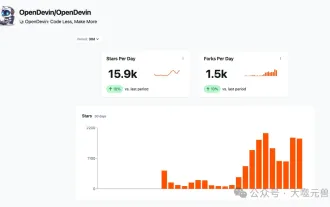

Quel programmeur IA est le meilleur ? Explorez le potentiel de Devin, Tongyi Lingma et de l'agent SWE

Apr 07, 2024 am 09:10 AM

Quel programmeur IA est le meilleur ? Explorez le potentiel de Devin, Tongyi Lingma et de l'agent SWE

Apr 07, 2024 am 09:10 AM

Le 3 mars 2022, moins d'un mois après la naissance de Devin, le premier programmeur d'IA au monde, l'équipe NLP de l'Université de Princeton a développé un agent SWE pour programmeur d'IA open source. Il exploite le modèle GPT-4 pour résoudre automatiquement les problèmes dans les référentiels GitHub. Les performances de l'agent SWE sur l'ensemble de tests du banc SWE sont similaires à celles de Devin, prenant en moyenne 93 secondes et résolvant 12,29 % des problèmes. En interagissant avec un terminal dédié, SWE-agent peut ouvrir et rechercher le contenu des fichiers, utiliser la vérification automatique de la syntaxe, modifier des lignes spécifiques et écrire et exécuter des tests. (Remarque : le contenu ci-dessus est un léger ajustement du contenu original, mais les informations clés du texte original sont conservées et ne dépassent pas la limite de mots spécifiée.) SWE-A

Quels outils de développement uniapp utilise-t-il ?

Apr 06, 2024 am 04:27 AM

Quels outils de développement uniapp utilise-t-il ?

Apr 06, 2024 am 04:27 AM

UniApp utilise HBuilder