Alibaba Cloud a pris les devants en lançant une gamme complète de solutions de formation et de déploiement pour Llama2 le 25 juillet. Ce projet open source prend en charge une utilisation commerciale gratuite, ce qui a attiré une large attention dans l'industrie sur les modèles open source à grande échelle. Les développeurs sont invités à créer leurs propres grands modèles personnalisés sur Alibaba Cloud

Récemment, le grand modèle de langage Llama2 a été annoncé comme open source, comprenant 7 milliards, 13 milliards et 70 milliards de versions de paramètres. Llama2 est gratuit pour une utilisation dans des scénarios de recherche et commerciaux avec moins de 700 millions d'utilisateurs actifs par mois, offrant aux entreprises et aux développeurs de nouveaux outils pour la recherche de modèles à grande échelle. Cependant, le recyclage et le déploiement de Llama2 ont encore un seuil élevé, en particulier pour la version de grande taille la plus puissante

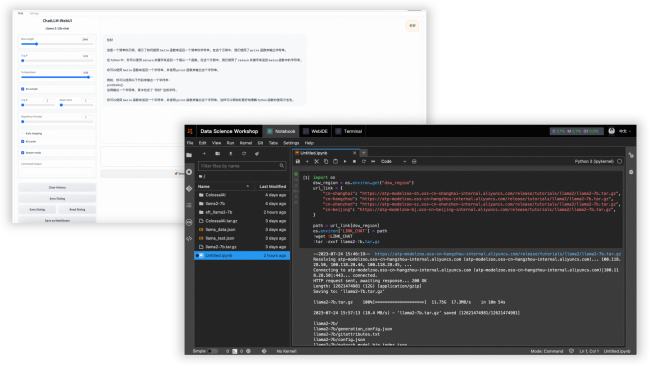

Afin de faciliter la tâche des développeurs, la plateforme d'apprentissage automatique Alibaba Cloud PAI est la première en Chine à adapter en profondeur les modèles de la série Llama2. configuration et lancé des solutions de bonnes pratiques adaptées au réglage fin léger, au réglage fin de tous les paramètres, aux services d'inférence et à d'autres scénarios pour aider les développeurs à se recycler rapidement sur la base de Llama2 et à créer leurs propres grands modèles personnalisés

ModelScope, une communauté de modèles d'IA dirigée par Alibaba Cloud, a immédiatement lancé la série de modèles Llama2. Les développeurs peuvent cliquer sur « Notebook Rapid Development » sur la page du modèle Llama2 de la communauté Magic pour lancer la plate-forme d'apprentissage automatique Alibaba Cloud PAI en un seul clic afin de développer et de déployer le modèle sur le cloud. Les modèles Llama2 téléchargés à partir d'autres plates-formes peuvent également être utilisés avec. Alibaba Cloud. Développé par PAI.

Afin de répondre aux besoins de scénarios spéciaux, les développeurs doivent généralement utiliser des méthodes de formation affinées pour ajuster le modèle afin d'acquérir des capacités professionnelles et des connaissances dans des domaines spécifiques. À cette fin, PAI prend en charge un réglage fin léger de Lora ou un réglage plus approfondi de tous les paramètres sur le cloud. Une fois le réglage fin du modèle terminé, les développeurs peuvent déployer Llama2 via l'interface utilisateur Web et l'API, afin que le modèle puisse interagir avec les utilisateurs via des pages Web ou des applications intégrées

sur Alibaba Cloud, via PAI Lingjun. Calcul intelligent La puissance de calcul distribuée fournie par le service peut facilement compléter le développement en profondeur du modèle de très grande taille Llama2. L'environnement prédéfini élimine les problèmes d'exploitation et de maintenance, rendant l'opération simple et pratique. De plus, les développeurs peuvent également profiter de ressources informatiques abondantes en IA et d’une extrême flexibilité. En revanche, le GPU local à carte unique ne peut gérer que le réglage fin et l'inférence légers de Lora de la version Llama2 à 7 milliards de paramètres, et il est difficile de prendre en charge la version de plus grande taille et une formation plus approfondie en tant que trois premiers au monde et. le troisième en Asie En tant que principal fournisseur de cloud, Alibaba Cloud est un leader et un fournisseur de services important dans la vague de l'IA en Chine. Il a construit un service d'IA IaaS+PaaS+MaaS intégré complet. Au niveau de l'infrastructure, Alibaba Cloud dispose de la réserve de puissance de calcul intelligente la plus importante de Chine. Le cluster informatique intelligent de Lingjun a une évolutivité allant jusqu'à 100 000 cartes GPU et peut transporter plusieurs grands modèles avec des milliards de paramètres pour une formation en ligne simultanée à l'IA ; Au niveau de la plate-forme, la plate-forme d'apprentissage automatique Alibaba Cloud PAI fournit des capacités d'ingénierie pour l'ensemble du processus de développement de l'IA. Le service informatique intelligent PAI Lingjun prend en charge la formation et l'application de très grands modèles tels que Tongyi Qianwen, ce qui peut améliorer les performances de formation des grands modèles. de près de 10 fois et augmenter l'efficacité de l'inférence de 37 % ; Dans la couche de service de modèle, Alibaba Cloud a construit la communauté de modèles d'IA la plus active de Chine, , et

aide les entreprises à se recycler sur la base des grands modèles Tongyi Qianwen ou Sanparty. .Début juillet de cette année, Alibaba Cloud a annoncé qu'il promouvrait la prospérité du grand écosystème de modèles chinois comme objectif principal et fournirait des services complets aux grandes startups de modèles, y compris la formation de modèles, l'inférence, le déploiement, l'analyse fine. réglage, évaluation et mise en œuvre des produits, et fournir un financement suffisant et un soutien à l'exploration commerciale

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!