Périphériques technologiques

Périphériques technologiques

IA

IA

Le « moment Android » des grands modèles d'IA domestiques est arrivé ! Alibaba Cloud Tongyi Qianwen est gratuit, open source et disponible pour un usage commercial

Le « moment Android » des grands modèles d'IA domestiques est arrivé ! Alibaba Cloud Tongyi Qianwen est gratuit, open source et disponible pour un usage commercial

Le « moment Android » des grands modèles d'IA domestiques est arrivé ! Alibaba Cloud Tongyi Qianwen est gratuit, open source et disponible pour un usage commercial

Après Meta à l'étranger, Alibaba est devenu un autre géant de la technologie qui promeut la tendance du « moment Android » des grands modèles d'intelligence artificielle (IA)

Selon les rapports du Beijing Business Daily, Alibaba Cloud publiera le modèle open source de questions et réponses générales Qwen-7B et le modèle de conversation Qwen-7B-Chat le jeudi 3 août. Les deux modèles ont 7 milliards de paramètres. Ils ont lancé la première plateforme ouverte « Model as a Service » en Chine, la Magic Community, et elle peut être utilisée gratuitement, et l'utilisation commerciale est également autorisée

Les utilisateurs peuvent quantifier Qwen-7B et Qwen-7B-Chat via un code open source, ainsi que déployer et exécuter des modèles sur des cartes graphiques grand public. Ils peuvent télécharger directement le modèle depuis la communauté Moda, ou accéder et appeler Qwen-7B et Qwen-7B-Chat via la plateforme Alibaba Cloud Lingji. Alibaba Cloud fournit aux utilisateurs des services comprenant la formation de modèles, l'inférence, le déploiement et le réglage fin

Sur la communauté Magic Tower, il y a un article dédié à la présentation de la méthode d'installation du modèle Tongyi Qianwen, à l'expérience de création d'espace, aux meilleures pratiques de raisonnement du modèle et de formation du modèle, et joint également les captures d'écran du lien du modèle et de la situation de téléchargement.

Selon les informations publiques, Qwen-7B est un modèle de base pré-entraîné utilisant plus de 2,2 billions de jetons après déduplication et filtrage. Il prend en charge plusieurs langues telles que le chinois et l'anglais et a une longueur de fenêtre contextuelle de 8 Ko. Le modèle contient des données de haute qualité en chinois, anglais, multilingues, codes, mathématiques et autres, couvrant l'ensemble du réseau texte, encyclopédie, livres, code, mathématiques et champs verticaux dans divers domaines

Selon les résultats de l'évaluation MMLU, Qwen-7B a obtenu de bons résultats lors de l'évaluation en anglais, surpassant d'autres modèles de pré-formation open source similaires et étant compétitif par rapport aux modèles à plus grande échelle. En termes d'évaluation chinoise, Qwen-7B a obtenu le score le plus élevé sur l'ensemble de validation C-Eval et était compétitif même avec des modèles à plus grande échelle

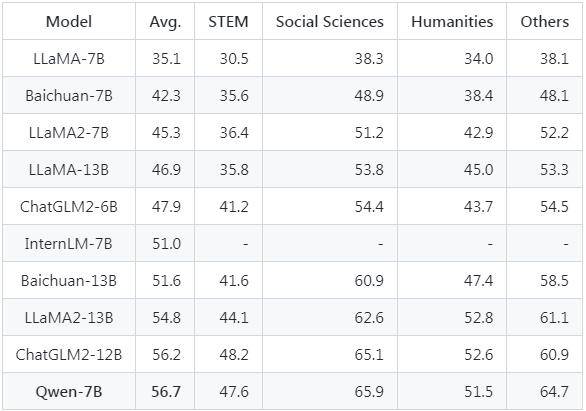

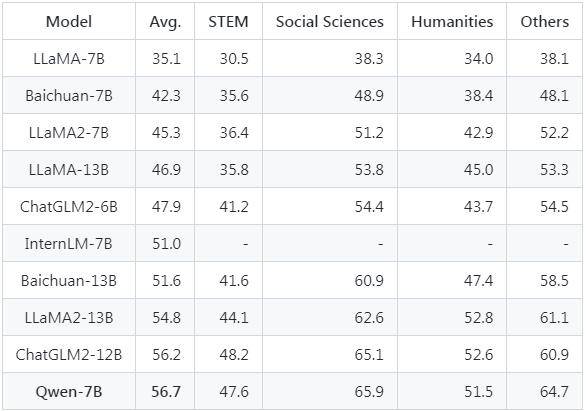

Ce qui suit est une comparaison des résultats de précision MMLU à 5 tirs du Qwen-7B

Alibaba Cloud a construit un assistant IA Qwen-7B-Chat basé sur le modèle de base via le mécanisme d'alignement. Il s'agit d'un grand modèle linguistique de dialogue chinois et anglais basé sur Transformer, qui a réussi à s'aligner sur la cognition humaine. Ce modèle utilise une variété de données de pré-formation, notamment des textes en ligne, des livres professionnels, des codes, etc., couvrant un large éventail de sujets

La précision zéro du modèle Qwen-7B-Chat sur l'ensemble de validation C-Eval et l'ensemble d'évaluation MMLU dépasse les autres modèles d'alignement similaires

Ce qui suit est une comparaison des résultats de précision du tir zéro sur l'ensemble de test C-Eval

Alibaba Cloud est devenue la première grande entreprise technologique en Chine à rejoindre les rangs des grands modèles open source, en juillet de cette année, elle a publié conjointement une version commerciale du modèle d'IA open source Llama 2 avec Meta, qui peut remplacer OpenAI et les modèles de Google. . En outre, Zhipu AI et Tsinghua KEG Laboratory ont également annoncé le meilleur grand modèle open source de Chine en juillet

L'avantage des modèles open source est d'augmenter l'acceptation des utilisateurs et de fournir plus de données pour le traitement de l'intelligence artificielle. Plus le volume de données de LLM est important, plus sa fonction est puissante. De plus, le modèle open source aide les chercheurs et les développeurs à découvrir et à résoudre les vulnérabilités, améliorant ainsi la technologie et les niveaux de sécurité

Lors de l'Alibaba Cloud Summit en avril 2023, Alibaba a annoncé l'ouverture de Tongyi Qianwen aux entreprises, permettant aux entreprises d'utiliser les capacités de Tongyi Qianwen pour former leurs propres grands modèles

Zhou Jingren, directeur de la technologie (CTO) d'Alibaba Cloud Intelligence Group, a déclaré qu'à l'avenir, les entreprises pourront tirer pleinement parti des capacités Tongyi Qianwen d'Alibaba Cloud et combiner leurs propres connaissances du secteur et leurs propres scénarios d'application pour former de grands modèles d'entreprise personnalisés. Par exemple, chaque entreprise peut disposer de son propre service client intelligent, de son guide d'achat intelligent, de son assistant vocal intelligent, de son assistant de rédaction, de son concepteur d'IA, de son modèle de conduite autonome et d'autres fonctions

Zhang Yong, PDG du groupe Alibaba et PDG d'Alibaba Cloud Intelligence Group, a déclaré que tous les produits Alibaba seront intégrés au grand modèle Tongyi Qianwen

Alibaba Cloud espère aider davantage d'entreprises à utiliser de grands modèles pour s'adapter aux besoins de l'ère de l'IA, afin que chaque entreprise puisse disposer de son propre grand modèle exclusif de capacités industrielles et le reconstruire sur la base de Tongyi Qianwen

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Alibaba Cloud a annoncé que la conférence Yunqi 2024 se tiendra à Hangzhou du 19 au 21 septembre. Application gratuite pour des billets gratuits.

Aug 07, 2024 pm 07:12 PM

Alibaba Cloud a annoncé que la conférence Yunqi 2024 se tiendra à Hangzhou du 19 au 21 septembre. Application gratuite pour des billets gratuits.

Aug 07, 2024 pm 07:12 PM

Selon les informations de ce site Web du 5 août, Alibaba Cloud a annoncé que la conférence Yunqi 2024 se tiendrait dans la ville de Yunqi, à Hangzhou, du 19 au 21 septembre. Il y aura un forum principal de trois jours, 400 sous-forums et sujets parallèles. ainsi que près de quatre Dix mille mètres carrés de surface d'exposition. La conférence Yunqi est gratuite et ouverte au public. Désormais, le public peut demander des billets gratuits via le site officiel de la conférence Yunqi. Un billet forfait de 5 000 yuans peut être acheté. Le site Web des billets est joint sur ce site Web. https://yunqi.aliyun.com/2024/ticket-list Selon certaines informations, la conférence Yunqi a débuté en 2009 et a été initialement nommée le premier forum de développement de sites Web en Chine en 2011, elle est devenue la conférence des développeurs Alibaba Cloud en 2015. , elle a été officiellement rebaptisée « Conférence Yunqi » et a continué à progresser avec succès

L'application de grands modèles Tencent Yuanbao est en ligne ! Hunyuan est mis à niveau pour créer un assistant IA complet pouvant être transporté n'importe où

Jun 09, 2024 pm 10:38 PM

L'application de grands modèles Tencent Yuanbao est en ligne ! Hunyuan est mis à niveau pour créer un assistant IA complet pouvant être transporté n'importe où

Jun 09, 2024 pm 10:38 PM

Le 30 mai, Tencent a annoncé une mise à niveau complète de son modèle Hunyuan. L'application « Tencent Yuanbao » basée sur le modèle Hunyuan a été officiellement lancée et peut être téléchargée sur les magasins d'applications Apple et Android. Par rapport à la version de l'applet Hunyuan lors de la phase de test précédente, Tencent Yuanbao fournit des fonctionnalités de base telles que la recherche IA, le résumé IA et l'écriture IA pour les scénarios d'efficacité du travail ; pour les scénarios de la vie quotidienne, le gameplay de Yuanbao est également plus riche et fournit de multiples fonctionnalités d'application IA. , et de nouvelles méthodes de jeu telles que la création d'agents personnels sont ajoutées. « Tencent ne s'efforcera pas d'être le premier à créer un grand modèle. » Liu Yuhong, vice-président de Tencent Cloud et responsable du grand modèle Tencent Hunyuan, a déclaré : « Au cours de l'année écoulée, nous avons continué à promouvoir les capacités de Tencent. Grand modèle Tencent Hunyuan. Dans la technologie polonaise riche et massive dans des scénarios commerciaux tout en obtenant un aperçu des besoins réels des utilisateurs.

Lancement du grand modèle Bytedance Beanbao, le service d'IA complet Volcano Engine aide les entreprises à se transformer intelligemment

Jun 05, 2024 pm 07:59 PM

Lancement du grand modèle Bytedance Beanbao, le service d'IA complet Volcano Engine aide les entreprises à se transformer intelligemment

Jun 05, 2024 pm 07:59 PM

Tan Dai, président de Volcano Engine, a déclaré que les entreprises qui souhaitent bien mettre en œuvre de grands modèles sont confrontées à trois défis clés : l'effet de modèle, le coût d'inférence et la difficulté de mise en œuvre : elles doivent disposer d'un bon support de base de grands modèles pour résoudre des problèmes complexes, et elles doivent également avoir une inférence à faible coût. Les services permettent d'utiliser largement de grands modèles, et davantage d'outils, de plates-formes et d'applications sont nécessaires pour aider les entreprises à mettre en œuvre des scénarios. ——Tan Dai, président de Huoshan Engine 01. Le grand modèle de pouf fait ses débuts et est largement utilisé. Le polissage de l'effet de modèle est le défi le plus critique pour la mise en œuvre de l'IA. Tan Dai a souligné que ce n'est que grâce à une utilisation intensive qu'un bon modèle peut être poli. Actuellement, le modèle Doubao traite 120 milliards de jetons de texte et génère 30 millions d'images chaque jour. Afin d'aider les entreprises à mettre en œuvre des scénarios de modèles à grande échelle, le modèle à grande échelle beanbao développé indépendamment par ByteDance sera lancé à travers le volcan.

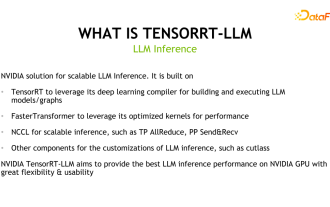

Découverte du framework d'inférence de grands modèles NVIDIA : TensorRT-LLM

Feb 01, 2024 pm 05:24 PM

Découverte du framework d'inférence de grands modèles NVIDIA : TensorRT-LLM

Feb 01, 2024 pm 05:24 PM

1. Positionnement du produit TensorRT-LLM TensorRT-LLM est une solution d'inférence évolutive développée par NVIDIA pour les grands modèles de langage (LLM). Il crée, compile et exécute des graphiques de calcul basés sur le cadre de compilation d'apprentissage en profondeur TensorRT et s'appuie sur l'implémentation efficace des noyaux dans FastTransformer. De plus, il utilise NCCL pour la communication entre les appareils. Les développeurs peuvent personnaliser les opérateurs pour répondre à des besoins spécifiques en fonction du développement technologique et des différences de demande, comme le développement de GEMM personnalisés basés sur le coutelas. TensorRT-LLM est la solution d'inférence officielle de NVIDIA, engagée à fournir des performances élevées et à améliorer continuellement sa praticité. TensorRT-LL

Référence GPT-4 ! Le grand modèle Jiutian de China Mobile a passé le double enregistrement

Apr 04, 2024 am 09:31 AM

Référence GPT-4 ! Le grand modèle Jiutian de China Mobile a passé le double enregistrement

Apr 04, 2024 am 09:31 AM

Selon des informations du 4 avril, l'Administration du cyberespace de Chine a récemment publié une liste de grands modèles enregistrés, et le « Grand modèle d'interaction du langage naturel Jiutian » de China Mobile y a été inclus, indiquant que le grand modèle Jiutian AI de China Mobile peut officiellement fournir des informations artificielles génératives. services de renseignement vers le monde extérieur. China Mobile a déclaré qu'il s'agit du premier modèle à grande échelle développé par une entreprise centrale à avoir réussi à la fois le double enregistrement national « Enregistrement du service d'intelligence artificielle générative » et le double enregistrement « Enregistrement de l'algorithme de service de synthèse profonde domestique ». Selon les rapports, le grand modèle d'interaction en langage naturel de Jiutian présente les caractéristiques de capacités, de sécurité et de crédibilité améliorées de l'industrie, et prend en charge la localisation complète. Il a formé plusieurs versions de paramètres telles que 9 milliards, 13,9 milliards, 57 milliards et 100 milliards. et peut être déployé de manière flexible dans le Cloud, la périphérie et la fin sont des situations différentes

Pratique avancée du graphe de connaissances industrielles

Jun 13, 2024 am 11:59 AM

Pratique avancée du graphe de connaissances industrielles

Jun 13, 2024 am 11:59 AM

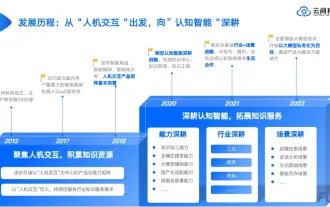

1. Introduction au contexte Tout d’abord, présentons l’historique du développement de la technologie Yunwen. Yunwen Technology Company... 2023 est la période où les grands modèles prédominent. De nombreuses entreprises pensent que l'importance des graphiques a été considérablement réduite après les grands modèles et que les systèmes d'information prédéfinis étudiés précédemment ne sont plus importants. Cependant, avec la promotion du RAG et la prévalence de la gouvernance des données, nous avons constaté qu'une gouvernance des données plus efficace et des données de haute qualité sont des conditions préalables importantes pour améliorer l'efficacité des grands modèles privatisés. Par conséquent, de plus en plus d'entreprises commencent à y prêter attention. au contenu lié à la construction des connaissances. Cela favorise également la construction et le traitement des connaissances à un niveau supérieur, où de nombreuses techniques et méthodes peuvent être explorées. On voit que l'émergence d'une nouvelle technologie ne détruit pas toutes les anciennes technologies, mais peut également intégrer des technologies nouvelles et anciennes.

Nouveau benchmark de test publié, le Llama 3 open source le plus puissant est gêné

Apr 23, 2024 pm 12:13 PM

Nouveau benchmark de test publié, le Llama 3 open source le plus puissant est gêné

Apr 23, 2024 pm 12:13 PM

Si les questions du test sont trop simples, les meilleurs étudiants et les mauvais étudiants peuvent obtenir 90 points, et l'écart ne peut pas être creusé... Avec la sortie plus tard de modèles plus puissants tels que Claude3, Llama3 et même GPT-5, l'industrie est en besoin urgent d'un modèle de référence plus difficile et différencié. LMSYS, l'organisation à l'origine du grand modèle Arena, a lancé la référence de nouvelle génération, Arena-Hard, qui a attiré une large attention. Il existe également la dernière référence pour la force des deux versions affinées des instructions Llama3. Par rapport à MTBench, qui avait des scores similaires auparavant, la discrimination Arena-Hard est passée de 22,6 % à 87,4 %, ce qui est plus fort et plus faible en un coup d'œil. Arena-Hard est construit à partir de données humaines en temps réel provenant de l'arène et a un taux de cohérence de 89,1 % avec les préférences humaines.

Xiaomi Byte unit ses forces ! Un grand modèle de l'accès de Xiao Ai à Doubao : déjà installé sur les téléphones mobiles et SU7

Jun 13, 2024 pm 05:11 PM

Xiaomi Byte unit ses forces ! Un grand modèle de l'accès de Xiao Ai à Doubao : déjà installé sur les téléphones mobiles et SU7

Jun 13, 2024 pm 05:11 PM

Selon les informations du 13 juin, selon le compte public « Volcano Engine » de Byte, l'assistant d'intelligence artificielle de Xiaomi « Xiao Ai » a conclu une coopération avec Volcano Engine. Les deux parties réaliseront une expérience interactive d'IA plus intelligente basée sur le grand modèle beanbao. . Il est rapporté que le modèle beanbao à grande échelle créé par ByteDance peut traiter efficacement jusqu'à 120 milliards de jetons de texte et générer 30 millions de contenus chaque jour. Xiaomi a utilisé le grand modèle Doubao pour améliorer les capacités d'apprentissage et de raisonnement de son propre modèle et créer un nouveau « Xiao Ai Classmate », qui non seulement saisit plus précisément les besoins des utilisateurs, mais offre également une vitesse de réponse plus rapide et des services de contenu plus complets. Par exemple, lorsqu'un utilisateur pose une question sur un concept scientifique complexe, &ldq