L'intelligence artificielle est entrée dans l'ère des grands modèles, ce qui changera complètement le modèle de mise en œuvre de l'IA dans diverses industries, et mettra également en avant de nouvelles exigences en matière de compétences en IA pour les R&D et les praticiens techniques de diverses industries.

Afin de contribuer à la mise à niveau de la technologie des grands modèles, nous avons organisé un événement intitulé "Llama 2 Large Model Algorithm and Application Practice". Ce forum sur la technologie de l'IA s'est terminé avec succès. Le jour de l'événement, la salle multifonctionnelle située au deuxième étage de la tour B du centre Wangjing Pohang à Pékin était remplie de 200 participants venus de plus de dix villes du pays. Sous la direction de quatre experts en technologie des grands modèles, nous avons systématiquement étudié la technologie sous-jacente des grands modèles de Llama 2 et construit personnellement notre propre grand modèle exclusif. Ensemble, nous avons complété efficacement la mise à niveau de la technologie des grands modèles

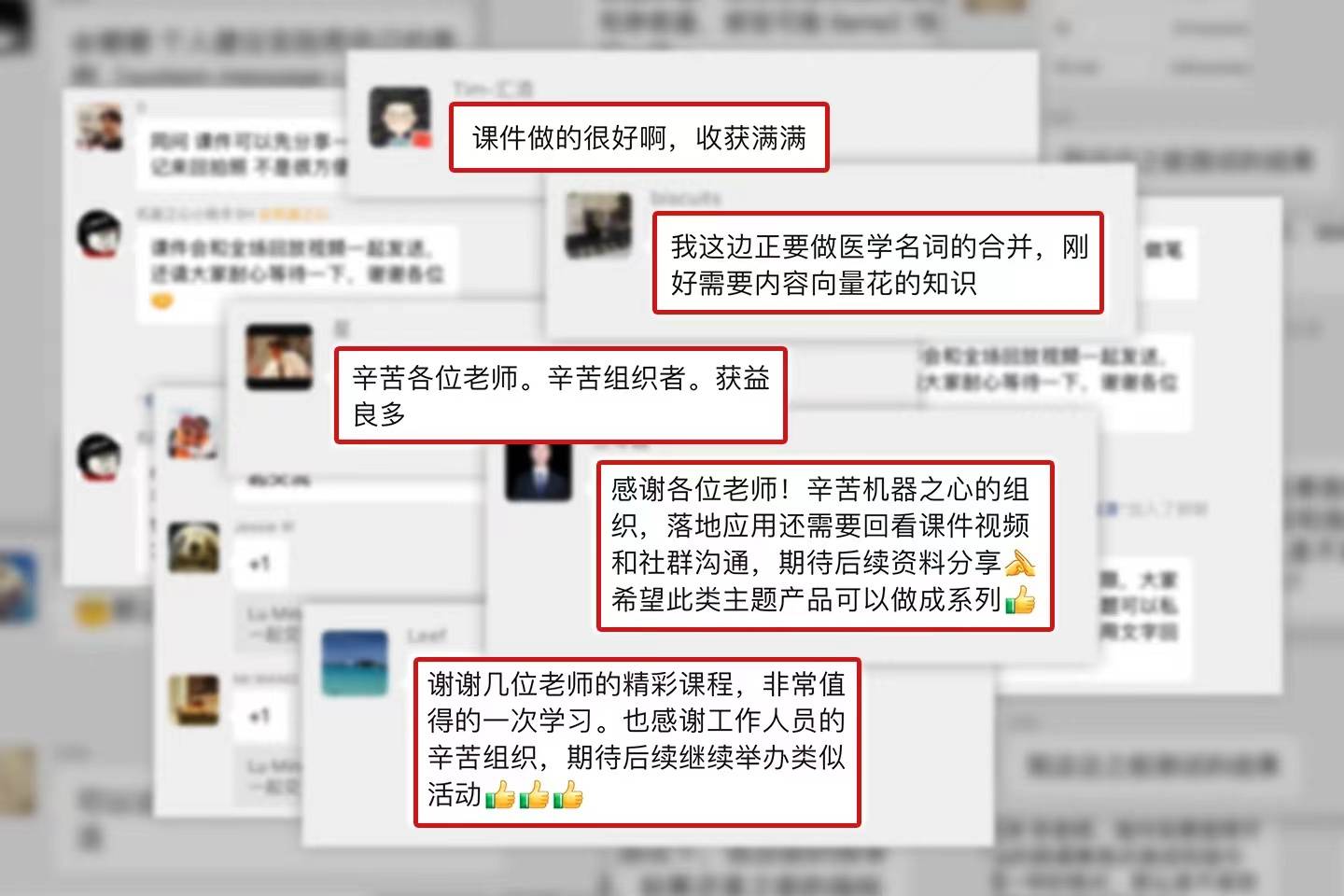

Le contenu était de grande qualité, dépassant les attentes, les explications étaient merveilleuses et approfondies, les échanges de questions/réponses sur place étaient éclairants et le service était complet et attentionné... Les participants ont donné l'événement. ont fait l'objet d'éloges généralisés et ont exprimé leur désir de niveaux de richesse plus élevés et d'attentes de contenu plus approfondies pour les activités techniques.

De plus, en raison de la distance de la ville, des horaires de déplacement et d'autres raisons, de nombreux amis intéressés par l'événement n'ont malheureusement pas pu venir sur place. Afin de répondre aux besoins d'apprentissage et de pratique de chacun, la station de connaissances officielle de ce site (https://vtizr.xet.tech/s/1GOWfs) est désormais en ligne avec la vidéo en direct de ce forum. L'ensemble complet de vidéos est au prix de 699 yuans (après un achat réussi, veuillez ajouter l'ID d'assistant de ce site Web : 13661489516 pour obtenir le package de matériel d'apprentissage pré et post-conférence). Achetez le cours maintenant et commencez votre parcours de mise à niveau de la technologie des grands modèles !

Explication systématique : les derniers progrès technologiques et les cas d'application de pointe

Liu Pengfei, professeur agrégé à l'Institut de recherche Qingyuan de l'Université Jiao Tong de Shanghai et chef du Groupe de recherche sur l'intelligence artificielle générative (GAIR)

"Former le modèle Il doit être suffisamment approfondi, et de très bonnes performances peuvent être obtenues dans un modèle relativement petit." Liu Pengfei, le premier intervenant, se concentre sur les domaines de recherche tels que la pré-formation, la génération et l'évaluation du langage naturel.

Llama 2 est le modèle de langage pré-entraîné avec le plus haut degré d'originalité, les détails techniques de formation les plus transparents et la meilleure réputation sur le marché, et a une valeur de recherche extrêmement élevée. Cette fois, Liu Pengfei a choisi « Interprétation technique du grand modèle Llama 2 » comme thème. En partant du contexte de la naissance de LLaMA, des concepts importants, de la technologie de formation de Llama 2 et de la technologie d'alignement, Liu Pengfei a profondément interprété les détails de la pile technologique impliquée. dans Llama 2 et sa version Chat. Il a également partagé son expérience pratique d'optimisation, y compris des détails techniques tels que la pondération des sources de données et le suréchantillonnage, et a discuté des difficultés liées au développement de grands modèles

Ancienne technologie PNL de Liu Shuo publique. auteur du compte et passionné d'open source Liu Huanyong

Réécrit : Le modèle de base a des exigences très élevées en matière de puissance de calcul et d'algorithmes. Par conséquent, dans davantage d'applications industrielles, il est choisi de construire de grands modèles industriels basés sur le modèle de base et de subdiviser davantage les domaines. . Le président Liu Huanyong a déclaré : « Basé sur le modèle de la grande industrie, le modèle de base contient moins de données de champ vertical, ce qui est sujet aux hallucinations et l'effet est insatisfaisant. » Bien que Llama ne soit pas le meilleur choix pour le marché chinois, car c'est le meilleur choix. premier à être open source et peut Pour un usage commercial, les riches cas de mise en œuvre de l'industrie accumulés sont très précieux

Il a partagé la comparaison du modèle de la série Llama avec d'autres modèles open source et son mécanisme de Chineseisation sous le titre "Interprétation des paradigmes pratiques et Cas de mise en œuvre industrielle basée sur le modèle open source de la série Llama". Interprétation du cas du modèle de réglage fin de domaine basé sur le modèle de la série Llama et du cas de mise en œuvre de "basé sur le modèle de la série LLama + amélioration de la base de connaissances". Il résume les conditions de puissance de calcul, les exigences en matière de quantité et de qualité des données, le retour sur investissement, les scénarios et d'autres conditions nécessaires pour l'ajustement fin des modèles industriels dans les domaines industriels. Il souligne que la forme de mise en œuvre de modèles à grande échelle dans l'industrie peut être des données hétérogènes multi-sources. analyse intelligente des documents, spécification de la base de connaissances.

Shi Yemin, PDG de LinkSoul.AI et initiateur du projet Chinese Llama 2 7B

Shi Yemin, PDG de LinkSoul.AI et initiateur du projet Chinese Llama 2 7B

Avec le développement de la technologie des grands modèles, les grands modèles multimodaux sont de plus en plus devenus la clé de l'intelligence incarnée et d'une meilleure expérience utilisateur, et deviendra sûrement un élément clé de la technologie d’intelligence artificielle de nouvelle génération. La transformation basée sur le LLM est actuellement l'une des meilleures solutions de modèle multimodal et présente une grande valeur en matière de recherche et pratique.

Shi Yemin a parlé du thème « Technologie et pratique des grands modèles multimodaux basés sur Llama 2 », a partagé les modes et principes des modèles multimodaux et a discuté en profondeur des grands modèles multimodaux visuels et des pratiques d'amélioration de la multimodalité vocale pour les grands modèles. Il a mentionné comment les anciens modèles peuvent prendre en charge de nouvelles modalités et quels sont les points importants à noter lors de l'examen de nouvelles capacités. En outre, il a également présenté plusieurs solutions pour l'amélioration multimodale et a souligné les points auxquels il faut prêter attention dans les détails de la formation. Shi Yemin estime que le plus grand défi des modèles multimodaux réside dans les données. Il a partagé quelques méthodes et chemins pour générer des images ou des données graphiques basées sur des modèles

L'évangéliste chinois des modèles à grande échelle, Su Yang, est un contributeur de Llama 2 7B

.Dans l'enquête de cet événement, le contenu des applications industrielles auquel les participants ont accordé le plus d'attention était « la quantification et le réglage fin ». Dans son partage, Su Yang a présenté le contenu spécial de « La quantification du modèle open source Llama 2 et la pratique de réglage fin à faible coût », y compris l'état actuel de l'écologie du modèle open source et de l'écologie Llama, les solutions traditionnelles de quantification et de réglage fin, et la facilité de ces deux choses

"Pour le réglage fin, il est recommandé d'utiliser la solution Sota partagée par l'industrie open source, plutôt que de rechercher aveuglément l'originalité." Il a souligné que la quantification et le réglage fin sont relativement pratiques sur la base de suivant divers principes. Le processus de quantification du modèle actuel n'est pas un processus simple et universel. Il existe de nombreuses dimensions et paramètres. La quantification ou la transformation la plus raisonnable doit également être effectuée au niveau de chaque couche et colonne. environnement de formation, environnement matériel et système de base, Su Yang a donné une explication détaillée à ce sujet.

Après une interprétation technique détaillée et une analyse de cas, Shi Yemin et Su Yang ont amené les participants sur place à se lancer dans la formation, la quantification et la mise au point de grands modèles.

Shi Yemin s'est concentré sur la sélection de modèles de base, les compétences de formation et l'expérience, comprenant deux parcours : une formation à partir de zéro basée sur un modèle de base et une formation d'expansion du vocabulaire basée sur des modèles open source, ainsi que l'architecture correspondante, la taille du modèle, si elle peut être commercialisé et s'il peut élargir le vocabulaire. Filtrer les conditions telles que les tableaux et répondre aux questions connexes telles que les ensembles de données SFT.

Su Yang a conduit les participants sur place à effectuer une série d'opérations, notamment le déploiement d'images, le chargement de modèles, le chargement d'ensembles de données, la définition des paramètres QLoRA, la configuration des paramètres SFT, l'utilisation du package de paramètres du transformateur, etc. Un grand modèle privé a été mis au point avec succès, ce qui a aidé les participants à mieux absorber le contenu de cet événement.

À l'avenir, nous continuerons à prêter attention et à suivre les derniers développements de l'industrie et les besoins des développeurs, et continuer à organiser des activités techniques à grande échelle de haute qualité pour aider les développeurs à améliorer rapidement leurs pratiques d'ingénierie et leurs capacités d'application innovantes, et à se préparer à l'ère des grands modèles. Bienvenue à tous pour continuer à prêter attention à nos activités de forum sur la technologie de l'IA

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

tutoriel CSS3

tutoriel CSS3

Plateforme de trading personnelle Bitcoin

Plateforme de trading personnelle Bitcoin

quel fichier est iso

quel fichier est iso

Comment fermer le démarrage sécurisé

Comment fermer le démarrage sécurisé

fonction de la touche prtscr

fonction de la touche prtscr

MySQL change le mot de passe root

MySQL change le mot de passe root

Comment résoudre le problème des 400 requêtes incorrectes lorsque la page Web s'affiche

Comment résoudre le problème des 400 requêtes incorrectes lorsque la page Web s'affiche

À quel point Dimensity 9000 équivaut-il à Snapdragon ?

À quel point Dimensity 9000 équivaut-il à Snapdragon ?