Périphériques technologiques

Périphériques technologiques

IA

IA

Quelle est la source des capacités d'apprentissage contextuel de Transformer ?

Quelle est la source des capacités d'apprentissage contextuel de Transformer ?

Quelle est la source des capacités d'apprentissage contextuel de Transformer ?

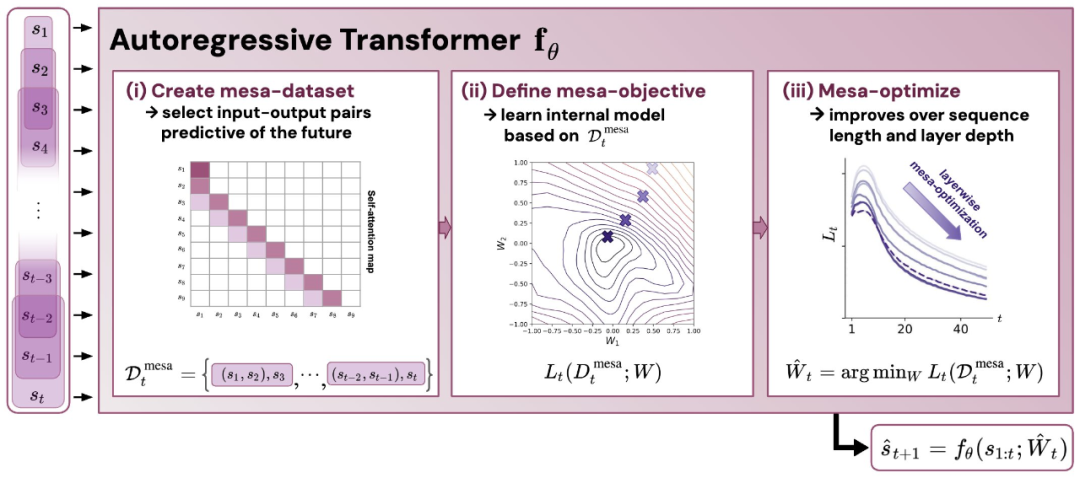

Pourquoi le transformateur fonctionne-t-il si bien ? D'où vient la capacité d'apprentissage en contexte qu'elle apporte à de nombreux grands modèles de langage ? Dans le domaine de l’intelligence artificielle, le transformateur est devenu le modèle dominant en matière d’apprentissage profond, mais les bases théoriques de ses excellentes performances n’ont pas été suffisamment étudiées.

Récemment, des chercheurs de Google AI, de l'ETH Zurich et de Google DeepMind ont mené une nouvelle étude pour tenter de découvrir les secrets de certains algorithmes d'optimisation de Google AI. Dans cette étude, ils ont procédé à une ingénierie inverse du transformateur et trouvé des méthodes d'optimisation. Cet article s'intitule « Révéler l'algorithme d'optimisation Mesa dans Transformer » algorithme d'optimisation auxiliaire basé sur le gradient qui s'exécute dans la passe avant du transformateur. Ce phénomène a récemment été appelé « mésa-optimisation ». En outre, les chercheurs ont découvert que l’algorithme d’optimisation mesa résultant présentait des capacités d’apprentissage contextuel à petite échelle, indépendamment de la taille du modèle. Les nouveaux résultats complètent donc les principes d’apprentissage à petite échelle qui ont émergé précédemment dans les grands modèles de langage.

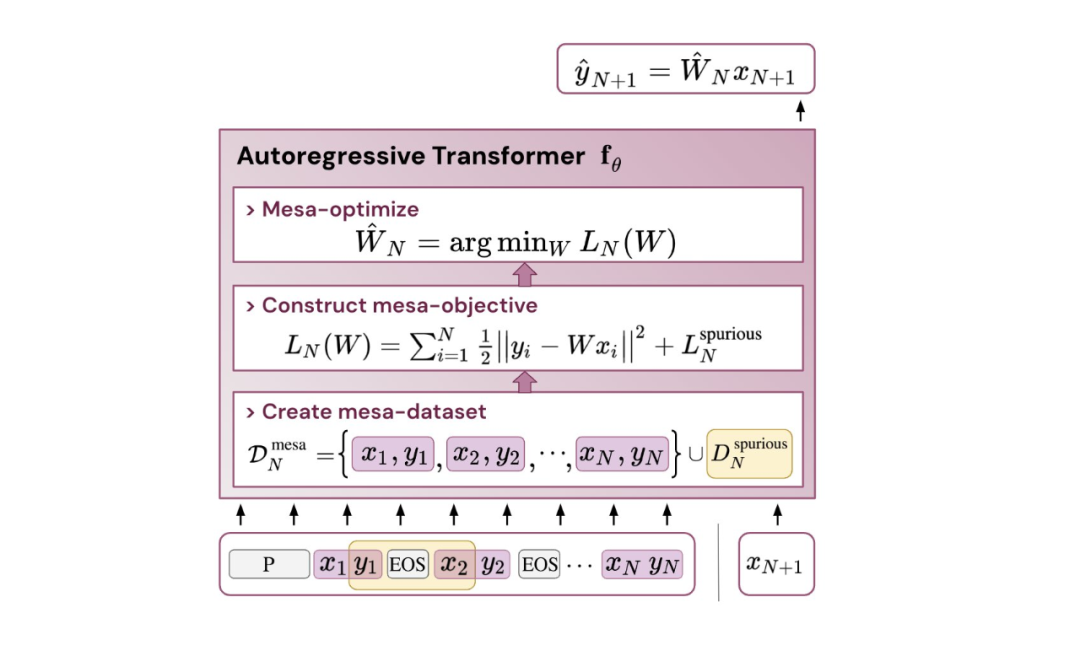

Les chercheurs estiment que le succès de Transformers repose sur le biais architectural de l'algorithme d'optimisation Mesa qu'il implémente dans la passe avant : (i) définir des objectifs d'apprentissage internes, et (ii) les optimiser

Les chercheurs estiment que le succès de Transformers repose sur le biais architectural de l'algorithme d'optimisation Mesa qu'il implémente dans la passe avant : (i) définir des objectifs d'apprentissage internes, et (ii) les optimiser

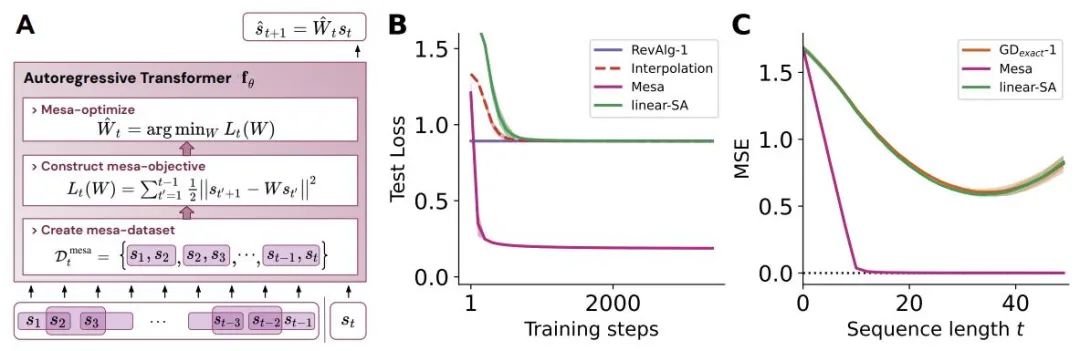

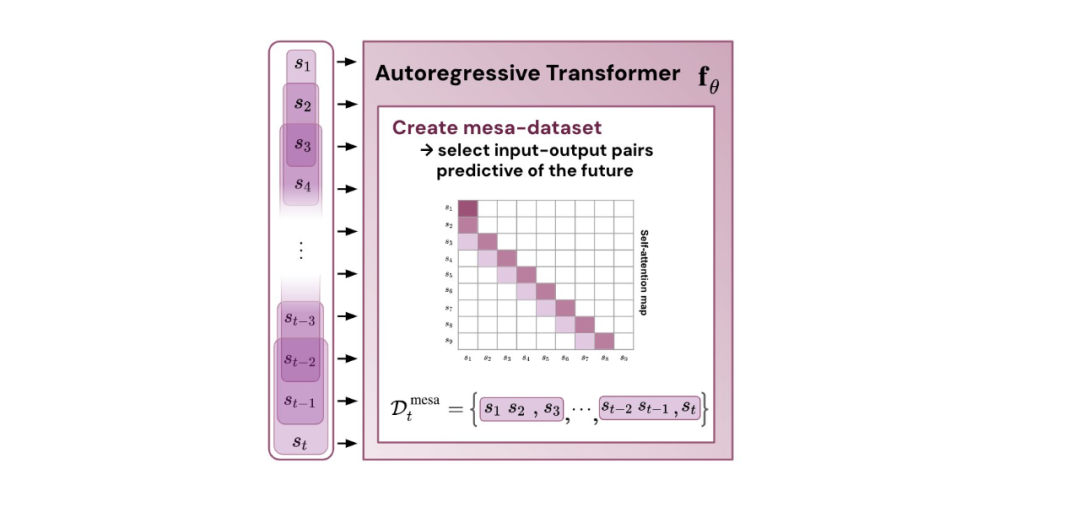

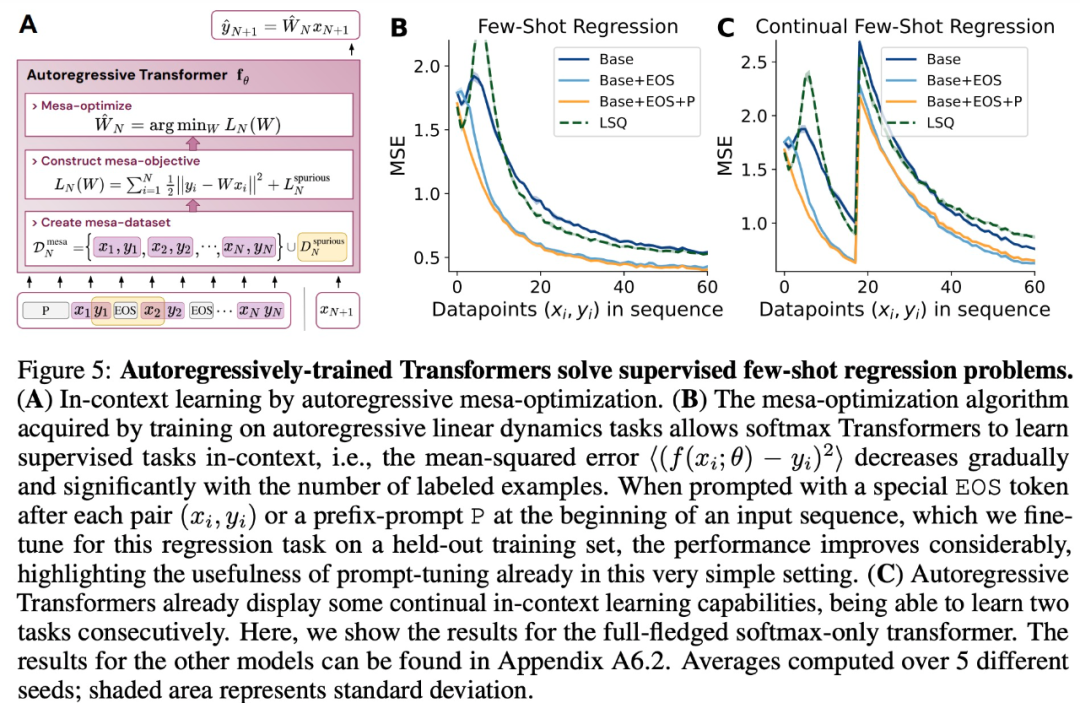

Figure 1 : Illustration de la nouvelle hypothèse : l'optimisation des poids θ du transformateur autorégressif fθ aboutit à un algorithme d'optimisation mesa implémenté dans la propagation vers l'avant du modèle. En tant que séquence d'entrée s_1, . . , s_t est traité au pas de temps t, Transformer (i) crée un ensemble d'entraînement interne composé de paires d'associations entrée-cible, (ii) définit une fonction objectif interne via l'ensemble de données de résultat, qui est utilisé pour mesurer les performances du modèle interne en utilisant les poids W, (iii) Optimiser cet objectif et utiliser le modèle appris pour générer des prédictions futures.

Les contributions de cette étude sont les suivantes :

Généralise la théorie de von Oswald et al et montre comment les Transformers peuvent théoriquement optimiser les objectifs construits en interne à partir de la régression en utilisant des méthodes basées sur le gradient. Prédire l'élément suivant du séquence.

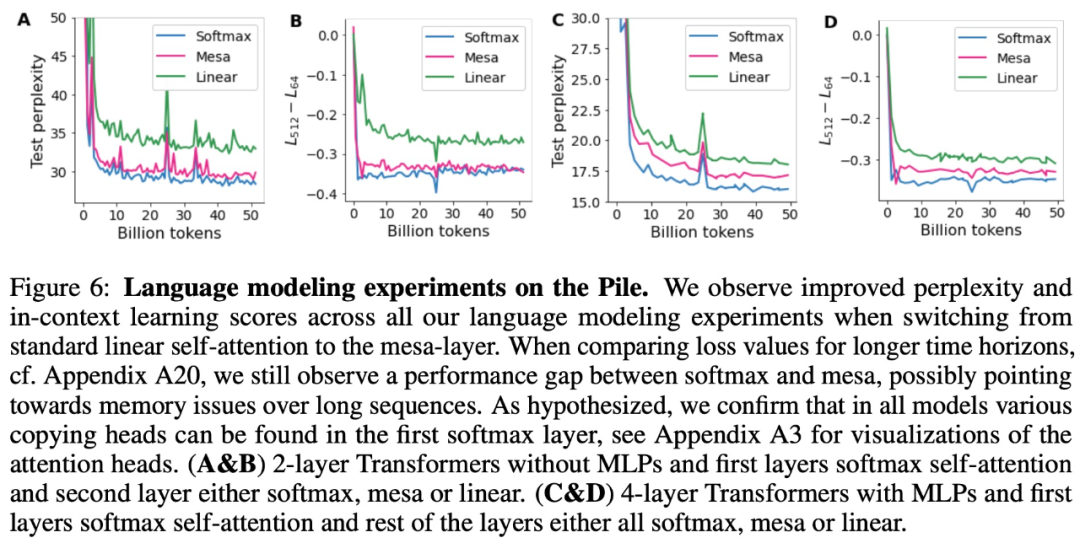

Semblable au LLM, les expériences montrent que de simples modèles de formation autorégressive peuvent également devenir des apprenants contextuels, et les ajustements à la volée sont cruciaux pour améliorer l'apprentissage contextuel du LLM et peuvent également améliorer les performances dans des environnements spécifiques.

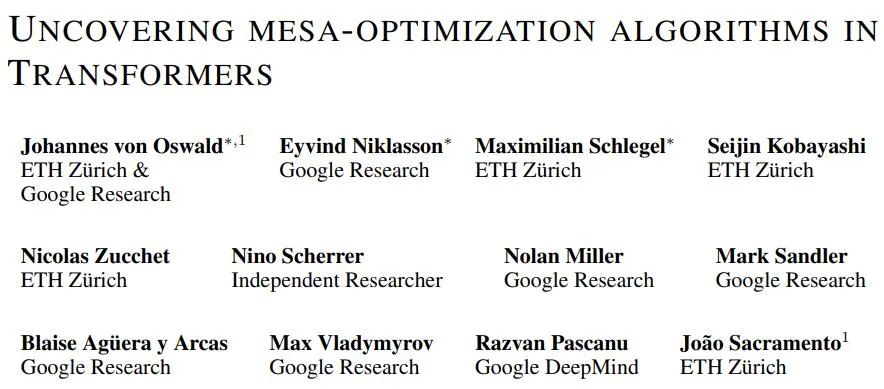

- Inspiré par la découverte selon laquelle les couches d'attention tentent d'optimiser implicitement la fonction objectif interne, l'auteur présente la couche mesa, un nouveau type de couche d'attention qui peut résoudre efficacement le problème d'optimisation des moindres carrés au lieu de simplement prendre une seule étape de gradient. pour atteindre l’optimalité. Les expériences démontrent qu'une seule couche mesa surpasse les transformateurs d'auto-attention linéaires profonds et softmax sur des tâches séquentielles simples tout en offrant plus d'interprétabilité.

- Après des expériences préliminaires de modélisation du langage, il a été constaté que le remplacement de la couche d'auto-attention standard par la couche mesa a donné des résultats prometteurs, prouvant que cette couche possède de fortes capacités d'apprentissage contextuel.

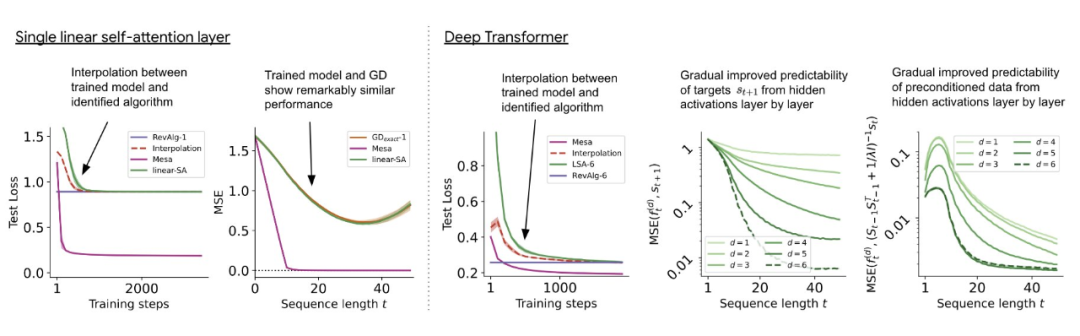

- Tout d'abord, analysez le Transformateur entraîné sur une dynamique linéaire simple. Dans ce cas, chaque séquence est générée par un W* différent pour éviter la mémorisation de séquences croisées. Dans cette configuration simple, les chercheurs montrent comment Transformer crée un ensemble de données mesa et utilise le GD prétraité pour optimiser l'objectif mesa

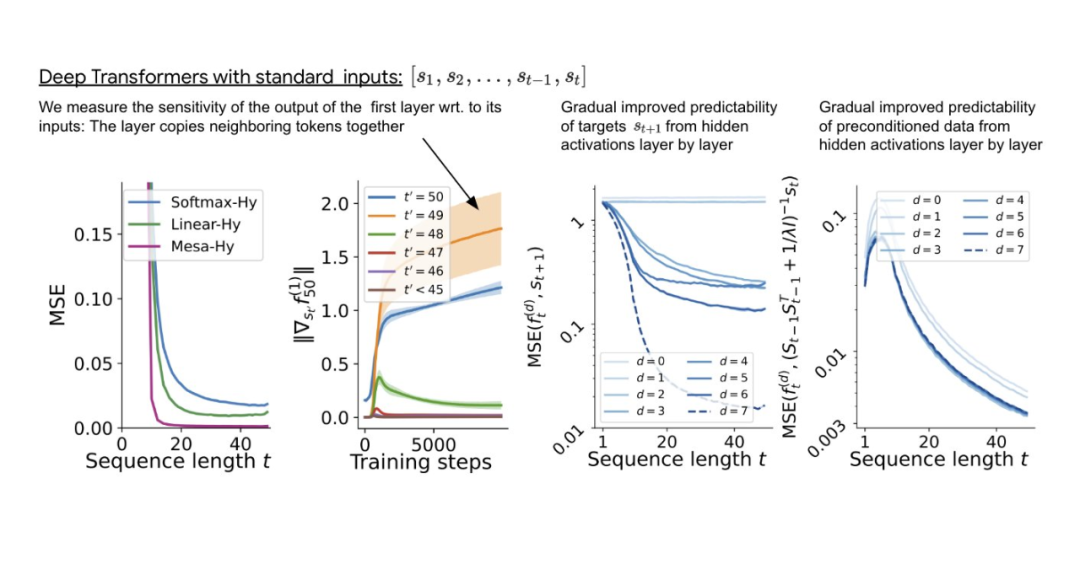

Le contenu réécrit est le suivant : nous pouvons agréger la structure de jetons des éléments de séquence adjacents en entraînant un transformateur profond. Fait intéressant, cette méthode de prétraitement simple aboutit à une matrice de poids très clairsemée (moins de 1 % des poids sont non nuls), ce qui donne lieu à un algorithme d'ingénierie inverse

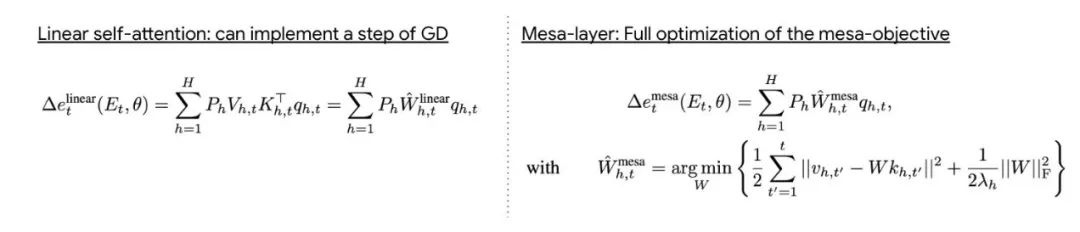

Pour une seule couche d'auto-attention linéaire, le poids Correspond à un pas de descente de gradient. Pour les Transformers profonds, l’interprétabilité devient difficile. L'étude s'appuie sur des sondages linéaires et examine si les activations cachées sont capables de prédire des cibles autorégressives ou des entrées prétraitées.

Fait intéressant, la prévisibilité des deux méthodes de sondage s'améliore progressivement avec l'augmentation de la profondeur du réseau. Cette découverte suggère que le GD prétraité est caché dans le modèle.

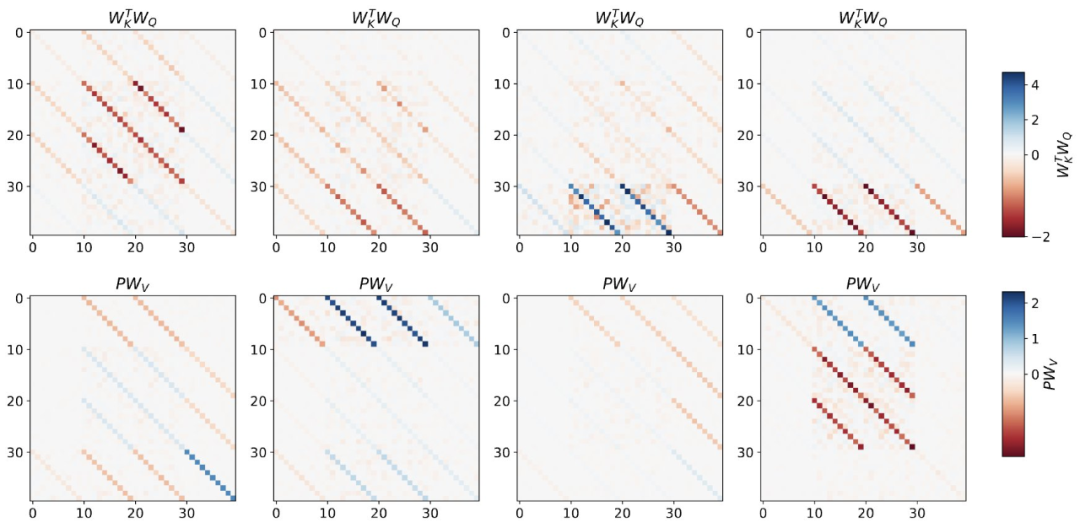

Figure 2 : Ingénierie inverse d'une couche d'auto-attention linéaire entraînée.

L'étude a révélé que la couche d'entraînement peut être parfaitement ajustée lors de l'utilisation de tous les degrés de liberté dans la construction, y compris non seulement le taux d'apprentissage appris η, mais également un ensemble de poids initiaux appris W_0. Il est important de noter que, comme le montre la figure 2, l’algorithme en une étape appris fonctionne toujours bien mieux qu’une seule couche mesa.

Avec un simple réglage du poids, nous pouvons remarquer qu'il est facile de trouver grâce à une optimisation de base que cette couche peut résoudre de manière optimale cette tâche de recherche. Ce résultat prouve que le biais inductif de codage en dur est bénéfique pour l'optimisation mesa

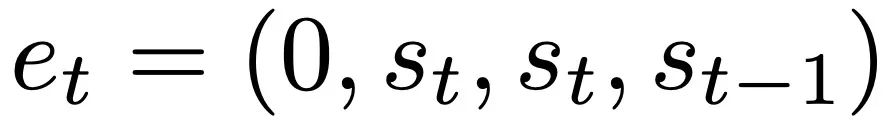

Avec des informations théoriques sur le cas multicouche, analysez d'abord Deep Linear et Softmax et faites attention uniquement à Transformer. Les auteurs formatent l'entrée selon une structure à 4 canaux,

, qui correspond au choix de W_0 = 0.

, qui correspond au choix de W_0 = 0. Comme pour le modèle monocouche, les auteurs voient une structure claire dans les poids du modèle entraîné. Dans le cadre d'une première analyse d'ingénierie inverse, cette étude exploite cette structure et construit un algorithme (RevAlg-d, où d représente le nombre de couches) contenant 16 paramètres par en-tête de couche (au lieu de 3200). Les auteurs ont découvert que cette expression compressée mais complexe peut décrire le modèle entraîné. En particulier, il permet l'interpolation entre les poids Transformer réels et RevAlg-d d'une manière presque sans perte

Bien que l'expression RevAlg-d explique un Transformer multicouche entraîné avec un petit nombre de paramètres libres, il est difficile de le comprendre. L'explication est l'algorithme d'optimisation mesa. Par conséquent, les auteurs ont utilisé une analyse par sondage par régression linéaire (Alain et Bengio, 2017 ; Akyürek et al., 2023) pour trouver les caractéristiques de l’algorithme d’optimisation mesa hypothétique.

Sur le transformateur d'auto-attention linéaire profond illustré à la figure 3, nous pouvons observer que les deux sondes sont capables de décoder linéairement, et à mesure que la longueur de la séquence et la profondeur du réseau augmentent, les performances de décodage augmentent également. Par conséquent, nous avons découvert un algorithme d’optimisation de base qui descend couche par couche sur la base de l’objectif mésa original Lt (W) tout en améliorant le numéro de condition du problème d’optimisation mesa. Cela se traduit par une diminution rapide du Lt (W) du mésa-objectif. De plus, nous pouvons également observer que les performances s'améliorent considérablement à mesure que la profondeur augmente

Avec un meilleur prétraitement des données, la fonction objectif autorégressive Lt (W) peut être optimisée par étapes (sur plusieurs couches), de sorte qu'un déclin rapide peut être envisagé Ceci est réalisé grâce à cette optimisation

Figure 3 : Formation de transformateur multicouche pour l'ingénierie inverse de l'entrée de jeton construite.

Cela montre que si le transformateur est formé sur le jeton construit, il prédira avec l'optimisation mesa. Fait intéressant, lorsque des éléments de séquence sont donnés directement, le transformateur construira lui-même le jeton en regroupant les éléments, ce que l'équipe de recherche appelle « créer l'ensemble de données mesa ».

Conclusion

La découverte de cette étude est que des algorithmes d'inférence basés sur le gradient peuvent être développés lorsqu'ils sont formés à l'aide du modèle Transformer pour des tâches de prédiction de séquence sous des objectifs autorégressifs standard. Par conséquent, les derniers résultats du multitâche et du méta-apprentissage peuvent également être appliqués aux paramètres de formation LLM auto-supervisés traditionnels

De plus, l'étude a également révélé que l'algorithme d'inférence autorégressive appris peut être réajusté sans qu'il soit nécessaire de se recycler. pour résoudre des tâches d'apprentissage contextuel supervisé et ainsi interpréter les résultats dans un cadre unifié

Alors, quel est le rapport avec l'apprentissage contextuel ? Selon l'étude, après avoir entraîné le modèle de transformateur sur la tâche de séquence autorégressive, il obtient une optimisation mesa appropriée et peut donc effectuer un apprentissage contextuel en quelques coups sans aucun réglage fin

L'étude suppose que LLM existe également optimisation mesa, améliorant ainsi ses capacités d'apprentissage contextuel. Il est intéressant de noter que l’étude a également observé qu’une adaptation efficace des invites pour le LLM peut également conduire à des améliorations substantielles des capacités d’apprentissage contextuel.

Les lecteurs intéressés peuvent lire le texte original de l'article pour en savoir plus sur le contenu de la recherche.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Bytedance Cutting lance le super abonnement SVIP : 499 yuans pour un abonnement annuel continu, offrant une variété de fonctions d'IA

Jun 28, 2024 am 03:51 AM

Bytedance Cutting lance le super abonnement SVIP : 499 yuans pour un abonnement annuel continu, offrant une variété de fonctions d'IA

Jun 28, 2024 am 03:51 AM

Ce site a rapporté le 27 juin que Jianying est un logiciel de montage vidéo développé par FaceMeng Technology, une filiale de ByteDance. Il s'appuie sur la plateforme Douyin et produit essentiellement du contenu vidéo court pour les utilisateurs de la plateforme. Il est compatible avec iOS, Android et. Windows, MacOS et autres systèmes d'exploitation. Jianying a officiellement annoncé la mise à niveau de son système d'adhésion et a lancé un nouveau SVIP, qui comprend une variété de technologies noires d'IA, telles que la traduction intelligente, la mise en évidence intelligente, l'emballage intelligent, la synthèse humaine numérique, etc. En termes de prix, les frais mensuels pour le clipping SVIP sont de 79 yuans, les frais annuels sont de 599 yuans (attention sur ce site : équivalent à 49,9 yuans par mois), l'abonnement mensuel continu est de 59 yuans par mois et l'abonnement annuel continu est de 59 yuans par mois. est de 499 yuans par an (équivalent à 41,6 yuans par mois) . En outre, le responsable de Cut a également déclaré que afin d'améliorer l'expérience utilisateur, ceux qui se sont abonnés au VIP d'origine

Assistant de codage d'IA augmenté par le contexte utilisant Rag et Sem-Rag

Jun 10, 2024 am 11:08 AM

Assistant de codage d'IA augmenté par le contexte utilisant Rag et Sem-Rag

Jun 10, 2024 am 11:08 AM

Améliorez la productivité, l’efficacité et la précision des développeurs en intégrant une génération et une mémoire sémantique améliorées par la récupération dans les assistants de codage IA. Traduit de EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG, auteur JanakiramMSV. Bien que les assistants de programmation d'IA de base soient naturellement utiles, ils ne parviennent souvent pas à fournir les suggestions de code les plus pertinentes et les plus correctes, car ils s'appuient sur une compréhension générale du langage logiciel et des modèles d'écriture de logiciels les plus courants. Le code généré par ces assistants de codage est adapté à la résolution des problèmes qu’ils sont chargés de résoudre, mais n’est souvent pas conforme aux normes, conventions et styles de codage des équipes individuelles. Cela aboutit souvent à des suggestions qui doivent être modifiées ou affinées pour que le code soit accepté dans l'application.

Sept questions d'entretien technique Cool GenAI et LLM

Jun 07, 2024 am 10:06 AM

Sept questions d'entretien technique Cool GenAI et LLM

Jun 07, 2024 am 10:06 AM

Pour en savoir plus sur l'AIGC, veuillez visiter : 51CTOAI.x Community https://www.51cto.com/aigc/Translator|Jingyan Reviewer|Chonglou est différent de la banque de questions traditionnelle que l'on peut voir partout sur Internet. nécessite de sortir des sentiers battus. Les grands modèles linguistiques (LLM) sont de plus en plus importants dans les domaines de la science des données, de l'intelligence artificielle générative (GenAI) et de l'intelligence artificielle. Ces algorithmes complexes améliorent les compétences humaines et stimulent l’efficacité et l’innovation dans de nombreux secteurs, devenant ainsi la clé permettant aux entreprises de rester compétitives. LLM a un large éventail d'applications. Il peut être utilisé dans des domaines tels que le traitement du langage naturel, la génération de texte, la reconnaissance vocale et les systèmes de recommandation. En apprenant de grandes quantités de données, LLM est capable de générer du texte

Le réglage fin peut-il vraiment permettre au LLM d'apprendre de nouvelles choses : l'introduction de nouvelles connaissances peut amener le modèle à produire davantage d'hallucinations

Jun 11, 2024 pm 03:57 PM

Le réglage fin peut-il vraiment permettre au LLM d'apprendre de nouvelles choses : l'introduction de nouvelles connaissances peut amener le modèle à produire davantage d'hallucinations

Jun 11, 2024 pm 03:57 PM

Les grands modèles linguistiques (LLM) sont formés sur d'énormes bases de données textuelles, où ils acquièrent de grandes quantités de connaissances du monde réel. Ces connaissances sont intégrées à leurs paramètres et peuvent ensuite être utilisées en cas de besoin. La connaissance de ces modèles est « réifiée » en fin de formation. À la fin de la pré-formation, le modèle arrête effectivement d’apprendre. Alignez ou affinez le modèle pour apprendre à exploiter ces connaissances et répondre plus naturellement aux questions des utilisateurs. Mais parfois, la connaissance du modèle ne suffit pas, et bien que le modèle puisse accéder à du contenu externe via RAG, il est considéré comme bénéfique de l'adapter à de nouveaux domaines grâce à un réglage fin. Ce réglage fin est effectué à l'aide de la contribution d'annotateurs humains ou d'autres créations LLM, où le modèle rencontre des connaissances supplémentaires du monde réel et les intègre.

Afin de fournir un nouveau système de référence et d'évaluation de questions-réponses scientifiques et complexes pour les grands modèles, l'UNSW, Argonne, l'Université de Chicago et d'autres institutions ont lancé conjointement le cadre SciQAG.

Jul 25, 2024 am 06:42 AM

Afin de fournir un nouveau système de référence et d'évaluation de questions-réponses scientifiques et complexes pour les grands modèles, l'UNSW, Argonne, l'Université de Chicago et d'autres institutions ont lancé conjointement le cadre SciQAG.

Jul 25, 2024 am 06:42 AM

L'ensemble de données ScienceAI Question Answering (QA) joue un rôle essentiel dans la promotion de la recherche sur le traitement du langage naturel (NLP). Des ensembles de données d'assurance qualité de haute qualité peuvent non seulement être utilisés pour affiner les modèles, mais également évaluer efficacement les capacités des grands modèles linguistiques (LLM), en particulier la capacité à comprendre et à raisonner sur les connaissances scientifiques. Bien qu’il existe actuellement de nombreux ensembles de données scientifiques d’assurance qualité couvrant la médecine, la chimie, la biologie et d’autres domaines, ces ensembles de données présentent encore certaines lacunes. Premièrement, le formulaire de données est relativement simple, et la plupart sont des questions à choix multiples. Elles sont faciles à évaluer, mais limitent la plage de sélection des réponses du modèle et ne peuvent pas tester pleinement la capacité du modèle à répondre aux questions scientifiques. En revanche, les questions et réponses ouvertes

Cinq écoles d'apprentissage automatique que vous ne connaissez pas

Jun 05, 2024 pm 08:51 PM

Cinq écoles d'apprentissage automatique que vous ne connaissez pas

Jun 05, 2024 pm 08:51 PM

L'apprentissage automatique est une branche importante de l'intelligence artificielle qui donne aux ordinateurs la possibilité d'apprendre à partir de données et d'améliorer leurs capacités sans être explicitement programmés. L'apprentissage automatique a un large éventail d'applications dans divers domaines, de la reconnaissance d'images et du traitement du langage naturel aux systèmes de recommandation et à la détection des fraudes, et il change notre façon de vivre. Il existe de nombreuses méthodes et théories différentes dans le domaine de l'apprentissage automatique, parmi lesquelles les cinq méthodes les plus influentes sont appelées les « Cinq écoles d'apprentissage automatique ». Les cinq grandes écoles sont l’école symbolique, l’école connexionniste, l’école évolutionniste, l’école bayésienne et l’école analogique. 1. Le symbolisme, également connu sous le nom de symbolisme, met l'accent sur l'utilisation de symboles pour le raisonnement logique et l'expression des connaissances. Cette école de pensée estime que l'apprentissage est un processus de déduction inversée, à travers les connaissances existantes.

Les startups d'IA ont collectivement transféré leurs emplois vers OpenAI, et l'équipe de sécurité s'est regroupée après le départ d'Ilya !

Jun 08, 2024 pm 01:00 PM

Les startups d'IA ont collectivement transféré leurs emplois vers OpenAI, et l'équipe de sécurité s'est regroupée après le départ d'Ilya !

Jun 08, 2024 pm 01:00 PM

" sept péchés capitaux" » Dissiper les rumeurs : selon des informations divulguées et des documents obtenus par Vox, la haute direction d'OpenAI, y compris Altman, était bien au courant de ces dispositions de récupération de capitaux propres et les a approuvées. De plus, OpenAI est confronté à un problème grave et urgent : la sécurité de l’IA. Les récents départs de cinq employés liés à la sécurité, dont deux de ses employés les plus en vue, et la dissolution de l'équipe « Super Alignment » ont une nouvelle fois mis les enjeux de sécurité d'OpenAI sur le devant de la scène. Le magazine Fortune a rapporté qu'OpenA

Les performances de SOTA, la méthode d'IA de prédiction d'affinité protéine-ligand multimodale de Xiamen, combinent pour la première fois des informations sur la surface moléculaire

Jul 17, 2024 pm 06:37 PM

Les performances de SOTA, la méthode d'IA de prédiction d'affinité protéine-ligand multimodale de Xiamen, combinent pour la première fois des informations sur la surface moléculaire

Jul 17, 2024 pm 06:37 PM

Editeur | KX Dans le domaine de la recherche et du développement de médicaments, il est crucial de prédire avec précision et efficacité l'affinité de liaison des protéines et des ligands pour le criblage et l'optimisation des médicaments. Cependant, les études actuelles ne prennent pas en compte le rôle important des informations sur la surface moléculaire dans les interactions protéine-ligand. Sur cette base, des chercheurs de l'Université de Xiamen ont proposé un nouveau cadre d'extraction de caractéristiques multimodales (MFE), qui combine pour la première fois des informations sur la surface des protéines, la structure et la séquence 3D, et utilise un mécanisme d'attention croisée pour comparer différentes modalités. alignement. Les résultats expérimentaux démontrent que cette méthode atteint des performances de pointe dans la prédiction des affinités de liaison protéine-ligand. De plus, les études d’ablation démontrent l’efficacité et la nécessité des informations sur la surface des protéines et de l’alignement des caractéristiques multimodales dans ce cadre. Les recherches connexes commencent par "S